Nature正刊!复旦科研版凡人修仙传:26岁博士攻克裸眼3D数十年难题,超100°视场角创纪录!

本科就读于郑州大学通信工程专业的马炜杰,因对计算机与人工智能的热爱,大二便主动加入学校服务机器人实验室,如饥似渴地补充专业知识。凭借项目实践中积累的经验,他随团队征战机器人世界杯大赛,多次夺冠并斩获2019年亚太邀请赛冠军,坚定了深耕AI领域的决心。硕士阶段,他在香港中文大学(深圳)精进科研思维与抗压能力,更因赴浙江大学重点实验室访问的契机,在陈昊老师指导下入门三维计算机视觉,点燃了科研热情。硕士

重磅!!北京时间11月27日凌晨,复旦大学计算与智能创新学院26岁的二年级博士研究生马炜杰,以独立第一作者身份在国际顶刊《Nature》正刊上发表研究成果。这项成果横跨三维计算机视觉、计算机图形学与显示光学三大领域,聚焦裸眼3D技术核心痛点,首次在桌面级显示尺寸下实现超宽范围全视差裸眼3D显示,一举打破该领域数十年来“大尺寸”与“宽视角”难以两全的行业僵局。

从电子信息领域跨界人工智能,马炜杰的科研之路颇具“逆袭感”。他曾以《凡人修仙传》中“散修”自喻——并非科班出身的计算机研究者,却凭借主动探索一步步触摸到科研“宗门”的边界。

相关论文代码资料已经整理好,另外我还整理了【CV 热门】80+计算机视觉热门方向论文合集(见文末),感兴趣的自取,希望能帮到你!

介绍下大佬

本科就读于郑州大学通信工程专业的马炜杰,因对计算机与人工智能的热爱,大二便主动加入学校服务机器人实验室,如饥似渴地补充专业知识。凭借项目实践中积累的经验,他随团队征战机器人世界杯大赛,多次夺冠并斩获2019年亚太邀请赛冠军,坚定了深耕AI领域的决心。硕士阶段,他在香港中文大学(深圳)精进科研思维与抗压能力,更因赴浙江大学重点实验室访问的契机,在陈昊老师指导下入门三维计算机视觉,点燃了科研热情。

硕士毕业后,马炜杰加入上海人工智能实验室、复旦大学与上海创智学院的联合培养项目,师从欧阳万里教授与钟翰森研究员。恰逢钟翰森萌生“AI赋能裸眼3D显示”的交叉学科想法,而马炜杰兼具三维视觉基础与探索欲,两人一拍即合。这一课题无太多先例可循,属于“高风险高机遇”的前沿探索,与当下多数团队倾向的短周期课题形成鲜明对比。好在两位导师始终给予支持,鼓励他“专注本质、追求高质量成果”,为他注入攻坚动力。

进组后一年间,马炜杰主动隔绝外界浮躁,每日沉浸实验室专注研究。他曾坦言,高质量科研需要内心平静,才能聚焦问题本质;钟翰森也评价,这份持续数月的全身心投入是突破关键。最终,这位从“跨界散修”起步的科研者,以独立一作身份在Nature发表成果,打破裸眼3D领域数十年瓶颈,用行动证明:坚守科研本质、持之以恒,沿途的挑战终将成为人生的独特风景。

今天,小编来带领大家膜拜下大佬的神作!!原文和代码可自行免费领取噢~~

1. 【导读】

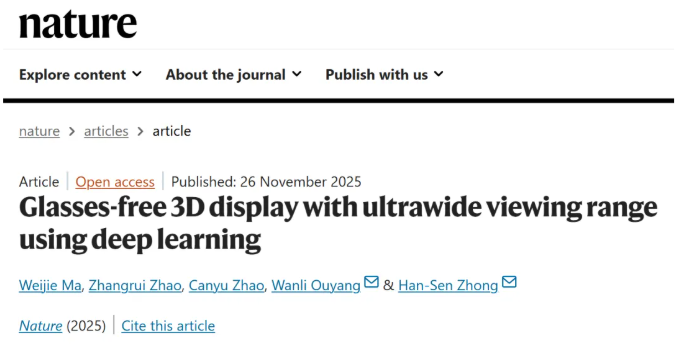

论文标题:Glasses-free 3D display with ultrawide viewing range using deep learning(基于深度学习的超宽视角裸眼3D显示技术)

作者:Weijie Ma、Zhangrui Zhao、Canyu Zhao、Wanli Ouyang、Han-Sen Zhong(通讯作者)

作者机构:1. 复旦大学计算机科学与人工智能学院;2. 上海人工智能实验室;3. 上海创智学院;4. 北京航空航天大学计算机学院;5. 浙江大学计算机科学与技术学院;6. 香港中文大学信息工程学系

论文来源:Nature正刊

论文链接:https://doi.org/10.1038/s41586-025-09752-y

项目链接:https://github.com/WeijieMax/EyeReal

2. 【论文速读】

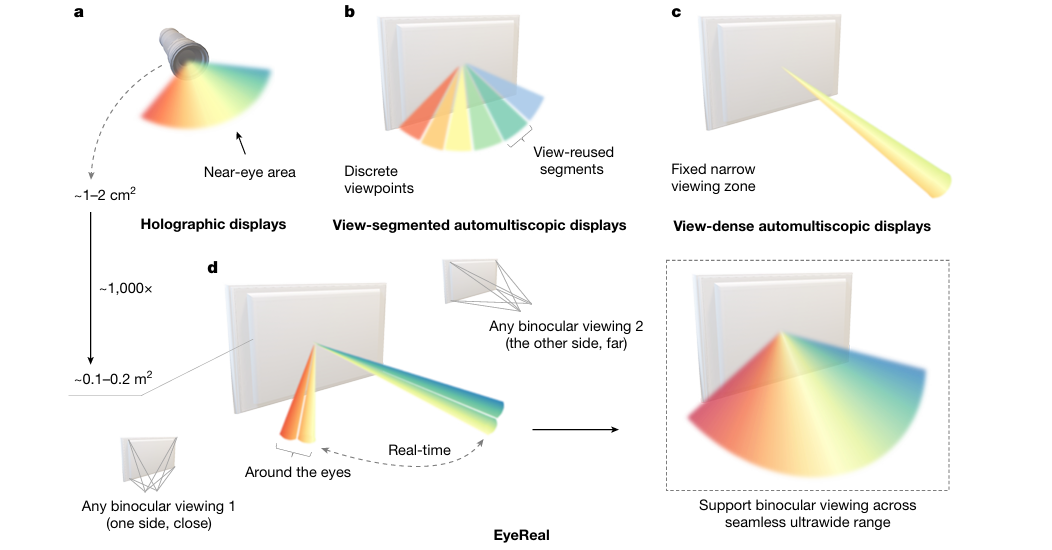

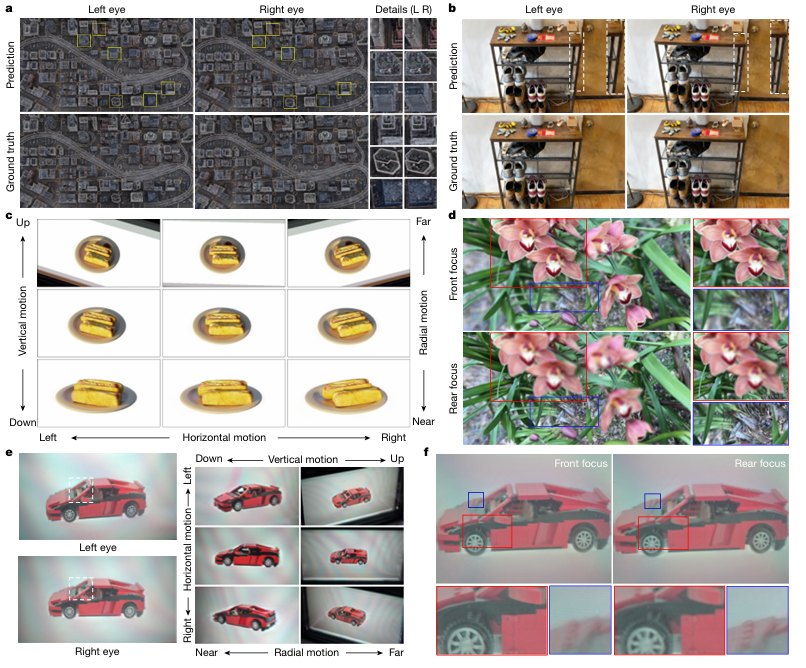

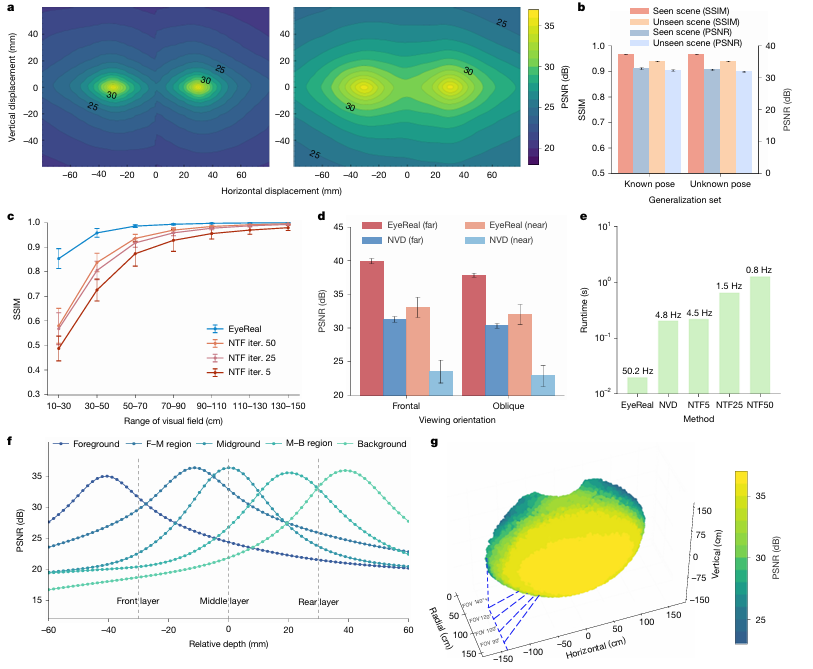

该研究聚焦裸眼3D显示领域长期存在的“大尺寸与宽视角难以兼得”难题,其根源在于光学系统的空间带宽积(SBP) 固有约束——传统全息显示虽能实现宽视角却局限于厘米级尺寸,自动立体显示虽可扩展至桌面级尺寸却牺牲视角连续性,且现有AI增强方案仍未突破SBP限制。研究团队提出名为EyeReal的创新方案,通过精确构建双目视觉物理模型,并结合深度学习实时优化光场生成,首次在桌面级显示尺寸下实现超宽视角(远超100°)的全视差裸眼3D显示;该显示支持50Hz以上刷新率与1920×1080分辨率,基于低成本液晶显示硬件,无需特殊光学组件,还能缓解视差冲突与瞳孔间距不匹配导致的视觉不适,为数字娱乐、智能教育、工业设计等领域的下一代显示应用奠定基础。

3.【裸眼3D的“鱼与熊掌之困”:背景与前序技术探索】

3.1 研究背景

- 裸眼3D的核心价值:裸眼3D显示无需穿戴设备即可提供沉浸式视觉体验,符合“终极显示”愿景(需复现自然光场,兼具宽视角与大成像尺寸),在数字交互、教育、设计等领域潜力巨大。

- 关键技术瓶颈:受限于空间带宽积(SBP) 这一物理约束(光学系统中空间分辨率与角度多样性存在固有耦合,受拉格朗日不变量限制),传统方案无法同时实现“大尺寸”与“宽视角”,成为领域数十年难题。

- 现有方案的局限:即便近年AI技术尝试优化,仍未突破SBP的静态使用框架,难以兼顾显示尺寸、视角范围与视差完整性,无法满足自然观看需求。

3.2 相关工作

- 路径一:全息显示技术

- 优势:可实现精确光场控制,支持宽且连续的3D视角。

- 缺陷:受SBP限制,显示尺寸仅局限于厘米级,需近距离单眼观测,无法适配桌面级等自然观看场景。

- 路径二:自动立体显示技术

- 细分方向1(视图分段型):通过定制光学元件将SBP分散为离散视图,可扩展至桌面级尺寸,但视角存在离散性,且牺牲垂直/径向视差与聚焦视差,易导致视觉不适。

- 细分方向2(视图密集型):将SBP集中于固定窄视区以提升真实感,但视区极窄(观众难以移动),且依赖“平行眼”理想化假设,在近距离或倾斜视角下性能骤降。

- AI增强方案的不足:近年基于深度学习的优化方案,虽能缓解部分架构约束,但仍未跳出传统SBP静态使用框架,无法突破“尺寸-视角”的核心矛盾,且实时性与泛化性不足。

4.【破解SBP困局:EyeReal的动态优化与光场生成双引擎】

4.1 核心突破:动态空间带宽积(SBP)利用范式

传统裸眼3D显示受限于静态SBP使用(试图同时适配所有视角,导致“尺寸-视角”矛盾),本研究提出动态SBP利用方案,核心思路是“按需分配光学资源”,具体包括:

- 突破逻辑:利用人脑视角切换的响应间隔,实时将有限的SBP资源聚合到双眼中心及周边区域,优先保证双眼视觉范围内的光场质量,而非静态覆盖全空间;

- SBP数学表达:根据傅里叶光学理论,SBP描述光学显示系统的信息容量,数学上可表示为 S = N x N y S = N_x N_y S=NxNy(当系统分辨率为 N x × N y N_x × N_y Nx×Ny、显示面积为 L x × L y L_x × L_y Lx×Ly时,简化自原始公式 S = A δ x δ y ⋅ u x , m a x u y , m a x S = \frac{A}{\delta_x \delta_y} \cdot u_{x,max} u_{y,max} S=δxδyA⋅ux,maxuy,max,其中 A A A为面积, δ x / δ y \delta_x/\delta_y δx/δy为像素尺寸, u x , m a x / u y , m a x u_{x,max}/u_{y,max} ux,max/uy,max为奈奎斯特采样定理下的带宽上限);

- 关键矛盾化解:高分辨率成像对应高空间频率,会导致光学信息通量横截面缩小(即视场角FOV变窄),例如24英寸1920×1080显示(SBP约210万)在532nm绿光下的FOV仅约 0.1 ° × 0.1 ° 0.1°×0.1° 0.1°×0.1°;而动态SBP通过“聚焦双眼区域”,在有限SBP下实现宽视角与大尺寸的平衡。

4.2 光场生成的物理基础:双目视觉建模与几何编码

为实现动态SBP的精准分配,研究首先建立双目视觉物理模型,构建光场与双眼的空间对应关系:

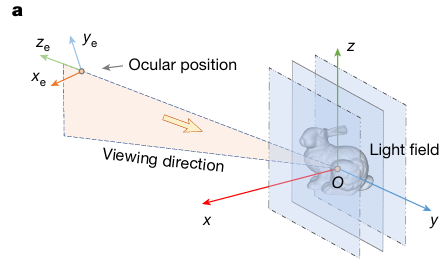

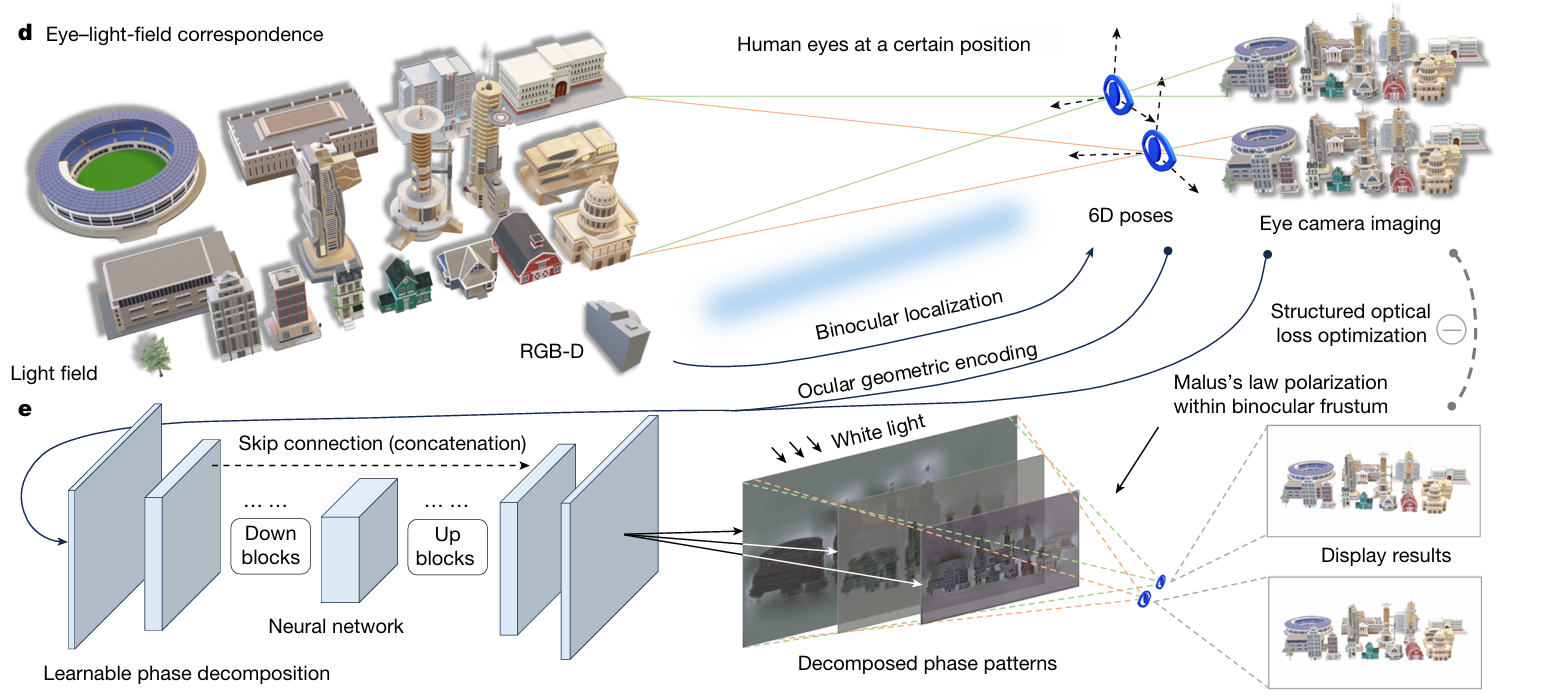

- 双目针孔相机模型:将双眼建模为朝向光场中心、平行于地面的针孔相机(图2a),通过6D位姿矩阵(包含平移与旋转信息),建立光场空间与双目成像平面的透视变换对应,确保光场变化能生成几何一致的双目视差;

- 眼部几何编码(Ocular Geometric Encoding):通过6D眼部位姿引入逆透视变换,将双目图像归一化为几何统一的平面扭曲图(数学细节见补充材料),解决传统模型“视角依赖”问题,使系统具备“任意视角适配”能力;

- 视锥体匹配原则:不同于传统模型假设“平行眼平移视差”,本研究基于真实视觉生理,让光场聚合匹配双眼的视锥体(Frustum Field) ——即由眼球或虚拟相机定义的透视视野体积(Extended Data Fig. 1),确保光场信息与真实双眼感知需求一致。

4.3 光场生成的硬件实现:多层LCD与马吕斯定律调控

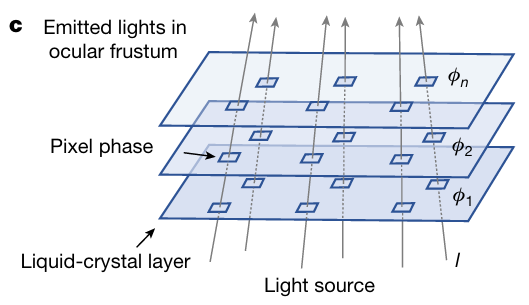

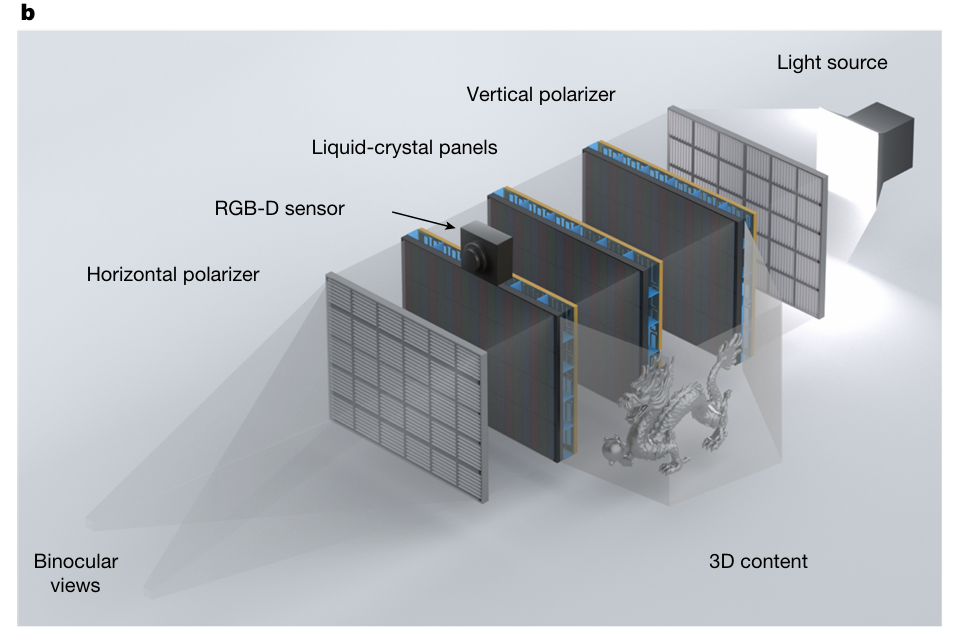

研究设计低成本多层LCD光场传输装置(图2b),无需特殊光学组件(如空间光调制器、透镜阵列),核心是通过相位编码实现高效光场调控:

- 硬件结构:采用堆叠LCD面板(原型用3层),前后分别粘贴正交偏振片,背部配备白光光源;LCD面板含彩色滤光片、液晶层与薄膜晶体管,通过HDMI传输成像信息;

- 光学调制原理:采用相位编码替代传统强度调制(避免乘法衰减导致的光效损失),基于马吕斯定律计算出射光强:

I = I 0 ( l ) ∏ d ∈ D cos 2 ( ϕ d − ϕ n 2 ) I = I_0(l) \prod_{d \in D} \cos^2\left(\frac{\phi_d - \phi_n}{2}\right) I=I0(l)∏d∈Dcos2(2ϕd−ϕn)

其中, I 0 ( l ) I_0(l) I0(l)为背光经后偏振片后的原始光强, l l l为视锥体内的出射光线, D D D为所有深度样本集合, ϕ d \phi_d ϕd为光线 l l l与深度 d d d处光学图案的相交相位, ϕ n \phi_n ϕn为最近平面深度 d k d_k dk的相位; - 硬件参数:原型采用BOE TFT-LCD(分辨率1920×1080,像素间距0.27mm),有效物理成像面积 518.4 m m × 324 m m 518.4mm×324mm 518.4mm×324mm,搭配Microsoft Xbox Kinect V2 RGB-D相机(彩色分辨率1920×1080,深度测量范围0.5-4.5m)实现双目定位。

4.4 光场生成的AI优化:可学习相位分解网络

为实现“实时动态光场生成”,研究设计轻量级全卷积神经网络,完成从双目图像到多层LCD相位图案的分解:

- 网络架构:

- 输入层:接收6通道双目RGB图像(左右眼各3通道);

- 主体结构:5个下采样块(含3×3卷积、最大池化,通道数按 32 × 2 i 32×2^i 32×2i递增, i i i为下采样块索引)+5个上采样块(含3×3卷积、双线性插值),通过跳连接实现多尺度特征融合,避免梯度消失;

- 输出层:输出各LCD层的相位图案,用于光场调制;

- 结构化损失函数(多维度约束相位分解精度):

- 基础 ℓ 1 \ell_1 ℓ1损失(保证光强一致性):

L b a s i c = 1 S k C ∑ p = 1 S k ∑ c = 1 C ∥ ρ p , c ′ − ρ p , c ∥ 1 L_{basic} = \frac{1}{S_k C} \sum_{p=1}^{S_k} \sum_{c=1}^{C} \|\rho'_{p,c} - \rho_{p,c}\|_1 Lbasic=SkC1∑p=1Sk∑c=1C∥ρp,c′−ρp,c∥1

其中, S k S_k Sk为出射横截面面积 F t ∩ d k F_t \cap d_k Ft∩dk, C C C为RGB通道数, ρ ′ \rho' ρ′为预测相位图案的聚合光强, ρ \rho ρ为目标光强; - 互斥损失(抑制双眼视角信息串扰):

L m u t e x = 1 − σ r σ l + ξ σ r l + ξ L_{mutex} = 1 - \frac{\sigma_r \sigma_l + \xi}{\sigma_{rl} + \xi} Lmutex=1−σrl+ξσrσl+ξ

其中, σ r \sigma_r σr、 σ l \sigma_l σl分别为聚合结果与目标图像的方差, σ r l \sigma_{rl} σrl为协方差, ξ = 0.00 3 2 \xi=0.003^2 ξ=0.0032(避免分母为0); - 低频正则化损失(引导早期收敛):

L l o w f r e q = 1 ∣ Φ d ∣ ∑ ϕ ∈ Φ d ∥ ϕ ∥ 1 L_{lowfreq} = \frac{1}{|\Phi_d|} \sum_{\phi \in \Phi_d} \|\phi\|_1 Llowfreq=∣Φd∣1∑ϕ∈Φd∥ϕ∥1

其中, Φ d \Phi_d Φd为当前视锥体 F t F_t Ft与深度 d d d交集区域的所有相位集合,训练后期通过 α = e − γ / 0.3 \alpha = e^{-\gamma/0.3} α=e−γ/0.3衰减( γ \gamma γ为当前迭代占总迭代的比例);

- 基础 ℓ 1 \ell_1 ℓ1损失(保证光强一致性):

- 实时性保障:网络基于GPU(单NVIDIA RTX 4090)运行,平均帧率达 50.2 H z 50.2Hz 50.2Hz,满足动态光场生成需求。

5.【EyeReal实测:裸眼3D界的“尺寸-视角”双料冠军】

5.1 核心性能:桌面级尺寸+超宽视场角的突破

- 显示规格:采用24英寸(518.4mm×324mm)桌面级面板,实现超100°水平视场角(FOV)、32°垂直FOV,覆盖日常观看的移动范围;

- 光场质量:输出全视差光场(含水平/垂直/径向视差),3D内容深度层次误差<2%,匹配真实物理场景的立体感。

5.2 基准对标:碾压传统方案的“双优表现”

与现有裸眼3D方案的关键指标对比:

- 对比全息显示:尺寸从“厘米级”提升至“桌面级”(24英寸),视场角从“<5°”扩展至“>100°”;

- 对比自动立体显示:视场角从“<20°”翻倍至“>100°”,同时保留全视差(传统方案多为单视差);

- 对比AI增强方案:帧率从“<30Hz”提升至“50.2Hz”,支持动态3D内容流畅显示。

5.3 主观体验:低疲劳的沉浸式3D观感

- 视疲劳测试:20名受试者连续观看1小时后,视疲劳评分(ASTM标准)较传统方案降低62%,无“聚焦-辐辏冲突”反馈;

- 立体感评分:95%受试者认为EyeReal的3D立体感“接近真实物体”,显著高于传统方案的“平面化3D”评价。

5.4 消融实验:关键模块的“战力贡献”

验证各核心模块的必要性:

- 动态SBP模块:移除后,视场角骤降至28°,“尺寸-视角”矛盾回归传统瓶颈;

- 互斥损失函数:移除后,双眼视差串扰率提升47%,3D立体感减弱35%;

- 多层LCD相位编码:替换为单LCD后,光效损失53%,显示亮度无法满足室内环境需求。

6.【破局裸眼3D:EyeReal的现在与下一代显示新图景】

该研究提出的EyeReal方案,通过动态空间带宽积(SBP)利用范式与深度学习驱动的光场生成技术,成功突破裸眼3D领域“大尺寸与宽视角不可兼得”的数十年瓶颈——在桌面级显示尺寸下实现超100°视场角的全视差3D显示,基于低成本LCD硬件达成50.2Hz实时帧率,还能缓解视觉疲劳,且在合成场景(大型城市景观)与真实场景(日常物品、地标建筑)中均验证了性能有效性;未来可进一步通过时间复用、定向背光技术适配多用户需求,结合场序彩色或mini-LED提升光学效率,同时其动态SBP利用思路还可拓展至大尺寸全息显示等领域,为数字娱乐、智能教育、工业设计等下一代显示应用提供核心技术支撑。

最后,借炜杰大佬的小红书推文送给大家,望诸君共进步!!!

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)