深入解读MCP(模型上下文协议):AI时代的连接基石

2024年,大语言模型(LLM)的能力突破让世人惊叹,但一个根本性的瓶颈日益凸显:再强大的模型也无法突破训练数据的"时间壁"。当你询问"今天的股市行情",模型只能抱歉地表示知识截止

前言:当AI需要"手脚"和"眼睛"

2024年,大语言模型(LLM)的能力突破让世人惊叹,但一个根本性的瓶颈日益凸显:再强大的模型也无法突破训练数据的"时间壁"。当你询问"今天的股市行情",模型只能抱歉地表示知识截止;当你希望AI自动整理会议纪要并发送邮件,它因无法连接办公系统而束手无策。这种"脑强体弱"的困境,使得AI应用始终停留在"高级聊天机器人"的层面。

更严峻的是碎片化危机。每家厂商都在做自己的Function Calling,每个API都需要定制化的适配代码,企业集成一个AI客服系统往往需要对接数十个异构接口。开发成本高昂、安全审计困难、生态壁垒林立——这就像在USB-C出现前,每家电子设备都配备专属充电口的时代。

模型上下文协议(Model Context Protocol, MCP) 的诞生,正是为了打破这一僵局。由Anthropic在2024年底开源的MCP,被业界誉为"AI世界的USB-C接口",它通过标准化通信协议让大模型能够即插即用地连接数据库、文件系统、API、IoT设备等一切外部资源。短短半年内,MCP生态已涌现400+开源服务器,覆盖Google Drive、Salesforce、GitHub等主流平台,国内阿里云、腾讯云等云巨头也纷纷推出全生命周期MCP服务。

本文将带您穿透MCP的技术表象,理解其重塑AI应用开发范式的深层逻辑,掌握从协议原理到生产部署的完整知识体系。无论您是希望提升开发效率的AI工程师,还是探索智能化转型的企业决策者,MCP都将是您未来五年无法回避的关键技术。

一、简介:MCP——大模型的"通用插座"

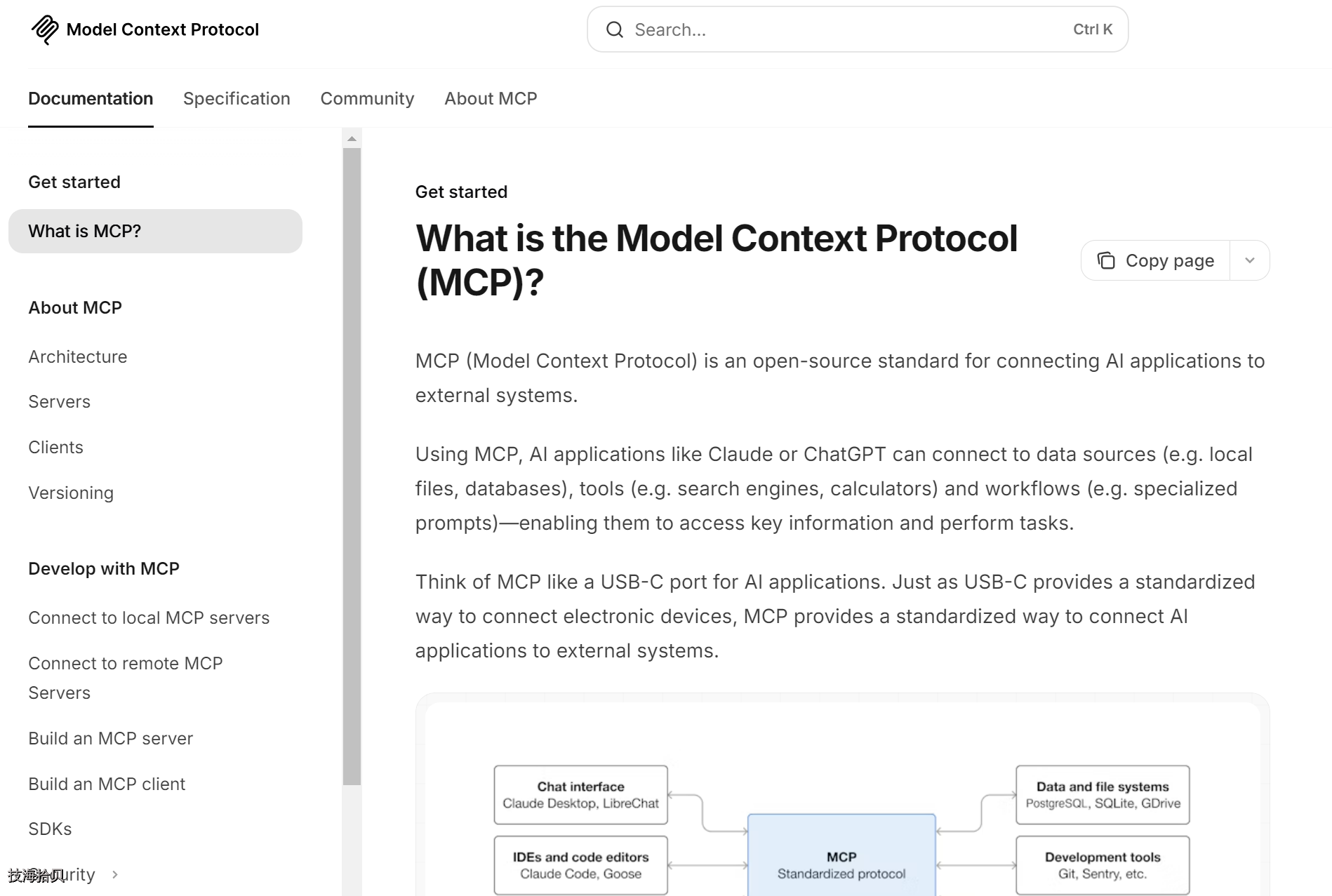

1.1 什么是MCP?

模型上下文协议(Model Context Protocol,MCP)是一种由 Anthropic 于 2024 年底提出的开放标准协议,旨在让AI模型能够方便、安全地连接到各种外部数据源和工具。简单来说,MCP为AI模型提供了一个类似“USB-C接口”的通用连接方式,将原本分散的集成方式统一起。

通过MCP,开发者不再需要为每个数据源定制单独的插件或API对接,取而代之的是让AI助手(如聊天机器人、编程助手等)使用单一协议就可以获取所需的上下文数据 。这一标准的核心目标是在各类AI应用与外部系统之间建立通用的“上下文桥梁” 。MCP能够连接的外部系统包括内容存储库(如文档库、产品库)、业务工具(如Slack、GitHub)、开发环境以及其他软件或数据库等,即“数据真正所在之处” 。

官网

What is the Model Context Protocol (MCP)? - Model Context Protocol https://modelcontextprotocol.io/docs/getting-started/intro

1.2 为什么需要MCP?

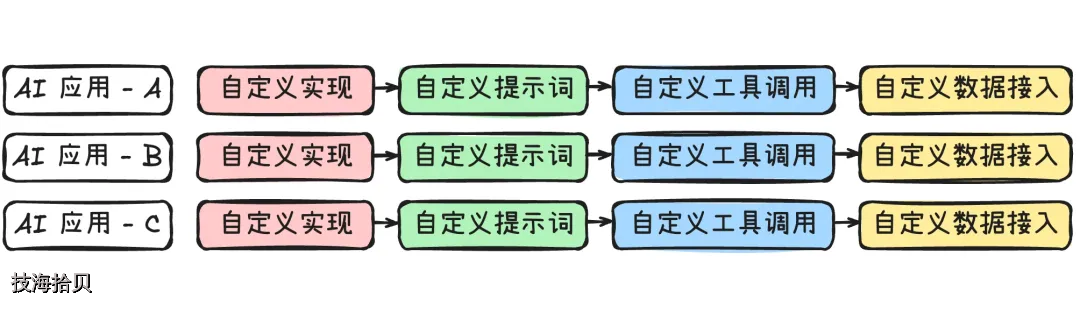

在MCP出现前,AI与外部系统的集成面临三大痛点:

- 协议碎片化:每个服务都有独特的API规范、认证方式和数据格式,开发者需要为每个集成对象重复编写适配代码,维护成本极高。

- 模型绑定性:不同厂商的Function Calling机制互不兼容,为Claude开发的工具无法直接用于GPT-4,造成生态割裂。

- 安全与管控缺失:将数据库凭证直接暴露给AI模型存在巨大风险,且缺乏细粒度的操作审计能力。

MCP通过定义一套通用语言,将"工具描述-参数传递-结果返回"全流程标准化。开发者只需一次性构建MCP服务器,所有兼容MCP的AI应用均可即插即用,实现"一次适配,服务百模"的跨平台复用。

拓展—AI与外部系统集成需求

背景—AI 模型的“信息孤岛”问题

随着 AI 大模型获得了广泛的使用,该行业在训练模型方面投入了大量资金,新的模型在推理能力和生成质量方面得到了较大的进步。

但是,训练 AI 的数据集始终是滞后的、固定的,再强大的 AI 也只是知道过去发生的事情,却无法实时从外界获取最新的信息,比如今天的天气情况、今天的热点新闻等。

方案

联网搜索:第一代解决方案

为了解决这个问题,常见的 AI 助手通过 AI 代理模式,设计了联网搜索的工作流。

当用户和 AI 助手对话,且开启联网搜索后,AI 助手会先将用户说的话发送给第三方搜索引擎,然后将第三方搜索引擎的返回的内容和用户说的话一起提供给 AI 大模型,再由 AI 大模型生成回答。可以看出,搜索引擎在这里充当了第三方实时信息源的角色,为 AI 大模型提供了额外的上下文信息。

自有系统数据:超越公共搜索的需求

对于搜索引擎能搜索到的、有多种信息源的公开信息,AI 助理的这种联网搜索功能效果不错。

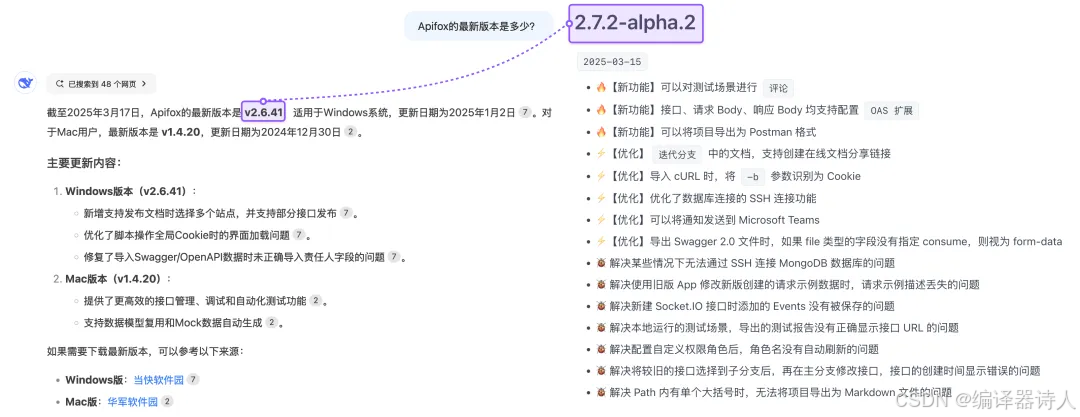

但是,如果希望 AI 能提供行业内部信息、或者你研发的自有系统内的信息,AI 联网搜索的效果就很不好,甚至无法实现。举个简单的例子,问开启了联网搜索的 DeepSeek 这个问题:Apifox 的最新版本是多少?DeepSeek 的回答是 2.6.41。但实际上,Apifox 的最新版已经到了 2.7.2,差了 10 个版本。

为了让自有系统和 AI 模型紧密协作,打破信息隔离,用户可以自行搭建 AI 代理,将自有系统的数据通过 API 的形式接入 AI 助手。继续上面的例子,我们可以将 Apifox 的更新日志内的信息,通过 API 向外提供。然后设定这样一个工作流:如果有人问 Apifox 的最新版本是多少,则调用这个 API,再将 API 返回的结果和用户的原始问题一起提供给 AI,这样 AI 就可以给出正确的回答了。

1.3 MCP的核心目标和功能

MCP的核心目标是为AI模型提供一个通用的接口,使其能够与各种外部数据源和工具进行无缝交互。具体功能包括:

标准化数据访问:通过统一的协议,简化AI模型与不同数据源的连接,避免为每个数据源单独开发接口代码。

增强上下文感知能力:允许AI模型访问实时、相关的数据和专门的工具,基于准确的信息做出响应。

双向安全通信:在AI应用和数据源之间建立安全的双向通信通道,确保数据的隐私性和交互的完整性。

- 拉取数据:LLM 服务器查询上下文 → 例如检查您的日历

- 触发操作:LLM 指示服务器执行操作 → 例如重新安排会议,发送电子邮件

MCP 与 API:

| 功能 | MCP | 传统 API |

|---|---|---|

| 集成工作量 | 单一、标准化的集成 | 每个 API 的独立集成 |

| 实时通信 | ✅ 是 | ❌ 无 |

| 动态发现 | ✅ 是 | ❌ 无 |

| 可扩展性 | 简单(即插即用) | 需要额外的集成 |

| 安全与控制 | 在工具间保持一致 | 根据 API 而异 |

MCP 与 Function Calling 的区别

- MCP(Model Context Protocol),模型上下文协议

- Function Calling,函数调用

这两种技术都旨在增强 AI 模型与外部数据的交互能力,但 MCP 不止可以增强 AI 模型,还可以是其他的应用系统。

| 类型/特性 | MCP (Model Context Protocol) | Function Calling |

|---|---|---|

| 性质 | 协议 | 功能 |

| 范围 | 通用(多数据源、多功能) | 特定场景(单一数据源或功能) |

| 目标 | 统一接口,实现互操作 | 扩展模型能力 |

| 实现 | 基于标准协议 | 依赖于特定模型实现 |

| 开发复杂度 | 低:通过统一协议实现多源兼容 | 高:需要为每个任务单独开发函数 |

| 复用性 | 高:一次开发,可多场景使用 | 低:函数通常为特定任务设计 |

| 灵活性 | 高:支持动态适配和扩展 | 低:功能扩展需要额外开发 |

| 常见场景 | 复杂场景,如跨平台数据访问与整合 | 简单任务,如天气查询 |

二、MCP核心概念(架构)解析

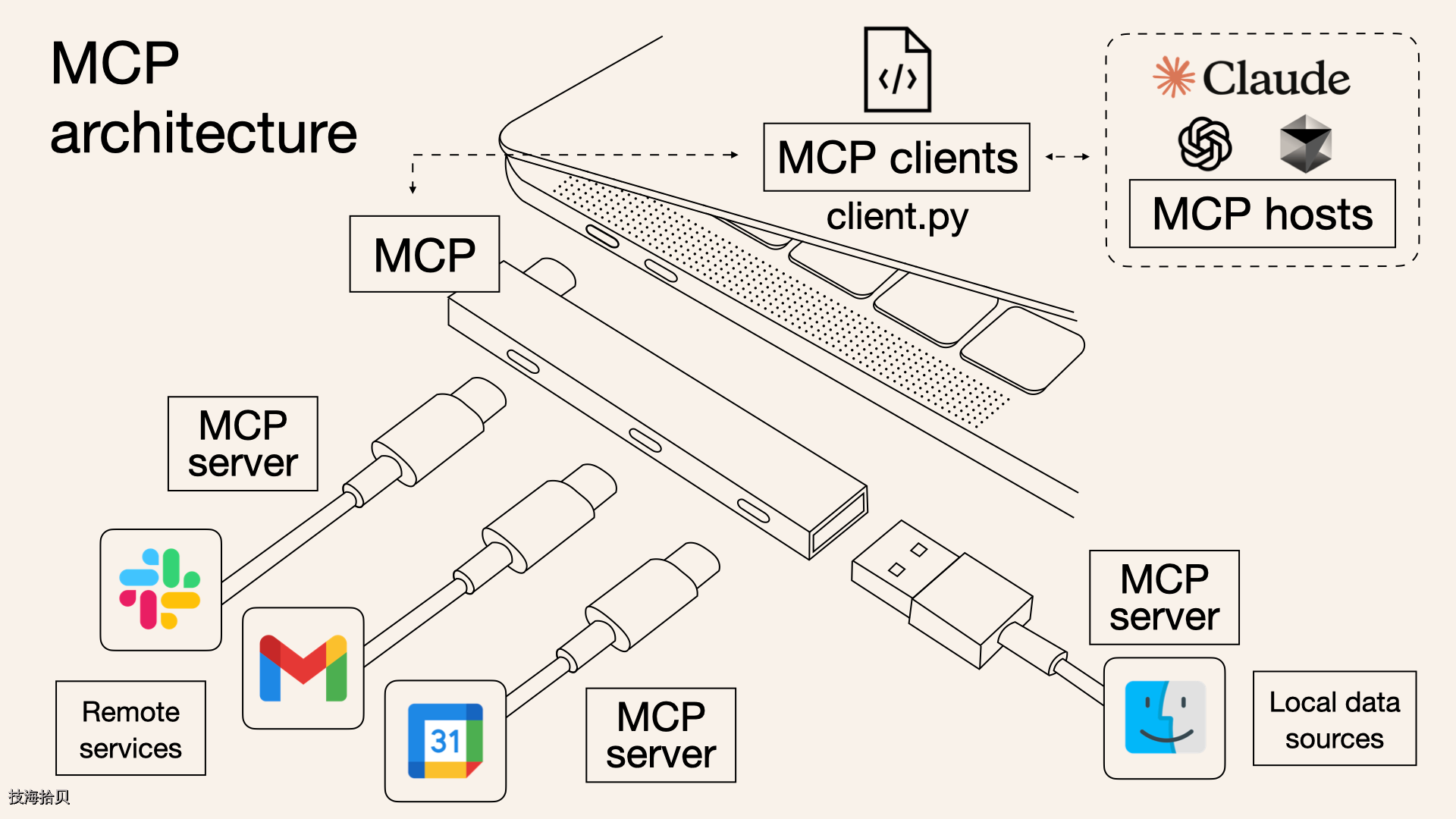

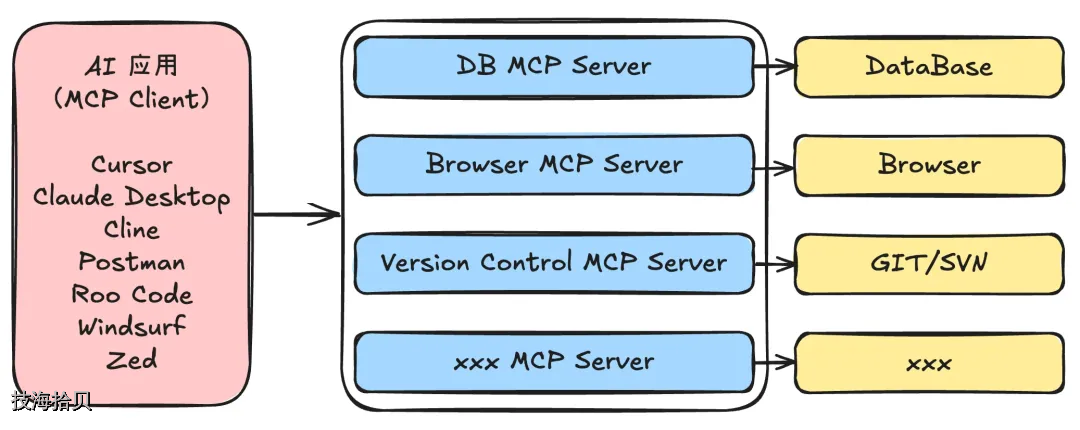

MCP架构包含三个关键角色:

- MCP Host:承载AI模型的应用,如Claude Desktop、Cursor IDE、智能客服系统等。

- MCP Client:运行在Host内部,负责与MCP Server建立连接、发现工具、执行调用的通信模块。

- MCP Server:封装具体能力的服务端,如数据库查询、文件读写、API调用等,向Client暴露标准化接口。

三者关系遵循"一对多"原则:一个Host可连接多个Server,一个Server也可被多个Host复用,支持本地与远程部署的混合架构。

MCP采用经典的客户端-服务器(Client/Server)架构,并引入了主机(Host)的概念,形成了协同工作的”三驾马车”:

- MCP主机(Host) :通常是用户直接交互的AI应用程序,例如Anthropic的Claude Desktop、AI辅助编程IDE如Cursor,或者企业内部的智能助手界面。Host负责管理整个用户会话,接收用户输入,协调LLM进行任务分解和规划,并将具体的外部操作请求分发给一个或多个MCP Client。它还负责从Client处收集结果,并最终呈现给用户。

- MCP客户端(Client) :作为Host应用内嵌的组件,Client是MCP协议的直接实现者。它负责与一个或多个MCP Server建立和维护安全的1:1连接。Client的主要职责包括:封装来自Host的请求(由LLM生成或预定义),按照MCP规范将其发送给Server;接收Server的响应或通知,并将其解析后传递给Host;处理协议层面的细节,如认证、心跳、错误处理等。

- MCP服务器(Server) :是一个轻量级的后端服务程序,它将特定的外部数据源或工具能力通过MCP标准接口暴露出来。例如,一个文件系统MCP Server可以提供读写本地文件的能力,一个数据库MCP Server可以执行SQL查询,一个GitHub MCP Server可以操作代码仓库。Server接收来自Client的MCP请求,执行相应的操作,并将结果或状态更新返回给Client。

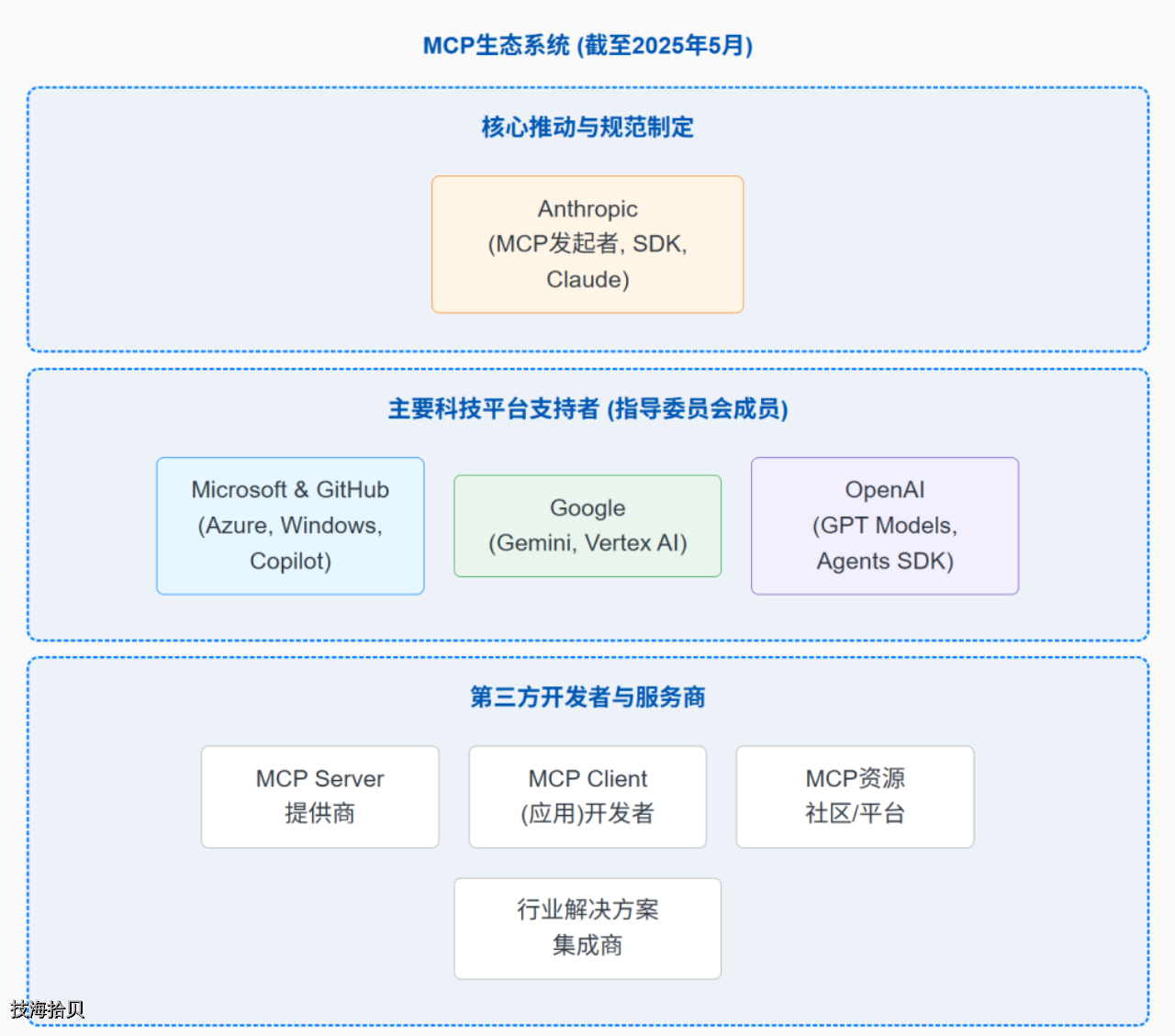

三、发展:从Anthropic实验室到全球生态

起源:2024年11月的破局

MCP的故事始于2024年11月,Anthropic公司在其官方文档中首次发布Model Context Protocol规范,并宣布Claude 3.5 Sonnet原生支持该协议。几乎同期,获得Anthropic投资的AI编程工具Cursor迅速跟进,成为首个深度集成MCP的IDE产品。这一战略协同为MCP的早期推广奠定了坚实基础。

此时的MCP定位清晰:解决大模型与外部世界的"最后一公里"连接问题。它并非从零发明,而是吸收了JSON-RPC、LSP(Language Server Protocol)等成熟协议的设计理念,针对AI交互场景做了专门优化——强调动态工具发现、上下文记忆和安全沙箱。

Anthropic官网 https://www.anthropic.com/

引爆:2025年3月的生态爆发

2025年3月成为MCP发展的关键转折点。随着国内外AI Agent赛道竞争白热化,开发者急需一种能快速集成海量工具的标准方案。MCP凭借其"即插即用"特性,迅速被Dify、Coze、BetterYeah等主流Agent平台采纳,形成雪球效应。

这一阶段呈现三大特征:

- 开源生态井喷:GitHub上MCP相关仓库数量从数十个激增至400+,覆盖办公协作、数据分析、开发工具、IoT控制等全场景。社区贡献者开发出Google Drive MCP、Slack MCP、PostgreSQL MCP等高质量服务器。

- 云厂商战略投入:阿里云百炼上线业界首个全生命周期MCP服务,提供Server托管、工具市场、调用监控等一站式能力。腾讯云EdgeOne将MCP集成到边缘计算节点,实现毫秒级工具响应。

- 行业方案落地:东方材料发布"东方六合"MCP服务平台,对标海外Porter平台,强调"多模型、多系统、技术中立"的智能协同。恒锋信息在公共安全领域推出AI+MCP"智能连接器",实现跨系统警情数据毫秒级联动。

现状:2025年的技术成熟度

截至2025年中,MCP已进入生产应用阶段。Gartner报告将MCP列为"AI工程化"领域的标杆技术,采用MCP的Agent开发周期平均缩短60%,工具调用成功率提升至98%。技术层面,MCP 1.0规范已稳定,支持SSE(Server-Sent Events)实时推送、OAuth 2.0认证、TLS加密传输等生产级特性。

但挑战依然存在。华中科技大学Security PRIDE团队的研究指出,MCP Server的生命周期管理(创建、运行、更新)存在安全隐患,如恶意Server注入、权限提升攻击等。性能方面,高并发场景下的延迟优化和连接池管理仍是社区重点攻关方向。

四、特点:五大核心优势重塑AI开发

1. 统一接口:真正的"一次编写,到处运行"

MCP将不同工具抽象为统一的"上下文提供者"接口,无论底层是REST API、SQL数据库还是本地文件系统,对AI模型而言调用方式完全一致。这种抽象带来三重价值:

- 开发效率跃升:传统方式每集成一个系统需编写数百行适配代码,MCP只需配置一个Server地址,接入成本降低80%以上。

- 技术债务清零:企业更换CRM或ERP系统时,无需重写AI逻辑层,只需替换对应的MCP Server,上层应用零感知。

- 生态协同效应:工具提供商一次性构建MCP服务器,即可被整个生态的AI应用调用,避免重复造轮子。

类比来看,MCP如同数字世界的"大一统语言",终结了AI集成领域的"巴别塔困境"。

2. 动态扩展:AI的"实时学习"能力

MCP支持客户端在运行时动态发现Server提供的工具列表、参数schema和使用说明。这意味着AI应用无需重启即可"学会"新技能。

例如,当企业上线新的数据分析MCP Server时,已部署的AI助手能立即感知并在对话中主动推荐使用该工具。这种热插拔特性使AI系统具备持续进化能力,工具生态越丰富,单个AI的能力边界越宽广。

3. 双向安全通信:可控的"数字信使"

安全是MCP设计的重中之重。协议内置三层防护机制:

- 传输层加密:默认采用TLS 1.3加密,防止中间人攻击。

- 细粒度授权:用户可精确控制AI对每项工具的访问权限,如"只读文件"或"禁止删除操作",敏感操作需人工二次确认。

- 本地优先架构:支持Server部署在企业内网,数据"不出域",满足金融、医疗等强监管场景需求。

这种"锁箱式"通信模型,确保AI只能在授权范围内行动,避免越权操作导致的数据泄露或系统破坏。

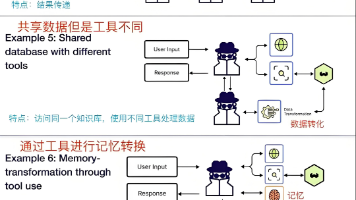

4. 上下文感知:超越单次调用的智能

MCP不仅传递单次请求,还维护完整的会话状态、历史交互记录和工具使用轨迹。这使得AI能进行多轮连贯操作,如"先查询数据库→分析结果→生成图表→发送邮件",整个过程上下文不丢失。

研究显示,引入MCP后,某些复杂任务的完成准确率提升近20%,因为模型能基于之前的工具返回结果动态调整策略。这种"记忆能力"是构建真正自主Agent的基础。

5. 模块化与可观测性:生产级运维保障

MCP架构天然契合微服务理念。每个Server独立部署、独立扩展,通过日志和监控接口向Host上报调用次数、延迟、错误率等指标。企业可基于这些数据实现:

- 成本优化:识别高频工具,针对性缓存或预加载。

- 故障隔离:单个Server故障不影响整体系统,符合N+1容灾设计。

- 审计合规:完整记录AI的每一项操作,满足GDPR、等保等合规要求。

五、应用场景:八大领域实践全景

1. 智能办公自动化

痛点:员工每天在邮件、日历、文档、IM间切换,重复性操作消耗30%工作时间。

MCP方案:通过集成Calendar MCP、Gmail MCP、Google Drive MCP,AI助手能理解自然语言指令"整理今天会议纪要并邮件发送给项目组"。执行链路为:

- 调用Calendar MCP获取今日会议列表

- 通过Drive MCP读取会议纪要文档

- 使用Gmail MCP发送邮件,收件人自动从企业通讯录解析

效果:某互联网大厂部署后,会议跟进效率提升75%,行政人力成本降低40%。

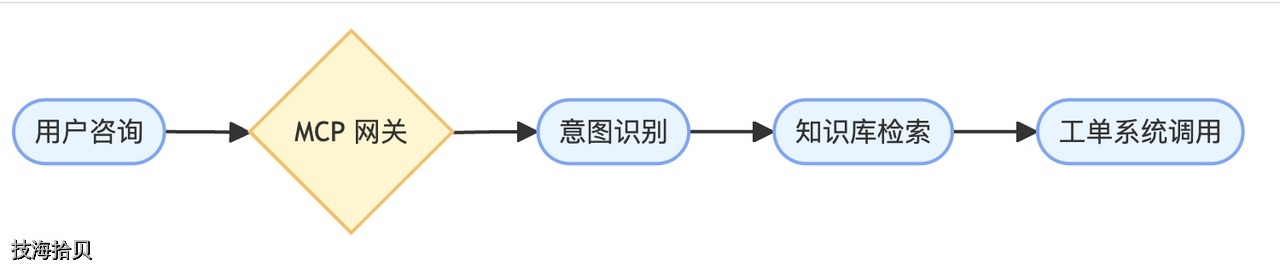

2. 企业级知识库问答

痛点:内部CRM、ERP、Wiki系统数据孤岛严重,员工查询客户信息需登录多个平台。

MCP方案:构建统一的企业知识网关,将Salesforce、Confluence、Jira等封装为MCP Server。AI客服或销售助手可通过单一入口实时查询订单状态、客户历史、工单进度。

关键价值:数据实时性(无需同步副本)、权限一致性(复用现有OA鉴权)、回答可追溯(附带数据源链接)。

3. 医疗诊断辅助

场景:放射科医生需快速查阅患者历史影像、化验结果和临床指南。

MCP实现:部署医疗专用MCP Server,包括:

- PACS影像服务器:支持DICOM协议,AI可调取历史CT对比

- HIS数据服务器:查询化验指标趋势

- 知识库服务器:匹配最新诊疗指南

流程:医生上传当前影像→AI通过MCP获取患者3年历史数据→生成鉴别诊断建议→高风险案例自动触发MDT会诊通知。

合规:全程TLS加密,通过HIPAA认证,诊疗记录区块链存证。

4. 工业设备预测维护

场景:制造产线设备非计划停机导致百万级损失。

MCP方案:在边缘侧部署IoT MCP Server,实时采集传感器数据(温度、振动、电流),AI通过LSTM模型预测故障概率。当异常阈值触发时:

- 调用Maintenance MCP创建工单

- 通过SMS MCP通知工程师

- 查询Inventory MCP确认备件库存

成果:设备停机时间减少70%,维护成本降低45%。

5. 金融实时风控

场景:信用卡盗刷、洗钱交易需毫秒级拦截。

MCP架构:Transaction MCP接收实时交易流→Risk Model MCP动态加载风控规则→Alert MCP触发处置动作(冻结、验证、放行)。

性能:风险识别准确率>99.9%,响应延迟<200ms,支撑万级TPS并发。

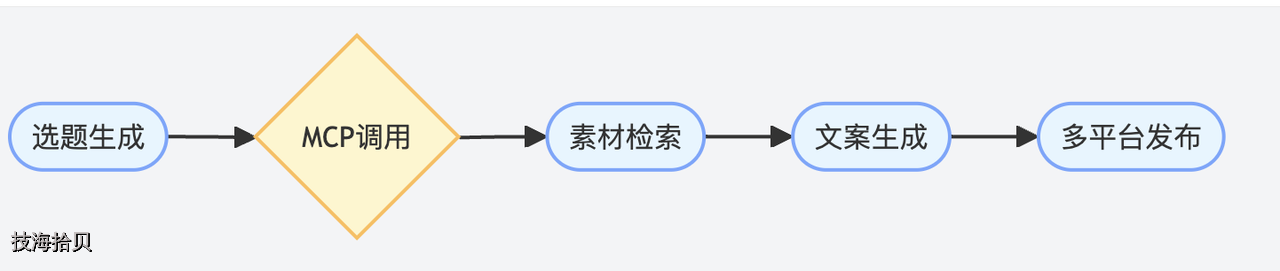

6. 内容创作自动化

工作流:新媒体运营需追热点、写稿件、配图文、发多平台。

MCP工具链:

- 新榜API MCP:抓取实时热点

- 腾讯云AI写作MCP:生成20+风格稿件

- Unsplash MCP:自动匹配版权图片

- WeChat/Weibo MCP:一键多平台发布

效率:从热点发现到内容发布缩短至15分钟,人力成本降低60%。

7. 智能开发辅助

场景:开发者频繁在IDE、浏览器、终端间切换,手动复制粘贴代码。

MCP方案:Cursor等IDE集成File System MCP、Git MCP、Docker MCP。开发者通过自然语言"为当前函数生成单元测试并推送到Git",AI自动完成:

- 读取当前文件AST

- 调用测试框架MCP生成用例

- 执行Docker MCP运行测试

- 通过Git MCP提交代码

收益:开发效率提升50%,新手员工上手周期缩短70%。

8. 智慧城市大脑

场景:城市管理者需整合交通、安防、环保、应急等多部门数据。

MCP架构:部署城市级MCP服务总线,各委办局将数据能力封装为Server。AI指挥中心可跨系统调度:

- 调用Traffic MCP获取路况→预测拥堵点

- 通过Camera MCP调取周边视频→识别事故

- 触发Emergency MCP派遣救援→联动红绿灯MCP开辟绿色通道

价值:应急响应时间缩短50%,跨部门协同从"周级"提速到"秒级"。

六、语法结构:协议规范深度解析

6.1 协议分层架构

MCP基于JSON-RPC 2.0构建,采用三层架构:

1. 传输层(Transport Layer)

支持两种模式:

- 标准输入输出(stdio) :用于本地MCP Server,Host通过子进程启动Server,通信延迟最低。

- HTTP Server-Sent Events(SSE) :用于远程Server,支持双向通信,AI可主动推送状态更新。

2. 消息层(Message Layer)

定义三类核心消息:

- Request:调用工具,含

method、params、id。 - Response:返回结果或错误,匹配对应

id。 - Notification:单向通知,如工具列表变更、日志上报。

3. 应用层(Application Layer)

包含四大能力域:

(1)资源访问(Resources)

{

"method": "resources/list",

"params": {

"cursor": "optional_pagination_token"

}

}

返回资源列表,每个资源有URI、MIME类型和描述。

(2)工具调用(Tools)

工具是MCP的核心。Server通过tools/list暴露可用工具:

{

"tools": [

{

"name": "query_database",

"description": "执行SQL查询并返回结果",

"inputSchema": {

"type": "object",

"properties": {

"sql": {"type": "string"}

},

"required": ["sql"]

}

}

]

}

(3)提示模板(Prompts)

可复用的提示片段,支持参数化:

{

"name": "analyze_code",

"description": "分析代码质量",

"arguments": [

{"name": "language", "required": true},

{"name": "focus_areas", "required": false}

]

}

(4)采样(Sampling)

允许Server请求AI模型生成内容,实现"工具调用AI"的双向能力,支持复杂工作流编排。

6.2 完整通信流程

以"查询数据库并分析"为例:

-

初始化:Host启动时,Client连接MCP Server,发送

initialize请求协商版本。 -

发现:Client调用

tools/list,Server返回工具元数据,Host解析后注入模型上下文。 -

调用:用户提问"查询上季度销售额",AI生成工具调用:

{ "jsonrpc": "2.0", "id": 1, "method": "tools/call", "params": { "name": "query_database", "arguments": { "sql": "SELECT SUM(amount) FROM sales WHERE quarter='Q4'" } } } -

执行:Server执行SQL,返回结果集。

-

续行:AI基于结果生成自然语言回答,或调用其他工具(如生成图表)。

-

会话保持:整个过程中,Client维护对话历史,确保多轮上下文不丢失。

6.3 安全机制

MCP采用"零信任"模型:

- 能力声明:Server在初始化时声明所需权限(如文件读/写),用户明确授权后才可连接。

- 操作确认:高危操作(如DELETE、DROP)触发二次确认弹窗,防止AI误操作。

- 审计日志:所有调用记录(时间、用户、工具、参数、结果)持久化存储,支持事后追溯。

结束语:拥抱AI的"USB-C时代"

模型上下文协议(MCP)的出现,标志着AI技术从"能力堆砌"迈向"生态互联"的新纪元。它不仅是一个技术协议,更是重构人机协作范式的基石。对开发者而言,MCP意味着10倍效率提升和无边界的工具组合可能;对企业而言,MCP是打破数据孤岛、激活AI投资回报率的关键路径;对行业而言,MCP正在催生一个开放、可信、可持续的智能工具新生态。

未来已来,只是分布不均。 率先掌握MCP的团队,将在AI应用的下一波浪潮中占据先机。现在就动手构建你的第一个MCP Server,体验AI从"大脑"到"全能伙伴"的质变吧!

如果您想获取MCP最新技术动态、实战案例源码和独家解读,欢迎关注我们的技术公众号:技海拾贝。在这里,我们深耕AI工程化落地,分享经过生产验证的硬核技术!

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)