一文了解:MCP和其他大语言模型工具调用流程有什么不同?

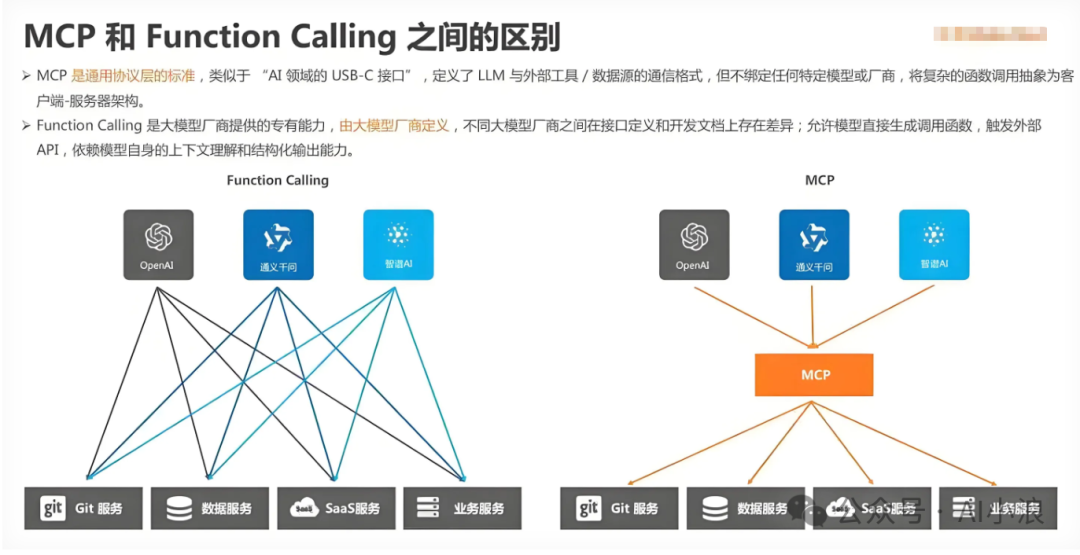

MCP与其他大语言模型工具调用流程的核心不同在于:MCP是一个标准化协议层,而传统工具调用是模型与宿主应用的直接交互机制。传统工具调用像是直接操作自家打印机,而MCP则像是通过统一标准的外卖平台订购服务,省去了为每个工具单独开发适配器的复杂性。

MCP与其他大语言模型工具调用流程的核心不同在于:MCP是一个标准化协议层,而传统工具调用是模型与宿主应用的直接交互机制。传统工具调用像是直接操作自家打印机,而MCP则像是通过统一标准的外卖平台订购服务,省去了为每个工具单独开发适配器的复杂性。

而MCP 与其他大语言模型工具调用流程的差异,需结合技术架构、交互逻辑和生态适配三个维度分析:

一、核心架构差异:从 “嵌入式函数” 到 “标准化协议层”

-

传统工具调用(如 LangChain、OpenAI Function Calling):工具逻辑与 LLM 应用深度耦合。例如,LangChain 需在代码中手动定义 Python 函数(如

def get_weather(city)),并在 Agent 初始化时显式注册;OpenAI 的 Function Calling 则要求在请求中硬编码函数描述(如"name":"get_weather","parameters":{"city":"San Francisco"})。这种模式下,工具与模型的集成依赖 “嵌入式函数逻辑”,不同模型(如 GPT、Claude)需单独适配,扩展性和复用性差。 -

MCP(模型上下文协议):采用客户端 - 服务器(Client-Server)架构,工具被封装为独立的

MCP Server(如一个部署在云端的天气服务),与 LLM 应用完全解耦。LLM 通过MCP Client(协议连接器)与MCP Server通信,无需感知工具的底层实现。这种 “协议化接口” 类似 AI 领域的 “USB-C 标准”,一次开发即可适配多模型(GPT、Claude、开源模型等),彻底打破厂商生态壁垒。

二、交互流程差异:从 “线性调用” 到 “动态协作”

-

传统工具调用流程:通常是线性的 “请求 - 响应”:用户输入→模型判断是否调用工具→生成函数调用请求→应用层执行 API→返回结果→模型生成回答。例如,用户问 “旧金山天气”,模型直接生成

get_weather("San Francisco")的函数调用,应用层调用天气 API 后返回数据,模型再整理成自然语言。这种流程缺乏对复杂任务的拆解和多工具协同能力。 -

MCP 工具调用流程(结合你提供的图片示例):流程更具动态性和协作性:

-

用户查询 “旧金山天气” 进入

MCP Client; MCP Client分析意图,选择 “天气工具”;

-

请求发送至

MCP Server,由其对接Weather API获取数据; -

数据返回

MCP Client后,整合上下文输入 LLM; -

LLM 生成最终回答。此外,MCP 支持双向通信和状态管理,例如工具可主动推送实时数据(如天气预警),且上下文(如用户历史查询)会在

MCP Client/Server间自动传递,让多轮交互更连贯。

-

三、生态与扩展性差异:从 “厂商锁定” 到 “跨平台兼容”

-

传统工具调用:依赖特定模型的原生能力(如 OpenAI 的 Function Calling 仅支持 GPT 系列,LangChain 的工具集成需手动适配不同向量数据库 / API)。若切换模型或工具,需大量重构代码,存在 “厂商锁定” 风险。

-

MCP:作为开源标准化协议,MCP 支持 “一次开发,多端复用”。例如,基于 MCP 开发的 “天气工具”,可同时被 GPT、Claude、本地部署的 Llama3 调用;且工具生态可通过

MCP Server动态扩展(如新增支付、地图工具时,只需部署对应的MCP Server,无需修改 LLM 应用)。这种扩展性让企业在技术选型时更灵活,避免被单一厂商绑定。

所以:

MCP 与传统工具调用的核心差异可概括为:MCP 通过 “标准化协议层 + 客户端 - 服务器架构”,实现了工具与 LLM 的解耦、复杂任务的动态协作,以及跨平台的生态兼容。

而传统工具调用则依赖 “嵌入式函数逻辑”,在扩展性、复用性和复杂任务处理上存在局限。这种差异让 MCP 更适合构建生产级、多模态的 AI 应用,是大语言模型工具调用的下一代技术方向。

更多推荐

已为社区贡献46条内容

已为社区贡献46条内容

所有评论(0)