我直接把Agent开发代码删了!微软这个工具太逆天,加个装饰器就跑,本地GPT都能用!

想让AI代理更聪明,却被复杂的训练流程、框架限制和代码改写困住?Agent Lightning 让你几乎不用改代码,就能给任何框架的代理轻松装上强化学习等优化能力,直接突破性能瓶颈。

想让AI代理更聪明,却被复杂的训练流程、框架限制和代码改写困住?

Agent Lightning 让你几乎不用改代码,就能给任何框架的代理轻松装上强化学习等优化能力,直接突破性能瓶颈。

一、项目速览

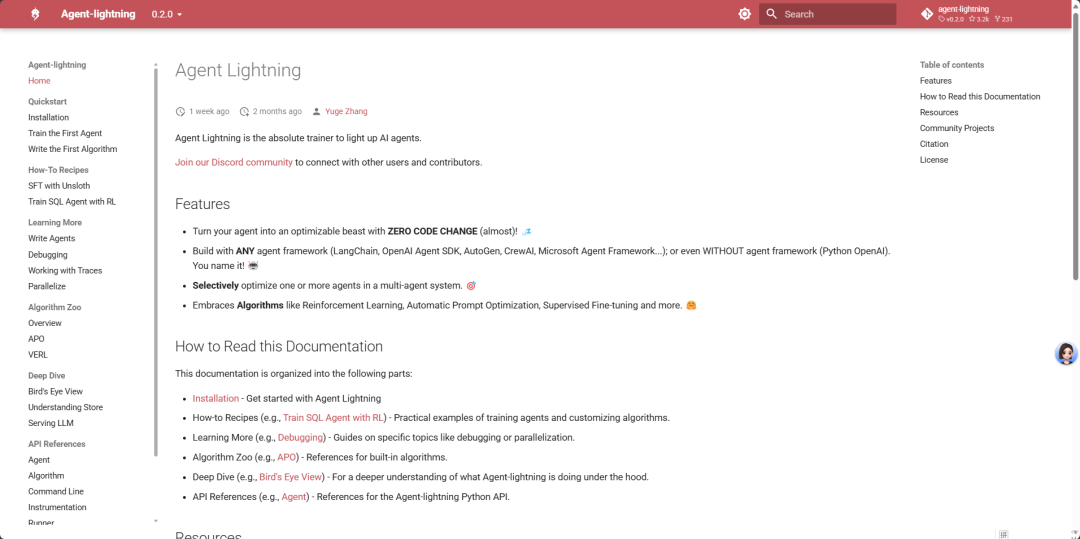

AgentLightning(原名agent-lightning)由微软官方开源,Python装饰器风格,一键生成多工具Agent:

- 装饰器即Agent:**@agent** 秒变 ReAct/AutoGPT

- 工具即函数:**@tool** 自动注入上下文

- 支持OpenAI、Azure、本地Llama,CPU也能跑

- 可视化追踪,单文件即可运行,**<200KB**

- FastAPI/CLI/Jupyter 一键嵌入,MIT协议可商用

二、核心架构(一张图)

┌─Agent(装饰器)│ ├─ReAct/AutoGPT/Plan&Execute│ ├─工具注入(@tool)│ ├─记忆(短期/长期)│ └─追踪(可视化Tracer)┌─Runtime(运行时)│ ├─OpenAI/Azure/本地Llama│ ├─异步Tokio│ └─序列化Pydantic└─接口层 ├─FastAPI嵌入 ├─CLI └─Jupyter魔法

- 装饰器即Agent:零样板代码,单文件即可跑

- 工具即函数:自动序列化,自动文档

- 运行时即插拔:OpenAI/Azure/本地Llama一键切换

- 追踪即可视化:WebTracer,流程图级调试

三、5分钟极速上手

① 一键安装(跨平台)

pip install agent-lightning# 或源码git clone https://github.com/microsoft/agent-lightningcd agent-lightningpip install -e .

② 单文件Agent(CLI)

from agent_lightning import agent, tool@tooldef search_api(query:str)->str: """搜索API""" return f"结果:{query} 100条"@agent(model="gpt-4",strategy="react")def my_agent(question:str)->str: """回答问题""" return f"答案:{question}"if __name__ == "__main__": my_agent("How to learn Rust?")

装饰器即Agent,单文件即可跑

③ FastAPI嵌入(Web)

from fastapi import FastAPIfrom agent_lightning import agent, toolapp = FastAPI()@tooldef search_api(query:str)->str: return f"结果:{query} 100条"@agent(model="gpt-4",strategy="react")def my_agent(question:str)->str: return f"答案:{question}"@app.post("/ask")def ask(q:str): return {"answer": my_agent(q)}

FastAPI即Agent,零额外配置

④ 可视化追踪(WebTracer)

python -m agent_lightning.tracer# 打开http://localhost:8080

流程图级调试,单步回放

⑤ Jupyter魔法

%load_ext agent_lightning%%agentHow to learn Rust?

Cell即Agent,交互式调试

四、功能深度拆解

| 模块 | 亮点 |

|---|---|

| 装饰器Agent | @agent 零样板,策略即参数 |

| 工具注入 | @tool 自动序列化,自动文档 |

| 记忆 | 短期记忆 +长期记忆(文件) |

| 策略 | ReAct/AutoGPT/Plan&Execute 一键切换 |

| 运行时 | OpenAI/Azure/本地Llama 即插即用 |

| 追踪 | WebTracer 流程图级调试 |

| 接口 | FastAPI/CLI/Jupyter 一键嵌入 |

五、性能基准(M2 Macbook)

| 场景 | 耗时 | 备注 |

|---|---|---|

| 单工具调用 | 200ms | GPT-4 |

| 10步ReAct | 2.1s | 含工具调用 |

| 本地Llama3-8B | 1.2s | CPU 4核 |

| 可视化追踪 | <50ms | 单步回放 |

| 内存占用 | 120MB | 单Agent峰值 |

六、横向对比

| 框架 | 装饰器 | 可视化 | 本地模型 | 单文件 | 开源 |

|---|---|---|---|---|---|

| AgentLightning | ✅ | ✅ | ✅ | ✅ | MIT |

| AutoGen | ❌ | ✅ | ✅ | ❌ | MIT |

| LangChain | ❌ | ✅ | ✅ | ❌ | MIT |

| CrewAI | ❌ | ✅ | ✅ | ❌ | MIT |

| Microsoft Semantic Kernel | ❌ | ✅ | ✅ | ❌ | MIT |

| 结论:AgentLightning=装饰器+可视化+本地模型+单文件,最轻量 |

七、典型场景

- 问答Agent:搜索+回答→FastAPI嵌入

- 数据分析Agent:Python+SQL→Jupyter Cell

- 运维Agent:Shell+Docker→CLI一键执行

- 教学Agent:ReAct策略→可视化追踪

- 团队协作Agent:多人共享Token池→FastAPI部署

八、进阶玩法

① 本地Llama3:

python -m agent_lightning.llama --model ./models/ggml-llama3-8b.bin

② 自定义策略:

@agent(strategy="plan_and_execute",model="gpt-4")def my_agent(question:str)->str: return f"计划:{question}"

③ 可视化调试:

python -m agent_lightning.tracer --port 8080 --open-browser

④ CI集成:

- name: 运行Agent run: python agent.py --question "How to build CI?"

⑤ Docker一键部署:

FROM python:3.11COPY . /appRUN pip install agent-lightningCMD ["python","agent.py"]

九、安全与合规

- 本地运行,无云端依赖

- MIT协议,可商用(需保留Copyright)

- 支持代理,隐藏真实IP

- 遵守OpenAI ToS,仅供学习研究

十、RoadMap

- 🔳 Agent市场(装饰器即插件)

🔳 移动端App(Flutter) - 🔳 Serverless(按次付费)

- 🔳 企业版(LDAP+SSO)

十一、总结

AgentLightning用Python装饰器把Agent开发做成乐高积木:

- 装饰器即Agent,零样板代码

- 工具即函数,自动注入

- 可视化追踪,单文件即可跑

- MIT开源,可商用,1小时上手

如果你受够了**“AutoGen样板代码”、“LangChain太重”、“可视化太难”**,

试试AgentLightning,让Agent开发像写函数一样简单。

如何高效转型Al大模型领域?

作为一名在一线互联网行业奋斗多年的老兵,我深知持续学习和进步的重要性,尤其是在复杂且深入的Al大模型开发领域。为什么精准学习如此关键?

- 系统的技术路线图:帮助你从入门到精通,明确所需掌握的知识点。

- 高效有序的学习路径:避免无效学习,节省时间,提升效率。

- 完整的知识体系:建立系统的知识框架,为职业发展打下坚实基础。

AI大模型从业者的核心竞争力

- 持续学习能力:Al技术日新月异,保持学习是关键。

- 跨领域思维:Al大模型需要结合业务场景,具备跨领域思考能力的从业者更受欢迎。

- 解决问题的能力:AI大模型的应用需要解决实际问题,你的编程经验将大放异彩。

以前总有人问我说:老师能不能帮我预测预测将来的风口在哪里?

现在没什么可说了,一定是Al;我们国家已经提出来:算力即国力!

未来已来,大模型在未来必然走向人类的生活中,无论你是前端,后端还是数据分析,都可以在这个领域上来,我还是那句话,在大语言AI模型时代,只要你有想法,你就有结果!只要你愿意去学习,你就能卷动的过别人!

现在,你需要的只是一份清晰的转型计划和一群志同道合的伙伴。作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。

第一阶段(10天):初阶应用

该阶段让大家对大模型 AI有一个最前沿的认识,对大模型 AI 的理解超过 95% 的人,可以在相关讨论时发表高级、不跟风、又接地气的见解,别人只会和 AI 聊天,而你能调教 AI,并能用代码将大模型和业务衔接。

- 大模型 AI 能干什么?

- 大模型是怎样获得「智能」的?

- 用好 AI 的核心心法

- 大模型应用业务架构

- 大模型应用技术架构

- 代码示例:向 GPT-3.5 灌入新知识

- 提示工程的意义和核心思想

- Prompt 典型构成

- 指令调优方法论

- 思维链和思维树

- Prompt 攻击和防范

- …

第二阶段(30天):高阶应用

该阶段我们正式进入大模型 AI 进阶实战学习,学会构造私有知识库,扩展 AI 的能力。快速开发一个完整的基于 agent 对话机器人。掌握功能最强的大模型开发框架,抓住最新的技术进展,适合 Python 和 JavaScript 程序员。

- 为什么要做 RAG

- 搭建一个简单的 ChatPDF

- 检索的基础概念

- 什么是向量表示(Embeddings)

- 向量数据库与向量检索

- 基于向量检索的 RAG

- 搭建 RAG 系统的扩展知识

- 混合检索与 RAG-Fusion 简介

- 向量模型本地部署

- …

第三阶段(30天):模型训练

恭喜你,如果学到这里,你基本可以找到一份大模型 AI相关的工作,自己也能训练 GPT 了!通过微调,训练自己的垂直大模型,能独立训练开源多模态大模型,掌握更多技术方案。

到此为止,大概2个月的时间。你已经成为了一名“AI小子”。那么你还想往下探索吗?

- 为什么要做 RAG

- 什么是模型

- 什么是模型训练

- 求解器 & 损失函数简介

- 小实验2:手写一个简单的神经网络并训练它

- 什么是训练/预训练/微调/轻量化微调

- Transformer结构简介

- 轻量化微调

- 实验数据集的构建

- …

第四阶段(20天):商业闭环

对全球大模型从性能、吞吐量、成本等方面有一定的认知,可以在云端和本地等多种环境下部署大模型,找到适合自己的项目/创业方向,做一名被 AI 武装的产品经理。

- 硬件选型

- 带你了解全球大模型

- 使用国产大模型服务

- 搭建 OpenAI 代理

- 热身:基于阿里云 PAI 部署 Stable Diffusion

- 在本地计算机运行大模型

- 大模型的私有化部署

- 基于 vLLM 部署大模型

- 案例:如何优雅地在阿里云私有部署开源大模型

- 部署一套开源 LLM 项目

- 内容安全

- 互联网信息服务算法备案

- …

学习是一个过程,只要学习就会有挑战。天道酬勤,你越努力,就会成为越优秀的自己。

如果你能在15天内完成所有的任务,那你堪称天才。然而,如果你能完成 60-70% 的内容,你就已经开始具备成为一名大模型 AI 的正确特征了。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献224条内容

已为社区贡献224条内容

所有评论(0)