ModelEngine智能体工程化全流程深度评测:从“玩具”到“工业级工具”的跃迁

当你的项目超越了单次对话的范畴,开始涉及多个专业化AI角色的协同、与复杂企业系统的对接、以及对生产环境下的稳定性和可维护性有严格要求时,ModelEngine所倡导的模块化、可观测性和生态开放性就显得尤为重要。它会自动加入诸如“请逐步分析”、“引用具体对话片段作为证据”等指令,这远比手动编写的提示词更具鲁棒性,有效减少了LLM的“幻觉”和逻辑跳跃。本文将以一个真实的“智能客服质量评估与优化助手”为

ModelEngine智能体工程化全流程深度评测:从“玩具”到“工业级工具”的跃迁

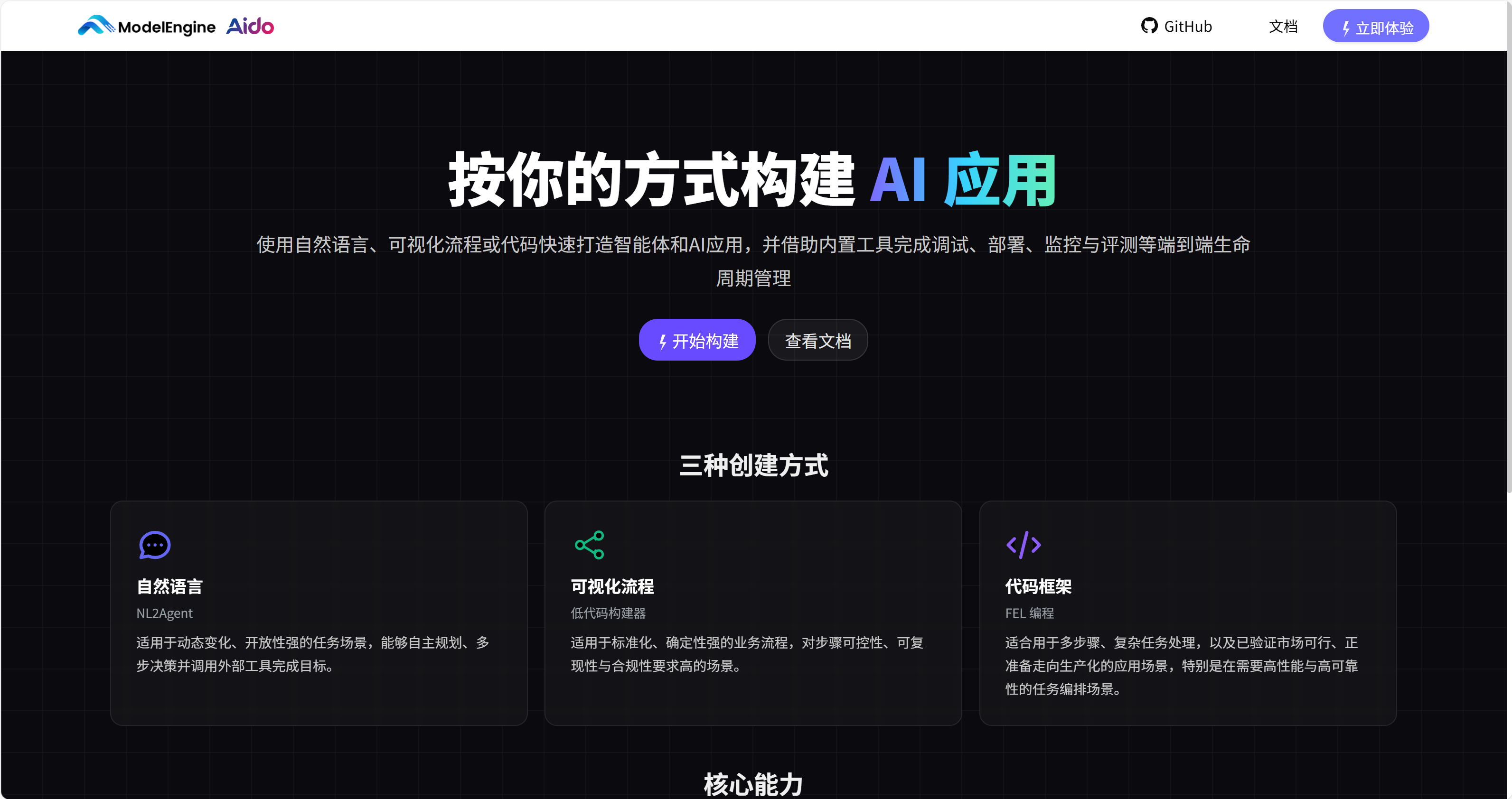

在智能体概念席卷AI领域的当下,我们目睹了无数“一分钟创建你的AI助手”的演示。然而,当企业试图将这些演示转化为稳定、可靠、可嵌入核心业务流程的“工业级工具”时,往往会陷入提示词脆弱、知识更新滞后、工具集成复杂与多角色协作混乱的泥潭。ModelEngine的出现,正是为了解决这一“最后一公里”的难题。它不仅仅是一个智能体构建平台,更是一套完整的智能体工程化(Agent Engineering) 解决方案。本文将以一个真实的“智能客服质量评估与优化助手”为例,全景式演示其从创建、赋能、协作到部署的全过程,并深度解读其背后的专业思考。

一、核心理念:ModelEngine的工程化哲学

ModelEngine将软件工程中的最佳实践引入了智能体开发领域,其核心思想可概括为三点:

- 模块化与高内聚:一个智能体被设计为一个功能完备、职责单一的模块。它拥有私有的提示词、知识库和工具集,内部逻辑被封装,仅通过清晰的接口与外界交互。这为复杂的多智能体系统奠定了架构基础。

- 可观测性与可调试性:智能体的思考过程、工具调用记录、知识检索来源不再是黑盒。开发者可以像查看程序日志一样审视智能体的完整执行轨迹,这使得迭代优化从“玄学”变成了“科学”。

- 生态化集成:通过拥抱MCP(Model Context Protocol)等开放协议,ModelEngine不以自身生态封闭为目的,而是致力于成为企业现有工具链和数据的“连接器”,极大降低了集成成本。

二、深度实战:构建“智能客服质量评估与优化助手”

假设我们是一家大型电商公司,需要自动化地对海量客服对话进行质量评估,并生成优化建议。我们将创建一个由两个智能体组成的协作系统:「质检专家」 和 「培训师」。

阶段一:智能体创建与“灵魂”塑造——提示词工程

1. 创建「质检专家」智能体

首先,我们定义其核心职责:对单条客服对话进行多维度打分并指出具体问题。

提示词自动生成的威力:

在ModelEngine的提示词编辑器中,我们无需从零开始。我们只需在“角色设定”中描述:“你是一名资深客服质检专员,精通《客户服务标准手册》。”在“任务目标”中写明:“请对给定的客服对话进行评分,维度包括:礼貌用语、问题解决效率、信息准确性。并指出扣分项及原因。”

基于此,ModelEngine的提示词自动生成功能会产出一个结构严谨、包含系统指令和思考链引导的完整提示词框架。它会自动加入诸如“请逐步分析”、“引用具体对话片段作为证据”等指令,这远比手动编写的提示词更具鲁棒性,有效减少了LLM的“幻觉”和逻辑跳跃。

2. 赋予记忆:知识库与自动总结

为了让「质检专家」的判断有据可依,我们上传公司的《客服标准手册》、《最新产品信息Q&A》等文档至其专属知识库。

知识库总结自动生成的实践:

ModelEngine在处理知识库文档时,不仅进行向量化切片,还会为每个文档或关键片段自动生成文本摘要。当智能体检索到相关片段时,它会先看到这个摘要,从而快速判断其相关性,决定是深入阅读还是继续检索。这一机制极大地提升了知识检索的效率和精准度,避免了因检索到长文档而导致的上下文浪费和判断干扰。

场景代码:MCP服务接入(获取实时对话数据)

为了让它能评估真实数据,我们需要接入内部的客服系统API。通过MCP服务,我们可以轻松封装这个能力。

# 在ModelEngine中定义一个MCP Server的概念性代码示例

from mcp import McpServer

import your_customer_service_sdk # 假设的内部客服系统SDK

server = McpServer("customer_service_tools")

@server.list_tools()

async def list_tools():

return [{

"name": "get_recent_chats",

"description": "获取最近N条客服对话记录,用于质量抽检。",

"inputSchema": {

"type": "object",

"properties": {

"limit": {"type": "number", "description": "获取的记录条数"}

},

"required": ["limit"]

}

}]

@server.call_tool()

async def call_tool(name: str, arguments: dict):

if name == "get_recent_chats":

# 调用内部系统API

chats = your_customer_service_sdk.get_recent_chats(limit=arguments["limit"])

return {"content": [{"type": "text", "text": str(chats)}]}

raise Exception(f"Unknown tool: {name}")

将此MCP Server注册后,「质检专家」智能体便能在其工具列表中看到get_recent_chats,并可以自主调用,获取最新的客服对话。

阶段二:智能体开发与调试——从“能用”到“好用”

现在,我们让「质检专家」试运行。在ModelEngine的对话调试界面,我们输入指令:“请对最近5条客服对话进行质检。”

深度调试过程:

- 观察执行轨迹:界面右侧会清晰地展示智能体的完整思考过程:它首先调用了

get_recent_chats(limit=5)工具,获得了原始数据;然后,它基于提示词开始对第一条对话进行分析。 - 发现问题:我们发现,它在“信息准确性”维度上判断有误。点击对应的推理步骤,我们看到它检索了知识库,但引用的是一份过时的产品文档。

- 迭代优化:问题根源在于知识库版本。我们无需修改提示词,只需在知识库管理中更新产品文档。再次运行,判断立刻变得准确。这种基于真实交互数据的、可追溯的调试,是智能体开发效率的核心保障。

阶段三:多智能体协作——系统能力的涌现

单个「质检专家」只能完成点状评估。要形成闭环,我们需要「培训师」智能体。

- 「培训师」智能体:其职责是根据「质检专家」输出的批量评估结果,总结共性问题和薄弱环节,并自动生成培训材料和改进方案。

现在,我们并不需要手动将两个智能体串联。ModelEngine的多智能体协作能力允许我们在一个更高层的“编排”或“会话”中,让它们自主协作。

协作流程:

- 用户向「培训师」发出指令:“请基于过去100条对话,生成一份客服团队周度培训报告。”

- 「培训师」智能体识别到需要原始质检数据,它不会自己去评估,而是作为协作者,向「质检专家」发起一个内部请求:“你好,我需要100条对话的详细质检结果,包括分项得分和扣分原因。”

- 「质检专家」收到请求后,自主执行其内部流程:调用工具获取数据 -> 利用知识库和提示词进行评估 -> 将结构化的评估结果返回给「培训师」。

- 「培训师」接收结果,开始执行自己的核心任务:总结分析 -> 生成报告。

这个过程展现了真正的多智能体协作:智能体之间通过清晰的“言语行为”(请求、响应)进行通信,各司其职,共同完成一个任何单一智能体都无法高效完成复杂任务。ModelEngine的平台层负责了这一切的调度、上下文管理和通信保障。

阶段四:部署与交付

开发调试完成后,我们可以将这两个智能体及其协作关系打包为一个应用。通过ModelEngine提供的API端点,我们可以轻松地将这个“智能质检系统”集成到公司内部的管理后台或数据看板中,实现定时触发或事件驱动运行。整个过程无需关心服务器部署、资源调度等运维问题。

三、系统特性与技术亮点总结

通过以上实践,我们可以提炼出ModelEngine的核心技术亮点:

- 提示词与知识库的深度集成:自动生成与总结不仅是便利功能,更是提升了智能体认知能力的稳定性和效率。

- MCP服务的生态开放性:它以标准化的方式解决了智能体与外部世界连接的难题,是企业级集成的关键。

- 白盒化的调试体验:赋予了开发者“外科手术式”的精准优化能力,是智能体工程化的基石。

- 原生多智能体协作支持:智能体被当作一等公民进行交互,使得构建具备“社会性”的复杂AI系统成为可能。

四、开发者视角:与Dify、Coze的横向对比

| 特性维度 | ModelEngine | Dify | Coze |

|---|---|---|---|

| 智能体抽象 | 高内聚、可协作的智能体单元,强调个体能力和团队协作。 | 功能导向的Agent,更侧重于通过工作流和工具扩展单Agent能力。 | 对话体验导向的Bot,核心场景是打造沉浸式对话交互。 |

| 多智能体协作 | 原生支持,智能体间可直接、结构化地通信与调用,协作逻辑清晰。 | 主要通过工作流编排来实现,将多个“推理节点”串联,协作是显式定义的。 | 在对话场景中可通过@提及实现Bot间调用,但对于复杂、非对话型业务协作支持较弱。 |

| 工具/MCP集成 | 率先深度集成MCP,理念前沿,为工具生态提供了可持续演进的架构。 | 支持自定义工具(API方式),成熟稳定,能满足大部分集成需求。 | 依赖插件市场,开放性相对较低,更倾向于使用平台预置能力。 |

| 开发调试体验 | 工程化、白盒化,提供完整的执行轨迹和中间结果,适合复杂系统调试。 | 直观、用户友好,调试信息清晰,适合快速迭代和原型开发。 | 侧重于对话流调试,对于逻辑和工具调用的深层调试支持有限。 |

| 目标用户与场景 | 企业级开发者和技术团队,构建复杂、可靠、需深度集成的AI业务系统。 | 应用开发者和业务专家,快速构建面向用户的AI应用和自动化流程。 | 内容创作者和社区运营者,构建有趣的、互动性强的对话机器人和社交应用。 |

结论

ModelEngine的选择,并非是在寻找一个功能最全的平台,而是在寻找一个理念最契合工程实践的伙伴。当你的项目超越了单次对话的范畴,开始涉及多个专业化AI角色的协同、与复杂企业系统的对接、以及对生产环境下的稳定性和可维护性有严格要求时,ModelEngine所倡导的模块化、可观测性和生态开放性就显得尤为重要。它或许不是创建第一个Demo最快的工具,但一定是将Demo顺利转化为坚实可靠的生产力工具的最优路径之一。在智能体技术从探索走向落地的关键时期,ModelEngine提供的正是一套不可或缺的工程学方法论和工具箱。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)