LinearRAG:零成本高性能图检索增强生成框架,收藏级大模型知识检索解决方案

LinearRAG解决了现有GraphRAG因知识图谱质量差导致的性能问题。通过Tri-Graph架构、两阶段精准检索和零Token范式,避免了关系提取错误,提高了检索准确率,同时大幅降低索引时间和成本。在多个基准数据集上全面超越现有方法,成为大规模企业知识库检索的生产级解决方案。

论文:Linear Graph Retrieval-Augmented Generation on Large-scale Corpora

单位:香港理工大学

arXiv:https://arxiv.org/abs/2510.10114

代码:https://github.com/DEEP-PolyU/LinearRAG

摘要速览

研究痛点:尽管图检索增强生成(GraphRAG)在理论上具有优越性,但最近的研究表明,GraphRAG 模型在许多实际应用中的表现经常不如朴素的 RAG 方法。

我们分析发现,这种性能下降主要源于自动构建的知识图谱质量不佳。虽然基于图的检索提高了相关知识的召回率,但由于图构建中的错误,它同时在检索的上下文中引入了大量噪声和歧义。

实验表明:现有GraphRAG方法虽然提升了证据召回率,但语境相关性大幅下降,整体表现不如朴素RAG——图结构引入的噪声超过了结构化带来的收益。

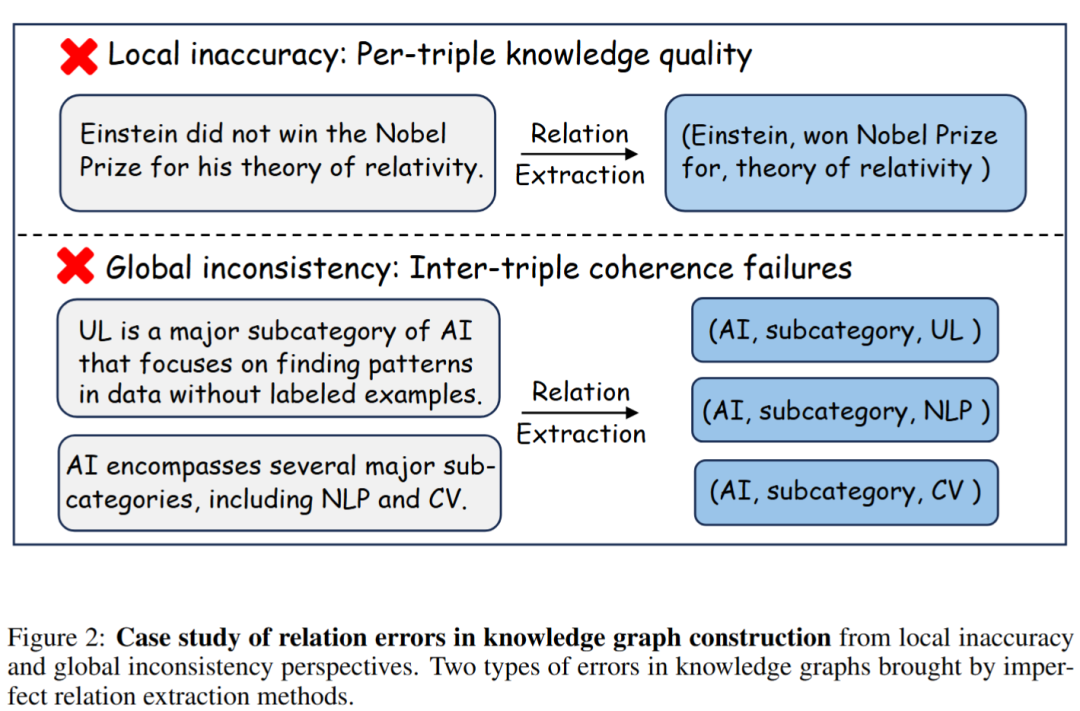

具体而言,两个关键缺陷破坏了图的质量:

(i) 局部不准确性:关系提取过程表现出显著的错误率,导致实体之间的语义关系不准确。例如"爱因斯坦没有因相对论获诺贝尔奖"被错误提取为(爱因斯坦, 获奖原因, 相对论),完全扭曲原意。

(ii) 全局不一致性:提取过程中缺乏强制执行层级一致性和全局连贯性的机制,导致图结构碎片化且连接性差。例如"AI的子领域"可能同时包含"无监督学习"和"NLP",但丢失了层级结构(NLP和CV是AI的子领域,而无监督学习是一种技术),造成结构混乱。

创新突破:提出LinearRAG框架,通过三大核心创新彻底重构GraphRAG范式:

- Tri-Graph架构:构建"实体-句子-段落"三层无关系图,仅用轻量级NER(spaCy)替代昂贵的关系提取,将索引时间降至250秒。

- 两阶段精准检索:先通过语义桥接激活多跳实体链,再用Personalized PageRank聚合全局重要性,实现准确的单次多跳推理。

- 零Token范式:图构建和检索全程无需调用LLM,消除token消耗,让GraphRAG首次实现真正的"零成本"部署。

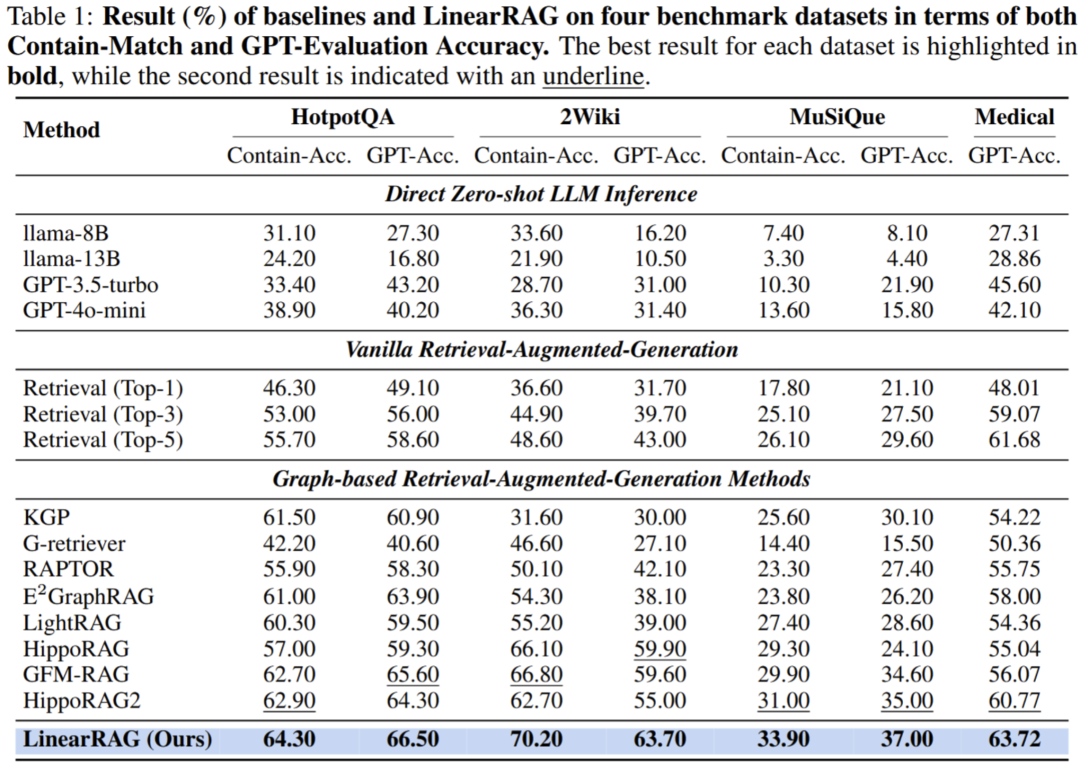

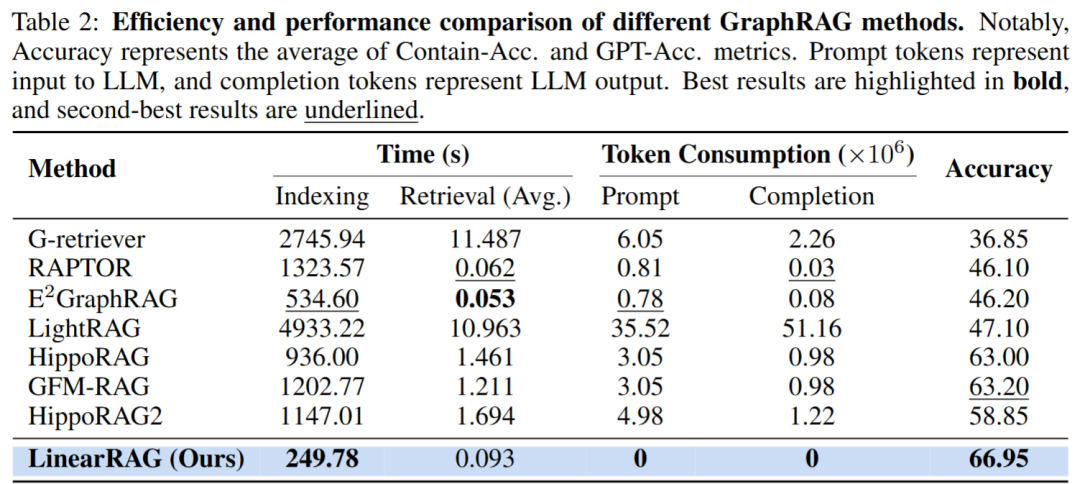

应用价值:LinearRAG为大规模企业知识库检索提供了生产级解决方案,在四大基准数据集上全面超越现有方法:

- 在2WikiMultiHopQA数据集上,LinearRAG的检索准确率达到63.7%,超越最强基线HippoRAG2(55.0%)8.7个百分点,同时Contain-Acc达到70.2%(第二名62.9%)。

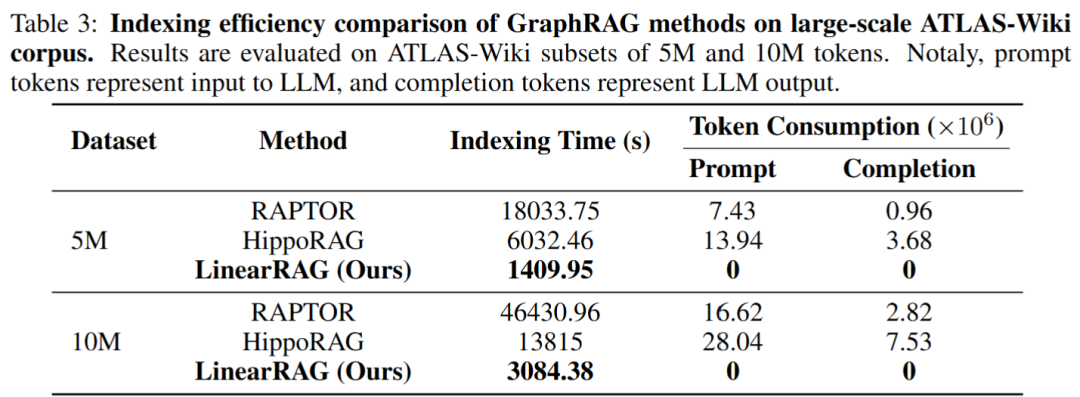

- 在ATLAS-Wiki 10M token语料上,索引仅需3084秒,比RAPTOR快15.1×,比HippoRAG快4.5×,且完全零API依赖。

方案详情

LinearRAG基于对现有GraphRAG局限性的深刻洞察,通过以下关键改进实现性能突破:

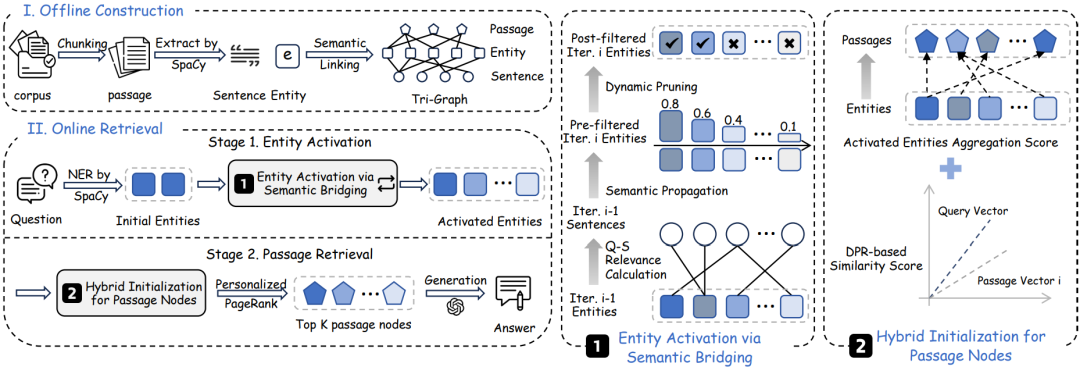

1. 免关系图构建(Tri-Graph):构建"实体-句子-段落"三层层级图,仅使用轻量级实体提取(spaCy NER)和语义链接,完全避免不稳定的关系建模。这种新范式将图构建复杂度降至线性,且不产生任何LLM token消耗,为原始段落提供了经济可靠的索引方式。

图3:LinearRAG整体架构 - Tri-Graph构建与两阶段检索流程

2. 语义桥接实体激活:通过在句子层面传播查询的语义相似度,动态激活多跳推理链中的中间实体,而非仅依赖字面匹配。这种局部语义桥接机制能够识别隐式关系(如"勃艮第伯爵夫人→丈夫→国籍"),从而在无需预提取关系的情况下实现多跳推理。

3. 全局重要性聚合:将激活的实体作为种子,在实体-段落子图上运行个性化PageRank算法,从全局视角聚合段落重要性。通过混合初始化策略,同时考虑实体激活分数、语义相似度和图结构中心度,确保检索结果既相关又全面。

4. 动态剪枝机制:引入阈值过滤和自动终止双重约束,在实体激活过程中动态剪除低相关性节点,防止语义扩散至无关领域。该机制确保激活路径始终贴合查询意图,通常在2-4轮内收敛,有效平衡了召回率与精确度。

应用价值

LinearRAG为大规模企业知识库检索提供了生产级解决方案,在四大基准数据集上全面超越现有方法:

- 在2WikiMultiHopQA数据集上,LinearRAG的检索准确率达到63.7%,超越最强基线HippoRAG2(55.0%)8.7个百分点,同时Contain-Acc达到70.2%(第二名62.9%)。

- 在Medical领域数据集上,创意生成任务同时实现89.08%召回率和72.74%相关性(GFM-RAG为83.51%/22.87%),破解了高召回与高精度的矛盾。

- 在ATLAS-Wiki 10M token语料上,索引仅需3084秒,比RAPTOR快15.1×,比HippoRAG快4.5×,且完全零API依赖。

这使得它成为那些需要强性能、速度、可扩展性及成本控制的部署场景,LinearRAG是最实用的选择。

此外,LinearRAG的代码和数据已开源,为后续研究提供了便利:

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

更多推荐

已为社区贡献346条内容

已为社区贡献346条内容

所有评论(0)