构建属于自己的创意/设计AI智能体?

本文探讨了从通用AI模型向专业领域AI模型的发展趋势,特别聚焦设计领域。文章分析了隐性知识在设计中的重要性及其特征(隐含性、情境特定性等),提出了通过定性研究和AI交互记录法提取隐性知识的方法。重点阐述了如何将设计师行为转化为知识向量,并构建能够理解设计意图、生成连贯行动序列的智能体。文章还讨论了模型训练策略(LoRA、RLHF等)及当前面临的挑战,如知识提取完整性和智能体泛化能力。最后指出,通过

从通用模型到专业领域AI

随着通用大语言模型的发展,GPT、豆包等通用模型逐渐在我们生活中扮演重要的角色。与之相伴的,各个大语言模型都开始往一些细分领域、专业知识方向发展,如何在构建某一个专业垂直领域的AI模型成为人们思考的问题。

为什么需要专业领域的AI模型?

在上一篇文章讨论的普通LLM和具身智能的区别的时候,我们举例了一些AI在具体细分领域的应用,比如电商、汽车驾驶等等。我们能不能用GPT去负责这些事情?似乎有点难为他了。

更普遍的做法都是基于一个已有的模型去利用特定的知识库进行Fine-tune微调,从而让其在某个知识面有更好的表现。这种方法的核心在于:

-

知识专业化:通用模型虽然知识面广,但在特定领域的深度和准确性有限

-

效率提升:专业模型能够更快、更准确地完成领域特定任务

-

成本优化:相比从零训练,微调的成本和周期都大大降低

一、设计领域的特殊性:隐性知识的挑战

1.1 什么是隐性知识?

作为一个设计师,以插画设计师为例,他完成一幅画需要构思很多细节:

-

人物结构:比例、姿态、动态感

-

颜色布局:色彩搭配、明暗对比、视觉层次

-

光线强弱:光源方向、阴影处理、氛围营造

-

构图平衡:视觉重心、留白处理、元素分布

这些概念似乎很难定量去分析。通常来说画家不会拿着一把量尺,每次画都精细到长、宽是多少厘米。相反,他们的创作具有强大的不确定性,每一次的创新都是在一次次尝试、意外中产生的。

我们暂且归纳下,这些设计师在创作使用的知识为**"隐性知识"(Tacit Knowledge)**。

1.2 隐性知识的特征

根据研究,设计领域的隐性知识具有以下特征:

-

隐含性:难以用语言明确表达,更多依赖直觉和经验

-

情境特定性:高度依赖具体的设计场景和上下文

-

主观性:不同设计师可能有不同的理解和应用方式

-

经验驱动:通过长期实践积累,难以快速传授

1.3 隐性知识在图形设计中的表现

研究发现,图形设计中的隐性知识主要通过以下方式体现:

-

操作和认知行动:拥有、感受、预测、判断

-

内部设计元素:颜色、字体、图像、空间

-

潜在目的:视觉和谐、设计趋势、用户体验

许多这些隐性决策严重依赖直觉和经验知识,这使得它们难以表达、编码或分享。

二、如何提取和识别隐性知识?

2.1 方法一:定性研究方法

通过一些定性的方法,比如说访谈,找一些设计师轮流去交流,了解他们的创作的细节、步骤、习惯,然后进行一个归纳。

具体实施步骤:

-

深度访谈

-

与专业设计师进行一对一访谈

-

了解他们的设计流程、决策过程

-

收集设计案例和背后的思考

-

-

标注研究

-

让设计师在创作过程中进行标注

-

记录关键决策点和理由

-

分析设计模式和行为习惯

-

-

系统文献综述

-

梳理现有设计理论和实践

-

识别已知的隐性知识类型

-

建立知识分类框架

-

研究案例: 在一项研究中,从10位专业图形设计师那里收集了123个隐性知识实例,例如:

-

预测设计错误案例

-

组合美观的颜色

-

判断边距空间的合理性

2.2 方法二:AI交互记录法

我们可以让设计师连续一段时间使用GPT等AI模型,然后去记录整理他和AI模型的交互提示词prompt、使用的语言习惯、修改的方向、目的等等。

这种方法的核心优势:

-

自然捕获:在真实工作流程中捕获知识,不打断创作过程

-

行为数据:记录实际的设计行为和决策,而非事后回忆

-

交互模式:了解设计师如何与AI协作,发现协作模式

具体捕获内容:

-

决策步骤:设计师在创作过程中的每个关键决策

-

隐含理由:决策背后的思考逻辑(即使未明确表达)

-

修改轨迹:设计迭代的方向和原因

-

语言习惯:设计师表达设计意图的方式

2.3 知识蒸馏:从行为到向量

基于上面两种方法,可以将设计师的习惯蒸馏为知识向量,作为后续的微调模型的数据集。

知识蒸馏过程:

-

数据收集:收集设计师的创作过程数据

-

特征提取:识别关键的设计模式和决策规则

-

向量化表示:将隐性知识转化为可计算的向量表示

-

知识库构建:建立结构化的知识库用于模型训练

三、生成式AI在创意探索中的作用

生成式AI不仅可以作为表达隐含设计构思意图的工具,还可以作为交互系统内创意探索的触发器。

3.1 AI如何辅助设计师?

AI模型应该通过以下方式帮助设计师:

-

为模糊的文本查询建议更具体的探索方向

-

设计师输入"想要一个温暖的配色"

-

AI建议具体的色彩方案和探索路径

-

-

支持基于图像的修改以表达特定的视觉意图

-

设计师上传草图或参考图

-

AI理解视觉意图并提供改进建议

-

-

提供基于关键词的图像修改以根据先前的搜索历史多样化想法探索

-

记录设计师的探索历史

-

基于历史推荐相关但多样化的设计方向

-

四、基于提取的知识构建智能体

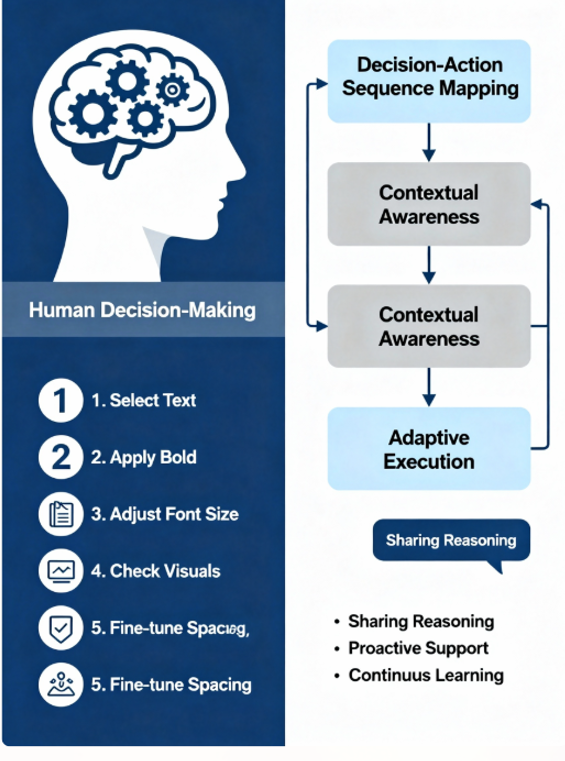

4.1 人类决策与智能体架构的差异

在做出设计决策(例如,"强调这段文本")后,专业人士遵循自己的行动序列来实现该决策:

-

选择文本

-

应用粗体样式

-

调整字体大小

-

检查视觉效果

-

微调间距

然而,这种人类决策与当前的智能体架构存在显著差异。

现有智能体的局限性:

-

单步决策:现有的基于反应结构的智能体通常基于当前任务环境做出决策(即推理),并在其行动空间中执行单个行动

-

缺乏序列性:虽然先前的工作探索了使用任务反思或先前的工作轨迹来增强行动选择的推理,但很少有探索生成与决策相对应的行动序列的智能体架构

-

上下文理解不足:难以理解设计决策的整体意图和长期目标

4.2 从人类决策步骤中学习的智能体

因此,开发一个从人类决策步骤中学习的智能体,以自主生成和执行连贯的行动序列成为需要。

智能体架构设计要点:

-

决策-行动序列映射

-

学习设计师的决策到行动序列的映射关系

-

理解不同决策对应的典型行动模式

-

-

上下文感知

-

理解当前设计任务的整体目标

-

考虑设计风格、用户需求、技术约束等

-

-

自适应执行

-

根据具体情况调整行动序列

-

在保持设计意图的同时灵活应对变化

-

4.3 智能体的协作模式

未来的设计智能体应该能够:

-

分享决策和推理

-

不仅产生设计结果,还解释设计理由

-

与设计师分享推理过程,支持共同创作

-

-

主动支持

-

在整个创意过程中提供主动支持

-

预测设计师的需求并提供建议

-

-

持续学习

-

从每次交互中学习

-

不断改进对设计师习惯和偏好的理解

-

五、模型训练策略

微调方法:

-

LoRA(Low-Rank Adaptation):高效微调,保持原模型能力

-

RLHF(Reinforcement Learning from Human Feedback):基于人类反馈的强化学习

-

知识蒸馏:从大型模型向小型模型传递知识

训练数据组织:

-

决策-行动序列对

-

设计意图-实现方案映射

-

设计模式库

-

风格特征向量

六、挑战与未来方向

6.1 主要挑战

-

知识提取的完整性

-

如何确保捕获了所有重要的隐性知识?

-

如何处理不同设计师之间的知识差异?

-

-

知识表示的准确性

-

如何准确地将隐性知识转化为可计算的形式?

-

如何保持知识的原始含义和上下文?

-

-

智能体的泛化能力

-

如何让智能体适应新的设计任务和场景?

-

如何平衡个性化与通用性?

-

6.2 未来研究方向

-

多模态知识捕获

-

结合视觉、文本、行为等多种模态

-

更全面地理解设计过程

-

-

实时协作框架

-

在实时设计工具中实现人机协作

-

支持设计师和智能体的无缝交互

-

-

知识迁移与共享

-

实现知识在不同设计师之间的共享

-

支持跨领域知识迁移

-

-

可解释性增强

-

让智能体的决策过程更加透明

-

帮助设计师理解和信任AI建议

-

创建属于自己的设计师AI助理是一个充满挑战但也极具前景的方向。通过识别、捕获和重用设计师的隐性知识,我们可以构建出真正理解设计师需求、能够与设计师协作的AI系统。

这不仅能够提升设计效率,更重要的是能够保持设计的创造性和人性化,让AI成为设计师的伙伴而非替代者。

未来的设计工作流程可能会是:设计师与AI助理共同探索创意,AI理解设计师的意图和习惯,提供个性化的支持和建议,而设计师则专注于更高层次的创意决策和审美判断。这样的人机协作模式,将开启设计领域的新篇章。

零基础入门AI大模型必看

陆陆续续也整理了不少资源,希望能帮大家少走一些弯路!

无论是学业还是事业,都希望你顺顺利利 !

1️⃣ 大模型入门学习路线图(附学习资源)

2️⃣ 大模型方向必读书籍PDF版

3️⃣ 大模型面试题库

4️⃣ 大模型项目源码

5️⃣ 超详细海量大模型LLM实战项目

6️⃣ Langchain/RAG/Agent学习资源

7️⃣ LLM大模型系统0到1入门学习教程

8️⃣ 吴恩达最新大模型视频+课件

以上大模型资料包的内容都整理在了我的gzh里,【小灰熊大模型】回复【6】自动掉落,都是🈚️尝分享,可以自取~

更多推荐

已为社区贡献24条内容

已为社区贡献24条内容

所有评论(0)