怎么生成角色一致的AI视频?用这个超强模型就够了

最近 AI 视频圈子卷得厉害,从文生视频到图生视频,大家都在拼画质。但我发现,后台私信被问爆的问题,其实主要还是那个老生常谈的痛点:“AI 视频怎么才能生成角色一致?我想做一个连续剧情,结果第一秒是御姐,下一秒变大妈,心态崩了。这问题问到了点子上。AI 生成单镜头炫技不难,难的是让同一个角色,在不同的场景、不同的动作里,还得是“同一个人”。而这一次,我专门去深度扒了扒,看它到底能不能帮我们这些想做

最近 AI 视频圈子卷得厉害,从文生视频到图生视频,大家都在拼画质。但我发现,后台私信被问爆的问题,其实主要还是那个老生常谈的痛点:

“AI 视频怎么才能生成角色一致?我想做一个连续剧情,结果第一秒是御姐,下一秒变大妈,心态崩了。”

这问题问到了点子上。AI 生成单镜头炫技不难,难的是让同一个角色,在不同的场景、不同的动作里,还得是“同一个人”。而这一次,我专门去深度扒了扒即梦AI 的最新能力,尤其是它的 3.0 Pro 模型,看它到底能不能帮我们这些想做IP、做短剧的创作者搞定“角色一致”这个老大难。

下面是我对着实测案例跑出来的一手总结,不整虚的,全是干货。

一、为什么“角色一致”是 AI 视频的生死线?

以前玩 AI 绘画,抽卡抽得开心就行。但现在是 AI 视频时代:

-

想做连载的剧情号

-

想打造固定的虚拟 IP

-

想让品牌代言人多场景出镜

-

想低成本批量生产叙事视频

这时候,如果你的主角的脸变来变去,体格变大变小,那就跟电视剧拍到一半偷偷把主演换了一样,观众瞬间出戏。

所以我这次评测的核心就一个:👇

到底能不能帮创作者解决 “怎么生成角色一致” 的问题?

二、我深挖了即梦的三个核心能力:结果有点东西

为了验证它的稳定性,我没有用简单的怼脸说话视频糊弄,分别测试了它的 “情绪演绎”、“复杂动作” 和 “切镜能力” 。

下面是基于技术文档的深度解析 👇

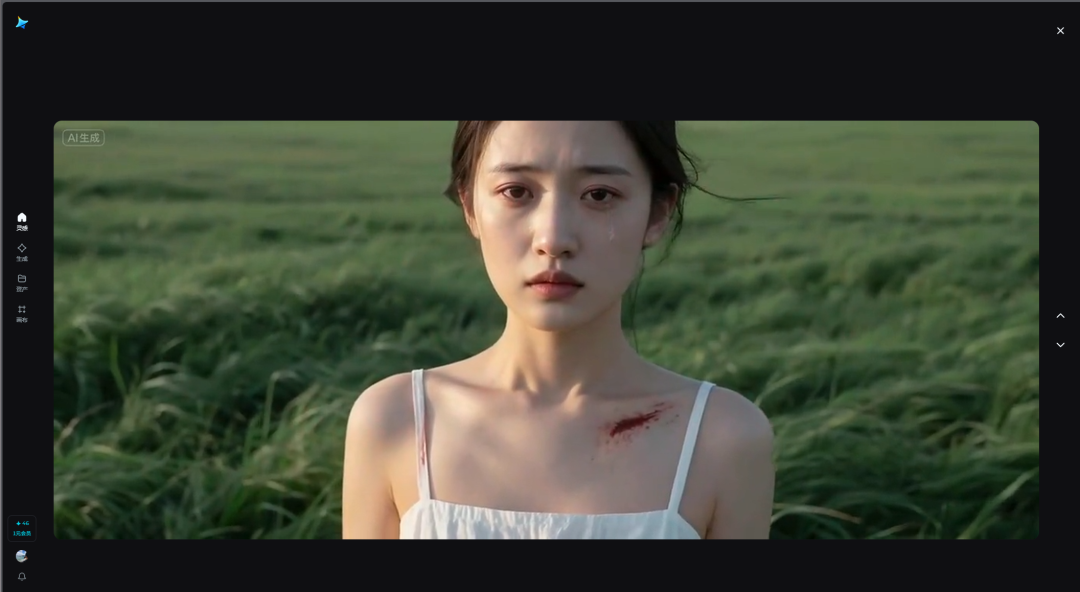

测试1:情绪大起大落,脸崩不崩?

结果:微表情拿捏得很死,脸部特征锁住了。

很多模型做大表情就容易脸部变形。但即梦在这方面表现很稳。它能精准呈现微妙的表情变化,比如挑眉、眼神颤动,甚至害羞时的面部泛红 。

我在测试时发现,无论是“恐惧时瞳孔的收缩”,还是“释然时长舒一口气”,它不仅还原了情绪,更重要的是,五官架构没有因为挤眉弄眼而位移。这意味着你可以让你的主角尽情演戏,不用担心演着演着变了个人。

测试2:图生视频,动起来还像吗?

结果:动作幅度再大,核心特征依然在线。

这是大家最关心的。即梦的逻辑是 “图+文生视频”,它能依据 Prompt 和图片信息精确响应 。

我试了下让角色做一些进阶动作,比如“快速奔跑”或者“用力挥手”。在常规的叙事动作里,人物的体态、服饰细节保持得相当完整。它不会因为动作大,就把衣服的纹理、发型给“甩”没了或者五官“错位”。

测试3:独门绝技“切镜”,这才是杀手锏

结果:这是真正的“一致性神器”。

大多数 AI 视频工具,换个镜头就得重新生成,这时候脸最容易变。但即梦支持 在同一个 Prompt 里写多个切镜 。

这功能简直是为叙事而生的。你可以在一段提示词里写:

-

镜头一:全景,女孩站在悬崖边。

-

镜头二:特写,她眼神坚定。

-

镜头三:中景,她转身离去 。

即梦能在一个视频里生成这些连续画面,保持主体、风格、场景的高度延续性 。这一招,直接从根源上解决了“怎么生成角色一致”的痛点,因为它压根就是在同一次生成里完成的。

三、即梦是怎么做到“角色一致”的?

用大白话解释技术原理:

即梦模型拥有极强的 语意遵循能力 。这就好比你跟一个专业的摄影师沟通,你只要描述得够准,它就能听懂。

更重要的是它的 风格延续 机制 。当你上传一张参考图后,模型会自动识别并锁定风格的核心特征(比如 2D 动漫的线条、3D 卡通的建模感、真人的五官轮廓) 。

哪怕你需要“无中生有”一些画面里原本没有的元素,它也能智能补全,让新元素和原本的画风无缝融合 。这就是为什么你的角色走到新场景里,依然是那个“TA”。

四、既然这么强,那怎么用才最稳?(保姆级教程)

想要搞定“怎么生成角色一致”,光靠工具不行,还得会写 Prompt。我也总结了一套 “锁脸五步法” 👇

✅ 步骤1:打造一个“全能”的人物外形公式

想锁住脸,描述必须精准。即梦推荐的公式是:核心特征 + 年龄性别 + 身材/体态 + 服饰风格 。

比如,别只写“一个美女”,要写“一位戴着金丝眼镜、身着白大褂的温柔女医生,手持病历夹” 。描述越具象,AI 越不容易发挥过头。

✅ 步骤2:善用“图生视频”起手

如果你对画面一致性要求极高,强烈建议使用“图+文生视频”模式 。 先用文生图跑出一张满意的“定妆照”,然后把它作为参考图喂给视频模型。因为图生视频更多依赖图像本身的信息,风格和长相直接由原图决定,你只需要用文字控制动作和镜头 。

✅ 步骤3:切镜写法要规范

想做连续剧情,一定要学会用切镜。格式很简单,直接在提示词里写 “切镜:” 或者 “镜头一、镜头二” 。

例如:

镜头一:全景俯拍XXX站在空旷停车场……

镜头二:镜头缓慢推近XXX……

镜头三:中景接车视角,XXX坐进车内......

这样模型就知道这是同一场戏,自然会帮你锁住角色。

✅ 步骤4:风格描述要直白,别整虚的

为了保持风格一致,不要写“美美的”、“风格酷酷的”这种主观词,模型听不懂 。 要直接写:“真人写实”、“3D动画”、“黑白线稿风格”、“赛博朋克” 。风格词越明确,画面崩坏的概率越低。

✅ 步骤5:动作指令要简洁

虽然我们想做大片,但为了稳,动作描述不要太贪心。 如果输入的动作超过三个,模型响应会下降,容易出乱子 。 推荐起手式:“主体”+“单动作” 。比如“老虎走路”、“机器人向前跑” 。先把简单的动作做稳了,一致性自然就有了。

五、“生成角色一致”?这就目前的最优解

在 AI 视频这个还在野蛮生长的阶段,我们创作者最怕的就是不可控。

而即梦AI给我最大的感受是,它试图把这种“不可控”变成“可控”。它不仅给了我们高质量的画质,更通过 参考图逻辑 和 切镜功能,给了我们一条低成本做连续内容的路。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)