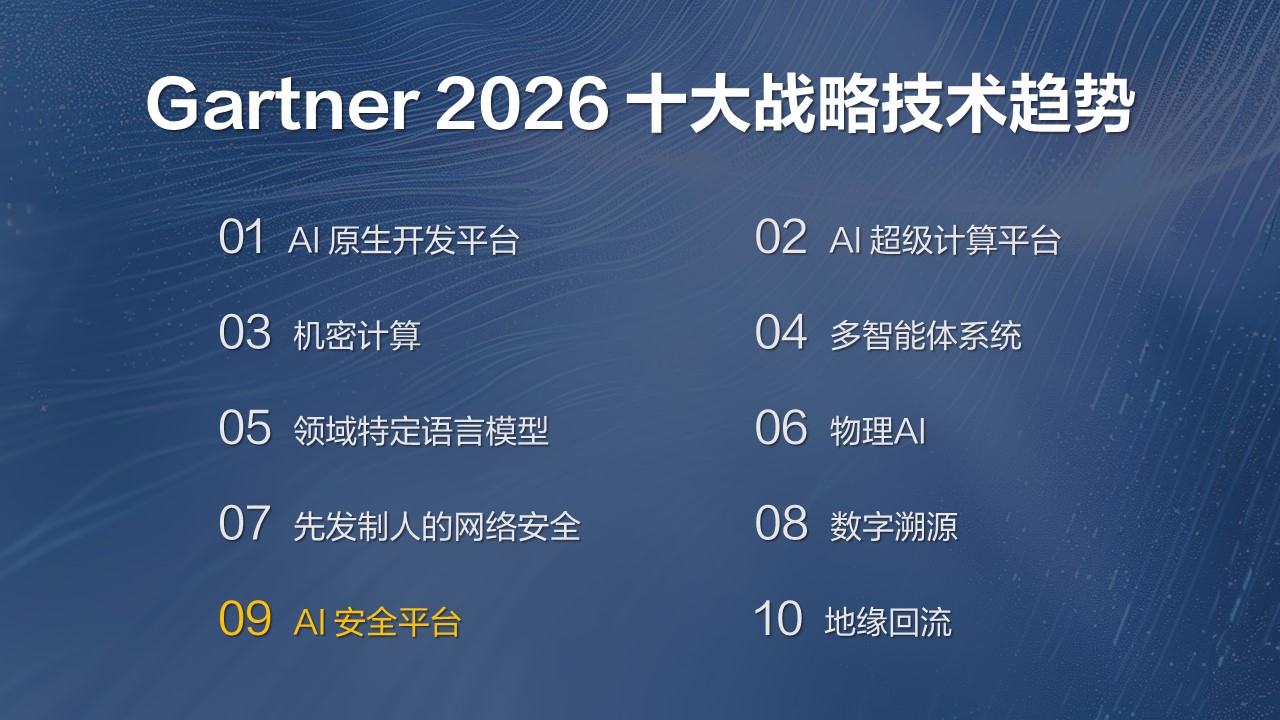

Gartner 2026十大战略技术趋势:AI安全平台成企业刚需

直击提示注入攻击、恶意智能体行为与数据泄露风险,为AI时代企业构建竞争壁垒。

近日,全球权威机构Gartner发布《2026年重点关注的十大战略技术趋势》报告。其中提出,AI安全平台(AISPs)将成为企业保护AI投资、构建竞争壁垒的关键支撑。预计到2028年,超半数企业将采用AI安全平台,而约八成未经授权的AI操作将来自内部违规,凸显了平台的管控价值。

AI技术正成为企业数字化转型的“必选项”,驱动着效率跃升与业务创新。但伴随大模型、智能体的规模应用,AI原生风险也爆发式增长。国家网信办《生成式人工智能服务管理暂行办法》明确要求,企业需落实AI安全主体责任,筑牢技术与合规双重防线。

AI原生风险:传统安全体系的短板

AI技术的非结构化输入、多语言交互、上下文依赖等特性,让传统安全工具陷入查不清也防不住的困境,三类核心风险已从理论走向现实。

1、提示注入攻击

攻击者通过篡改输入指令,诱导AI模型绕过预设的安全规则,从而生成恶意内容或泄露敏感信息。2024年,ChatGPT曾因该漏洞被诱导生成恶意代码,传统关键词过滤机制无法解析语义关联,完全失去防御效果。

这类攻击隐蔽性强,小到诱导生成违规内容,大到窃取企业核心信息,给业务安全带来直接冲击。

2、恶意智能体行为

攻击者通过篡改模型参数、劫持控制权或协同攻击,使AI系统在特定条件下执行非法操作,如数据窃取、系统破坏等。2024年,微软Azure AI“健康助手机器人”的权限提升漏洞,险些导致数百租户的敏感健康数据泄露;美国人工智能公司Anthropic为Claude模型新增的Computer Use功能,可能因提示词注入下载并运行恶意软件,扩大了潜在威胁面。

这类风险不仅破坏系统稳定性,更直接威胁数字资产安全。

3、数据泄露

AI模型训练与推理需处理海量数据,包括用户隐私、企业机密、业务数据等。由于权限配置错误、API接口暴露等问题,数据泄露事件频发。2024年,ChatGPT因接口漏洞导致用户对话数据被第三方访问,Claude模型因权限管理问题泄露训练数据片段。

此类事件引发合规风险的同时,还会削弱企业核心竞争力。

平台价值:AI安全平台为何成为企业刚需?

传统安全工具的失效

AI模型的输入具有非结构化、多语言、上下文依赖等特点,传统安全检测手段难以适应这种复杂性。例如,无法识别跨语言恶意指令、语义模糊的攻击话术等。AI安全平台通过零信任架构与动态策略调整,填补了传统安全工具的防护缺口,为企业提供更全面的安全防护方案。

内部违规行为的威胁

Gartner预测,到2028年约八成未经授权的AI操作将来自内部违规。例如,员工因疏忽或恶意,通过API接口泄露敏感数据、篡改模型参数等。AI安全平台通过细粒度访问控制、AI使用策略强制执行和行为审计,帮助企业构建内部风险的防控网,有效遏制内部违规行为的发生。

行业合规要求的约束

随着《生成式人工智能服务管理暂行办法》《数据安全法》《个人信息保护法》的落地实施,企业AI应用需满足安全合规要求。AI安全平台的身份验证、数据脱敏、审计追溯等功能,帮助企业对接合规标准。

未来趋势:AI安全平台赋能企业核心竞争力

Gartner将AI安全平台列为2026年十大战略技术之一,其价值远不止风险防控,更关乎企业数字化进程的可持续性。AI安全不再是“成本中心”,而是企业构建信任生态、赢得市场竞争的核心资产。

AI安全平台以“AI治理+安全监控+风险管理”为核心,通过三大路径帮助企业打造可持续竞争优势:

- 技术架构转型:将AI安全能力嵌入开发、运维和数据流程,实现从虚拟机、网络、API到模型层的全覆盖防护,构建可编排、可扩展的云原生安全架构,规避单体AI系统风险,为企业转型提供技术支撑。

- 信任生态构建:通过大模型防火墙和数据防护模块,构建模型输入输出可信管道,实现模型、数据与应用的全生命周期可控可溯,为企业打造安全、可信的AI应用生态。

- 主动风险管理:通过漏洞扫描、对抗测试、攻击模拟等功能,将未知威胁转化为可量化、可处置的安全指标,形成闭环的风险管理体系,提前发现并应对潜在风险,确保AI应用的稳定运行。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)