Dify实战:打造你的第一个AI应用,开发者必备收藏教程!

Dify是一款开源的LLMOps平台,专为生成式AI应用开发设计,提供可视化拖拽、全栈支持和开源免费等特性。本文详细介绍了在Windows 11上部署Dify的完整流程,包括环境准备、获取源码、启动中间件、设置后端服务和Web服务等步骤。通过Dify,开发者可以零门槛构建AI应用,无需从零搭建Prompt编排、RAG引擎和Agent框架,大幅降低AI应用开发门槛。

AI 应用开发的风口越来越热,但门槛依然让不少人望而却步。想象一下:你有一个绝妙的 AI 创意,却要从头搭建 Prompt 编排、RAG 引擎和 Agent 框架?这听起来像是一场马拉松。但今天,我要带你用 Dify 这个开源神器,轻松搞定一切!

为什么选择 Dify?

Dify 不是一个简单的聊天机器人框架,它是一个完整的 LLMOps 平台,专为生成式 AI 应用而生。不同于偏向研究的 LangChain,Dify 更注重生产级落地:

- 可视化拖拽:零代码设计工作流,Prompt、数据集、插件一键集成。

- 全栈支持:内置数百个 LLM 模型接入(OpenAI、Anthropic 等),加上高质量 RAG 和 Agent 框架。

- 开源免费:GitHub 上星标 20k+,社区活跃,适合个人开发者或小团队快速 MVP。

环境准备

- 系统要求:CPU>=2;内存>=4

- 安装Docker和Docker Compose

- Dify的github源代码

- 良好的网络支持

- 安装过程以windows 11为例

部署安装步骤

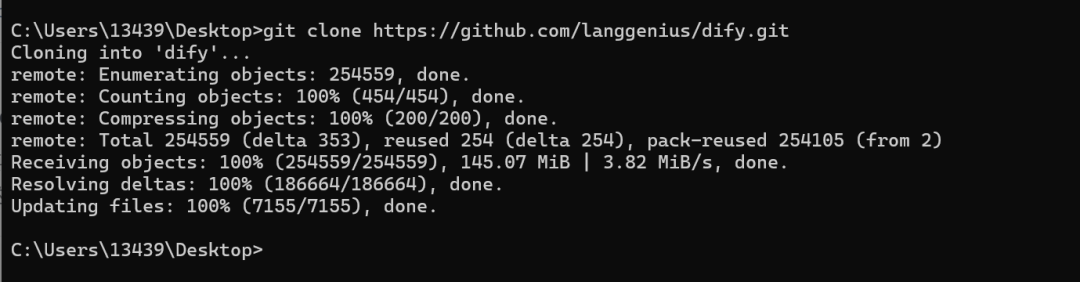

- 获取Dify源码

git clone https://github.com/langgenius/dify.git

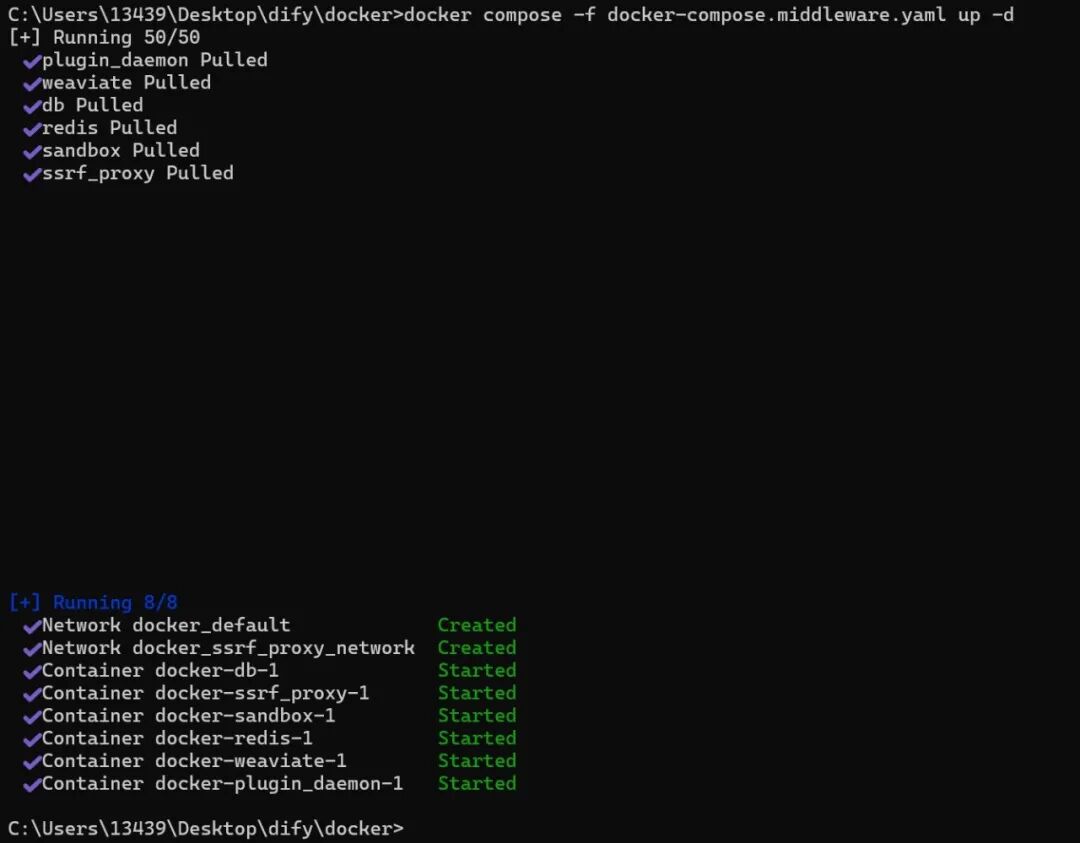

- 使用Docker Compose启动中间件

Dify后端服务需要一系列用于存储的中间件,例如PostgreSQL/Redis/Weaviate;Dify扩展功能,例如Dify Sandbox和 plugin-daemon服务。

执行命令:

cd docker

copy middleware.env.example middleware.env

docker compose -f docker-compose.middleware.yaml up-d

设置后端服务

后端服务包括API服务和Worker服务。API服务为前端和API访问提供API请求支持;Worker服务为数据集处理、工作区、清理等异步任务提供服务。

- 启动API服务

- 进入api目录

cd api #进入api目录

copy .env.example .env #复制环境变量配置文件

- 生成一个Base64随机密钥,并替换.env文件中SECRET_KEY的值。

f4r7W6iJ0eP3lN9mK2sQ8vH1uY5tG0xZcB7nA4pE9oD6jL3hR8iM1qV2wU5yT0gF

-

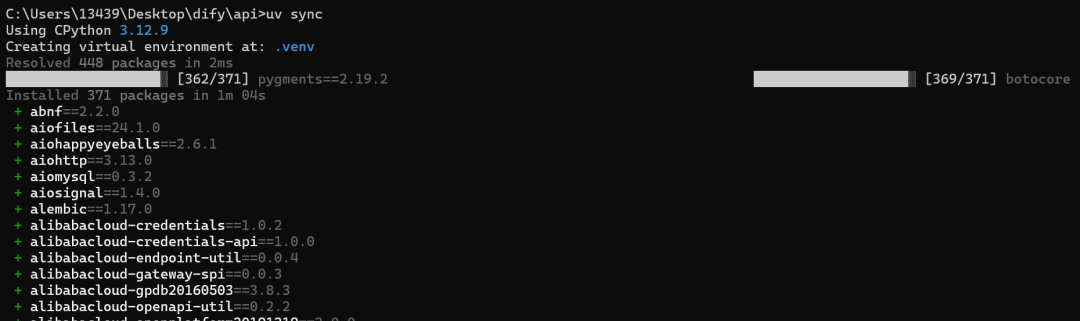

依赖项管理

uv用于管理依赖项。uv运行以下命令安装所需的依赖项:

uv sync

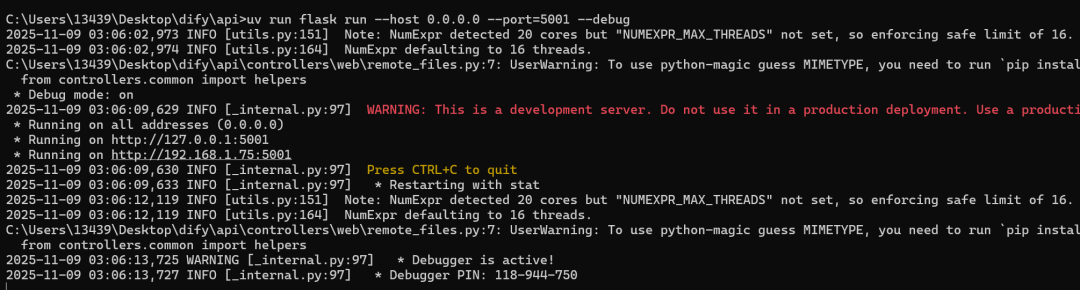

- 启动API服务

uv run flask run --host0.0.0.0 --port=5001 --debug

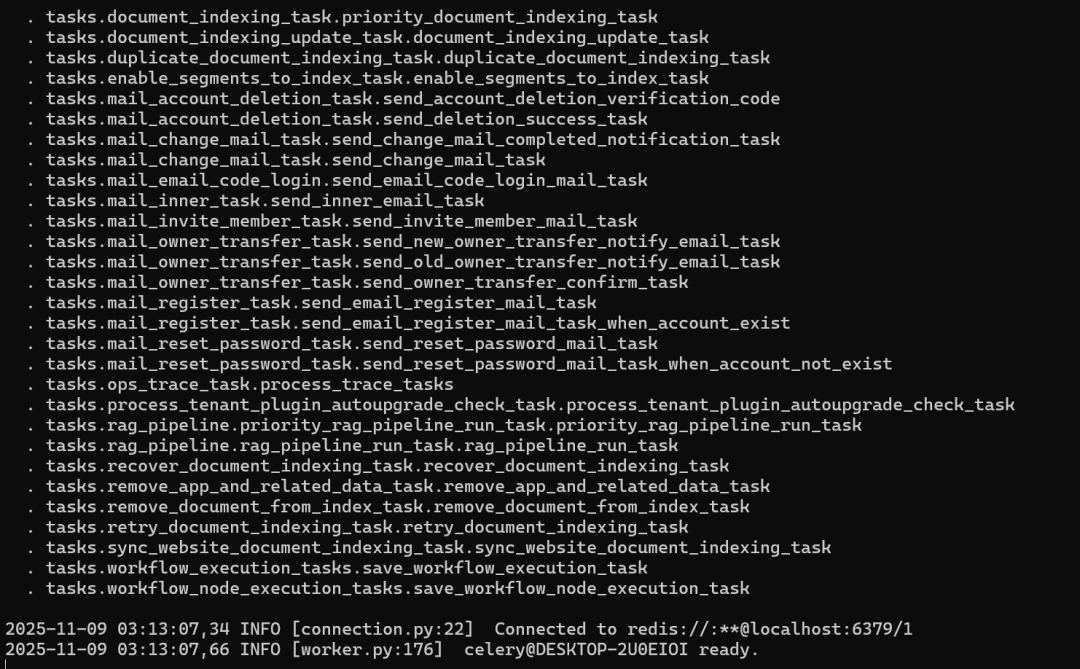

- 启动Worker服务

要从队列中处理异步任务,例如数据集文件导入和数据集文档更新,需要按照以下步骤启动Worker服务。

uv run celery -A app.celery worker -P solo --without-gossip --without-mingle -Q

dataset,generation,mail,ops_trace --loglevel INFO

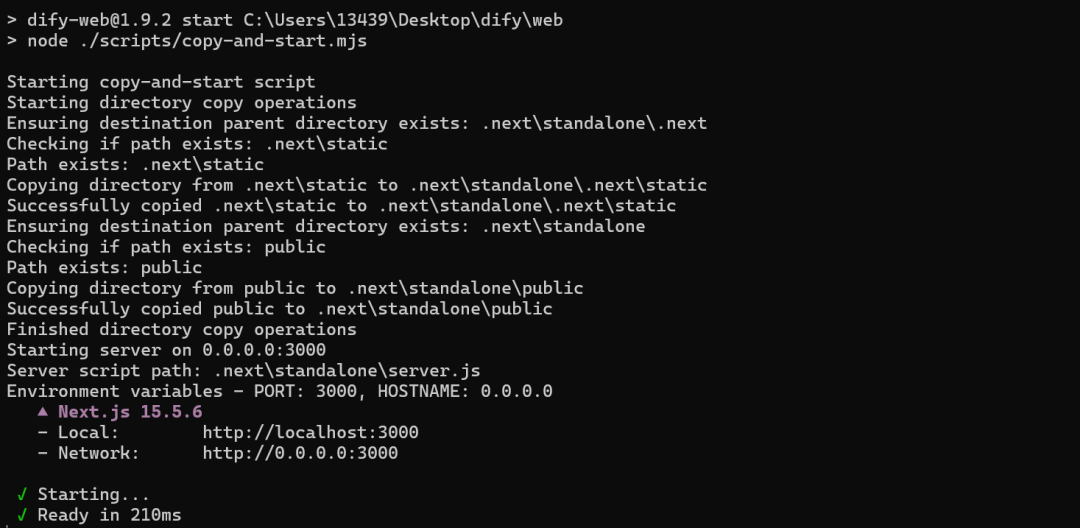

设置Web服务

启动前端Web服务,需要NodeJS22和PNPM v10。

- 安装Nodejs和PNPM

访问https://nodejs.org/en/download并选择适用于您操作系统的 v22.x 或更高版本的安装包。建议常用版本使用 LTS 版本;直接运行npm i -g pnpm即可。

- 安装运行依赖

cd web #进入web目录

pnpm install --frozen-lockfile

- 编辑环境变量配置文件

copy .env.example .env.local # 单机部署保持默认配置即可

- 构建并启动Web服务

pnpm build & pnpm start

#pnpm build不能正常执行时,请以管理员身份运行

如何学习AI大模型?

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

这份完整版的大模型 AI 学习和面试资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

这是一份大模型从零基础到进阶的学习路线大纲全览,小伙伴们记得点个收藏!

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

100套AI大模型商业化落地方案

大模型全套视频教程

200本大模型PDF书籍

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

LLM面试题合集

大模型产品经理资源合集

大模型项目实战合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献462条内容

已为社区贡献462条内容

所有评论(0)