PeerLLM产品分析:去中心化AI时代的新社会契约

摘要 PeerLLM是一款去中心化AI网络产品,旨在解决当前AI发展中的集中化风险和社会经济问题。其核心架构由主机(个人电脑)、协调器网络和消费者组成,形成一个点对点AI计算市场。产品特点包括:1)将闲置算力转化为被动收入来源;2)保护数据主权和抗审查;3)建立涵盖计算、数据和模型的多维交易市场。通过去中心化设计,PeerLLM希望实现AI权力的重新分配,让普通用户也能参与并受益于AI经济。与传统

PeerLLM产品分析:去中心化AI时代的新社会契约

概述

随着人工智能(AI)的飞速发展,它在带来空前生产力的同时,也引发了工作岗位流失和权力过度集中的双重挑战。PeerLLM正是在这一背景下诞生的,它是一个去中心化、点对点(P2P)的网络,目的是为了创建一个新的、开放的AI驱动经济。本文将基于其白皮书和官方网站,对PeerLLM的产品背景、核心功能、解决的痛点以及实现架构进行全面分析。

产品背景

AI集中化的经济与社会挑战

当前的AI发展模式正在从根本上重塑全球经济,但也带来了集中化的巨大风险和经济中断。

- 大规模工作岗位取代:AI正在加速自动化工作,导致各行各业的工人被广泛取代,造成许多人陷入不稳定的财务困境。

- 算力与控制权集中:绝大多数计算能力和控制权集中在少数大型公司手中。这种集中化带来了以下风险:

- 单点故障:中心化服务器容易遭受中断和攻击,影响数百万用户的服务。

- 审查与控制:中央机构可以决定哪些想法和应用是允许的,从而扼杀创新和自由表达。

- 数据隐私风险:用户必须将敏感数据委托给公司,为大规模数据泄露创造了极具吸引力的目标。

PeerLLM正是为应对这些挑战而设计的“解药”,它寻求通过一种新的经济和社会模式,确保技术进步的成果被广泛分享。

功能分析

PeerLLM的核心愿景是让任何拥有个人电脑的人都能成为新AI经济中的主权利益相关者。它是一个社区驱动的生态系统,让用户能够从人工智能中贡献资源并赚取被动收入。

核心三层架构(Tri-Nature Architecture)

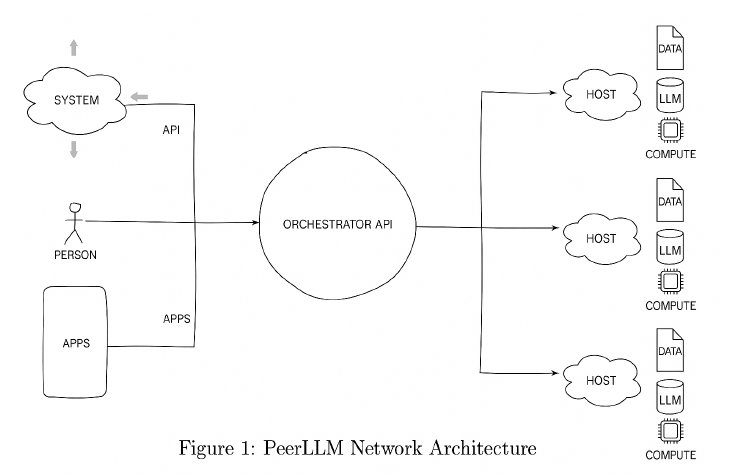

PeerLLM网络由三个协同工作的主要组件构成,形成一个无缝的去中心化AI计算市场:

- 主机(The Host):

- 运行一个或多个大语言模型(LLMs)的个人电脑。

- 主机应用是一个轻量级客户端,它向网络协调器注册,并宣布其可服务的模型和可用性。

- 它利用本地硬件(CPU或GPU)处理传入的提示请求。

- 角色:计算提供者(Compute Providers)、数据提供者(Data Providers)、模型提供者(Model Providers)。

- 协调器(The Orchestrator / Network):

- 充当发现和路由机制的网络层。

- 维护实时活跃主机的注册表和其能力。

- 使用负载均衡算法公平分配工作负载。

- 功能:路由(Routing)、核算(Accounting,跟踪资源使用和管理补偿)、治理(Governance)。

- 消费者(The Consumer):

- 任何需要AI处理并集成到PeerLLM网络的实体。

- 消费者对服务请求的主机是不可知的,确保体验的无缝和弹性。

- 形式:终端用户应用、开发者和系统集成(调用API)、第二层AI系统(复杂的AI代理)。

- 交互模式:人与人(P2P)、人与系统(P2S)、系统与系统(S2S)。

PeerLLM市场(The PeerLLM Marketplace)

该网络引入了一种新的经济模型,创建了一个去中心化的市场,参与者可以在其中买卖多种数字资产:

- 计算能力(Compute):主机所有者因提供计算能力而获得补偿,这直接将闲置硬件转化为生产性资产和可靠的被动收入来源。

- 数据作为商品(Data as a Commodity):主机拥有出售其所拥有的精选数据集的主权,用于AI训练或其他目的,从而直接、安全地将其信息变现。例如,艺术家可以出售其作品集来训练特定风格的生成模型。

- 模型与智能(A Marketplace for Intelligence):开发者可以对专业LLMs进行微调和训练,并将其出售给网络上的其他主机,通过每一次销售赚取收入。

解决了什么问题

PeerLLM旨在解决中心化AI模式下的核心痛点:

| 中心化AI带来的痛点 | PeerLLM的解决方案 |

|---|---|

| 工作岗位被取代与经济不稳定 | 赋予个人将闲置电脑转化为生产性资产、赚取被动收入的能力,在AI经济中为个体创造生存和发展的路径。 |

| 权力集中与审查风险 | 去中心化网络没有中央权威机构,确保了抗审查性,保护了真正的知识自由,防止AI被垄断。 |

| 大规模数据泄露和隐私风险 | 提示被发送到单个主机处理,从不存储在中央服务器上,将敏感信息的控制权保留在用户手中(数据主权),最大限度地减少大规模泄露的攻击面。 |

| 缺乏信任和公平性 | 通过可验证的信任系统和透明、可审计的交易账本,确保所有贡献者都能获得公平的报酬。 |

产品实现分析

技术架构

PeerLLM的系统实现基于去中心化、弹性和安全的原则,依赖于上述的主机、协调器和消费者三大组件。

工作流程总结:

- 消费者将AI请求(提示)发送到协调器的公共端点。

- 协调器根据请求的模型、主机信誉和网络延迟等因素,选择最合适的主机。

- 提示被安全地路由到选定的主机。

- 主机使用其本地LLM处理提示。

- 生成的响应通过协调器流式传输回消费者。

产品实现的逻辑图(架构描述):

在PeerLLM网络架构中,协调器API(Orchestrator API)**是核心枢纽。它将需要AI计算的实体(包括个人、应用和系统等消费者)连接到网络中分布式的主机。每个主机(Host)都提供其自身的**数据(Data)、大语言模型(LLM)**和**计算资源(Compute),并通过协调器接收和处理请求。

技术优势

这种去中心化架构带来了关键优势:

- 鲁棒性和弹性:网络没有单点故障。即使一个或数百个主机离线,网络也能无缝地将请求路由到其他可用节点,持续运行。

- 安全性:所有通信均采用端到端加密。

- 透明性:所有交易都记录在一个透明、可审计的账本上,以确保公平和可验证的补偿。

产品优势

PeerLLM与传统的中心化AI平台相比,最大的优势在于将权力和利益重新分配给了个体和社区。

- 多市场设计(Multi-Marketplace):主机可以在一个集成生态系统中出售计算能力、数据、模型和训练服务。这创造了一个强大的飞轮效应:更多样的模型和数据吸引更多消费者,增加需求,从而提高主机的收入,进一步去中心化并增强网络。

- 赋能个体与创造被动收入:任何人只需运行网络主机,即可将闲置的个人电脑转化为生产性资产和被动收入来源。这种模式使个人能够将独特的技能和创作(如艺术家的风格或专业知识)转化为AI经济中可持续的收入流。

- 防止AI集中化:通过去中心化所有权,确保AI保持分布式、多样化和社区驱动,从而保护AI的未来不被单一实体垄断。

- 广泛可访问性:PeerLLM的设计目标是面向所有人开放,从高级开发者到没有技术技能的普通人都可以参与和贡献。未来的路线图包括构建用户友好的一键式安装程序,以简化主机设置。

PeerLLM与传统的LLM算力调度平台

PeerLLM与传统的LLM算力调度平台在架构、资源来源、商业模式和核心愿景上存在本质的区别。

传统的LLM算力调度平台主要是一个中心化、以效率为导向的技术服务;而PeerLLM则是一个去中心化、以公平和个体赋权为核心的经济生态系统。

以下是两者之间的详细区别:

| 维度 | PeerLLM:去中心化AI网络 | 传统LLM算力调度平台 / 智算中心 |

|---|---|---|

| 核心架构 | 去中心化、点对点(P2P)网络。网络由分散的主机(Host)、**协调器(Orchestrator)和消费者(Consumer)**构成。 | 中心化平台。通常是基于大型云计算或“智算中心”,算力资源集中在少数大型公司手中。 |

| 算力来源 | 分散的个体资源。利用个人电脑的闲置硬件(CPU/GPU)作为主机提供算力。任何拥有个人电脑的人都可以成为资源提供者。 | 集中式、专业级硬件。使用大规模、专业化的GPU算力集群(如万卡级集群)和异构算力(NVIDIA、昇腾等)。 |

| 经济/商业模式 | 多市场生态系统。主机不仅出售计算能力,还可以出售私有数据、定制模型和训练服务,形成一个去中心化的AI经济市场。个人可以通过贡献资源获得被动收入。 | IaaS/PaaS服务。主要提供计算资源、模型部署、训练和推理服务。以商业服务和最大化资源利用率为目标。 |

| 调度核心 | 公平性与声誉(Fairness & Reputation)。协调器在调度时会考虑请求模型、主机信誉和网络延迟,以确保工作负载公平分配。 | 性能与效率(Performance & Efficiency)。调度策略基于技术指标,例如基于前缀缓存(KV Cache亲和性)、LLM指标、最少请求/token等进行智能分配和负载均衡,以提升推理效率。 |

| 安全与控制 | 数据主权与抗审查。提示被发送到单个主机处理,从不存储在中央服务器上,最大限度地减少大规模数据泄露的攻击面。网络没有中央权威机构,因此具有抗审查性。 | 集中式控制与风险。数据和控制权集中在平台所有者手中。存在数据泄露、审查和单点故障的风险。 |

| 核心愿景 | 个体赋权与社会契约。目标是民主化AI所有权,让普通人能够从AI革命中获益,解决AI导致的工作取代和权力集中问题。 | 商业效率与产业赋能。目标是为企业提供全栈AI能力支撑,加速AI模型在产业中的落地应用和数智化转型。 |

PeerLLM将AI算力从企业级数据中心转移到了个体用户,将算力服务转化为一个多资产交易的去中心化市场。它的重点不在于对专业级算力集群进行最高效的技术调度,而在于建立一个公平、有弹性且对个人友好的经济模型,让被AI取代工作的人有机会通过贡献资源在AI经济中继续生存和发展。

传统的LLM算力调度平台则致力于在中心化、高性能的硬件基础上,通过先进的调度算法(如KV Cache亲和性调度)来最大限度地提高推理效率和服务性能,为企业提供高质量的AI服务。

总结

PeerLLM不仅仅是一个技术项目,它更是一场旨在AI时代建立一个更公平、更具弹性、更自由的经济未来的运动。通过将控制权去中心化并重新分配AI带来的经济利益,PeerLLM旨在赋予那些原本可能被时代淘汰的个人和社区权力。随着项目进入Alpha阶段并计划构建市场基础设施,PeerLLM宣告了中心化智能时代的终结,迎来了人民的AI时代。

参考url

- https://www.peerllm.com/

更多推荐

已为社区贡献14条内容

已为社区贡献14条内容

所有评论(0)