LocalAI:一个免费开源的AI替代方案,让创意更自由!

LocalAI是一个开源自托管AI框架,可作为OpenAI等商业方案的替代品,支持文本生成、语音合成、图像处理等功能。其亮点包括本地部署、数据隐私保护、低硬件要求(无需GPU),并提供Docker容器化部署方案。项目支持多种AI模型,适用于企业应用、教育、内容创作等场景,相比同类开源方案更注重易用性和去中心化特性。通过简单安装即可实现本地AI推理,是低成本使用AI技术的理想选择。

LocalAI:开源自托管的AI模型替代方案

在当前的人工智能技术蓬勃发展的大环境下,许多企业和个人都希望能够利用AI技术提升自己的工作效率,尤其是自然语言处理、语音识别和图像生成等领域。然而,面对诸多商业AI解决方案,价格往往成为使用者的一大障碍。今天,我们将为大家介绍一个强大且免费的开源项目——LocalAI,它是OpenAI及其他服务的自托管替代方案,能够运行在消费级硬件上,无需GPU支持,适合各类应用场景。

项目概述

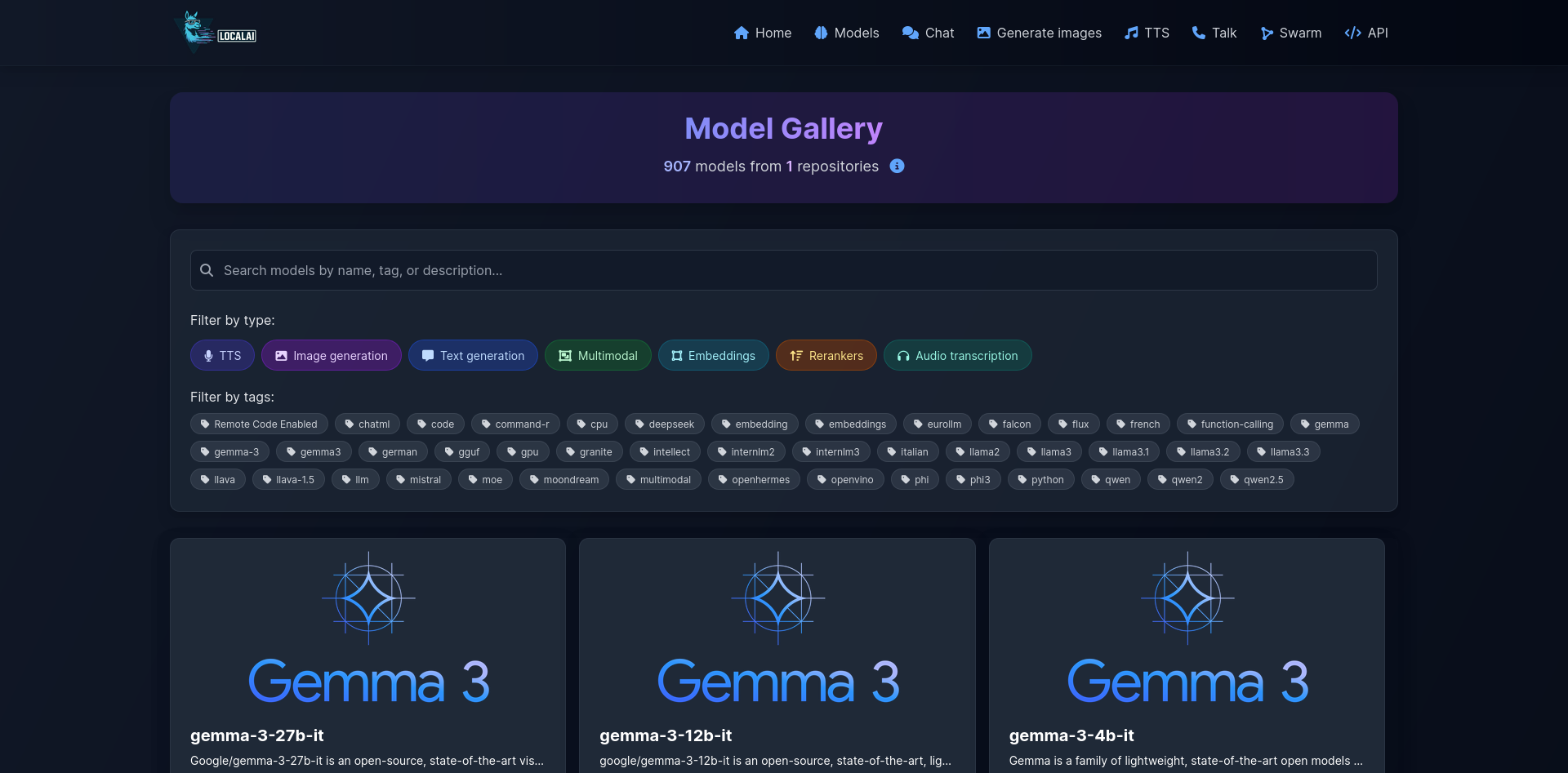

LocalAI是一个支持多种人工智能模型的开源框架,包括文本生成、语音合成、图像生成等功能。其设计理念是提供一个简易上手、灵活性强且数据安全的AI应用环境,支持各种模型(如gguf、transformers和diffusers等),并允许用户在本地或内部服务器上运行推理。此外,LocalAI注重去中心化和分布式处理,允许多用户环境下的协作。

主要特点

LocalAI具备以下核心功能:

- 生成文本、音频、视频、图像及语音克隆:无论是写作助手、播客制作还是图像创作,LocalAI都能满足你的需求。

- 分布式和去中心化推理:支持P2P网络,能够在多台设备之间协同工作。

- 自托管与本地优先:用户可轻松将其部署在私有服务器或本地计算机上,确保数据隐私。

- 无须高性能硬件:LocalAI可在普通的消费级硬件上运行,无需高昂的GPU设备。

典型应用场景

-

企业应用:公司可以利用LocalAI的文本生成能力,用于自动化客户服务、生成产品描述或内容创建。通过自托管的方式,企业能够对数据安全进行控制,避免关键数据泄露。

-

教育领域:教育机构可利用LocalAI创建个性化的学习助手,提供针对特定学科的智能反馈和推荐,助力学生自主学习。

-

内容创作:独立创作者或小型团队可以利用LocalAI生成音频、视频甚至图像内容,以便在社交媒体和市场营销中吸引更多的受众。

-

研究与实验:科研人员可以在本地实验和测试各种AI模型,减少对云服务的依赖,进行高效的数据处理和分析。

安装与使用方法

使用LocalAI非常简单,用户只需通过安装脚本即可完成环境配置。以下是基本的安装步骤:

# 基本安装方法

curl https://localai.io/install.sh | sh

此外,LocalAI还提供了Docker镜像,便于在容器化环境中部署。以下是CPU和GPU的Docker运行示例:

CPU版本

docker run -ti --name local-ai -p 8080:8080 localai/localai:latest

NVIDIA GPU版本

# CUDA 12.0支持

docker run -ti --name local-ai -p 8080:8080 --gpus all localai/localai:latest-gpu-nvidia-cuda-12

AMD GPU版本

docker run -ti --name local-ai -p 8080:8080 --device=/dev/kfd --device=/dev/dri --group-add=video localai/localai:latest-gpu-hipblas

Intel GPU版本

docker run -ti --name local-ai -p 8080:8080 --device=/dev/dri/card1 --device=/dev/dri/renderD128 localai/localai:latest-gpu-intel

用户可以根据需要选择适合的版本进行安装,确保本地环境能够顺利运行LocalAI的所有功能。

使用示例

安装完成后,您可以通过命令行接口快速调用LocalAI的功能。以下是一些基本的使用示例:

-

生成文本:

local-ai run llama-3.2-1b-instruct:q4_k_m -

直接从Hugging Face加载模型:

local-ai run huggingface://TheBloke/phi-2-GGUF/phi-2.Q8_0.gguf -

通过配置文件运行模型:

local-ai run https://gist.githubusercontent.com/.../phi-2.yaml

这些简单的命令即可启动模型并进行推理,帮助用户快速上手。

功能详解

LocalAI的功能涵盖了文本生成、音频合成、图像生成等多个方面,以下是详细的功能介绍:

-

文本生成:支持多种模型,包括GPT和LLM,用户可以生成高质量的文本内容,用于聊天机器人、自动写作等场景。

-

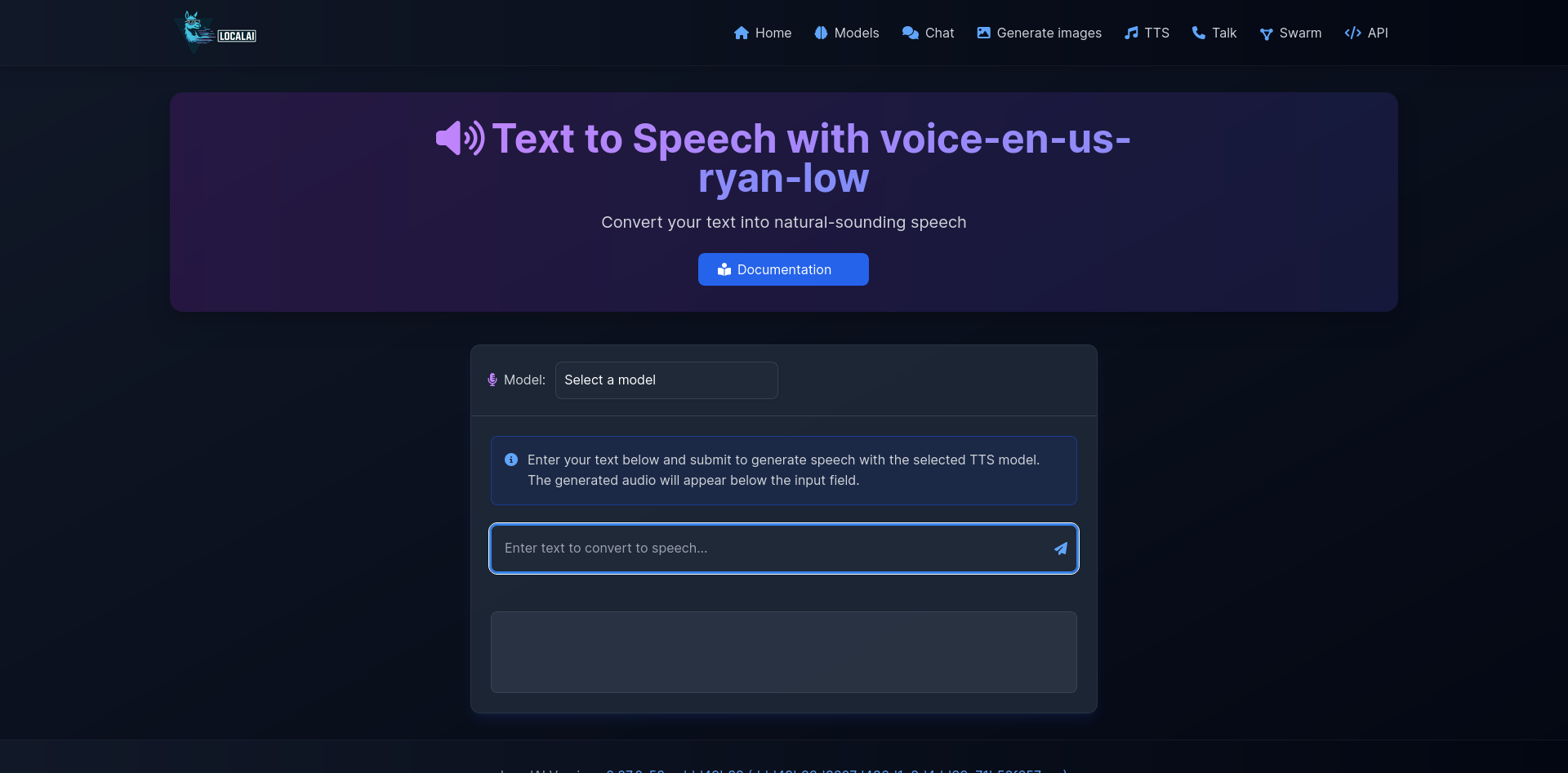

语音合成:能够将文本转换为自然流畅的语音,支持多种语音风格和语言,适合语音助手和播客应用。

-

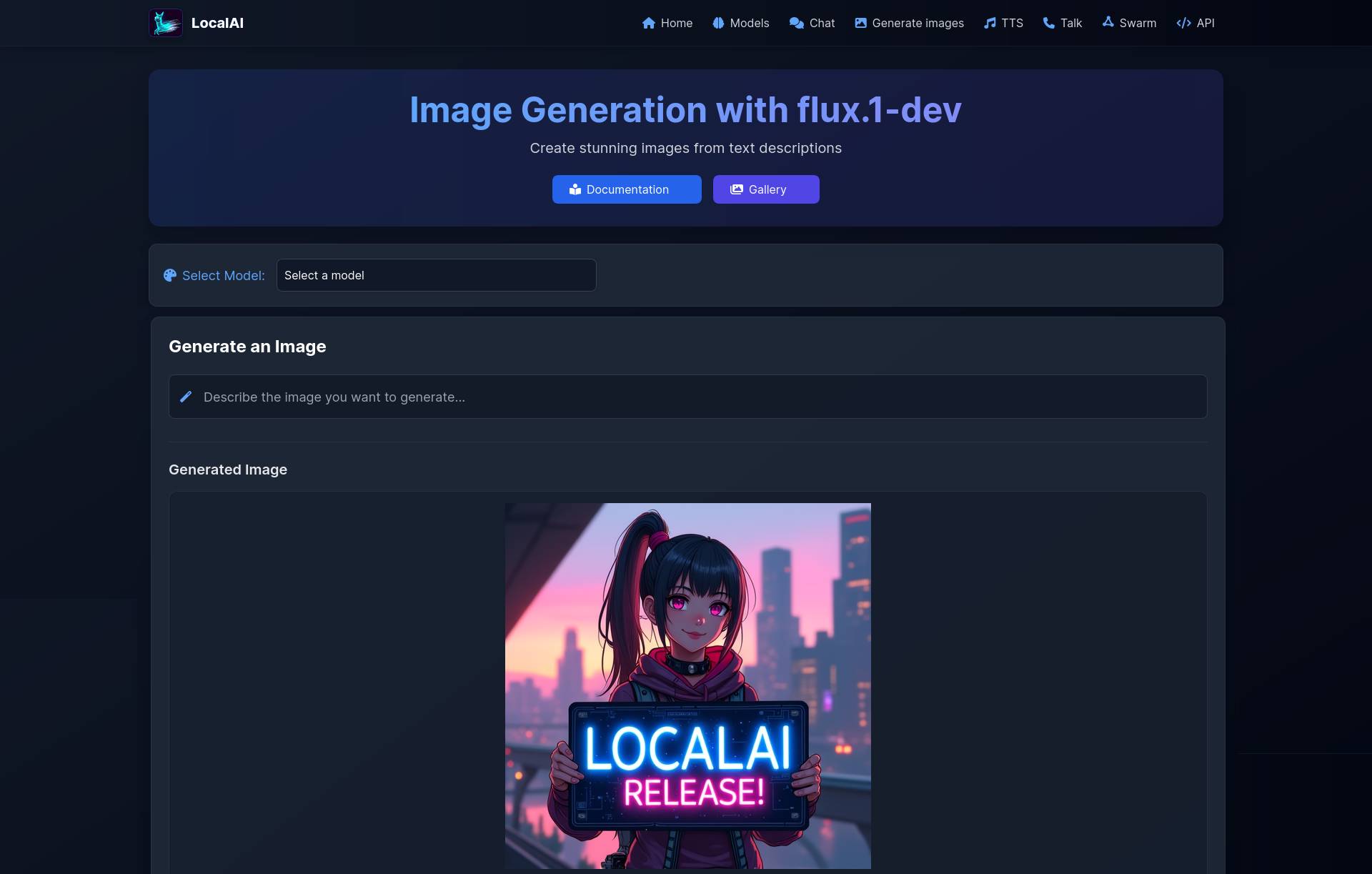

图像生成:支持基于文本描述生成图像,让创意不再受限于专业设计技能,是艺术创作和产品展示的绝佳工具。

-

对象识别与检测:能够识别和检测图像中的对象,为智能监控、自动驾驶等应用提供技术支持。

-

内部API支持:LocalAI具备开放的API,允许第三方应用集成,满足不同用户的需求。

未来发展

随着技术的不断进步,LocalAI的开发团队也在将新的功能与特性引入到项目中,近期更新包括:

- 加强了对多种模型的支持,提升了AI推理的稳定性和准确性。

- 推出基于社区反馈的新特性,如模型上下文协议(MCP),增强了与外部工具的集成能力。

- 改进了Web UI,使用户体验更加友好,易于操作。

同类项目对比

在开源AI空间中,LocalAI有许多同类项目可供选择,如:

-

Hugging Face Transformers:一个高度可定制的NLP库,支持数百个预训练模型,在文本生成和分类方面表现出色。

-

GPT-NeoX:由EleutherAI开发,旨在提供自由的GPT-3替代方案,适用于大规模的语言建模任务。

-

Stable Diffusion:一个广泛使用的图像生成模型,用户能生成高质量的视觉内容,尤其适合艺术创作和图像编辑。

-

LLama:一系列面向对话和语言理解的模型,旨在提供灵活且交互性强的AI解决方案。

通过对比,可以看出LocalAI的独特之处在于它的自托管特性,以及对低硬件要求的优化,极大地方便了个人和企业用户的使用。

LocalAI作为一个开源项目,不断进化,期待在未来为更多用户带来强大的AI能力,助力各种应用场景的实现。

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)