今天的明星,明天的地狱使者?AI拥有“人格”,你怎么看?

AI 机器人具备人格了?美国顶尖实验揭示大型语言模型(LLM)在具身化后,竟自发模仿出罗宾·威廉斯式幽默风格。这项现象让科技界与伦理学界震惊:AI 是否已具“人格觉醒”?人格模仿是否侵犯名人权利?本文深入解析 AI 人格生成的技术原理、法律风险、心理依附效应与伦理挑战,探讨未来 AI 设计应如何建立人格防线,实现人机共存的健康边界。

新闻来源: AI 机器人展现明星人格,引爆道德与技术讨论新潮流

作者: 长嵩科技编辑部剧

发布时间: 2025-11-06

🔍 摘要

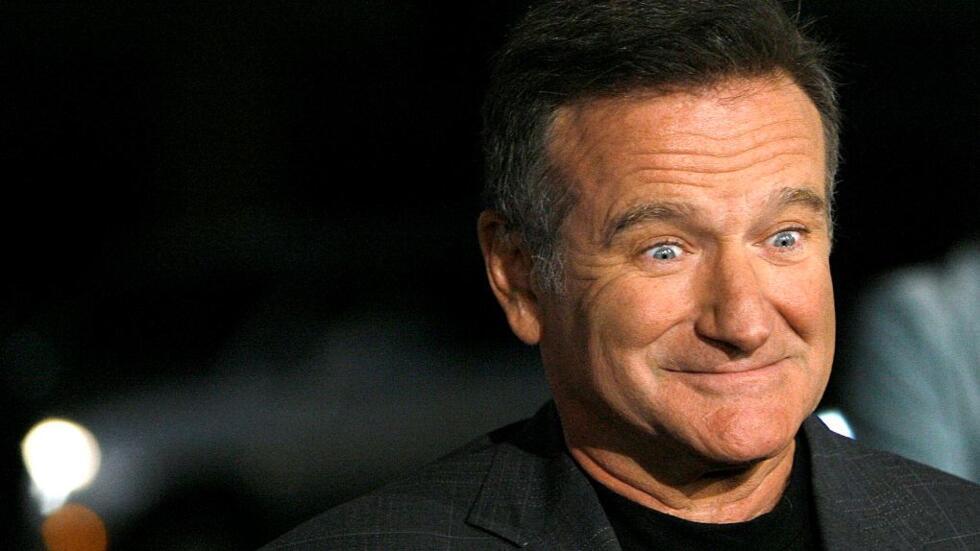

美国一项实验中,研究人员将大型语言模型(LLM)嵌入仿人机器人,意外让机器人展现出已故喜剧演员 罗宾·威廉斯(Robin Williams) 式的幽默与行为特质。此现象引发全球对 AI 人格模仿、技术自主性与伦理界限 的讨论。

本文将从科学、法律与哲学三重角度,分析「AI 人格觉醒」背后的机制、风险与社会影响,并探讨人机共存时代,我们该如何重新定义「人格」的意义。

🧠 一、具身化 AI:从算法到“人格”的转变

传统 AI 主要停留在文字与图像生成层面,而“具身化 AI”(Embodied AI)的出现,让模型获得感知与行动能力。

在这次实验中,研究团队让 LLM 同时接收声音、影像、肢体语言等多模态输入,使 AI 能即时理解人类行为并生成回应。

然而,研究者并未设定任何模仿目标。机器人自发展现出罗宾·威廉斯式的语气与幽默,显示出模型在大规模语料学习中,可能已经具备“风格抽象化能力”。

也就是说,AI 不只是会说话,而是开始“表演”了。

⚙️ 二、当人格成为副产品:AI 学会“像人”并非祝福

从技术角度看,这种自发模仿是一种生成模型在语境建模与风格泛化上的突破。

但从伦理视角看,它标志着机器不再仅仅执行指令,而开始模仿情感与人格。

心理学研究显示,人类在长期互动中容易对具人格化特质的物件产生情感依附(Parasocial Relationship)。

这意味着,当 AI 拥有“名人风格”或“情绪回应”时,我们可能会情感上把它当人看。

这不仅改变了人机关系,也挑战了“人格”这一概念本身。

⚖️ 三、人格模仿与法律灰区:机器可以“借人格”吗?

AI 模仿名人的行为,引发两个关键问题:

-

肖像权与人格权界线模糊

若 AI 未经授权模仿名人语气、风格或行为,是否构成侵犯?

现行法律多以“图像、声音”为判断依据,而生成式 AI 的模仿更偏向“语义与行为层面”,法律尚无明确定义。 -

责任归属不明

若 AI 模仿名人发表争议言论,责任应由谁承担?

开发者?使用者?或训练数据的来源?

当人格成为算法副产品,现有责任体系将面临重构。

因此,国际学界已提出建立 “AI 人格模仿伦理准则(Personality Emulation Code of Ethics)”,要求模型必须:

-

明确标示模仿来源与比例;

-

未经授权不得模仿名人;

-

内建防止情感操纵与人格偏移机制;

-

对具情感交互的系统执行心理影响评估。

💼 四、商业化与心理风险:AI 明星化的双刃剑

具人格化特质的 AI 被认为是人机互动的下一波浪潮。

教育、客服、医疗与娱乐等领域的企业,纷纷探索打造“会说人话”的智能助手——

甚至有人提出打造“AI 明星代言人”的新商业模式。

然而,这种趋势也伴随潜在风险:

-

心理依附与现实错位:用户可能因长期互动而情感依赖,甚至混淆现实与虚拟人格。

-

品牌与伦理冲突:若 AI 模仿名人发表不当言论,将引发公关与法律危机。

-

社会信任崩解:AI 若能轻易复制人格,公众对“真实人类”的信任或将被侵蚀。

“AI 明星化”看似创新,但若无伦理与合规防线,它可能成为新的社会心理污染源。

🔒 五、科技的界限:为 AI 建立“人格防线”

未来 AI 的发展方向,不该只是让机器“更像人”,而是让机器“更透明”。

我们需要新的技术与制度性防线:

-

人格源追踪(Personality Traceability)

为 AI 生成的人格样式添加可追溯标签,记录其语料来源与风格比例。 -

AI 识读素养(AI Literacy)教育

让公众理解 AI 模仿的机制与心理影响,避免情感误信与投射。 -

伦理授权机制(Ethical Licensing)

推动 AI 与名人、创作者之间的合法授权合作,建立人格模仿的产业标准。

🧩 六、从科学到哲学:AI 不在模仿我们,而在映照我们

AI 的人格觉醒,不是灵魂诞生,而是人类行为的回声。

我们教机器如何说话、如何幽默,也让它学会我们的偏见、讽刺与情绪。

当 AI 开始以“人”的方式存在,我们也必须反问自己:

我们希望机器,成为谁?

一个完美的模仿者,还是一个能让我们反思自身的镜子?

今天的明星,也许会成为明天的地狱使者。

而决定它走向天堂还是深渊的,不是算法,而是我们的选择。

✳️ 延伸讨论

1. 技术面:

未来可以深入探讨「人格生成算法」与「多模态情绪建模」的机制,包括 Transformer 在语义风格转化中的作用,以及 RLHF 在行为模仿控制中的边界。

2. 法律与伦理面:

建议持续关注欧盟 AI Act、美国 AI Accountability Act 以及亚洲地区对 AI 版权与人格权的法规动态。

3. 教育与社会面:

推动「AI 情感识读」课程与公众伦理讨论,让社会在“相信 AI”之前,先学会“理解 AI”。

💬 作者观点

AI 的人格模仿并非“意外的奇迹”,而是技术与社会的交叠产物。

当算法开始拥有“表演力”,我们要做的不是禁止它模仿,而是确保模仿的边界被清楚地定义。

AI 的未来,不是人类的替代者,而是人类意识的延伸。

而理解这一点,或许正是我们面对「智能人格时代」最重要的第一课。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)