【必收藏】大模型RAG技术全解析:解决幻觉、时效与数据安全问题的实战指南

本文详细介绍了大语言模型(LLM)面临的幻觉、时效性和数据安全问题,并提出了检索增强生成(RAG)作为解决方案。通过RAG技术,模型可以获取外部知识有效避免幻觉,处理最新信息,同时保障数据安全。文章提供了LangChain实现的RAG实践示例,包括数据加载、文档分割、向量化、检索和生成等完整流程,并对比分析了RAG与微调技术的适用场景,为读者提供了系统学习大模型AI的四个阶段路径。

本文详细介绍了大语言模型(LLM)面临的幻觉、时效性和数据安全问题,并提出了检索增强生成(RAG)作为解决方案。通过RAG技术,模型可以获取外部知识有效避免幻觉,处理最新信息,同时保障数据安全。文章提供了LangChain实现的RAG实践示例,包括数据加载、文档分割、向量化、检索和生成等完整流程,并对比分析了RAG与微调技术的适用场景,为读者提供了系统学习大模型AI的四个阶段路径。

写在前面

大模型(Large Language Model,LLM)的浪潮已经席卷了几乎各行业,但当涉及到专业场景或行业细分域时,通用大模型就会面临专业知识不足的问题。相对于成本昂贵的“Post Train”或“SFT”,基于RAG的技术方案往成为一种更优选择。本文从RAG架构入手,详细介绍相关技术细节,并附上一份实践案例。

LLM的问题

尽管LLM拥有令人印象深刻的能力,但是它们还面临着一些问题和挑战:

- 幻觉问题:大模型的底层原理是基于概率,在没有答案的情况下经常会胡说八道,提供虚假信息。

- 时效性问题:规模越大(参数越多、tokens 越多),大模型训练的成本越高。类似 ChatGPT3.5,起初训练数据是截止到 2021 年的,对于之后的事情就不知道了。而且对于一些高时效性的事情,大模型更加无能为力,比如帮我看看今天晚上有什么电影值得去看?这种任务是需要去淘票票、猫眼等网站先去获取最新电影信息的,大模型本身无法完成这个任务。

- 数据安全:OpenAI 已经遭到过几次隐私数据的投诉,而对于企业来说,如果把自己的经营数据、合同文件等机密文件和数据上传到互联网上的大模型,那想想都可怕。既要保证安全,又要借助 AI 能力,那么最好的方式就是把数据全部放在本地,企业数据的业务计算全部在本地完成。而在线的大模型仅仅完成一个归纳的功能,甚至,LLM 都可以完全本地化部署。

解决这些挑战对于 LLMs 在各个领域的有效利用至关重要。一个有效的解决方案是集成检索增强生成(RAG)技术,该技术通过获取外部数据来响应查询来补充模型,从而确保更准确和最新的输出。主要表现方面如下:

- 有效避免幻觉问题:虽然无法 100% 解决大模型的幻觉问题,但通过 RAG 技术能够有效的降低幻觉,在软件系统中结合大模型提供幂等的API接口就可以发挥大模型的重要作用。

- 经济高效的处理知识&开箱即用:只需要借助信息检索和向量技术,将用户的问题和知识库进行相关性搜索结合,就能高效的提供大模型不知道的知识,同时具有权威性。

- 数据安全:企业的数据可以得到有效的保护,通过私有化部署基于 RAG 系统开发的AI产品,能够在体验AI带来的便利性的同时,又能避免企业隐私数据的泄漏。

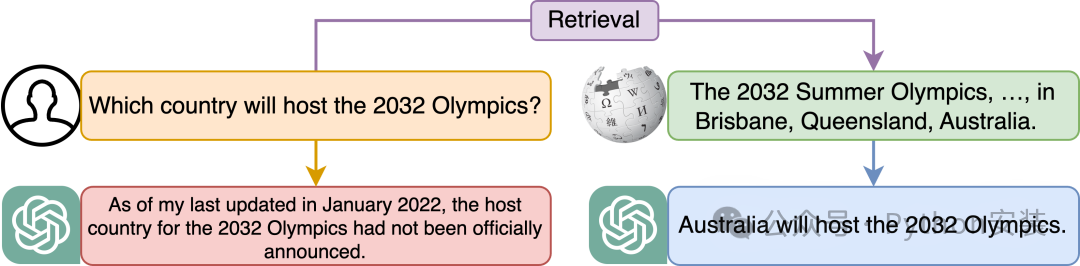

上图展示了 RAG 如何使 ChatGPT 能够提供超出其初始训练数据的精确答案。

什么是RAG?

检索增强生成(Retrieval Augmented Generation),简称 RAG,已经成为当前最火热的LLM应用方案。经历今年年初那一波大模型潮,想必大家对大模型的能力有了一定的了解,但是当我们将大模型应用于实际业务场景时会发现,通用的基础大模型基本无法满足我们的实际业务需求,主要有以下几方面原因:

- 知识的局限性:模型自身的知识完全源于它的训练数据,而现有的主流大模型(ChatGPT、文心一言、通义千问…)的训练集基本都是构建于网络公开的数据,对于一些实时性的、非公开的或离线的数据是无法获取到的,这部分知识也就无从具备。

- 幻觉问题:所有的AI模型的底层原理都是基于数学概率,其模型输出实质上是一系列数值运算,大模型也不例外,所以它有时候会一本正经地胡说八道,尤其是在大模型自身不具备某一方面的知识或不擅长的场景。而这种幻觉问题的区分是比较困难的,因为它要求使用者自身具备相应领域的知识。

- 数据安全性:对于企业来说,数据安全至关重要,没有企业愿意承担数据泄的风险,将自身的私域数据上传第三方平台进行训练。这也导致完全依赖通用大模型自身能力的应用方案不得不在数据安全和效果方面进行取舍。

而RAG是解决上述问题的一套有效方案。

实践示例

那具体 RAG 怎么做呢?我们用一个简单的 LangChain 代码示例来展示 RAG 的使用。

环境准备

安装相关依赖

# 环境准备,安装相关依赖 pip install langchain sentence_transformers chromadb

本地数据加载

这个例子使用了保罗·格雷厄姆(Paul Graham)的文章"What I Worked On"的文本。下载文本后,放置到"./data"目录下。Langchain 提供了很多文件加载器,包括 word、csv、PDF、GoogleDrive、Youtube等,使用方法也很简单。这里直接使用 TextLoader 加载txt文本。

from langchain.document_loaders import TextLoader loader = TextLoader("./data/paul_graham_essay.txt") documents = loader.load()

文档分割(split_documents)

文档分割,借助 langchain 的字符分割器。代码中我们指定 chunk_size=500, chunk_overlap=10, 这样的意思就是我们每块的文档中是 500 个字符,chunk_overlap 表示字符重复的个数,这样可以避免语义被拆分后不完整。

# 文档分割 from langchain.text_splitter import CharacterTextSplitter # 创建拆分器 text_splitter = CharacterTextSplitter(chunk_size=500, chunk_overlap=10) # 拆分文档 documents = text_splitter.split_documents(documents)

向量化(embedding)

接下来对分割后的数据进行 embedding,并写入数据库。LangChain 提供了许多嵌入模型的接口,例如 OpenAI、Cohere、Hugging Face、Weaviate等,请参考 LangChain 官网。这里选用 m3e-base 作为 embedding 模型,向量数据库选用 Chroma。

from langchain.embeddings import HuggingFaceBgeEmbeddings from langchain.vectorstores import Chroma # embedding model: m3e-base model_name = "moka-ai/m3e-base" model_kwargs = {'device': 'cpu'} encode_kwargs = {'normalize_embeddings': True} embedding = HuggingFaceBgeEmbeddings( model_name=model_name, model_kwargs=model_kwargs, encode_kwargs=encode_kwargs )

数据入库

将嵌入后的结果存储在 VectorDB 中,常见的 VectorDB包括 Chroma、weaviate 和 FAISS 等,这里使用 Chroma 来实现。Chroma 与 LangChain 整合得很好,可以直接使用 LangChain 的接口进行操作。

# 指定 persist_directory 将会把嵌入存储到磁盘上。persist_directory = 'db' db = Chroma.from_documents(documents, embedding, persist_directory=persist_directory)

检索(Retrieve)

向量数据库被填充后,可以将其定义为检索器组件,该组件根据用户查询与嵌入式块之间的语义相似性获取附加上下文。

retriever = db.as_retriever()

增强(Augment)

接下来,为了将附加上下文与提示一起使用,需要准备一个提示模板。如下所示,可以轻松地从提示模板自定义提示。

from langchain.prompts import ChatPromptTemplate template = """You are an assistant for question-answering tasks. Use the following pieces of retrieved context to answer the question. If you don't know the answer, just say that you don't know. Use three sentences maximum and keep the answer concise. Question: {question} Context: {context} Answer: """ prompt = ChatPromptTemplate.from_template(template)

生成(Generate)

最后,可以构建一个 RAG 流水线的链,将检索器、提示模板和LLM连接在一起。一旦定义了 RAG 链,就可以调用它。本地通过 ollama 运行的 llama3 来作为 LLM 使用。如果不了解本地ollama部署模型的流程,可以参考这篇文章。

from langchain_community.chat_models import ChatOllama from langchain.schema.runnable import RunnablePassthrough from langchain.schema.output_parser import StrOutputParser llm = ChatOllama(model='llama3') rag_chain = ( {"context": retriever, "question": RunnablePassthrough()} | prompt | llm | StrOutputParser() ) query = "What did the author do growing up?" response = rag_chain.invoke(query) print(response)

我这里的本地llama3环境下,输出为:

Before college, Paul Graham worked on writing and programming outside of school. He didn't write essays, but instead focused on writing short stories. His stories were not very good, having little plot and just characters with strong feelings.

从这个输出中,可以看到已经将我们提供的文本中的相关信息检索出来,并由 LLM 总结回答我们的问题了。

RAG 与微调

上面都是介绍的 RAG ,在这里顺便对比一下微调(Fine-tuning)。在大语言模型的优化措施中, RAG 和微调都是一种重要的技术。

可以把 RAG 想象成给模型提供一本参考书,让它根据问题去查找信息然后回答问题。这种方法适用于模型需要解答具体问题或执行特定信息检索任务的情况。但 RAG 并不适合于教会模型理解广泛的领域或学习新的语言、格式或风格。

而微调更像是让学生通过广泛学习来吸收知识。当模型需要模仿特定的结构、风格或格式时,微调就显得非常有用。它可以提高未经微调的模型的表现,使交互更加高效。

微调特别适用于强化模型已有的知识、调整或定制模型的输出,以及给模型下达复杂的指令。然而,微调并不适合于向模型中添加新的知识,或者在需要快速迭代新场景的情况下使用。

RAG 和微调可以相互补充,而非相互排斥,从而在不同层次上增强模型的能力。在特定情况下,结合这两种方法可以达到模型性能的最佳状态。

还有一个形象的对比来介绍 RAG 和微调, RAG 就相当于是开卷考试,考试的时候可以翻书, 可以随时翻到某一页来查找对应的知识点去回答。微调相当于你一整个学期的学习,并在考试前进行了重点复习和记忆,考试时,凭借自己巩固的知识去答题。

总结

本文列举了LLM的问题。简单介绍了什么是 RAG ,以及 RAG 的流程。最后使用了一个简单的LangChain代码示例来展示 RAG 的使用。最后对比了 RAG 和微调的区别,方便大家选型。

大模型未来如何发展?普通人如何抓住AI大模型的风口?

※领取方式在文末

为什么要学习大模型?——时代浪潮已至

随着AI技术飞速发展,大模型的应用已从理论走向大规模落地,渗透到社会经济的方方面面。

- 技术能力上:其强大的数据处理与模式识别能力,正在重塑自然语言处理、计算机视觉等领域。

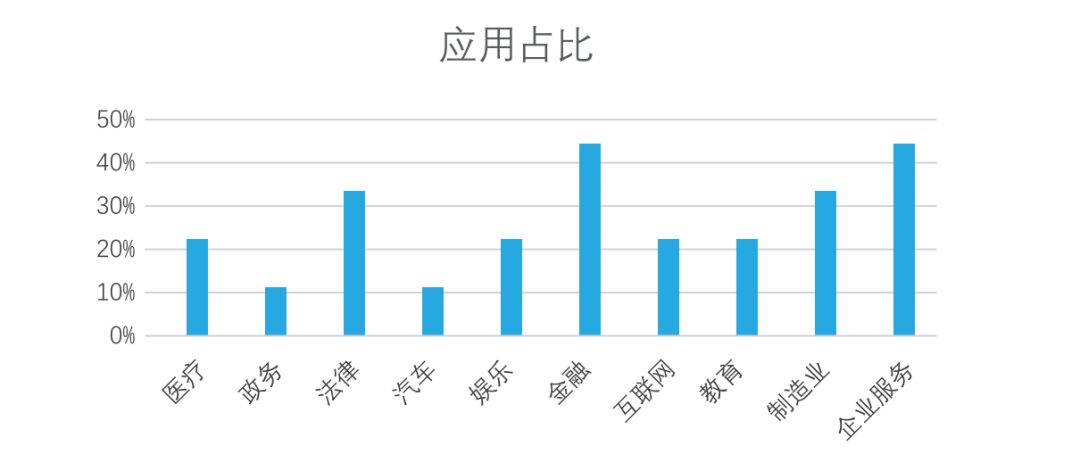

- 行业应用上:开源人工智能大模型已走出实验室,广泛落地于医疗、金融、制造等众多行业。尤其在金融、企业服务、制造和法律领域,应用占比已超过30%,正在创造实实在在的价值。

未来大模型行业竞争格局以及市场规模分析预测:

同时,AI大模型技术的爆发,直接催生了产业链上一批高薪新职业,相关岗位需求井喷:

AI浪潮已至,对技术人而言,学习大模型不再是选择,而是避免被淘汰的必然。这关乎你的未来,刻不容缓!

那么,我们如何学习AI大模型呢?

在一线互联网企业工作十余年里,我指导过不少同行后辈,经常会收到一些问题,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题,也不是三言两语啊就能讲明白的。

所以呢,这份精心整理的AI大模型学习资料,我整理好了,免费分享!只希望它能用在正道上,帮助真正想提升自己的朋友。让我们一起用技术做点酷事!

ps:微信扫描即可获取

加上后我将逐一发送资料

与志同道合者共勉

真诚无偿分享!!!

适学人群

我们的课程体系专为以下三类人群精心设计:

-

AI领域起航的应届毕业生:提供系统化的学习路径与丰富的实战项目,助你从零开始,牢牢掌握大模型核心技术,为职业生涯奠定坚实基础。

-

跨界转型的零基础人群:聚焦于AI应用场景,通过低代码工具让你轻松实现“AI+行业”的融合创新,无需深奥的编程基础也能拥抱AI时代。

-

寻求突破瓶颈的传统开发者(如Java/前端等):将带你深入Transformer架构与LangChain框架,助你成功转型为备受市场青睐的AI全栈工程师,实现职业价值的跃升。

※大模型全套学习资料展示

通过与MoPaaS魔泊云的强强联合,我们的课程实现了质的飞跃。我们持续优化课程架构,并新增了多项贴合产业需求的前沿技术实践,确保你能获得更系统、更实战、更落地的大模型工程化能力,从容应对真实业务挑战。 资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

01 大模型系统化学习路线

作为学习AI大模型技术的新手,方向至关重要。 正确的学习路线可以为你节省时间,少走弯路;方向不对,努力白费。希望这份最科学最系统的学习成长路线图和学习规划,带你从零基础入门到精通!

👇微信扫描下方二维码即可~

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

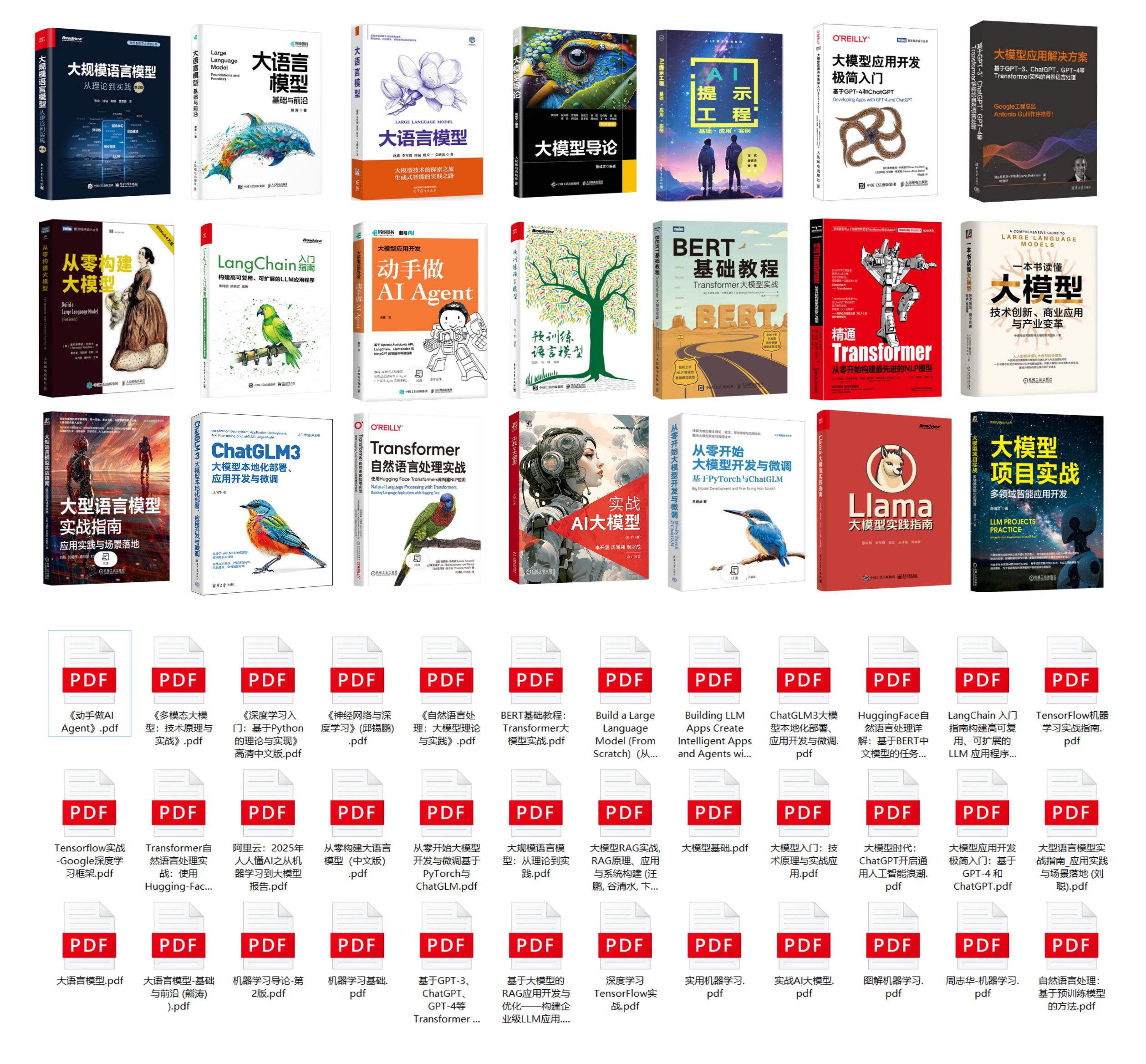

02 大模型学习书籍&文档

新手必备的权威大模型学习PDF书单来了!全是一系列由领域内的顶尖专家撰写的大模型技术的书籍和学习文档(电子版),从基础理论到实战应用,硬核到不行!

※(真免费,真有用,错过这次拍大腿!)

03 AI大模型最新行业报告

2025最新行业报告,针对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

04 大模型项目实战&配套源码

学以致用,在项目实战中检验和巩固你所学到的知识,同时为你找工作就业和职业发展打下坚实的基础。

05 大模型大厂面试真题

面试不仅是技术的较量,更需要充分的准备。在你已经掌握了大模型技术之后,就需要开始准备面试,我精心整理了一份大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

06 全套AI大模型应用开发视频教程

(包含提示工程、RAG、LangChain、Agent、模型微调与部署、DeepSeek等技术点)

由于篇幅有限

只展示部分资料

并且还在持续更新中…

ps:微信扫描即可获取

加上后我将逐一发送资料

与志同道合者共勉

真诚无偿分享!!!

最后,祝大家学习顺利,抓住机遇,共创美好未来!

更多推荐

已为社区贡献194条内容

已为社区贡献194条内容

所有评论(0)