GPT革命:AI如何重塑人类未来

本文系统解析了GPT模型的技术原理及实际应用。核心技术包括:1)模仿人脑神经网络的参数化连接结构,1750亿参数规模触发智能涌现;2)生成式架构通过单词接龙实现文本创作;3)Transformer机制实现语义关联分析。GPT-4在HuggingFace评测中获381分,支持多模态输入和2.5万字上下文处理。实际应用覆盖文案创作(爆款标题生成准确率提升40%)、代码开发(HumanEval测试通过率

人类大脑与计算机神经网络的类比

人类大脑皮层包含约860亿神经元,每个神经元通过约1万个突触连接形成复杂网络。计算机神经网络模仿这一结构建立参数化连接,当参数规模突破临界点(如GPT-3.5的1750亿参数)时,会触发“智能涌现”现象。

GPT模型的发展历程

-

参数规模演变:

- 1980年:16万参数

- 2018年(谷歌Beta):3.4亿参数

- 2019年(OpenAI):15亿参数

- 2022年(GPT-3.5):1750亿参数,ChatGPT实现质的飞跃

-

历史意义:

比尔·盖茨评价其为堪比PC和互联网的革命性技术,马化腾称之为“工业革命级机遇”,类比蒸汽机对生产力的颠覆性影响。

GPT核心组成解析

G(Generation,生成式)

- 通过“单词接龙”逐词生成文本,例如输入“我爱吃”可能输出“苹果”(概率50%)或“香蕉”(50%)。

- 控制生成多样性的方法:

- 调整温度参数(Temperature)

- 多次重新生成(Regenerate)

- 明确指示输出非典型词汇

P(Pre-training,预训练)

- 三阶段学习机制:

- 无监督预训练:类似儿童阅读故事书,学习语言结构与常识。

- 有监督微调:通过标注数据(如问答对)优化答案准确性。

- 强化学习:基于人类反馈(RLHF)调整模型,类似游戏得分机制。

T(Transformer)

- 自注意力机制:动态分析词间关系,例如解析代词指代对象(如“他”指代前文的“牛顿”)。

- 其他关键技术:

- 堆叠编码结构:逐层提取信息,类似过滤系统。

- 位置编码:通过类似“拼图编号”的算法保留词语顺序信息。

实际应用案例

输入问题:“牛顿定律是什么?”

输出生成逻辑:

- 检索预训练知识库中的物理学相关内容。

- 通过自注意力机制关联“牛顿”与“运动定律”的上下文。

- 计算各词汇生成概率,组合成结构化回答(如分点阐述三大定律并举例)。

功能场景:

- 自动化文案创作(邮件、脚本、论文)。

- 代码生成与翻译。

- 复杂对话系统(基于上下文的多轮交互)。

技术意义总结

GPT模型通过生成式架构、多阶段预训练及Transformer机制,实现了:

- 从数据中归纳语言规律而非简单复制。

- 上下文感知的原创内容生成能力。

- 推动AI从专用工具向通用生产力工具进化。

GPT的应用场景与能力分析

文本生成与编辑

GPT能够生成多种形式的文本内容,包括文章、诗歌、故事、小说和视频脚本。还能对已有文本进行润色和修改,提升内容质量。

客户支持助手

通过自动化回复用户问题,GPT实现类人沟通,减少人工客服的工作量,同时提升用户体验。

软件开发与代码生成

GPT能够编写和调整代码,为程序员提供建议。OpenAI的Call Desk和GitHub等工具已应用该功能,显著提高开发效率。

语言翻译与学习

支持多语种沟通,具备翻译能力,还能纠正语法和发音错误。已在语言学习应用中发挥作用,未来可能替代部分语言教师功能。

教育与培训

适用于儿童学习辅导、问题解答、企业员工培训和入职指导。能够提高教育和培训的效率,覆盖广泛的技能提升需求。

商业数据分析

能够处理来自图片、Excel、PDF等多渠道的数据,进行清洗、统计和关键信息提取,辅助企业和个人决策。

娱乐与互动

涵盖游戏角色、虚拟人物和数字人直播等场景,是GPT未来重点发展的方向之一。

个人专项助理

可作为个人财务管家、职业发展助理、健康管理师或健身教练,提供个性化服务。

GPT衍生生态

文本生成视频

当前技术尚处初级阶段,部分工具仅支持生成约3秒的视频内容,包括图像生成和虚拟人物生成。

能力优点

通用能力强

应用场景广泛,具备极强的通用性,适应多种任务需求。

预训练与微调能力

对于未在预训练中学到的内容,能够通过提供数据和案例快速学习,适应新领域。

大规模文本处理能力

短时间内处理长文本(如历史文献、甲骨文、外文书籍),提取关键信息,远超人类效率。

知识储备丰富

基于互联网海量知识训练,是目前知识储备最丰富的模型之一。

多语言支持

支持多语言无障碍沟通,实现全球化交流。

能力缺点

缺乏解释性

基于参数“涌现”智能,本质是“黑箱”,智能形成机制不可解释,开发者也无法完全理解其逻辑。

易出现常识性错误

输出中可能包含不准确或错误信息,需用户自行辨别。

模型训练难度大

训练资源消耗高,数据库无法动态增删改,资源有限的设备上部署困难。小型模型可部署,但大型模型难以达到理想效果。

主流大模型特点及适用场景分析

大模型性能概览

- GPT-4:综合评分381分(HuggingFace OpenLLM Leaderboard),支持多模态输入(图像/文本/数据)和25000字长上下文,插件生态超800款。

- Claude:免费开放,支持5文件上传和数万字长文本处理,内容审核宽松。

- GPT-3.5:性价比选择,3000字上下文限制,基础推理能力相当于"大学生水平"。

- Google Bard:图像识别领先,提供三选一答案机制,实时联网获取最新信息。

- Microsoft Copilot:基于GPT-4优化,自带文献引用功能,学术场景优势显著。

核心功能对比

多模态能力

- GPT-4支持图像描述、图表数据分析

- Google Bard在视觉问答(VQA)任务中准确率达89.7%(VQAv2基准)

- 国内文心一言可生成PPT/思维导图等结构化输出

插件与扩展

- ChatGPT应用商店提供Wolfram Alpha(数学计算)、Kayak(旅行规划)等专业工具

- Claude支持直接解析PDF/Word文档内容

- 讯飞星火内置Excel数据处理模块

代码相关能力

- Code Interpreter(Python沙盒环境)可执行数据可视化及数学建模

- Claude在HumanEval代码测试中通过率72.3%

- GLM-130B开源模型支持本地化代码调试

国内外模型专项对比

| 需求场景 | 国际推荐模型 | 国内替代方案 |

|---|---|---|

| 学术文献综述 | Copilot | 智谱清言 |

| 长文档处理 | Claude | 通义千问 |

| 实时信息获取 | Google Bard | 文心一言联网版 |

| 创意写作 | GPT-4 | 讯飞星火 |

| 隐私敏感任务 | Llama 3 | 百川大模型 |

典型应用建议

技术开发场景

- 代码调试:GPT-4 + Code Interpreter组合

- 算法优化:使用HumanEval评分85%以上的Claude 3 Opus

- API集成:Azure OpenAI服务提供企业级部署方案

内容创作场景

- 营销文案生成:GPT-4温度值设为0.7获得平衡性输出

- 多语言翻译:DeepL与Google Bard混合使用

- 视频脚本:结合DALL·E 3图像生成能力

注:最新测试显示GPT-4-turbo在MMLU基准测试中准确率达88.4%,但部分专业领域(如法律)仍需要微调模型补充。实际选择应结合具体任务的延迟要求、成本预算和输出稳定性综合考量。

ChatGPT页面布局与调教技巧总结

页面结构

- 新建聊天窗口:建议每个新问题开启独立窗口,避免上下文干扰。支持锁定模板便于重复使用。

- 任务列表:管理历史对话和常用任务模板。

- 账号设置:包含套餐信息、自定义指令(如启用插件Plankin)、个性化配置。

- 版本切换:支持GPT-3.5(免费)与GPT-4(付费)版本,根据需求选择。

- 内容展示区:输出回答内容,支持快捷场景入口(如代码解释、翻译等)。

- 指令输入框:输入问题或调教指令的核心区域。

五大调教技巧详解

背景设定

背景信息能大幅提升回答针对性。示例对比:

- 基础提问:“推荐好书。”

- 优化后:“刚读完《1984》,喜欢其社会批判风格,请推荐类似主题的书籍。”

- 另一案例:“最近总感觉累” vs “36岁女性,睡眠充足但持续疲劳三个月,分析可能原因。”

任务目标明确化

需包含四要素:

- 范围限定:如“2022年爱情剧推荐”。

- 排除内容:如“减肥食物但不含绿色蔬菜”。

- 任务拆解:复杂任务分段输出(如招商策略计划书)。

- 参考样例:提供模板要求同类输出(如市场分析报告结构)。

角色定义三重维度

- 用户身份:年龄、职业等(如“36岁程序员”)。

- AI角色:指定回答视角(如“营养师”“小说家”)。

- 输出对象:内容受众(如“四年级小学生”)。

示例: - “作为小说家,写杨过与小龙女的爱情故事提纲。”

- “如何提高阅读水平?受众为小学生。”

输出要求规范

需明确以下细节:

- 格式:表格、Markdown、分点列表等。

- 量化指标:字数、时间限制(如“30天计划”)。

- 语气风格:口语化、正式、幽默等。

- 语言:中英文或其他特定要求。

示例: - “表格形式输出30天素食减肥计划,每天一栏。”

- “用通俗语言解释光合作用给五年级学生。”

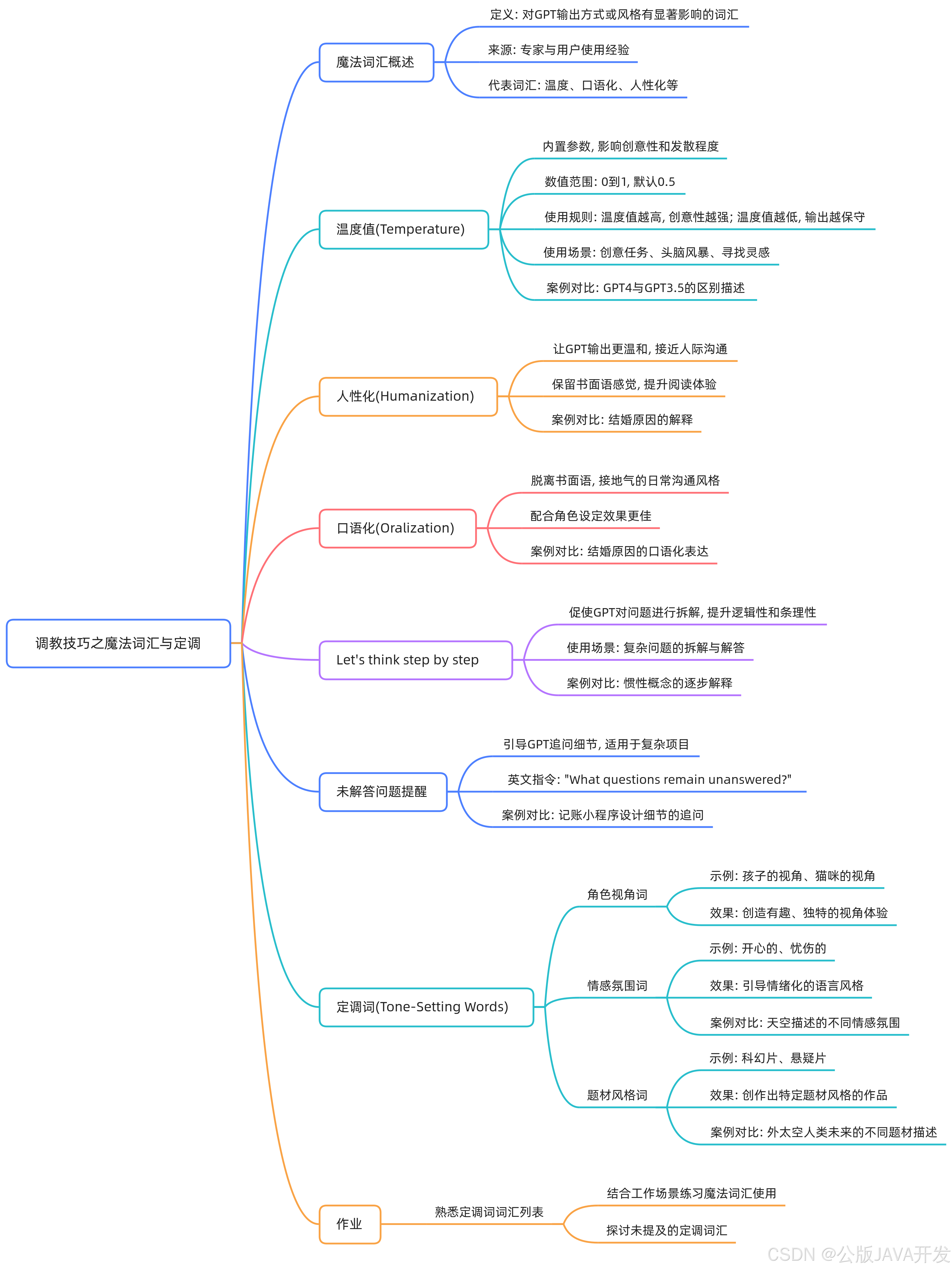

超级词汇与Prompt优化

关键词直接影响输出风格:

- “口语化”:“用聊天式语言介绍《流浪地球》。”

- “人性化”:“拟人化解释GPT工作原理。”

Prompt优化器用法:

输入预设指令“成为我的prompt创作者”,通过交互细化需求。例如:“一个月内用AI知识赚10万元”可分解为市场分析、工具推荐、执行步骤等子任务。

实例演示:公式化指令模板

通用结构:

背景 + 任务目标 + 角色 + 输出要求

示例:

“我是一名创业者(背景),需要制定跨境电商营销策略(任务目标)。你作为资深市场顾问(角色),请分步骤输出方案,包含成本估算和风险分析(输出要求)。”

通过结构化提问,可显著提升回答精准度和实用性。

拆解问题层层递进的三种核心技巧

让GPT自行拆解

在指令末尾添加"let's think step by step"提示语,适用于逻辑性强、需分步解决的问题。数学计算类问题中,GPT会先计算总数和平均数,再得出具体转移数量。解释类问题如温室效应,模型会依次拆解能量平衡、成因、结果等层次,输出结构化答案。

关键点:明确问题类型为强逻辑或分步骤任务;直接使用标准提示语;适用于用户不熟悉具体拆解路径的场景。

用户自主拆解

适用于用户对领域较熟悉的场景,需主动设计问题结构。以招商策略制定为例:明确咨询顾问角色定位;确定商业计划书形式;拆解企业规模(40人初创)、产品类型(无代码工具)、市场目标(国内品牌拓展);最终整合为包含市场分析、合作伙伴评估的完整方案。

操作要点:厘清问题背景和输出格式要求;将大目标分解为可验证的子模块;确保各环节信息相互关联支撑。

对话式逐步推进

通过多轮交互完成复杂内容创作。小红书种草文案案例中:先确认平台特性与酒店定位(亲子主题);再分别解决标题设计(包含"超级震撼"等爆款词)、内容框架(江景+亲子设施)、语言风格(宝妈口吻+EMOJI);最终生成带#上海亲子酒店#标签的完整笔记。

实施流程:初始提问聚焦核心要素;中间对话补充细节要求;最终输出前进行风格校准。特别适合需要多次调整的内容创作场景。

典型应用场景示范

商业文档生成

制定招商计划时,需包含:行业竞争分析(竞品功能对比);目标客户画像(企业规模/数字化需求);合作政策(分层级返佣体系)。示例输出会包含SWOT分析矩阵和季度推进路线图。

新媒体内容仿写

爆款文章仿写需注意:保留原文数据信息(如"四句话"结构);重构表达方式("人生如咖啡"比喻);控制阅读难度(Flesch指数>60)。输出时应分段交付,便于逐部分优化调整。

平台化内容创作

酒店种草笔记包含:场景化标题(外滩地理位置+亲子元素);痛点解决方案(儿童娱乐区解放父母);价格策略呈现(性价比话术:"均摊每人仅800")。严格遵循平台字数限制和标签规范。

实施效果优化建议

提示词设计应包含:具体角色定义(如"资深母婴博主");量化指标("500字以内");禁忌条款("不虚构用户评价")。案例模板需根据实际需求替换关键参数,例如将酒店案例中的"上海外滩"替换为"三亚亚龙湾"。

内容校验阶段关注:逻辑闭环(种草理由与产品卖点对应);风格一致性(全篇保持活泼语气);平台合规性(避免绝对化用词)。可通过追问"如何证明这家酒店真的适合带娃?"补充真实体验细节。

投喂目的

通过提供参考内容降低GPT生成错误信息的概率,补充时效性数据,并引导其输出更符合特定领域或任务需求的结果。投喂能利用GPT的归纳与检索能力,辅助处理本地文件、分析案例或总结规律。

投喂内容类型

优秀案例:爆款文案、视频、图片等,供GPT分析结构或规律。

学习模板:论文写作规范、回答模板等标准化内容。

原始文件:论文、网页、图片、链接等,用于总结、筛选或数据提取。

投喂方式与操作演示

调用GPT已有知识

适用文献、书籍或理论参考。示例:

- 提问:“推荐爆款标题写作的书籍”,获取书单后进一步要求:“结合《XXX》写10个副业标题”。

- 输出示例:“副业大揭秘:无编码经验也能月入过万”。

直接文本投喂

适用于简单问题或少量背景信息需求。示例:

- 提供6个爆款标题,要求GPT分析结构(如情感符号、悬念设计),再生成10个类似标题。

上传本地文档

支持格式:txt、word、jpg、json等。操作步骤:

- 在GPT4界面直接上传文件,或通过插件(如AskYourPDF)精准检索。

- 示例:上传课件后要求“概括为1000字”或“定位‘数据科学项目流程’页码”。

URL链接投喂

需启用联网插件,适用于网页内容分析。示例:

- 输入发布会链接,要求概括为表格,或转换为口播稿。

技术型投喂补充

- 微调(Fine-tuning):用小数据集训练模型,适合技术用户。

- 向量化(Embedding):将问题与答案匹配,用于客服场景。

注意事项

- 投喂内容需与任务强相关,避免信息过载。

- 时效性数据需明确标注时间范围。

- 复杂任务建议结合“拆解问题”技法分步处理。

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)