当AI遇见海量文献:RAG如何重塑医学知识获取方式

临床决策支持系统面临海量医学文献筛选难题,传统方法效率低且易遗漏关键信息。检索增强生成(RAG)技术通过结合向量检索与大语言模型,能快速定位相关文献并生成结构化回答。其核心流程包括:文献向量化(使用BioBERT等医学模型)、语义检索(基于向量数据库)和内容生成(基于检索结果)。实际应用中需解决文献结构不统一(分级检索策略)、知识时效性(时间加权)和引用规范性(PMID标注)等挑战。生产环境优化包

三个月前在做一个临床决策支持系统时,遇到了一个棘手的问题。医生在诊疗过程中需要快速查阅相关文献,但PubMed上关于某种罕见病的研究论文有上千篇,人工筛选至少需要几个小时。更麻烦的是,这些文献散落在不同期刊,有的关注病因机制,有的讨论治疗方案,有的分析预后指标,很难快速建立完整的知识体系。

传统的解决方案是用关键词搜索加人工筛选,但这种方式有个致命缺陷:它依赖精确匹配,而医学领域充斥着同义词和相关概念。搜"myocardial infarction"可能会错过标记为"heart attack"的重要文献。更重要的是,医生真正需要的不是文献列表,而是针对具体临床问题的答案,比如"这种罕见病的一线治疗方案是什么"或者"最新研究对预后有什么新发现"。

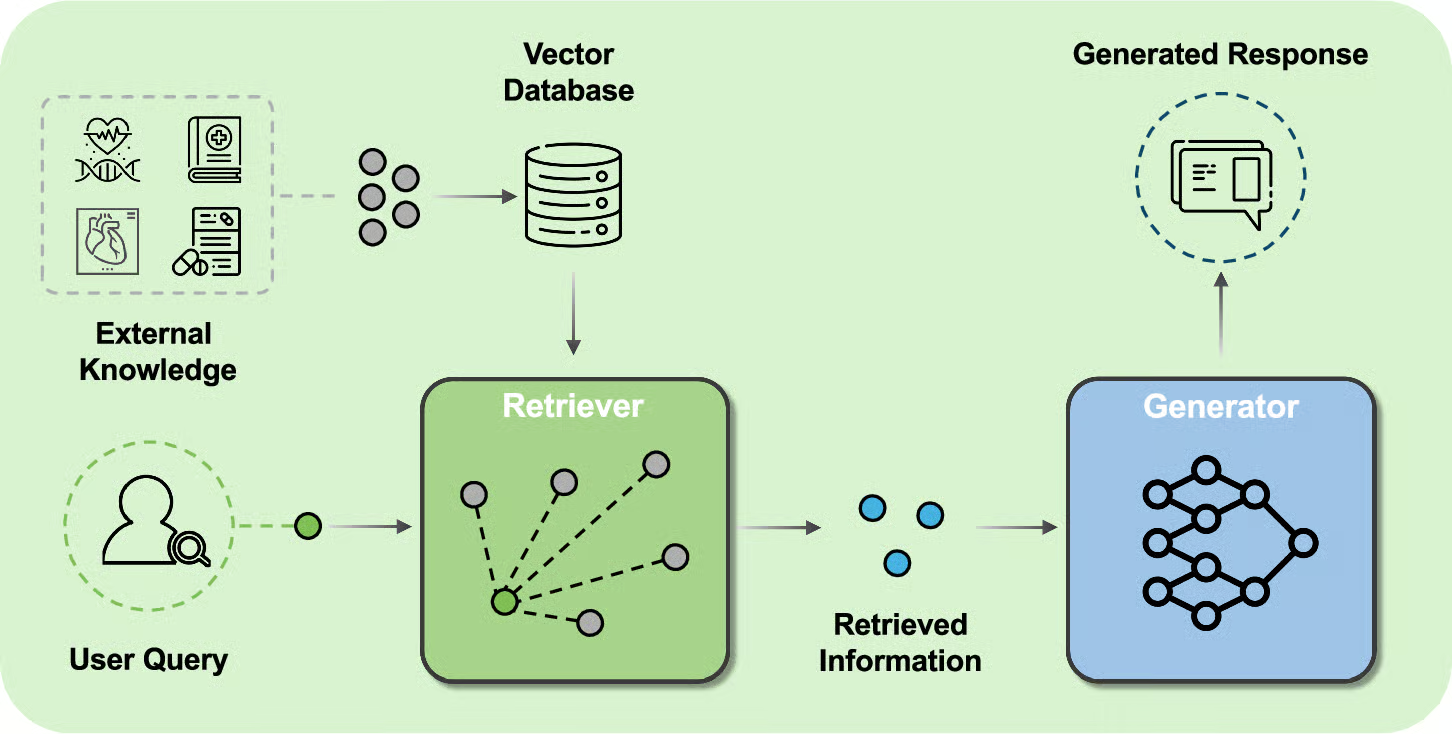

这正是检索增强生成(Retrieval-Augmented Generation,简称RAG)技术发挥作用的地方。它将大语言模型的理解能力和向量检索的精准性结合起来,能够从海量文献中快速定位相关内容,然后生成结构化的回答。根据《Journal of the American Medical Informatics Association》在2025年1月发表的系统综述,RAG在医学领域的应用正在快速增长,特别是在文献综述、临床指南解读、诊断辅助等场景中展现出巨大潜力。

RAG的工作原理:从文献到答案的转换链

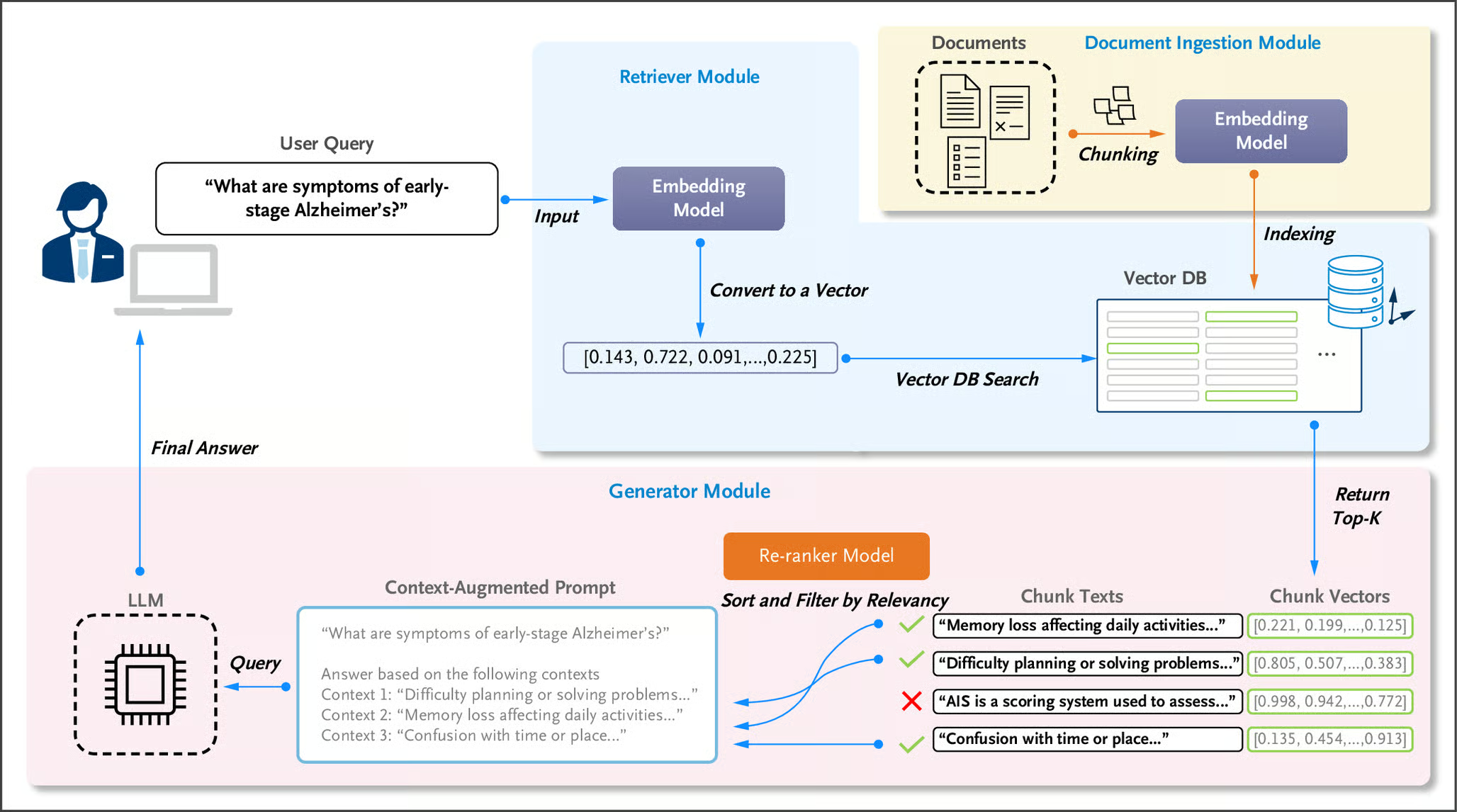

要理解RAG在医学文献分析中的价值,需要先搞清楚它的工作机制。整个流程可以分成三个核心环节:文献向量化、语义检索和内容生成。

第一步是把医学文献转换成计算机能理解的数学表示。传统搜索引擎用关键词索引,但RAG使用的是向量嵌入(Vector Embedding)技术。简单说,就是用深度学习模型把每篇文献的语义信息压缩成一个高维向量,比如768维或1536维的数字数组。这种表示方式的好处是,语义相近的文献在向量空间中的距离也很近,即使它们用词完全不同。

实现这一步通常会用到专门的医学语言模型,比如BioBERT或PubMedBERT。这些模型在海量医学文献上预训练过,能够准确捕捉医学术语之间的关联。比如它知道"MI"、"AMI"和"acute myocardial infarction"指的是同一个概念,也知道"aspirin"和"antiplatelet therapy"存在上下位关系。

from transformers import AutoTokenizer, AutoModel

import torch

# 加载医学领域的预训练模型

tokenizer = AutoTokenizer.from_pretrained("microsoft/BiomedNLP-PubMedBERT-base-uncased-abstract")

model = AutoModel.from_pretrained("microsoft/BiomedNLP-PubMedBERT-base-uncased-abstract")

def encode_text(text):

inputs = tokenizer(text, return_tensors="pt", max_length=512, truncation=True)

with torch.no_grad():

outputs = model(**inputs)

# 取[CLS] token的输出作为文本向量

embeddings = outputs.last_hidden_state[:, 0, :].numpy()

return embeddings

# 示例:将文献摘要转换为向量

abstract = "Aspirin reduces the risk of recurrent myocardial infarction..."

vector = encode_text(abstract)

向量化之后,这些数据需要存储在专门的向量数据库中。目前主流的选择包括Pinecone、Milvus、Weaviate等。它们都支持高维向量的高效检索,能在毫秒级别从百万级文献中找到最相关的内容。根据实际测试,Milvus在开源方案中性能表现较好,而Pinecone则提供了更便捷的托管服务,省去了运维成本。

第二步是语义检索。当医生输入一个具体问题时,系统会先用同样的模型将问题转换成向量,然后在向量数据库中进行相似度搜索。这里用的通常是余弦相似度或欧氏距离等度量方式。检索出来的不是完全匹配的关键词,而是语义上最相关的文献片段。

第三步是生成答案。RAG的核心创新在于,它不是简单地返回检索结果,而是把这些相关文献作为上下文(Context)喂给大语言模型,让模型基于这些真实文献来生成回答。这样既避免了大模型的幻觉问题(编造不存在的信息),又能够生成连贯、针对性强的答案,而不是让用户自己去阅读一堆文献摘要。

实际应用中的技术挑战

理论很美好,但真正落地时会遇到各种意想不到的问题。最大的挑战之一是医学文献的结构化程度不统一。有些论文摘要写得很规范,清楚地列出研究目的、方法、结果、结论;有些则是一大段描述性文字,关键信息埋在中间。更复杂的是,很多重要信息藏在正文、图表和补充材料里,单纯依赖摘要会丢失大量细节。

我们团队最初的方案是只对摘要进行向量化,因为全文处理的计算成本太高。但很快发现,当医生询问具体的实验数据或治疗方案细节时,系统经常答不上来。后来改成了分级检索策略:先用摘要进行粗筛,找到相关文献后再对这些文献的全文进行精细检索。这种方式把检索召回率从约60%提升到了85%以上。

另一个棘手的问题是医学知识的时效性。一篇2020年的综述可能已经被2024年的新研究推翻了,如果系统不加区分地把旧文献和新文献混在一起,生成的答案就会自相矛盾。解决办法是在检索阶段引入时间权重,优先返回近期发表的高引用论文,同时在生成答案时明确标注信息来源和发表时间。

还有一个容易被忽视的问题是引用格式的规范性。医学文献必须注明出处,不仅是学术规范的要求,更是医生做临床决策时核验信息的需要。但大语言模型生成的内容经常会把多篇文献的信息混在一起,导致引用关系模糊。我们采用的方案是在Prompt中明确要求模型为每个论点标注来源文献的PMID(PubMed唯一标识符),然后在后处理阶段自动添加完整的引用信息。

from langchain.chains import RetrievalQA

from langchain.vectorstores import Milvus

from langchain.llms import OpenAI

# 构建RAG链

vectorstore = Milvus.from_documents(

documents=medical_docs,

embedding=medical_embeddings,

collection_name="pubmed_articles"

)

qa_chain = RetrievalQA.from_chain_type(

llm=OpenAI(temperature=0),

chain_type="stuff",

retriever=vectorstore.as_retriever(search_kwargs={"k": 5}),

return_source_documents=True

)

# 提问并获取答案

query = "What is the first-line treatment for type 2 diabetes?"

result = qa_chain({"query": query})

print(f"Answer: {result['result']}")

print(f"Sources: {[doc.metadata['pmid'] for doc in result['source_documents']]}")

从实验室到生产环境的距离

理论验证和生产应用之间隔着一道鸿沟。在实验环境里,我们可以用几千篇精心挑选的文献做测试,响应时间在5秒左右。但真实场景中,系统需要处理PubMed上超过3500万篇文献,而且用户期望的响应时间在2秒以内。

性能优化成了头等大事。第一个关键点是缓存策略。医学领域的问题虽然多样,但常见问题就那么几类,比如"某某疾病的诊断标准"、"某某药物的副作用"等。我们发现大约30%的查询是重复或高度相似的,因此引入了两层缓存:Redis缓存常见问题的答案,向量数据库缓存近期查询的检索结果。这让平均响应时间从4.5秒降到了1.8秒。

第二个优化是异步处理流水线。传统的同步调用方式是:等向量检索完成 → 等LLM生成答案 → 返回结果。改成异步后,向量检索和某些预处理任务可以并行执行,把总耗时再压缩了约40%。

模型选择也大有讲究。GPT-4虽然理解能力强,但API调用成本高,而且延迟较大。我们测试了多个模型,发现对于简单的文献摘要任务,使用开源的Llama 2-13B配合医学领域的微调,在准确性上与GPT-3.5相当,但推理速度快了一倍,成本降低了90%。只有在需要复杂推理或生成长篇综述时,才调用GPT-4。

一个意外的发现

在优化过程中,我们做了一个有趣的实验:让系统用同样的问题去查询不同的知识库,对比生成答案的质量。结果显示,知识库的构建质量对最终效果的影响远超预期,甚至比模型选择更重要。

一个精心设计的知识库应该包含文献的多层次信息:不仅有摘要和全文,还要提取出关键实体(疾病名称、药物、基因等)、研究方法、样本量、统计显著性等结构化字段。这些元数据能帮助检索系统更精准地定位信息。比如当医生问"有没有大规模随机对照试验证明XX治疗有效"时,系统可以直接筛选出研究类型为RCT且样本量大于500的文献,而不是返回一堆观察性研究。

在这个过程中,我们也尝试了一些现成的医学文献工具。像suppr超能文献(suppr.wilddata.cn)就提供了不错的中文检索和AI综述功能,底层应该也是用了类似的RAG架构。从技术角度看,他们在中文医学术语处理上做得比较到位,能够准确理解"心梗"、“心肌梗死”、"AMI"这些不同表述之间的等价关系。对于不想从零搭建系统的团队来说,这类工具可以作为快速原型验证的起点。

但如果要深度定制或集成到特定的临床系统中,自建方案仍然是必要的。特别是在数据隐私敏感的医疗场景,本地部署的向量数据库和开源大模型能够确保患者信息不出内网。我们最终采用的方案是:用Milvus搭建私有向量数据库,使用经过医学语料微调的Llama 2模型,配合LangChain做流程编排。整套系统部署在医院内网,既满足了合规要求,又保证了响应速度。

未来的想象空间

RAG技术在医学文献分析的应用才刚刚开始。目前大部分系统还停留在问答层面,但它的潜力远不止于此。一个值得探索的方向是自动文献综述生成。根据《Nature Communications: Health》在2025年1月发表的研究,结合知识图谱的RAG系统已经能够识别文献之间的引用关系、研究方法的演进、观点的对立和支持等复杂语义,这为自动化生成结构化综述创造了可能。

另一个有意思的应用是实时临床决策支持。当医生在电子病历系统中输入症状和检查结果时,RAG系统可以在后台自动检索最新文献,推送相关的诊疗建议。这不是简单的关键词匹配,而是基于患者具体情况的个性化推荐。比如对于一个有肾功能不全的糖尿病患者,系统不仅会推荐常规的降糖方案,还会特别提示哪些药物需要调整剂量或禁用。

技术演进的速度超乎想象。一年前我们还在纠结向量数据库的选型和部署,现在已经有了成熟的托管服务;那时候大模型的医学知识还很粗糙,需要大量人工校验,现在GPT-4和Claude在医学问答上的准确率已经接近专科医生水平。可以预见,再过两三年,RAG驱动的智能文献助手会成为每个医学研究者和临床医生的标配工具。

但技术归技术,医学的严谨性永远不能妥协。无论AI多么先进,它生成的答案都必须经过专业人士的审核,引用的文献都需要人工核验。RAG的价值在于提升效率,让医生能够把时间花在真正需要人类智慧的判断上,而不是被淹没在文献的海洋里。从这个意义上说,我们做的不是替代人类,而是增强人类的能力。

参考文献|资料|项目:

- Retrieval-augmented generation and LLM in biomedicine: systematic review - JAMIA, 2025

- RAG for generative AI in healthcare - Nature, 2025

- Enhancing medical AI with RAG - PMC, 2025

- Suppr 中文搜pubmed Github项目 - GitHub

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)