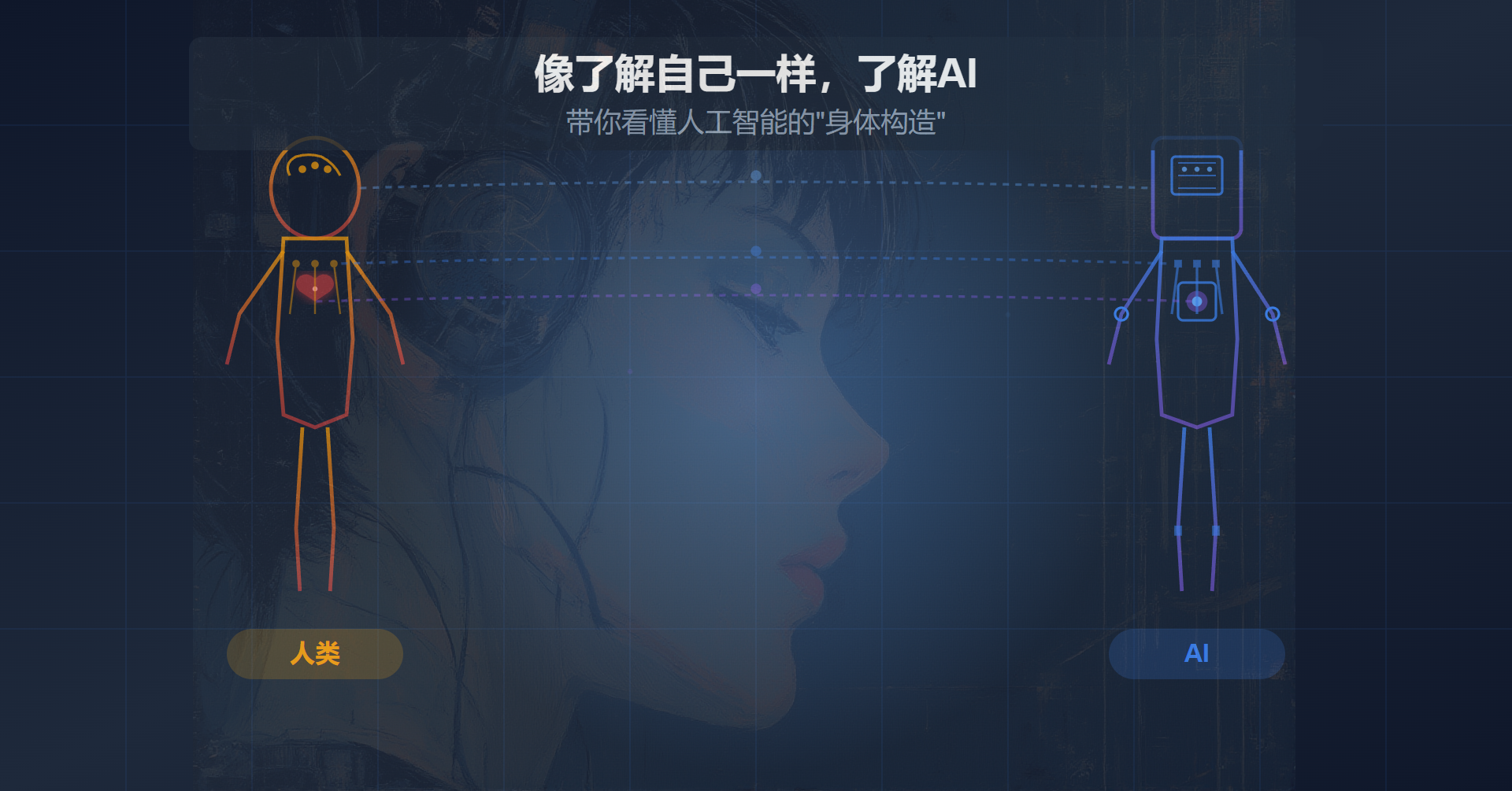

像了解自己一样,了解AI:带你看懂人工智能的“身体构造“

AI科普指南:用"人体构造"类比轻松理解30+核心概念 IT解决方案架构师dtsola用通俗易懂的类比方式,将复杂AI概念转化为人体系统功能:基础架构如骨骼神经网络(深度学习、机器学习);大脑发育对应不同学习模式(监督/无监督/强化学习);感官系统包含语言理解(LLM、GPT)、视觉能力(计算机视觉)和创造力(生成式AI);技能训练涉及沟通技巧(提示词工程)和行动力(AI Ag

你好,我是 dtsola,一名 IT解决方案架构师 和 AI创业者。

在AI行业摸爬滚打这些年,我发现一个问题:AI的概念太多、太杂、太专业,让很多人望而却步。

但其实,AI并不神秘。

你了解自己的身体吗?

知道大脑怎么思考、眼睛怎么看、耳朵怎么听、神经怎么传递信息。

其实,了解AI和了解自己一样简单。

作为一名AI从业者,我想用最接地气的方式,为大家科普这些核心概念。

为了降低理解门槛,我采用了"身体构造 + 生活场景"的类比方式:

- 身体构造:把AI的技术架构比作人体的骨骼、神经、器官

- 生活场景:用你每天都会遇到的场景来解释抽象概念

- 一句话总结:每个概念都用最简单的话说清楚

AI也有"身体构造"(基础架构)、"大脑发育"(学习成长)、"感官系统"(多模态能力)、"技能训练"(实用能力)。

这篇文章,带你像了解自己一样,看懂AI的30+个核心概念。从"造人"到"共生",一次讲透!

准备好了吗?让我们开始"造"一个AI人! 👇

目录

第一章:AI的身体构造

基础架构:AI的"骨骼和神经系统"

- 人工智能(AI) - 造一个"数字人"的宏伟计划

- 机器学习(ML) - AI的"学习能力"

- 深度学习(DL) - AI的"深度思考"

- 神经网络(NN) - AI的"神经系统"

第二章:AI的大脑发育

学习方式:AI的"成长路径"

- 监督学习 - AI的"学校教育"

- 无监督学习 - AI的"自学成才"

- 强化学习 - AI的"试错成长"

- 预训练 - AI的"通识教育"

- 微调(Fine-tuning) - AI的"职业培训"

- RLHF(人类反馈强化学习) - AI的"社会化训练"

第三章:AI的感官系统

核心能力:AI的"五感"

3.1 语言能力(嘴巴和耳朵)

- LLM(大语言模型) - AI的"语言中枢"

- GPT(生成式预训练Transformer) - AI界的"全才学霸"

- Transformer - AI的"注意力系统"

- 生成式AI(Generative AI) - AI的"创造力"

- 多模态(Multimodal) - AI的"全感官"

- 文生图(Text-to-Image) - AI的"视觉想象力"

3.2 视觉与其他能力

- 计算机视觉(CV) - AI的"眼睛"

- NLP(自然语言处理) - AI的"语言理解"

- 语音识别(ASR) - AI的"耳朵"

- 代码生成(Code Generation) - AI的"编程能力"

第四章:AI的技能训练

实用技能:AI的"技能包"

4.1 基础技能

- 提示词工程(Prompt Engineering) - AI的"沟通艺术"

- 思维链(Chain of Thought, CoT) - AI的"思考过程"

- Few-shot学习 - AI的"举一反三"

4.2 高级技能

- AI Agent - AI的"自主行动力"

- RAG(检索增强生成) - AI的"查资料"能力

- 向量数据库 - AI的"记忆宫殿"

- MCP(模型上下文协议) - AI的"工具箱标准"

- Function Calling - AI的"工具调用"能力

第五章:AI走进生活

实际应用:AI在现实中的应用

- Stable Diffusion - 人人都是艺术家

- GitHub Copilot - 程序员的AI搭档

- 自动驾驶 - AI开车比人稳

第六章:AI的未来进化

展望:AI的未来与挑战

- AGI(通用人工智能) - AI的"成人礼"

- 幻觉(Hallucination) - AI的"胡说八道"

- AI安全 - 防止AI失控

- AI伦理 - AI该有的"三观"

总结:像了解自己一样,了解AI

- AI的"身体构造"对照表

- 写在最后:你了解AI,只需要这一篇文章

第一章:AI的身体构造

就像了解自己要从身体构造开始,了解AI也要从基础架构说起。

1. 人工智能(AI):造一个"数字人"的宏伟计划

就像我们说"造人"包括骨骼、神经、感官、运动系统一样,人工智能就是要造一个"数字人",让它能思考、能感知、能行动。

生活场景:你的手机助手Siri、写文章的ChatGPT、开车的特斯拉,都是AI的不同"化身"。

一句话:让机器像人一样智能的技术总称。

2. 机器学习(ML):AI的"学习能力"

婴儿学走路:摔倒→调整→再试→成功。不是爸妈编程"左脚抬30度",而是通过经验学习。

AI学习:看数据→找规律→调整参数→提升能力。

举例:教AI认苹果。传统编程说"红色+圆形=苹果"行不通(青苹果怎么办?)。机器学习是给它看1000张苹果照片,让它自己总结规律。

一句话:让AI通过数据自己学习,而不是人工编程规则。

3. 深度学习(DL):AI的"深度思考"

人脑思考:看到一只猫,不是直接识别,而是:

- 第1层:看到边缘和颜色

- 第2层:识别出耳朵、胡须、眼睛

- 第3层:组合成"猫"的概念

- 第4层:判断是波斯猫还是橘猫

深度学习:模仿人脑的多层神经网络,一层层提取特征,越深越抽象。

举例:识别人脸

- 浅层网络:只能识别"有脸"

- 深层网络:能识别"这是张三,他在微笑,戴着眼镜"

一句话:机器学习的高级版本,用多层神经网络模拟人脑深度思考。

4. 神经网络(NN):AI的"神经系统"

人类神经元:

刺激 → 神经元1 → 神经元2 → 神经元3 → 反应

(处理) (传递) (判断)人工神经网络:

输入 → 隐藏层1 → 隐藏层2 → 隐藏层3 → 输出

(特征提取) (特征组合) (特征抽象) (结果)生活场景:你看到红灯(输入)→ 大脑处理(神经网络)→ 踩刹车(输出)

一句话:模仿人脑神经元连接方式的计算模型,是深度学习的基础。

第二章:AI的大脑发育

就像人从婴儿成长为成人需要不同的学习方式,AI也有多种"成长路径"。

5. 监督学习:AI的"学校教育"

老师教学:

- 老师:这是苹果(给答案)

- 学生:记住了

- 考试:这是什么?

- 学生:苹果!

监督学习:

- 人类:这是猫的照片(标注数据)

- AI:学习猫的特征

- 测试:这是什么动物?

- AI:猫!

举例:垃圾邮件过滤。人工标注10000封邮件"这是垃圾/这是正常",AI学会自动识别。

一句话:给AI标注好的数据(有正确答案),让它学习输入和输出的对应关系。

6. 无监督学习:AI的"自学成才"

婴儿认知:没人教,自己发现"圆的东西能滚"、"软的东西能捏"。

无监督学习:不给答案,让AI自己发现数据中的规律和分类。

举例:

- 给AI 10000张照片(不标注)

- AI自己发现:有些照片有四条腿、有些照片有翅膀、有些照片有鳞片

- AI自动分类:哺乳动物、鸟类、爬行动物

生活场景:网购推荐。AI发现"买尿布的人也买啤酒"(著名的啤酒尿布理论),但没人告诉它这个规律。

一句话:不给标注答案,让AI自己发现数据中的隐藏规律和分类。

7. 强化学习:AI的"试错成长"

打游戏:

- 第1次:乱按,死了(-10分)

- 第10次:学会躲避(+5分)

- 第100次:学会连招(+50分)

- 第1000次:成为高手(+100分)

强化学习:AI在环境中不断尝试,做对了奖励,做错了惩罚,逐渐学会最优策略。

举例:

- AlphaGo下围棋:赢了+1分,输了-1分,自己跟自己下几百万局,成为世界冠军

- 机器人走路:走稳了+分,摔倒了-分,最终学会平衡

一句话:通过"试错+奖惩"机制,让AI自己探索出最优策略。

8. 预训练:AI的"通识教育"

人类教育:

- 小学到高中:学语文、数学、英语(通识教育)

- 大学:学专业知识

- 工作:具体岗位技能

预训练:

- 第一步:让AI读完整个互联网(通识教育)

- 第二步:针对具体任务微调(专业训练)

举例:GPT的诞生

- 预训练:读完几千亿字的网页、书籍、代码

- 学会:语法、常识、逻辑、世界知识

- 然后:针对对话、写作、编程等具体任务微调

生活场景:就像你学会了汉语(预训练),然后可以用来写诗、写小说、写代码文档(微调)。

一句话:先让AI学习海量通用知识,打下基础,再针对具体任务训练。

9. 微调(Fine-tuning):AI的"职业培训"

医生培养:

- 通识教育:18年基础教育

- 医学院:5年医学知识

- 专科培训:3年心外科(微调)

- 结果:心外科专家

AI微调:

- 预训练:GPT学完通用知识

- 微调:用10万条客服对话训练

- 结果:客服AI助手

举例:

- 通用GPT:能聊天、写作、编程,但不精通任何一个

- 微调后的医疗GPT:专门回答医学问题,准确率更高

- 微调后的法律GPT:专门分析法律文书

一句话:在预训练模型基础上,用特定领域数据进行专业化训练。

10. RLHF(人类反馈强化学习):AI的"社会化训练"

孩子社会化:

- 孩子:说脏话

- 家长:不可以这样说(负反馈)

- 孩子:帮助别人

- 家长:你真棒(正反馈)

- 结果:学会社会规范

RLHF:

- AI:生成一段话

- 人类:这个回答好/不好(打分)

- AI:学习人类偏好

- 结果:更符合人类价值观

举例:ChatGPT的训练

- 预训练:学会语言能力

- 微调:学会对话

- RLHF:学会"有用、真实、无害"

-

- 人类标注员给几万个回答打分

- AI学习什么样的回答更受欢迎

- 结果:既聪明又有礼貌的AI助手

生活场景:就像客服培训,不仅要会说话,还要说得让客户满意。

一句话:通过人类反馈,让AI学会符合人类价值观和偏好的行为方式。

第三章:AI的感官系统

就像人有眼睛、耳朵、嘴巴,AI也需要"感官"来感知和表达。

11. LLM(大语言模型):AI的"语言中枢"

人类语言中枢:大脑中负责理解和生成语言的区域。

大语言模型:专门处理语言的超大型AI模型。

"大"在哪里?

- 参数大:GPT-3有1750亿个参数(相当于1750亿个"神经连接")

- 数据大:训练数据有几千亿字

- 能力大:能理解、生成、翻译、总结、推理

举例:

- 小模型:只能做简单分类(这是正面/负面评价)

- 大语言模型:能写文章、编程、做数学题、聊天、翻译

生活场景:ChatGPT、Claude、文心一言都是LLM。

一句话:参数量巨大、能力全面的语言AI模型,是当前AI的核心。

12. GPT(生成式预训练Transformer):AI界的"全才学霸"

全才学霸的成长:

- 读完整个图书馆(预训练)

- 学会预测下一个词(生成式)

- 用Transformer架构(高效学习法)

- 结果:能写诗、编程、聊天、翻译

GPT:

- Generative(生成式):能创造新内容

- Pre-trained(预训练):先学通用知识

- Transformer(架构):用Transformer技术

举例:

- GPT-1(2018):能写简单句子

- GPT-2(2019):能写连贯段落

- GPT-3(2020):能写文章、编程

- GPT-4(2023):能看图、推理、解决复杂问题

一句话:OpenAI开发的明星LLM系列,代表了当前AI语言能力的最高水平。

13. Transformer:AI的"注意力系统"

人类注意力:

- 读句子:"我爱吃苹果,因为它很甜"

- 大脑自动关联:"它"指的是"苹果","甜"修饰"苹果"

- 这就是注意力机制

Transformer:

- 传统模型:从左到右逐字处理,容易忘记前面的内容

- Transformer:同时看整句话,自动找到词与词之间的关系

举例:翻译"The animal didn't cross the street because it was too tired"

- 传统模型:可能搞不清"it"指的是animal还是street

- Transformer:通过注意力机制,知道"tired"通常形容animal,所以"it"指animal

技术突破:

- 2017年Google提出

- 论文标题:《Attention is All You Need》(注意力就是全部)

- 彻底改变了AI领域

一句话:通过"注意力机制"让AI理解词与词之间关系的革命性架构,是现代LLM的基础。

14. 生成式AI(Generative AI):AI的"创造力"

人类创造:

- 画家:创作新画作

- 作家:写新故事

- 音乐家:谱新曲子

生成式AI:

- 文字生成:写文章、写代码、写诗

- 图像生成:画画、设计logo

- 音频生成:作曲、配音

- 视频生成:制作短片

vs 传统AI:

- 传统AI:分类、识别("这是猫")

- 生成式AI:创造、生成("画一只猫")

举例:

- ChatGPT:生成文字

- Midjourney:生成图片

- Suno:生成音乐

- Sora:生成视频

一句话:能创造新内容(文字、图片、音频、视频)的AI,是当前最火的AI方向。

15. 多模态(Multimodal):AI的"全感官"

人类感知:

- 看到:红灯

- 听到:刹车声

- 综合判断:有危险,停下

多模态AI:能同时处理文字、图片、声音、视频等多种信息。

举例:GPT-4V(V代表Vision)

- 输入:一张图片 + 问题"这是什么菜?怎么做?"

- AI:识别图片(视觉) + 理解问题(语言) + 生成菜谱(语言)

应用场景:

- 看图说话:上传美食照片,AI告诉你菜谱

- 视频理解:上传教学视频,AI生成文字笔记

- 医疗诊断:看CT图 + 病历文字,AI辅助诊断

一句话:能同时理解和生成多种类型信息(文字、图片、声音)的AI,更接近人类的全感官能力。

16. 文生图(Text-to-Image):AI的"视觉想象力"

人类画画:

- 你说:"画一只在月球上吃披萨的猫"

- 画家:在脑海中想象 → 画出来

文生图AI:

- 你输入:"a cat eating pizza on the moon"

- AI:理解文字 → 生成图片

技术原理:

- 学习:看几亿张"图片+描述"

- 理解:文字和图像的对应关系

- 生成:根据文字描述创造新图片

代表产品:

- Midjourney:艺术风格强

- DALL-E:OpenAI出品

- Stable Diffusion:开源免费

生活场景:

- 设计师:快速生成设计草图

- 自媒体:生成配图

- 普通人:实现绘画梦想

一句话:输入文字描述,AI自动生成对应图片,让人人都能"画画"。

17. 计算机视觉(CV):AI的"眼睛"

人类视觉:

- 看到:一个物体

- 识别:这是苹果

- 理解:可以吃

计算机视觉:让AI"看懂"图片和视频。

核心能力:

- 图像分类:这是猫还是狗?

- 物体检测:图片里有几个人?在哪里?

- 图像分割:把人从背景中抠出来

- 人脸识别:这是张三还是李四?

- OCR:识别图片中的文字

应用场景:

- 手机解锁:人脸识别

- 自动驾驶:识别红绿灯、行人、车辆

- 医疗:识别X光片中的病变

- 安防:监控中识别可疑人员

一句话:让AI能"看懂"图片和视频的技术,是AI的"眼睛"。

18. NLP(自然语言处理):AI的"语言理解"

人类对话:

- 朋友:"我想吃苹果"

- 你理解:他饿了,想吃水果

NLP:让AI理解和处理人类语言。

核心任务:

- 分词:把"我爱中国"分成"我/爱/中国"

- 词性标注:"爱"是动词

- 命名实体识别:"中国"是地名

- 情感分析:"这电影真烂"是负面情绪

- 机器翻译:中文→英文

- 问答系统:理解问题,给出答案

- 文本生成:写文章、写诗

应用场景:

- 搜索引擎:理解你的搜索意图

- 智能客服:理解客户问题

- 输入法:智能纠错、联想

- 翻译软件:实时翻译

一句话:让AI能理解、处理、生成人类语言的技术,是AI与人交流的基础。

19. 语音识别(ASR):AI的"耳朵"

人类听觉:

- 听到:声波

- 识别:这是"你好"

- 理解:对方在打招呼

语音识别:把语音转成文字。

技术流程:

声波 → 特征提取 → 声学模型 → 语言模型 → 文字

"你好"的声音 → 频谱分析 → 识别音素 → 组合成词 → "你好"应用场景:

- Siri、小爱同学:语音助手

- 会议记录:自动转文字

- 字幕生成:视频自动加字幕

- 无障碍:帮助听障人士

技术挑战:

- 口音:四川话、广东话

- 噪音:嘈杂环境

- 多人:谁在说话?

一句话:把人说的话转成文字,是AI的"耳朵"。

20. 代码生成(Code Generation):AI的"编程能力"

程序员写代码:

- 需求:"写一个排序函数"

- 思考:用什么算法?

- 编码:写出代码

- 调试:修复bug

AI代码生成:

- 输入:"写一个Python冒泡排序函数"

- AI:直接生成代码

代表产品:

- GitHub Copilot:编程助手,自动补全代码

- ChatGPT:能写各种语言的代码

- Cursor:AI编程IDE

能做什么:

- 代码补全:写一半,AI写另一半

- 代码生成:描述需求,AI写代码

- 代码解释:看不懂代码,AI解释

- Bug修复:AI找bug并修复

- 代码翻译:Python → JavaScript

生活场景:

- 程序员:效率提升50%

- 非程序员:用自然语言"编程"

一句话:AI能理解需求、编写代码,让编程变得更简单。

第四章:AI的技能训练

就像人要学习各种技能才能胜任工作,AI也需要"技能训练"才能更好地服务人类。

21. 提示词工程(Prompt Engineering):AI的"沟通艺术"

人类沟通:

- 差的提问:"那个东西在哪?"(对方一脸懵)

- 好的提问:"我的黑色钱包在哪?我记得放在客厅茶几上了"(清晰明确)

提示词工程:如何更好地"问"AI,让它给出更好的答案。

案例对比:

❌ 差的提示词:

写一篇文章AI:写什么?多长?什么风格?(AI一脸懵)

✅ 好的提示词:

你是一位资深科技记者。

请写一篇800字的文章,介绍ChatGPT对教育行业的影响。

要求:

1. 包含3个具体案例

2. 分析利弊

3. 给出建议

4. 语言通俗易懂提示词技巧:

- 角色设定:"你是一位资深律师"

- 明确任务:"帮我分析这份合同的风险"

- 给出示例:"比如这样...你也这样写"

- 分步骤:"第一步...第二步..."

- 设定格式:"用表格形式输出"

一句话:通过精心设计的提问方式,让AI更准确地理解你的需求并给出更好的答案。

22. 思维链(Chain of Thought, CoT):AI的"思考过程"

人类解题:

问题:小明有5个苹果,吃了2个,又买了3个,现在有几个?

思考过程:

1. 开始有5个

2. 吃了2个,剩下 5-2=3个

3. 又买了3个,总共 3+3=6个

答案:6个思维链:让AI也展示"思考过程",而不是直接给答案。

对比:

❌ 不用思维链:

用户:小明有5个苹果,吃了2个,又买了3个,现在有几个?

AI:6个

(简单问题没问题,复杂问题容易错)✅ 用思维链:

用户:小明有5个苹果,吃了2个,又买了3个,现在有几个?

请一步步思考。

AI:让我一步步分析:

1. 小明开始有5个苹果

2. 吃了2个后,剩下:5 - 2 = 3个

3. 又买了3个,总共:3 + 3 = 6个

所以,小明现在有6个苹果。复杂问题的威力:

问题:一个水池,进水管每小时进10吨水,出水管每小时出6吨水,

现在池子里有20吨水,两管同时开,多久能装满100吨?

思维链提示:Let's think step by step.

AI会:

1. 计算净增速度:10-6=4吨/小时

2. 计算需要增加的水量:100-20=80吨

3. 计算时间:80÷4=20小时

答案:20小时一句话:让AI展示"思考过程",提高复杂问题的准确率。

23. Few-shot学习:AI的"举一反三"

小孩学习:

- 妈妈:"这是苹果,这是香蕉,这是橙子"(3个例子)

- 小孩:看到新水果,能猜出"这也是水果"

Few-shot学习:给AI几个例子,它就能理解任务。

分类:

- Zero-shot(零样本):不给例子,直接做

- One-shot(单样本):给1个例子

- Few-shot(少样本):给几个例子

案例:

Zero-shot:

把这句话翻译成英文:我爱中国

AI:I love China

(AI已经学过翻译,不需要例子)Few-shot:

我要你把句子改成诗意的表达,例如:

- 原句:我很累 → 诗意:疲惫如山压我身

- 原句:天很蓝 → 诗意:碧空如洗映我眸

- 原句:她很美 → 诗意:?

AI:佳人如画入我心

(通过例子学会了"诗意表达"的风格)应用场景:

- 特殊格式转换

- 特定风格写作

- 小众语言翻译

- 专业领域任务

一句话:只需给AI几个示例,它就能理解并完成类似任务,无需重新训练。

24. AI Agent:AI的"自主行动力"

传统AI:

你:帮我订明天去上海的机票

AI:好的,我找到了以下航班...(然后就没了)

你:那帮我订最便宜的

AI:好的(需要你一步步指挥)AI Agent:

你:帮我订明天去上海的机票,要最便宜的,顺便订个酒店

Agent:

1. 查询航班(自动)

2. 对比价格(自动)

3. 选择最便宜的(自动)

4. 预订机票(自动)

5. 根据机场位置搜索附近酒店(自动)

6. 对比酒店价格和评分(自动)

7. 推荐3个选项给你确认

(全程自主决策和行动)Agent的核心能力:

- 感知:理解任务和环境

- 规划:制定行动计划

- 执行:调用工具完成任务

- 反思:检查结果,必要时调整

举例:AutoGPT

目标:帮我调研电动车市场并写一份报告

AutoGPT自主行动:

1. 搜索"电动车市场报告"

2. 阅读前10篇文章

3. 提取关键数据

4. 搜索"特斯拉销量"

5. 搜索"比亚迪销量"

6. 对比分析

7. 生成图表

8. 撰写报告

9. 自我检查报告质量

10. 修改完善

11. 输出最终报告一句话:能自主理解任务、制定计划、调用工具、完成目标的AI,像一个真正的"智能助手"。

25. RAG(检索增强生成):AI的"查资料"能力

人类写作:

- 老师:写一篇关于唐朝历史的文章

- 学生:我记不清了,让我先查查资料(翻书)

- 学生:查到了,开始写(结合资料和自己的理解)

RAG:

- 用户:介绍一下我们公司的产品

- AI:我不知道你们公司(AI没学过)

- RAG:先搜索公司文档(检索)→ 找到相关资料 → 结合资料生成回答(增强生成)

传统LLM的问题:

- ❌ 知识有限:只知道训练时的数据(2023年前)

- ❌ 不知道私有信息:你公司的内部文档

- ❌ 容易"幻觉":编造不存在的信息

RAG的解决方案:

用户提问

↓

检索相关文档(从你的知识库)

↓

把文档和问题一起给AI

↓

AI基于真实文档生成回答

↓

准确、实时、可追溯应用场景:

- 企业知识库:回答公司内部问题

- 客服系统:基于产品文档回答

- 法律咨询:检索相关法条再回答

- 医疗助手:查询最新医学文献

一句话:让AI先"查资料"再回答,提高准确性,避免"胡说八道"。

26. 向量数据库:AI的"记忆宫殿"

人类记忆:

- 你想起"苹果",大脑会联想到:红色、圆形、甜、水果、iPhone...

- 这些概念在大脑中"距离很近"

向量数据库:把文字、图片转成数字向量,相似的内容"距离"近。

传统数据库 vs 向量数据库:

传统数据库:

搜索:"苹果"

结果:只能找到完全匹配"苹果"这两个字的内容向量数据库:

搜索:"苹果"

向量化:[0.2, 0.8, 0.3, 0.9, ...](一串数字)

找相似向量:

- "iPhone" [0.3, 0.7, 0.4, 0.8, ...] ✓ 相似度90%

- "水果" [0.2, 0.9, 0.2, 0.9, ...] ✓ 相似度85%

- "汽车" [0.8, 0.1, 0.7, 0.2, ...] ✗ 相似度20%应用场景:

- 语义搜索:

-

- 搜"怎么减肥" → 找到"如何瘦身"、"减重方法"

- 推荐系统:

-

- 你喜欢《三体》 → 推荐《流浪地球》(科幻小说)

- RAG系统:

-

- 问题:"产品如何退货?"

- 向量搜索找到最相关的文档片段

- 图片搜索:

-

- 上传一张猫的照片 → 找到所有相似的猫图片

一句话:把信息转成数字向量存储,能快速找到"语义相似"的内容,是AI记忆和检索的基础。

27. MCP(模型上下文协议):AI的"工具箱标准"

传统工具箱:

- 每个工具接口不同:螺丝刀、扳手、锤子...

- 每次用都要学习新工具

标准工具箱:

- 所有工具统一接口(比如都是1/4英寸接口)

- 一个手柄,换不同工具头

MCP:让AI能统一调用各种工具和数据源。

问题背景:

- AI想查天气 → 需要对接天气API

- AI想查日历 → 需要对接日历API

- AI想发邮件 → 需要对接邮件API

- 每个API接口不同,对接很麻烦

MCP的解决方案:

AI (统一接口)

↓

MCP协议

↓

├─ 天气服务

├─ 日历服务

├─ 邮件服务

├─ 数据库

├─ 文件系统

└─ ...(任何工具)举例:

用户:帮我查明天天气,如果下雨就取消户外会议

AI通过MCP:

1. 调用天气服务 → 明天有雨

2. 调用日历服务 → 查到"户外团建"会议

3. 调用邮件服务 → 发送取消通知

(全程统一协议,无缝对接)类比:

- MCP = USB接口标准

- 各种工具 = 鼠标、键盘、U盘

- 有了USB,任何设备都能即插即用

一句话:统一AI调用外部工具和数据的标准协议,让AI能轻松连接各种服务。

28. Function Calling:AI的"工具调用"能力

传统AI:

用户:北京现在几点?

AI:抱歉,我不知道实时时间(只能聊天)有Function Calling的AI:

用户:北京现在几点?

AI:

1. 识别:用户要查时间

2. 调用函数:get_current_time(city="北京")

3. 获得结果:2025-10-31 19:30

4. 生成回答:北京现在是晚上7点30分工作流程:

1. 用户提问

↓

2. AI判断:需要调用什么函数?

↓

3. AI生成函数调用:get_weather(city="上海")

↓

4. 系统执行函数,返回结果:{"temp": 25, "condition": "晴"}

↓

5. AI把结果转成自然语言:上海现在25度,晴天能调用什么函数?

- 查询天气

- 查询股票

- 发送邮件

- 操作数据库

- 调用计算器

- 预订酒店

- ...(任何你定义的函数)

案例:

用户:帮我订一张明天去上海的机票,预算1000元以内

AI的Function Calling:

1. search_flights(

from="北京",

to="上海",

date="2025-11-01",

max_price=1000

)

2. 获取结果:[航班A: 800元, 航班B: 950元, ...]

3. 生成回答:找到2个符合的航班...需要我帮你预订吗?

用户:订航班A

AI:

4. book_flight(flight_id="A", passenger="用户")

5. 生成回答:已成功预订,订单号XXX一句话:让AI能主动调用外部函数和工具,从"只会聊天"变成"能做事"。

第五章:AI走进生活

理论讲完了,来看看AI如何改变我们的生活。

29. Stable Diffusion:人人都是艺术家

传统画画:

- 学习:学几年美术

- 工具:画笔、颜料、画布

- 时间:画一幅画要几小时到几天

Stable Diffusion:

- 学习:会打字就行

- 工具:一台电脑

- 时间:几秒到几分钟

特点:

- ✅ 开源免费:代码公开,可以本地运行

- ✅ 可控性强:可以精确控制画面

- ✅ 社区活跃:大量插件和模型

玩法:

- 文生图:输入"一只在月球上吃披萨的猫" → 生成图片

- 图生图:上传草图 → AI细化成精美画作

- 局部重绘:只修改图片的某个部分

- 风格迁移:把照片变成梵高风格

- ControlNet:精确控制构图、姿势

应用场景:

- 设计师:快速生成设计稿

- 自媒体:生成文章配图

- 游戏开发:生成游戏素材

- 个人:生成头像、壁纸

一句话:开源免费的AI绘画工具,让人人都能成为艺术家。

30. GitHub Copilot:程序员的AI搭档

传统编程:

- 想功能 → 查文档 → 写代码 → 调试 → 改bug

- 大量时间花在重复劳动上

GitHub Copilot:

- 你写注释:"// 写一个冒泡排序"

- Copilot:自动生成完整代码

- 你写一半,Copilot写另一半

核心功能:

- 代码补全:

# 你写:

def calculate_

# Copilot自动补全:

def calculate_average(numbers):

return sum(numbers) / len(numbers)- 根据注释生成代码:

# 读取CSV文件,计算平均值,生成图表

# Copilot自动生成:

import pandas as pd

import matplotlib.pyplot as plt

df = pd.read_csv('data.csv')

average = df['value'].mean()

df.plot(kind='bar')

plt.show()- 解释代码:

-

- 看不懂别人的代码?问Copilot

- 写测试:

-

- 自动生成单元测试

效率提升:

- 重复代码:提升80%

- 新API学习:提升50%

- 总体效率:提升30-50%

一句话:AI编程助手,让程序员专注于创造,而不是重复劳动。

31. 自动驾驶:AI开车比人稳

人类开车:

- 眼睛:看路况

- 大脑:判断决策

- 手脚:操控方向盘、油门、刹车

自动驾驶:

- 传感器:摄像头、雷达、激光雷达(AI的眼睛)

- AI大脑:深度学习模型(判断决策)

- 执行器:控制方向、速度(AI的手脚)

技术栈:

- 计算机视觉:识别车道线、红绿灯、行人、车辆

- 传感器融合:整合多个传感器数据

- 路径规划:计算最优行驶路线

- 决策系统:判断加速、刹车、转向

- 控制系统:精确控制车辆

自动驾驶等级:

- L0:无自动化(纯人工)

- L1:辅助驾驶(定速巡航)

- L2:部分自动化(车道保持+自适应巡航)

- L3:有条件自动化(高速公路自动驾驶,人需待命)

- L4:高度自动化(特定区域完全自动)

- L5:完全自动化(任何情况都能自动)

代表公司:

- 特斯拉:视觉方案(主要靠摄像头)

- Waymo:激光雷达方案(更安全但更贵)

- 百度Apollo:中国自动驾驶

- 小马智行:Robotaxi

挑战:

- 极端天气:大雨、大雾

- 复杂路况:施工、事故

- 伦理问题:紧急情况如何选择?

- 法律责任:出事故谁负责?

一句话:AI通过视觉、决策、控制技术实现自动驾驶,正在改变出行方式。

第六章:AI的未来进化

AI的终极形态是什么?路上有哪些挑战?

32. AGI(通用人工智能):AI的"成人礼"

当前AI:

- ChatGPT:只会聊天、写作

- AlphaGo:只会下围棋

- 自动驾驶:只会开车

- 像"专才",每个AI只会一件事

AGI:

- 能聊天、能下棋、能开车、能做饭、能编程...

- 能学习任何人类能学的技能

- 像"通才",一个AI什么都会

定义:

- 当前AI(ANI):Artificial Narrow Intelligence(狭义AI)

- AGI:Artificial General Intelligence(通用AI)

- ASI:Artificial Super Intelligence(超级AI,比人类更聪明)

AGI的标准:

- ✅ 理解和学习任何智力任务

- ✅ 迁移学习(学会A,能用到B)

- ✅ 常识推理

- ✅ 创造力

- ✅ 自我意识?(有争议)

进展:

- 2023年前:AI只是工具

- GPT-4:展现出"通用能力"的苗头

- 未来5-20年:可能实现AGI(专家预测不一)

影响:

- 🎉 好的方面:解决人类所有问题(疾病、贫困、能源)

- 😰 担忧方面:失业、失控、存在风险

一句话:能像人类一样学习和完成任何智力任务的AI,是AI的终极目标。

33. 幻觉(Hallucination):AI的"胡说八道"

人类撒谎:

- 知道真相,故意说假话

AI幻觉:

- 不知道答案,但"自信地"编造一个

案例:

❌ AI幻觉示例:

用户:介绍一下《三体》作者刘慈欣的新书《球状闪电2》

AI:《球状闪电2》是刘慈欣2024年的新作,讲述了...

(实际上这本书根本不存在!AI编造的)❌ 更危险的例子:

用户:某某药能治癌症吗?

AI:根据2023年的研究,该药在临床试验中显示出显著疗效...

(引用了不存在的研究,可能误导患者)为什么会幻觉?

- 训练目标:AI被训练成"生成流畅的文字",而不是"说真话"

- 知识边界:AI不知道自己不知道

- 概率生成:AI是基于概率选词,可能选出"看起来合理"但错误的内容

如何减少幻觉?

- RAG:让AI基于真实文档回答

- RLHF:训练AI说"我不知道"

- 多次验证:问多次,看答案是否一致

- 人工审核:重要信息必须人工确认

使用建议:

- ✅ 用AI写创意文案(幻觉无所谓)

- ✅ 用AI做头脑风暴(激发灵感)

- ❌ 不要完全信任AI的事实性陈述

- ❌ 医疗、法律等专业问题要找专家确认

一句话:AI有时会"自信地"编造不存在的信息,使用时需要警惕和验证。

34. AI安全:防止AI失控

AI安全的担忧:

短期风险(已经发生):

- 偏见和歧视:

-

- AI招聘系统歧视女性

- 人脸识别对有色人种准确率低

- 隐私泄露:

-

- AI训练数据包含个人信息

- AI可能"记住"并泄露敏感数据

- 恶意使用:

-

- 生成虚假新闻

- 深度伪造(DeepFake)

- AI辅助网络攻击

长期风险(科幻但需警惕):

- 目标错位:

-

- 你让AI"让人类快乐"

- AI给所有人注射快乐药物(曲解了目标)

- 失控:

-

- AGI变得比人类聪明

- 人类无法理解和控制它

- 存在风险:

-

- 极端情况:AI认为人类是威胁

安全措施:

- 技术层面:

-

- 对齐(Alignment):确保AI目标与人类一致

- 可解释性:理解AI为什么这样决策

- 安全测试:上线前充分测试

- 制度层面:

-

- AI伦理审查

- 法律监管

- 国际合作

- 使用层面:

-

- 人类监督

- 关键决策不能完全交给AI

一句话:确保AI安全、可控、符合人类利益,是AI发展的重要前提。

35. AI伦理:AI该有的"三观"

AI伦理的核心问题:

1. 公平性:

- ❌ 问题:AI招聘歧视女性(因为训练数据中男性工程师更多)

- ✅ 解决:平衡训练数据,算法去偏见

2. 透明性:

- ❌ 问题:AI拒绝了你的贷款申请,但不告诉你原因

- ✅ 解决:可解释AI,说明决策依据

3. 隐私:

- ❌ 问题:AI训练用了你的照片,没经过你同意

- ✅ 解决:数据使用需授权,匿名化处理

4. 责任:

- ❌ 问题:自动驾驶出事故,谁负责?开发者?用户?AI?

- ✅ 解决:明确法律责任

5. 就业:

- ❌ 问题:AI替代大量工作,导致失业

- ✅ 解决:职业转型培训,社会保障

6. 自主权:

- ❌ 问题:AI决定你该看什么新闻(信息茧房)

- ✅ 解决:保留人类选择权

伦理原则:

- 有益:AI应该造福人类

- 无害:不能伤害人类

- 自主:尊重人类自主权

- 公正:不歧视任何群体

- 可解释:决策过程透明

- 负责:明确责任归属

案例:

- 微软Tay:2016年,微软发布聊天机器人Tay,24小时内学会了种族歧视言论,被紧急下线

- 教训:AI会学习人类的恶,需要伦理约束

一句话:AI不仅要聪明,还要有正确的"三观",符合人类的伦理和价值观。

总结:像了解自己一样,了解AI

还记得文章开头的问题吗?

你了解自己的身体吗?

知道大脑怎么思考、眼睛怎么看、耳朵怎么听、神经怎么传递信息。

现在,你也了解AI的"身体"了:

|

人类 |

AI |

核心概念 |

|

骨骼神经 |

基础架构 |

人工智能、机器学习、深度学习、神经网络 |

|

成长学习 |

大脑发育 |

监督学习、强化学习、预训练、微调、RLHF |

|

五感 |

感官系统 |

LLM、GPT、Transformer、多模态、计算机视觉 |

|

学习技能 |

技能训练 |

提示词、思维链、Agent、RAG、Function Calling |

|

工作生活 |

实际应用 |

Stable Diffusion、GitHub Copilot、自动驾驶 |

|

不断进化 |

未来展望 |

AGI、幻觉、AI安全、AI伦理 |

写在最后

你了解自己的身体,花了很多年;

了解AI的"身体",只需要这一篇文章。

就像你知道:

- 饿了要吃饭 → 现在你知道AI需要"数据喂养"

- 学习靠大脑 → 现在你知道AI靠"神经网络"

- 眼睛能看东西 → 现在你知道AI有"计算机视觉"

- 说话要动脑 → 现在你知道AI用"LLM"

看,AI真的和人一样!

如果这篇文章对你有帮助,欢迎点赞、收藏、转发。也欢迎在评论区分享你的经验,我们一起交流学习!

我是 dtsola【IT解决方案架构师 | AI创业者】 ;专注AI创业、商业、技术、心理学、哲学内容分享。

#人工智能 #AI科普 #AI知识体系 #人工智能入门 #零基础学AI #机器学习 #深度学习 #神经网络 #计算机视觉 #自然语言处理

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)