AI时代必备技能:DeepSeek-R1满血版671B本地服务器部署教程,大模型入门到精通,收藏这篇就足够了!

本博主目前主要技术方向为AIGC应用,为了帮助提供基础服务的朋友快速部署DeepSeek-R1 满血版模型,为上层应用提供稳定高效的模型服务能力,特出此教程。

本博主目前主要技术方向为AIGC应用,为了帮助提供基础服务的朋友快速部署DeepSeek-R1 满血版模型,为上层应用提供稳定高效的模型服务能力,特出此教程。

环境准备

资源要求:

服务器2台

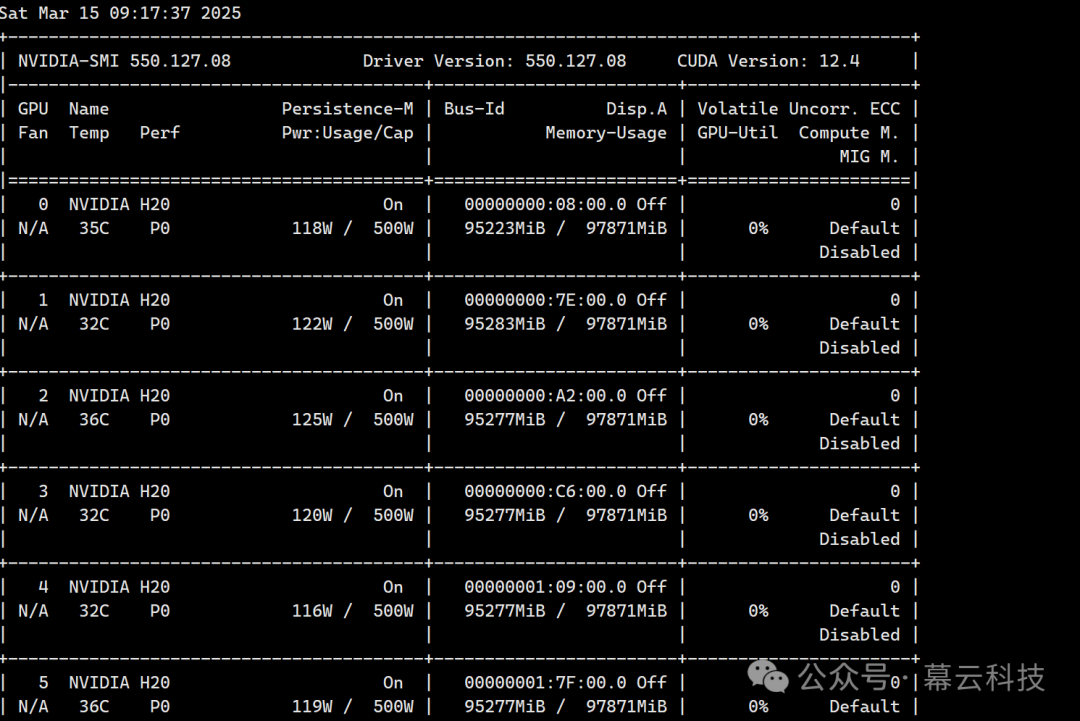

显卡 H20 GPU*16 每台8张

IB训练网络

服务器配置:

本教程以虚机为例

CPU192 C

内存 1024 G

系统盘 200 G

数据盘 3072G

模型文件大概1.3T当然你可以通过挂在共享盘,或者外挂移动硬盘的方式节省数据盘的容量

系统需求:

系统的显卡驱动是必须的

操作系统版本

Ubuntu 22.04

操作系统驱动版本

Driver:550.90.07

Cuda: 12.6

执行命令nvidia-smi 查看

安装Docker

安装必要的一些系统工具

sudo apt-get update

sudo apt-get install ca-certificates curl gnupg

信任 Docker 的 GPG 公钥

sudo install -m 0755 -d /etc/apt/keyrings

curl -fsSL https://mirrors.aliyun.com/docker-ce/linux/ubuntu/gpg | sudo gpg --dearmor -o /etc/apt/keyrings/docker.gpg

sudo chmod a+r /etc/apt/keyrings/docker.gpg

写入软件源信息

echo \

"deb [arch=$(dpkg --print-architecture) signed-by=/etc/apt/keyrings/docker.gpg] https://mirrors.aliyun.com/docker-ce/linux/ubuntu \

"$(. /etc/os-release && echo "$VERSION_CODENAME")" stable" | \

sudo tee /etc/apt/sources.list.d/docker.list > /dev/null

安装Docker

sudo apt-get update

sudo apt-get install docker-ce docker-ce-cli containerd.io docker-buildx-plugin docker-compose-plugin

安装Docker-CE:

sudo apt-get -y install docker-ce

设置docker 开机自启动

sudo systemctl enable docker

安装英伟达容器驱动

获取Key

curl -s -L https://nvidia.github.io/nvidia-container-runtime/gpgkey | sudo apt-key add -

获取版本,添加源

curl -s -L https://nvidia.github.io/nvidia-container-runtime/$(. /etc/os-release;echo $ID$VERSION_ID)/nvidia-container-runtime.list | sudo tee /etc/apt/sources.list.d/nvidia-container-runtime.list

更新

apt-get update

安装

apt install nvidia-container-runtime -y

增加配置

sudo nvidia-ctk runtime configure --runtime=docker

重启Docker

sudo systemctl restart docker

以下为补充说明和校验安装成功

文档补充 https://nvidia.github.io/nvidia-container-runtime/

curl -s -L https://nvidia.github.io/nvidia-container-runtime/gpgkey | \

sudo apt-key add -

distribution=$(. /etc/os-release;echo $ID$VERSION_ID)

curl -s -L https://nvidia.github.io/nvidia-container-runtime/$distribution/nvidia-container-runtime.list | \

sudo tee /etc/apt/sources.list.d/nvidia-container-runtime.list

sudo apt-get update

判断安装是否成功

dpkg -l | grep nvidia-container-runtime

nvidia-container-runtime --version

模型文件准备

下载权重文件

权重文件较大,整体约1.3T,网络下载耗时较长,建议使用高速网络或者离线拷贝的方式。

git lfs install

git clone https://www.modelscope.cn/deepseek-ai/DeepSeek-R1.git

权重复制到各个node

scp -r DeepSeek-R1 root@10.151.xx.xx:/mnt/nemo-ds-r1

模型部署

本次教程是双节点,master 和node

实力雄厚的可以按照本次教程的方式添加多个node

启动Docker镜像(master)

根据实际情况替换你的网卡名称,master节点IP地址,模型文件路径等

sudo docker run -it -d \

--restart=always \

--gpus all \

--shm-size 32g \

--network host \

--privileged \

--entrypoint /bin/bash \

--env NCCL_SOCKET_IFNAME=eth0 \

--env GLOO_SOCKET_IFNAME=eth0 \

-e NCCL_IB_HCA=mlx5_0,mlx5_3,mlx5_4,mlx5_7 \

-v /mnt/nemo-ds-r1:/root/.cache/huggingface/nemo-deepseek-r1 \

cp-controller-cn-beijing.cr.volces.com/appdeliver-ml/sglang:0.4.2 \

-c "python3 -m sglang.launch_server --model-path /root/.cache/huggingface/nemo-deepseek-r1 --tp 16 --dist-init-addr 10.151.xx.xx:5000 --nnodes 2 --node-rank 0 --trust-remote-code --port 30000 --host 0.0.0.0 --mem-fraction-static 0.9"

请在master 启动3到5分钟之后再执行node 的运行操作

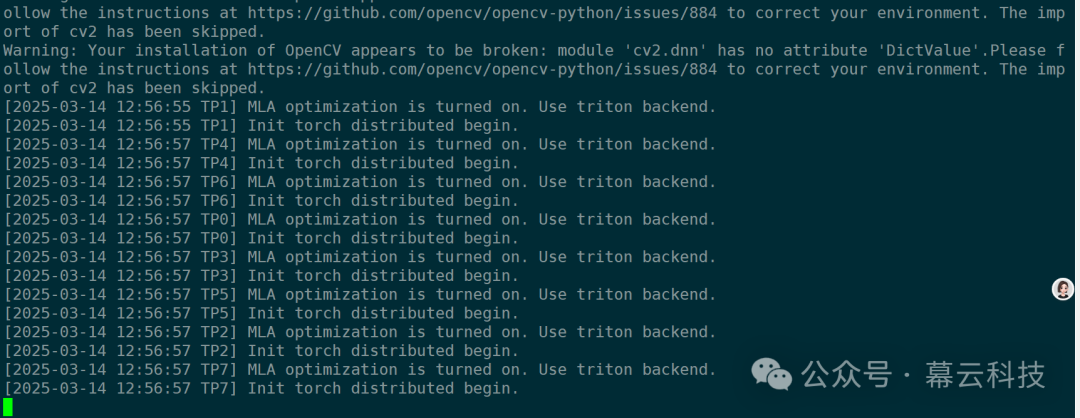

看到如下界面,等待node 节点加入

说明:

a. 以上脚本需在master或者node1执行

b. 注意挂载权重文件目录挂载

c. 也可以增加----privileged等参数,或修改以-d的模式启动,自行调整。

d. 或者将推理框架启动命令写成shell,放到挂载目录,自行调整。

e. 如果网络支持IB/Roce, 也可以增加NCCL环境变量参数,如-e NCCL_IB_HCA=mlx5_0,mlx5_3,mlx5_4,mlx5_7 等,挂载设备如 -v /dev/infiniband:/dev/infiniband

f.10.151.xx.xx为master宿主机IP。

g. 如果要让外网访问,需要映射30000端口。

启动Docker镜像(node 01)

sudo docker run -it -d \

--restart=always \

--gpus all \

--shm-size 32g \

--network host \

--privileged \

--entrypoint /bin/bash \

--env NCCL_SOCKET_IFNAME=eth0 \

--env GLOO_SOCKET_IFNAME=eth0 \

-e NCCL_IB_HCA=mlx5_0,mlx5_3,mlx5_4,mlx5_7 \

-v /mnt/nemo-ds-r1:/root/.cache/huggingface/nemo-deepseek-r1 \

cp-controller-cn-beijing.cr.volces.com/appdeliver-ml/sglang:0.4.2 \

-c "python3 -m sglang.launch_server --model-path /root/.cache/huggingface/nemo-deepseek-r1 --tp 16 --dist-init-addr 10.151.xx.xx:5000 --nnodes 2 --node-rank 1 --trust-remote-code --mem-fraction-static 0.9"

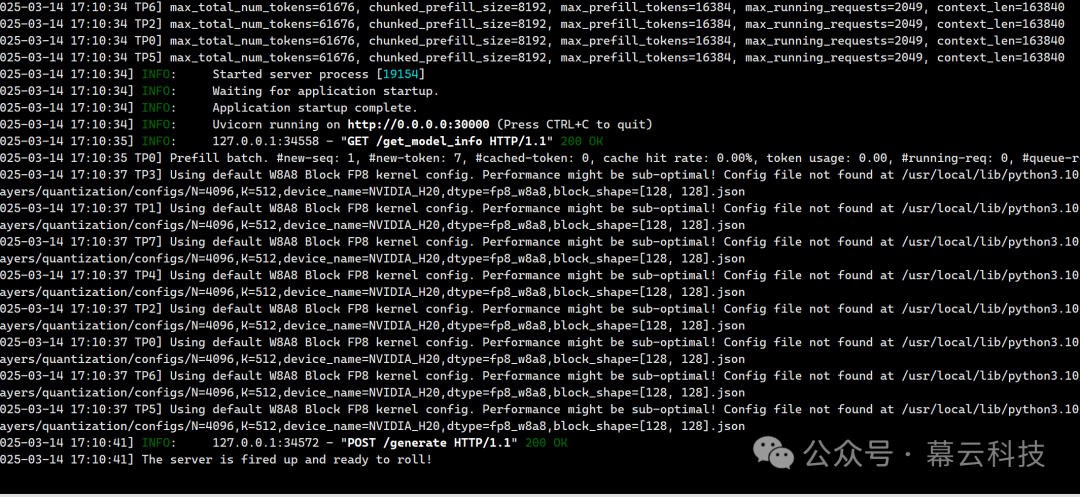

看到如下界面表示你部署成功

部署验证

验证工具

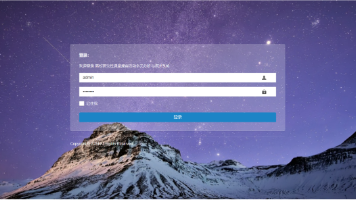

下载chatbox,安装后运行

https://chatboxai.app/zh

配置,只需要填截图所示参数即可,当然API接口没有鉴权,你可以在master 上部署一个nginx,通过nginx进行转发和鉴权

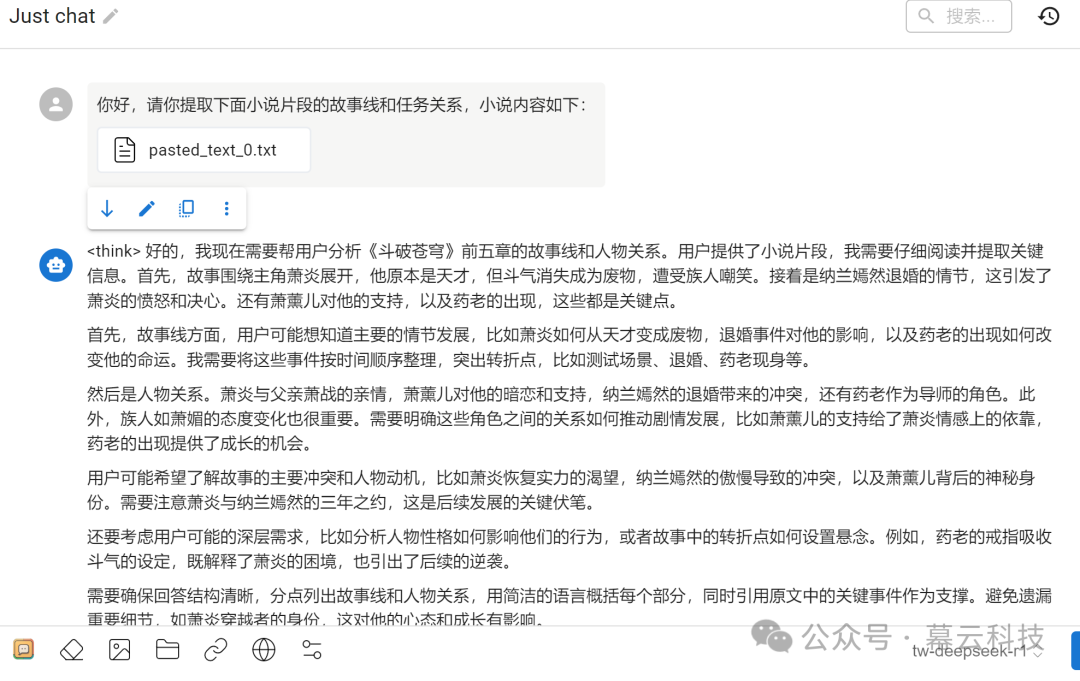

进行长文本测试

我这边是上传一个64k token 的小说,测试长文本输入能力

进行性能测试

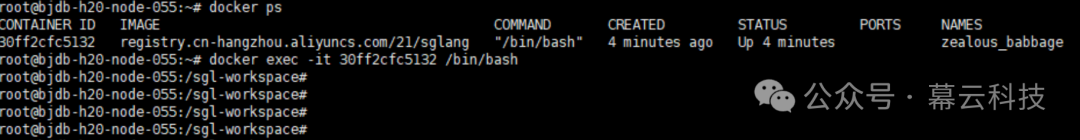

登陆镜像

在主节点( master节点)执行以下命令,查看下在运行的Docker镜像:

docker ps #查看当前运行的镜像

docker exec -it 30ff2cfc5132 /bin/bash #登陆sglang镜像

如下图所示

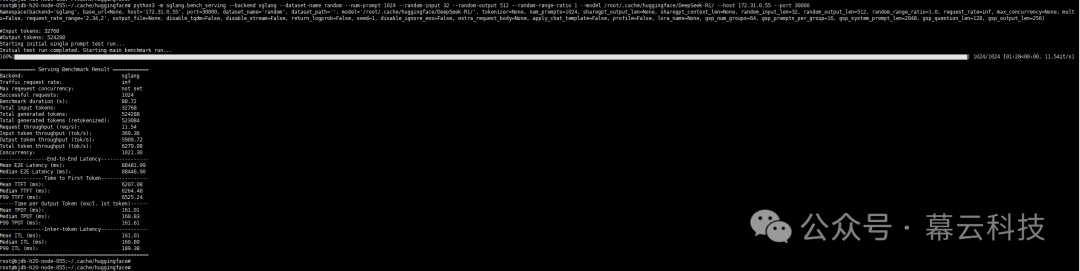

执行侧试脚本

在sglang镜像内执行测试脚本

python3 -m sglang.bench_serving --backend sglang --dataset-name random --num-prompt 1024 --random-input 32 --random-output 512 --random-range-ratio 1 --model /root/.cache/huggingface/nemo-deepseek-r1 --host 10.151.xxx.xxx --port 30000

参数说明,请注意b

a. 阅读使用说明,可以根据用户需求调整以上参数值

b. 执行过程中会下载测试数据集,尽量手动下载上传至Docker挂载目录。

c. 并发性吞吐测试大约在3000~6300token/s(输入+输出)均为正常范围,主要看优化参数及测试参数。

d. 以下为nemo两台H20压测吞吐数据

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

更多推荐

已为社区贡献336条内容

已为社区贡献336条内容

所有评论(0)