20250922_103033_给企业应用注入AI:架构师需关注的3大工程挑战与9种设计模式

企业AI落地架构设计要点 本文系统阐述了企业应用集成AI服务时的关键工程挑战与解决方案,聚焦可靠性、性能和安全三大核心维度。在可靠性方面,提出断路器、重试和降级三种容错模式,确保AI服务故障时的业务连续性;性能优化层面,分析异步处理、缓存复用和对冲请求三种策略,解决AI服务延迟问题;安全防护方面,强调输入输出验证、沙箱隔离和安全代理的必要性。这些微观架构模式共同构成了企业级AI集成的工程保障体系,

收藏必备!企业AI落地指南:确保可靠、高性能、安全的三大工程模式详解

本文探讨企业现有应用集成AI服务时架构师需关注的三大工程问题及应对模式:可用性增强(断路器、重试、降级)、性能优化(异步、缓存、请求对冲)和安全保障(输入输出守卫、沙箱、安全代理)。通过这些模式,企业可确保AI服务引入后的系统可靠性、响应性能和安全性,使AI应用从"能用"走向"好用",成为企业核心能力。

相对于独立的原生AI应用,更多的企业尝试将AI能力引入现有应用(ERP/OA/行业应用),常见的模式是调用API来集成各类AI服务 — 从简单的LLM生成到复杂的RAG管道与Agent服务。

当在现有生产系统中整合AI服务时,考虑到生成式AI的特点(不确定性、响应较慢等),你需要小心确保:不能因为AI的引入而带来潜在的系统风险,如可靠性。

本文介绍在现有应用中集成新的AI服务时,架构师最需要关注的三个工程问题及其常见应对模式。

- 从基础版本开始

- 可用性增强:断路器、重试、降级

- 性能增强:异步、缓存、请求对冲

- 安全增强:输入输出守卫、沙箱、安全代理

01

从基础版本开始

首先来看一个基础的“脆弱”版本的AI服务集成。

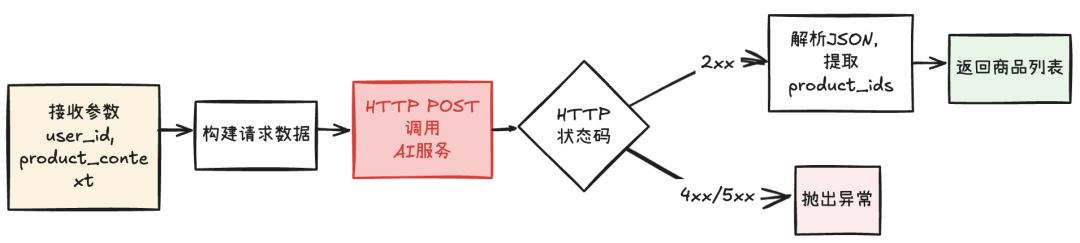

比如需要在客户交互时调用AI服务(API)进行产品推荐,最简单的流程如下:

这是一个模拟实现:

classBasicProductRecommendationService:

这是一个典型的“能用“但不够”健壮“的版本。AI服务可能会因为LLM上下文溢出、配额不足等失败;也可能因为并发导致响应太慢;某些场景你还需要小心AI输出内容是否合规等等。作为架构师与设计师,你需要思考:

如何确保引入AI服务后的业务连续性、响应性能和安全性?

下面我们来介绍常见的一些改进方法与模式。

特别说明:

- 探讨的是程序设计的微观模式;而非“容灾”等宏观架构策略

- 探讨的是集成AI服务的策略;而非如何设计AI服务本身

- 每一个策略都有适应的特定环境;但并非唯一的、必须的模式

02

可用性增强:断路器、重试、降级

【为什么重要】

生产系统要求7x24小时不间断服务,但生成式AI的基础 — LLM的输出具备天然的不确定性,如果你的AI服务高度依赖LLM(比如某个结构化输出),那么就会引入潜在的故障因素:输出超时、格式不遵循指令、配额耗尽、速率限制等。如果没有容错机制,用户将直接感受到故障冲击。可用性设计模式是为了尽量确保:

即使AI部分出错也能确保核心业务不中断。

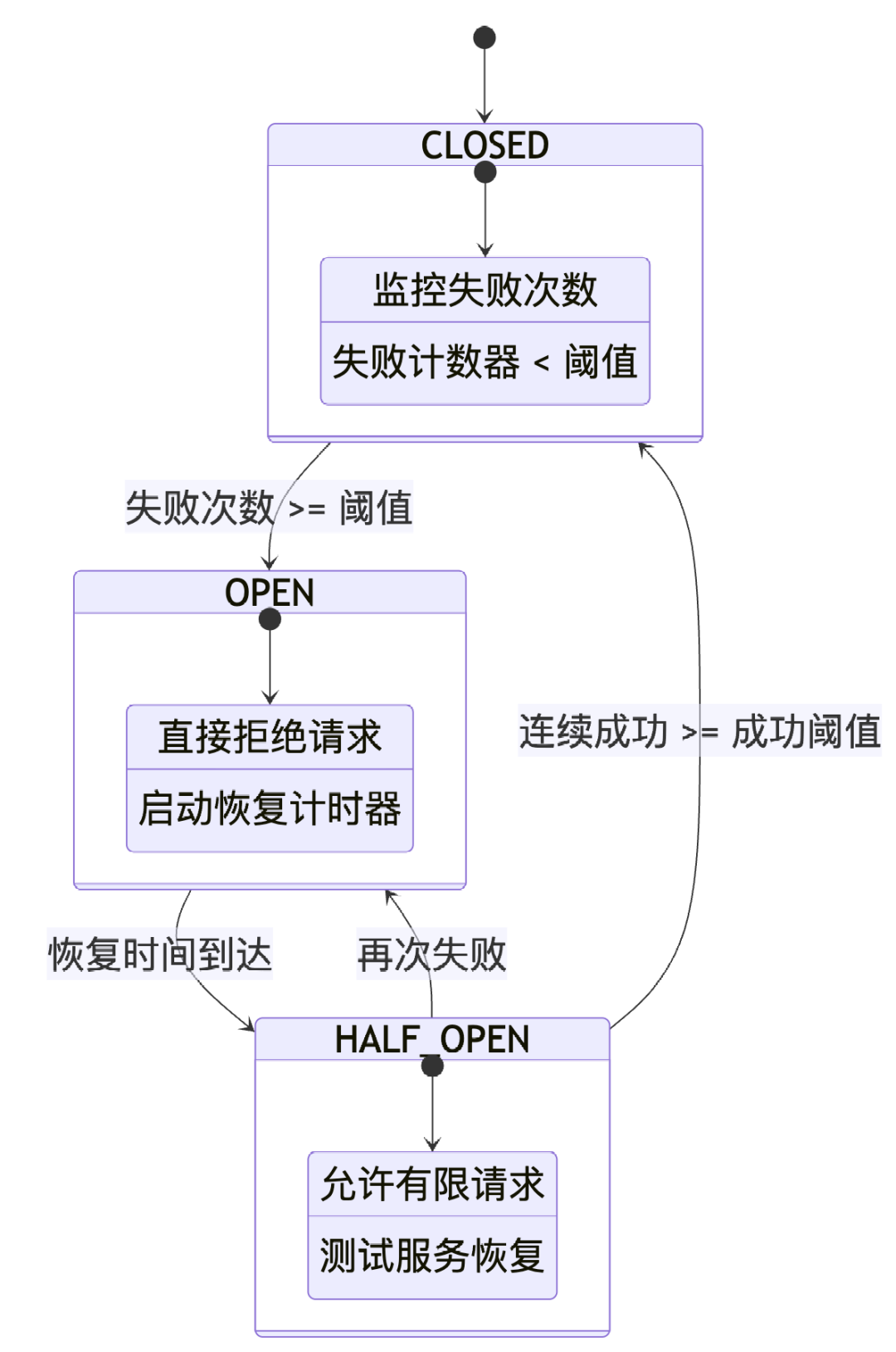

【模式:断路器】

这种模式类似于电路中的“保险丝”。简单说就是:

当AI服务故障时,系统会"跳闸",过段时间再尝试恢复。

由于暂时阻止了对故障服务的调用,可以避免资源浪费和级联故障。优势是快速失败,并可以自动恢复;适合作为第三方API(比如LLM)不稳定时的一种保护机制。

断路器一般设计有三种状态:

- CLOSED状态:正常工作,请求正常传递

- OPEN状态:故障状态,直接拒绝请求,快速失败

- HALF_OPEN状态:探测状态,尝试少量请求检测服务恢复

断路器模式的基本工作流程如下:

- 初始状态为CLOSED,正常转发请求(比如调用AI的API)

- 监控失败次数,达到阈值时转为OPEN状态

- OPEN状态下直接拒绝请求或降级处理,设置恢复超时

- 超时后转为HALF_OPEN,允许少量探测请求

- 探测成功则转回CLOSED,失败则回到OPEN

用下面的状态迁移图来表示这种模式:

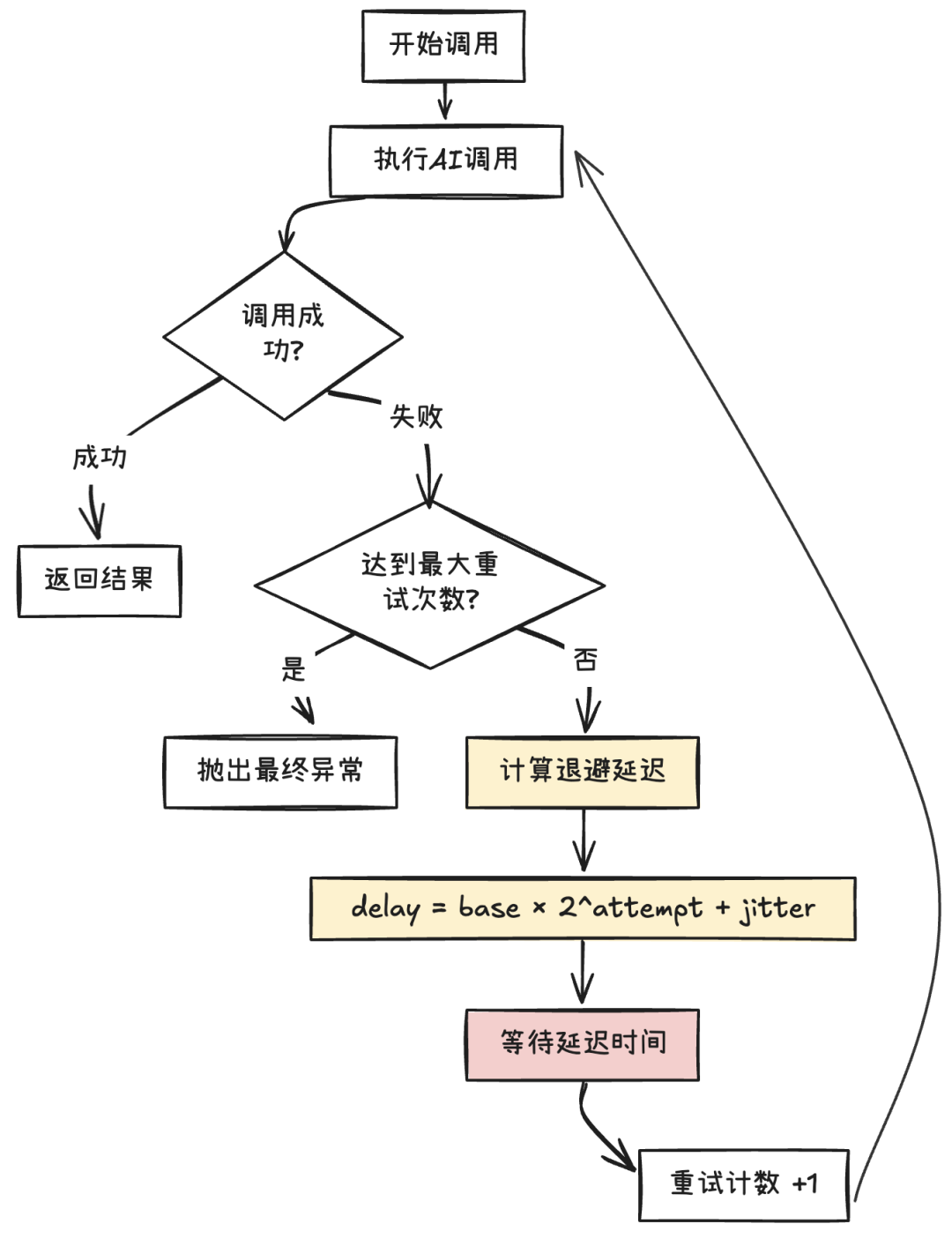

【模式:重试策略】

重试是处理临时性故障的常见策略。简单说就是:

当AI服务故障时,尝试再来几次(等待时间由算法决定)。

这种模式显然很适合一些临时性的负载过大(比如模型限流、消息队列拥挤)、连接中断(比如网络波动、数据库连接断开、临时重启)等场景。

重试策略尽管听上去简单,但实际上需要注意两点:

-

要确保重试的动作是幂等操作

以AI应用的集成场景为例,比如调用某个Tool,或者通过API调用某个Agent,你需要确保多次“重试”不会有额外副作用(还记得MCP协议中的Tool注解字段idempotentHint吗)。所以,一个简单的LLM辅助判断可能是幂等的;但一个操作性的Agent就不能轻易“重试”。

-

要小心重试“风暴”拖垮系统

在大型分布式并发系统中,多个AI服务如果被大量触发重试,可能产生各种级联效应,影响系统稳定性。因此需要小心的设计重试机制,一种常见的方法是“指数退避”,即通过逐渐增加重试间隔,给故障服务留有恢复的时间。相关设计如下:

-

指数退避:让每次重试的间隔做指数翻倍(0.2s -> 0.4s -> 0.8s)

-

随机抖动:在退避时间基础上再增加随机值,避免同时重试

-

设置最大重试次数:避免无限重试

-

设置最大退避时间:避免退避时间过长

重试模式的基本工作流程如下:

- 第一次API调用失败,立即重试

- 第二次失败,等待 base_delay * 2^1 + 随机抖动时间

- 第三次失败,等待 base_delay * 2^2 + 随机抖动时间

- 达到最大重试次数,抛出最后一次异常或者降级处理

这里的base_delay是一个基础等待时间,比如200ms。流程图如下:

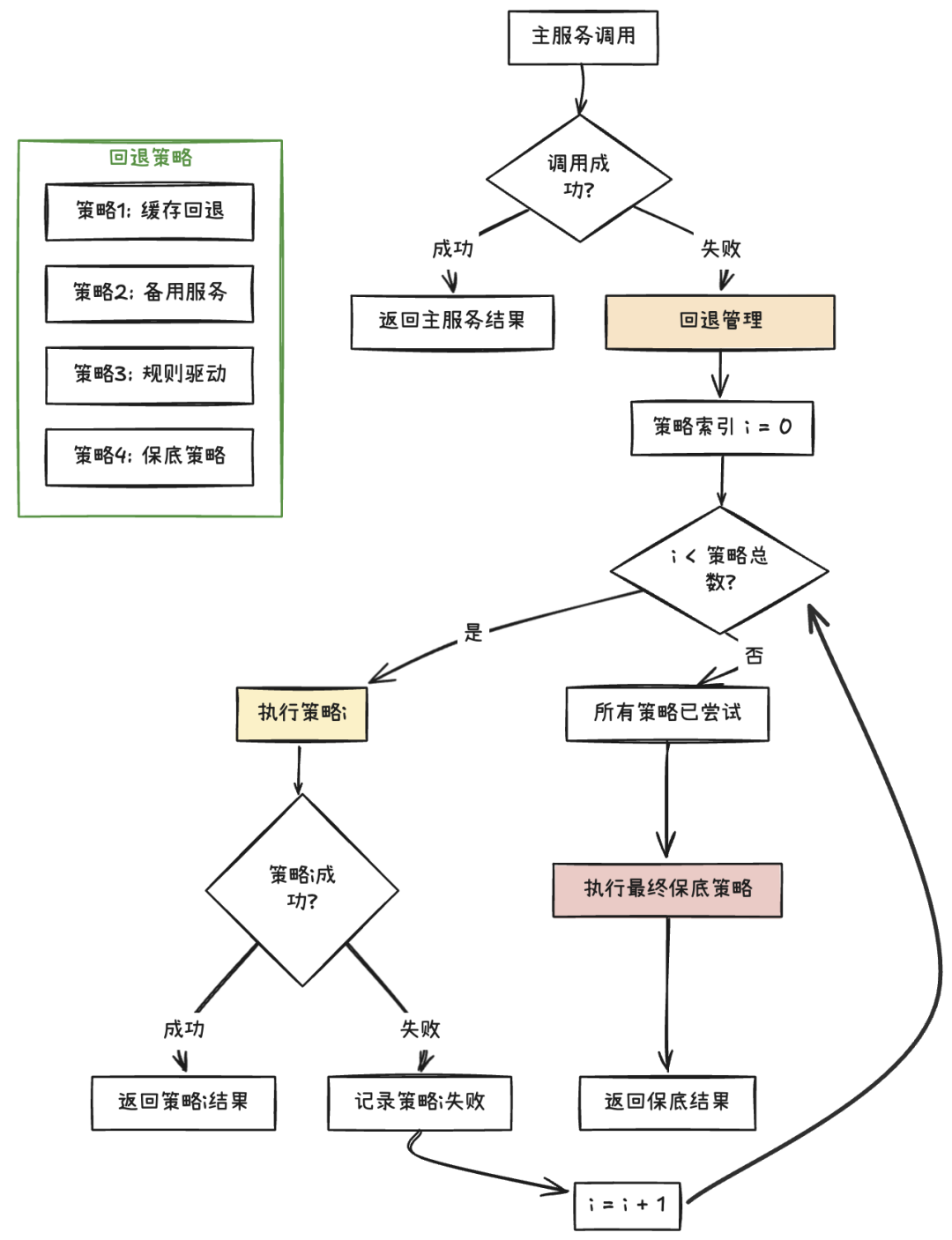

【模式:降级策略】

在某些场景中,当服务发生故障时可以进行“降级”(兜底)处理。简单说就是:

当标准的AI服务不可用时,自动回退到“备胎”方案。

通过这种平滑甚至无体验的切换,最大限度的确保业务连续性。适合能够容忍一定的服务降级,但要求有极高的业务连续性的场景。注意,回退不是失败,而是一种优雅“兜底"的手段。在设计回退方案时,可以按优先级设计多层方案。比如:

- 返回缓存的历史成功结果(如AI上次推荐的产品)

- 切换到备用的依赖服务(如切换不同的LLM)

- 从AI驱动切换到简单的规则驱动模式

其基本的工作流程为:

- 优先调用标准的AI API服务

- 如果失败,则按优先级尝试各级回退方案

- 回退过程中记录回退事件和原因,用于观测监控

- 主服务恢复后会自动切回正常服务

流程示意如下:

03

性能增强:异步、缓存、请求对冲

【为什么重要】

目前依赖于LLM的AI服务(从简单的大模型API到工作流的Agent),往往存在较高的延迟。一次复杂的AI请求可能需要数百毫秒到几秒钟,这对一些实时交互的应用来说是巨大的延迟。另外,AI服务还需要考虑到大模型的调用配额或成本,频繁重复调用既耗时又烧钱。如果不加优化,AI功能可能成为系统性能瓶颈,无法满足企业级的响应时间和吞吐量要求。

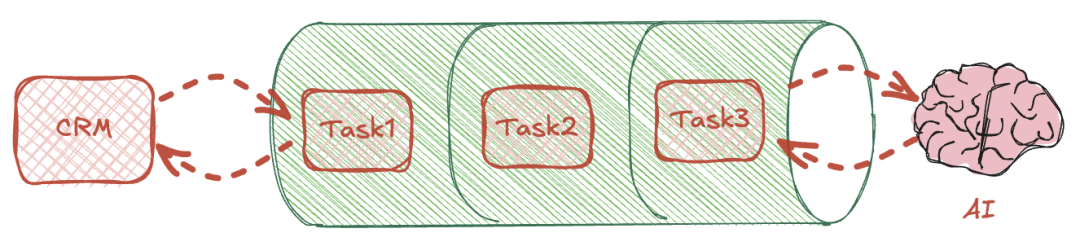

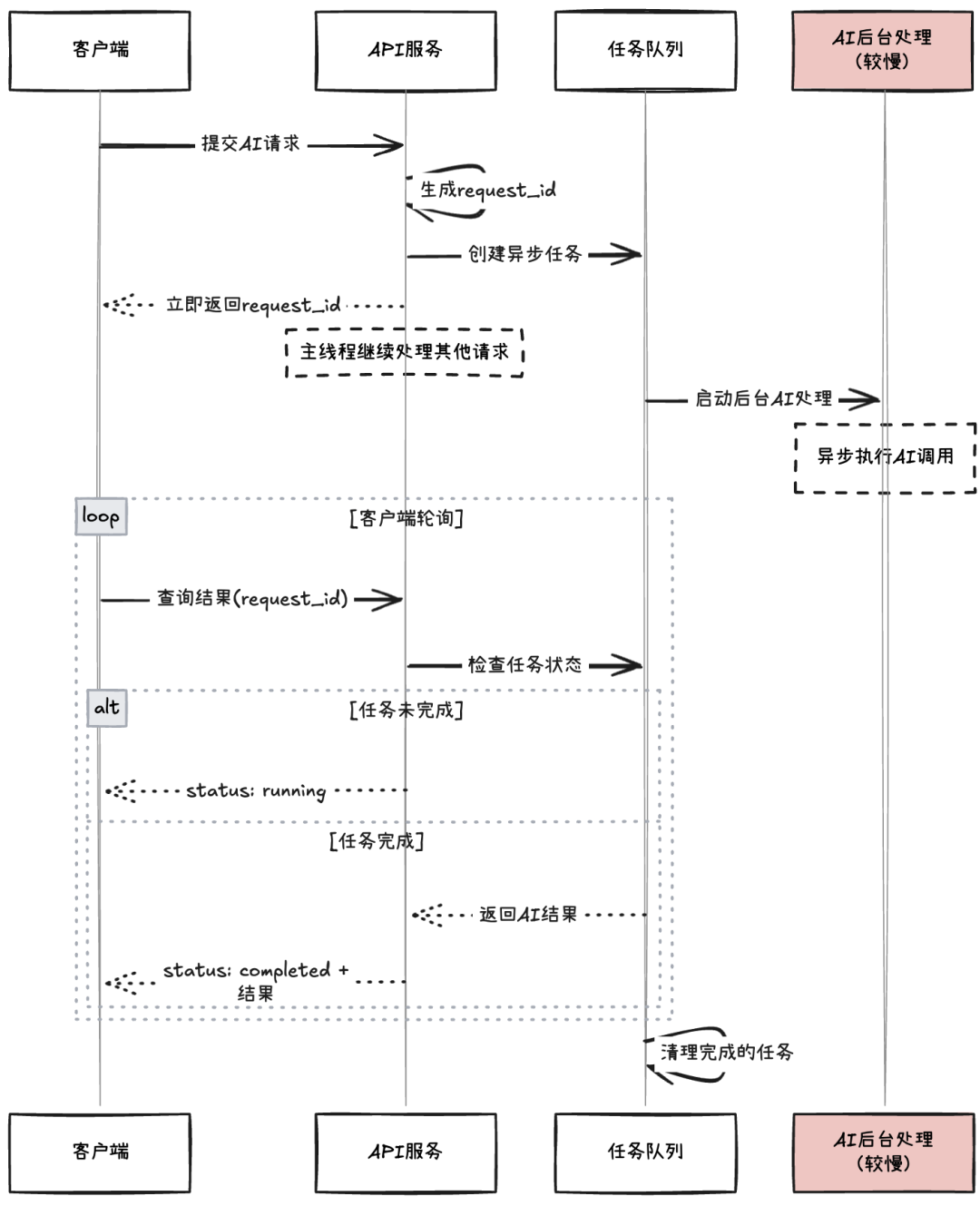

【模式:异步策略】

如果你的企业应用经常需要等待LLM的输出结束、某个Agent的完成、某个MCP工具的调用等(特别是I/O密集型),但都采用同步调用,就会导致响应性能下降,且浪费资源(很多时候在“干等”)。而异步模式就是:

让多个AI任务非阻塞的同时运行,随后再来取任务的结果。

异步模式在设计上通常是借助任务队列和请求ID机制,将耗时的AI调用从主线程中分离,实现非阻塞处理:提交请求后立即获得请求ID,AI处理在后台异步进行,客户端随后可以通过请求ID轮询结果。这种模式避免了长时间等待,同时允许并发处理多个AI请求,显著提升系统吞吐量。

异步模式的常见工作流程为:

- 请求提交:客户端发送AI请求,系统生成唯一请求ID并立即返回

- **任务入队:**创建异步任务(如借助async.create_task),加入请求队列

异步执行:后台协程开始处理AI调用,主线程继续处理其他请求- 状态更新:比如任务状态从PENDING → RUNNING → COMPLETED/FAILED

- 结果轮询:客户端通过请求ID查询任务状态和结果

- 资源清理:完成的任务从队列中移除,定期清理过期结果

用时序图来表示这个流程:

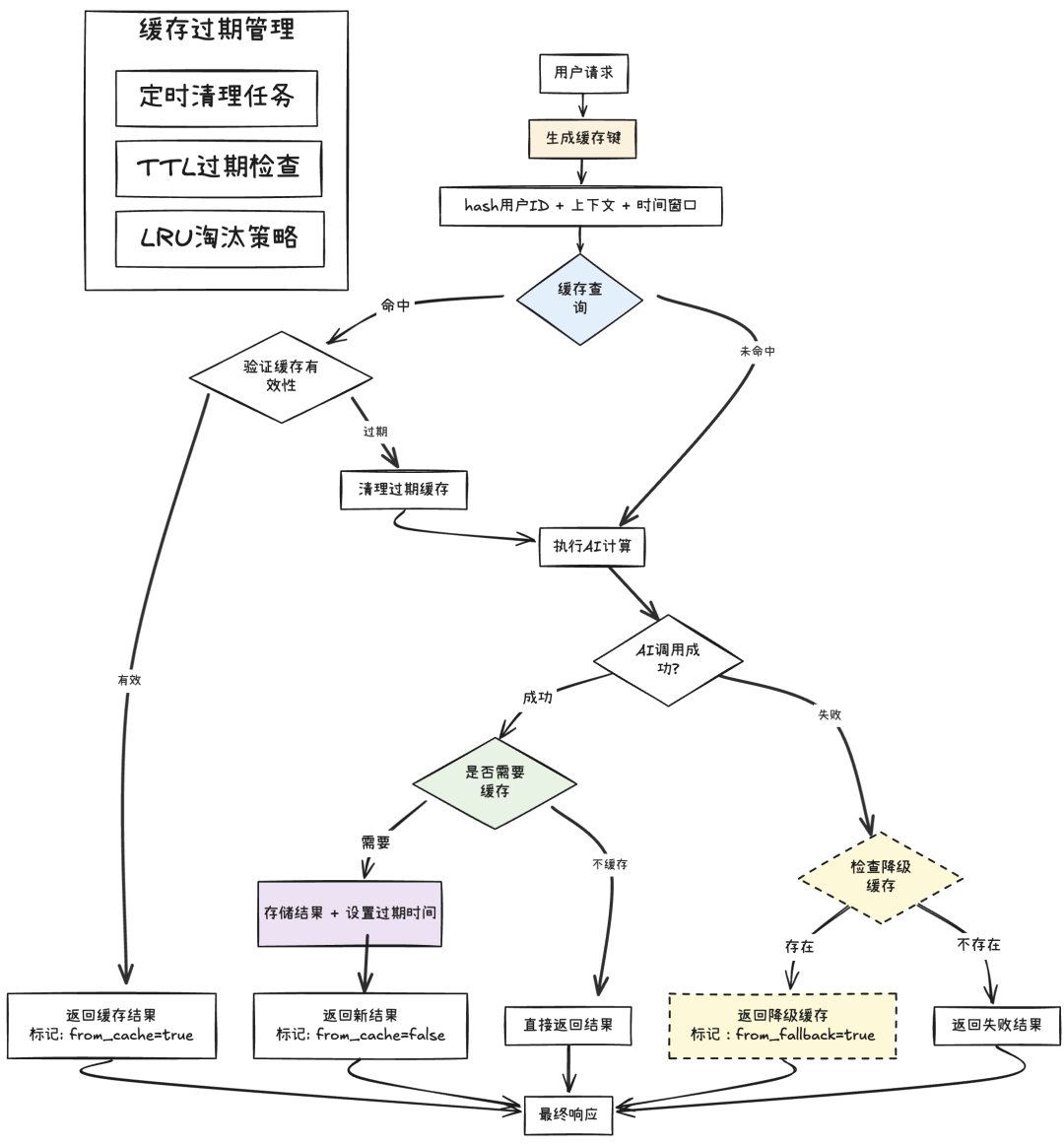

【模式:缓存策略】

缓存是计算机信息处理无处不在的一种策略。具体到AI应用中,缓存可以更具体的体现到LLM输出缓存、Agent结果缓存、工具调用缓存(如MCP调用)等。简单的说,缓存策略就是:

空间换时间,存储已计算或获取过的结果,以便后续快速复用。

通过存储和复用任务结果来避免重复的、昂贵的AI计算,可以显著提升响应速度和系统吞吐量,并降低资源消耗。

尽管缓存对性能的提升显而易见;但在使用时你仍然需要精心考虑和设计,特别是:哪些调用或结果可以缓存,可以缓存多长时间。比如,你可以分成三类:

- 可以长期缓存的调用:相同输入下的结果长期不变(幂等)的调用。比如向AI应用发起的一个知识库提问、AI数据分析等。

- 可以短期缓存的调用:相同输入下的结果短期内可以重用,但长期可能会发生变化,比如一个整理新闻的AI智能体的返回。

- 不适合缓存的调用:相同输入会导致某些状态不断变化,比如一个操作型的智能体;或者结果不适合重用,比如让AI生成创意。

相应的,你需要设计一个缓存“过期”时间和机制来配合这些策略。

一个基本的缓存流程为:

- 请求预处理:对输入请求进行标准化和特征提取,生成缓存键(Key)

- 缓存查询:使用生成的键在多级缓存中查找已有结果

- 缓存命中处理:如果找到有效缓存,验证时效性后直接返回

- 缓存未命中处理:执行实际的AI计算,获取新数据、新结果

- 智能缓存存储:根据结果质量、访问频率等因素决定是否缓存

- 缓存维护:定期清理过期数据,更新热点数据,优化缓存命中率

大致流程示意图如下:

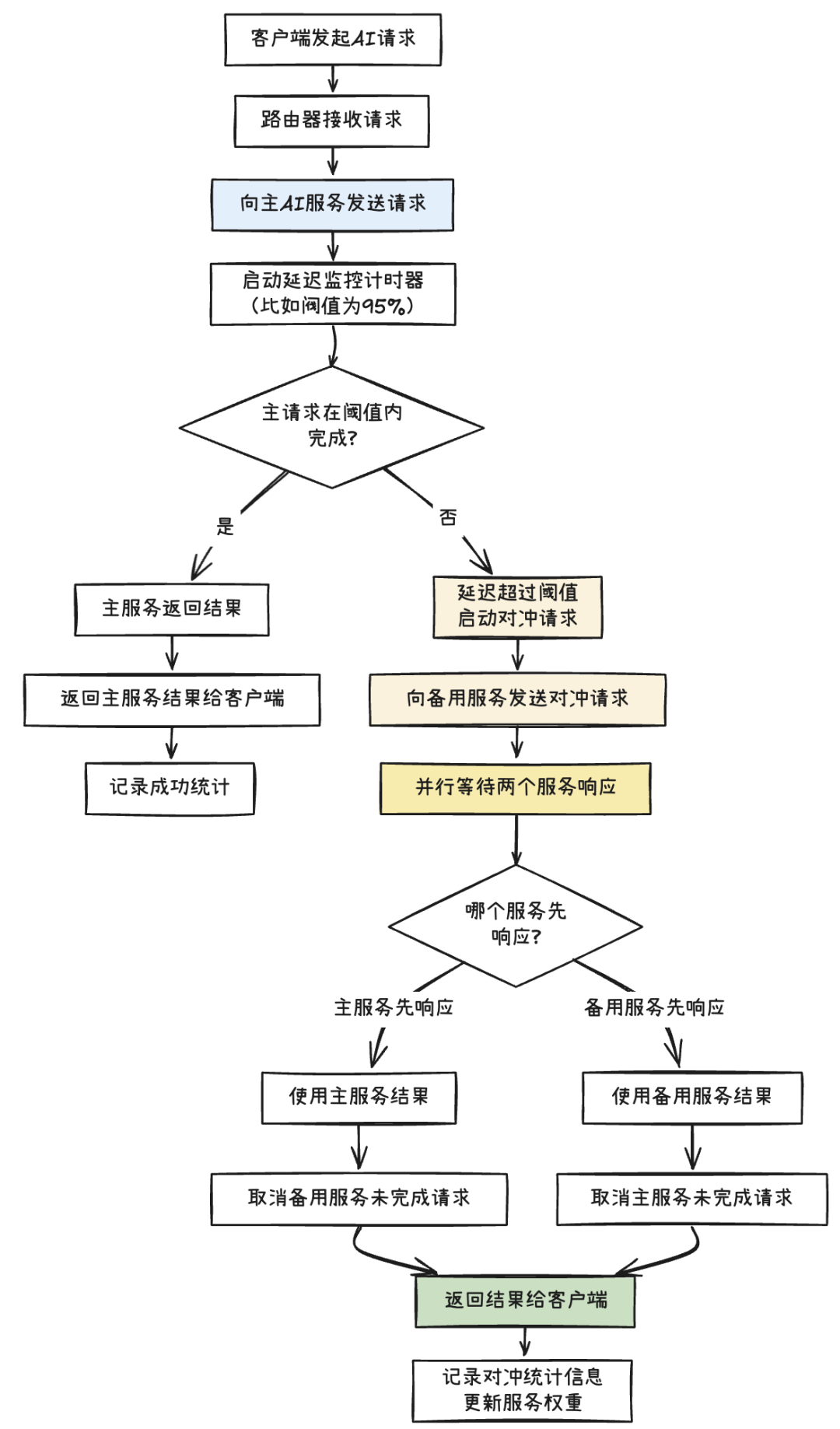

【模式:请求对冲】

这是一种主动的性能优化策略,通过同时向多个服务实例发送相同请求,使用最先返回的有效响应来降低延迟。简单的说就是:

让多个AI服务者“赛跑”,谁先完成就用谁。

该模式特别适用于对延迟敏感的AI服务,可以有效应对个别服务实例的性能抖动。对冲模式需要在性能提升和资源消耗之间找到平衡,通常配合智能触发策略(如延迟阈值触发)来避免不必要的资源浪费。

基本流程如下:

- 主请求发起:向主AI服务发送请求,启动计时器

- 延迟检测:监控主请求的响应时间,判断是否超过预设阈值

- 对冲触发:当延迟超过阈值时,向备用服务发起对冲请求

- 并行竞争:多个请求并行执行,系统等待任一请求的成功响应

- 快速响应选择:一旦收到第一个有效响应,立即返回结果

- 资源清理:取消其他尚未完成的请求,释放网络和计算资源

- 性能统计:记录各服务的响应时间,用于后续的路由优化

大致的流程示意图如下:

04

安全增强:输入输出守卫、沙箱、安全代理

【为什么重要】

在将AI能力引入到企业应用中时,安全性也是决策层最关注的焦点问题之一(特别是某些特殊行业与企业)。企业引入AI能力的安全性体现在诸多方面,诸如:

- 调用第三方服务(如LLM)时的敏感信息泄漏

- 自身暴露的API(如MCP、Agent API等)被越权滥用

- 调用AI生产的内容是否敏感与合规等

除了宏观层面的安全加固(防火墙/等保/各种防攻击等)以及集中的用户认证授权(OAuth)等,这里探讨常见的三种安全策略。

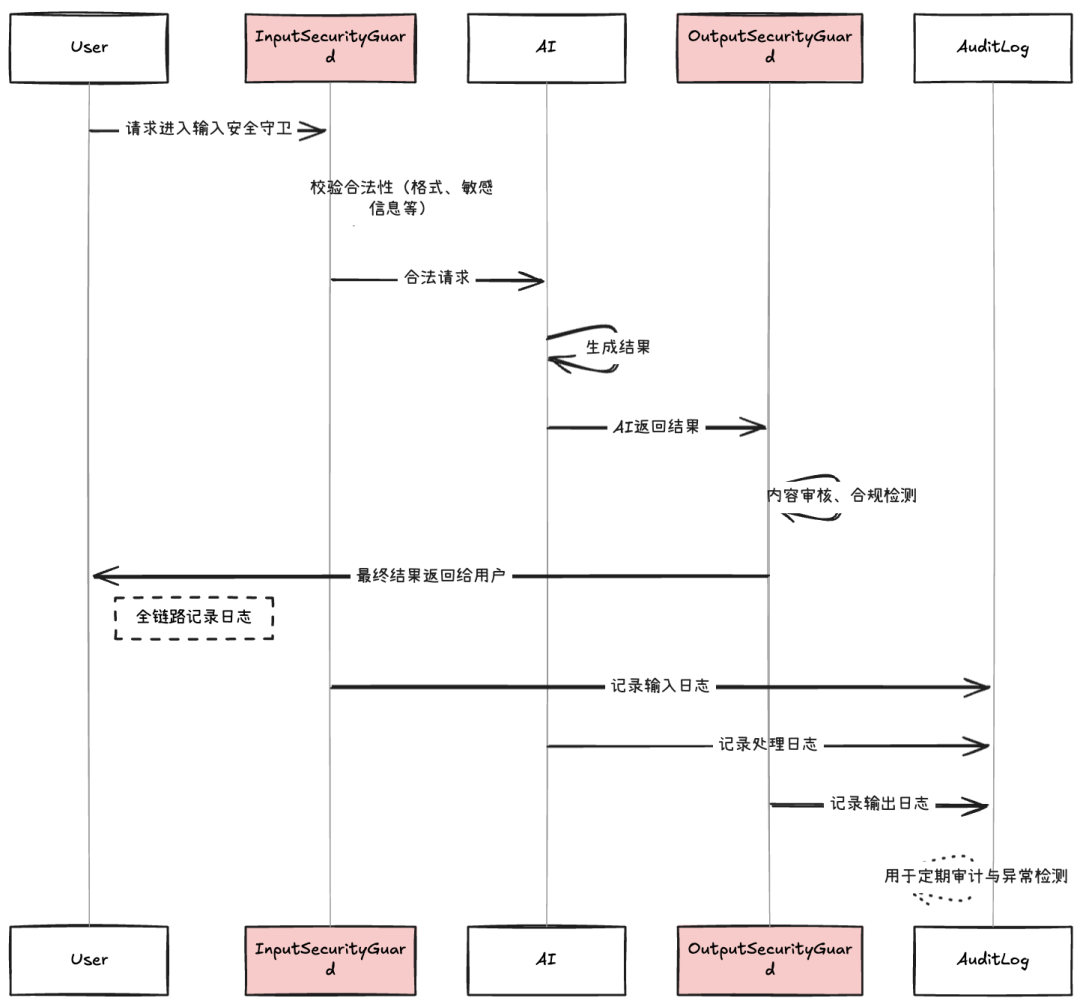

【模式:输入输出守卫】

还记得OpenAI的Agent SDK中的一个独有设计Guardrails(护栏)吗?它是Agent运行的“门卫”,通过验证用户输入输出来保护Agent系统,以避免不必要的风险。输入输出守卫就是一种类似的模式:

对AI的输入和输出进行验证和审计,以确保信息安全。

实际应用中这种模式可以用在调用非信任方LLM/Agent服务时,也可以用来保护企业对外开放的AI服务。

基本的工作原理是:

- AI请求进入输入安全守卫 → 校验合法性(格式、敏感信息等)

- AI返回结果 → 经过输出安全守卫(内容审核、合规检测)

- 最终结果再送往客户端或企业业务系统

- 全链路记录日志 → 用于定期审计与异常检测

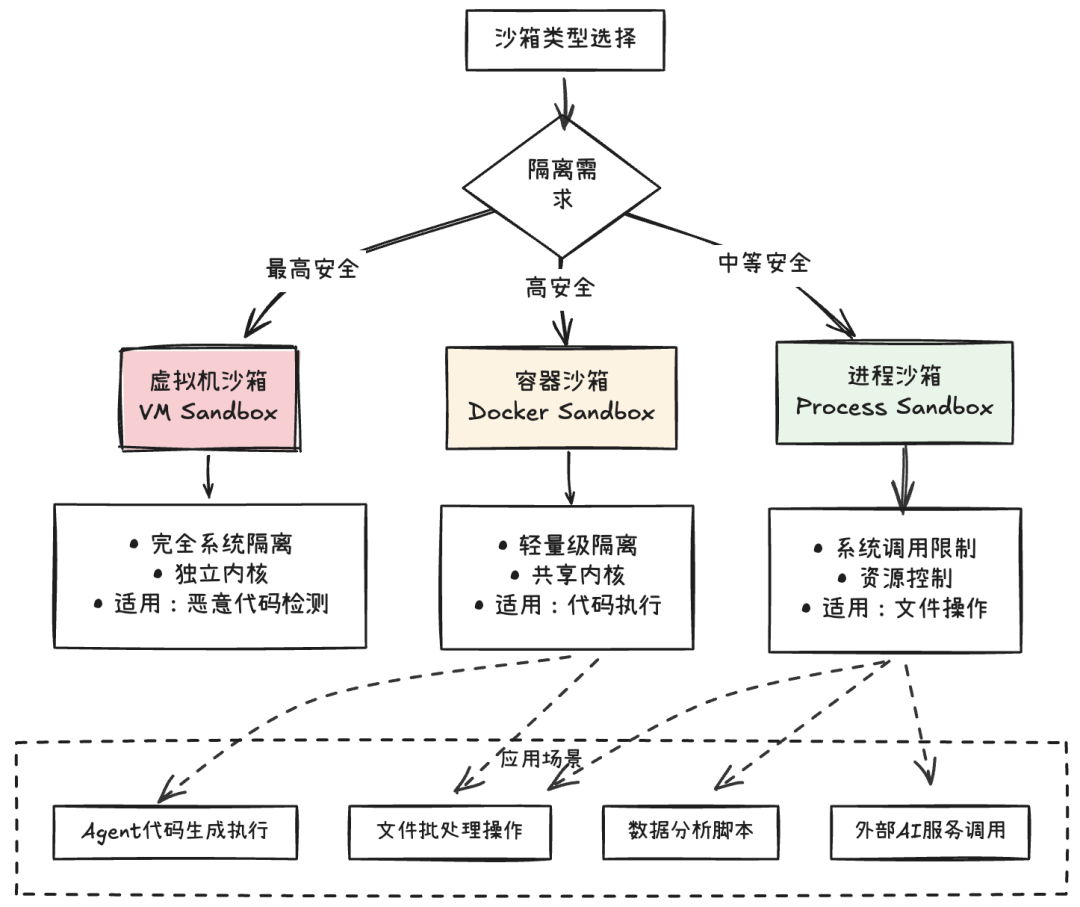

【模式:安全沙箱】

当我们把基于AI的自动化在企业中引入时,一个直观的担忧来自:这些有一定自主能力的AI会不会给环境造成破坏?比如错误的删除了重要文件与数据?沙箱模式通过创建隔离的AI执行环境,确保危险操作不会影响宿主系统。或者简单的说:

把AI服务关在一个安全、隔离的”沙盒“里运行。

在企业AI服务中,主要应用于两个场景:

一是AI在执行代码、文件管理等主动操作时的环境隔离,防止对本地系统造成破坏或多个AI相互影响。比如当你的Agent或者MCP Server通过网络提供共享AI服务时,由于客户端行为的不可预知以及AI的不确定性,用沙箱来隔离风险至关重要

二是将调用外部AI服务时的网络和数据隔离,防止数据泄露和恶意攻击

一些关键的做法包括:

- 根据不同的风险等级采用与创建不同的隔离环境

- 在隔离的环境中运行危险操作,比如执行生成的Python代码

- 监控与限制沙箱的资源使用与行为

- 及时销毁沙箱,防止资源泄漏

比如设计虚拟机、容器(docker)甚至进程几个不同的隔离级别:

当然,这种模式还需要考虑一定的沙箱管理策略来配合。

一个沙箱(容器)的应用例子:

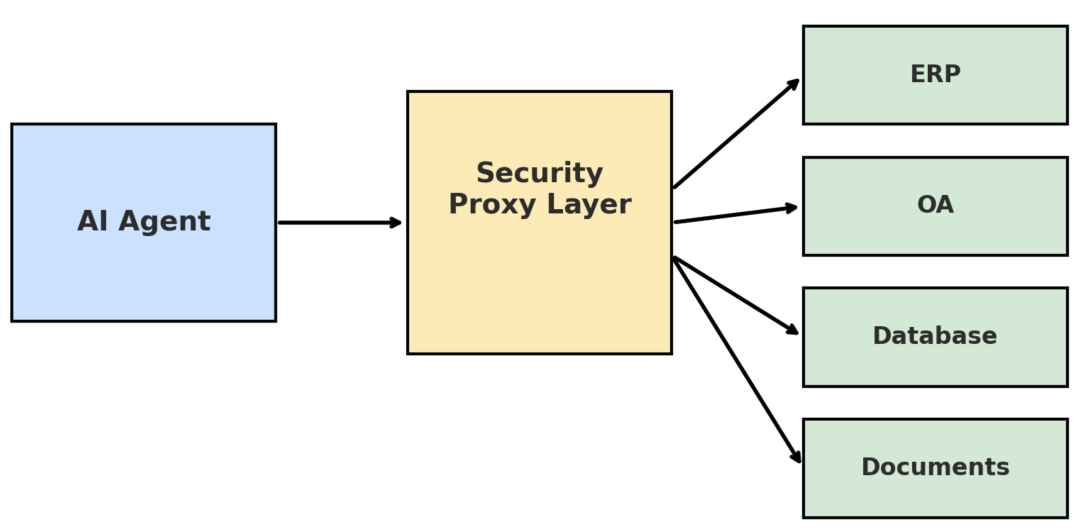

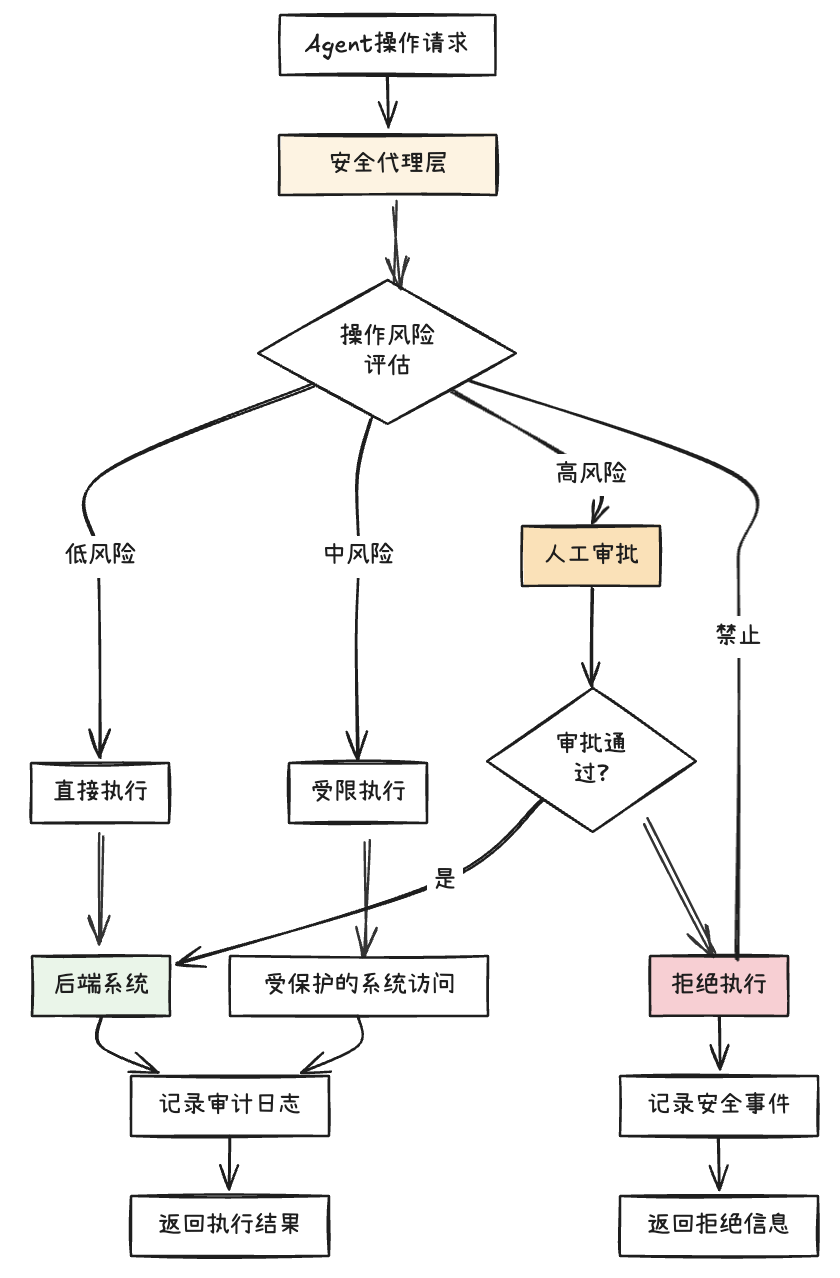

【模式:安全代理】

这种模式是为了保障AI服务调用企业应用、访问企业数据的安全。

这是因为:不是所有的操作都能限制在沙箱内。比如一个借助Tex2SQL的数据库信息查询,除了数据库的权限控制,如何在更细粒度的层面防止风险?

安全代理层模式通过在AI和生产系统之间设置一个”代理层”,对所有的AI操作请求进行策略检查和权限验证,防范AI对关键业务系统的误操作、越权访问、批量破坏等:

给AI的主动行为增加“闸门”,安全的操作才能通过。

这种模式适合AI智能体需要直接访问数据库、业务系统API等关键资源的场景。

典型的工作流程为:

- 操作请求拦截:Agent发起的所有系统操作都被代理层拦截

- 请求解析分析:解析SQL语句、API调用、系统命令的具体内容

- 策略匹配检查:根据预定义的安全策略进行权限和操作合规性检查

- 风险等级评估:评估操作的影响范围和危险程度

- 执行决策:根据策略决定放行、拦截、降级或转人工审批

- 操作审计记录:记录所有操作请求和处理结果用于合规审计

05

结束语

我们对上面的模式做简单总结:

当AI进入企业级场景,真正的考验不仅是LLM或Agent能否更准确的完成任务,更在于如何通过工程化手段构建可靠、可用且安全的高性能服务,而不是带来新的不确定性与风险。高可用性、性能优化与安全性等,都是AI能否在企业真正落地的关键。架构师与开发者唯有把握并灵活运用这些设计模式,才能让AI应用从“能用”走向“好用”,最终成为企业“离不开”的核心能力。

读者福利大放送:如果你对大模型感兴趣,想更加深入的学习大模型**,那么这份精心整理的大模型学习资料,绝对能帮你少走弯路、快速入门**

如果你是零基础小白,别担心——大模型入门真的没那么难,你完全可以学得会!

👉 不用你懂任何算法和数学知识,公式推导、复杂原理这些都不用操心;

👉 也不挑电脑配置,普通家用电脑完全能 hold 住,不用额外花钱升级设备;

👉 更不用你提前学 Python 之类的编程语言,零基础照样能上手。

你要做的特别简单:跟着我的讲解走,照着教程里的步骤一步步操作就行。

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

现在这份资料免费分享给大家,有需要的小伙伴,直接VX扫描下方二维码就能领取啦😝↓↓↓

为什么要学习大模型?

数据显示,2023 年我国大模型相关人才缺口已突破百万,这一数字直接暴露了人才培养体系的严重滞后与供给不足。而随着人工智能技术的飞速迭代,产业对专业人才的需求将呈爆发式增长,据预测,到 2025 年这一缺口将急剧扩大至 400 万!!

大模型学习路线汇总

整体的学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战,跟着学习路线一步步打卡,小白也能轻松学会!

大模型实战项目&配套源码

光学理论可不够,这套学习资料还包含了丰富的实战案例,让你在实战中检验成果巩固所学知识

大模型学习必看书籍PDF

我精选了一系列大模型技术的书籍和学习文档(电子版),它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。

大模型超全面试题汇总

在面试过程中可能遇到的问题,我都给大家汇总好了,能让你们在面试中游刃有余

这些资料真的有用吗?

这份资料由我和鲁为民博士(北京清华大学学士和美国加州理工学院博士)共同整理,现任上海殷泊信息科技CEO,其创立的MoPaaS云平台获Forrester全球’强劲表现者’认证,服务航天科工、国家电网等1000+企业,以第一作者在IEEE Transactions发表论文50+篇,获NASA JPL火星探测系统强化学习专利等35项中美专利。本套AI大模型课程由清华大学-加州理工双料博士、吴文俊人工智能奖得主鲁为民教授领衔研发。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的技术人员,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

👉获取方式:

😝有需要的小伙伴,可以保存图片到VX扫描下方二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最适合零基础的!!

更多推荐

已为社区贡献182条内容

已为社区贡献182条内容

所有评论(0)