AI能否实现“多时间尺度的整合”来增强学习效果?

摘要:人工智能学习效能的提升依赖于多时间尺度记忆的整合。当前研究通过结合短期记忆(快速适应)与长期记忆(知识保存),采用层次递归网络、快速权重、记忆增强网络等技术,显著提升了模型的灵活学习能力。近期进展包括快速权重的复兴、时间感知注意力以及多尺度时间序列与大语言模型的融合。然而,仍面临计算成本、记忆冲突等挑战,未来需在硬件优化、元学习调度等方面寻求突破,以实现更高效、稳定的AI学习系统。

根据图灵和冯・诺依曼观点,智能的基础是学习,是理解网络中的连接速度,而理解是前提,之后才能进行转化。那神经网络(深度学习)技术发展到今天,有没有更好的学习技术帮助AI提升学习效果呢?

在当前的人工智能研究中,将不同时间尺度进行整合已经被视为提升短期记忆容量、实现灵活学习的核心方向。下面从概念、主要技术路线、已有成果以及面临的挑战四个层面进行梳理,并给出近期的学术与业界参考。

1. 为什么需要多时间尺度的记忆?

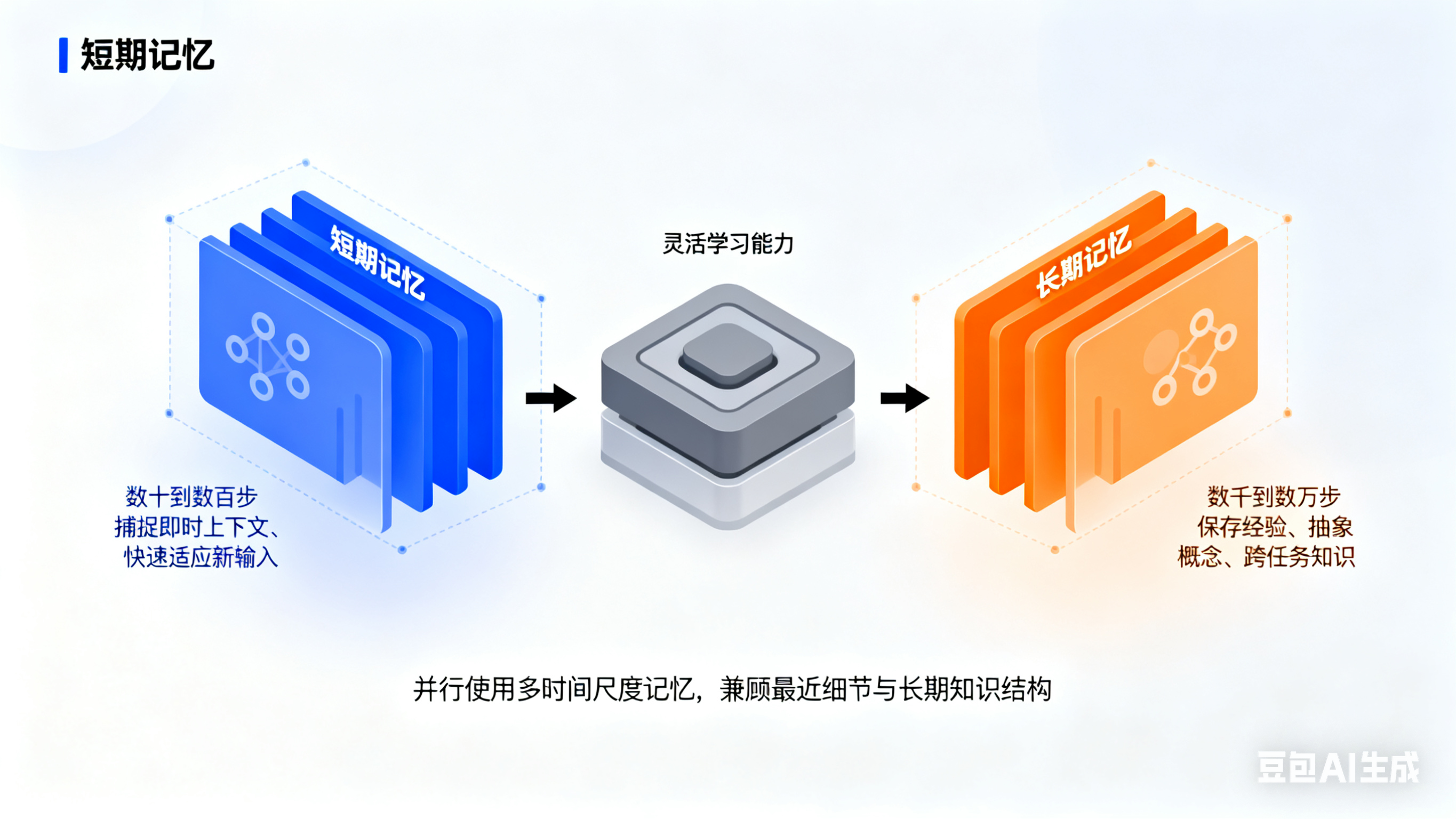

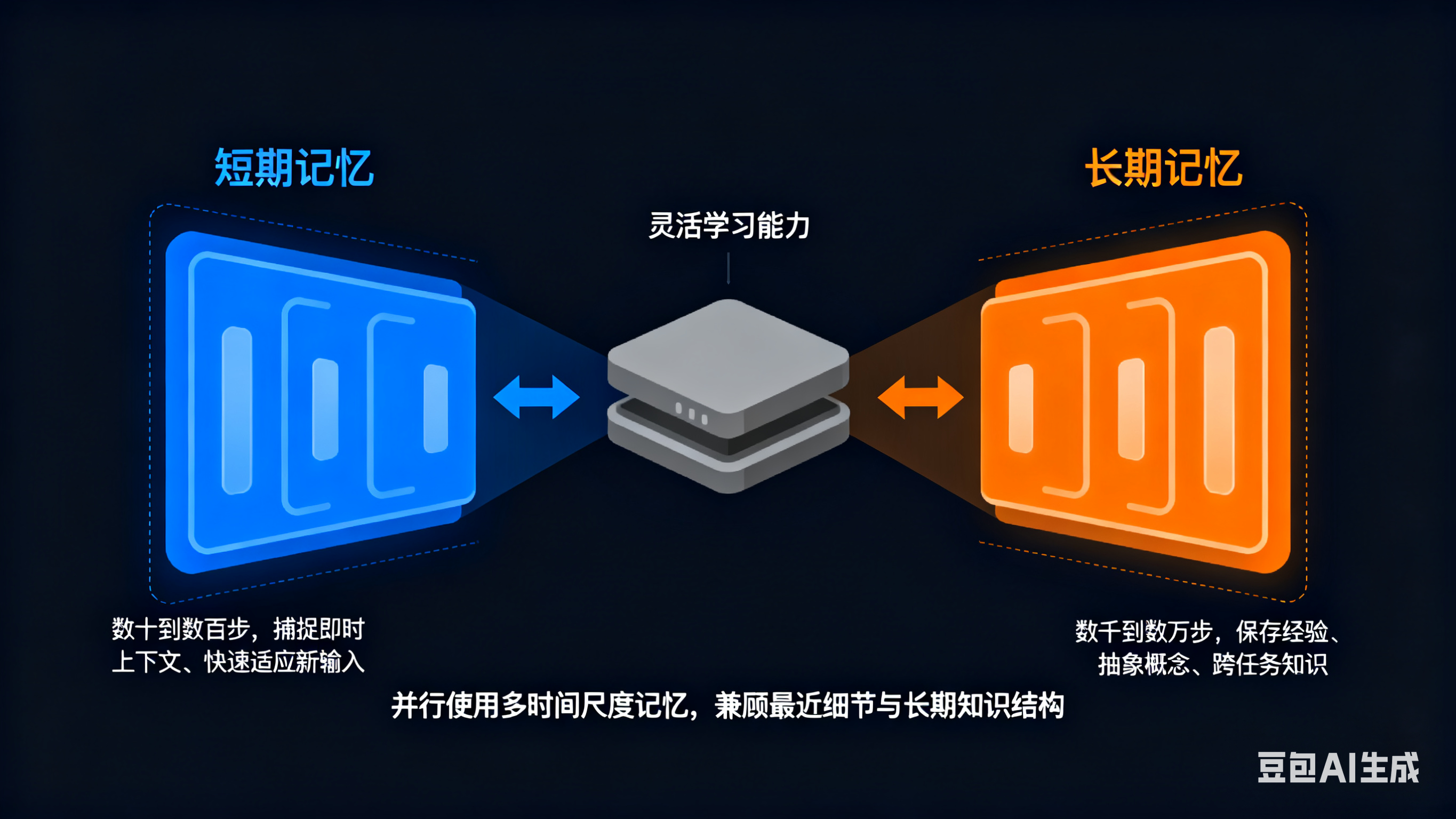

短期记忆(数十到数百步)能够捕捉即时上下文、快速适应新输入;长期记忆(数千到数万步)负责保存经验、抽象概念以及跨任务的知识。

仅靠单一的、缓慢更新的参数权重,模型在面对快速变化的情境时往往表现不佳;而只依赖短期记忆则缺乏跨会话的持续性。

将二者或更多时间尺度并行使用,有概率能可让系统在“记住最近的细节”的同时,“保持长期的知识结构”,从而实现类似人类的灵活学习能力。

2. 主要技术路线

|

方法 |

时间尺度层次 |

关键机制 |

代表性工作 |

|

层次递归网络 / 多尺度 RNN |

低层(毫秒秒)→高层(分钟小时) |

通过金字塔式隐藏状态传递,实现不同时间窗口的特征聚合 |

早期的层次 LSTM、Clock work RNN 等 |

|

快速权重(Fast Weights) |

快速变化的权重(短期)+ 常规权重(长期) |

权重在一次前向传播后即时更新并在若干步后衰减,提供高容量短期记忆 |

Hinton 等提出的快速权重概念,近期在多模态记忆系统中被复现 |

|

记忆增强网络(Memory augmented NN) |

外部记忆库(可持久)+ 内部状态(短期) |

通过可读写的键值表或向量数据库实现跨步检索 |

Neural Turing Machine、Differentiable Neural Computer |

|

Transformer+Temporal Bias |

通过时间编码或时间感知注意力实现多尺度 |

在自注意力中加入时间窗口、时间图或时间感知注意力,使模型能够区分近期与远期信息 |

Xiao 等的时间感知注意力模型 |

|

混合记忆(Hybrid Memory) |

参数化记忆 + 非参数化记忆 + 场景记忆 |

将模型内部权重、外部向量库、情景日志三者组合,动态调度资源 |

机器之心报道的混合记忆系统 |

|

LLM Mixer 等多尺度时间序列模型 |

短期波动 + 长期趋势 |

将时间序列分解为多尺度子序列,再通过大语言模型进行统一预测 |

LLM Mixer 论文展示了在金融、气象等任务上的优势 |

3. 学术界最新研究进展

(1)快速权重的再度兴起

2025 年《AI for the Open‑World: the Learning Principles》详细描述了“快速权重”在随机重叠的短期/长期记忆中的实现方式,证明了在不同时间窗口上进行并行学习可以显著提升模型的适应性。

2025年全球人工智能大会上,姚期智、辛顿等在《当AI更强大,我们该如何理解它》中提出了在神经网络中引入三种时间尺度(慢权重、快权重、快速衰减权重),并解释硬件限制是目前尚未广泛采用的主要原因。

(2)时间感知注意力与图结构

2025 年的综述《Rethinking Memory in AI》指出,最新的记忆检索已经从静态相似度转向时间上下文图和时间感知注意力,能够在长对话或跨任务场景中保持时间连贯性。

(3)多尺度时间序列与 LLM 融合

《LLM‑Mixer: 融合多尺度时间序列分解与预训练模型》展示了将多尺度时间序列分解与大语言模型结合的方案,在捕捉短期波动的同时保留长期趋势,验证了多时间尺度对预测精度的提升。

(4)混合记忆系统的工程实现

机器之心的技术报道《那天,AI大模型想起了,被‘失忆’所束缚的枷锁》介绍了实际产品中采用的混合记忆架构:参数化记忆负责核心能力,外部记忆记录用户交互,情景记忆捕捉特定事件,实现了“短期+长期+情景”三层次的协同。

4. 关键挑战与未来方向

|

挑战 |

说明 |

潜在解决思路 |

|

计算与存储成本 |

快速权重或外部记忆的读写会显著增加显存/带宽需求。 |

采用稀疏化、低秩近似或专用硬件(如神经形态芯片) |

|

记忆冲突与遗忘 |

多尺度记忆之间可能出现信息竞争,导致重要信息被覆盖。 |

引入元学习的记忆调度策略,或使用注意力门控动态决定写入对象 |

|

跨模态一致性 |

当记忆涉及文本、图像、音频等多模态时,需要统一时间标记。 |

构建统一的时间戳嵌入并在多模态融合层统一对齐 |

|

可解释性 |

多层记忆结构使得模型决策路径难以追踪。 |

通过可视化时间图、记忆检索日志等手段提供解释框架 |

|

训练稳定性 |

快速权重的梯度传播容易出现爆炸/消失。 |

使用梯度裁剪、正则化以及层归一化等技术 |

5. 小结

多时间尺度的整合已经从理论概念转向可落地的技术实现,涵盖快速权重、外部记忆、时间感知注意力等多种手段。因此,AI 完全可以通过不同时间尺度的整合来实现更强的短期记忆与灵活学习。近期的学术与业界工作表明,这种整合能够显著提升短期记忆容量、跨会话连贯性以及对新任务的快速适应。

目前阶段,仍需在计算效率、记忆冲突管理、跨模态统一等方面进行深入研究,未来可能通过专用硬件、元学习调度以及更精细的时间编码来进一步突破。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)