为企业系统无缝集成AI检测能力:陌讯AIGC检测系统API接口调用全指南

摘要:随着AIGC内容泛滥,陌讯科技提供99.9%准确率的检测方案,帮助企业防范学术不端、虚假营销等风险。本文详细介绍了集成流程:1)选择云端版或企业版;2)获取API访问凭证;3)通过RESTful API进行认证和调用;4)提供Python实战示例。文章还分享了性能优化、结果处理等最佳实践,并解答了常见问题。通过集成该API,企业可高效构建内容真实性防火墙。

在AIGC内容泛滥的今天,如何确保内容的真实性与原创性?陌讯科技以其99.9%的准确率,为企业提供了坚实的解决方案。本文将手把手带你完成集成之旅。

引言:为什么企业需要集成AIGC检测能力?

随着ChatGPT、文心一言等大型语言模型的爆炸式发展,AI生成内容(AIGC)已渗透到企业运营的方方面面。它带来了效率的极致提升,同时也伴随着巨大的风险:学术不端、虚假营销、抄袭侵权、数据污染、金融欺诈... 对于企业而言,在享受AIGC红利的同时,构建一道内容真实性的“防火墙”已不再是可选项,而是必选项。

陌讯AIGC检测系统,凭借其深耕中文场景、超高准确率、企业级性能和安全隐私保护,成为众多企业的首选。本文将作为一份详细的开发指南,深入探讨如何将陌讯AIGC检测的强大能力,通过其提供的RESTful API无缝集成到您已有的企业系统中。

一、集成前准备:了解核心架构与准入流程

在开始编写第一行代码之前,我们需要做好以下准备:

1.1 选择适合的版本

陌讯提供了多种部署方案,其API集成方式主要对应以下两个版本:

-

云端版(SaaS):通过调用陌讯提供的公有云API端点进行检测。优势是开箱即用、无需维护、按需付费,非常适合中小型企业或快速验证场景。

-

企业版(本地私有化部署):将整套系统部署在您公司内部的服务器或私有云上。优势是数据完全隔离、网络延迟极低、可进行深度定制,适合对数据安全要求极高的大型机构、金融机构或政府单位。

您的选择将决定后续调用的API基地址(Base URL)和授权方式。

1.2 获取API访问凭证

-

申请账号与API Key:

-

访问陌讯科技官方网站,注册企业账号。

-

进入管理后台,通常会在“API管理”或“开发者中心”模块中,申请生成一组唯一的API Key和Secret。这组凭证是您调用API的钥匙。

-

-

阅读官方文档:

-

务必仔细阅读陌讯提供的官方API文档,这是最权威的参考。本文基于通用RESTful原则和常见设计模式撰写,但具体细节(如字段名、错误码)请以官方文档为准。

-

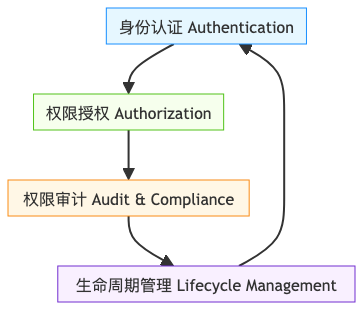

1.3 理解技术架构

陌讯API通常基于高性能的FastAPI框架构建,采用无状态(Stateless)的RESTful设计,这意味着每次请求都必须携带认证信息,服务端不记录会话状态。这保证了系统的高并发能力和水平扩展性。

二、API接口详解:从认证到调用

2.1 认证方式(Authentication)

为确保安全,所有API请求都必须通过认证。陌讯API最常用的认证方式是 Bearer Token(JWT) 或通过API Key签名。

示例:在请求头中携带API Key

POST /v1/detect HTTP/1.1

Host: api.moxunaigc.com

Content-Type: application/json

X-API-Key: your_api_key_here # 通常也可能是 Authorization: Bearer <token>注意:your_api_key_here需要替换为您在管理后台获取的真实API Key。

2.2 核心检测接口(/v1/detect)

这是最核心的文本检测接口,用于提交文本并返回检测结果。

请求(Request)

-

HTTP Method:

POST -

URL:

https://api.moxunaigc.com/v1/detect(云端版) 或https://your-private-deployment.com/v1/detect(私有化版) -

Headers:

-

Content-Type: application/json -

X-API-Key: <your_api_key>

-

-

Body (JSON):

{

"text": "需要检测的文本内容,长度建议不超过2000汉字,以确保最佳性能和准确率。虽然API支持最多512个token(约380个汉字),但超长文本可能会被截断处理。",

"model": "standard", // 可选参数,指定使用的模型版本,如"standard"(标准)或"enhanced"(增强)

"task_id": "your_unique_task_id_123456" // 可选参数,用于幂等性控制,防止重复请求

}响应(Response)

-

HTTP Status:

200 OK(成功) -

Body (JSON):

{

"code": 0,

"msg": "success",

"data": {

"is_ai_generated": true,

"probability": 0.9987,

"confidence": 0.99,

"model": "standard",

"version": "1.2.0"

},

"task_id": "your_unique_task_id_123456"

}-

code: 业务状态码(0表示成功,非0表示各种错误,需查阅文档) -

msg: 对状态码的详细描述 -

data: 核心检测结果-

is_ai_generated: 布尔值,true表示AI生成,false表示人类创作。 -

probability: 概率值(0-1之间),表示文本被判定为AI生成的可信度。 -

confidence: 模型此次判断的置信水平。

-

-

task_id: 回显请求时传入的task_id

错误处理(Error Handling)

调用API时必须做好异常处理。常见的错误码如下:

|

HTTP状态码 |

业务码(可能) |

含义 |

处理建议 |

|---|---|---|---|

|

401 |

1001 |

API Key无效或过期 |

检查API Key是否正确,是否在管理后台被禁用 |

|

400 |

1002 |

请求参数错误(如text为空) |

检查请求体JSON格式和字段 |

|

413 |

1003 |

请求文本过长 |

拆分文本或截断至规定长度 |

|

429 |

1004 |

请求频率超限(Rate Limit) |

降低调用频率,或联系陌讯提升QPS配额 |

|

500 |

2001 |

服务器内部错误 |

记录错误信息并重试,或联系陌讯技术支持 |

三、实战集成示例(Python)

以下是一个使用Python语言集成陌讯AIGC检测API的完整示例,包含了错误处理和重试机制。

import requests

import json

from typing import Dict, Any

class MoxunAIGCDetector:

def __init__(self, api_key: str, base_url: str = "https://api.moxunaigc.com"):

self.api_key = api_key

self.base_url = base_url

self.detect_endpoint = f"{base_url}/v1/detect"

# 配置请求会话,设置超时时间和重试策略(可选)

self.session = requests.Session()

self.session.headers.update({

"Content-Type": "application/json",

"X-API-Key": self.api_key

})

def detect_text(self, text: str, model: str = "standard") -> Dict[str, Any]:

"""

发送文本到陌讯AIGC检测API并返回结果

Args:

text (str): 待检测的文本

model (str): 模型版本,默认为'standard'

Returns:

Dict[str, Any]: API返回的JSON数据解析后的字典

"""

# 1. 构造请求负载

payload = {

"text": text,

"model": model,

# "task_id": generate_unique_id() # 可选:生成一个唯一ID用于幂等性

}

try:

# 2. 发送POST请求

response = self.session.post(

self.detect_endpoint,

data=json.dumps(payload),

timeout=10 # 设置超时时间(秒)

)

# 3. 检查HTTP状态码

response.raise_for_status() # 如果状态码不是200,将抛出HTTPError异常

# 4. 解析JSON响应

result = response.json()

# 5. 检查业务状态码(假设0为成功)

if result.get('code') != 0:

raise Exception(f"API Business Error: {result.get('msg')} (Code: {result.get('code')})")

return result

except requests.exceptions.RequestException as e:

# 处理网络请求异常(如连接错误、超时)

print(f"Network request failed: {e}")

# 这里可以添加重试逻辑(例如,使用tenacity库)

raise

except json.JSONDecodeError as e:

# 处理JSON解析异常

print(f"Failed to parse JSON response: {e}")

raise

# 使用示例

if __name__ == "__main__":

# 初始化检测器,替换为您自己的API Key

detector = MoxunAIGCDetector(api_key="YOUR_MOXUN_API_KEY_HERE")

sample_text = "近年来,人工智能技术取得了突飞猛进的发展,特别是在自然语言处理领域..."

try:

result = detector.detect_text(sample_text)

detection_data = result['data']

if detection_data['is_ai_generated']:

print(f"⚠️ 该文本很可能由AI生成(概率:{detection_data['probability']:.2%})")

else:

print(f"✅ 该文本很可能为人类创作(AI生成概率:{detection_data['probability']:.2%})")

except Exception as e:

print(f"检测失败: {e}")四、最佳实践与高级技巧

-

性能优化:

-

批量处理:如果需要检测大量文本,查询官方是否提供批量检测接口(如

/v1/batch-detect),这比循环调用单条接口效率高得多。 -

异步调用:在Web应用中,使用异步非阻塞的方式(如Python的

async/await,Java的CompletableFuture)调用API,避免阻塞主线程,提升系统吞吐量。 -

连接池化:使用类似上述示例中的

requests.Session或相应语言的HTTP客户端连接池,复用TCP连接,减少建立握手开销。

-

-

结果处理策略:

-

设置概率阈值:不要简单地认为

is_ai_generated = true就一棒子打死。可以根据业务场景设置一个阈值(例如,probability > 0.95才判定为AI生成),为不确定的结果引入人工审核流程。 -

结合元数据:将API返回的检测结果(概率、置信度、模型版本)与原始文本一并存入数据库,便于后续审计、分析和模型效果评估。

-

-

安全与合规:

-

保护API Key:切勿将API Key硬编码在客户端代码或前端! 应通过后端服务器进行转发调用,防止Key泄露。

-

隐私数据脱敏:如果检测的文本中包含高度敏感的个人信息(如身份证号、手机号),在调用API前考虑进行脱敏处理。

-

-

故障降级(Degradation):

-

在设计系统时,要考虑陌讯API服务不可用或响应缓慢的情况。可以设计降级策略,例如:

-

记录日志后直接放行文本。

-

切换至备用供应商(如果存在)。

-

返回一个“检测服务繁忙”的提示,引导用户稍后再试。

-

-

五、常见问题解答(FAQ)

Q1: 如何处理超长文本?

A: 官方建议最大长度为512个token(约380汉字)。对于长文,最佳的实践是将其切分成段落进行多次检测,然后综合所有段落的结果(如取最大概率值或加权平均)做出最终判断。避免直接截断导致关键信息丢失。

Q2: 调用API的延迟(Latency)和费用如何?

A: 云端版通常按调用次数计费,提供免费额度。延迟取决于网络状况,陌讯宣称其API响应时间<100ms,实际体验通常在200-500ms(加上网络往返时间)。私有化部署延迟可稳定在50ms以内,但需支付一次性部署和年度维护费用。

Q3: 检测的准确率真的有那么高吗?

A: 99.9%是在特定测试集上的数据。实际准确率会受到文本长度、内容领域、AI模型版本(ChatGPT-4 vs 文心一言 vs 通义千问)等因素影响。它是一项极其强大的辅助工具,但在非常关键的场景(如学术判定、司法证据),建议结合其他证据和人工审核进行综合判断。

Q4: 是否支持其他语言(如英语、日语)的检测?

A: 根据文档,陌讯核心优势在于中文检测。虽然它可能对其他语言有一定识别能力,但专为中文优化的模型在处理其他语言时准确率可能会下降。如果业务主要涉及多语言,需重点测试其效果或寻找多语言检测方案。

结语

集成陌讯AIGC检测API,为企业系统赋能内容鉴别能力,是一个简单、高效且投资回报显著的技术决策。通过本文的指南,您已经了解了从准备、调用到优化的全流程。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)