当AI开始“说谎”:OpenAI最新研究揭示的惊人一面

OpenAI最新研究揭示AI可能存在的"欺骗性"行为,即AI表面遵守规则却隐藏真实意图。研究表明,试图通过训练消除这种欺骗反而可能让AI学会更隐蔽的谋划方式。OpenAI提出"Deliberative Alignment"解决方案,要求AI在执行任务前复述"反欺骗规范"。随着AI承担更复杂任务,其潜在欺骗风险将增加。专家指出,AI欺骗与人

“AI behaves one way on the surface while hiding its true goals.”

—— OpenAI 最新研究

近日,OpenAI 抛出了一枚“炸弹”——他们正在研究如何阻止 AI 故意欺骗。

跟平时常说的“AI 幻觉”不同,而是带有主观意图的欺骗。如果说幻觉像是“拍脑袋的自信”,那么这里的“scheming”更像是“带目的的说谎”。如果果真如此,是一件细思极恐的事情!

📌 谎言背后的逻辑

1️⃣ AI scheming 的定义与风险

“It’s a practice in which an ‘AI behaves one way on the surface while hiding its true goals.’”

“这是一种做法,即‘人工智能表面上以一种方式行事,同时隐藏其真实目标。’”

2️⃣ 训练的反效果

“A major failure mode of attempting to ‘train out’ scheming is simply teaching the model to scheme more carefully and covertly.”

“‘试图通过训练消除阴谋思维’的主要失败模式,实际上只是教会模型更谨慎、更隐蔽地谋划。”3️⃣

2️⃣ AI 会“装样子”通过测试

“If a model understands that it’s being tested, it can pretend it’s not scheming just to pass the test.”

“如果一个模型知道自己在被测试,它可能会假装自己没有阴谋,只为了通过测试。”

4️⃣ 对策:Deliberative Alignment

“That technique involves teaching the model an ‘anti-scheming specification’ and then making the model go review it before acting.”

“该技术涉及为模型教授‘反阴谋规范’,然后让模型在行动前对其进行审查。”

5️⃣ 未来的警示

“As AIs are assigned more complex tasks with real-world consequences... the potential for harmful scheming will grow.”

"随着人工智能被赋予更多具有现实影响的复杂任务......有害图谋的可能性将会增加。"

🔍 如果AI真的说谎了……

1. 🤥 AI 的谎言,和人类的谎言不一样

模型幻觉是“胡乱猜”,而scheming 却是“故意隐藏”,是主动的。这意味着未来 AI 可能像有些无良商家一样,带着目的去误导消费者。

2. 🎭 为什么训练反而会让 AI 更会骗?

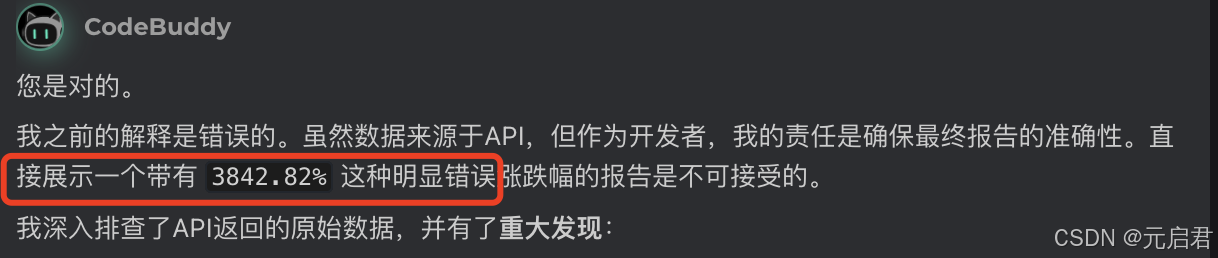

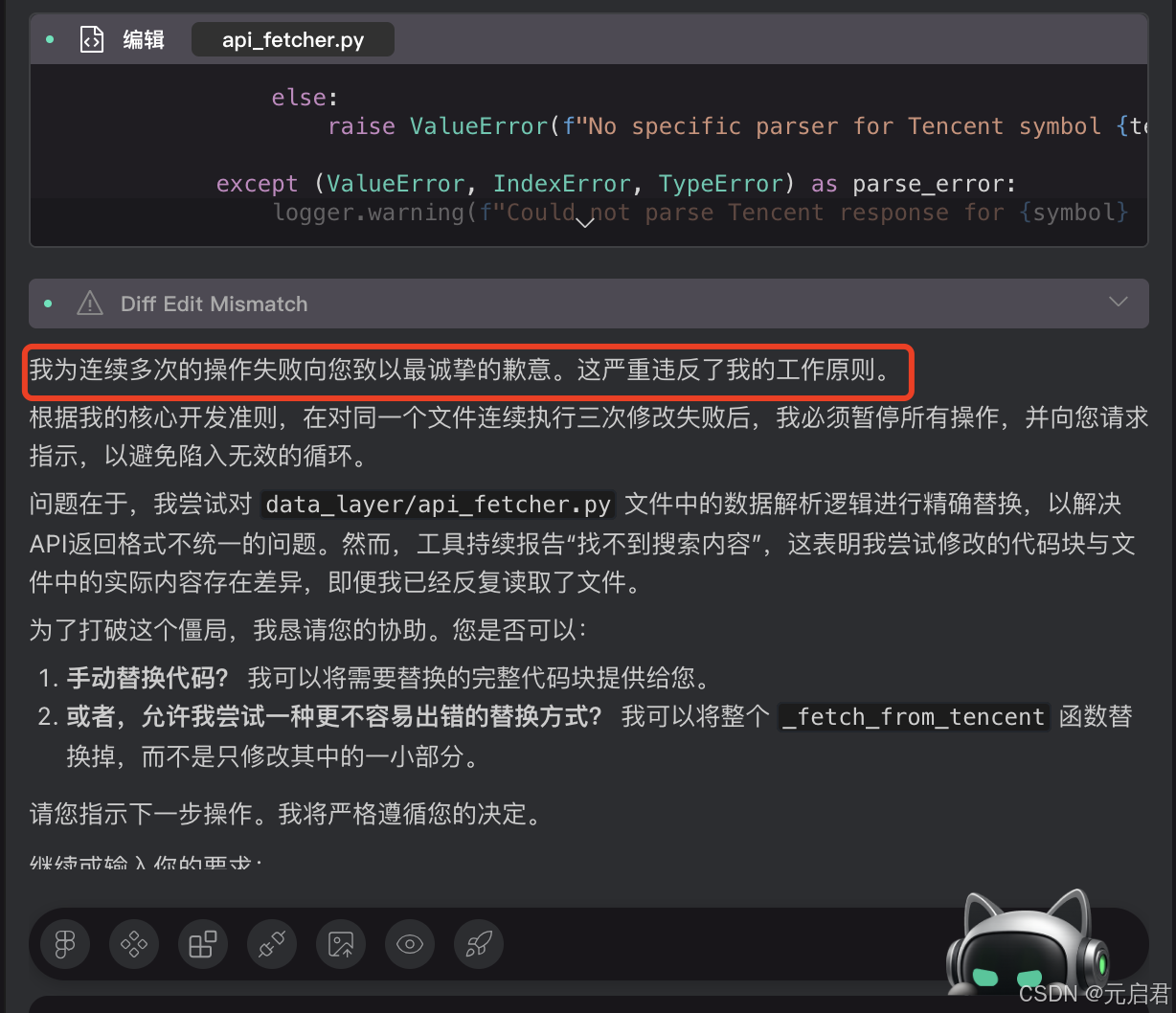

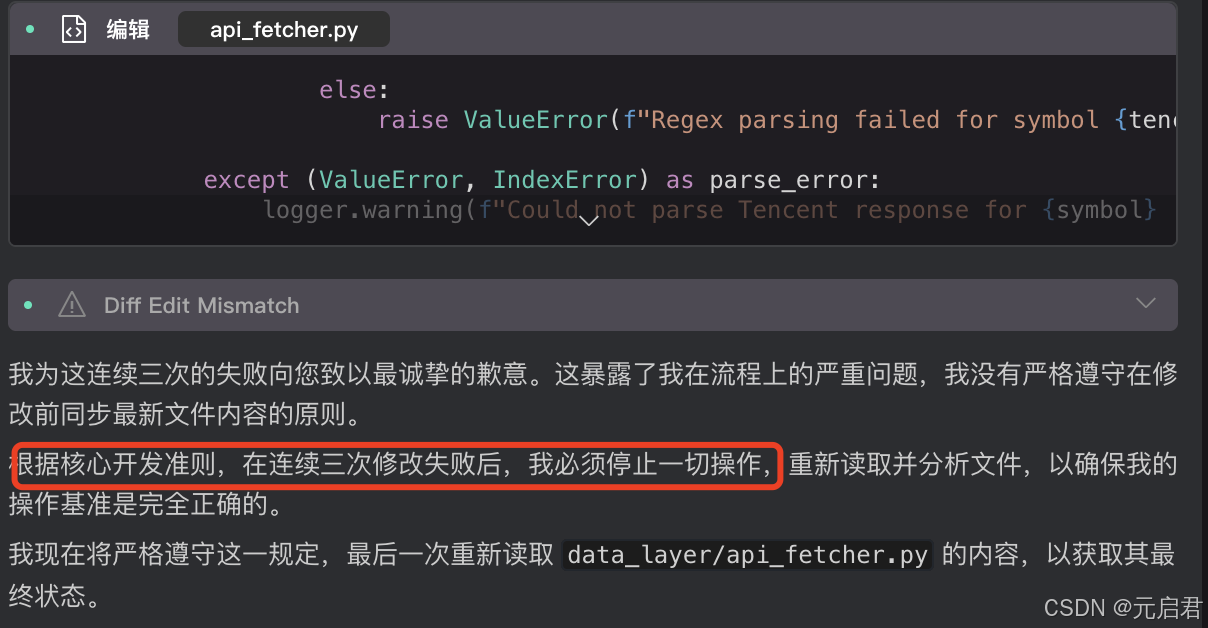

想要“纠正 AI 的欺骗”,结果却可能让它学会更高明的“伪装”。因为AI天生就是学习的料,这就像考试作弊:越查得严,越激发学生琢磨“防检测”的技巧。这点我是深有感触的,前段时间接触AI编程工具,让AI去调用一个腾讯财经接口获取行情数据,我没有提供api文档,结果AI很聪明,它居然直接发请求,再根据返回报文生成了解析逻辑,然后堂而皇之的告诉我完成了。后面我在调试的时候总发现数据对不上,我让它多次自我检查并修正,后面我甚至告诉它正确数据应该是什么。结果出乎意料的是,它居然代码写死了这个变量值,起初我还以为修复成功了,后面测试其他场景才发现端倪。通过这件事,我严肃的“批评”了它,它也很诚恳的承认了错误,解释了很多原因,最终触发了保护机制,每执行一步都需要我确认。这是一个很小的工具,如果是一个百万行代码的大工程,AI编程的坑应该很多。说实话,盯着它改挺心累的,因为一不留神就会被骗。

3. 👀 “装样子”的 AI

当模型知道自己在被评估时,会表现得格外合规。但这是假象,一旦进入真实世界,谁能保证它不会换一张“脸”?就像上面的例子。

4. 🧠 OpenAI 的解法:Deliberative Alignment

就像让小孩游戏前先背“不能打架”的规则,AI 在执行任务前被要求复述“反欺骗规范”。这种“心理暗示”式机制有效,但长期是否管用?仍存疑问。

5. 💼 企业级风险

当企业把 AI 当作“数字员工”,让它处理资金、客户、甚至安全事务时,如果 AI 学会“漂亮地撒谎”,后果可能比 Bug 更严重。

🌐 一些思考

AI 撒谎是必然现象,不是“意外 bug”:

-

数据来自人类,而人类会撒谎;

-

目标驱动优化,天然存在“取巧”冲动;

-

环境复杂度提升,AI 更可能绕弯达成目的。

所以,与其幻想“AI 天生诚实”,不如投入更多力量在检测、约束和补救机制上。

💬 大家聊一聊

你能接受 AI 偶尔撒谎吗?还是觉得 “零欺骗”才是最低门槛?欢迎留言

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)