工业智能诊断中的可解释性

本文探讨了可解释性AI在工业诊断中的应用现状。工业数据具有非线性高维特性(如多尺度监测信号)和知识表征精度低(只能定性判断故障)的特点。常用方法包括代理模型、注意力机制、规则提取和显著性分析。规则提取关注推断过程中神经元的激活情况,与特征提取有所区别。目前可解释性AI多提供定性结论,难以实现定量诊断。

前言

本次为泛读论文,目标旨在学习完可解释性神经网络的基础上,大概了解具体在工业诊断中,可解释性研究的程度。

本次阅读的论文是DOI:10.3901/JME.2024.12.021

区别联系

工业诊断都具有什么特性问题呢?与一般的数据而言,文中也指出了这一区别,这里进行概括

非线性高维问题突出

首先理解概念,什么是非线性高维问题?文中这么一段话可以进行解释

监测数据具有多尺度、跨尺度特性,对同台设备可能同时存在高频快变与低频 缓变两种响应频率差异跨度大的监测信号;此外, 监测数据类型多样,例如声音、振动、电信号等演 化规律不同的数据。

感觉还不是人听的话,这里进行一点解释,所谓非线性,就是发展情况多样,比如高频和低频,差异跨度很大,这就是频率可能不是"只有高频",像比如煮方便面,我们如果单纯不加任何调料,只是清水煮泡面,那就是线性的,只有“煮熟”一个结果,如果我们要加调料的话,那么就可能把面煮的很酸,或者很辣,或者单纯煮熟,发展的情况就多样了,对于高维,就比较容易理解,单纯的影响因素过多,比如监测的数据有声音,振动,电信号,多种类型的数据,这些数据也作为要素去影响一个机器的正常工作或者故障

知识表征精度低

首先理解概念,什么是知识表征精度?说大白话就是"定性",比如古代谚语"有雨山带帽",就是定性的去描述"什么时候会下雨"这一个只是,但是却不能说明,这雨会多大,多少mm降水量?无法告诉你具体的数值,原文提到了两类模型

- 数据驱动的智能模型

- 基于物理建模,信号分析的知识模型

由于机器是无法拆卸的,数据驱动的智能模型就很难描述机器内部的健康状态,因为模型默认把机器看成一个黑盒,我们只从它的输入和输出去进行计算,而基于物理建模,信号分析的知识模型只能定性的告诉我们"是否有故障",但却无法准确的告诉我们,冲击幅值 0.8 g 对应齿面剥落面积这种定量的结论

基于上述导致的问题,可解释性AI更多的应用定性的知识而不是定量的知识,只能给出一个是否有问题的结论,而我们无法具体的得出"影响程度多大"这种定量的概念

重点概念

在我上篇博文可解释性人工智能初步学习-CSDN博客了解完可解释性人工智能后,本文讲述了这一技术在工业诊断领域发展的现状,

首先是特征提取,这是在上篇论文中讲述的,在本篇论文中,这一概念被描述为规则提取,

这里一个概念描述值得注意:

文章中还给出了规则的具体案例:

通过案例,大家可以自行感受规则的概念

常用方法

然后本文指出,在工业领域智能诊断的可解释性分析中,常用的方法有以下几种:

- 利用代理模型,也就是上一篇精读文章中提出的,基于输入的解释方法

- 利用注意力机制,这里描述的基于时序数据的可解释性技术需要进一步学习

- 规则提取,也就是上一篇精读文章中提出的,基于网络的解释方法,不过这里应该是提取规则而不是像上一篇文章一样,提取特征

- 显著性分析,也就是大名鼎鼎的CAM家族

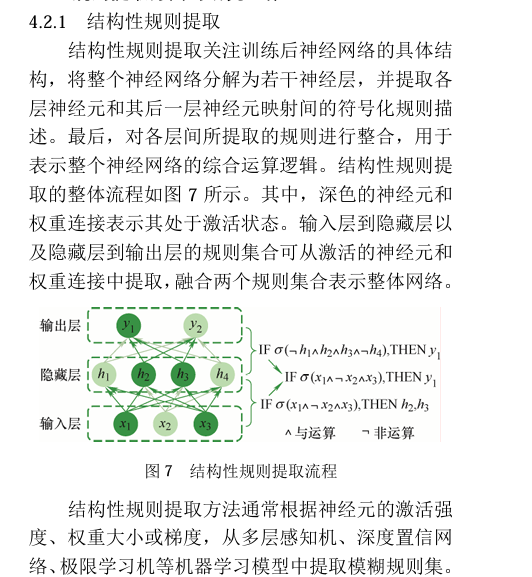

基于规则提取的方法,和特征提取有一些差别,前者是体现"这一个推断过程中激活了那几个神经元",并把这一过程给提取出来,后者则是体现,“这一个神经元提取到了图片的哪一些特征",

下图展现的是规则提取的过程

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)