【无标题】

Qwen 3-Next 系列的发布标志着稀疏模型技术的重要进展。通过将激活比例降至史无前例的低水平,同时保持强大的性能表现,这一创新为 AI 模型的部署和应用开辟了新的可能性。对于开发者和研究人员而言,Qwen 3-Next 提供了在有限硬件资源下运行大规模模型的现实方案。随着 llama.cpp 等推理框架对新架构的支持逐步完善,这类稀疏模型有望在移动设备和边缘计算场景中发挥更大作用。阿里巴巴表

Qwen 3-Next 系列正式发布:80B 参数仅激活 3B,开启稀疏模型新纪元

Qwen 近日正式发布了 Qwen 3-Next 系列模型,其中最引人瞩目的是 Qwen3-Next-80B-A3B-Instruct 模型。这款模型采用了极端稀疏架构,总参数量达到 80B,但仅激活 3B 参数,实现了前所未有的计算效率。

核心技术创新

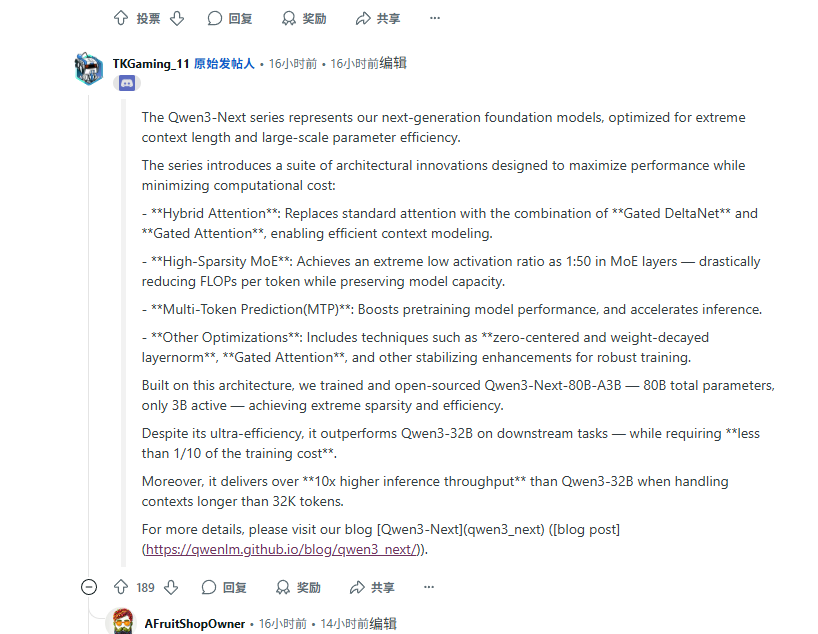

Qwen 3-Next 系列引入了多项突破性技术,专为超长上下文和大规模参数效率而优化。

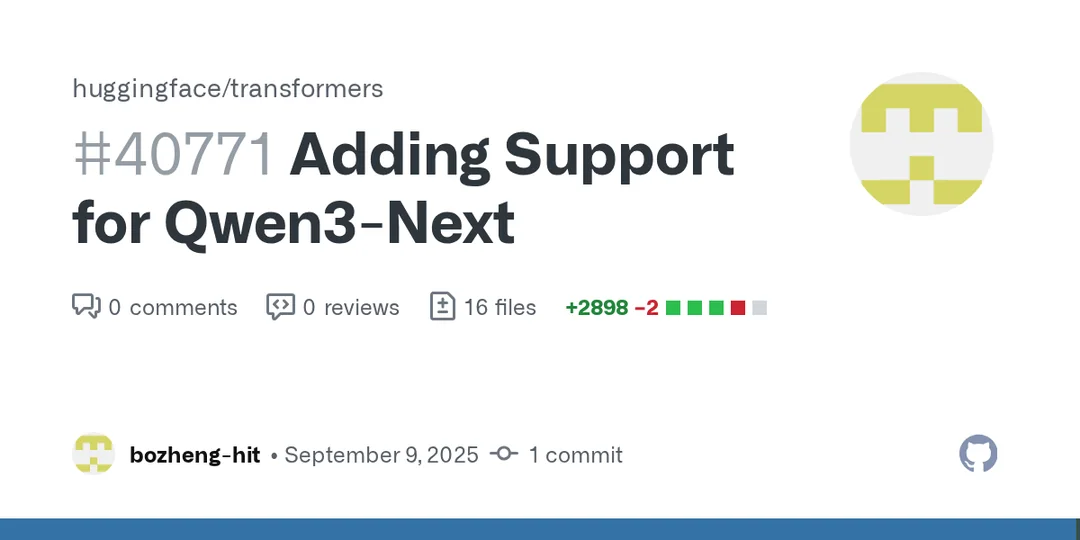

混合注意力机制是该系列的核心创新之一。传统的标准注意力被门控 DeltaNet 和门控注意力的组合所替代,显著提升了上下文建模的效率。从 Hugging Face 的相关代码可以看出,75% 的层使用线性注意力,只有 25% 的层采用全注意力机制,这种设计在保证性能的同时大幅降低了计算复杂度。

高稀疏混合专家系统(MoE)实现了极低的激活比例,达到惊人的 1:50,意味着在 MoE 层中只有 2% 的专家被激活。这种设计在保持模型容量的同时,将每个 token 的浮点运算量(FLOPs)降至极低水平。相比之下,其他知名稀疏模型如 GPT-OSS-12B 的激活比例为 1:32,显示出 Qwen 3-Next 在稀疏性方面的领先地位。

多 Token 预测(MTP)技术不仅提升了预训练模型的性能,还显著加速了推理过程。结合零中心和权重衰减层归一化等其他优化技术,确保了训练过程的稳定性。

性能表现与成本优势

尽管采用超高效稀疏架构,Qwen3-Next-80B-A3B 在下游任务中的表现超越了 Qwen3-32B,同时训练成本仅为后者的十分之一。更令人印象深刻的是,在处理超过 32K tokens 的长上下文时,该模型的推理吞吐量比 Qwen3-32B 高出 10 倍以上。

这种性能提升主要源于其独特的架构设计。只有 3.75% 的参数处于激活状态,大幅减少了实际计算量,但通过巧妙的专家路由机制,模型仍能访问完整的 80B 参数知识库。

硬件部署的革命性影响

Qwen 3-Next 的发布对硬件部署策略产生了深远影响。社区讨论显示,这类稀疏模型特别适合 CPU 推理场景。

一位用户分享了使用 AMD EPYC 9575F 配合 1152GB 系统内存的方案,理论带宽达到 614GB/s,成本与单块 RTX Pro 6000(96GB GDDR7)相当。对于只有 3B 激活参数的模型,这样的 CPU 配置能够提供相当不错的推理速度。

另一位用户报告称,Qwen3-30B-A3B 已经在 CPU 上表现出色,成为其日常使用的首选模型。虽然在处理长上下文时仍面临提示词处理速度和 KV 缓存大小的挑战,但整体体验已经非常接近密集型模型。

量化与内存优化

对于内存受限的用户,极端量化为运行大型稀疏模型提供了可能性。讨论中提到,80B 参数的模型通过 IQ2_XSS 量化可以在 32GB RAM 中运行,而在 64GB RAM 系统中可以使用更高质量的 Q4 量化。

社区普遍认为,高度量化的大模型往往优于中等量化的小模型。一位经验丰富的用户指出,80B A3B 模型即使使用 Q2 量化,其表现也会明显优于使用 Q4 量化的 30B A3B 模型。

与竞品的对比分析

Qwen 3-Next 被视为 GPT-OSS-120B 的直接竞争者。GPT-OSS-120B 激活 5% 的参数并采用原生 MXFP4 量化,能够在单个 H100 上运行。Qwen 3-Next 虽然总参数量较小,但其 3.75% 的超低激活比例可能在效率上更胜一筹。

值得注意的是,Qwen 3-Next 采用了更先进的线性注意力机制,这不仅节省了内存,还加速了生成和预填充过程。如果这种权衡能够带来最小的性能损失,该模型有望成为资源受限环境下的理想选择。

小编总结

Qwen 3-Next 系列的发布标志着稀疏模型技术的重要进展。通过将激活比例降至史无前例的低水平,同时保持强大的性能表现,这一创新为 AI 模型的部署和应用开辟了新的可能性。

对于开发者和研究人员而言,Qwen 3-Next 提供了在有限硬件资源下运行大规模模型的现实方案。随着 llama.cpp 等推理框架对新架构的支持逐步完善,这类稀疏模型有望在移动设备和边缘计算场景中发挥更大作用。

阿里巴巴表示将很快发布更多技术细节和基准测试结果,届时我们将对这一突破性模型的实际表现有更全面的了解。

更多推荐

已为社区贡献22条内容

已为社区贡献22条内容

所有评论(0)