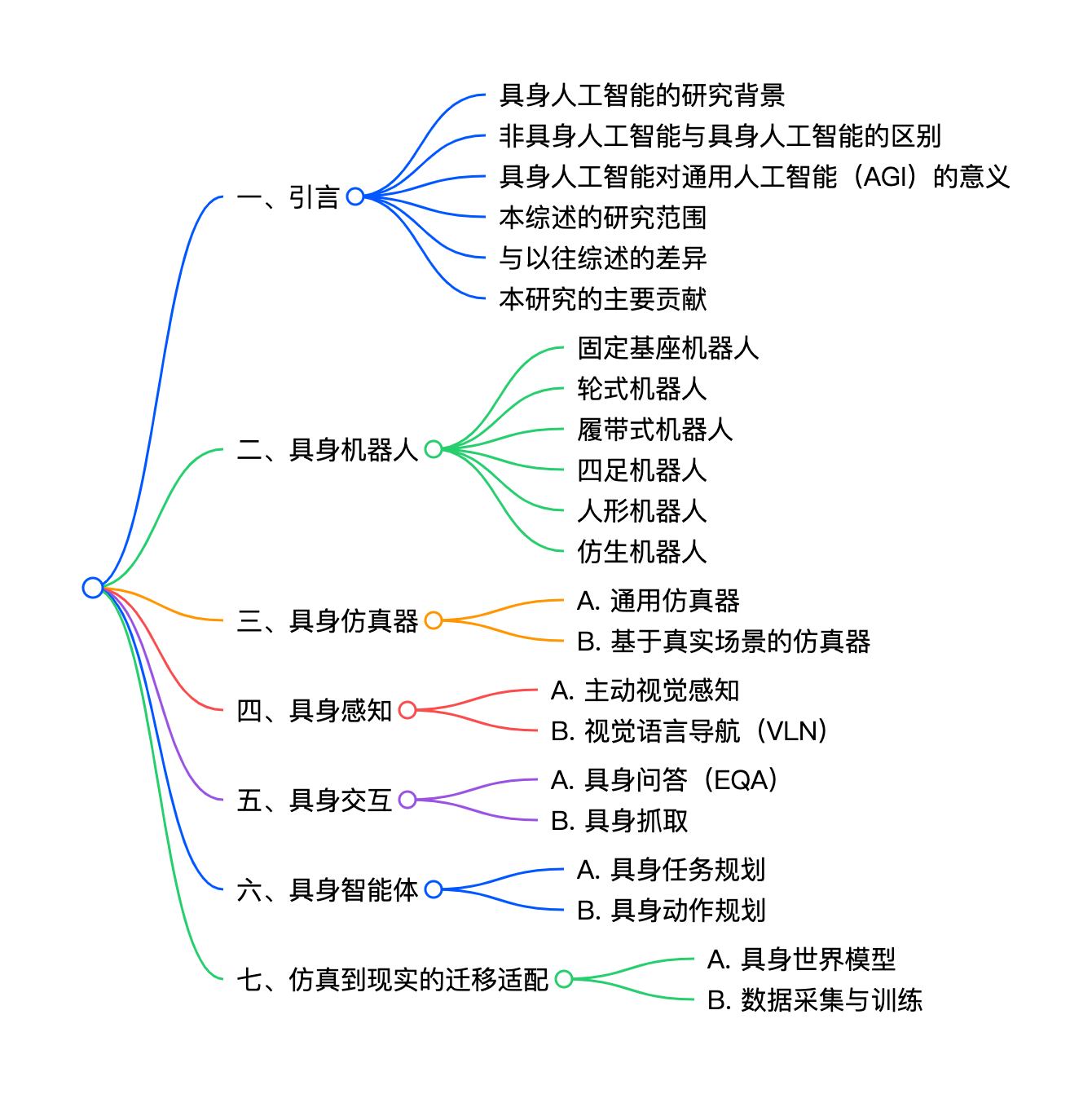

具身智能综述1:Aligning Cyber Space with Physical World: A Comprehensive Survey on Embodied AI

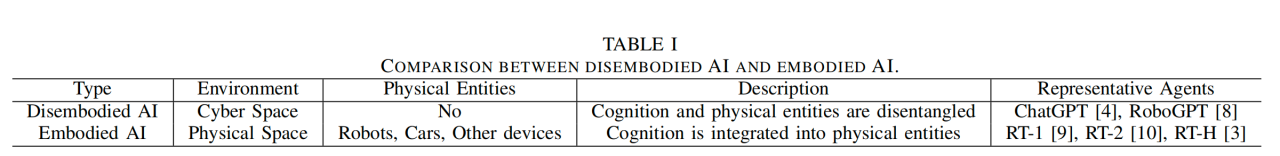

具身智能定义网络空间中对应非具身智能,物理空间对应具身智能。多模态大模型(MLMs)的最新进展为具身模型注入了强大的感知、交互和规划能力,以开发能与虚拟和物理环境积极交互的通用具身智能体和机器人。因此,具身智能体被广泛认为是多模态大模型的最佳载体。近期具有代表性的具身模型包括RT-2和RT-H。当我们站在通用人工智能(AGI)驱动的创新前沿时,深入研究具身人工智能领域、剖析其复杂性、评估其当前发展

1.基础概念

具身智能定义

网络空间中对应非具身智能,物理空间对应具身智能。

多模态大模型(MLMs)的最新进展为具身模型注入了强大的感知、交互和规划能力,以开发能与虚拟和物理环境积极交互的通用具身智能体和机器人。因此,具身智能体被广泛认为是多模态大模型的最佳载体。近期具有代表性的具身模型包括RT-2和RT-H。

当我们站在通用人工智能(AGI)驱动的创新前沿时,深入研究具身人工智能领域、剖析其复杂性、评估其当前发展阶段并思考其未来可能的发展轨迹至关重要。如今,具身人工智能包含计算机视觉(CV)、自然语言处理(NLP)和机器人技术等多个关键技术,其中最具代表性的是具身感知、具身交互、具身智能体以及从模拟到现实的机器人控制。因此,通过全面的综述来把握具身人工智能在通用人工智能探索过程中的发展态势至关重要。

本综述涵盖具有代表性的具身机器人、模拟器以及四大主要研究任务:具身感知、具身交互、具身智能体和仿真到现实的适配。除此之外,为了推动强大的通用具身智能体的发展,我们提出了一个新的数据集标准ARIO(All Robots In One)以及一个统一的大规模ARIO数据集,该数据集包含约300万段情节,这些情节来自258个系列和321,064项任务。

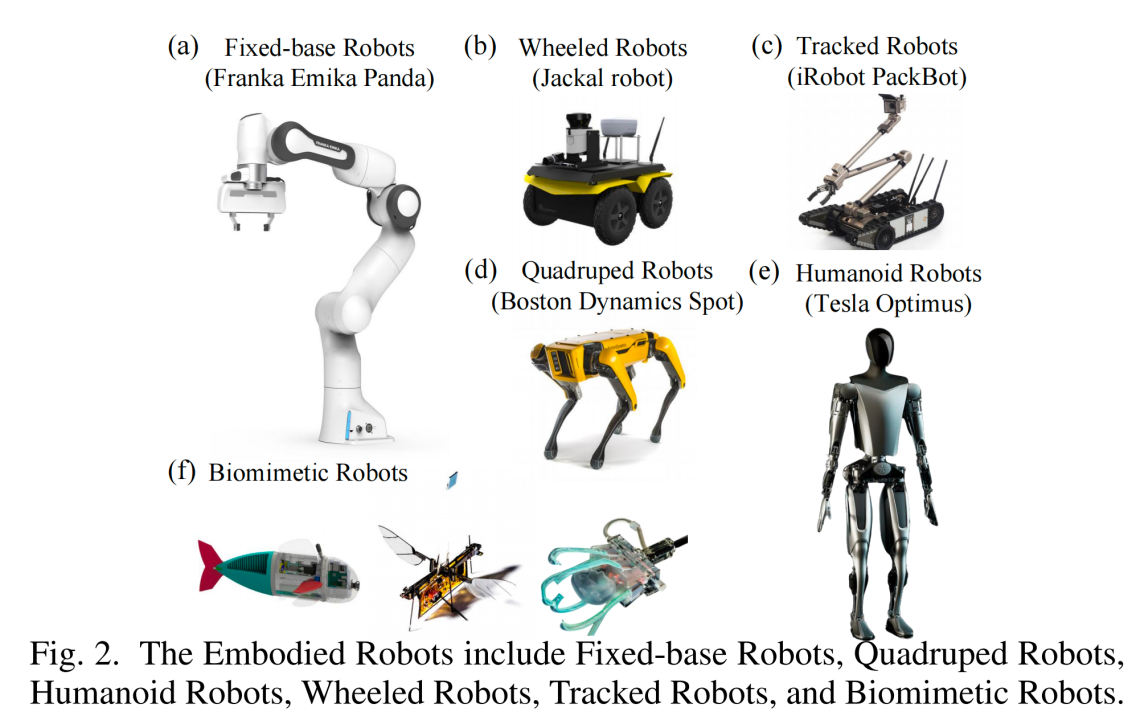

2 具身机器人

添加图片注释,不超过 140 字(可选)

|

标识 |

机器人类型 |

核心特点 |

典型使用场景 |

代表案例 |

|---|---|---|---|---|

|

a |

固定基座机器人(Fixed-base Robots) |

定位精准,运动范围固定,擅长高精度操作 |

实验室自动化、工业生产(如零件组装、精密加工) |

Franka Emika Panda、Kuka iiwa、Sawyer |

|

b |

轮式机器人(Wheeled Robots) |

结构简单,成本较低,移动效率高,但对地形适应性弱(易受不平路面影响) |

物流仓储(如货物搬运、库存盘点) |

Kiva、Jackal robots |

|

c |

履带式机器人(Tracked Robots) |

履带式设计,接地面积大,在松软/复杂地形(如泥泞、废墟)中稳定性强 |

农业作业(如田间巡检、播种)、灾害救援(如废墟搜救) |

iRobot PackBot |

|

d |

四足机器人(Quadruped Robots) |

多足结构,灵活性高,可适应台阶、斜坡等非结构化地形 |

复杂地形探索(如山地勘测)、救援任务(如灾区生命探测) |

Unitree Robotics’ A1、Go1、Boston Dynamics Spot |

|

e |

人形机器人(Humanoid Robots) |

模仿人类肢体结构与运动模式,手部灵活性强,可完成精细动作 |

个性化服务(如家庭陪护、康复辅助)、制造业协作(如人机协同组装) |

Tesla Optimus |

|

f |

仿生机器人(Biomimetic Robots) |

模仿自然生物(如鱼类、昆虫)的运动方式与功能,能量效率高,能适应特殊环境 |

水下探测(如鱼形机器人勘察海洋生物)、狭窄空间作业(如昆虫形机器人检修设备)、柔性操作(如软体机器人处理易碎物品) |

鱼形机器人、昆虫形机器人、软-bodied robots |

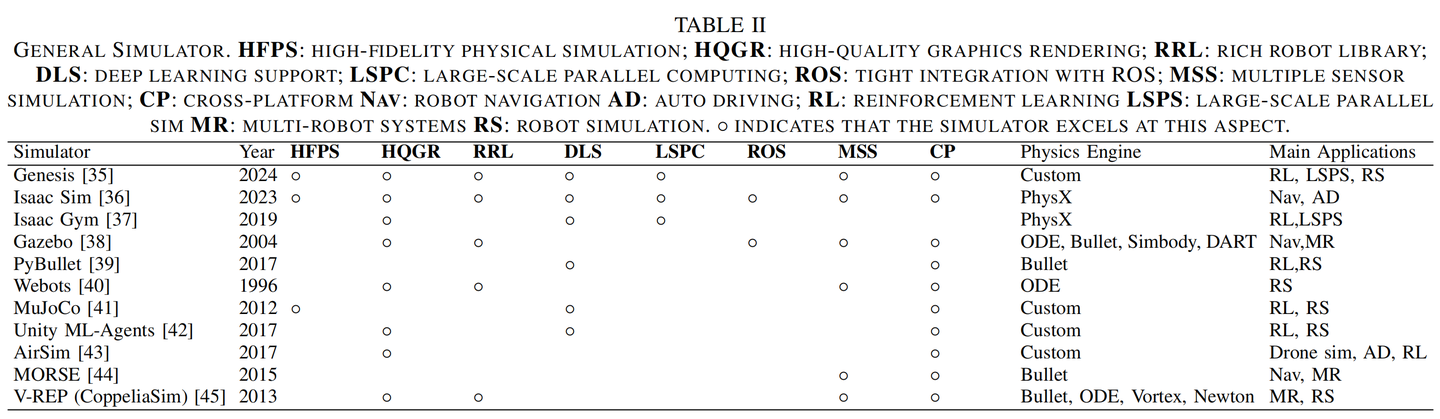

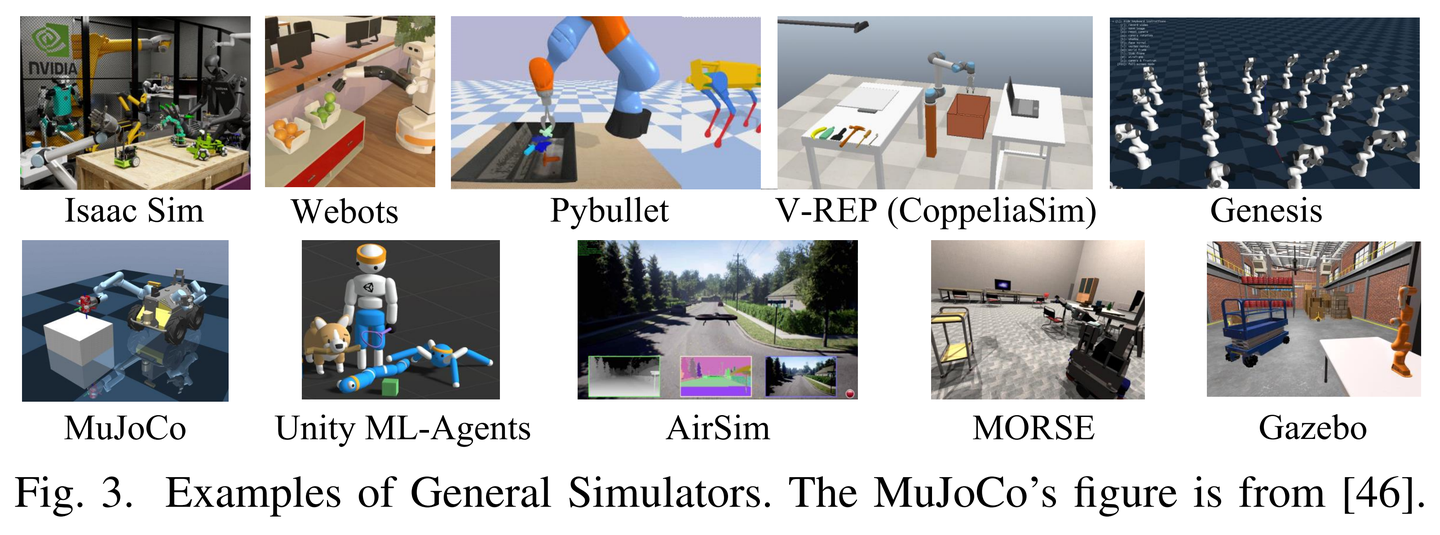

3 模拟器

3.1 通用模拟器(General Simulator)

真实环境中存在的物理交互和动态变化是不可替代的。然而,在物理世界中部署具身模型往往成本高昂,且面临诸多挑战。通用模拟器提供了一个能密切模拟物理世界的虚拟环境,可用于算法开发和模型训练,这在成本、时间和安全性方面具有显著优势。

通用模拟器表

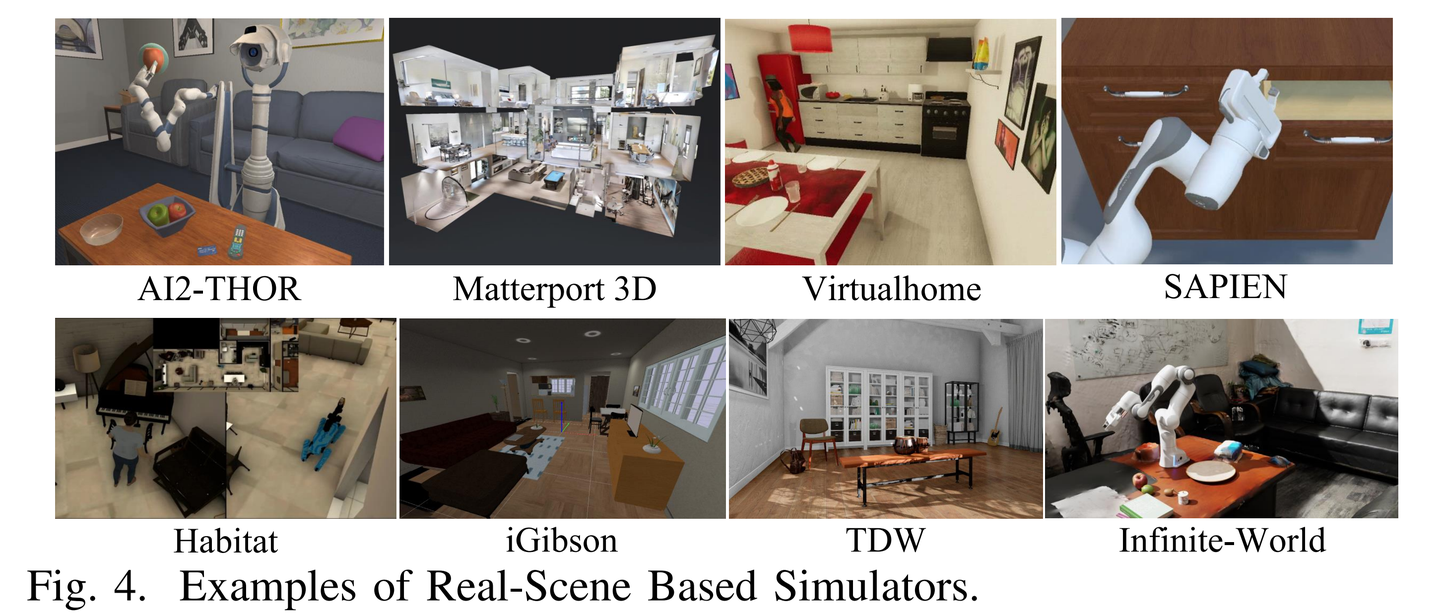

3.2 基于真实场景的模拟器(Real-Scene Based Simulators)

在具身人工智能领域,实现能胜任家庭活动的通用具身智能体是一个主要研究重点。这些具身智能体需要深入理解人类日常生活,并执行复杂的具身任务,例如在室内环境中进行导航和交互。

|

模拟器名称 |

核心特点 |

适用场景 |

关键优势 |

|---|---|---|---|

|

SAPIEN |

专门优化关节类物体(如门、橱柜、抽屉)的交互模拟 |

模拟涉及家具、设备等关节物体操作的任务(如开门取物、抽屉整理) |

精准复现关节物体的物理交互逻辑,支持精细操作测试 |

|

VirtualHome |

具备独特的环境图结构,支持基于自然语言描述的高层具身规划 |

基于语言指令的家居场景任务规划(如“按步骤整理客厅”“规划做饭流程”) |

可将自然语言转化为结构化的环境交互逻辑,提升任务规划的合理性 |

|

AI2-THOR |

提供丰富的交互式室内场景,但交互以脚本驱动为主,缺乏真实物理交互 |

无需精细物理交互的具身任务(如简单导航、物体定位、基础场景识别) |

场景数量多、交互类型基础,适合入门级具身感知与导航训练 |

|

iGibson |

支持细粒度具身控制与高仿真物理交互,提供大量真实、大规模室内场景 |

复杂且长期的移动操作任务(如长时间家居环境巡检、多房间物体搬运) |

场景真实性强、物理交互精度高,能模拟现实中复杂的环境动态 |

|

TDW |

支持用户自由扩展场景,具备独特的音频模拟与灵活的流体模拟功能 |

需自定义场景或涉及特殊模拟需求的任务(如含音频线索的导航、流体相关操作) |

场景扩展性强,可满足个性化模拟需求,特殊模拟(音频、流体)功能稀缺 |

|

Matterport3D |

作为基础2D-3D视觉数据集,广泛用于扩展具身AI基准测试 |

为各类室内场景具身任务(如导航、物体识别)提供基础场景数据支撑 |

数据覆盖范围广、场景真实性高,是多数室内具身任务的基础数据来源 |

|

Habitat |

拥有海量室内场景,提供友好接口与开放框架,但智能体缺乏交互能力 |

专注于具身导航任务(如“从卧室导航至厨房”“按指令找到指定房间”) |

导航场景丰富、易用性强,适合专注于导航算法开发与测试 |

|

InfiniteWorld |

采用统一可扩展的模拟框架,支持隐式资产重建、自然语言驱动的场景生成与编辑,支持分布式协作与人类在环(Human-in-the-Loop) |

复杂机器人交互任务(如多机器人协同作业、需动态编辑场景的任务) |

框架扩展性强,支持场景动态生成与协作交互,能适配复杂且多变的任务需求 |

4.具身感知

关键词:感知(看到)、理解(知道)、推理(想到)、执行(做到)

与仅仅识别图像中的物体不同,具备具身感知能力的智能体必须在物理世界中移动并与环境交互。这需要对三维空间和动态环境有更深入的理解。具身感知需要视觉感知与推理、理解场景内的三维关系,以及基于视觉信息预测并执行复杂任务。

4.1 主动视觉感知(Active Visual Perception)

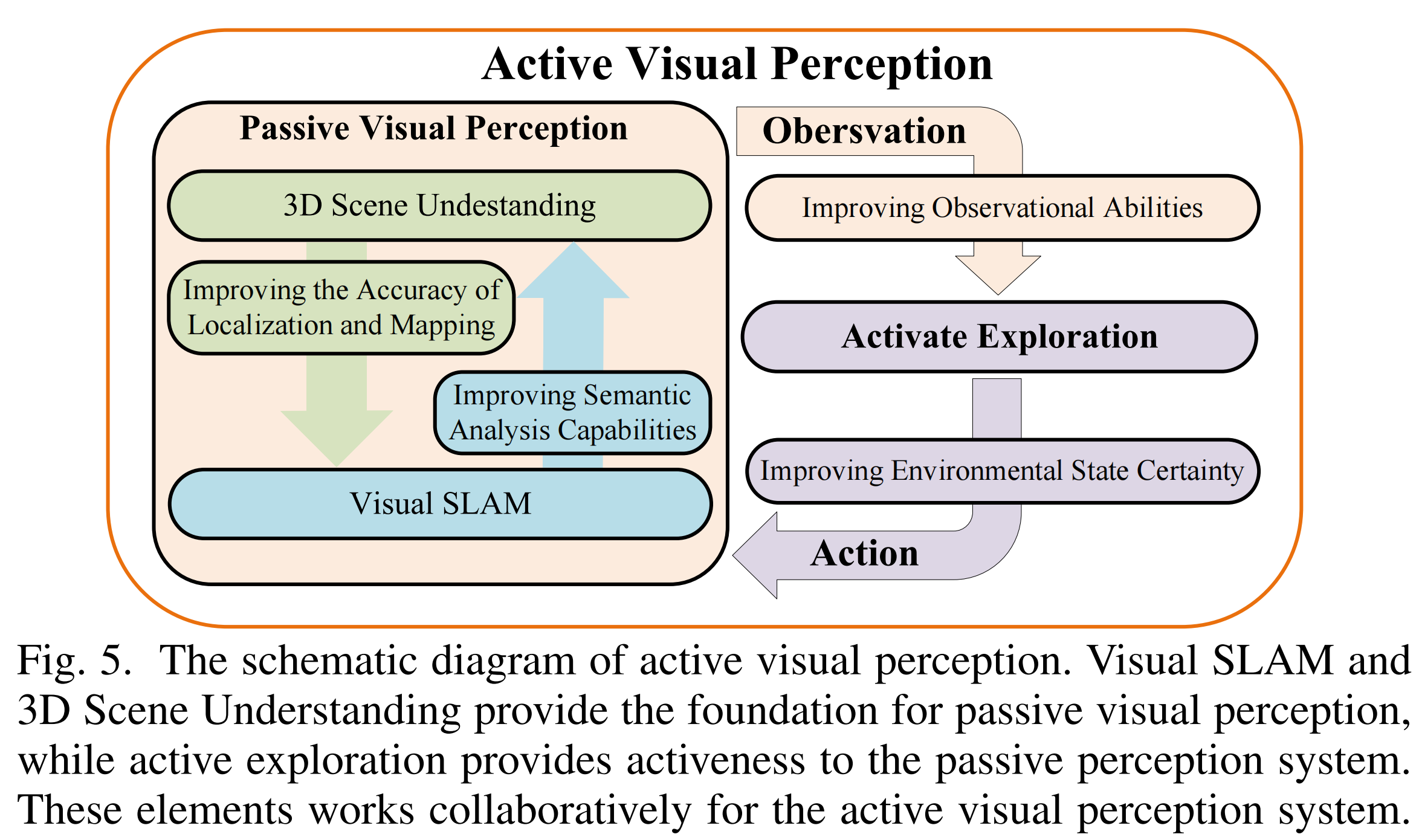

主动视觉感知系统需要一些基本能力,如状态估计、场景感知和环境探索。如图5所示,这些能力在视觉同步定位与地图构建(vSLAM)、三维场景理解、主动探索等领域已得到广泛研究。这些研究领域有助于开发稳健的主动视觉感知系统,促进在复杂、动态环境中更好地进行环境交互和导航。我们简要介绍这三个组成部分,并在表III中总结了每个部分提到的方法。

1) 视觉同步定位与地图构建:同步定位与地图构建(SLAM)旨在确定机器人在未知环境中的位置,同时构建该环境的地图。基于测距的SLAM依靠激光扫描仪、雷达和声纳等测距仪生成点云表示。然而,这种方法成本高昂,且提供的环境信息有限。相比之下,视觉SLAM(vSLAM)采用车载摄像头捕获图像帧并构建环境表示。其优势包括硬件成本低、在小规模场景中精度高,以及能够捕捉丰富的环境细节。

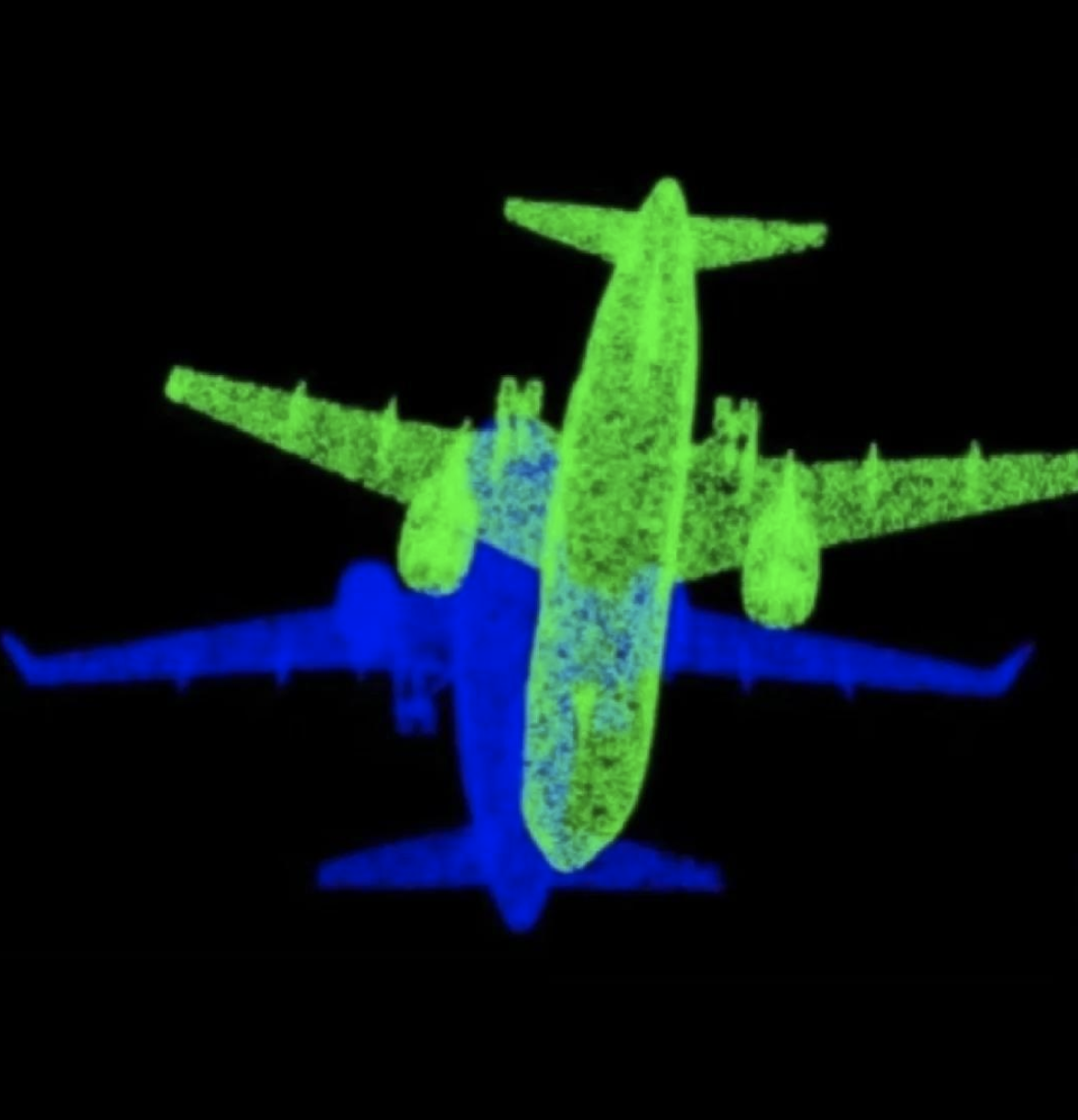

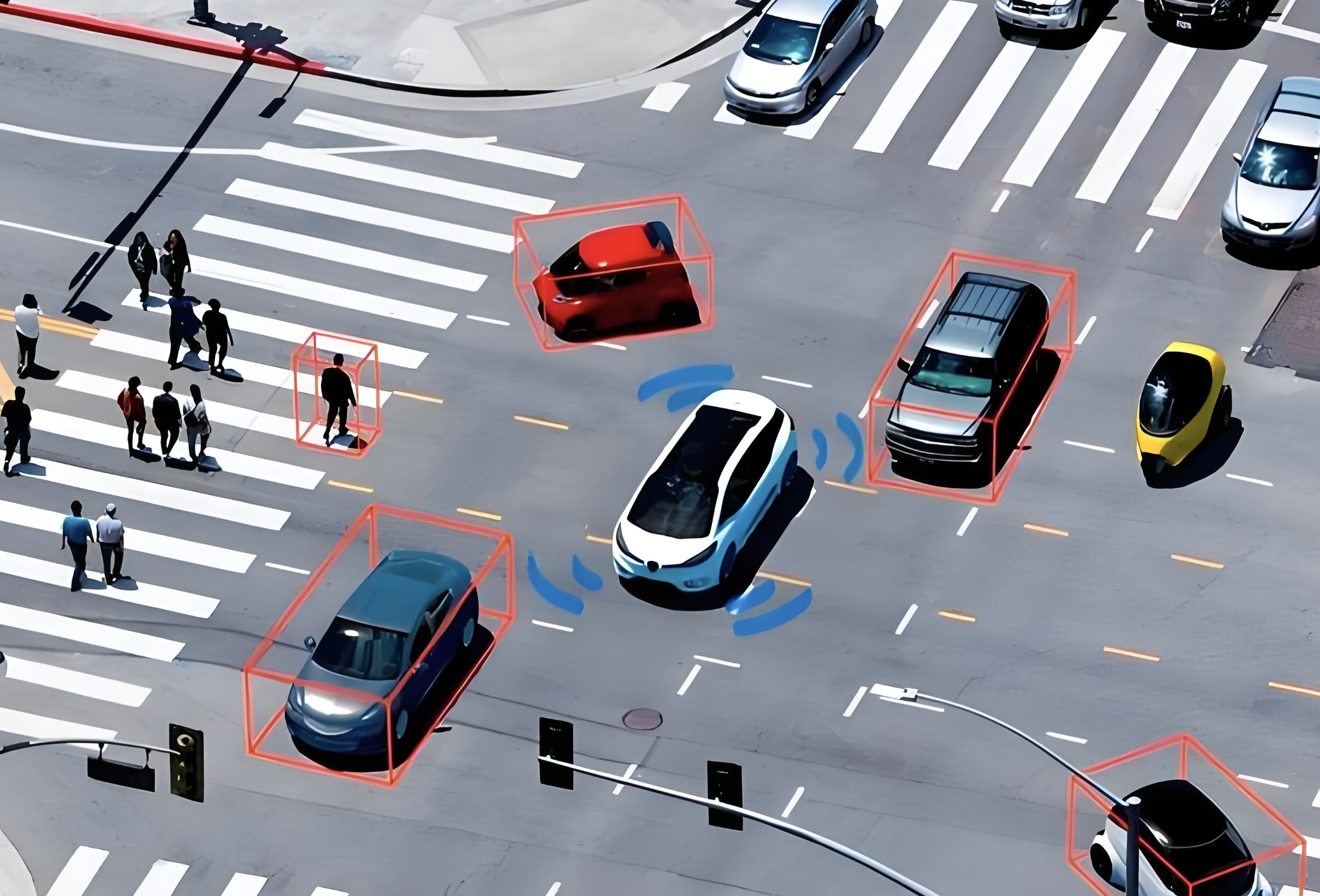

2)三维场景理解:三维场景理解旨在从三维场景数据中区分物体的语义、确定其位置并推断几何属性,这在自动驾驶、机器人导航和人机交互等领域具有基础性地位。场景可通过激光雷达(LiDAR)或RGB-D传感器等三维扫描工具记录为三维点云。与图像不同,点云具有稀疏性、无序性和不规则性。深度学习在三维场景理解方面的最新进展可分为基于投影、基于体素和基于点的方法。

3)主动探索:3D场景理解方法使机器人能够被动感知环境,进行静态信息获取和决策,而不考虑场景变化。因此,虽然被动感知至关重要,但必须辅以主动探索,使机器人能够动态地与周围环境交互并感知它们。它们之间的关系如图5所示。

理解:视觉同时定位与地图构建(Visual SLAM)和三维场景理解(3D Scene Understanding)相互促进并构成被动视觉感知(passive visual perception)的基础,而主动探索(activate Exploration)则为被动感知系统赋予了主动性。这些要素协同作用,共同构成主动视觉感知系统。

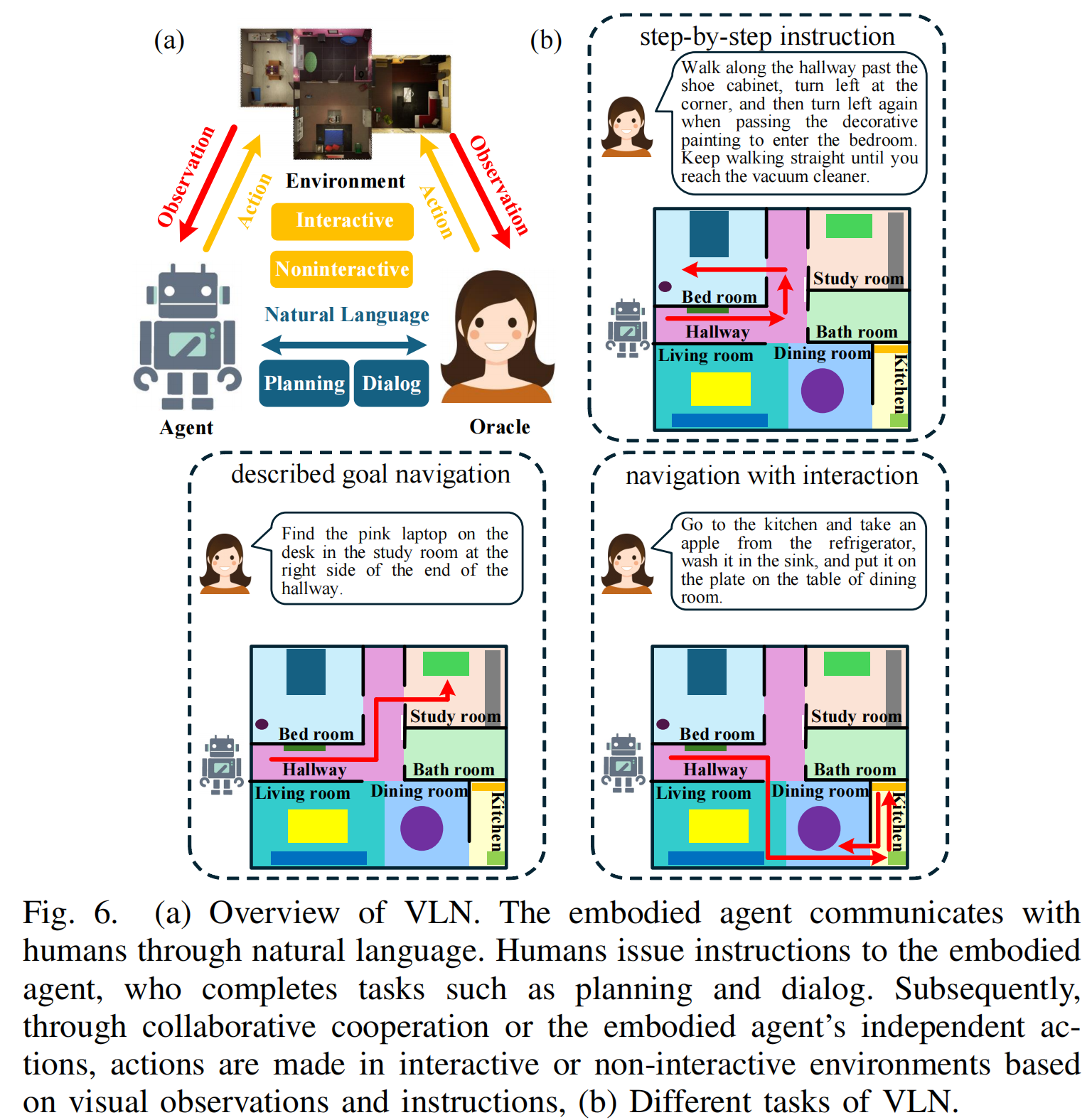

4.2 视觉语言导航(Visual Language Navigation )-VLN

Visual Language Navigation 侧重于基于语言指令的导航任务,而 Visual Language Action 范围更广,强调视觉、语言和动作的结合,可应用于包括导航在内的多种需要机器人执行动作的场景。

视觉语言导航(VLN)是一项重要任务,旨在让智能体依照语言指令在未知环境中导航。例如,“去厨房给我哪一个红色的杯子”。VLN要求机器人理解复杂多样的视觉观察信息,同时解读不同粒度的指令。输入通常包含两部分:视觉信息和自然语言指令。视觉信息可以是过去轨迹的视频,也可以是一组历史-当前观察图像。自然语言指令包括智能体需要到达的目标或预计完成的任务。智能体必须利用上述信息从候选列表中选择一个或一系列动作,以满足自然语言指令的要求。这一过程可表示为:Action =M(O, H, I),其中Action是所选动作或动作候选列表,O是当前观测,H是历史信息,I是自然语言指令。

随着大型语言模型(LLMs)的惊人表现,视觉语言导航(VLN)近年来取得了巨大进展,其方向和重点也受到了深远影响。尽管如此,视觉语言导航方法仍可分为两个方向:基于记忆理解和基于未来预测。

决策逻辑:

- 基于记忆 - 理解的方法:决策时,将当前的导航场景与记忆中的相似场景进行匹配,找到最符合当前情况的历史经验,并复用当时的策略或结论。

- 基于未来预测的方法:先通过模型预测未来多个可能的状态,然后根据一定的目标函数或奖励机制,评估这些未来状态的优劣,选择能够使未来收益最大化或最有利于实现目标的动作作为当前决策。

基于记忆-理解的方法侧重于对环境的感知与理解,以及基于历史观测或轨迹的模型设计,这是一种基于过往学习的方法。基于未来预测的方法则更注重对未来状态的建模、预测与理解,这是一种面向未来学习的方法。

由于视觉语言导航(VLN)可被视为部分可观测的马尔可夫决策过程,其中未来的观测结果取决于智能体当前所处的环境和采取的行动,因此历史信息对导航决策,尤其是长跨度的导航决策具有重要意义,这使得基于记忆-理解的方法一直是视觉语言导航领域的主流。

然而,基于未来预测的方法仍具有重要意义。其对环境的本质理解在连续环境中的视觉语言导航任务中具有很大价值,特别是随着世界模型概念的兴起,基于未来预测的方法正受到研究人员越来越多的关注。

插图理解:具身智能体(embodied agent)通过自然语言与人类进行交互。人类向具身智能体下达指令,智能体则完成规划、对话等任务。随后,基于视觉观测信息与指令,通过协同协作或具身智能体的自主行动,在交互式或非交互式环境中执行相应动作。

5.具身交互

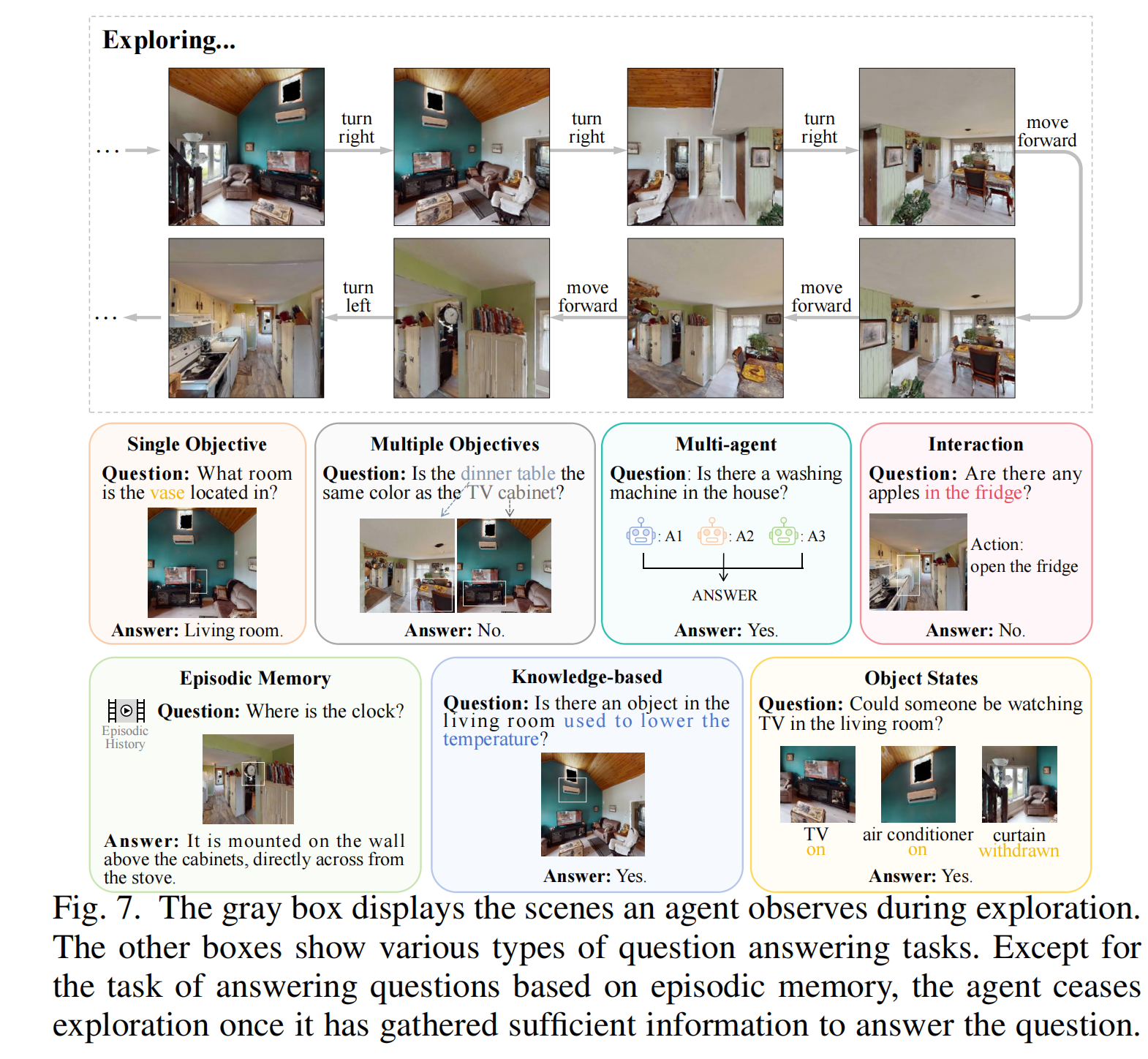

具身交互指的是智能体在物理或模拟空间中与人类及环境进行交互的场景。典型的具身交互任务包括具身问答(EQA)和具身抓取。

5.1 EQA

EQA任务中,智能体需要从第一人称视角探索环境,以收集必要的信息。以回答给定的问题。

方法:具身问答任务主要涉及导航和问答子任务,其实现方法大致分为两类:基于神经网络的方法和基于大语言模型/视觉语言模型的方法。

局限性:

a)数据集:构建数据集需要大量的人力和资源。此外,大规模数据集仍然较少,而且不同数据集评估模型性能的指标各不相同,这使得性能的测试和比较变得复杂;

b)模型:尽管大型语言模型带来了诸多进步,但这些模型的性能仍远落后于人类水平。未来的工作可能会更侧重于有效存储智能体探索到的环境信息,引导它们根据环境记忆和问题来规划行动,同时提高其行动的可解释性。

具身抓取:将传统的运动学方法与LLM和视觉-语言模型等大模型相结合,实现多感官感知和任务执行推理。

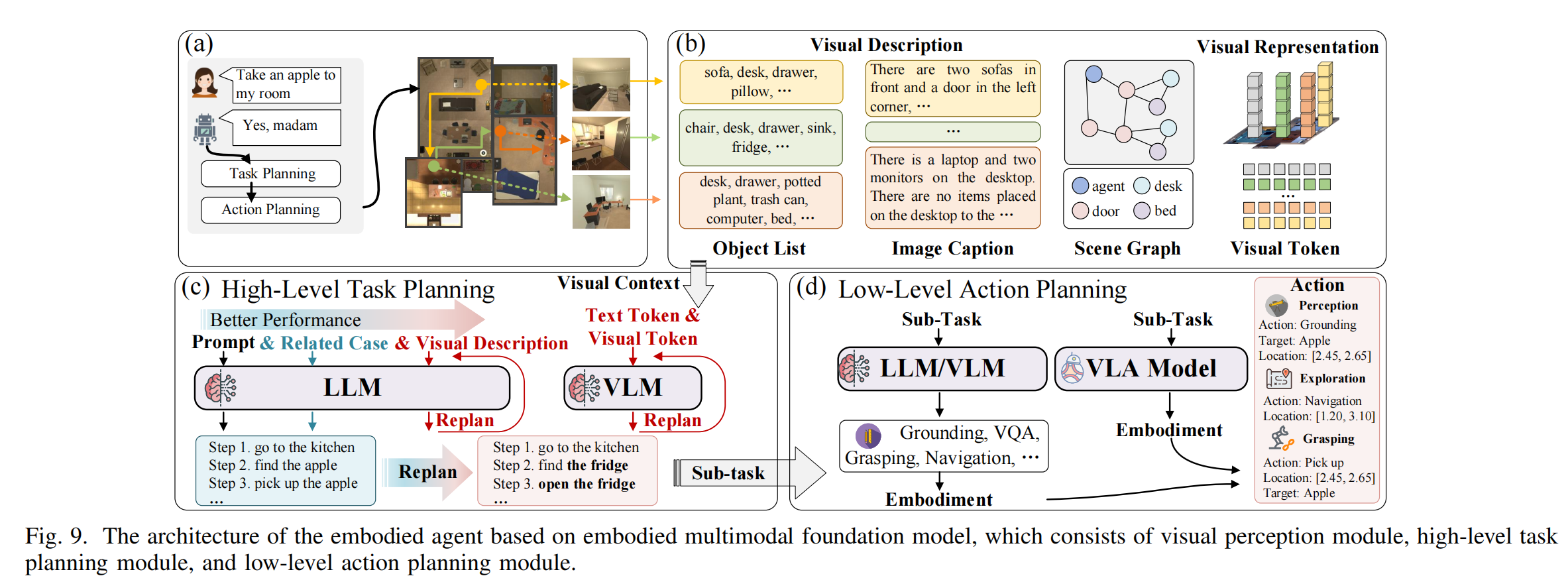

6 具身智能体(EMBODIED AGENT )

基于大语言模型的智能体被赋予物理实体时,它们能够有效地将自身能力从虚拟空间转移到物理世界,从而成为具身智能体。

为了使具身智能体能够在信息丰富且复杂的现实世界中运作,人们已开发出具备强大多模态感知、交互和规划能力的具身智能体,如图9所示。为完成一项任务,具身智能体通常涉及以下过程:

1)将抽象复杂的任务分解为具体的子任务,这被称为高层具身任务规划。

2)通过有效利用具身感知和具身交互模型,或借助基础模型的策略函数,逐步执行这些子任务,这被称为低层具身动作规划。值得注意的是,任务规划涉及行动前的思考,因此通常被认为是在网络空间中进行的。相比之下,动作规划必须考虑与环境的有效交互,并将相关信息反馈给任务规划器,以调整任务规划。因此,具身智能体将其能力从网络空间对齐并推广到物理世界至关重要。

具身任务规划方法:传统的具身任务规划方法通常基于明确的规则和逻辑推理。例如,会使用像PDDL这样的符号规划算法,以及MCTS、A*等搜索算法来生成规划。然而,这些方法往往依赖于预定义的规则、约束和启发式策略,这些内容较为僵化,可能难以很好地适应动态变化或意外情况。随着大语言模型(LLMs)的普及,许多研究尝试利用大语言模型进行规划,或者将传统方法与大语言模型相结合,借助其丰富的内置世界知识进行推理和规划,无需手工定义,这极大增强了模型的泛化能力。

任务规划和行动规划之间的区别表明,由于任务规划子任务的粒度不足,行动规划必须应对现实世界中的不确定性。行动规划可以通过以下方式实现:1)使用预训练的具身模型通过API完成子任务;2)利用VLA模型的能力。行动规划的结果会被反馈以优化任务规划。

7 模拟现实适配(Sim-to-Real Adaption)

具身人工智能中的仿真到现实适配指的是将在仿真环境(网络空间)中习得的能力或行为迁移到现实世界场景(物理世界)的过程。这包括验证并提升在仿真中开发的算法、模型和控制策略的有效性,以确保它们在物理环境中能够稳健且可靠地运行。要实现仿真到现实的适配,具身世界模型、数据收集与训练方法以及具身控制算法是三个关键组成部分。

7.1 世界模型

补充:世界模型是对环境进行感知和预测的模型,作用是为智能体决策提供输入,为后续行动规划提供 “认知依据”。

仿真到现实涉及创建与真实世界环境高度相似的基于仿真的世界模型。这些模型通过预测下一个状态来做出决策,并且是从零开始在物理世界数据上进行训练的,这与VLA模型不同,后者是在大规模数据集上进行预训练,再用真实世界数据进行微调。世界模型在自动驾驶、物体分类等结构化任务中效果显著,但不太适用于非结构化的复杂任务。

学习世界模型在物理模拟领域具有广阔前景。与传统模拟方法相比,它具有显著优势,例如能够在信息不完整的情况下对交互进行推理、满足实时计算需求,以及随着时间的推移提高预测精度。此类世界模型的预测能力至关重要,它能使机器人形成在人类世界中运作所必需的物理直觉。如图10所示,根据对世界环境的学习流程,这些模型可分为基于生成的方法、基于预测的方法和基于知识驱动的方法。

7.2 数据收集与训练

8 未来挑战

尽管具身智能取得了快速发展,但它仍面临一些挑战,同时也展现出令人振奋的未来发展方向。

高质量机器人数据集:获取足够的真实世界机器人数据仍是一项重大挑战。收集这类数据既耗时又耗费资源。仅依赖模拟数据会加剧模拟与现实之间的差距问题。创建多样化的真实世界机器人数据集需要各机构之间开展密切且广泛的合作。

长时任务执行:执行单一指令往往需要机器人完成长时任务,例如“打扫厨房”这样的指令,其中涉及整理物品、扫地、擦桌子等多项活动。成功完成此类任务需要机器人具备在较长时间内规划并执行一系列低级动作的能力。尽管当前的高级任务规划器已取得初步成功,但由于缺乏针对具身任务的优化,它们在多种场景中往往表现不足。要应对这一挑战,需要开发具备强大感知能力和丰富常识知识的高效规划器。为了平衡规划复杂性与实时适应性之间的权衡,我们可以结合用于高频监控的轻量级监控模块,以及两个用于较低频率的子任务和路径适应推理的适配器。

因果推理:现有的数据驱动型具身智能体基于内在的数据相关性做出决策。然而,这种方法无法让模型真正理解知识、行为和环境之间的因果关系,从而导致策略存在偏差。这使得它们难以在真实世界环境中实现稳健且可靠的运行。因此,具身智能体由世界知识驱动并具备自主因果推理能力至关重要。

统一评估基准:尽管存在众多用于评估低级控制策略的基准,但这些基准各有不同。

安全与隐私:具身智能体在敏感或私人空间部署时面临重大的安全挑战。这些智能体通常依赖大语言模型进行决策,这带来了新的漏洞。例如,大语言模型容易受到后门攻击,如词语注入、场景操纵和知识注入,这可能导致危险后果,比如自动驾驶汽车朝着障碍物加速,或者机器人执行危险动作。为了缓解这些风险,我们可以评估潜在的攻击向量并开发更强大的防御措施。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)