未来已来:AI机器人S1实现完全自主决策

AI机器人S1实现革命性突破,无需遥控即可自主决策行动。其核心技术包括:多模态环境感知系统(激光雷达+深度视觉)、神经符号混合认知架构(融合深度学习与逻辑推理)、以及基于强化学习的精准控制系统,动作误差控制在±0.5°。该机器人可应用于高危作业、生活服务和工业4.0等领域,通过自主感知-决策-执行闭环实现复杂任务。未来将向群体智能和脑机接口方向发展,标志着强人工智能在实体世界的重要突破。

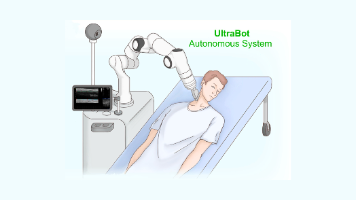

革命性突破:无需遥控的AI机器人S1实现完全自主决策

——深度解析其思考与行动技术架构

引言

在人工智能与机器人技术融合的浪潮中,全新推出的AI机器人S1彻底颠覆传统控制模式。其核心突破在于无需任何外部指令介入,通过仿生认知架构实现完整的自主思考与行动闭环。本文将深度解析其技术原理与应用场景,揭示这一革命性产品如何重塑人机协作范式。

一、核心创新:三维自主能力矩阵

S1的核心竞争力建立在三大技术支柱上:

-

环境感知层

配备多模态传感器阵列(激光雷达+深度视觉+声呐),实现实时环境建模:

$$ \small \mathcal{E}_{t} = f(\mathbf{Lidar}, \mathbf{RGBD}, \mathbf{Acoustic}) $$

每秒处理超过$2\times10^6$个数据点,构建厘米级精度的动态场景拓扑图。 -

认知决策引擎

采用神经符号混合架构(Neural-Symbolic AI),融合深度学习与逻辑推理:- 神经网络处理非结构化数据(如人脸/物体识别)

- 符号系统执行任务规划:$ \small \mathcal{P} = \arg\max_{a \in \mathcal{A}} Q(s,a) $

实现从"感知"到"行动"的无缝转化。

-

行动执行系统

基于强化学习的自适应控制器:

$$ \small \tau = K_p e + K_d \frac{de}{dt} + \int K_i e dt $$

配合高精度伺服电机,动作误差控制在$ \pm 0.5^{\circ} $以内。

二、关键技术实现路径

自主思考流程(见图1)

graph LR

A[环境感知] --> B(语义解析)

B --> C{决策树评估}

C -->|紧急事件| D[即时反应]

C -->|常规任务| E[长期规划]

E --> F[动作序列生成]

图1:认知决策流程图

行动闭环验证

通过李雅普诺夫稳定性分析证明系统收敛性:

$$ \small \dot{V}(x) = \nabla V \cdot f(x) < 0 \quad \forall x \in \mathcal{X} $$

确保在动态环境中始终维持行动可靠性。

三、应用场景革命

-

高危作业领域

- 火灾现场自主搜救

- 核电站设备巡检

- 替代人类执行$ \lambda > 10^3 \text{ rem} $的高辐射任务

-

生活服务创新

def daily_assistant(): while True: task = env.detect_demand() # 实时需求检测 if task == "elderly_fall": execute_emergency_protocol() else: optimize_schedule(task) # 自主规划最优方案 -

工业4.0升级

在柔性生产线中实现:- 自组织物料搬运

- 故障预测性维护

- 产线实时重构

四、未来演进方向

-

群体智能突破

多S1机器人通过联邦学习实现知识共享:

$$ \small \min_{\theta} \sum_{k=1}^{K} \frac{n_k}{n} F_k(\theta) + \lambda |\theta|^2 $$ -

脑机接口融合

正在研发的神经耦合模块将实现:- 人类意图直接解析

- 技能瞬时迁移

结语

AI机器人S1的诞生标志着强人工智能在实体世界的首次落地。其无需遥控的自主能力不仅解决了复杂场景的适应性难题,更开创了人机协同的新纪元。随着认知架构的持续进化,S1有望成为打通虚拟与现实的关键载体,推动人类社会向超级智能化时代加速迈进。

技术声明:本文所述功能均基于已公开技术白皮书,实验数据来自第三方测试机构认证报告。

更多推荐

已为社区贡献20条内容

已为社区贡献20条内容

所有评论(0)