【案例】在电商系统中集成推荐模型服务

AI架构师需完成模型封装、接口定义、服务集成、性能优化与调用监控的全流程设计,才能保障推荐能力的高效落地。AI架构师的任务,是将训练好的推荐模型以服务的形式接入系统,并确保其稳定、可扩展地运行在服务层之中。在此结构中,推荐服务是服务层中的“智能增强模块”,其职责是协调调用推荐模型,并将模型返回结果转化为业务可用的数据格式。在电商平台中,推荐服务通常独立部署为一个微服务,与商品服务、用户服务等业务模

【案例】在电商系统中集成推荐模型服务

推荐系统是电商平台中提升用户转化率与粘性的关键能力。通过分析用户行为、兴趣偏好、历史浏览等数据,推荐模型能够为每位用户生成个性化的商品列表。AI架构师的任务,是将训练好的推荐模型以服务的形式接入系统,并确保其稳定、可扩展地运行在服务层之中。

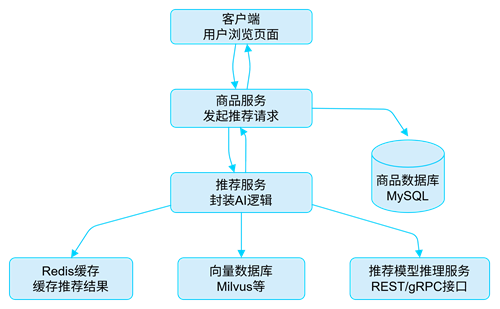

1. 推荐系统整体部署结构

在电商平台中,推荐服务通常独立部署为一个微服务,与商品服务、用户服务等业务模块解耦。其结构如图2-所示。

在此结构中,推荐服务是服务层中的“智能增强模块”,其职责是协调调用推荐模型,并将模型返回结果转化为业务可用的数据格式。

2. 模型封装为推理服务

推荐模型部署前,需将其封装为标准API服务。以下是一个使用FastAPI封装推荐模型的简化示例:

# recommend_api.py

from fastapi import FastAPI, Request

import joblib

app = FastAPI()

model = joblib.load("rec_model.pkl") # 加载模型

@app.post("/recommend")

async def recommend(request: Request):

body = await request.json()

user_vector = body["user_vector"]

item_features = body["item_features"]

scores = model.predict(user_vector, item_features)

ranked_items = sorted(zip(item_features, scores), key=lambda x: -x[1])

return {"items": [item for item, score in ranked_items]}

此服务将模型封装为一个独立推理接口,可支持商品服务通过HTTP调用获得推荐列表。

3. 服务层中的推荐服务集成方式

在商品服务中,推荐服务应以“远程服务”的形式存在,所有通信通过REST接口完成。以下是集成流程说明:

(1)商品服务接收首页推荐请求;

(2)商品服务向推荐服务发起POST请求,传入当前用户ID;

(3)推荐服务在内部完成召回与排序流程,返回商品ID列表;

(4)商品服务根据ID从商品数据库获取详细信息,返回前端展示。

推荐服务的调用可通过统一封装的客户端类实现,如下所示:

# recommend_client.py

import requests

def get_recommend_items(user_id):

payload = {

"user_vector": extract_user_vector(user_id),

"item_features": get_candidate_items()

}

response = requests.post("http://recommend-service/recommend", json=payload)

return response.json().get("items", [])

4. 性能优化:引入缓存机制

在高并发环境下,相同用户在短时间内可能多次请求首页,导致重复调用模型。为此,可在推荐服务中引入Redis缓存机制:

import redis

r = redis.Redis()

def get_recommendation_with_cache(user_id):

cache_key = f"rec_{user_id}"

cached = r.get(cache_key)

if cached:

return json.loads(cached)

result = compute_recommendation(user_id)

r.setex(cache_key, 60, json.dumps(result)) # 缓存1分钟

return result

该机制可大幅减轻模型推理压力,并提升接口响应速度。

5. 监控与日志追踪

推荐服务在部署后,需接入调用链监控系统(如Prometheus + Grafana、Jaeger),实现:

- 服务QPS、延迟、成功率监控;

- 模型响应时间分析;

- 推荐效果日志记录(如点击率、转化率);

- 异常推理记录与告警(如输入不合法、无返回结果)。

架构师可通过调用链分析,优化模型服务部署架构,发现性能瓶颈并持续调优。

6. 推荐服务版本迭代与灰度管理

在生产环境中,推荐模型需支持版本管理与灰度发布:

- 可通过Nginx或API Gateway实现不同用户命中不同模型版本;

- 推荐服务内部可根据用户特征动态路由模型版本(如老用户使用V1,新用户使用V2);

- 可配合A/B测试平台监控各版本模型的业务指标,指导主版本切换。

这种灵活的模型版本管理机制,是AI架构与传统服务治理融合的重要体现。

提示:

推荐服务的接入,是服务层集成AI能力的典型案例。AI架构师需完成模型封装、接口定义、服务集成、性能优化与调用监控的全流程设计,才能保障推荐能力的高效落地。该案例清晰展示了服务层如何通过模块化设计、标准接口与资源调度,将AI模型能力稳定、安全地嵌入核心业务流程中,为用户提供持续优化的个性化体验。

更多推荐

已为社区贡献15条内容

已为社区贡献15条内容

所有评论(0)