用 Ollama 本地运行 OpenAI gpt-oss 官方完整教程,大模型入门到精通,收藏这篇就足够了!

手把手教你使用 Ollama 本地部署 gpt-oss-20b 或 gpt-oss-120b,实现离线对话、API 调用,甚至连接到 Agents SDK。

想在自己的macbook上运行 OpenAI 开源模型gpt-oss吗?前几天,OpenAI出了一个教程,手把手教你使用 Ollama 本地部署 gpt-oss-20b 或 gpt-oss-120b,实现离线对话、API 调用,甚至连接到 Agents SDK。

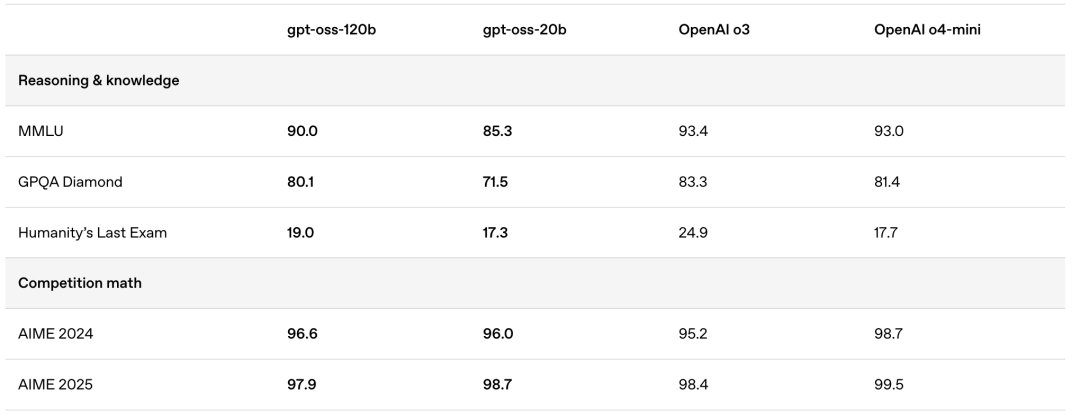

模型版本和硬件要求

Ollama 支持 gpt-oss 的两个版本:

gpt-oss-20b

- 小模型版本

- 建议配置:≥16GB VRAM 或统一内存

- 适用于:高端消费级显卡或 Apple Silicon Mac

gpt-oss-120b

- 完整大模型版本

- 建议配置:≥60GB VRAM 或统一内存

- 适用于:多 GPU 或高配工作站

注意事项:

- 这些模型默认采用 MXFP4 量化,目前没有其他量化选项

- 显存不足时可以 offload 到 CPU,但运行速度会变慢

关于MXFP4 量化技术

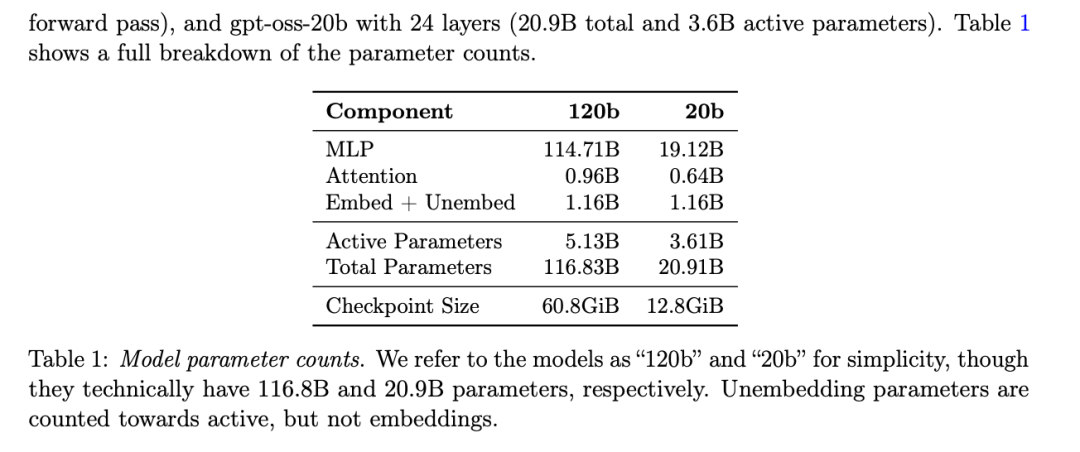

OpenAI 为了让 gpt-oss 能在消费级硬件上运行,使用了先进的量化技术。这些模型在后训练阶段,将混合专家(MoE)权重量化为 MXFP4 格式,每个参数仅需 4.25 位存储空间。

这个优化很关键:MoE 权重占总参数数量的 90% 以上。通过 MXFP4 量化,20B 模型能在 16GB 内存系统上运行,120B 模型可以适配单个 80GB GPU。

Ollama 原生支持 MXFP4 格式,无需额外量化或转换步骤。为了支持这种格式,Ollama 团队为其新引擎开发了专门的内核,并与 OpenAI 合作进行基准测试,确保实现质量与官方参考实现一致。

安装和设置

- 安装或者升级最新版本 Ollama → 下载链接[1]

- 拉取模型:

# 20B 版本

ollama pull gpt-oss:20b

# 120B 版本

ollama pull gpt-oss:120b

开始对话

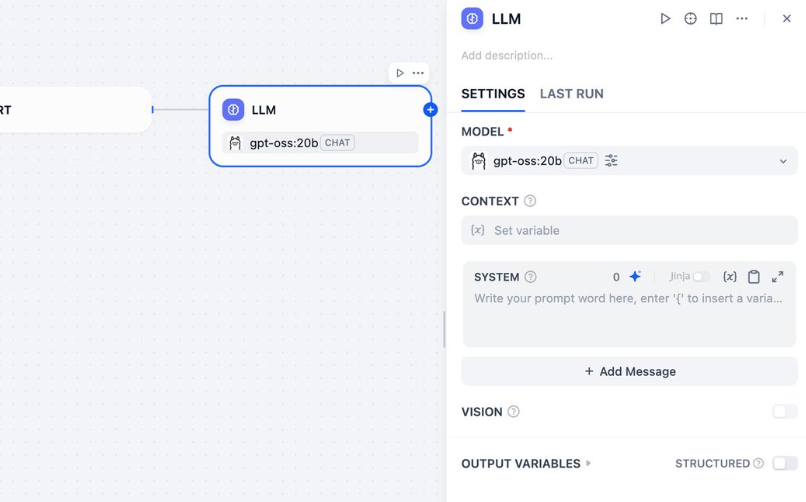

可以在应用或终端启动对话使用ollama UI,甚至可以直接配置到Dify等产品上:

ollama run gpt-oss:20b

Ollama 内置了聊天模板,模仿 OpenAI harmony 格式。输入消息就能开始对话。

通过 API 使用

Ollama 提供兼容 Chat Completions 的 API,所以你可以直接用 OpenAI SDK,几乎不需要修改代码。Python 示例:

from openai import OpenAI

client = OpenAI(

base_url="http://localhost:11434/v1", # 本地 Ollama API

api_key="ollama"# 随便填个 key

)

response = client.chat.completions.create(

model="gpt-oss:20b",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Explain what MXFP4 quantization is."}

]

)

print(response.choices[0].message.content)

如果你之前用过 OpenAI SDK,这个过程会非常熟悉。

你也可以直接使用 Ollama 的 Python[2] 或 JavaScript[3] SDK。

工具调用功能

Ollama 支持:

- 调用函数

- 内置浏览器工具(在应用中)

通过 Chat Completions 调用函数的示例:

tools = [

{

"type": "function",

"function": {

"name": "get_weather",

"description": "Get current weather in a given city",

"parameters": {

"type": "object",

"properties": {"city": {"type": "string"}},

"required": ["city"]

},

},

}

]

response = client.chat.completions.create(

model="gpt-oss:20b",

messages=[{"role": "user", "content": "What's the weather in Berlin right now?"}],

tools=tools

)

print(response.choices[0].message)

因为模型可以在推理链(CoT)中执行工具调用,所以需要将 API 返回的推理过程传递给后续的工具调用,直到模型得出最终答案。

Responses API 支持

Ollama 目前还不原生支持 Responses API。

如果需要使用 Responses API,可以通过 Hugging Face 的 Responses.js 代理[4] 将 Chat Completions 转换为 Responses API。

对于基础使用场景,也可以运行我们的示例 Python 服务器,以 Ollama 作为后端[5]:

pip install gpt-oss

python -m gpt_oss.responses_api.serve \

--inference_backend=ollama \

--checkpoint gpt-oss:20b

与 Agents SDK 集成

想要在 OpenAI Agents SDK 中使用 gpt-oss?

两个 Agents SDK 都支持覆盖 OpenAI 基础客户端,指向 Ollama 的 Chat Completions 或你的 Responses.js 代理。或者,可以使用内置功能将 Agents SDK 对接第三方模型。

- Python: 使用 LiteLLM[6] 通过 LiteLLM 代理到 Ollama

- TypeScript: 使用 AI SDK[7] 配合 ollama adapter[8]

Python Agents SDK 使用 LiteLLM 的示例:

import asyncio

from agents import Agent, Runner, function_tool, set_tracing_disabled

from agents.extensions.models.litellm_model import LitellmModel

set_tracing_disabled(True)

@function_tool

defget_weather(city: str):

print(f"[debug] getting weather for {city}")

returnf"The weather in {city} is sunny."

asyncdefmain(model: str, api_key: str):

agent = Agent(

name="Assistant",

instructions="You only respond in haikus.",

model=LitellmModel(model="ollama/gpt-oss:120b", api_key=api_key),

tools=[get_weather],

)

result = await Runner.run(agent, "What's the weather in Tokyo?")

print(result.final_output)

if __name__ == "__main__":

asyncio.run(main())

现在你可以在本地完全离线运行 OpenAI 的模型,同时保持与现有代码的兼容性。

大模型算是目前当之无愧最火的一个方向了,算是新时代的风口!有小伙伴觉得,作为新领域、新方向人才需求必然相当大,与之相应的人才缺乏、人才竞争自然也会更少,那转行去做大模型是不是一个更好的选择呢?是不是更好就业呢?是不是就暂时能抵抗35岁中年危机呢?

答案当然是这样,大模型必然是新风口!

那如何学习大模型 ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。但是具体到个人,只能说是:

最先掌握AI的人,将会比较晚掌握AI的人有竞争优势。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

但现在很多想入行大模型的人苦于现在网上的大模型老课程老教材,学也不是不学也不是,基于此我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近100余次后,终于把整个AI大模型的学习路线完善出来!

在这个版本当中:

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型路线+学习教程已经给大家整理并打包分享出来, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、大模型经典书籍(免费分享)

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套大模型报告(免费分享)

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、大模型系列视频教程(免费分享)

四、2025最新大模型学习路线(免费分享)

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方二维码,免费领取

更多推荐

已为社区贡献212条内容

已为社区贡献212条内容

所有评论(0)