2025 小白也能搞定的 AI 私有化,3 分钟上手 DeepSeek 本地部署,大模型入门到精通,收藏这篇就足够了!

担心本地部署需要写代码?别慌!这两款工具全程无需一行代码,点击鼠标就能让 DeepSeek 在你电脑里 “安家”。

为什么需要 “专属” AI 助手?

每次用 AI 写方案都担心公司数据上传云端?想不想拥有一个断网也能用、完全听你指挥的 AI 助手?这些烦恼的根源,其实是你在用 “共享 AI”—— 就像共享单车,方便但不专属:别人抢着用就卡,数据要 “公开” 给平台,长期用还不划算。而本地部署的 DeepSeek,相当于给你 “买了一辆私家车”,完全自己说了算。

这些问题的根源,其实是你在用“共享AI”——就像共享单车,方便但不专属:别人抢着用就卡,数据要“公开”给平台,长期用还不划算。而本地部署的DeepSeek,相当于给你“买了一辆私家车”,完全自己说了算。

把 DeepSeek 部署在自己的电脑上,你会获得:

数据安全感:所有内容存在本地硬盘,不上传云端,比锁进保险柜还放心

响应速度快:本地处理数据,回复比云端快 3 倍,不用等 “服务器繁忙”

断网也能用:地下室、飞机上没信号?照样写报告、改代码

一次部署终身免费:不用按次付费,硬件成本摊下来比奶茶还便宜

我们就用普通电脑,3 分钟把这个 “专属 AI 助手” 请回家

两款 “傻瓜式” 工具,部署门槛降为 0

担心本地部署需要写代码?别慌!这两款工具全程无需一行代码,点击鼠标就能让 DeepSeek 在你电脑里 “安家”。

🔧 Ollama—— 你的 “AI 安装师傅”

把 Ollama 想象成上门安装师傅:官网下载对应系统版本(Windows/macOS/Linux),双击安装包一路 “下一步”,它会自动搭好 “AI 工作室”。安装后在命令框输入ollama run deepseek-r1:1.5b,就能召唤 DeepSeek 模型。

Ollama核心优势

✅ 全平台支持

✅ 自动配置环境,新手无需懂技术

✅ 1.5B模型仅占1.1GB,老旧电脑也能跑

💬 Chatbox—— 你的 “AI 聊天窗口”

Chatbox 是可视化对话界面,官网下载后 3 步绑定 Ollama:选 “模型提供方” 为 Ollama→选 “deepseek-r1:1.5b”→点保存。界面和微信一样简单,打字就能聊天,内容全程存在本地。

3 步上手!比煮泡面还简单的部署教程

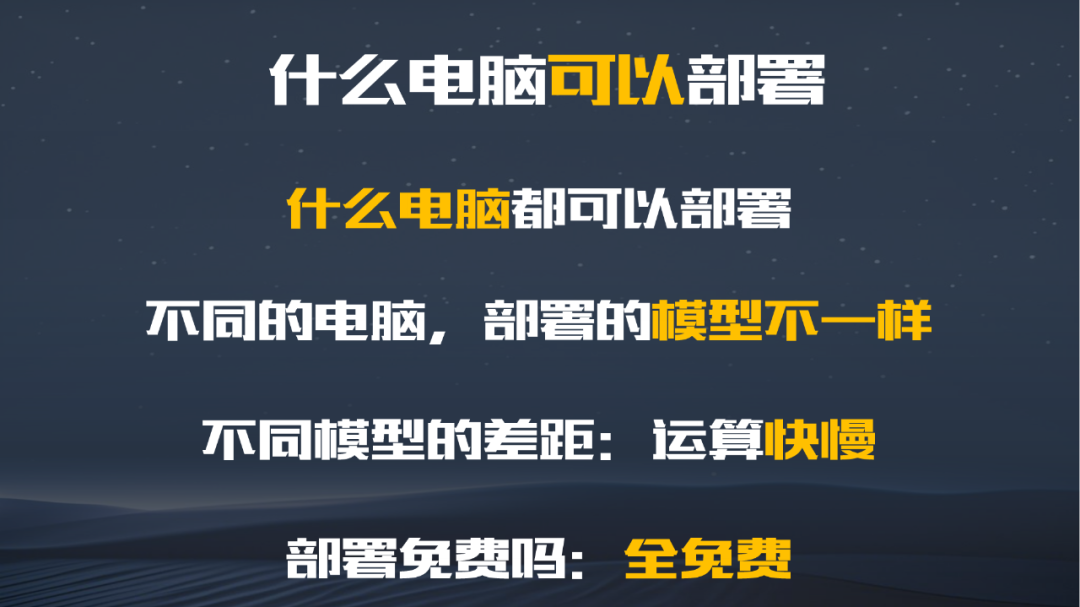

亲测 2018 年老笔记本(i5+8G 内存)都能流畅运行,1.5B 模型手机也能带得动,3 步搞定:

第一步:装 Ollama,像装微信一样简单

访问 Ollama 官网下载对应系统版本,双击安装包一路 “下一步”,自动配置好环境。

第二步:复制 1 行代码,召唤 AI

打开 “命令提示符”(Windows 搜 cmd,Mac/Linux 搜终端),粘贴代码:

bash

ollama run deepseek-r1:1.5b

按回车后自动下载模型,进度条走完即成功(1.5B 模型约 1.1GB,5 分钟下完)。

第三步:30 秒配 Chatbox,开聊!

下载 Chatbox,设置里选 Ollama→选 deepseek-r1:1.5b→保存。输入问题就能聊,响应速度比网页版快 3 倍。

新手必看:1.5B模型适合入门,占1.1GB空间;电脑配置高可试7B版本,性能更强但需8G以上内存。

本地部署的 4 个 “真香” 瞬间,用了就回不去

- 隐私安全感:客户合同锁得比保险柜还牢

处理商业合同、工资表时,数据全程在本地硬盘,不上传云端。财务小姐姐直接丢报销单给 AI 算税,再也不纠结 “数据会不会被存下来”。

- 离线自由:出差没网照样改代码写报告

酒店 WiFi 连不上?高铁没信号?打开电脑就能用 AI 写周报、改 Python 代码,深山老林里都能办公,彻底告别 “服务器繁忙”。

- 速度起飞:回复快到以为按了快进键

本地 GPU 直接运算,复杂代码解释、长文档摘要秒出结果,比云端快 3-5 倍,连加载动画都来不及出现。

- 省 money:一年省出 36 杯奶茶钱

不用按次付 API 费,每天聊 100 次,一年省几百块。硬件成本摊 3 年,每天不到一杯可乐钱,高频使用者血赚。

总结:从“怕数据泄露”到“随便聊”,从“等服务器”到“秒回”,本地部署把AI变成“私人助理”。这波“真香”体验,试过就回不去!

现在就行动,让 AI 真正 “为你所用”

别再羡慕别人的 AI 助手了!3 分钟让 DeepSeek 在你电脑安家,数据安全、离线可用、速度飞起。现在就动手:

按教程 3 步部署,开启专属 AI 之旅。

记住:真正的 AI 自由,从 “数据由你说了算” 开始—— 你的专属 DeepSeek,等你唤醒!

如果还需要详细一点的教程,点赞关注公众号对话框回复《一键部署》获取教程链接,包括DEEPSEEK提示指令

大模型算是目前当之无愧最火的一个方向了,算是新时代的风口!有小伙伴觉得,作为新领域、新方向人才需求必然相当大,与之相应的人才缺乏、人才竞争自然也会更少,那转行去做大模型是不是一个更好的选择呢?是不是更好就业呢?是不是就暂时能抵抗35岁中年危机呢?

答案当然是这样,大模型必然是新风口!

那如何学习大模型 ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。但是具体到个人,只能说是:

最先掌握AI的人,将会比较晚掌握AI的人有竞争优势。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

但现在很多想入行大模型的人苦于现在网上的大模型老课程老教材,学也不是不学也不是,基于此我用做产品的心态来打磨这份大模型教程,深挖痛点并持续修改了近100余次后,终于把整个AI大模型的学习路线完善出来!

在这个版本当中:

您只需要听我讲,跟着我做即可,为了让学习的道路变得更简单,这份大模型路线+学习教程已经给大家整理并打包分享出来, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

一、大模型经典书籍(免费分享)

AI大模型已经成为了当今科技领域的一大热点,那以下这些大模型书籍就是非常不错的学习资源。

二、640套大模型报告(免费分享)

这套包含640份报告的合集,涵盖了大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(几乎涵盖所有行业)

三、大模型系列视频教程(免费分享)

四、2025最新大模型学习路线(免费分享)

我们把学习路线分成L1到L4四个阶段,一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方二维码,免费领取

更多推荐

已为社区贡献220条内容

已为社区贡献220条内容

所有评论(0)