【ComfyUI】区域件控制生成 主体位置一致性

本文介绍了一个基于DreamShaper核心模型的ComfyUI工作流,通过多阶段采样与区域控制技术实现高质量图像生成。该工作流包含模型加载、提示词解析、潜空间生成与解码等环节,采用两阶段KSampler采样机制,先构建基础画面再精修细节,确保构图一致性与精细度。应用场景涵盖风景设计、艺术创作和可视化展示,支持局部区域控制与整体优化。配套提供了相关开发教程和资源链接,为AIGC爱好者提供实用参考。

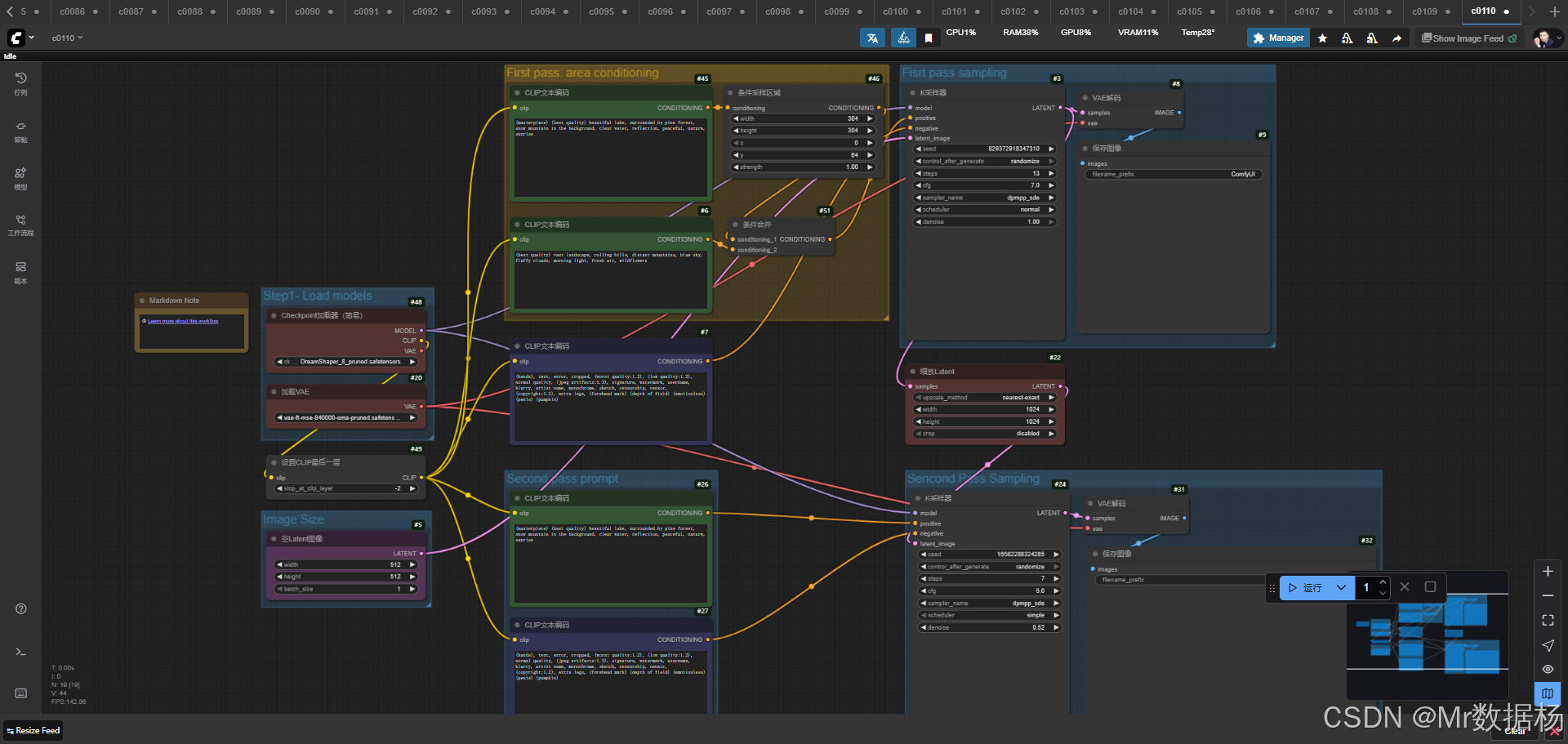

今天给大家演示一个基于 DreamShaper 核心模型 的 ComfyUI 工作流。这个工作流结合了多阶段采样与区域控制技术,能够在生成图像时保持场景构图的一致性,同时通过二次采样与放大处理来提升画面的精细度和整体效果。整个流程不仅涵盖了模型加载、正反向提示词的编码与合并,还通过 VAE 的编解码完成从潜空间到最终图像的转化,让读者能直观理解完整的生成逻辑与应用潜力。

工作流介绍

该工作流的设计以 DreamShaper_8_pruned 模型为核心,通过加载配套的 VAE 模型来优化潜空间与图像之间的映射关系。在核心模型的支撑下,工作流利用 CLIP 编码器进行提示词的正负向解析,再结合条件控制与区域约束,让图像生成过程更具可控性。通过两阶段的 KSampler 采样机制,第一阶段完成初步画面构建,第二阶段在放大后的潜空间基础上进行进一步精修,从而兼顾画面完整性与细节表现。核心节点的协同作用,使得整个流程具备高效、灵活与稳定的特征。

核心模型

在核心模型部分,工作流选用了 DreamShaper 模型作为生成主体,它具备良好的风格泛化能力和细节表现力。同时,配合使用的 VAE 模型 vae-ft-mse-840000-ema-pruned 则在潜空间解码方面提供了高质量的支持,确保图像还原过程中细节与色彩更加自然。模型的组合既保证了生成结果的艺术性,也提升了结构的稳定性。

| 模型名称 | 说明 |

|---|---|

| DreamShaper_8_pruned.safetensors | 核心生成模型,负责图像的整体构建与风格呈现 |

| vae-ft-mse-840000-ema-pruned.safetensors | VAE 模型,用于潜空间和图像的高质量映射解码 |

Node节点

节点的构建围绕模型加载、提示词解析、潜空间生成与解码展开。CheckpointLoaderSimple 和 VAELoader 分别完成主模型与 VAE 的加载,CLIPTextEncode 节点将正反向提示词转化为可控条件输入,ConditioningCombine 与 ConditioningSetArea 则进一步实现条件信息的融合与局部区域的精细控制。KSampler 节点通过两阶段的采样过程生成潜空间,LatentUpscale 节点则提升图像的分辨率,最后由 VAEDecode 与 SaveImage 输出最终图像。整体节点分工清晰,形成了一个高效的生成闭环。

| 节点名称 | 说明 |

|---|---|

| CheckpointLoaderSimple | 加载核心模型 DreamShaper 并提供 CLIP 与 VAE 支持 |

| VAELoader | 加载指定 VAE 模型以优化潜空间解码 |

| CLIPTextEncode | 将文本提示词转化为条件信息,支持正向与负向输入 |

| ConditioningSetArea | 为提示词条件设定作用区域,提升局部一致性 |

| ConditioningCombine | 融合多路条件信息,用于更复杂的生成控制 |

| KSampler | 进行潜空间采样,支持多阶段生成优化 |

| LatentUpscale | 对潜空间图像进行放大,为二次采样提供更大细节空间 |

| VAEDecode | 将潜空间转换为可见图像输出 |

| SaveImage | 保存生成的最终图像 |

工作流程

该工作流的流程结构清晰,分为模型加载、初步采样、放大处理与二次采样四个阶段。首先通过 CheckpointLoaderSimple 与 VAELoader 节点完成模型与 VAE 的加载,同时生成空的潜空间作为基础画布。接着通过 CLIPTextEncode 与 ConditioningSetArea 进行正反向提示词的条件解析与区域控制,在 ConditioningCombine 的作用下实现多条件的融合。随后,KSampler 节点进行第一次采样,生成初步潜空间结果,并经由 VAEDecode 输出图像进行预览。为了进一步提升分辨率和细节表现,LatentUpscale 将潜空间放大,再经由第二个 KSampler 完成二次精修采样,最终通过 VAEDecode 和 SaveImage 输出高质量的成品图像。整个流程兼顾速度与质量,在保持一致性的同时增强了画面的丰富度与自然感。

| 流程序号 | 流程阶段 | 工作描述 | 使用节点 |

|---|---|---|---|

| 1 | 模型加载 | 加载核心模型与 VAE 模型,准备潜空间画布 | CheckpointLoaderSimple、VAELoader、EmptyLatentImage |

| 2 | 条件设定 | 将正反向提示词转化为条件,并结合区域控制进行解析 | CLIPTextEncode、ConditioningSetArea、ConditioningCombine |

| 3 | 初步采样 | 基于条件输入对潜空间进行第一次采样并生成初始图像 | KSampler、VAEDecode、SaveImage |

| 4 | 放大与二次采样 | 对潜空间图像进行放大后进行二次采样,提升细节与一致性 | LatentUpscale、KSampler、VAEDecode、SaveImage |

应用场景

该工作流在实际应用中具有广泛的适配性。它能够在生成自然风景、写实画面或艺术风格化作品时保持整体构图的一致性,适合需要高质量场景生成的设计师、插画师以及内容创作者。通过区域控制与二次采样机制,用户不仅能快速得到结构完整的图像,还能在关键区域进行细节增强,实现局部与整体的和谐统一。无论是用于数字艺术创作、概念设计,还是内容演示与可视化展示,该流程都能提供稳定且高效的生成效果,为用户带来可靠的创作工具支持。

| 应用场景 | 使用目标 | 典型用户 | 展示内容 | 实现效果 |

|---|---|---|---|---|

| 自然风景与概念设计 | 生成构图完整、风格统一的场景图像 | 插画师、概念设计师 | 山川湖泊、森林、城市风光等 | 保持画面整体一致性与细节丰富性 |

| 艺术风格化创作 | 在基础图像上进行艺术化再创作 | 数字艺术创作者 | 风格化插画、艺术构图 | 增强细节表现,提升艺术风格还原度 |

| 可视化展示与内容演示 | 快速生成高质量图像用于展示 | 内容创作者、演示人员 | 演示用图、教程示例 | 高效生成,画面自然协调 |

开发与应用

更多 AIGC 与 ComfyUI工作流 相关研究学习内容请查阅:

更多内容桌面应用开发和学习文档请查阅:

AIGC工具平台Tauri+Django环境开发,支持局域网使用

AIGC工具平台Tauri+Django常见错误与解决办法

AIGC工具平台Tauri+Django内容生产介绍和使用

AIGC工具平台Tauri+Django开源ComfyUI项目介绍和使用

AIGC工具平台Tauri+Django开源git项目介绍和使用

更多推荐

已为社区贡献13条内容

已为社区贡献13条内容

所有评论(0)