【大模型】我花了10年,总结出这份「原理拆解与表达」黑手册!附独家思维导图模板,从此告别死记硬背,效率飙升300%。

《论文原理:学术研究的灵魂与脊梁》摘要 论文质量的核心在于原理运用——它不仅是现象解释的"万能说明书",更是构建研究逻辑的"乐高积木"。原理包含解释性、预测性等四种类型,通过六步阅读法(定位→梳理→拆解→验证→联系→记录)可深度掌握。写作时需完成三步骤:确立关键概念、评估相关原理、展示应用创新,可复用成熟理论或跨领域拼接。优秀原理框架需匹配研究方法、明确理论

你是否也正在经历这种绝望?

- 读顶尖论文时,每个字都认识,但连在一起就不知道作者到底想干什么,核心逻辑支离破碎?

- 自己做研究时,感觉想法很好,但一落笔就变成一盘散沙,被审稿人痛批“缺乏理论支撑”?

- 拼命堆砌实验数据,却根本无法形成一条强有力的论证链条,结论显得苍白无力?

💡 停!这一切的根源,都是因为你忽略了论文真正的“灵魂”——原理!

它绝不是引言里一段可有可无的“背景介绍”,而是你整个研究的****大脑和脊梁**!** 是你用来降维打击审稿人和读者的最强武器!

Part 1

原理阅读方法

原理的定义与核心要素

-

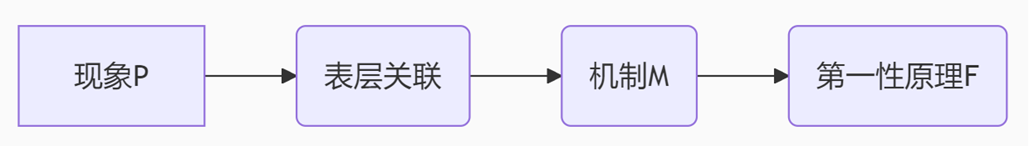

本质理解:原理是一套看透现象、猜透趋势的 “规律总结”,堪称看懂世界的 “万能说明书”,其形成目的是解释、预测和理解现象,甚至挑战和扩展现有知识。

-

学术定义:原理是一组相互关联的结构(概念)、定义和命题,通过说明变量之间的关系呈现现象的系统视图,核心是解释和预测现象。

-

三大核心要素:

-

-

由定义明确、相互关联的结构组成的命题;

-

阐述一组变量(结构)之间的相互关系;

-

能解释现象,并通过变量关系实现预测。

-

原理框架的本质与构建

-

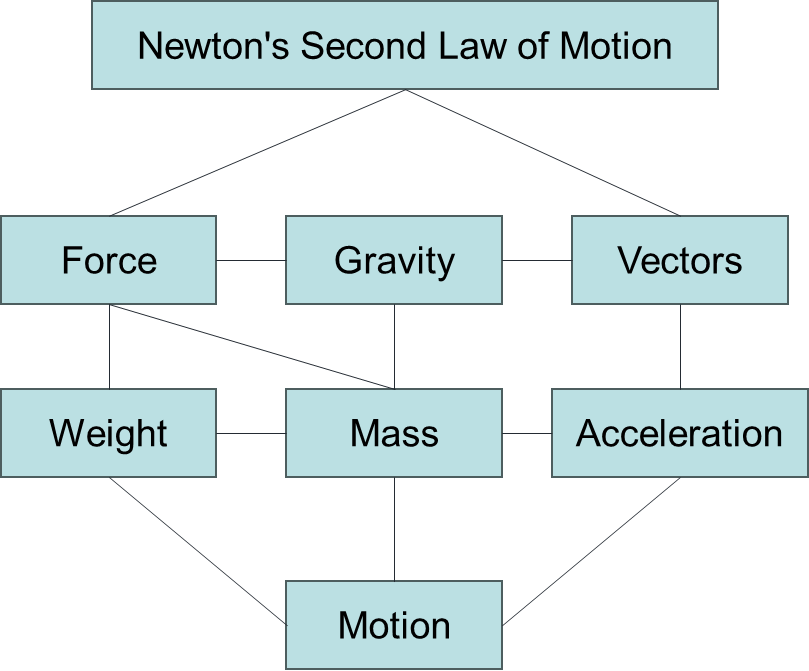

本质与作用:原理框架是研究者选择的指导性原理体系,通常源自经典理论(如集合论、进化论、牛顿运动定律等),通过提炼核心概念用于解释特定问题。

-

重要性:如同 “乐高说明书”,是论文的结构主线,帮助定位研究问题、选择工具和规划路线,需 “量身定制” 而非简单堆砌。

-

构建逻辑:从原理库中挑选适配研究问题的 “零件”,串联形成独特分析框架。例如研究 “小区便利店生意不均”,需结合区位原理(分析选址)、消费心理学(探究偏好)、供应链管理(理解进货效率)等。

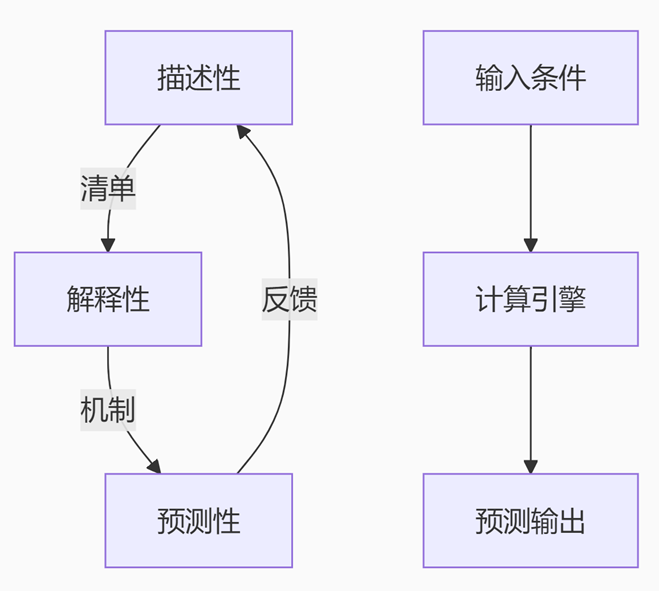

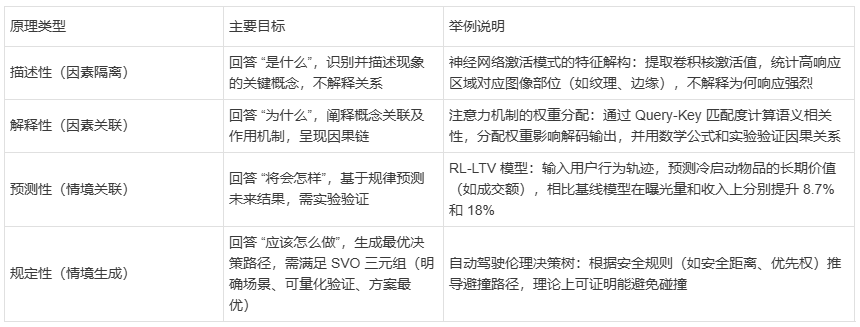

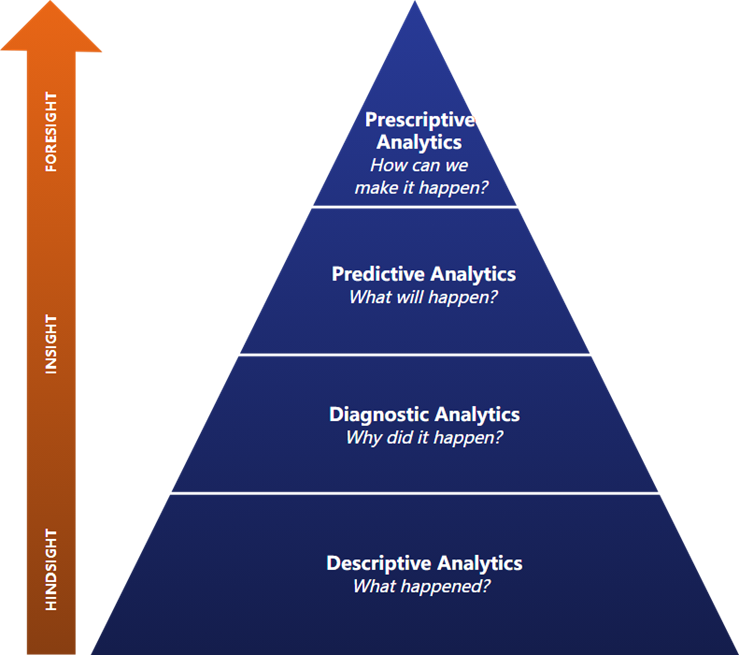

原理的四种类型及发展层次

-

四种类型(按目标划分):

原理发展的初级层次

解释性原理(Explanatory Theories)

—— 亦称“因素关联型原理”

预测性原理(Predictive Theories)

——亦称“情境关联型原理”

-

发展的四个层次:

1.因素隔离(描述现象);

2.因素关联(解释现象);

3.情境关联(预测两个现象之间的关系);

情境产生(控制现象和关系)。

-

应用选择:

-

-

界定问题:优先用描述性原理;

-

明确变量关系:加入解释性原理;

-

预测结果:引入预测性原理;

-

指导实践:设计规定性原理环节。

-

原理的核心功能

-

支撑研究设计:作为实验或模型的 “设计依据”,例如 “基于光合作用原理,设计人工光合系统”;

-

解释结果逻辑:作为 “结果→结论” 的 “桥梁”,例如 “根据酶促反应原理,解释温度升高导致反应速率先升后降的结果”;

-

体现学术贡献:

-

-

原理创新:提出新原理(如爱因斯坦提出 “相对论”);

-

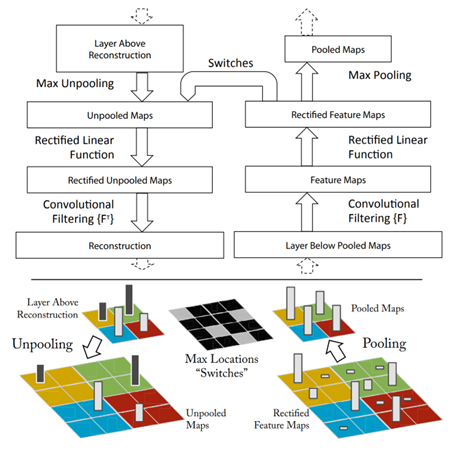

原理应用创新:将现有原理用于新领域(如将深度学习原理用于医学影像诊断)。

-

原理阅读的六步流程

步骤 1:定位原理(Locate)

-

位置分布:

-

原理论文:多见于引言(Introduction)、方法(Method);

-

实验论文:多见于方法(Method)、讨论(Discussion);

-

综述论文:多见于引言(Introduction)、文献回顾(Literature Review);

-

定位技巧:

-

找关键词如“principle”“mechanism”“theory”“basedon”“derive from”;

-

看逻辑衔接:通常位于 “研究问题” 与 “方法设计” 之间(如 “提出研究问题→介绍支撑原理→说明方法设计”);

-

查参考文献:原理部分常引用经典文献(如 “根据 Smith et al. (2000) 的信息不对称原理,我们...”)。

步骤 2:梳理逻辑框架(Frame)

-

操作:用流程图或思维导图梳理原理的逻辑链条(如 “输入→过程→输出”);

-

技巧:用 “5W1H 法” 拆解(以自注意力机制为例):

-

What(是什么):计算序列中元素间关联的机制(如句子中 “词” 与 “词” 的依赖关系);

-

Why(为什么需要):解决 RNN/CNN 的长距离依赖问题(RNN 处理长序列时梯度消失,CNN 感受野有限);

-

How(如何工作):通过 Query(查询)、Key(键)、Value(值)的交互,计算每个元素对其他元素的 “注意力权重”;

-

Who(谁提出):Vaswani 等人(2017),基于之前的注意力机制改进;

-

When(何时提出):2017 年,标志 “注意力时代” 开始;

-

Where(适用场景):序列到序列任务(机器翻译、文本摘要)、单序列任务(文本分类)、多模态任务(图像 captioning)。

步骤 3:拆解核心组件(Disassemble)

-

四维拆解法:

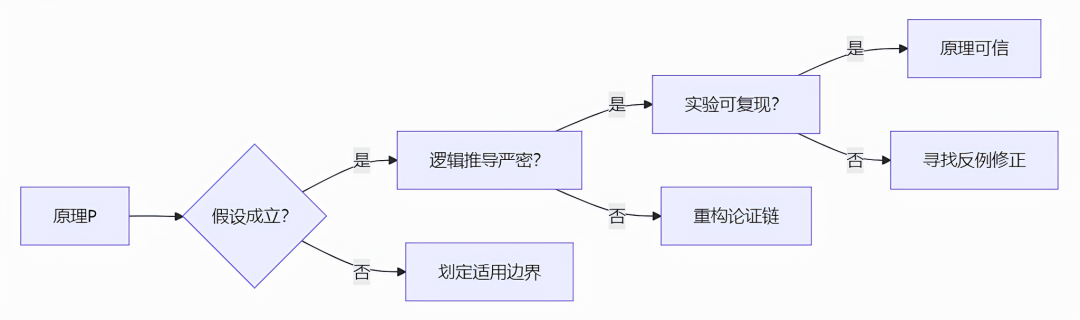

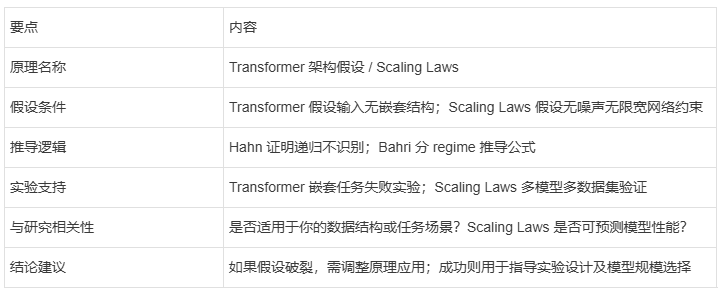

步骤 4:验证合理性(Verify)

-

假设条件:判断原理是否仅在特定条件下适用,越界是否可能失效。例如线性可分数据假设:若数据非线性可分(如 XOR 问题),依赖该假设的算法将永不收敛;

-

逻辑推导:跟踪 “定义→假设→推导→结论” 的逻辑链,检查公式连贯性、每一步依据(是否基于公认定律)、是否有跳跃或不当近似;

-

实验支持:评估实验是否充足。例如 2020 年 GPT-3 因未验证长文本连贯性,生成 500 + 单词后逻辑崩溃,后通过人类反馈强化学习(RLHF)改进。

步骤 5:联系应用(Relate)

-

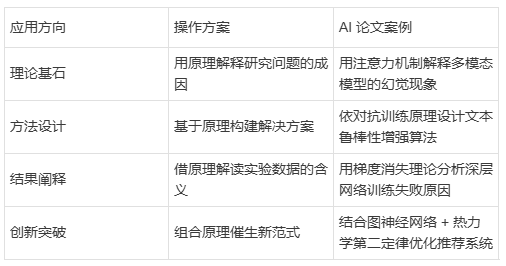

思考 “原理如何支撑研究”,应用方向包括:

步骤 6:记录要点(Record)

-

为每个原理记录以下内容,便于后续读写:

批判性阅读:评估原理的合理性与局限性

-

评估合理性:

-

-

假设条件是否符合研究场景(如 Transformer 假设输入适应自注意力机制,但若处理递归嵌套结构则不成立);

-

逻辑推导是否有漏洞(如 “从 A→B 和 B→C,能否推出 A→C?”);

-

实验支持是否充分(仅 1 项实验支持的原理可靠性低);

-

应用效果是否一致(不同研究中效果是否稳定,如《Scaling Laws Do Not Scale》指出部分场景下模型性能随规模下降)、;

-

-

识别局限性(常见类型):

-

-

适用场景局限:如 Transformer 对复杂递归结构识别无效;

-

假设条件局限:如信息不对称理论在信息高度对称场景不适用;

-

精度局限:如 Transformer 处理极长文本时,注意力机制复杂度呈二次增长,导致效率瓶颈。

-

Part 2

原理阅读示例

(以 Diffusion 模型为例)

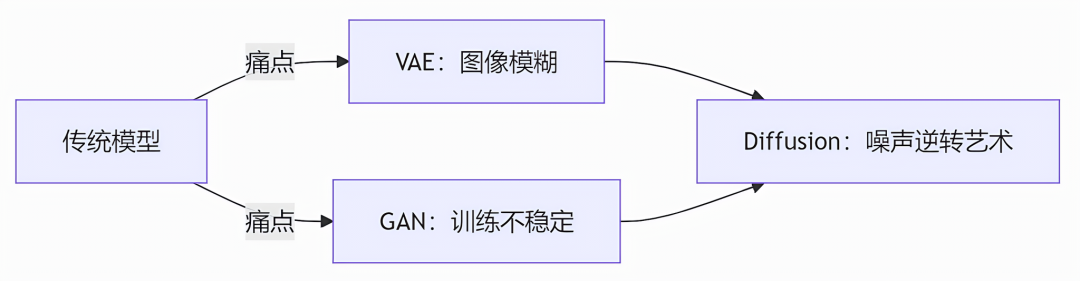

Diffusion 模型的核心思想

-

基本逻辑:通过逐渐添加高斯噪声将数据转换为近似纯噪声(前向扩散),再学习逆转该过程,将噪声逐步恢复成新数据样本;

-

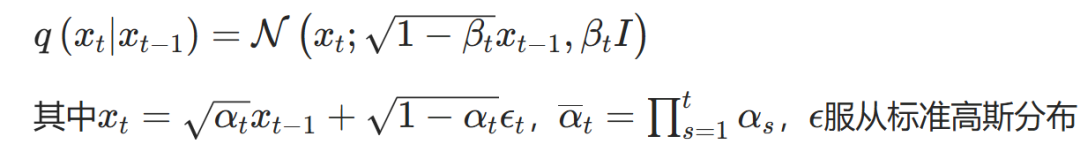

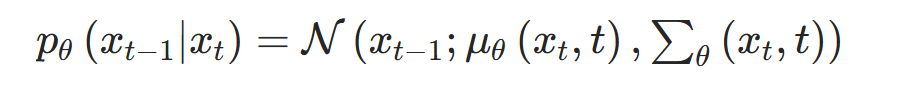

前向扩散公式:

-

反向扩散公式:

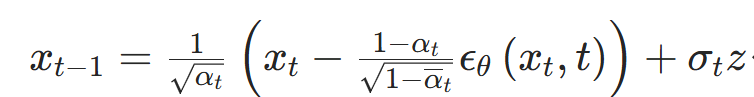

训练目标是使反向扩散生成的样本分布接近原始数据分布,采样公式为:

Diffusion 模型的优势

-

生成质量高:能生成高质量、高分辨率图像,视觉效果出色;

-

训练稳定性好:相较于 GAN,训练过程更稳定,不易出现模式坍塌;

-

理论基础扎实:来源于非平衡热力学,具有良好的理论特性。

Diffusion 模型的发展历程

-

理论奠基期(2015-2019):2015 年首次提出基于扩散过程的生成模型框架,后续论文提出简洁算法并证明图像生成优越性;

-

应用爆发期(2022-2023):Stable Diffusion 系列、DALL・E 系列、SoRA 系列;

-

多模态统一期(2024-):AlphaFold 3(生成 2.6 亿 + 蛋白质复合物)、GenAI OS(统一处理文本 / 图像 / 音频 / 3D)。

Part 3

原理写作技巧

确立理论框架的三个步骤

步骤 1:确定关键概念

-

从研究问题中提取核心术语(如研究问题 “如何改进 Transformer 架构以增强其在小样本学习场景下的泛化性能?” 的核心概念:Transformer 架构、小样本学习、泛化能力、训练稳定性);

-

明确界定采用的定义版本:引用经典定义(如 Vapnik 对泛化的定义),或说明在研究中的具体含义(如 “泛化指在全新类别上保持 90% 以上准确率”);

步骤 2:评估和解释相关原理

-

通过文献综述分析关键概念的理论来源,比较不同理论的关系、差异和适用性(如研究 “提升深度强化学习中策略优化的稳定性”,需分析 “策略梯度”“收敛性”“泛化能力” 在各算法中的定义与差异);

-

明确选择依据:说明为何选用某理论(适配模型设计、训练目标、实验环境等),例如 “结合结构风险最小化(统计学习)+ 策略梯度估计误差分析(RL 原理),构建新的损失函数设计思路”;

步骤 3:展示原理的应用与推进

-

说明如何利用现有理论,包括:

-

用现有理论作为解释结果的基础;

-

测试理论在新场景下是否成立;

-

批评或挑战理论;

-

以新方式组合不同理论;

-

注意:需明确研究的潜在假设,避免 AI 生成文本抄袭(如 ChatGPT 输出可能被检测)。

理论框架的两种构建方式

方式一:复用成熟理论(迁移应用)

-

选用已有成熟理论,换角度解决新问题;

-

举例:

-

用最优化理论(原用于凸优化)分析深度网络的训练稳定性,借动量方法、Adam 改进梯度爆炸 / 消失问题;

-

用信息瓶颈理论(最初用于压缩编码)解释深层神经网络中间层的特征提取能力;

方式二:跨领域理论拼接(组合创新)

-

针对复杂问题,组合多个理论提供全新视角;

-

举例(研究 “如何设计更有效的深度强化学习算法”):

-

强化学习理论:提供基本决策框架;

-

图优化理论:改进策略网络的训练效率;

-

控制理论:分析策略收敛的稳定性;

-

博弈论:在多智能体系统中分析策略交互。

原理框架构建的四步流程

-

步骤 1:明确核心问题:用 “5W1H” 锁定目标,避免偏离(如研究火锅店就不涉及其他餐饮类型);

-

步骤 2:选取原理 “积木”:遵循相关性、适配性、新鲜感原则,核心原理 1-2 个即可,不生搬硬套无关原理;

-

步骤 3:绘制框架地图:按 “文献综述(前人研究)→原理框架(ABC 原理)→研究方法(如问卷调研)→结果→结论” 逻辑梳理;

-

步骤 4:填充内容并检查:往框架模块中填具体内容,确保变量定义清晰。

原理写作的加分技巧

-

通俗表达:避免堆砌术语,如将 “基于结构风险最小化原理建模” 改为 “用‘模型复杂度越高越容易过拟合’的思路建模”;

-

时态正确:理论描述用现在时(如 “信息瓶颈理论认为,模型应该保留最相关的信息”);

-

明确理论来源:显示文献阅读基础(如 “参考 Goodfellow 提出的生成对抗网络(GAN)原理,用于图像生成的结构设计”);

-

说明选择依据:不仅说选了什么,还说没选什么及原因(如 “未采用强化学习中的 Actor-Critic 框架,因它更适合持续反馈任务,不适合单步预测场景”);

-

理论与方法匹配:框架需服务于研究方法(如 “采用对抗训练实验,是为了验证‘扰动越大,模型越容易崩’的假设”);

-

坦诚说明局限:增强可信度(如 “这个理论框架没考虑多智能体间的通信开销,可能影响复杂场景下的性能”)。

图表辅助呈现(类型与适用场景)

-

图表类型及应用:

-

注意事项:

-

-

图要简洁,控制在 1 页内呈现逻辑核心;

-

可在图下方加注 “引用” 或 “理论来源”,体现依据。

-

原理是论文的 “灵魂”,无论是阅读时的逻辑拆解,还是写作时的框架构建,都需要结合具体案例反复实践。掌握这些技巧,能让你在学术研究中更精准地把握核心逻辑,让研究论证更具说服力。

更多推荐

已为社区贡献30条内容

已为社区贡献30条内容

所有评论(0)