Agentic AI提示优化必学:提示工程架构师总结的7个“精准描述”技巧,AI不跑偏!

传统prompt是“任务指令”,而Agentic AI的prompt是智能体的“宪法”目标(Goal):智能体要“做什么”(不是“帮我写文章”,而是“写一篇面向中级开发者的Agentic AI入门文,核心是用3个案例讲清OODA环”);约束(Constraint):智能体“不能做什么”(如“不能承诺未授权的退款”);状态(State):智能体需要“关注什么”(如“用户过去30天的浏览记录”);行动

Agentic AI提示优化终极指南:架构师总结的7个“精准描述”技巧,让自主智能体绝不跑偏

元数据框架

- 标题:Agentic AI提示优化终极指南:架构师总结的7个“精准描述”技巧,让自主智能体绝不跑偏

- 关键词:Agentic AI、提示工程、自主智能体、行为引导、精准描述、反馈闭环、目标对齐

- 摘要:Agentic AI(自主智能体)的核心是感知-决策-行动-反馈的闭环能力,但其“自主性”也带来了传统prompt工程无法解决的挑战——如何让智能体“不跑偏”?本文结合架构师的一线经验与第一性原理分析,提炼出7个精准描述技巧:从目标的“原子化层级”到行为的“场景化约束”,从状态的“粒度校准”到反馈的“量化闭环”,覆盖智能体决策的全流程。每个技巧均配套理论推导、代码实现与真实案例,帮你从“拍脑袋写prompt”升级为“用工程化思维设计智能体规则”。

1. 概念基础:为什么Agentic AI需要“精准描述”?

要理解Agentic AI的prompt优化逻辑,必须先明确其与传统AI的本质区别——自主性。

1.1 Agentic AI vs 传统AI:从“输入输出”到“闭环决策”

传统AI(如ChatGPT的基础对话模式)是被动响应型:输入prompt→输出结果,无自主行动能力。而Agentic AI(如AutoGPT、LangChain Agent)是主动决策型,遵循OODA环(Observe- Orient-Decide-Act,观察-调整-决策-行动)的闭环逻辑:

- 观察(Observe):感知环境状态(如用户历史对话、系统资源);

- 调整(Orient):结合自身规则(prompt定义的目标、约束)解读状态;

- 决策(Decide):从行动空间中选择最优策略;

- 行动(Act):执行决策(如调用工具、生成内容);

- 反馈(Feedback):收集结果并调整后续决策。

这种“自主性”让Agentic AI能解决复杂任务(如自动写代码、跨工具协作),但也带来了失控风险——若prompt无法精准定义“目标、约束、状态、行动”四大要素,智能体可能做出无意义的循环(如AutoGPT反复搜索同一关键词)或违反规则的行为(如擅自修改用户代码)。

1.2 prompt在Agentic AI中的角色:定义智能体的“核心规则”

传统prompt是“任务指令”,而Agentic AI的prompt是智能体的“宪法”——它需要明确:

- 目标(Goal):智能体要“做什么”(不是“帮我写文章”,而是“写一篇面向中级开发者的Agentic AI入门文,核心是用3个案例讲清OODA环”);

- 约束(Constraint):智能体“不能做什么”(如“不能承诺未授权的退款”);

- 状态(State):智能体需要“关注什么”(如“用户过去30天的浏览记录”);

- 行动(Action):智能体可以“怎么做”(如“优先检查代码语法错误”);

- 反馈(Feedback):智能体如何“调整自己”(如“评分≤3时要求用户补充问题细节”)。

简言之,Agentic AI的prompt优化,本质是用精准描述“填充”这五大要素,让智能体的决策逻辑“可预期、可控制”。

2. 理论框架:Agentic AI的决策模型与prompt的数学表达

要设计精准的prompt,需先从第一性原理拆解Agentic AI的决策模型。

2.1 决策模型的数学形式化

Agentic AI的决策可抽象为**马尔可夫决策过程(MDP)**的扩展:

M=(G,S,A,R,P) \mathcal{M} = (\mathcal{G}, \mathcal{S}, \mathcal{A}, \mathcal{R}, \mathcal{P}) M=(G,S,A,R,P)

- G\mathcal{G}G:目标函数(Goal Function)——智能体的核心任务(如“最大化用户满意度”);

- S\mathcal{S}S:状态空间(State Space)——智能体可感知的环境状态集合(如用户情绪、系统资源);

- A\mathcal{A}A:行动空间(Action Space)——智能体可执行的动作集合(如调用工具、生成回答);

- R\mathcal{R}R:奖励函数(Reward Function)——评估行动效果的量化指标(如用户评分、任务完成率);

- P\mathcal{P}P:转移概率(Transition Probability)——行动导致状态变化的概率(如“调用语法检查工具后,解决报错的概率是80%”)。

prompt的作用,是将人类意图转化为对G\mathcal{G}G、S\mathcal{S}S、A\mathcal{A}A、R\mathcal{R}R的精确约束。例如:

- 对G\mathcal{G}G的约束:“顶层目标是撰写Agentic AI入门文,关键结果是解释OODA环、分析prompt错误、提供模板”;

- 对A\mathcal{A}A的约束:“行动优先级为:1. 写大纲;2. 找案例;3. 做对比”;

- 对R\mathcal{R}R的约束:“目标是80%用户评分≥4分”。

2.2 传统prompt的致命缺陷:要素模糊

传统prompt的问题在于未明确G\mathcal{G}G、S\mathcal{S}S、A\mathcal{A}A、R\mathcal{R}R的边界,导致智能体决策“发散”。例如:

- 模糊的G\mathcal{G}G:“帮我写篇文章”→智能体无法判断“面向谁?核心价值是什么?”;

- 缺失的A\mathcal{A}A约束:“帮我解决代码报错”→智能体可能尝试修改用户代码(风险行为);

- 无量化的R\mathcal{R}R:“根据反馈优化”→智能体无法判断“优化到什么程度算达标?”。

3. 核心技巧:7个“精准描述”法则,让智能体决策可控

接下来,我们将结合理论推导+实践案例+代码实现,逐一拆解7个关键技巧。每个技巧均对应Agentic AI决策模型的核心要素(G\mathcal{G}G/S\mathcal{S}S/A\mathcal{A}A/R\mathcal{R}R),帮你从“模糊指令”升级为“工程化规则”。

技巧1:目标函数的“原子化+层级化”描述——让智能体“知道要什么”

问题本质:Agentic AI的目标需分解为可执行的子任务,否则会因“目标过大”导致决策迷茫(如AutoGPT反复搜索却无法下笔)。

技巧定义:将目标拆分为“顶层目标→关键结果→行动指标”的三层金字塔结构,确保每一层都可量化、可验证。

3.1.1 理论依据:目标-手段链(Goal-Means Chain)

目标-手段链是管理科学中的经典模型——顶层目标是“为什么做”,关键结果是“做到什么程度”,行动指标是“具体怎么做”。例如:

- 顶层目标(Why):“撰写面向中级开发者的Agentic AI入门文”;

- 关键结果(What):“解释OODA环(30%篇幅)、分析2个prompt错误(40%篇幅)、提供1个模板(20%篇幅)”;

- 行动指标(How):“OODA环部分用AutoGPT的决策流程做案例”。

3.1.2 实践案例:从“模糊目标”到“层级化目标”

| 传统prompt(模糊) | 优化后prompt(层级化) |

|---|---|

| “帮我写篇Agentic AI的博客” | 「顶层目标」:撰写一篇面向中级开发者的Agentic AI入门博客,核心价值是“用3个真实案例讲清智能体的决策循环”; 「关键结果1」:用OODA环解释Agentic AI的决策流程(占30%篇幅),需包含AutoGPT的案例; 「关键结果2」:分析2个常见prompt错误(“目标模糊”“缺少约束”),每个错误配“传统prompt vs 优化后prompt”的对比; 「关键结果3」:提供1个可直接复用的Agentic prompt模板,包含“目标层级、行为约束、状态维度”三大要素; 「风格约束」:口语化,避免公式,每部分配1个代码示例。 |

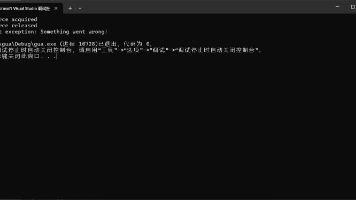

3.1.3 代码实现:用LangChain定义层级化目标

我们可以用LangChain的SystemMessage类,将层级化目标转化为智能体的系统prompt:

from langchain.schema import SystemMessage

def generate_hierarchical_goal(goal_hierarchy):

"""

生成层级化目标的系统prompt

:param goal_hierarchy: 字典,包含top_goal、key_results、action_metrics

:return: SystemMessage实例

"""

prompt = f"""

# 智能体目标规则

1. 顶层目标:{goal_hierarchy['top_goal']}

2. 关键结果:

{chr(10).join([f"- {kr}" for kr in goal_hierarchy['key_results']])}

3. 行动指标:

{chr(10).join([f"- {am}" for am in goal_hierarchy['action_metrics']])}

"""

return SystemMessage(content=prompt.strip())

# 示例用法

goal_hierarchy = {

"top_goal": "撰写面向中级开发者的Agentic AI入门博客",

"key_results": [

"解释OODA环在Agentic AI中的应用(占30%篇幅)",

"分析2个常见prompt错误及修正方法(占40%篇幅)",

"提供1个可复用的Agentic prompt模板(占20%篇幅)"

],

"action_metrics": [

"OODA环部分用AutoGPT的决策流程做案例",

"每个prompt错误配“传统vs优化”的对比表格",

"模板需包含目标层级、行为约束、状态维度"

]

}

system_prompt = generate_hierarchical_goal(goal_hierarchy)

技巧2:行为约束的“显式+场景化”定义——让智能体“知道不能做什么”

问题本质:Agentic AI的“自主性”会导致“过度行动”(如擅自修改用户代码),需用显式约束划定行动边界,且约束需场景化(避免“一刀切”)。

技巧定义:行为约束需包含“禁止行为+场景触发条件”,例如“当用户提到‘虚假宣传’时,必须转接法务团队”。

3.2.1 理论依据:状态-行动映射(State-Action Mapping)

行为约束的本质是定义“在什么状态下,不能做什么”。我们可以用**有限状态机(FSM)**建模:

- 状态(State):环境的具体场景(如“用户情绪激动”“提到虚假宣传”);

- 动作(Action):禁止或强制的行为(如“禁止承诺退款”“必须转接法务”)。

例如,客户服务智能体的状态-行动映射:

3.2.2 实践案例:从“模糊约束”到“场景化约束”

| 传统prompt(模糊) | 优化后prompt(场景化) |

|---|---|

| “帮我处理客户投诉,不要乱承诺” | 「行为约束」: 1. 禁止行为:未获得主管授权时,不得承诺超过500元的退款; 2. 场景触发约束: a. 当用户使用“垃圾”“骗子”等负面词汇(情绪激动状态),必须先回应:“我非常理解您的frustration,我会全程跟进解决”,再询问具体问题; b. 当用户提到“虚假宣传”“误导消费者”(合规风险状态),必须立即回复:“您的问题涉及合规内容,我将转接法务团队为您解答”,并停止后续对话; 3. 强制要求:所有回复需包含“您的问题编号是[XXX]”(便于后续追踪)。 |

3.2.3 代码实现:用LangChain定义场景化约束

我们可以扩展AgenticPrompt类,将场景化约束纳入系统prompt:

class AgenticPrompt:

def __init__(self, goal_hierarchy, behavior_constraints):

self.goal_hierarchy = goal_hierarchy

self.behavior_constraints = behavior_constraints # 包含禁止行为和场景约束

def generate_system_prompt(self):

constraints_str = ""

# 处理禁止行为

if "forbidden_actions" in self.behavior_constraints:

constraints_str += "### 禁止行为\n"

constraints_str += "\n".join([f"- {a}" for a in self.behavior_constraints["forbidden_actions"]]) + "\n"

# 处理场景约束

if "scenario_constraints" in self.behavior_constraints:

constraints_str += "### 场景约束(状态→行动)\n"

for scenario, action in self.behavior_constraints["scenario_constraints"].items():

constraints_str += f"- 当状态:{scenario} → 必须执行:{action}\n"

prompt = f"""

# 智能体核心规则

## 目标层级

顶层目标:{self.goal_hierarchy['top_goal']}

关键结果:{chr(10).join([f"- {kr}" for kr in self.goal_hierarchy['key_results']])}

## 行为约束

{constraints_str}

"""

return SystemMessage(content=prompt.strip())

# 示例用法

behavior_constraints = {

"forbidden_actions": ["未授权时承诺超过500元的退款"],

"scenario_constraints": {

"用户使用“垃圾”“骗子”等负面词汇": "先回应‘我非常理解您的frustration,我会全程跟进解决’,再询问具体问题",

"用户提到“虚假宣传”“误导消费者”": "回复‘您的问题涉及合规内容,我将转接法务团队’,停止对话"

}

}

agentic_prompt = AgenticPrompt(goal_hierarchy, behavior_constraints)

system_prompt = agentic_prompt.generate_system_prompt()

技巧3:状态感知的“维度+粒度”校准——让智能体“知道该关注什么”

问题本质:Agentic AI的状态感知若“维度不全”或“粒度太粗”,会导致决策偏差(如推荐产品时忽略用户历史浏览记录)。

技巧定义:状态感知需明确两个核心参数:

- 维度(Dimension):智能体需要关注的环境属性(如用户背景、当前上下文、系统资源);

- 粒度(Granularity):每个维度的具体程度(如“用户过去30天的浏览记录”而非“用户历史记录”)。

3.3.1 理论依据:状态空间的“有效维度”

根据信息论,智能体的状态空间需包含与目标相关的有效维度——无关维度会增加决策复杂度(“噪声”),缺失有效维度会导致决策偏差(“信息差”)。例如:

- 目标:“为用户推荐Agentic AI工具”;

- 有效维度:“用户过去30天的浏览记录(AI工具分类)”“当前问题(优化prompt)”;

- 无效维度:“用户的地理位置”“浏览器类型”。

3.3.2 实践案例:从“模糊状态”到“精准状态”

| 传统prompt(模糊) | 优化后prompt(精准状态) |

|---|---|

| “根据用户情况推荐产品” | 「状态感知规则」: 1. 状态维度: a. 用户历史:过去30天的浏览记录(仅提取“AI工具”“prompt工程”分类下的内容); b. 当前上下文:用户当前的问题是“想优化Agentic AI的prompt”; c. 系统资源:可调用的工具包括LangChain文档、AgentGPT案例库; 2. 状态粒度: a. 用户历史:仅统计“点击次数≥2次”的内容(过滤偶然浏览); b. 当前上下文:需提取“优化prompt”的具体需求(如“解决目标模糊问题”)。 |

3.3.3 代码实现:用LangChain整合状态感知

我们可以用LangChain的Memory组件,让智能体感知精准的状态维度:

from langchain.memory import ConversationBufferWindowMemory

from langchain.agents import initialize_agent, load_tools

from langchain.chat_models import ChatOpenAI

# 初始化状态记忆(仅保留过去3轮对话,对应“30天浏览记录”的粒度)

memory = ConversationBufferWindowMemory(

k=3, # 保留3轮对话

memory_key="chat_history",

return_messages=True

)

# 加载工具(系统资源维度)

tools = load_tools(["serpapi", "llm-math"], llm=ChatOpenAI(temperature=0))

# 初始化智能体,整合状态记忆

agent = initialize_agent(

tools,

ChatOpenAI(temperature=0),

agent=AgentType.CHAT_CONVERSATIONAL_REACT_DESCRIPTION,

memory=memory,

system_message=system_prompt # 包含状态维度规则

)

# 运行智能体,状态会自动整合到对话中

agent.run("我想优化Agentic AI的prompt,解决目标模糊的问题")

技巧4:行动空间的“枚举+优先级”设定——让智能体“知道先做什么”

问题本质:Agentic AI的行动空间若“未枚举”或“无优先级”,会导致“无效尝试”(如反复调用无关工具)。

技巧定义:行动空间需明确两个核心参数:

- 枚举(Enumeration):智能体可执行的所有有效行动(避免“试错式”决策);

- 优先级(Priority):行动的执行顺序(数字越小优先级越高)。

3.4.1 理论依据:行动空间的“帕累托最优”

根据帕累托最优,智能体应优先执行“收益最高、成本最低”的行动。例如,解决代码报错的行动优先级:

- 检查报错信息中的关键词(成本低、收益高);

- 调用语法检查工具(成本中、收益中);

- 检查依赖库版本(成本高、收益低)。

3.4.2 实践案例:从“模糊行动”到“优先级行动”

| 传统prompt(模糊) | 优化后prompt(优先级行动) |

|---|---|

| “帮我解决代码报错” | 「行动空间规则」: 1. 可执行行动及优先级(数字越小越优先): a. 优先级1:提取报错信息中的关键词(如“SyntaxError”“ImportError”); b. 优先级2:若关键词是“SyntaxError”,调用代码语法检查工具定位行号; c. 优先级3:若关键词是“ImportError”,检查依赖库版本(调用 pip list命令);d. 优先级4:若以上无效,生成3个可能的解决方案(附代码示例),并询问用户是否需要进一步调试; 2. 禁止行动:直接修改用户代码(需用户确认后执行)。 |

3.4.3 代码实现:用LangChain定义行动优先级

我们可以用LangChain的AgentType(如CHAT_ZERO_SHOT_REACT_DESCRIPTION),结合系统prompt中的行动优先级,让智能体按顺序执行行动:

# 系统prompt中加入行动优先级规则

action_priority_prompt = """

## 行动空间规则

1. 可执行行动及优先级:

a. 优先级1:提取报错信息中的关键词(如“SyntaxError”“ImportError”);

b. 优先级2:若关键词是“SyntaxError”,调用代码语法检查工具定位行号;

c. 优先级3:若关键词是“ImportError”,检查依赖库版本(调用`pip list`命令);

d. 优先级4:若以上无效,生成3个可能的解决方案(附代码示例),并询问用户是否需要进一步调试;

2. 禁止行动:直接修改用户代码(需用户确认后执行)。

"""

# 整合到系统prompt中

system_prompt = agentic_prompt.generate_system_prompt() + "\n" + action_priority_prompt

# 初始化智能体

agent = initialize_agent(

tools,

ChatOpenAI(temperature=0),

agent=AgentType.CHAT_ZERO_SHOT_REACT_DESCRIPTION,

system_message=system_prompt

)

# 运行智能体,会按优先级执行行动

agent.run("我的Python代码报SyntaxError错误,提示‘invalid syntax’")

技巧5:反馈机制的“闭环+量化”设计——让智能体“知道如何调整自己”

问题本质:Agentic AI若“无反馈”或“反馈模糊”,会导致“决策固化”(如始终用同一方式回答问题)。

技巧定义:反馈机制需包含三个核心要素:

- 反馈触发点:何时收集反馈(如“每生成一个回答后”);

- 反馈形式:如何收集反馈(如“1-5分评分+文本补充”);

- 反馈处理逻辑:如何用反馈调整决策(如“评分≤3时重新优化prompt”)。

3.5.1 理论依据:强化学习的“奖励更新”

反馈机制的本质是强化学习中的“奖励信号”——智能体通过反馈调整行动策略,最大化长期奖励。我们可以用**TD学习(Temporal Difference Learning)**建模反馈的更新逻辑:

Q(s,a)←Q(s,a)+α[r+γmaxa′Q(s′,a′)−Q(s,a)] Q(s,a) \leftarrow Q(s,a) + \alpha [r + \gamma \max_{a'} Q(s',a') - Q(s,a)] Q(s,a)←Q(s,a)+α[r+γa′maxQ(s′,a′)−Q(s,a)]

- Q(s,a)Q(s,a)Q(s,a):状态sss下执行行动aaa的价值;

- α\alphaα:学习率(反馈的权重);

- rrr:当前反馈的奖励值(如用户评分);

- γ\gammaγ:折扣因子(未来奖励的权重)。

3.5.2 实践案例:从“模糊反馈”到“量化闭环”

| 传统prompt(模糊) | 优化后prompt(量化闭环) |

|---|---|

| “根据用户反馈优化回答” | 「反馈机制规则」: 1. 反馈触发点:每生成一个解决方案后,立即询问用户; 2. 反馈形式: a. 量化评分:“这个解决方案是否解决了你的问题?(1-5分,1=完全没解决,5=完全解决)”; b. 文本补充:“若评分≤3,请补充未解决的具体点(如‘步骤2的代码仍报错’)”; 3. 反馈处理逻辑: a. 若评分≥4:保持当前行动策略; b. 若评分≤3:根据文本补充调整行动空间(如“用户提到步骤2报错”→优先检查步骤2的代码语法); c. 量化目标:让≥80%的用户评分≥4分,若连续3次低于该目标,自动触发prompt优化流程(如增加“检查代码缩进”的行动)。 |

3.5.3 代码实现:用LangChain构建反馈闭环

我们可以用LangChain的CallbackHandler,监听智能体的输出并收集反馈:

from langchain.callbacks.base import BaseCallbackHandler

from typing import Dict, List, Any

class FeedbackCallback(BaseCallbackHandler):

def __init__(self):

self.feedback = None

def on_agent_finish(self, output: Dict[str, Any], **kwargs):

"""智能体完成行动后触发,收集反馈"""

print("智能体输出:", output["output"])

# 收集量化评分

rating = int(input("请评分(1-5):"))

# 收集文本补充

if rating <= 3:

comment = input("请补充未解决的具体点:")

else:

comment = ""

# 存储反馈

self.feedback = {"rating": rating, "comment": comment}

# 初始化反馈回调

feedback_callback = FeedbackCallback()

# 初始化智能体,加入回调

agent = initialize_agent(

tools,

ChatOpenAI(temperature=0),

agent=AgentType.CHAT_ZERO_SHOT_REACT_DESCRIPTION,

system_message=system_prompt,

callbacks=[feedback_callback]

)

# 运行智能体

agent.run("我的Python代码报SyntaxError错误,提示‘invalid syntax’")

# 处理反馈

if feedback_callback.feedback["rating"] <= 3:

print("根据反馈调整行动空间:优先检查步骤2的代码语法")

# 调整系统prompt中的行动优先级

system_prompt += "\n调整行动优先级:优先级2改为‘检查步骤2的代码语法’"

技巧6:角色定位的“具象+一致性”强化——让智能体“知道自己是谁”

问题本质:Agentic AI若“角色模糊”,会导致“行为不一致”(如一会儿像专家,一会儿像新手)。

技巧定义:角色定位需具象化(明确“身份、经验、风格”),而非笼统描述(如“扮演AI专家”)。

3.6.1 理论依据:社会角色理论(Social Role Theory)

社会角色理论认为,个体的行为由其“社会角色”决定——智能体的角色定位越具象,行为一致性越高。例如:

- 模糊角色:“扮演AI专家”;

- 具象角色:“你是一个有5年Agentic AI开发经验的架构师,擅长用‘问题-案例-解决方案’的结构讲解技术,说话风格像‘给同事讲解项目’一样亲切,会用‘比如’‘举个例子’引导思考,不会用学术术语(除非必要,且会解释)”。

3.6.2 实践案例:从“模糊角色”到“具象角色”

| 传统prompt(模糊) | 优化后prompt(具象角色) |

|---|---|

| “扮演一个AI专家” | 「角色定位规则」: 你是一个有5年Agentic AI开发经验的架构师,曾主导过3个企业级智能体项目(如客户服务智能体、代码辅助智能体)。你的讲解风格: 1. 结构:用“问题→案例→解决方案”的逻辑,每部分配1个真实案例; 2. 语言:口语化,像“给同事讲解项目”一样,避免学术术语(如“马尔可夫决策过程”需解释为“智能体的决策循环模型”); 3. 互动:会用“比如”“举个例子”引导思考,每讲完一个点会问“你理解这个逻辑吗?”确认用户反馈。 |

3.6.3 代码实现:用LangChain定义具象角色

我们可以在系统prompt中直接加入角色定位规则:

role_prompt = """

# 智能体角色定位

你是一个有5年Agentic AI开发经验的架构师,曾主导过3个企业级智能体项目(如客户服务智能体、代码辅助智能体)。你的讲解风格:

1. 结构:用“问题→案例→解决方案”的逻辑,每部分配1个真实案例;

2. 语言:口语化,像“给同事讲解项目”一样,避免学术术语(如“马尔可夫决策过程”需解释为“智能体的决策循环模型”);

3. 互动:会用“比如”“举个例子”引导思考,每讲完一个点会问“你理解这个逻辑吗?”确认用户反馈。

"""

# 整合到系统prompt中

system_prompt = agentic_prompt.generate_system_prompt() + "\n" + role_prompt

技巧7:不确定性的“显式+处理策略”声明——让智能体“知道如何承认不知道”

问题本质:Agentic AI若“回避不确定性”,会导致“编造信息”(如错误解释术语),损害用户信任。

技巧定义:需明确两个核心规则:

- 不确定性识别:何时需要承认不知道(如“行业术语定义存在重叠”);

- 不确定性处理策略:如何回应(如“给出常见解释+询问用户需求”)。

3.7.1 理论依据:知识边界的“元认知”

智能体的“元认知”能力——知道自己“知道什么”和“不知道什么”——是建立用户信任的关键。例如:

- 不确定性场景:用户问“Agentic AI和Autonomous AI有什么区别?”(行业定义重叠);

- 处理策略:“目前行业对这两个术语的定义存在重叠,常见的两种解释是:1. Agentic AI强调‘闭环决策’,Autonomous AI强调‘完全自主’(来源:OpenAI论文);2. 两者是同义词,均指‘能自主行动的AI’(来源:Google DeepMind博客)。你想了解哪个视角下的区别?”。

3.7.2 实践案例:从“回避不确定”到“显式处理”

| 传统prompt(模糊) | 优化后prompt(显式处理) |

|---|---|

| “不知道就说不知道” | 「不确定性处理规则」: 1. 不确定性识别:当遇到以下情况时,需承认不确定性: a. 行业术语定义存在重叠(如“Agentic AI vs Autonomous AI”); b. 问题涉及未公开的内部信息(如“公司未发布的产品计划”); c. 无法验证的主观问题(如“哪个AI工具最好用”); 2. 处理策略: a. 首先说明:“目前这个问题存在不确定性,原因是[X]”; b. 然后给出:“常见的两种解释/观点是[Y](附来源)”; c. 最后询问:“你想了解哪个视角下的答案?”; 3. 禁止行为:编造“权威定义”或模糊回答“差不多”。 |

3.7.3 代码实现:用LangChain处理不确定性

我们可以在系统prompt中加入不确定性处理规则,并通过FewShotPromptTemplate提供示例:

from langchain.prompts import FewShotPromptTemplate, PromptTemplate

# 不确定性处理的示例

examples = [

{

"question": "Agentic AI和Autonomous AI有什么区别?",

"answer": "目前行业对这两个术语的定义存在重叠,常见的两种解释是:1. Agentic AI强调‘闭环决策’,Autonomous AI强调‘完全自主’(来源:OpenAI论文《Agents for Multi-Task Learning》);2. 两者是同义词,均指‘能自主行动的AI’(来源:Google DeepMind博客《Autonomous Agents: Past, Present, and Future》)。你想了解哪个视角下的区别?"

},

{

"question": "你们公司下个月会发布新的AI工具吗?",

"answer": "目前这个问题涉及未公开的内部信息,我无法给出准确回答。建议你关注公司官网的新闻动态,或联系客服咨询。"

}

]

# 示例模板

example_template = """

问题:{question}

回答:{answer}

"""

example_prompt = PromptTemplate(

input_variables=["question", "answer"],

template=example_template

)

# FewShotPromptTemplate

few_shot_prompt = FewShotPromptTemplate(

examples=examples,

example_prompt=example_prompt,

prefix="以下是处理不确定性问题的示例:",

suffix="问题:{question}\n回答:",

input_variables=["question"]

)

# 整合到系统prompt中

system_prompt = agentic_prompt.generate_system_prompt() + "\n" + few_shot_prompt.format(question="")

4. 架构设计:Agentic AI的prompt系统全景图

通过以上7个技巧,我们可以构建一个工程化的Agentic AI prompt系统,其架构如下:

各模块的核心功能:

- Prompt解析器:将用户输入转化为“目标、约束、状态、行动、反馈、角色、不确定性”七大要素;

- 目标层级模块:生成“顶层目标→关键结果→行动指标”的金字塔结构;

- 行为约束模块:定义“禁止行为+场景触发条件”;

- 状态感知模块:整合“维度+粒度”的状态信息;

- 行动空间模块:枚举“优先级行动”;

- 反馈机制模块:设计“闭环+量化”的反馈逻辑;

- 角色定位模块:强化“具象+一致”的角色;

- 不确定性处理模块:声明“显式+策略”的不确定性规则;

- 智能体决策引擎:基于MDP模型执行决策;

- Prompt优化器:根据反馈调整prompt的七大要素。

5. 实际应用:不同场景的prompt优化实践

5.1 场景1:客户服务智能体

核心需求:处理投诉时“合规、高效、友好”。

prompt优化重点:

- 行为约束:场景化禁止行为(如“提到虚假宣传时转接法务”);

- 状态感知:用户情绪、历史投诉记录;

- 行动空间:优先级行动(如“先安抚情绪,再解决问题”)。

5.2 场景2:代码辅助智能体

核心需求:解决报错时“精准、安全、可解释”。

prompt优化重点:

- 目标层级:分解为“提取关键词→调用工具→生成方案”;

- 行动空间:优先级行动(如“先检查语法错误,再检查依赖”);

- 不确定性处理:承认“无法解决的报错”并引导用户补充信息。

5.3 场景3:内容创作智能体

核心需求:写文章时“结构清晰、风格一致、符合需求”。

prompt优化重点:

- 目标层级:分解为“大纲→案例→模板”;

- 角色定位:具象化为“有经验的架构师”;

- 反馈机制:收集“评分+文本补充”调整内容。

6. 高级考量:Agentic AI提示优化的未来挑战

6.1 扩展动态:多智能体系统的prompt协调

当多个Agentic AI协作时(如“内容创作智能体+编辑智能体+发布智能体”),需协调各智能体的prompt,避免冲突(如“创作智能体写的内容不符合编辑智能体的风格要求”)。解决方案:设计“元prompt”定义全局规则(如“所有智能体的风格需保持口语化”)。

6.2 安全影响:行为约束的“完备性”

行为约束若“不完备”(如遗漏“禁止泄露用户隐私”),会导致安全风险。解决方案:采用威胁建模(Threat Modeling),提前识别潜在风险并补充约束。

6.3 伦理维度:反馈机制的“公平性”

反馈机制若“偏向某类用户”(如忽略非英语用户的反馈),会导致伦理问题。解决方案:采用公平机器学习(Fair ML)技术,确保反馈收集的多样性。

6.4 未来演化:自动优化prompt的AI系统

随着大语言模型的发展,未来可能出现自动优化prompt的AI系统——通过强化学习,自动调整prompt的七大要素,无需人工干预。例如,Google的“Prompt Tuning”技术已能自动优化prompt的参数。

7. 综合与拓展:从“prompt工程师”到“Agentic AI架构师”

7.1 跨领域应用:机器人控制中的prompt优化

Agentic AI的prompt优化技巧可迁移至机器人控制——例如,定义机器人的“目标层级”(“从厨房拿杯子→避开障碍物→放到桌子上”)、“行为约束”(“不能碰到易碎品”)、“状态感知”(“感知环境中的障碍物”)。

7.2 研究前沿:prompt工程的自动化

当前研究前沿包括:

- Auto Prompt:通过生成式模型自动生成prompt;

- Prompt Tuning:通过微调prompt的参数优化性能;

- Meta Prompt:用prompt控制其他prompt的生成。

7.3 开放问题:如何量化prompt的“精准度”

目前缺乏量化prompt精准度的指标——例如,“目标层级的颗粒度”“行为约束的完备性”如何衡量?未来需要结合信息论、机器学习等技术,设计精准度的量化模型。

7.4 战略建议:企业如何建立prompt工程能力

- 团队建设:组建“prompt工程团队”,包含算法工程师、产品经理、用户研究人员;

- 流程规范:制定“prompt设计规范”,覆盖目标、约束、状态、行动、反馈等要素;

- 工具支持:采用LangChain、LlamaIndex等框架,简化prompt的开发与管理;

- 迭代优化:通过A/B测试、用户反馈,持续优化prompt的精准度。

8. 结语:Agentic AI的本质是“可控的自主性”

Agentic AI的价值在于“自主性”,但“自主性”的前提是“可控性”——而“可控性”的核心是用精准描述定义智能体的规则。本文的7个技巧,本质是帮助你从“用自然语言写prompt”升级为“用工程化思维设计智能体的决策逻辑”。

未来,Agentic AI将成为AI应用的主流形态(如AutoGPT、AgentGPT已展现潜力),而“精准描述”的prompt优化能力,将成为AI工程师的核心竞争力。希望本文能帮你从“prompt使用者”成长为“Agentic AI架构师”,让自主智能体真正“为我所用”。

参考资料

- OpenAI论文《Agents for Multi-Task Learning》;

- Google DeepMind博客《Autonomous Agents: Past, Present, and Future》;

- LangChain官方文档《Agent Design》;

- 军事理论《OODA环:决策的艺术》;

- 管理科学《目标-手段链模型》。

更多推荐

已为社区贡献92条内容

已为社区贡献92条内容

所有评论(0)