CVPR的虚拟导演上线:可微渲染+动态场景生成,带你看AI如何自导自演动作戏

机器人行业正处于高速发展期,从智能感知、路径规划到人机协作,技术不断突破,应用场景日益拓展。无论是工业制造中的精准操作,还是医疗、服务领域的智能助手,机器人正在加速走向“泛在化”与“智能化”。这一方向不仅是人工智能、控制理论和多模态交叉的前沿,更是顶刊顶会的热点,极具科研与应用价值。

关注gongzhonghao【CVPR顶会精选】

机器人行业正处于高速发展期,从智能感知、路径规划到人机协作,技术不断突破,应用场景日益拓展。无论是工业制造中的精准操作,还是医疗、服务领域的智能助手,机器人正在加速走向“泛在化”与“智能化”。这一方向不仅是人工智能、控制理论和多模态交叉的前沿,更是顶刊顶会的热点,极具科研与应用价值。

今天小图给大家精选3篇CVPR有关机器人方向的论文,请注意查收!

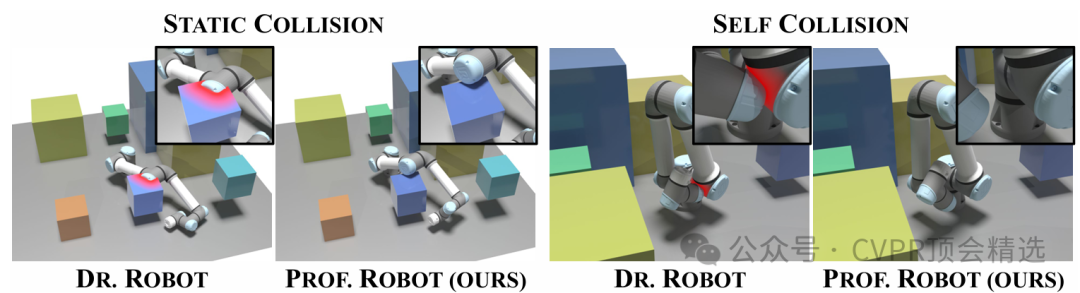

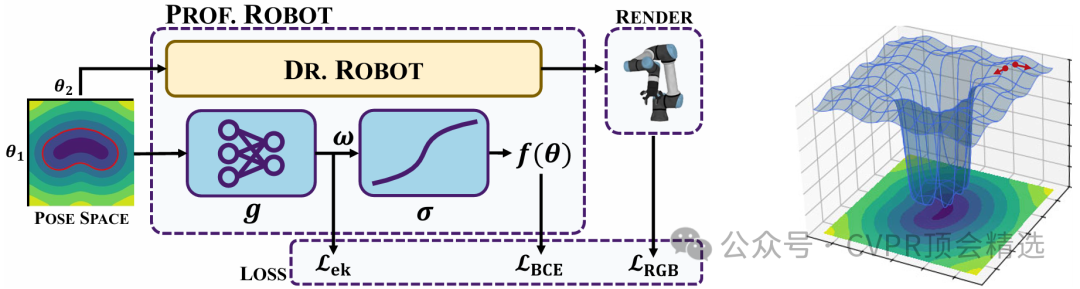

论文一:Prof. Robot: Differentiable Robot Rendering Without Static and Self-Collisions

方法:

文章的模型将机器人关节动作映射到空间轨迹,并通过神经网络实时预测每个姿态的碰撞概率,实现了碰撞约束的可微分建模和反馈。训练过程中,模型联合优化动作质量与安全性指标,使生成的运动序列天然规避静态障碍和自身结构冲突。最终,该方法无需繁琐的后处理或显式采样,直接输出安全、流畅且高效的机器人动作,极大增强了机器人在实际应用中的自主决策和交互能力。

创新点:

-

引入可微分神经碰撞分类器,实现在动作优化过程中对碰撞风险的高效感知与反馈。

-

首次实现无静态和自碰撞的可微分机器人渲染,为复杂环境中的高效路径规划提供新思路。

-

通过端到端优化方式,将碰撞约束完全融入动作生成流程,无需传统的离散采样或额外后处理。

论文链接:

https://arxiv.org/abs/2503.11269

图灵学术科研辅导

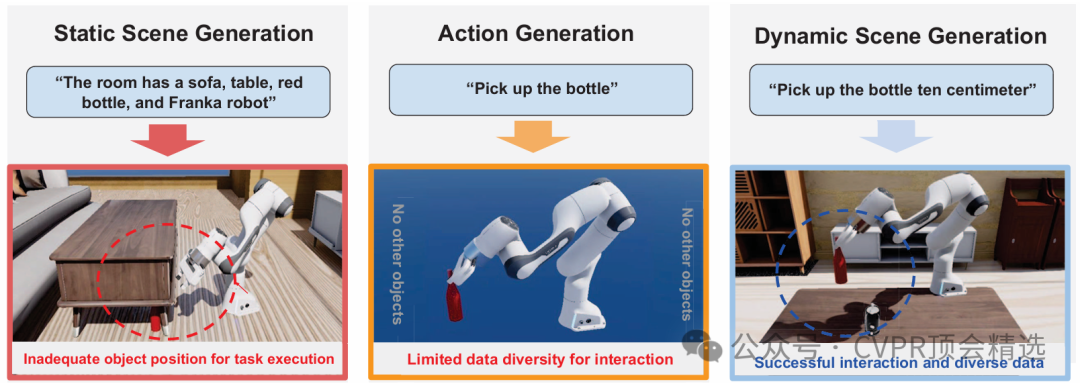

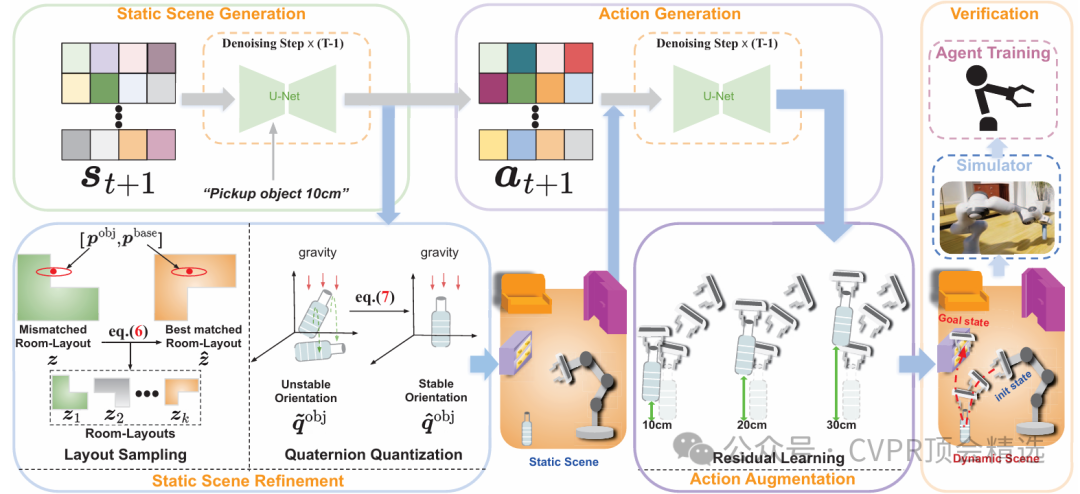

论文二:DynScene: Scalable Generation of Dynamic Robotic Manipulation Scenes for Embodied AI

方法:

作者首先将用户输入的自然语言指令解析为具体的操作场景参数,通过模块化生成器合成包含物体、环境和动态交互的三维场景,兼容多种机器人任务类型。生成流程结合了语义理解与物理模拟技术,确保每个场景既真实可用又能覆盖多样化任务需求。最后,系统会自动对生成场景进行评估和优化,保证数据的高质量和代表性,为具身AI模型的训练与评测提供坚实的数据基础。

创新点:

-

首创文本驱动动态场景生成机制,实现场景构建与任务设计的无缝融合。

-

设计了可扩展的数据生成管道,支持大规模高精度动态机器人操作场景合成。

-

引入多阶段质量评估和修正流程,大幅提升生成数据的准确性和多样性。

论文链接:

https://ieeexplore.ieee.org/document/11092633

图灵学术科研辅导

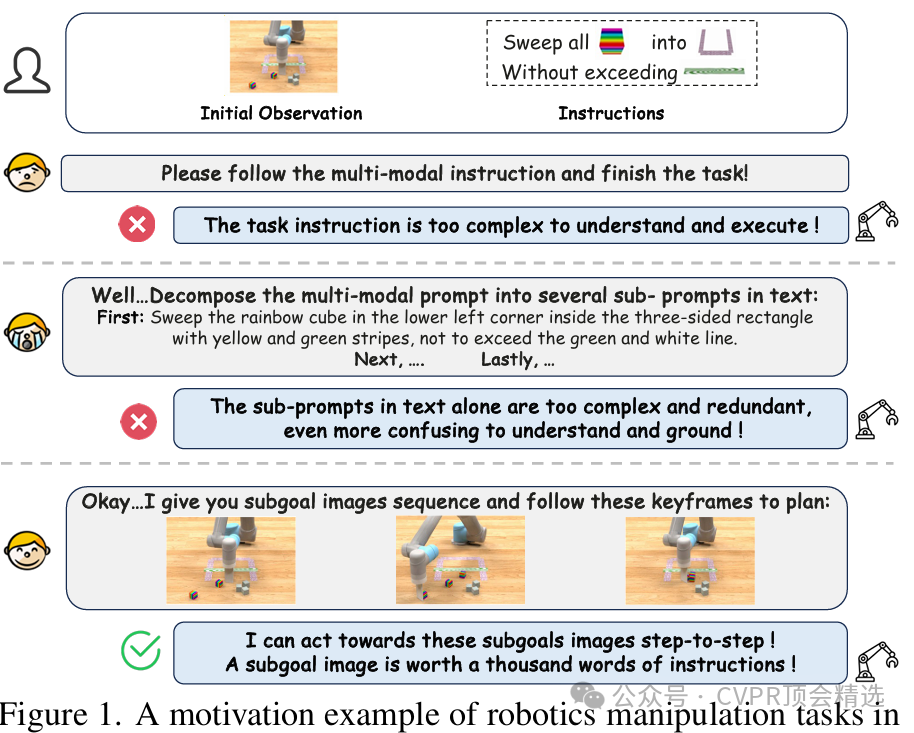

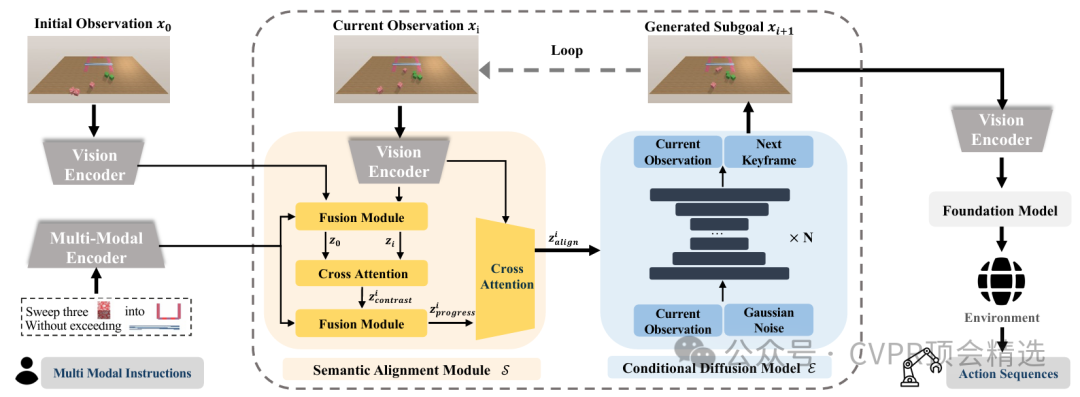

论文三:Generate Subgoal Images Before Act: Unlocking the Chain-of-Thought Reasoning in Diffusion Model for Robot Manipulation with Multimodal Prompts

方法:

文章框架以多模态输入为引导,利用扩散模型生成一系列符合任务语义的子目标图像,帮助机器人明确每一步操作目标。整个系统将子目标生成与动作规划紧密结合,确保机器人可以顺利从当前状态逐步达到最终任务要求。最终,通过端到端的决策机制,CoTDiffusion极大提升了机器人在长时、复杂操作任务中的执行成功率和任务适应能力。

创新点:

-

首次将扩散模型用于多步推理中的子目标图像生成,实现类链式思维的操作规划。

-

结合多模态提示,使机器人能够理解并分解复杂任务,提升指令跟随的灵活性和准确度。

-

构建端到端的图像生成与动作决策流程,为长时机器人操作带来高效的新范式。

论文链接:

https://openaccess.thecvf.com/content/CVPR2024/html/Ni_Generate_Subgoal_Images_before_Act_Unlocking_the_Chain-of-Thought_Reasoning_in_CVPR_2024_paper.html

本文选自gongzhonghao【CVPR顶会精选】

更多推荐

已为社区贡献12条内容

已为社区贡献12条内容

所有评论(0)