如何基于SophNet搭建一个私人语音助手

摘要:本教程详细介绍了如何利用SophNet云平台快速搭建私人语音助手。从注册账户、创建组织项目、获取APIKey,到配置语音识别、对话模型和语音合成三项核心服务,逐步指导完成部署。用户只需准备电脑和Python环境,按照步骤安装依赖并启动本地界面,即可实现语音交互功能。该方案为后续扩展唤醒词、第三方系统接入等功能提供了基础框架,适合开发者快速构建个性化AI助手。

·

前言

想要快速搭建一个既能“听”又会“说”的私人语音助手?SophNet 提供了一套简单高效的云端能力,让你几分钟内就能把语音识别、对话大模型与语音合成串起来。这篇教程将从注册开始,带你一步步完成部署与本地体验。

准备工作

- 一台可联网的电脑(Mac/Windows/Linux 均可)

- Python 3.8 及以上环境

- 基础的命令行操作能力

步骤一:注册 SophNet 账户并领取额度

- 访问:SophNet | 云算力平台

- 使用手机号注册新账号

- 成功注册后可获赠 20 元额度,足够支撑长时间的开发与测试

步骤二:创建组织

- 登录 SophNet

- 新建一个“组织”(Organization),用于管理项目、成员与资源

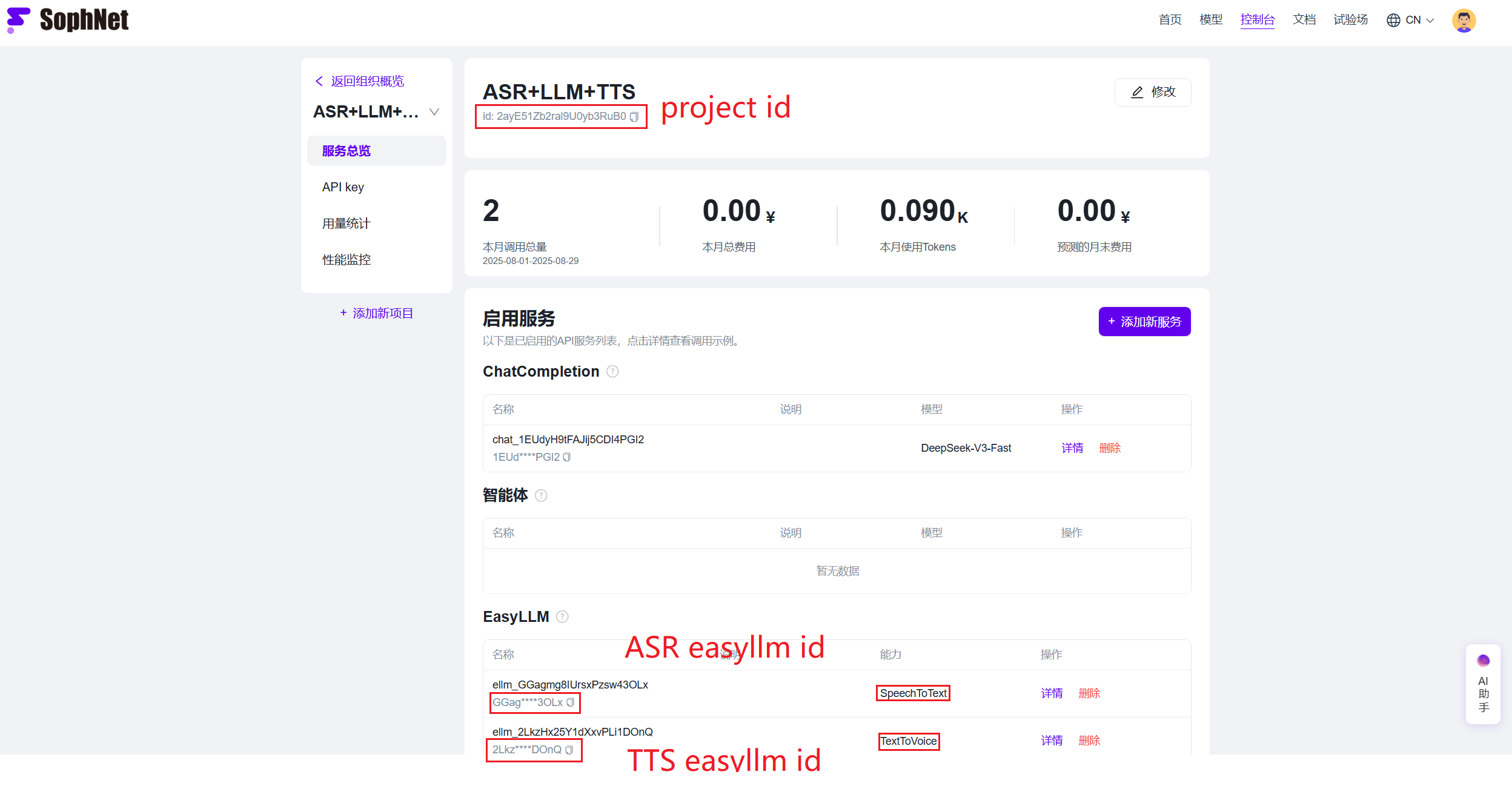

步骤三:创建项目

- 在组织下新建“项目”(Project)

- 进入项目详情页,记录“Project ID”(稍后配置代码时会用到)

步骤四:创建 API Key

- 在控制台中创建一个新的 API Key

- 妥善保存,不要泄露给他人(建议存入环境变量或本地密钥管理工具)

步骤五:添加服务能力

ChatCompletion(对话模型)

- 新增服务,类型选择 ChatCompletion

- 模型建议:DeepSeek-V3-fast(兼具速度与稳定性)

- 创建完成后记下服务的 easyllm id(后续代码会用到)

SpeechToText(语音转文字)

- 新增服务,类型选择 SpeechToText

- 创建完成后记录对应的 easyllm id

TextToSpeech(文字转语音)

- 新增服务,类型选择 TextToSpeech

- 创建完成后记录对应的 easyllm id

小贴士:

- 不同服务各自有 easyllm id,请为三项服务分别记录清楚,避免混淆。

- 如果有多种模型可选,可根据自己的需要进行调整。

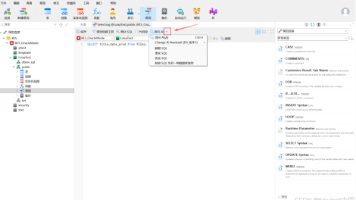

步骤六:获取源码并安装依赖

- 从源码仓库sophon-zhijuhuang/VoiceAssistant: ASR+LLM+TTS地址拉取项目代码(如遇问题,评论区随时交流)。

- 根据项目中的readme按照依赖。

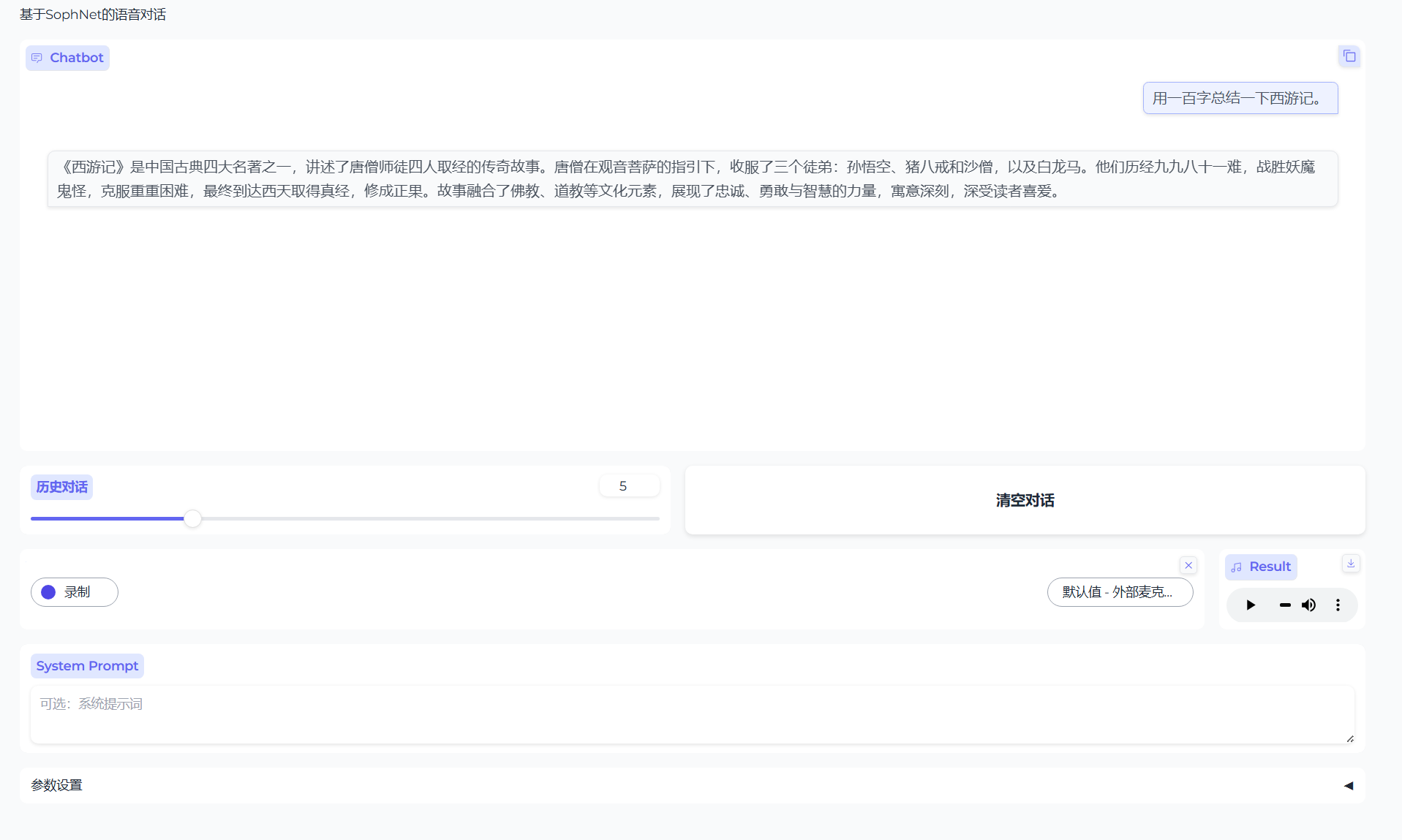

步骤七:启动本地界面

- 在终端执行:python3 main.py

- 若首次运行,留意终端输出的端口与日志信息。

步骤八:同网段设备快速体验

- 在同一内网环境下(我的服务器IP为172.26.41.46),使用浏览器访问:http://172.26.41.46:7809

结语

通过 SophNet 将 ChatCompletion、SpeechToText、TextToSpeech 三项能力串联起来,你就拥有了一套可扩展的私人语音助手基础框架。后面会陆续添加:

- 加入自定义唤醒词、关键词指令

- 接入日程、邮箱、智能家居等第三方系统

- 自定义知识库

- 在玩具上的实际应用

- .......

动手实践,做一个真正属于你的 AI 助手吧!如果本文对你有帮助,欢迎转发给需要的朋友,也欢迎在评论区交流你的使用经验与问题。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)