M-VLM【1】:Multi-Resolution Pathology-Language Pre-training Model with Text-Guided Visual Representati

本文提出了一种多分辨率病理学-语言预训练模型(MR-PLIP),通过整合全切片图像(WSI)的多分辨率视觉特征与文本描述,显著提升了计算病理学的分析能力。传统视觉-语言模型(VLM)仅关注单一分辨率,而MR-PLIP创新性地在5×、10×、20×、40×四个放大层级构建3400万个图像-文本对,并建立跨分辨率视觉-文本对齐(CVTA)。该模型采用层次化表征优化策略,通过Top-k₀关键词筛选机制消

前言

原论文链接:Multi-Resolution Pathology-Language Pre-training Model with Text-Guided Visual Representation

Abstract

在计算病理学(Computational Pathology, CPath)中,引入视觉-语言模型(Vision-Language Models, VLMs)为研究开辟了新的方向,这些研究主要集中在单一放大倍率下对图像-文本对进行对齐。然而,这种方法在癌症亚型分类、组织表型分析以及生存分析等任务中可能并不充分,因为单一分辨率图像所能提供的细节有限。为了解决这一问题,我们提出了一种新的多分辨率范式,利用全切片图像(Whole Slide Images, WSIs)在多个分辨率下提取组织学图像块,并通过先进的计算病理学视觉-语言模型生成相应的文本描述。我们在多分辨率下引入视觉-文本对齐,并进一步通过跨分辨率对齐来建立更有效的文本引导视觉表征。跨分辨率对齐借助多模态编码器,增强了模型在组织学图像中从多分辨率捕获上下文的能力。我们的模型旨在捕获更广泛的信息范围,并在新颖损失函数的支持下,丰富特征表征、提升判别能力,并增强跨分辨率的泛化能力。基于 TCGA 数据集的预训练(包含 3400 万个多分辨率的图像-文本对),我们对模型进行微调后,在多个数据集和任务上均优于现有的最新方法(State-Of-The-Art, SOTA),验证了其在计算病理学中的有效性。

Introduction

Motivation

- 临床需求驱动:

- 病理学家在诊断过程中始终采用 多分辨率观察流程(低倍看整体结构,高倍看细胞细节)。

- 现有 VLMs 主要依赖单一分辨率 → 无法同时捕捉全局组织学上下文与局部细胞学特征。

- 现有方法的不足:

- 单分辨率模型导致 信息缺失(例如,高倍缺乏上下文,低倍缺乏细节)。

- 即便已有部分多分辨率研究,也大多采用 简单拼接或融合,缺乏显式建模跨分辨率的复杂关系。

- 现有 SOTA 病理学 VLMs 在不同分辨率上的性能表现不一致,存在 泛化短板。

- 研究空白:

- 缺乏一种系统性的 多分辨率视觉—语言预训练框架,能够在不同分辨率间保持一致语义,同时充分利用分辨率特有的细粒度特征。

Contribution

- 提出 MR-PLIP 框架:

- 第一个专门为计算病理学设计的 多分辨率视觉—语言预训练模型。

- 从 全切片图像(WSIs) 中构建跨分辨率图像—文本对,建立“多分辨率组织学包”。

- 跨分辨率语义对齐:

- 提出 跨分辨率视觉—文本对齐(CVTA),确保不同分辨率下的图像与其文本描述共享统一语义空间。

- 层次化表征优化:

- 引入 多分辨率文本引导视觉表征对齐(MRTVA),同时建模分辨率内一致性与跨分辨率一致性。

- 采用新颖损失函数,提升判别力与泛化性。

- 多模态融合机制:

- 设计 多模态编码器,将多分辨率视觉特征与文本特征整合到统一表征中,用于多种下游任务。

- 大规模预训练与验证:

- 在 TCGA 数据集 上构建 3400 万对多分辨率图像—文本对进行预训练。

- 在 26 个公开数据集、多个任务(癌症亚型分类、组织表型分析、生存预测、细胞核分割等)上验证有效性,结果显著优于 SOTA。

Methods

Generating Multi-Resolution Histology Bags: Image Patches and Textual Descriptions

我们首先从 TCGA 数据集中选择了 N = 20,000 N=20{,}000 N=20,000 张全切片图像(WSIs) { W i } i = 1 N \{W_i\}_{i=1}^{N} {Wi}i=1N,该数据集是组织病理学中的关键资源。我们在不同分辨率层级 r ∈ { 5 × , 10 × , 20 × , 40 × } r \in \{5\times, 10\times, 20\times, 40\times\} r∈{5×,10×,20×,40×} 下,提取每张图像的 n n n 个图像块 { p i , j r } j = 1 n \{p^r_{i,j}\}_{j=1}^{n} {pi,jr}j=1n。我们的第一步是在 5 × 5\times 5× 放大倍数(2 µm/像素)下,从每张 WSI 中随机提取 20 个图像块,并将每个图像块的大小统一为 512 × 512 512\times512 512×512 像素。为了进一步探查这些图像,我们将初始图像块处理到更高的放大倍数 1 0 × , 20 × , 40 × 0\times,\,20\times,\,40\times 0×,20×,40×,分别对应 1 µm/像素、0.5 µm/像素与 0.25 µm/像素。对于每一个原始 5 × 5\times 5× 图像块,这一过程将产生 4 个 10 × 10\times 10× 块、16 个 20 × 20\times 20× 块和 64 个 40 × 40\times 40× 块。该方法使我们能够在不同尺度上更细致地检查细胞结构。

先在较低倍数下随机抽样,随后对同一视野逐级放大切块,保证跨分辨率的空间对应关系(同一低倍视野映射到多个更高倍细分视野)

为组织这一大规模数据集,我们在图像块之间建立了“父—子”关系:每个较低分辨率图像块作为“父”块,与其在下一个更高分辨率层级上的 4 个“子”块相连接。该策略在所有放大层级上累计得到 3400 万个图像块,从而显著强化了当前 CPath 领域 SOTA VLMs 的多分辨率能力。此外,为了把文本信息与图像数据整合起来,我们使用了在大规模组织病理学图文对上预训练的 Quilt-LLaVA 与 QuiltNet。这一流程使我们能够为每个图像块 p i , j r p^r_{i,j} pi,jr 提取文本描述 t i , j r t^r_{i,j} ti,jr,从而为组织病理图像提供更为细致的解读信息。通过这一细致且有条理的处理过程,我们希望在不同分辨率下结合视觉与文本数据,提升对组织病理影像的理解,并为 CPath 提供重要洞见。

低分辨率通过严格的空间下采样关系将其区域在高倍率下等分为 4 个

与同一父级 5 × 5\times 5× 图像块 p i , j 5 × p^{5\times}_{i,j} pi,j5× 相对应的所有图像块(即 10 × , 20 × , 40 × 10\times, 20\times, 40\times 10×,20×,40×)被视为一个视觉包** B i , j v B^v_{i,j} Bi,jv。我们令 ∣ B i , j v ∣ = v 0 |B^v_{i,j}| = v_0 ∣Bi,jv∣=v0,在我们的设定中 v 0 = 85 v_0 = 85 v0=85。对每个 p i , j r ∈ B i , j v p^r_{i,j} \in B^v_{i,j} pi,jr∈Bi,jv,我们使用 UNI 视觉编码器(ViT-L/16)提取视觉特征向量 v i , j r ∈ R d v^r_{i,j} \in \mathbb{R}^d vi,jr∈Rd,并据此得到集合 V i , j = { v a } a = 1 v 0 V_{i,j} = \{v_a\}{a=1}^{v_0} Vi,j={va}a=1v0。

同时,我们利用现有的 CPath VLM(Quilt-LLaVA)并使用如下提示语生成每个 p i , j r ∈ B i , j v p^r_{i,j} \in B^v_{i,j} pi,jr∈Bi,jv 的文本描述:“Can you describe the main features visible in this histopathology image?”。对于每个视觉包,我们将对应的全部文本描述串接形成一个文本描述包 B i , j t B^t_{i,j} Bi,jt。随后,我们采用 QuiltNet 的文本编码器从 B i , j t B^t_{i,j} Bi,jt 中抽取文本表征,并得到与不同关键词对应的集合 T = { w b } b = 1 k T=\{w_b\}_{b=1}^{k} T={wb}b=1k,其中 k k k 为文本包中的词数, w b w_b wb 为第 b b b 个词的特征向量。

本段给出了核心数据结构:

- 视觉包 B v B^v Bv:收纳与同一 5 × 5\times 5× 视野对应的全部高倍块,并提取其视觉特征 V i , j V_{i,j} Vi,j。

- 文本包 B t B^t Bt:将该视野下所有块的描述合并,再由文本编码器提炼为关键词向量集合 T T T。

Visual-Textual Feature Alignment Across Resolutions for Top k 0 k_0 k0 Words Extraction

在文本描述包 B i , j t B^t_{i,j} Bi,jt 内,只有一部分文本描述在更高放大倍率下与某个特定图像块直接相关。此外,这些文本描述是通过无监督方法生成的,可能包含与给定图像块并不准确相关的无关关键词。因此,有必要使视觉编码器与文本编码器能够在不同分辨率下有效协同工作。

两类噪声来源

- “跨倍率可见性”差异导致并非所有文本都适用于所有分辨率的图像块

- 无监督生成文本会引入无关词

直接把整包文本与任一图像块对齐会造成语义漂移与负迁移,因此需要一个机制来在跨分辨率场景下挑选与当前图像特征最匹配的少量高置信关键词,并据此对齐与训练。

为此,我们提出跨分辨率视觉-文本对齐(CVTA)模块,用以校准两个编码器,使其在不同放大倍率下协调一致地工作。具体做法是:对于每一个视觉特征 v a v_a va,从对应的 T i , j T_{i,j} Ti,j 中识别出 k 0 < k k_0<k k0<k 个正样本关键词 w b + w_b^{+} wb+。该识别过程基于最大化词特征 w b ∈ T i , j w_b \in T_{i,j} wb∈Ti,j 与视觉特征 v a ∈ V i , j v_a \in V_{i,j} va∈Vi,j 的余弦相似度,其计算形式为 w b ⊤ v a ∥ w b ∥ 2 ∥ v a ∥ 2 \frac{w_b^\top v_a}{\lVert w_b\rVert_2\,\lVert v_a\rVert_2} ∥wb∥2∥va∥2wb⊤va。这一选择的理由在于:并非 B i , j t B^t_{i,j} Bi,jt 中的所有文本特征都与每个视觉特征 v a v_a va 相关;那些不相关的词被视为负样本关键词。

核心思想是先筛后对齐:先用余弦相似度在图像-文本两侧做细粒度匹配,为每个图像特征挑出最相关的 k 0 k_0 k0 个词(正样本),其余作为负样本。这样就把原本“嘈杂的文本包”转化为“图像特征感知的精炼词集”,为后续的对比学习提供更干净的监督信号,同时天然适配跨分辨率场景(因为选择是针对每个 v a v_a va 在其当前分辨率上进行的)。

Top- k 0 k_0 k0 选择的机制本质上是“分辨率自适应”

- 筛选过程是 逐个 v a v_a va 进行的。

- 也就是说,在 5 × 5 \times 5× 的视觉特征下,模型自然会选取更偏宏观的 Top- k 0 k_0 k0 词;在 40 × 40\times 40× 的视觉特征下,模型自然会选取更偏微观的 Top- k 0 k_0 k0 词。

Top- k 0 k_0 k0 筛选是 逐分辨率、逐视觉特征进行的,因此它能自然保证不同倍率下的图像块各自只对齐到最合适的语义关键词,从而在跨分辨率场景下避免语义冲突、提升对齐质量。

随后,我们采用如下对比损失函数,利用上述识别出的正/负关键词对进行最小化训练:

L CVTA = − 1 v 0 ∑ a = 1 v 0 ( 1 k 0 ∑ b = 1 k 0 log exp ( v a ⊤ w + b / τ ) ∑ b ’ = 1 k exp ( v a ⊤ w b ’ / τ ) ) \mathcal{L}{\text{CVTA}} = -\,\frac{1}{v_0}\sum{a=1}^{v_0} \left( \frac{1}{k_0}\sum_{b=1}^{k_0} \log \frac{\exp\!\big(v_a^\top w^{+}b/\tau\big)} {\sum{b’=1}^{k}\exp\!\big(v_a^\top w_{b’}/\tau\big)} \right) LCVTA=−v01∑a=1v0(k01∑b=1k0log∑b’=1kexp(va⊤wb’/τ)exp(va⊤w+b/τ))

其中, τ \tau τ 是可学习的温度超参数,用于调节输出分布的“集中度”,初始值设为 0.07。

这是一个词粒度的 InfoNCE:对每个视觉特征 v a v_a va,把其对应的 Top k 0 k_0 k0 正词 w b + w_b^{+} wb+ 推近,同时把同一文本包中的其他 k − k 0 k-k_0 k−k0 个词推远。分母在同一图像视野的词集合内做归一化,能有效抑制包内噪声词的干扰。平均因子 1 v 0 \frac{1}{v_0} v01 与 1 k 0 \frac{1}{k_0} k01 分别保证了对所有图像块特征与所有正样本词的均衡贡献; τ \tau τ 控制梯度“锐度”,可学习设定利于不同数据域 / 分辨率下自适应。

Integrating Multi-Modal Features for CrossResolution Alignment

尽管先前研究已经表明,视觉编码器能够隐式地学习视觉表征,但它在识别跨多种分辨率的内在语境关系方面仍然存在困难。这一限制阻碍了 VLM 的表现,尤其影响了 CPath 的下游任务。更具体地说,这一差距在当前 CPath 的视觉—语言预训练范式中尤为明显:这些范式主要把注意力放在对齐视觉与文本数据上,而经常忽视文本在不同分辨率上引导语境表征学习所应起到的作用,因而错过了关键的语境细节。

结论:需要一种在多分辨率场景中“用文本驱动语境学习”的机制。

- 仅做“图文对齐”(例如全局 InfoNCE)并不足以让模型理解跨倍率的结构—细节关系;模型缺少“多尺度语境建模”。

- 作者强调文本不仅是对齐目标,也是指导信号:在不同倍率下,文本可以引导模型将宏观结构与微观细节建立联结,从而弥补单纯对齐造成的“语境缺失”。

为应对上述挑战,我们提出了多模态跨分辨率特征对齐方法——一种感知语境信息的全新预训练任务,用以增强模型在组织学图像多种分辨率下捕获语境信息的能力。其通过精确的文本驱动式引导来促进多模态数据对的对齐。具体而言,我们的模型使得来自低放大倍率(如 v i , j 5 × v^{5\times}_{i,j} vi,j5×)的视觉特征能够为更高放大倍率(如 v i , j 10 × v^{10\times}_{i,j} vi,j10×)的图像块特征提供信息与语境。随之,文本特征被提取出来,并通过多模态编码器与视觉特征交互,从而得到文本引导的视觉表征 z i , j r z^{r}_{i,j} zi,jr。

方法的关键是“文本驱动”+“跨倍率信息流”:低倍(全局上下文)→ 高倍(细胞细节)有显式的信息传递;文本作为桥梁把不同倍率下的视觉语义对齐并融合。多模态编码器使文本与各倍率视觉特征交互,进而得到跨分辨率、一致且可迁移的表征。

直观理解:文本当“老师”,引导各倍率的图像特征学到与临床语义对齐的可解释表示;同时实现从低倍到高倍的语境补全。

Text-guided Visual Representation

对于每个图像块 p i , j r p^{r}_{i,j} pi,jr,我们提取一个视觉特征 v i , j r v^{r}_{i,j} vi,jr,并从 T i , j T_{i,j} Ti,j 中取得 k 0 k_0 k0 个正关键词特征 w b + w_b^{+} wb+(这些正关键词由通过 CVTA 模块训练得到的视觉与文本编码器选出)。随后,将这些视觉与文本特征拼接后送入一个多模态编码器,该编码器被专门训练用于实现跨分辨率特征对齐:

z i , j r = E m m ( v i , j r , w 1 + , w 2 + , … , w k 0 + ) . z^{r}_{i,j}=E_{\mathrm{mm}}\!\big(v^{r}_{i,j},\,w^{+}_{1},\,w^{+}_{2},\,\dots,\,w^{+}_{k_0}\big). zi,jr=Emm(vi,jr,w1+,w2+,…,wk0+).

这里把Top- k 0 k_0 k0 文本关键词与该分辨率下的图像特征一起输入到多模态编码器 E m m E_{\mathrm{mm}} Emm。产出 z i , j r z^{r}_{i,j} zi,jr 是“文本引导”后的视觉表示:它在语义上已与最相关的词对齐,因此更贴近病理学描述。

其中, E m m ( ⋅ , ⋅ ) E_{\mathrm{mm}}(\cdot,\cdot) Emm(⋅,⋅) 表示生成输出 z i , j r z^{r}_{i,j} zi,jr 的多模态编码器; r r r 指当前图像块的分辨率,而 r ∈ R r\in\mathcal{R} r∈R 表示所有可能分辨率的集合。该文本引导表征 z i , j r z^{r}_{i,j} zi,jr 有助于将视觉特征与其最优的文本表征对齐。然而,这并不能保证不同分辨率之间(例如父分辨率与子分辨率层级)的一致性。为了维系组织图像在“整体结构”与“细节层面”之间的连贯性,我们引入了一个基于 SimSiam 框架的多分辨率文本引导视觉表征对齐(MRTVA)损失:

L M R T V A ( h i , j p , g i , j c ) = − ∑ p , c ∈ R , p ≠ c ( h i , j p ∥ h i , j p ∥ 2 ⋅ g i , j c ∥ g i , j c ∥ 2 ) . \mathcal{L}{\mathrm{MRTVA}}\!\big(h^{p}_{i,j},\,g^{c}_{i,j}\big)\;=\; -\!\!\sum_{\;p,c\in\mathcal{R},\,p\neq c}\!\! \left( \frac{h^{p}_{i,j}}{\lVert h^{p}_{i,j}\rVert_2} \;\cdot\; \frac{g^{c}_{i,j}}{\lVert g^{c}_{i,j}\rVert_2} \right). LMRTVA(hi,jp,gi,jc)=−∑p,c∈R,p=c(∥hi,jp∥2hi,jp⋅∥gi,jc∥2gi,jc).

这里 h i , j p h^{p}_{i,j} hi,jp 是父分辨率(低倍)的表征, g i , j c g^{c}_{i,j} gi,jc 是子分辨率(高倍)的表征。

归一化余弦相似度的负和(与 SimSiam 思路一致):最小化它等价于最大化父 / 子分辨率表征的相似度,从而拉近跨分辨率(例如 5×→10×)的文本引导表示。直观上,它让“低倍全局语境”与“高倍细胞细节”朝同一语义方向对齐,避免跨分辨率表征“各说各话”。

SimSiam 的核心思想是:通过预测头 + 投影头的表征对比,最大化同一样本在不同视角/增强下的表征相似度。

训练目标是最小化损失,所以最小化负的余弦相似度 = 最大化余弦相似度。

在 MRTVA 里,场景类似:

- “不同视角/增强”换成了“不同分辨率(父/子)”。

- 通过余弦相似度最大化,让父分辨率表征和子分辨率表征对齐在同一语义方向。

其中, p p p 表示低放大倍率(父级)的图像块, c c c 表示高放大倍率(子级)的图像块,这是实现跨分辨率对齐的关键。父/子图像块的文本引导视觉特征之间的对齐尤为重要,因为它能够在父—子层级中保留语境信息。此外,设 h i , j = p d ( p j ( z i , j ) ) , g i , j = p j ( z i , j ) h_{i,j}=p_d\!\big(p_j(z_{i,j})\big),\qquad g_{i,j}=p_j(z_{i,j}) hi,j=pd(pj(zi,j)),gi,j=pj(zi,j),其中 p d p_d pd 与 p j p_j pj 分别为投影头与预测头。

在多分辨率文本引导视觉表征上最小化 L M R T V A \mathcal{L}{\mathrm{MRTVA}} LMRTVA 本质上会退化为一个带尺度因子的均方误差最小化,从而确保多模态特征在不同分辨率间的对齐。我们进一步给出一个对称损失:

L M R T V A = 1 2 [ L M R T V A ( h p i , j , S g ( g c i , j ) ) + L M R T V A ( g p i , j , S g ( h c i , j ) ) ] \mathcal{L}{\mathrm{MRTVA}} =\frac{1}{2}\Big[ \mathcal{L}{\mathrm{MRTVA}}\!\big(h^{p}{i,j},\,S_g(g^{c}{i,j})\big) +\mathcal{L}{\mathrm{MRTVA}}\!\big(g^{p}{i,j},\,S_g(h^{c}{i,j})\big) \Big] LMRTVA=21[LMRTVA(hpi,j,Sg(gci,j))+LMRTVA(gpi,j,Sg(hci,j))]

其中 S g ( ⋅ ) S_g(\cdot) Sg(⋅) 表示停止梯度(stop-gradient)操作,用于在训练中防止模型坍塌。

投影/预测头的引入与 SimSiam 的设计一致: g g g 先做预测, h h h 在其基础上再做投影;二者经单位范数化后做相似度。

对称损失 + 停梯度可有效抑制“塌陷”解(所有表示趋同),保证学习到非退化的跨分辨率语义。

“父→子、子→父”对称约束让信息可双向流动,既保留低倍的全局结构,也不损失高倍的关键细节。

Pre-Training Tasks

我们集成了四个预训练任务:图像—文本对比学习(ITC)、图像—文本匹配(ITM)、掩码语言建模(MLM)以及前缀语言建模(PLM)。

组合了对比、判别、生成三类信号:

ITC(对比类)侧重全局语义对齐;

ITM(判别类)提供二分类监督以辨别图文是否匹配;

MLM/PLM(生成类)让模型理解并生成语言,把视觉线索融入语言上下文。

多任务联合能在训练初期稳定表征,同时减少单一任务偏置。

在 ITC 任务中,将由单模态编码器提取的图像特征与文本特征进行对齐。在 ITM 任务中,目标是利用跨模态表征判断一段图像与文本之间是否匹配。对于 MLM,我们随机掩盖 15% 的文本标记,模型需依赖跨模态表征来预测被遮蔽的词语。在 PLM 中,基于给定图像,我们先生成标题(caption),并进一步预测随后的文本片段,使其与跨模态语境保持一致。

- ITC:通常采用 InfoNCE/对比式打分,使正匹配(同一对图文)相似度更高、负匹配更低,强化语义对齐的“骨架”。

- ITM:对比 ITC 的“软约束”,ITM是硬判别(match / non-match),对错误对齐更敏感,能校正对比学习的盲点。

- MLM:把图像作为外部线索,要求语言侧在缺词情况下仍能补全,促进视觉→语言的信息注入。

- PLM:前缀式生成让模型学会从图像到更长文本的续写,提升跨模态的生成一致性。四者互补:对比 + 判别 + 生成,覆盖对齐、辨识、补全、续写四个维度。

为简化实现,我们把上述损失合成为一个基线损失: L b l = L I T C + L I T M + L M L M + L P L M \mathcal{L}_{\mathrm{bl}} = \mathcal{L}_{\mathrm{ITC}} + \mathcal{L}_{\mathrm{ITM}} + \mathcal{L}_{\mathrm{MLM}} + \mathcal{L}_{\mathrm{PLM}} Lbl=LITC+LITM+LMLM+LPLM

进而得到 MR-PLIP 的完整预训练目标: L t = L b l + L C V T A + L M R T V A S \mathcal{L}_{\mathrm{t}} = \mathcal{L}_{\mathrm{bl}} + \mathcal{L}_{\mathrm{CVTA}} + \mathcal{L}_{\mathrm{MRTVAS}} Lt=Lbl+LCVTA+LMRTVAS

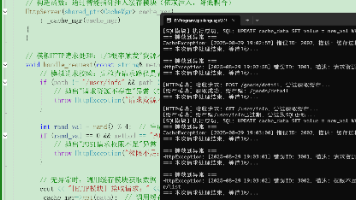

Experiment

总结

作者提出了一个 多分辨率病理学视觉—语言预训练框架(MR-PLIP),它模拟病理学家临床诊断时“低倍看全局、 高倍看细节”的流程,构建了多分辨率图像—文本包,并设计了 跨分辨率对齐(CVTA) 和 文本引导的跨分辨率一致性约束(MRTVA),再结合 多任务预训练目标(ITC/ITM/MLM/PLM),最终在 26 个公开病理学任务上显著优于现有 SOTA 模型。

可借鉴的地方:

• 方法层面:在多尺度任务(不仅是病理图像,任何需要兼顾全局与局部的视觉任务)中,借助多分辨率包 + 文本引导对齐的思路,可以有效缓解单一尺度信息不足的问题。

• 算法层面:利用 Top-k_0 筛词 → 文本引导视觉表征 → 对称性跨分辨率对齐(SimSiam式 stop-gradient),是一个值得在跨模态/跨尺度场景推广的范式。

• 工程层面:作者通过 3400 万对图文样本大规模预训练验证,说明该方法在真实超大规模数据场景中是可行且稳定的,这一点对医学/遥感等数据昂贵、分辨率多样的领域尤其有借鉴意义。

更多推荐

已为社区贡献10条内容

已为社区贡献10条内容

所有评论(0)