使用 Dify 必备:AI 核心知识与概念全梳理

非技术用户(如运营、产品):优先掌握「基础认知层」(LLM、生成式 AI)+「应用实践层」(低代码、RAG 知识库上传、权限配置),能快速搭建标准化应用;技术用户(如开发者):需额外掌握「核心技术层」(Agent 逻辑、模型编排、LLMOps 监控)+「高级实践」(插件开发、私有化部署),可定制复杂业务流与企业级方案。理解这些概念后,能更清晰地判断 “Dify 的哪些功能适配业务需求”,并通过参数

·

要高效使用 Dify 开发生成式 AI 应用,无需深入掌握 AI 底层算法研发细节,但需理解与 “大语言模型(LLM)应用构建、数据处理、流程编排” 相关的核心 AI 知识与概念。以下从基础认知层、核心技术层、应用实践层三个维度,梳理关键概念并展开解析:

一、基础认知层:理解 AI 应用的 “底层基石”

这一层概念是使用 Dify 的 “入门前提”,帮助用户明确 AI 应用的核心构成与运行逻辑。

1. 大语言模型(LLM,Large Language Model)

- 概念解析:基于海量文本数据训练的深度学习模型,能理解人类语言、生成连贯文本、完成逻辑推理(如问答、创作、代码生成),是生成式 AI 应用的 “核心引擎”。

- 关键特性:具备上下文理解能力(能记住对话历史)、泛化能力(适配多场景),但存在 “幻觉”(生成虚假信息)、知识截止期(无法获取训练数据之后的信息)等局限。

- Dify 中的关联:Dify 支持数百个开源(如 Llama、DeepSeek)与商业(如 GPT-4、通义千问)LLM,用户需根据应用场景选择模型(如生成文案选 GPT-4,私有化部署选 Llama 3)。

2. 生成式 AI(Generative AI)

- 概念解析:与 “判别式 AI”(如图片分类、垃圾邮件识别)相对,指能主动生成新内容(文本、图片、音频等)的 AI 技术,LLM 是生成式 AI 在 “语言领域” 的核心载体。

- 关键特性:创造性(生成未存在的内容)、多模态性(部分模型支持文本生成图片、语音生成文本)。

- Dify 中的关联:Dify 的核心定位是 “生成式 AI 应用开发平台”,所有功能(如智能客服、文档摘要)均围绕 “基于 LLM 生成高质量内容 / 执行任务” 展开。

3. 后端即服务(BaaS,Backend as Service)

- 概念解析:一种云服务模式,平台提供现成的后端基础设施(如服务器、数据库、API 接口),开发者无需自建后端,只需专注前端与业务逻辑开发。

- 关键价值:降低技术门槛,缩短开发周期。

- Dify 中的关联:Dify 融合 BaaS 理念,已封装好模型调用、数据存储、权限管理等后端能力,用户无需搭建后端架构,直接通过可视化界面构建 AI 应用。

二、核心技术层:掌握 Dify 功能的 “技术逻辑”

这一层概念对应 Dify 的核心功能(如 RAG、Agent、LLMOps),理解后可灵活配置平台能力,解决实际业务问题。

1. 检索增强生成(RAG,Retrieval-Augmented Generation)

- 概念解析:解决 LLM“知识过时、幻觉、不精准” 的核心技术,原理是:

- 检索:当用户提问时,先从 “私有知识库”(如企业文档、行业数据)中检索与问题相关的精准信息;

- 增强生成:将检索到的信息作为 “上下文” 传给 LLM,让 LLM 基于真实数据生成回答,而非仅依赖自身训练数据。

- 关键价值:提升回答准确性(减少幻觉)、实现 “私有知识注入”(让 LLM 掌握企业内部数据)、支持动态更新知识(无需重新训练模型)。

- Dify 中的关联:Dify 内置企业级 RAG 引擎,支持 PDF、PPT 等 20 + 文档格式的语义化处理,用户可上传私有文档构建知识库,配置 RAG 参数(如检索 Top-K 值、上下文长度)优化回答效果。

2. 智能助手(Agent,智能体)

- 概念解析:具备 “自主理解任务、规划步骤、调用工具、执行任务” 能力的 AI 模块,而非简单的 “问答机器人”。例如:“生成季度销售报告” 的 Agent 会先规划步骤(1. 调用数据库查询销售数据;2. 用 Excel 工具统计数据;3. 基于数据生成报告),再逐步执行。

- 核心构成:

- 任务理解:解析用户需求,明确目标;

- 规划能力:拆分复杂任务为可执行的子步骤;

- 工具调用:调用外部插件 / API(如数据库、邮件工具、计算器);

- 记忆能力:记住任务执行过程中的关键信息。

- Dify 中的关联:Dify 支持构建复杂 Agent,用户通过 “可视化工作流设计器” 配置 Agent 逻辑(如 “当用户问库存时,先调用 ERP 系统 API 查库存数据,再生成回答”),适配财务分析、旅游规划等场景。

3. LLMOps(LLM Operations)

- 概念解析:类比 “DevOps”(软件开发与运维一体化),指 “大语言模型应用的全生命周期管理”,涵盖模型选择、部署、监控、优化、成本控制等环节。

- 核心目标:保障 LLM 应用在生产环境中 “稳定、高效、低成本” 运行。

- Dify 中的关联:Dify 提供完整的LLMOps 监控体系,包含三大核心能力:

- 成本分析:统计不同模型的调用次数、token 消耗,计算成本;

- 效果评估:监测回答准确率、用户满意度,定位问题;

- 持续优化:支持模型切换、参数调优(如温度系数)、检索策略调整。

4. 模型编排(Model Orchestration)

- 概念解析:对 “多个开源 / 商业模型” 进行动态组合与调度,实现 “优势互补” 或 “成本优化”。例如:简单问答用低成本的开源模型(如 DeepSeek),复杂创作用高能力的商业模型(如 GPT-4);或用 A 模型生成初稿,B 模型优化润色。

- Dify 中的关联:Dify 独创 “蜂巢架构”,支持模型、插件、数据源的动态编排,用户可通过 “智能路由算法” 配置规则(如 “问答长度 < 100 字用 Llama 3,>100 字用 GPT-3.5”),实现成本降低 30%-50%。

5. 多模态(Multimodality)

- 概念解析:指 AI 模型能处理 / 生成 “多种类型的数据”(文本、图片、音频、视频),而非仅局限于文本。例如:输入图片生成描述文本、输入文本生成图片、输入语音转文字后回答。

- Dify 中的关联:Dify 支持多模态任务编排,用户可配置 “文本 + 图片” 的交互逻辑(如 “上传产品图片,生成商品描述文案”),或调用多模态模型(如 GPT-4V、通义千问 - V)实现跨模态功能。

三、应用实践层:适配 Dify 使用的 “落地概念”

这一层概念与 Dify 的实际操作、部署、安全相关,帮助用户解决 “如何用、如何保障安全” 的问题。

1. 私有化部署(Private Deployment)

- 概念解析:将 AI 应用的 “模型、数据、服务” 部署在企业自有的服务器 / 私有云环境中,而非使用公有云平台,数据不对外泄露。

- 适用场景:金融、医疗等对 “数据安全、合规” 要求高的行业(如医院的患者数据、银行的客户信息)。

- Dify 中的关联:Dify 支持私有化部署,用户可下载开源代码,将平台部署在企业内网,保障数据不流出,同时满足《数据安全法》《个人信息保护法》等合规要求。

2. RBAC 权限管理(Role-Based Access Control)

- 概念解析:基于 “用户角色” 分配系统权限的安全机制,即 “先定义角色(如管理员、开发者、普通用户),再给角色分配权限(如修改模型、查看日志、使用应用),用户关联角色后获得对应权限”。

- 关键价值:避免权限滥用,保障系统安全(如普通用户无法修改知识库数据)。

- Dify 中的关联:Dify 内置企业级 RBAC 权限管理,管理员可创建角色、分配功能权限(如 “开发者可配置模型,普通用户仅能使用应用”),适配企业多部门协作场景。

3. 插件 / 工具(Plugins/Tools)

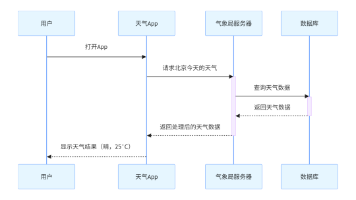

- 概念解析:扩展 AI 应用功能的 “模块化组件”,AI 可通过调用插件连接外部系统或获取特定服务。例如:天气插件(获取实时天气)、邮件插件(发送邮件)、数据库插件(查询数据)、API 插件(调用第三方服务)。

- Dify 中的关联:Dify 拥有 “插件生态系统”,内置丰富工具(如 Excel 分析、地图查询),同时支持用户自定义开发插件(通过 API 接口对接企业内部系统,如 ERP、CRM),扩展 AI 应用的业务边界。

4. 低代码 / 无代码(Low-Code/No-Code)

- 概念解析:两种降低开发门槛的模式:

- 低代码:通过 “可视化界面 + 少量代码” 开发应用;

- 无代码:完全通过 “拖拽、配置” 操作开发应用,无需编码。

- 关键价值:让非技术人员(如产品经理、运营)也能开发 AI 应用。

- Dify 中的关联:Dify 的 “AI 应用工厂”“Workflow Studio” 均采用低代码 / 无代码设计,用户通过拖拽组件、配置参数(如 Prompt 内容、检索范围),3 分钟即可创建智能客服、数据报告生成等应用。

5. 语义化处理(Semantic Processing)

- 概念解析:区别于 “关键词匹配”(仅找含相同关键词的内容),语义化处理能 “理解文本的深层含义”,即使表述不同,也能识别核心信息。例如:“如何降低人力成本” 与 “怎么减少员工开支” 语义一致,可检索到相同结果。

- 技术基础:基于 “向量数据库” 实现 —— 将文本转化为 “向量”(数字表示的语义特征),通过计算向量相似度找到语义相关的内容。

- Dify 中的关联:Dify 的 RAG 引擎支持语义化处理,上传的文档会被转化为向量存储,用户提问时能精准检索到 “语义相关” 的信息,而非仅匹配关键词。

总结:不同用户的知识掌握优先级

- 非技术用户(如运营、产品):优先掌握「基础认知层」(LLM、生成式 AI)+「应用实践层」(低代码、RAG 知识库上传、权限配置),能快速搭建标准化应用;

- 技术用户(如开发者):需额外掌握「核心技术层」(Agent 逻辑、模型编排、LLMOps 监控)+「高级实践」(插件开发、私有化部署),可定制复杂业务流与企业级方案。

理解这些概念后,能更清晰地判断 “Dify 的哪些功能适配业务需求”,并通过参数配置、流程编排实现高效的 AI 应用开发。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)