不看后悔!GitHub 开源 MultiTalk .8k star 强大的人语音+图像绑定项目

MultiTalk是一款开源的多角色对话视频生成框架,由MeiGen-AI开发。它能通过多路音频输入、参考图片和文本提示,生成唇音同步的多人对话视频,支持最长15秒内容。技术亮点包括L-RoPE机制解决音频角色绑定问题、TeaCache加速推理、APG优化长视频色彩一致性等。相比同类工具,MultiTalk在多人交互、唇动精度和场景多样性方面表现突出。适用于教学视频、营销内容、卡通动画等场景,支持

嗨,我是小华同学,专注解锁高效工作与前沿AI工具!每日精选开源技术、实战技巧,助你省时50%、领先他人一步。👉免费订阅,与10万+技术人共享升级秘籍!

MultiTalk 是一个音频驱动的、多人的对话视频生成框架。它接受多路音频输入、参考图片与文本提示,生成包含多个角色对话、且唇动与语音高度同步的视频内容。

项目介绍

MultiTalk 是由 MeiGen‑AI 开发的开源框架,旨在从音频输入、参考图片和提示语中生成多人对话视频。不仅支持单人讲话,还可创建虚拟人物之间的对话、情景互动、卡通角色说话或唱歌场景。可达 480p 或 720p 输出、最长支持 15 秒视频生成,是教学、虚拟人、娱乐短视频创作的利器。

痛点场景

-

传统视频制作成本高:真人拍摄、配音、后期耗时耗力;

-

唇动不真实:现有 TTS + 图像生成方法难以做到精准唇动同步;

-

多人对话绑定困难:一段音频对应多角色时,传统方法容易混音或角色错配;

-

缺乏交互性:很难根据指令控制虚拟角色的语气与表情。

MultiTalk 在这些方面提供了更灵活、更一致、更真实的视频生成体验。

核心功能亮点

-

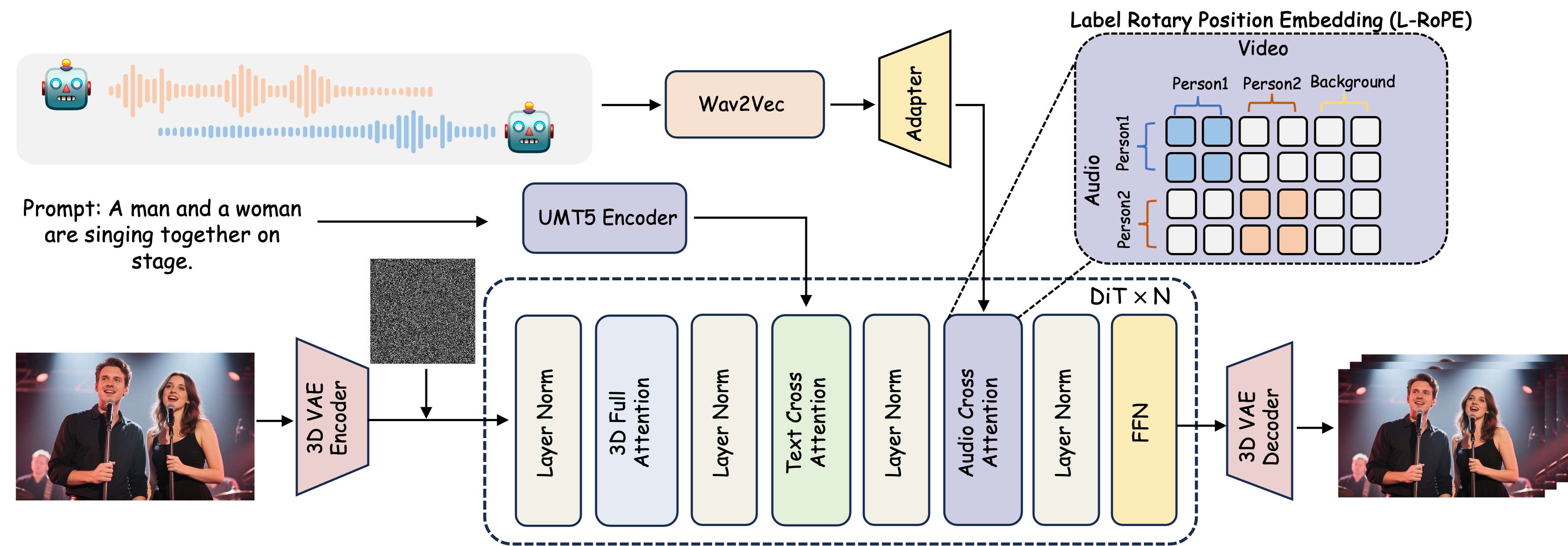

多人音频输入绑定:支持多路音频与对应角色绑定,通过 Label Rotary Position Embedding(L‑RoPE)机制解决音频与人物错位问题。

-

指令控制角色行为:通过 prompt 控制角色动作、语气、情景连接,实现交互式对话效果。

-

多场景通用性:支持卡通、唱歌、标准日常对话等多种场景下的视频生成。

-

分辨率灵活:支持 480p(单 GPU)及即将支持的 720p(多 GPU)。

-

长视频生成能力:支持最长约 15 秒的视频生成,部分用户通过 streaming 模式生成更长片段。

-

高效推理优化:集成 TeaCache(提升推理速度 2–3 倍)、APG(缓解长视频色差累积)、INT8 量化 LORA 加速。

-

Gradio 界面支持:提供简易界面 demo,可通过 Hugging Face Gradio 快速体验。

技术架构

以下流程图展示 MultiTalk 的整体生成流程:

技术优势整理表

| 技术模块 | 优势说明 |

|---|---|

| L‑RoPE 多音轨绑定 | 准确解决多个音轨与角色的绑定,避免错语和唇动不同步 |

| 分词 Prompt 控制 | 可控制角色语气与行为,实现多场景对话 |

| TeaCache + APG | 提升生成速度与颜色一致性,在长视频中稳定输出 |

| INT8 量化 & LoRA | 降低显存需求,可在低 VRAM 环境下推理 |

| 多 GPU / 单 GPU 支持 | 灵活部署,单 GPU 可跑 480p,群组设备可做 720p |

界面效果展示

目前官方尚无完整 GUI 屏幕截图,但有 Hugging Face 的 Gradio Demo,可体验 UI 操作如下:

-

输入角色参考图片、音频文件及提示语;

-

控制采样步数、是否开启 TeaCache、使用 INT8 模型;

-

生成完成后展示对话视频、可下载 MP4 文件。

部分用户反馈表示通过 ComfyUI‑WanVideoWrapper 集成使用 MultiTalk,效果也非常流畅。

应用场景示例

-

虚拟讲师教学视频:老师图片 + 语音输入,可快速生成教学对话片段;

-

企业介绍、营销视频:多角色对话介绍产品卖点,无需真人拍摄;

-

卡通动画创作:给卡通形象配音,让其进行对话、唱歌互动;

-

社交短视频内容:结合多角色音频与图片,制作幽默对话或合唱短片。

与同类项目对比

| 项目名称 | 多人支持 | 唇动同步准确度 | 控制方式 | 推理效率 | 场景丰富性 |

|---|---|---|---|---|---|

| MultiTalk | ✅ 支持 | ✅ 高(L‑RoPE) | ✅ Prompt 控制 | ✅ TeaCache、INT8、APG | ✅ 多种(唱歌、卡通、对话) |

| MuseTalk | ❌ 仅限单人 | ❌ 一般 | ❌ 不灵活 | ⚠️ 未优化 | ⚠️ 局限单场景 |

| Video‑retalking | ❌ 单人主线 | ⚠ 一般唇动偏差 | ❌ 静态音频绑定 | ⚠️ 效率中等 | ⚠️ 多为演讲类内容 |

| LatentSync | ✅ 可多角色说话 | ⚠ 爆破不稳定(咧嘴过度) | ⚠ UI 控制有限 | ❌ 需高显卡 | ⚠️ 单人优先 |

MultiTalk 在多人绑定、跨角色唇动同步、效率优化、场景多样性方面表现突出,技术领先。

使用示例(命令 + JSON)

{

"audio_paths": ["speaker1.wav","speaker2.wav"],

"reference_images": ["img1.png","img2.png"],

"prompt": [

{"speaker":0,"text":"欢迎大家!"},

{"speaker":1,"text":"谢谢介绍,我来说一下。"}

],

"fps":25,

"frames":81

}

对应命令:

python generate_multitalk.py \

--ckpt_dir weights/Wan2.1-I2V-14B-480P \

--wav2vec_dir weights/chinese-wav2vec2-base \

--input_json examples/multitalk_example.json \

--sample_steps 40 \

--mode streaming \

--use_teacache \

--save_file output.mp4

如需低显存运行,只需添加 --quant int8 和 --num_persistent_param_in_dit 0 参数,即可在 RTX 4090 单卡上稳定运行。

总结

MultiTalk 是目前开源社区在“多角色对话视频生成”方向上的翘楚,拥有高质量唇同步、多场景覆盖、灵活控制能力与优秀推理效率。无论是创作者、教育工作者还是短视频内容生产者,都是能显著提升效率与创意表达的工具。

项目地址

更多推荐

已为社区贡献17条内容

已为社区贡献17条内容

所有评论(0)