使用Llama-Factory进行模型训练与微调-环境准备与工具部署

本文介绍了在WSL环境下使用llama-factory进行大模型训练的完整流程。主要包括:1)安装WSL和Ubuntu;2)下载llama-factory项目;3)通过conda创建Python3.10运行环境;4)安装llama-factory及其依赖项;5)使用Qwen1.5-0.5B模型和内置数据集进行简单训练演示。文中详细说明了各步骤的具体操作命令和注意事项,特别针对安装过程中的常见问题提

本文档介绍如何准备环境,以及如何安装conda和Llama-factory等工具。

使用llama-factory预置的数据集进行模型的简单训练。

1. wsl环境准备

1.1 安装wsl及ubantu

安装完成后,你的应用目录中可以查询到Ubuntu图标,点击打开。

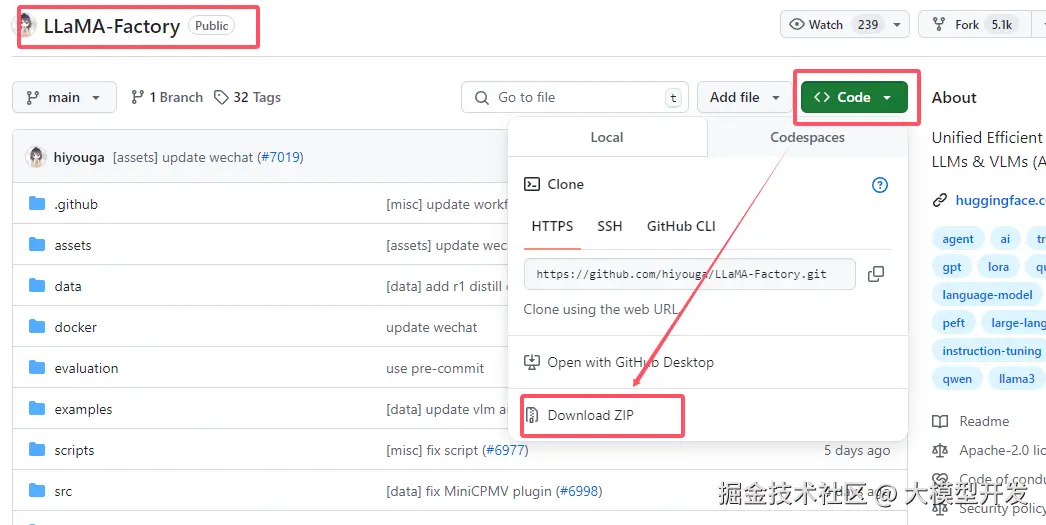

2. 下载llama-factory

llama-factory是一个零代码大模型训练平台,可以快速搭建模型训练环境,并提供丰富的模型训练功能。

前往github下载llama-factory项目的压缩包。

网盘压缩包内文件名:llama-factory.zip

拿到安装包后,可以将其解压到任意目录,如D:\llama-factory。

3. 安装conda

conda是Python的包管理工具,可以方便地安装、管理Python环境。

3.1 安装

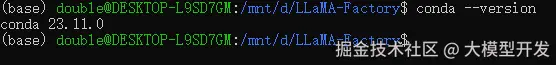

在D:\llama-factory目录下,linuxshell下打开命令提示符,依次输入以下命令安装conda,此处安装miniconda3:

#安装miniconda3wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh#运行安装脚本bash Miniconda3-latest-Linux-x86_64.sh#激活source ~/.bashrc#验证安装conda --version

安装过程注意按键盘上的Enter键,并在最后输入yes确认安装,直到安装完成,过程中你也可以切换安装路径,默认在/home/用户名目录下。至最终显示版本号,表示安装成功。

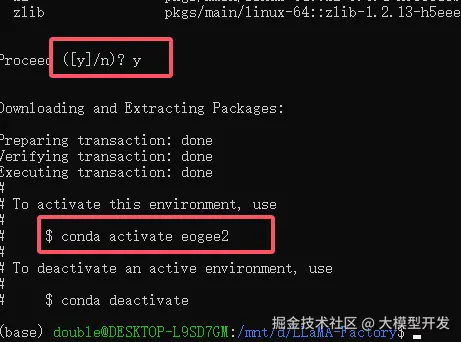

3.2 新增python运行环境

你可以使用conda创建多个Python运行环境,每个环境可以有不同的Python版本、依赖包等。

conda create -n eogee2 python=3.10

表示创建了一个名为eogee2的Python运行环境,版本为3.10。

安装过程较慢,如果发现报错,可以尝试重新运行安装命令。

3.3 激活环境

输入以下命令来激活刚刚创建的环境:

conda activate eogee2

3.4 其他python环境命令

#查看已创建的环境conda env list#删除环境conda remove -n eogee2 --all

4. 安装llama-factory

4.1 安装llama-factory

在llama-factory目录下,linuxshell下打开命令提示符,输入以下命令安装llama-factory:

#安装llama-factorypip install -e ".[torch,metrics]" -i https://pypi.tuna.tsinghua.edu.cn/simple

注意过程中需要按y键确认安装。

-e表示安装llama-factory为开发模式,可以实时更新代码。".[torch,metrics]"表示安装llama-factory所需的依赖包,包括torch和metrics两个包。torch是Python的深度学习框架metrics是llama-factory的评估指标库。

如果你是AMD显卡且支持rocm,可以尝试安装llama-factory的rocm版本:

pip install -e ".[rocm,metrics]"

-i后的内容表示使用过清华镜像,已解决下载安装过程过慢的问题。

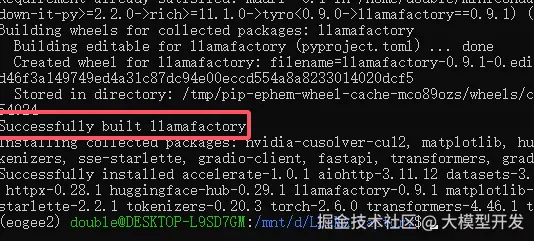

直至最终明确显示successfully built llamafactory字样,表示环境安装成功。

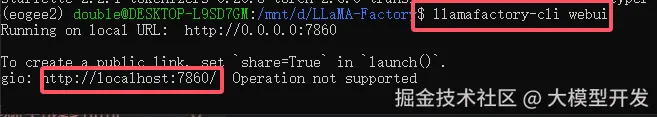

4.2 启动llama-factory

执行以下命令启动llama-factory:

llamafactory-cli webui

在浏览器中打开http://localhost:7860,进入llama-factory的界面。

5. 模型训练

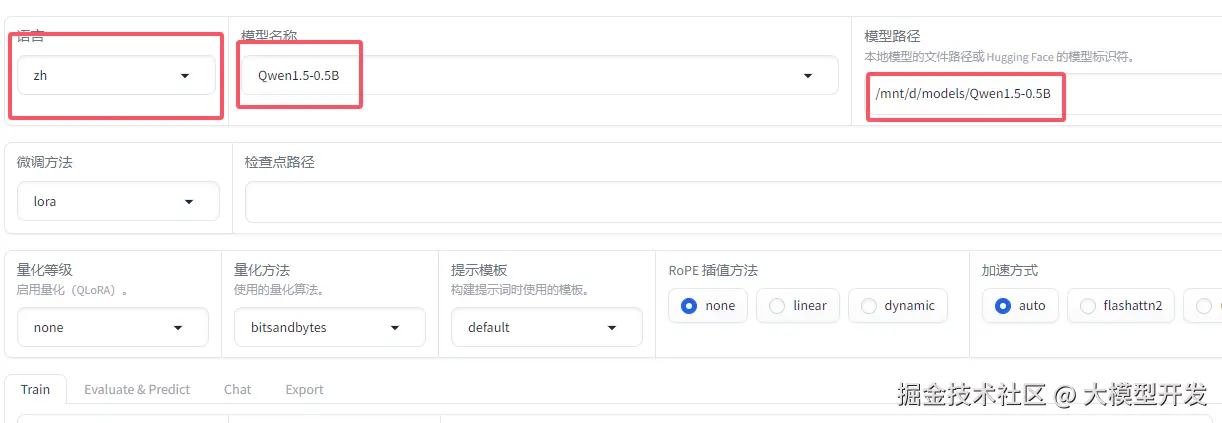

5.1 选择被训练模型

你可以提前在hf-mirror下载得到QWEN1.5-0.5B模型,我们选取已知最小的模型用于测试。

网盘内文件名为:Qwen1.5-0.5B.zip

下载完成后,解压压缩包,得到Qwen1.5-0.5B文件夹。你可以将其拷贝到D:\models目录下。

由于我们在ubantu环境下进行训练,需要在模型路径中填写ubantu系统中的相对路径,如:

/mnt/d/models/Qwen1.5-0.5B

你可以在右上角将语言设置为zh中文,以便阅读。

注意

如果你载入Qwen3系列模型报transformers的错,表示当前安装的 transformers 库不支持 qwen3 这个模型架构。这通常是因为:你使用的 transformers 版本太旧,不支持这个新模型或者这个模型非常新,还没有被正式版本的 transformers 收录

解决方案:首先尝试升级 transformers 库

在你的对应的python环境下,更新transformers:

pip install --upgrade transformers

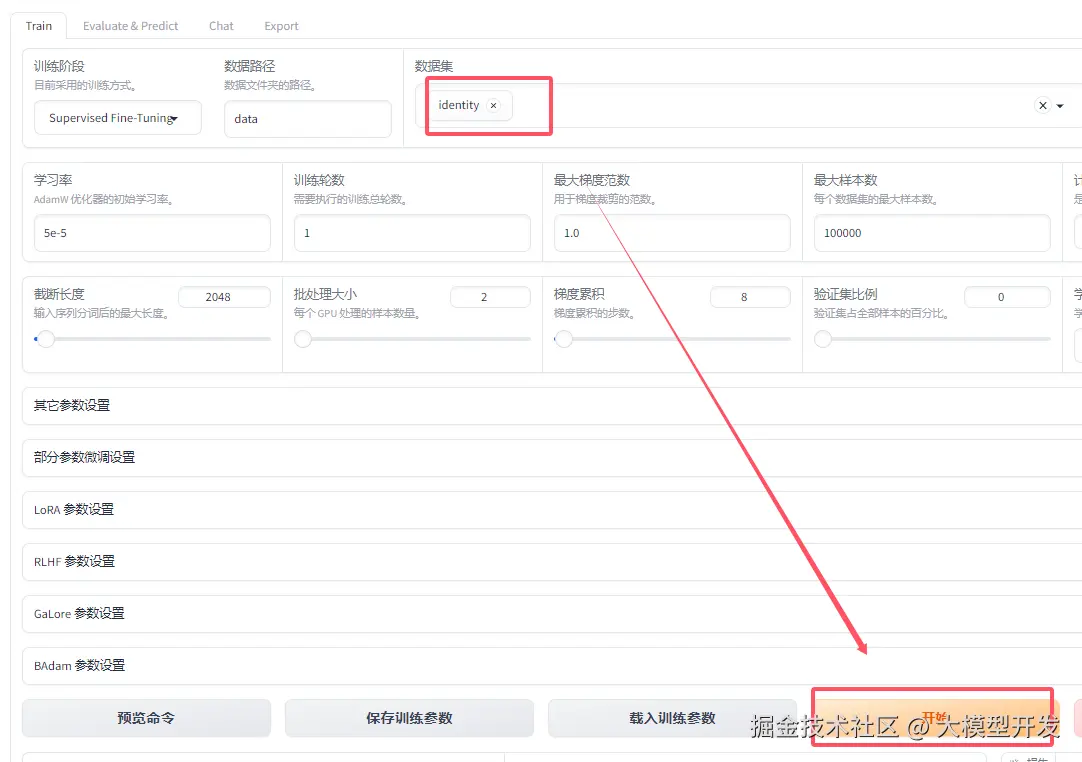

5.2 调整训练参数,选择数据集

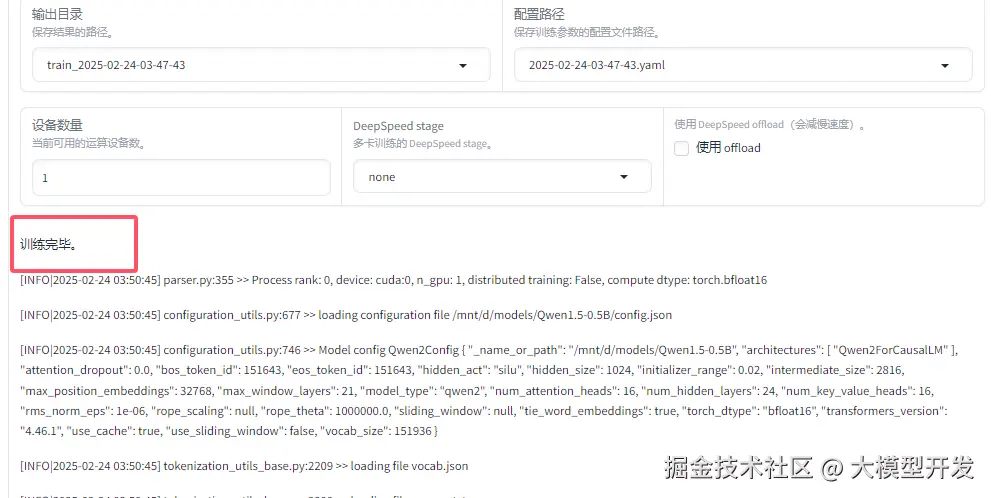

我们在界面下方选择llama-factory的自带的数据集identity,选择训练轮数为1,选择梯度为1,以加快训练速度(这种训练参数的设置会造成训练效果不好的状况,此处仅作演示)。设置完成后,点击开始训练按钮。

当界面中提示训练完成,即表示我们本次模型训练初体验成功。

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

事实上,抢你饭碗的不是AI,而是会利用AI的人。

继科大讯飞、阿里、华为等巨头公司发布AI产品后,很多中小企业也陆续进场!超高年薪,挖掘AI大模型人才! 如今大厂老板们,也更倾向于会AI的人,普通程序员,还有应对的机会吗?

与其焦虑……

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高。

针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等

这份 LLM大模型资料 包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 下方小卡片领取🆓↓↓↓

更多推荐

已为社区贡献138条内容

已为社区贡献138条内容

所有评论(0)