扣子Coze重磅开源!详细部署教程

字节跳动开源AI智能体平台Coze核心功能,采用Apache2.0协议可商用。开源项目包含CozeStudio(一站式AI开发工具)和CozeLoop(运维平台),支持工作流设计等核心功能。部署过程需配置大模型并使用Docker,虽然相比商业版功能有所精简,但技术架构采用DDD设计,展现字节强大技术实力。随着Dify等开源平台竞争加剧,Coze的开源标志着AI智能体赛道进入白热化阶段,未来或将持续

大家好,我是羊仔,专注AI编程、智能体、AI工具。

早上醒来刷手机,差点被一条消息给震醒:字节跳动的Coze竟然开源了!而且还是Apache 2.0协议,直接可商用!

一、一觉醒来,Coze开源

说起来,羊仔折腾AI工具也有一年多了。从最开始玩ChatGPT,到后来折腾各种开源大模型,再到研究Dify、n8n这些工作流平台,基本上市面上的热门工具都玩过一遍。

但Coze开源这件事,真的让羊仔有点意外,要知道,Coze的企业版HiAgent可是百万级别的产品,字节这次直接把核心功能开源出来,这背后的战略意图太明显了——就是要在AI Agent平台这个赛道上抢占制高点。

想想也是,现在Dify这些开源平台发展得如火如荼,但商业授权一直是个痛点。字节这一招真的是绝了,直接Apache 2.0协议,告诉大家:来吧,随便用,随便改,随便商用!

二、Coze究竟开源了个啥?

在咱们动手之前,得先搞明白,字节这次到底给了我们什么东西。

这次开源的核心是两个项目:

-

Coze Studio:这是一个一站式的AI Agent(智能体)开发工具。你可以把它想象成一个超级乐高工坊,里面有各种各样的零件(比如Prompt编排、知识库、插件、工作流),你可以通过拖拉拽的方式,轻松搭建出你想要的任何AI机器人。

-

Coze Loop:这个更偏向开发者,是一个专注于AI Agent开发和运维的平台。如果说Coze Studio是造机器人的工厂,那Coze Loop就是这个工厂的“中控室”和“维修部”,负责监控机器人的运行状态,确保它们7x24小时稳定工作。

简单来说,字节几乎是把Coze平台最核心的功能都开放出来了。

虽然和功能齐全的线上版比,它更像一个“毛坯房”,比如官方自带的插件少了一些,大家很喜欢的画图功能也暂时没开源,但最重要的核心——工作流设计功能,被原封不动地保留了下来。

这才是它的灵魂!有了它,我们就能设计出各种复杂、强大的自动化流程,让AI帮我们完成各种任务。

三、说干就干,直接部署

看到这个消息,羊仔的第一反应就是:赶紧试试!于是羊仔二话不说,打开电脑就开始折腾。

这里给大家分享一下具体的部署过程,真的比想象中简单多了。

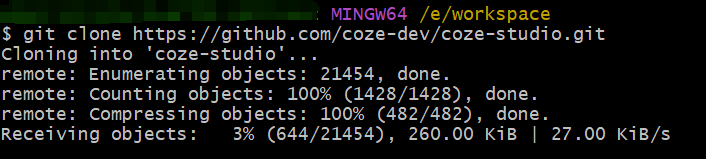

第一步:获取源码

首先当然是从GitHub拉取代码:

git clone https://github.com/coze-dev/coze-studio.git羊仔这里遇到了一个小插曲,因为GitHub的访问速度时好时坏,下载了好几次都失败了,最后还是用镜像下载才行。

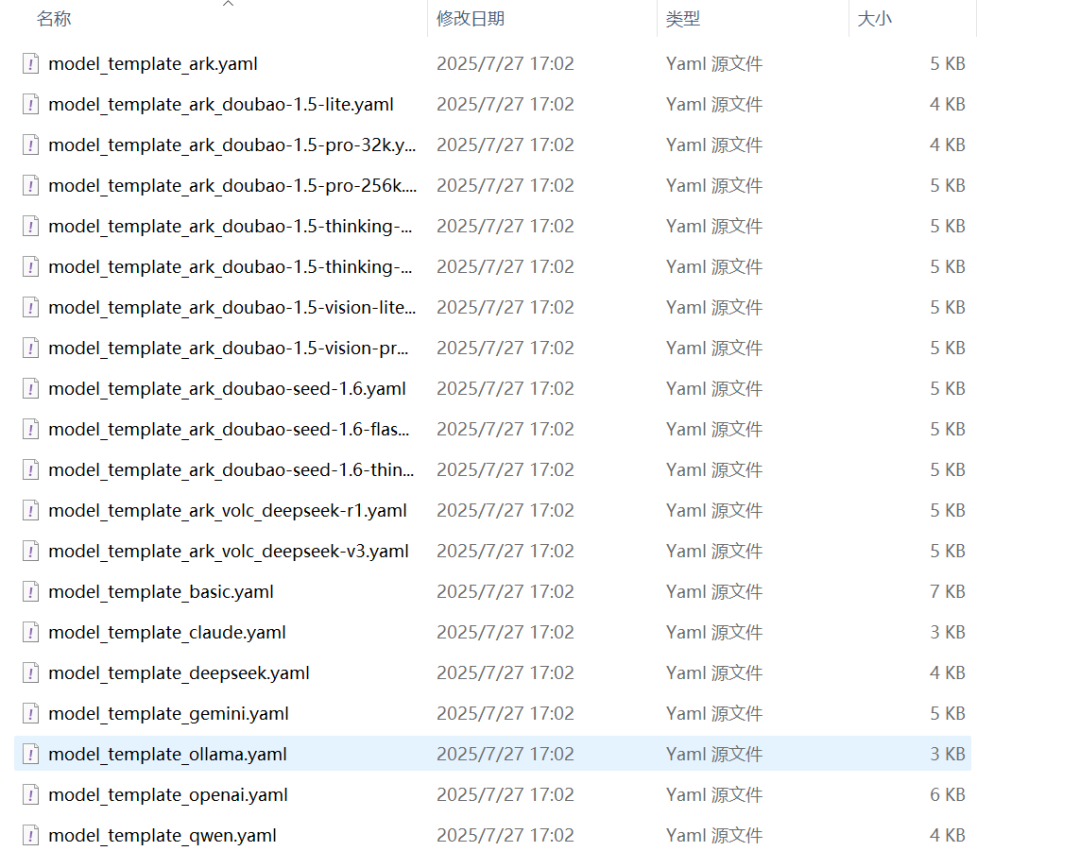

第二步:配置大模型

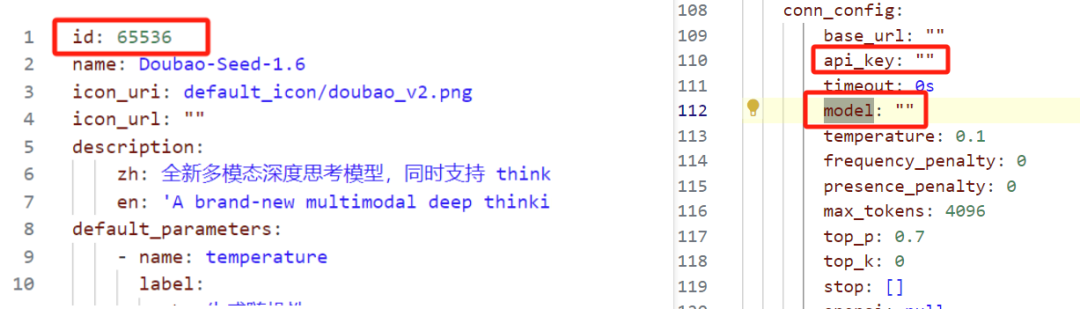

这一步是关键。开源版的Coze本身不带模型,需要我们自己配置一个"大脑",Coze很贴心的提供了很多模板,在 backend\conf\model\template 目录下。

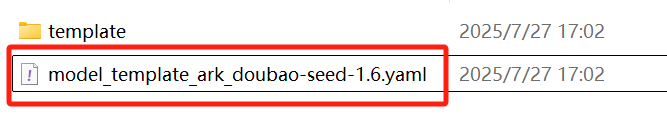

羊仔选择了豆包模型,主要是因为便宜好用,而且是字节自家的,兼容性应该不错。

配置过程其实很简单,先复制一个模板文件到 backend/conf/model 目录。

然后填入三个关键参数:

-

-

id:随便填一个整数就行

-

api_key:从火山方舟获取

-

model的endpoint:也是从火山方舟获取

-

这里羊仔要吐槽一下,火山方舟的界面有点复杂,找API Key和创建推理接入点的流程不太直观。

不过好在官方文档比较完善,按照官方文档一步步来,还是能搞定的,官方文档地址如下。

api key文档:

https://www.volcengine.com/docs/82379/1541594

推理接入点文档:

https://www.volcengine.com/docs/82379/1099522

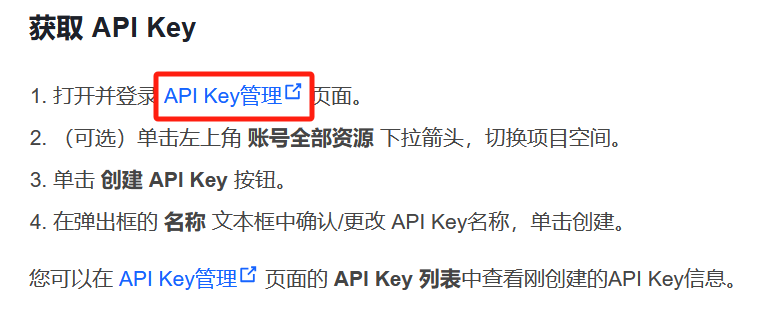

先打开api key文档,点击【API Key管理】。

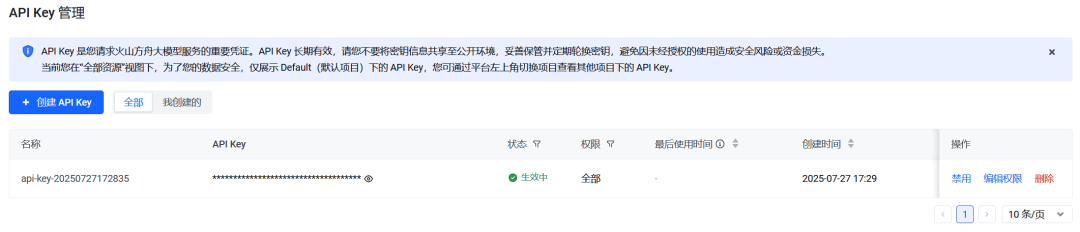

按照文档的步骤创建API Key。

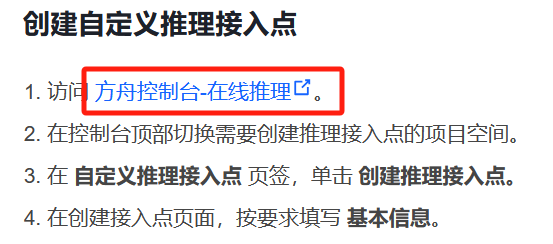

推理接入点也是按照官方文档操作。

找到自定义推理接入点,点击【创建推理接入点】:

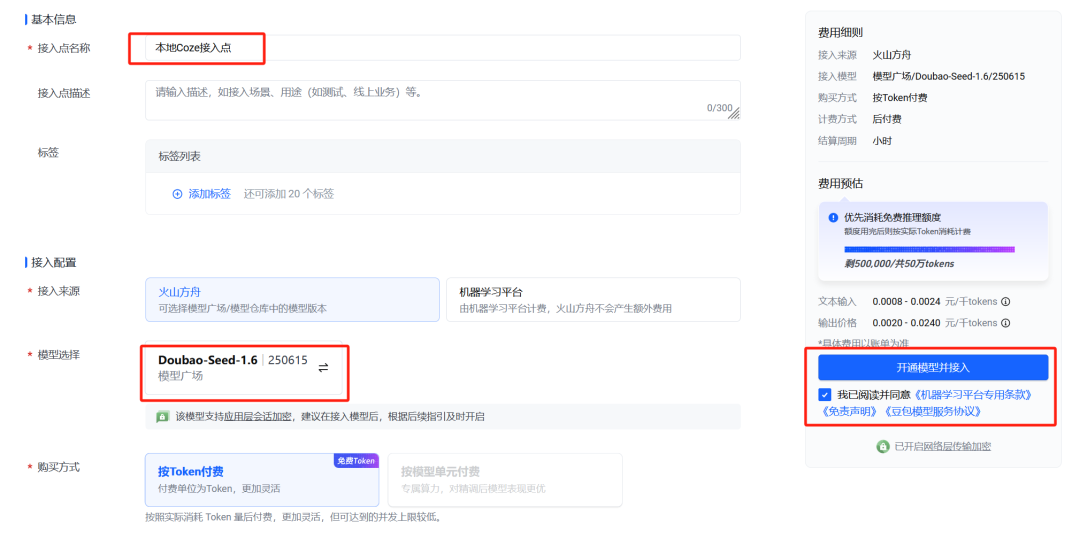

输入名称,选择模型,这里选的豆包1.6模型,然后点击【开通模型并接入】:

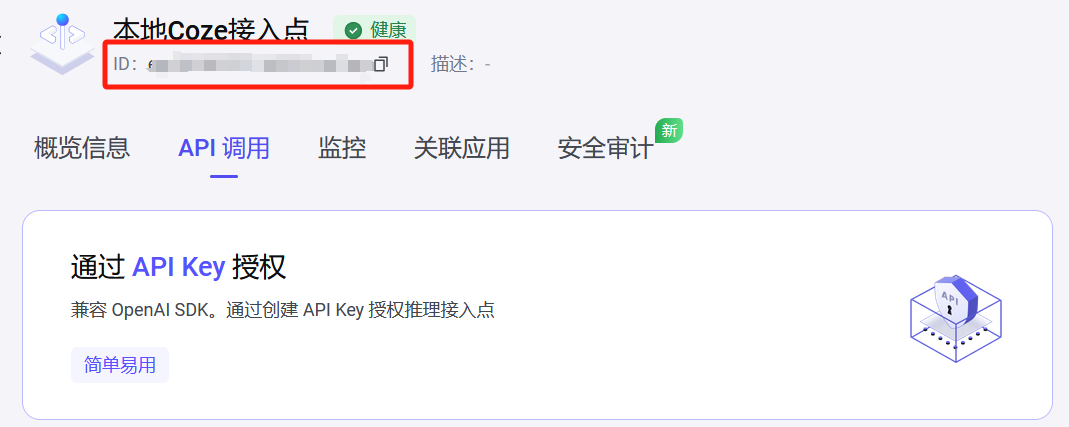

开通后就能看到Endpoint ID了,点旁边的复制按钮即可。

第三步:Docker部署

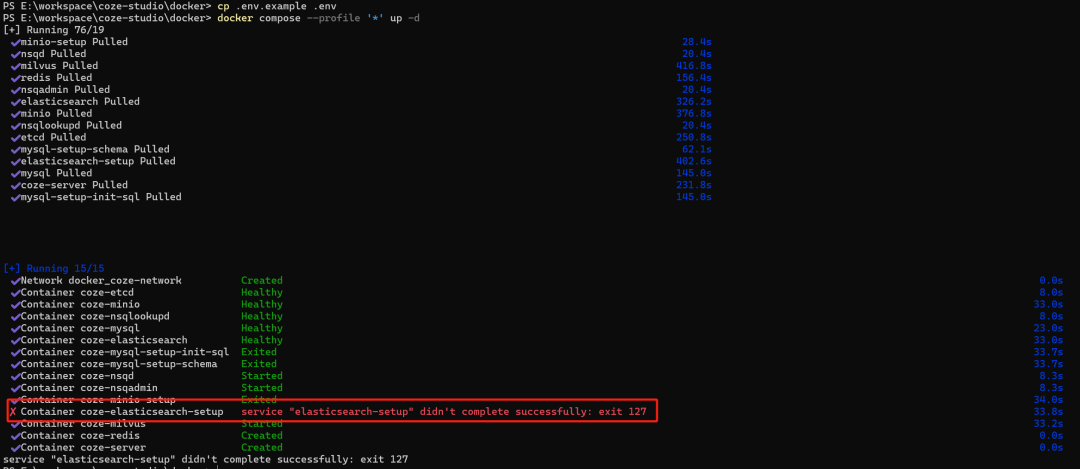

这一步就很爽了,直接用Docker一键部署:

cd docker

cp .env.example .env

docker compose --profile '*' up -d第一次部署需要等一会儿,要下载各种镜像,可能还会报这个错。

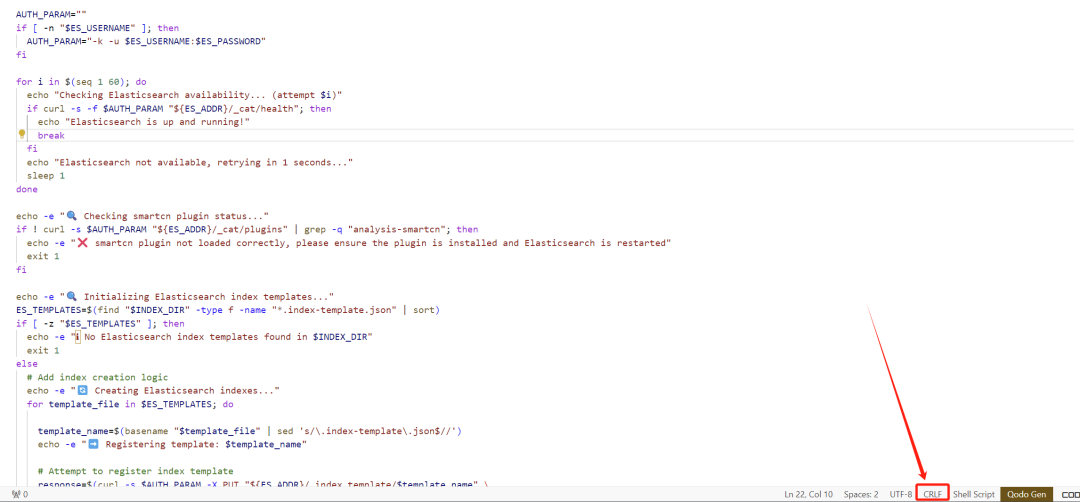

是因为

docker\volumes\elasticsearch\setup_es.sh

文件的换行符格式默认是“CRLF”,要改成Linux的“LF”格式。

然后重新运行,就OK了。

四、初体验:惊喜与遗憾并存

当羊仔在浏览器输入http://localhost:8888,看到熟悉又陌生的Coze界面时,心情还是挺复杂的。

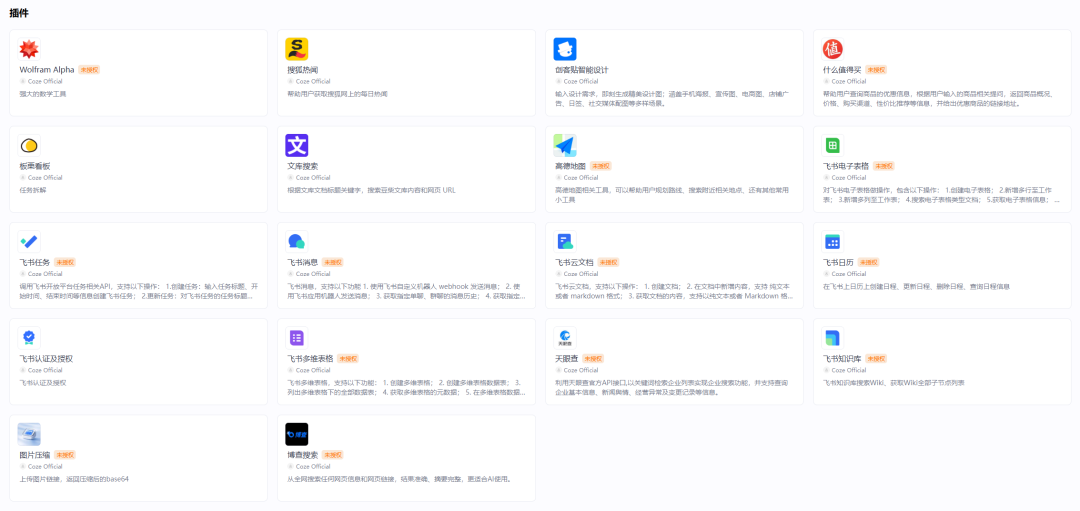

说熟悉,是因为界面风格和在线版基本一致;说陌生,是因为功能确实被阉割了不少。插件只有18个,图像生成和画板功能都没有,确实有种"乞丐版"的感觉。

但是!核心的工作流、知识库功能是完整的。羊仔试着搭建了一个简单的客服机器人,从对话处理到知识库检索,再到条件判断,整个流程跑得非常顺畅。

五、技术架构让人眼前一亮

作为一名程序员,羊仔忍不住深入研究了一下Coze Studio的代码结构,不得不说,字节的技术功底真的很扎实。

整个项目采用了经典的DDD(领域驱动设计)架构:

backend/

├── domain/ # 灵魂:领域层,业务逻辑的核心

│ ├── agent/ # 智能体

│ ├── workflow/ # 工作流

│ ├── knowledge/ # 知识库

│ └── ...

├── application/ # 应用层,协调领域对象完成业务流程

├── infra/ # 基础设施层,与外部依赖(DB, Cache等)解耦

└── api/ # 接口层,暴露HTTP API这种设计的好处是职责清晰,便于维护和扩展,而且大量使用了字节自家的CloudWeGo微服务框架,说明这不是临时拼凑的项目,而是经过生产验证的成熟方案。

六、这颗子弹,还会再飞一会儿

从Dify、n8n到现在的Coze Studio,开源的AI Agent平台选择越来越多,说明这个赛道已经进入了白热化的竞争阶段。

虽然Coze Studio的开源版目前看还只是第一步,功能上和它那成熟的“商业大哥”相比还有差距。

但这毕竟是字节啊,考虑到它强大的生态和恐怖的迭代速度,我们完全有理由相信,这颗子弹还会再飞一会儿。

如果你也对AI智能体感兴趣,赶紧动手去试试吧。

共勉!

欢迎关注羊仔,一起探索AI,成为超级个体!

如果你喜欢这篇文章,不妨点赞,收藏,转发。

你的每一次互动,对羊仔来说都是莫大的鼓励。

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)