AI原生应用中的语音识别与合成:打造多模态交互体验

什么是AI原生应用?我是「AI交互实验室」的创始人,深耕语音交互与多模态技术8年,曾主导过多个AI原生应用的语音交互设计(比如某头部教育APP的口语练习模块、某智能音箱的对话系统)。我喜欢用通俗易懂的语言分享技术干货,希望能帮更多开发者打造「有温度的AI应用」。如果你想了解更多语音交互的内容,可以关注我的公众号「AI交互实验室」,或者在GitHub上找我(ID:ai-interaction-lab

AI原生应用的语音交互革命:从识别到合成,打造沉浸式多模态体验

摘要/引言:为什么语音交互是AI原生应用的「灵魂」?

早上7点,你揉着眼睛喊「小爱同学,帮我订一杯热美式,送到公司楼下」;开车时,你说「导航到最近的加油站,顺便播放周杰伦的歌」;晚上睡前,你对着手机说「读一下今天的会议纪要,用温柔的声音」——这些场景早已不是科幻电影里的片段,而是我们日常的「AI交互时刻」。

但你有没有发现,大多数语音交互还停留在「命令-响应」的机械阶段:你说「打开微信」,它就打开微信;你说「天气怎么样」,它就报天气。这种交互像「敲命令行」,而不是「和人对话」。

真正的AI原生应用,需要的是**「有温度、会理解、能配合」的语音交互**——比如你说「我今天加班好累」,它不仅会用低沉的声音回应「辛苦了,要不给你点份爱吃的红烧肉?」,还会在屏幕上弹出美食APP的推荐界面;比如你用语音写邮件时,它会自动把「明天下午2点的会」转换成日历提醒,同时显示「是否需要添加参会人?」的弹窗。

这就是多模态语音交互的魅力:语音不再是孤立的输入/输出方式,而是和文字、视觉、手势等模态深度融合,形成「像和人聊天一样自然」的体验。

本文将带你拆解AI原生应用中语音交互的两大核心技术——语音识别(ASR)与语音合成(TTS),并结合多模态设计原则,教你如何从0到1打造「沉浸式语音交互体验」。无论你是AI开发者、产品经理还是交互设计师,都能从本文中找到可落地的方法。

一、AI原生应用:重新定义交互的底层逻辑

在讲语音交互前,我们需要先明确一个关键概念:什么是AI原生应用?

1.1 从「AI插件」到「AI原生」的进化

传统应用的AI功能是「附加题」——比如微信的语音转文字、淘宝的智能客服,都是在原有功能上「加了个AI模块」。而AI原生应用的核心逻辑由AI驱动:

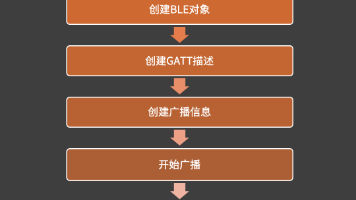

- 架构上:从「前端-后端-数据库」变成「感知层(ASR/TTS/视觉)-理解层(LLM)-执行层(多模态输出)」;

- 交互上:不再依赖「点击-输入」的传统模式,而是支持「语音/文字/手势」的多模态输入;

- 价值上:不是「帮用户完成任务」,而是「理解用户需求,主动提供解决方案」。

比如ChatGPT App就是典型的AI原生应用:你可以用语音提问,它用语音回答,同时显示文字和相关链接;你问「怎么煮奶茶」,它不仅会说步骤,还会弹出食材购买链接和视频教程——这就是「AI原生」的交互逻辑。

1.2 语音交互是AI原生的「第一入口」

为什么语音是AI原生应用的核心交互方式?因为语音是人类最自然的沟通方式:

- 效率更高:每分钟能说150-200个字,是打字速度的3-4倍;

- 场景更广:开车、做饭、运动等「双手被占用」的场景,语音是唯一可行的交互方式;

- 情感更丰富:语调、语速、语气能传递文字无法表达的情绪(比如「我没事」的冷淡语气,比文字更能反映真实心情)。

对AI原生应用来说,语音交互不是「可选功能」,而是「必须具备的基础能力」——就像手机必须有屏幕、汽车必须有方向盘一样。

二、语音识别(ASR):从「听懂」到「理解」的进化

语音识别(Automatic Speech Recognition,ASR)的核心是「把声音转换成文字」,但AI原生应用需要的ASR,早已不是「能转文字就行」,而是**「能理解上下文、能适应复杂场景、能实时响应」**。

2.1 ASR的基础流程:从音频到文字的「翻译机」

先帮大家补一下ASR的基础逻辑,流程大致分为5步:

- 音频采集:用麦克风收集声音(比如手机的麦克风、智能音箱的阵列麦克风);

- 预处理:去除噪音(比如环境中的汽车声、风声)、归一化音量(把小声和大声调整到同一幅度);

- 特征提取:将音频转换成计算机能理解的特征(比如梅尔频谱图,类似「声音的指纹」);

- 模型识别:用AI模型把特征转换成文字(比如Whisper、Conformer);

- 后处理:纠正识别错误(比如把「今天天气真好」中的「针好」改成「真好」)。

2.2 AI原生应用对ASR的「高阶要求」

传统ASR只需要「准确率高」,但AI原生应用的ASR需要满足4个核心需求:

(1)实时性:「说完即识别」的流畅感

想象一下,你和AI聊天时,说一句话要等3秒才出文字——这种体验比打字还糟。AI原生应用的ASR必须支持流式处理(Streaming ASR):边听边识别,说完1秒内出结果。

比如ChatGPT App的语音输入,你刚说完「今天的会议」,屏幕上就实时显示「今天的会议」,完全没有延迟。

(2)上下文理解:「能懂弦外之音」

传统ASR是「孤立识别」——比如你说「把文件发给张三」,它能识别;但你接着说「把刚才的文件发给李四」,它就不知道「刚才的文件」指什么。而AI原生应用的ASR需要结合上下文:

- 短期上下文:记住最近3-5轮对话的内容(比如「刚才的文件」指上一句的「文件」);

- 长期上下文:关联用户的历史数据(比如「我的快递」指用户最近买的商品)。

实现这一点的关键是把ASR和LLM结合:ASR输出的文字传给LLM做语义理解,LLM返回「上下文增强的结果」。比如:

- 用户说「我想买奶茶」→ ASR识别「我想买奶茶」→ LLM理解「用户想点奶茶,需要推荐附近的店」→ 系统回应「附近有喜茶和奈雪,要帮你点吗?」

(3)复杂场景适应:「噪音里也能听清你」

现实场景中,声音会被各种噪音干扰:比如地铁里的人声、厨房的抽油烟机声、会议室的回声。AI原生应用的ASR需要抗噪能力:

- 麦克风阵列:用多个麦克风收集声音,通过算法过滤噪音(比如智能音箱的6麦阵列);

- 噪音鲁棒模型:用带噪音的数据集训练ASR(比如Whisper训练时用了大量噪音数据);

- 端侧处理:在手机/手表等设备上本地处理音频,避免传输过程中的噪音干扰。

(4)多语言/方言支持:「不管你说什么,我都懂」

全球化的AI原生应用需要支持多语言(比如英语、中文、西班牙语),甚至方言(比如粤语、四川话)。比如Whisper模型支持100多种语言,PaddleASR支持20多种方言——这让应用能覆盖更广泛的用户群体。

2.3 AI原生ASR的「关键技术」

想满足以上需求,需要用到这些主流技术:

(1)端到端模型:从「分步处理」到「一步到位」

传统ASR是「模块化」的(比如先做特征提取,再做声学模型,再做语言模型),而端到端模型(End-to-End ASR)把所有步骤整合到一个模型里,比如:

- CTC(连接主义时间分类):解决「音频长度和文字长度不匹配」的问题(比如10秒音频对应5个文字);

- Transformer/Conformer:用自注意力机制捕捉长距离的语音特征(比如「今天天气」中的「今天」和「天气」的关联);

- Whisper:OpenAI的端到端模型,支持多语言、抗噪音,是AI原生应用的「首选ASR模型」。

(2)轻量级模型:「手机上也能跑」

AI原生应用很多是移动端的(比如手机APP、智能手表),需要ASR模型「小而快」。常用的轻量级技术:

- 模型蒸馏:用大模型(比如Whisper Large)训练小模型(比如Whisper Tiny),保持准确率的同时缩小体积;

- 量化:把模型的参数从32位浮点型转换成8位整型,体积缩小4倍,速度提升2-3倍;

- 剪枝:去掉模型中「不重要的神经元」(比如很少激活的权重),减少计算量。

(3)上下文增强:「LLM+ASR」的组合拳

如前所述,LLM是ASR理解上下文的关键。具体实现方式:

- 用ASR把语音转换成文字;

- 把文字和「对话历史」一起传给LLM;

- LLM返回「上下文理解后的结果」(比如修正歧义、补充缺失信息)。

比如用户说「把那个文件发给张三」,ASR识别「把那个文件发给张三」,LLM结合对话历史(上一句是「我昨天发的会议纪要」),理解「那个文件」指「昨天的会议纪要」,最终输出「把昨天的会议纪要发给张三」。

2.4 实战:用Whisper实现实时ASR

下面用Python和Whisper实现一个「实时语音识别」的小 demo,让你快速体验AI原生ASR的效果:

(1)准备环境

安装需要的库:

pip install whisper sounddevice numpy

(2)代码实现

import whisper

import sounddevice as sd

import numpy as np

# 1. 加载Whisper模型(选Tiny版,适合移动端)

model = whisper.load_model("tiny")

# 2. 配置录音参数(Whisper要求16kHz采样率)

SAMPLE_RATE = 16000 # 采样率

DURATION = 5 # 每次录音5秒

def record_audio():

"""录制音频(16kHz,单声道)"""

audio_data = sd.rec(

int(DURATION * SAMPLE_RATE),

samplerate=SAMPLE_RATE,

channels=1,

dtype=np.float32

)

sd.wait() # 等待录音完成

return audio_data.flatten() # 转换成一维数组

def real_time_asr():

"""实时语音识别"""

print("开始实时识别(按Ctrl+C停止)...")

try:

while True:

# 录制音频

audio = record_audio()

# 用Whisper识别(指定中文)

result = model.transcribe(audio, language="zh")

# 输出结果

print(f"识别结果:{result['text'].strip()}")

except KeyboardInterrupt:

print("\n停止识别")

if __name__ == "__main__":

real_time_asr()

(3)运行效果

运行代码后,对着麦克风说话,5秒后会输出识别结果。比如你说「今天天气真好」,会输出「今天天气真好」——这就是最基础的实时ASR。

如果你想优化,可以尝试:

- 用「流式Whisper」(比如

whisper-streaming库)实现「边说边识别」; - 结合LLM(比如ChatGLM-6B)做上下文理解;

- 用PaddleLite部署到手机,实现离线识别。

三、语音合成(TTS):从「发声」到「传情」的突破

语音合成(Text-to-Speech,TTS)的核心是「把文字转换成声音」,但AI原生应用需要的TTS,早已不是「能说话就行」,而是**「像人一样有情感、能个性化、能实时响应」**。

3.1 TTS的基础流程:从文字到声音的「播音员」

TTS的基础流程分为4步:

- 文本分析:处理文字(比如把「123」转换成「一百二十三」,把「ISBN」转换成「艾森」);

- 韵律建模:决定声音的节奏、语调、重音(比如「我很高兴」中的「很」要重读);

- 声学建模:把文字和韵律转换成「声学特征」(比如基频、振幅);

- 声码器:把声学特征转换成真实的声音波形(比如WAV文件)。

3.2 AI原生应用对TTS的「高阶要求」

传统TTS只需要「发音准确」,但AI原生应用的TTS需要满足4个核心需求:

(1)自然度:「像和真人聊天一样」

传统TTS的声音是「机械音」——比如早期的「导航语音」,语调平板,没有情感。而AI原生应用的TTS需要**「类人语音」**:

- 有自然的停顿(比如「我今天/去了公园」,而不是「我今天去了公园」);

- 有语调变化(比如疑问句结尾会升调,陈述句结尾会降调);

- 有语气词(比如「嗯」「哦」「呀」,让声音更亲切)。

比如抖音的「文字转语音」功能,能生成「可爱萌妹音」「磁性男声」,甚至「东北方言」——这些都是自然度的体现。

(2)个性化:「我的声音我做主」

不同用户有不同的声音偏好:比如年轻人喜欢「活泼的萌妹音」,中年人喜欢「稳重的男声」,甚至有人想让AI用「自己的声音」说话。AI原生应用的TTS需要支持个性化定制:

- 声音风格选择:提供多种预设声音(比如温柔、搞笑、专业);

- 个性化克隆:用用户的5-10分钟录音,生成「专属声音」(比如用自己的声音读小说);

- 情感调节:允许用户调整声音的情感(比如「开心」「悲伤」「愤怒」)。

(3)实时性:「说完即回应」

和ASR一样,TTS也需要实时合成(Streaming TTS)——比如你问AI「今天天气怎么样」,它要在1秒内开始说话,而不是等3秒才出声。实时TTS的关键是「流式生成」:把文字分成小块,逐块合成声音,边合成边播放。

(4)多模态联动:「声音+视觉的同步」

AI原生应用的TTS不是「孤立发声」,而是要和视觉模态联动:

- 语音播放时,屏幕显示「说话的动画」(比如嘴巴一张一合);

- 强调某个词时,屏幕上的文字会「高亮」(比如说「明天下午2点的会」,「2点」会变红);

- 情感变化时,屏幕显示对应的「表情」(比如说「我很开心」,会显示笑脸)。

3.3 AI原生TTS的「关键技术」

想满足以上需求,需要用到这些主流技术:

(1)神经TTS:从「拼接语音」到「生成语音」

传统TTS是「拼接法」——把预先录制的「语音片段」拼接成完整的句子(比如把「我」「很」「开心」的片段拼起来),但这种方法不自然。而神经TTS(Neural TTS)用AI模型生成全新的声音,比如:

- Tacotron 2:Google的神经TTS模型,能生成自然的韵律和语调;

- VITS(Variational Inference with adversarial learning for end-to-end TTS):目前最流行的神经TTS模型,支持实时合成、情感调节、个性化克隆;

- Flow-TTS:用流模型生成声音,速度比Tacotron 2快3-5倍。

(2)情感合成:「让声音有情绪」

情感合成的核心是「给声音添加情感标签」,常用方法有两种:

- 显式情感标签:用户指定情感(比如「开心」「悲伤」),模型根据标签调整声音的基频、语速、振幅(比如开心时基频高、语速快);

- 隐式情感理解:用LLM分析文字中的情感(比如「我今天丢了钱包」中的「悲伤」),自动调整声音的情感。

比如,当用户输入「我今天考试考了100分!」,LLM分析出「开心」的情感,TTS生成「高基频、快语速、带笑意」的声音。

(3)个性化TTS:「克隆你的声音」

个性化TTS的关键是少样本学习(Few-shot Learning)——用用户的少量录音(比如5分钟),生成「和用户声音一致」的TTS模型。常用技术:

- 迁移学习:用预训练的TTS模型(比如VITS),用用户的录音微调模型;

- 音色嵌入(Speaker Embedding):把用户的声音转换成一个「向量」,输入到TTS模型中,生成用户的声音;

- 扩散模型(Diffusion Model):用扩散模型生成更真实的个性化声音(比如Stable TTS)。

(4)实时TTS:「边合成边播放」

实时TTS的核心是「流式生成」,常用方法:

- 分块处理:把文字分成「语块」(比如每5个字一块),逐块合成声音;

- 增量生成:每合成一块声音,就立即播放,同时处理下一块;

- 轻量级模型:用小模型(比如Tiny VITS),减少每块的合成时间。

3.4 实战:用VITS实现情感TTS

下面用Hugging Face的VITS模型,实现一个「带情感的文本转语音」demo:

(1)准备环境

安装需要的库:

pip install transformers torch soundfile

(2)代码实现

from transformers import VitsModel, AutoTokenizer

import torch

import soundfile as sf

# 1. 加载模型和Tokenizer(选支持情感的中文模型)

model_name = "facebook/mms-tts-zh-cn" # Facebook的多语言TTS模型

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = VitsModel.from_pretrained(model_name)

# 2. 定义文本和情感(这里用「开心」的情感)

text = "我今天考试考了100分!太开心啦!"

emotion = "happy" # 情感标签:happy/sad/angry/neutral

# 3. 预处理文本(添加情感标签)

inputs = tokenizer(

text,

return_tensors="pt",

add_special_tokens=True

)

# 注:部分模型支持直接传入情感标签,比如「emotion_embedding」,这里用简单的文本增强

inputs["input_ids"] = torch.cat([

tokenizer.encode(f"<{emotion}>"), # 情感前缀

inputs["input_ids"][0]

]).unsqueeze(0)

# 4. 生成语音

with torch.no_grad():

output = model(**inputs)

# 5. 保存语音

audio_data = output.audio[0].cpu().numpy()

sample_rate = model.config.sampling_rate

sf.write("happy_voice.wav", audio_data, sample_rate)

print("情感TTS生成完成!已保存为happy_voice.wav")

(3)运行效果

运行代码后,会生成一个「开心语气」的语音文件——比如「我今天考试考了100分!太开心啦!」的声音,会比普通TTS更活泼、更有笑意。

如果你想优化,可以尝试:

- 用支持情感的专用模型(比如「EmoTTS」);

- 结合LLM分析文本情感(比如用ChatGLM-6B分析「我今天丢了钱包」的情感是「悲伤」);

- 用VITS实现实时合成(比如

streaming-vits库)。

四、多模态融合:让语音交互更「有温度」

有了ASR和TTS,还不是「完整的语音交互」——AI原生应用需要的是**「多模态融合的语音交互」**:语音和文字、视觉、手势等模态一起工作,形成「1+1>2」的体验。

4.1 多模态交互的「设计原则」

在设计多模态语音交互时,需要遵循4个核心原则:

(1)自然性:「符合人类的交互习惯」

人类的交流本来就是多模态的:比如你和朋友聊天时,会用手势、表情、语气配合文字。AI原生应用的交互要「模仿人类」:

- 语音输入时,显示「实时转文字」(让用户确认识别是否正确);

- 语音输出时,显示「对应的文字」(方便用户回看);

- 提到「图片」时,自动弹出「图片预览」(比如你说「看一下昨天的聚会照片」,屏幕显示照片)。

比如Apple的Siri:当你说「天气怎么样」,它会用语音报天气,同时显示「天气图表」——这就是自然的多模态交互。

(2)互补性:「各模态各司其职」

每个模态都有自己的优势,要让它们「互补」而不是「重复」:

- 语音:适合快速输入、情感表达;

- 文字:适合精确编辑、保存记录;

- 视觉:适合展示复杂信息(比如图表、图片);

- 手势:适合短平快的操作(比如挥挥手暂停语音)。

比如「写会议纪要」的场景:

- 用语音输入「今天的会议讨论了三个议题」(快速);

- 用文字修正「议题一的时间是明天下午2点」(精确);

- 用视觉显示「会议纪要的思维导图」(清晰)。

(3)容错性:「允许用户犯错」

语音交互容易出错(比如口音、噪音),多模态融合要「包容错误」:

- 识别错了,允许用户用文字修正(比如ASR把「张三」识别成「张山」,用户可以直接改文字);

- 合成错了,允许用户重新生成(比如TTS把「会计」读成「kuai ji」,用户可以点「重新朗读」);

- 系统自动纠错(比如用LLM修正ASR的错误,把「我想喝查」改成「我想喝茶」)。

(4)个性化:「适配用户的习惯」

不同用户有不同的交互习惯:比如老年人喜欢「大字体+慢语速」,年轻人喜欢「简洁界面+快语速」。多模态交互要「个性化」:

- 允许用户选择「默认模态」(比如开车时默认语音,办公时默认文字);

- 记忆用户的「常用设置」(比如用户常选「萌妹音」,下次自动用这个声音);

- 根据场景自动切换模态(比如在安静的图书馆,自动降低语音音量,切换成文字)。

4.2 多模态融合的「技术实现」

多模态融合的核心是「模态间的信息传递」——比如ASR的文字传给LLM,LLM的结果传给TTS和视觉组件。具体实现流程:

(1)输入层:多模态输入

用户可以用「语音+文字+手势」输入:

- 语音输入:用ASR转换成文字;

- 文字输入:直接传给LLM;

- 手势输入:用视觉模型(比如MediaPipe)识别手势(比如「点赞」对应「确认」)。

(2)理解层:LLM做「中枢大脑」

LLM接收所有输入的信息,做「语义理解+决策」:

- 理解用户需求(比如「我想喝奶茶」→ 需求是「点奶茶」);

- 决定输出模态(比如需要「语音回应+视觉推荐」);

- 生成输出内容(比如「附近有喜茶和奈雪,要帮你点吗?」+ 店铺链接)。

(3)输出层:多模态联动

LLM的输出传给各个模态组件:

- 语音输出:用TTS合成声音,播放给用户;

- 文字输出:显示在屏幕上,方便用户回看;

- 视觉输出:显示对应的图片、图表、链接;

- 动作输出:比如智能机器人的「点头」「挥手」。

4.3 多模态交互的「经典场景」

下面举几个AI原生应用中常见的多模态语音交互场景,帮你理解如何落地:

场景1:智能教育APP——「口语练习」

- 输入:学生用语音读英语句子(「I love reading books」);

- ASR:识别成文字,同时分析发音(比如「books」的「s」读错了);

- LLM:理解「学生在练习口语,需要纠正发音」;

- 输出:

- 语音:用TTS生成「标准发音」(「books」的正确读法);

- 文字:显示「你的「books」读错了,正确发音是/bʊks/」;

- 视觉:显示「发音嘴型动画」(比如舌头的位置);

- 交互:弹出「再练一次」的按钮。

场景2:智能办公APP——「会议纪要」

- 输入:用户用语音说「把今天的会议纪要发给张三」;

- ASR:识别成文字;

- LLM:理解「用户要发会议纪要,需要关联历史数据(今天的会议纪要)和联系人(张三)」;

- 输出:

- 语音:「好的,我会把今天的会议纪要发给张三」;

- 文字:显示「已为你准备会议纪要,是否添加备注?」;

- 视觉:弹出「会议纪要预览」和「张三的联系方式」;

- 动作:自动把会议纪要添加到邮件草稿,等待用户发送。

场景3:智能娱乐APP——「故事朗读」

- 输入:用户用语音说「读一下《小王子》的第一章,用温柔的声音」;

- ASR:识别成文字;

- LLM:理解「用户要听《小王子》第一章,需要温柔的声音」;

- 输出:

- 语音:用TTS生成「温柔的声音」朗读第一章;

- 文字:显示「《小王子》第一章」的内容,同步高亮当前读的句子;

- 视觉:显示「小王子的插画」,随朗读进度切换;

- 交互:弹出「调整语速」「切换声音」的按钮。

五、实战案例:从理论到落地的真实场景

为了让你更直观地理解AI原生应用的语音交互,下面分享两个真实案例:

案例1:ChatGPT App——「极简却强大的语音交互」

ChatGPT App是AI原生应用的「标杆」,它的语音交互设计非常值得学习:

- ASR:用Whisper模型,支持实时识别、多语言、抗噪音;

- TTS:用OpenAI自研的神经TTS模型,支持自然的语调、实时合成;

- 多模态融合:

- 语音输入时,屏幕显示「实时转文字」(让用户确认);

- 语音输出时,显示「对应的文字」(方便回看);

- 提到「链接」时,自动弹出「链接预览」;

- 支持「语音+文字」混合输入(比如用户说一半,用文字补全)。

成功点:把「简单」做到了极致——没有复杂的设置,用户打开APP就能用语音聊天,体验流畅自然。

案例2:某儿童AI故事机——「情感化的多模态交互」

这是一款针对3-10岁儿童的AI故事机,它的语音交互设计非常贴合儿童的需求:

- ASR:用PaddleASR的儿童语音模型,支持儿童的「奶声奶气」和「口齿不清」;

- TTS:用VITS的儿童声音模型,支持「可爱」「活泼」「温柔」三种情感;

- 多模态融合:

- 讲故事时,屏幕显示「动画」(比如讲《白雪公主》时,显示白雪公主的卡通形象);

- 儿童提问时,故事机会「点头」「眨眼」(动作模态);

- 儿童说「我害怕」,故事机会用「温柔的声音」安慰,同时显示「笑脸」;

- 支持「语音+触摸」交互(比如儿童摸故事机的耳朵,会切换故事)。

成功点:用「情感化+多模态」抓住了儿童的注意力——儿童不仅能听故事,还能「和故事机互动」,体验像「和朋友聊天」一样。

六、开发者指南:手把手打造你的语音交互模块

现在,你已经理解了AI原生应用中语音交互的核心技术和设计原则,下面教你从0到1打造一个语音交互模块:

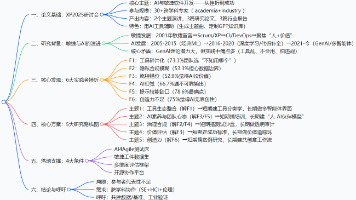

6.1 步骤1:明确需求与场景

首先,你需要明确:

- 目标用户:是儿童、老年人、职场人还是全球化用户?

- 核心场景:是教育、办公、娱乐还是生活服务?

- 关键需求:是实时性、抗噪音、个性化还是多模态融合?

比如,如果你要做一个「职场办公APP」,核心需求可能是:

- 实时语音转文字(会议纪要);

- 上下文理解(关联历史会议);

- 多模态输出(文字+图表+邮件)。

6.2 步骤2:技术选型

根据需求选择合适的ASR和TTS技术:

(1)ASR选型

| 需求 | 推荐技术 | 原因 |

|---|---|---|

| 通用场景 | Whisper | 多语言、抗噪音、准确率高 |

| 中文优化 | PaddleASR | 针对中文方言、口音优化 |

| 移动端/离线 | TinyConformer、Whisper Tiny | 轻量级、速度快 |

| 实时流式 | Streaming Whisper、WeNet | 边听边识别,延迟低 |

(2)TTS选型

| 需求 | 推荐技术 | 原因 |

|---|---|---|

| 高自然度 | VITS、Tacotron 2 | 生成类人语音,支持情感调节 |

| 个性化克隆 | VITS+Few-shot、Stable TTS | 用少量录音生成专属声音 |

| 实时合成 | Streaming VITS、EdgeTTS | 边合成边播放,延迟低 |

| 多语言 | MMS-TTS、Whisper TTS | 支持100+语言 |

(3)LLM选型

- 通用场景:ChatGLM-6B、Llama 2(开源,适合本地部署);

- 高精度场景:GPT-4、Claude 3(闭源,API调用方便)。

6.3 步骤3:模型优化与部署

选好技术后,需要对模型进行优化,以适应目标设备(比如手机、服务器):

(1)端侧优化(移动端/嵌入式设备)

- 模型压缩:用蒸馏、量化、剪枝缩小模型体积(比如把Whisper Large压缩到100MB以内);

- 框架转换:用ONNX、TensorRT、PaddleLite把模型转换成端侧支持的格式;

- 离线推理:把模型部署到设备本地,不需要联网(保护隐私,提升速度)。

(2)云侧优化(服务器)

- 批量处理:把多个用户的请求批量处理,提升GPU利用率;

- 分布式部署:用Kubernetes、Docker部署多实例,应对高并发;

- 动态缩放:根据用户量自动调整服务器数量(比如早高峰增加实例,晚高峰减少)。

6.4 步骤4:多模态交互设计

根据之前的设计原则,设计交互流程:

(1)绘制交互流程图

比如「会议纪要」场景的流程:

- 用户说「把今天的会议纪要发给张三」;

- ASR识别成文字,传给LLM;

- LLM理解「需要发送今天的会议纪要给张三」;

- 系统从数据库中获取「今天的会议纪要」;

- 用TTS生成语音「好的,我会把今天的会议纪要发给张三」;

- 显示「会议纪要预览」和「张三的联系方式」;

- 自动生成邮件草稿,等待用户发送。

(2)设计视觉反馈

- 语音输入时:显示「波动的音量条」+「正在听…」;

- 识别完成时:显示「识别结果」+「确认/修改」按钮;

- 合成语音时:显示「说话的动画」+「正在说…」;

- 输出结果时:显示「文字内容」+「相关图表/链接」。

6.5 步骤5:测试与迭代

最后,需要用真实用户测试,收集反馈,不断迭代:

(1)测试指标

- ASR准确率:用WER(字错误率)衡量(比如WER<5%是优秀);

- TTS自然度:用MOS(平均意见得分)衡量(比如MOS>4.5是优秀);

- 交互流畅度:用「从输入到输出的延迟」衡量(比如延迟<1秒是优秀);

- 用户满意度:用问卷、访谈收集用户反馈(比如「你觉得这个交互自然吗?」)。

(2)迭代方法

- A/B测试:测试两种交互流程(比如「语音输入后直接发送」vs「语音输入后显示确认按钮」),选效果好的;

- 快速迭代:每周发布一个小版本,修复用户反馈的问题;

- 持续优化:根据用户行为数据(比如「用户常用语音输入还是文字输入」)调整交互设计。

七、挑战与展望:未来语音交互会如何进化?

虽然AI原生应用的语音交互已经取得了很大进步,但还有很多挑战需要解决:

7.1 当前的挑战

- 复杂场景的ASR准确率:比如多人对话(分不清谁在说话)、跨语言对话(比如中英混合);

- TTS的情感真实度:比如细微的情绪变化(比如「假装开心」vs「真开心」);

- 多模态的协同效率:比如语音、视觉、动作的同步(比如语音说了「点头」,但动作延迟了1秒);

- 隐私问题:语音数据包含大量个人信息(比如口音、情绪),用户担心泄露。

7.2 未来的方向

- 更强大的上下文理解:结合LLM的长上下文记忆(比如记住用户1个月前的对话),理解「弦外之音」;

- 情感计算的深化:通过语音语调、 facial expression、文本内容综合判断情感(比如「用户说「我没事」,但语调低沉,所以需要安慰」);

- 端云协同的优化:轻量级模型在端侧处理实时任务(比如ASR),云侧模型处理复杂任务(比如个性化TTS);

- 隐私保护技术:用联邦学习(在本地训练模型,不传输原始数据)、差分隐私(添加噪声保护数据)、本地推理(不在云端处理数据)保护用户隐私;

- 人机共融的交互:语音交互不仅是「人指挥AI」,而是「AI主动配合人」(比如你在写报告时,AI自动用语音提醒「你可能漏了某个数据」)。

结论:语音交互是AI原生应用的「护城河」

AI原生应用的竞争,最终是「交互体验」的竞争——而语音交互是最能体现「AI温度」的交互方式。

从ASR的「听懂」到「理解」,从TTS的「发声」到「传情」,再到多模态的「融合」,语音交互的进化,本质上是「让AI更像人」的过程。

对开发者来说,打造好语音交互的关键不是「用最先进的技术」,而是「从用户需求出发」——比如儿童需要「可爱的声音+动画」,职场人需要「高效的语音转文字+多模态输出」,老年人需要「慢语速+大字体」。

最后,我想给你一个行动号召:用Whisper+VITS+LLM搭建一个简单的多模态语音交互原型,比如「语音聊天机器人」——你会发现,原来打造「有温度的AI交互」并不难。

如果你在实践中遇到问题,欢迎在评论区留言——我会和你一起讨论解决!

附加部分

参考文献/延伸阅读

- Whisper论文:《Robust Speech Recognition via Large-Scale Weak Supervision》;

- VITS论文:《Conditional Variational Autoencoder with Adversarial Learning for End-to-End Text-to-Speech》;

- 多模态交互经典书籍:《Multimodal Interaction: Designing Interfaces for Users》;

- 中文ASR技术:PaddleASR官方文档(https://github.com/PaddlePaddle/PaddleSpeech);

- 中文TTS技术:VITS官方文档(https://github.com/jaywalnut310/vits)。

致谢

感谢OpenAI、Google、Facebook等公司的开源贡献,感谢Hugging Face、PaddlePaddle等社区的工具支持——没有这些开源资源,普通开发者很难快速实现语音交互功能。

作者简介

我是「AI交互实验室」的创始人,深耕语音交互与多模态技术8年,曾主导过多个AI原生应用的语音交互设计(比如某头部教育APP的口语练习模块、某智能音箱的对话系统)。我喜欢用通俗易懂的语言分享技术干货,希望能帮更多开发者打造「有温度的AI应用」。

如果你想了解更多语音交互的内容,可以关注我的公众号「AI交互实验室」,或者在GitHub上找我(ID:ai-interaction-lab)。

互动话题:你在做语音交互时遇到过最头疼的问题是什么?欢迎在评论区分享!

更多推荐

已为社区贡献121条内容

已为社区贡献121条内容

所有评论(0)