企业私有化部署 AI 大模型:到底要不要 Token?费用怎么算?小算台一文讲透

企业私有化部署 AI 大模型无需 Token,因模型在本地闭环运行,仅需厂商授权文件。但需付费,含软件许可、部署服务及硬件成本,费用模式与云端 API 不同。小算台通过定制硬件和纳管系统监控资源、优化成本,适配数据敏感、高并发等场景,降本提效。

在 AI 大模型落地过程中,企业最常问的两个问题是:“私有化部署需要 Token 吗?”“是不是一次性买断就完事了?” 事实上,这两个问题背后藏着私有化部署的核心逻辑 —— 与公有云 API 服务不同,私有化部署是 “把模型请回家”,但 “回家” 的规则、成本和保障都有讲究。小算台结合 50 + 企业部署经验,用直白的语言 + 真实案例拆解其中关键,帮你避开 “隐性成本坑”。

一、私有化部署要不要 Token?一句话说清

不需要,但要有 “准入证”

很多用过公有云 API(如 OpenAI、讯飞星火)的企业会有惯性思维:调用模型必须先申请 Token。但私有化部署的逻辑完全不同 ——

为什么不需要 Token?

Token 的本质是云端 API 的 “门禁卡”:每次调用厂商的云端服务,都需要用 Token 验证身份、记录调用量(用于计费)。比如你用 ChatGPT API 生成文案,每 1000 个 token 收费 0.02-0.15 美元,Token 既是授权凭证也是计费单位。

而私有化部署是 “模型在企业自己服务器上跑”:模型文件、推理过程、数据交互全在企业内网闭环完成,不经过厂商的云端网关。用户通过企业自己的系统(如内部 OA、APP)调用模型,就像用自己电脑里的软件,自然不需要厂商的 Token 来 “开门”。

某金融企业的实操场景很典型:其部署的客服大模型接入内部 CRM 系统,客户经理在系统内输入客户问题,模型直接在本地服务器生成回复,全程数据不流出企业内网,既不需要 Token,也避免了数据泄露风险。

那需要什么 “准入证”?

虽然不需要 Token,但厂商会提供软件授权文件(License),这是私有化部署的 “合法身份证”,包含三大核心信息:

-

权限边界:明确企业可部署的模型版本(如基础版 / 精调版)、功能模块(如多模态、长文本处理);

-

规模限制:通常会约定支持的服务器节点数(如≤5 个节点)、GPU 核心数(如≤16 卡)、最大并发用户数(如≤500 人);

-

时效与服务:授权有效期(如 1 年 / 3 年)、是否包含厂商的技术支持(如 7×24 小时故障响应)。

举个例子:某制造企业采购的私有化模型 License 约定 “16 卡 GPU 集群内可部署,含 2 年免费升级 + 5×8 小时技术支持”,超过 16 卡或到期未续费,模型可能会限制部分功能或需要重新授权。

二、私有化部署要付费吗?

不仅要,而且是 “组合账单”

“把模型请回家” 不是免费的 —— 私有化部署的核心是 “购买模型的使用权 + 部署权”,费用结构比公有云 API 复杂,但更可控。

费用构成:三大块支出必须算清楚

1. 软件许可费:最核心的 “模型使用费”

这是企业为 “使用模型知识产权” 支付的费用,类似买软件的 “永久授权” 或 “年度订阅”,常见两种模式:

-

一次性买断:支付高额费用(几十万到数百万)获得某版本模型的永久使用权,适合长期使用且模型迭代慢的场景(如传统行业质检模型)。但后续升级新版本需额外付费,类似买 Office 2021 永久版,想升 Office 2024 得再掏钱。

-

订阅许可:按年 / 按季度付费(几万到几十万 / 年),包含期间的版本升级和基础支持,适合 AI 技术迭代快的场景(如互联网企业的智能推荐模型)。某电商企业选择 “3 年订阅”,每年支付 28 万,期间免费升级了 3 次模型版本,成本比买断更灵活。

计费参考:70 亿参数基础模型的年度订阅费约 20-50 万,精调至垂直领域(如金融、医疗)后费用会增加 30%-50%;千亿参数模型的许可费通常百万级起步。

2. 服务费:让模型 “落地跑起来” 的必要投入

私有化部署不是 “给个安装包就完事”,需要厂商提供专业服务,常见费用包括:

-

部署实施费:厂商工程师上门部署、配置环境、对接企业系统(如 OA、ERP)的一次性费用,按人天收费(约 2000-5000 元 / 人天),70 亿参数模型的部署通常需要 5-10 人天。

-

定制开发费:如果需要针对企业数据精调模型(如用 10 万条内部文档训练)、开发专属功能(如对接企业知识库),按需求复杂度收费,精调一个垂直领域模型的费用约 10-30 万。

-

运维支持费:年度服务费,通常为许可费的 10%-20%,包含故障排查、补丁更新、性能优化等,某车企支付的年度运维费为许可费的 15%(约 4.5 万 / 年),保障生产线质检模型全年稳定运行。

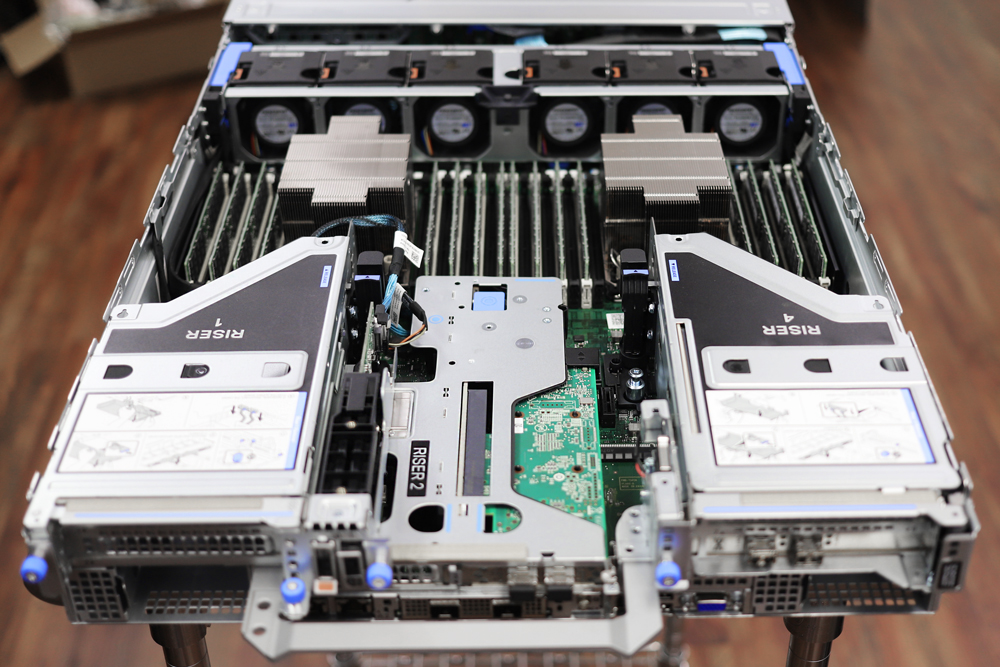

3. 基础设施费:企业自己要掏的 “硬件成本”

模型运行需要强大的算力支撑,这部分由企业自行承担,核心包括:

| 模型规模 | 推荐硬件配置 | 单年成本参考(含硬件折旧 + 电费) |

|---|---|---|

| 70 亿参数推理 | 4 卡 A100 服务器(80GB 显存)+ 全闪存储(2TB) | 约 15 万(硬件采购 35 万,按 3 年折旧) |

| 70 亿参数训练 | 8 卡 A100 集群(NVLink 互联)+ 分布式存储(10TB) | 约 40 万(硬件采购 100 万,按 3 年折旧) |

| 千亿参数训练 | 32 卡 H100 集群(400Gbps 网络)+ 液冷系统 | 约 200 万(硬件采购 500 万,按 3 年折旧) |

比公有云 API 贵?算清 “总拥有成本” 更重要

很多企业觉得私有化部署初期投入高,但长期看未必:某律所对比了两种模式 ——

-

公有云 API:按每月 10 万次调用,每次 0.5 元计算,年费用 60 万,且数据需上传云端,合规风险高;

-

私有化部署:一次性许可费 30 万 + 硬件 15 万 + 服务费 5 万,首年总成本 50 万,次年起仅需运维费 5 万 + 硬件折旧 5 万,年成本 10 万,3 年总成本比 API 模式节省 70 万。

三、小算台如何帮企业 “降本提效”?

硬件 + 纳管双保障

私有化部署的核心挑战是 “成本可控 + 稳定运行”,小算台通过 “定制化硬件方案 + 轻量化纳管系统” 解决痛点:

1.按需匹配硬件,避免 “高配浪费”

小算台会根据模型规模、并发需求推荐性价比配置,比如:

-

中小企推理场景:用 4 卡 L40S 服务器(48GB 显存)替代 A100,成本降低 40%,完全满足 70 亿参数模型的 500 并发需求;

-

弹性租赁模式:训练任务可短期租赁 H100 集群(按天计费,每天 8000 元),避免长期闲置,某 AI 企业用此模式节省 60% 硬件成本。

2.算力纳管系统:让模型 “跑稳、跑省”

小算台算力纳管系统针对私有化场景设计轻量功能,不增加 IT 负担:

-

资源监控与预警:实时监控 GPU 利用率、显存占用,当检测到某节点负载超 90% 时自动预警,避免模型因资源不足崩溃(某案例中减少 80% 意外中断);

-

成本精细化管理:统计各部门的模型调用量、硬件消耗,生成成本分摊报表,帮企业发现 “低价值高频调用”(如某部门用大模型处理简单格式转换,优化后节省 20% 算力);

-

授权合规校验:自动匹配 License 约定的部署规模,避免因超配导致的授权失效风险。

四、企业决策指南:私有化部署适合谁?

不是所有企业都需要私有化部署,这三类场景最值得投入:

-

数据敏感型:金融、医疗、政务等行业,数据不能流出内网(如病历、交易记录);

-

高并发稳定型:生产线质检、客服等高可用场景,不能接受公有云的波动延迟;

-

长期大用量型:年调用量超 100 万次,私有化的长期成本更低。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)