AI 应用出海美国,内容合规要点解读 | 出海合规

2015 年,欧洲难民危机一再升级,网络仇恨言论开始成为欧盟立法机构与网络巨头争论的焦点。以Facebook 为例,Facebook 在其社区守则中将“仇恨言论”定义为“针对他们受保护的特征,而非观念或习俗直接发起的直接言论攻击,这些特征包括:民族、种族、原国籍、残疾、宗教信仰、种姓、性取向、性别、性别认同,以及严重疾病”,并明确禁止在平台上发布仇恨言论。转变发生在 2011 年,这一年联邦裁定,

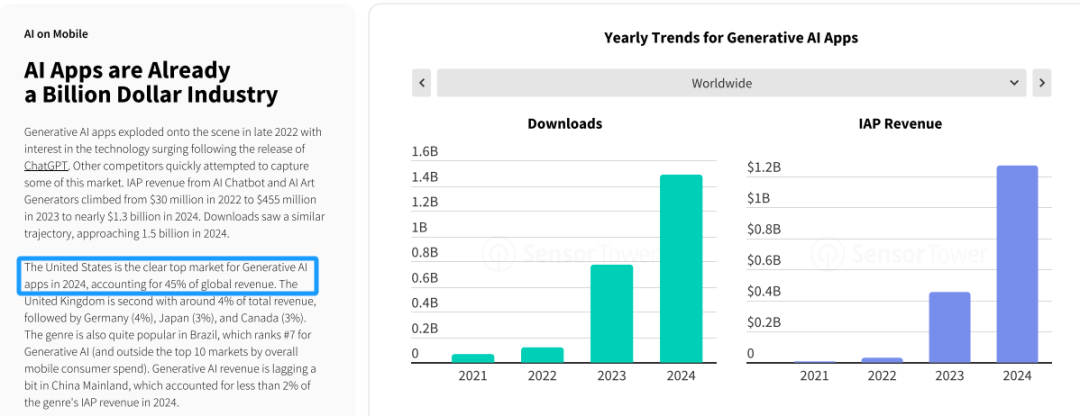

据 Sensor Tower 数据显示,截至 2024 年,美国是 AI 应用的绝对头部市场,占全球收入的 45%。美国市场拥有良好的用户付费意愿、成熟的支付习惯,使其成为中国AI企业出海战略中不容忽视的一站。

图源:State of Mobile 2025

然而,同其他行业一样,文化、制度与法律环境的巨大差异,意味着曾在国内行之有效的商业逻辑,到了美国可能不得不进行“重构”。从知识产权、数据隐私、内容合规等,每一个环节都可能影响 AI 企业在美国市场的长期可持续发展。因此,若想在美国扎根,第一步就必须打下合规的地基。

美国 AI 治理相关政策

美国形成了联邦与州相协同的双轨规范架构,通过分散式立法、行政指引与司法判例共同构建动态人工智能法律治理体系。

1.联邦层面法律与政策

(1)2021 年 1 月,美国正式颁布了《2020 年国家人工智能倡议法案》。该法案从国家层面推动可信人工智能系统在公共和私营部门的开发与应用,旨在进一步巩固美国在人工智能研发领域的地位。

(2)2022 年,美国政府发布《人工智能权利法案蓝图》,以政策文件的形式确立了人工智能技术应用的五项原则,为公私主体划设技术伦理边界,确保人工智能技术的开发和应用符合社会需求,并保护公民权利。

(3)2025 年,美国总统特朗普签署《消除美国人工智能领导地位的障碍》行政令,优先考虑以监管最小化路径巩固美国在全球人工智能技术竞争中的优势,解除对私营部门开发和部署的多重限制,以加速人工智能技术的创新突破,但此举可能削弱对技术的伦理约束与风险防控效

(4)2025 年 7 月 23 日,白宫发布了长达 28 页的《赢得AI竞赛:美国 AI 行动计划》(Winning the AI Race: U.S. AI Action Plan)(以下简称《行动计划》),标志着美国总统特朗普 AI 领域总体规划思路逐渐成型,也标志着美国国家人工智能战略的重大转向。

AI 治理相关核心内容:通过最大程度地扫除监管障碍,为美国私营部门的 AI 创新“松绑”和“加油”;其次,确保AI技术的发展方向和内容产出,符合本届政府的价值观和政治议程,即所谓的“美国价值观” 。为实现这一双重目标,计划部署了三套强有力的政策工具。

-

“监管大扫除”。这是最直接的“松绑”措施。由 OMB 统筹,要求联邦机构 60 天内审查并修订或废除阻碍 AI 开发部署的法规;白宫科技政策办公室(OSTP)向产业界征询信息,设快速通道让企业直报监管痛点,实现精准解障。

-

风险框架“瘦身”。计划明确指示国家标准与技术研究院(NIST)修订《AI 风险管理框架》,移除或淡化错误信息、多样性公平性包容性(DEI)、气候变化等社会伦理考量,将风险管理焦点收窄至技术安全与性能风险,回应行业对合规成本及 “政治正确” 限制创新的不满。

-

联邦采购的“思想门槛”。通过行政令更新采购指南,要求政府部门采购的前沿大语言模型需 “客观且无意识形态偏见”,以 “真实性” 和 “意识形态中立” 为原则,明确规避 DEI 等 “意识形态教条”,实质是借联邦采购力量对 AI 模型进行意识形态审查。

这反映了美国 AI 治理思路的根本性转变。它从拜登政府时期强调“过程合规”(如进行风险评估、影响报告)的模式,转向了更注重“结果控制”的模式。一方面通过去监管简化过程,另一方面通过采购标准直接控制最终 AI 产品的“思想”产出。这种从“如何做 AI ”到“ AI 应该说什么”的转变,代表了一种更直接、更具干预性的治理思路。

2. 美国州级 AI 立法实践

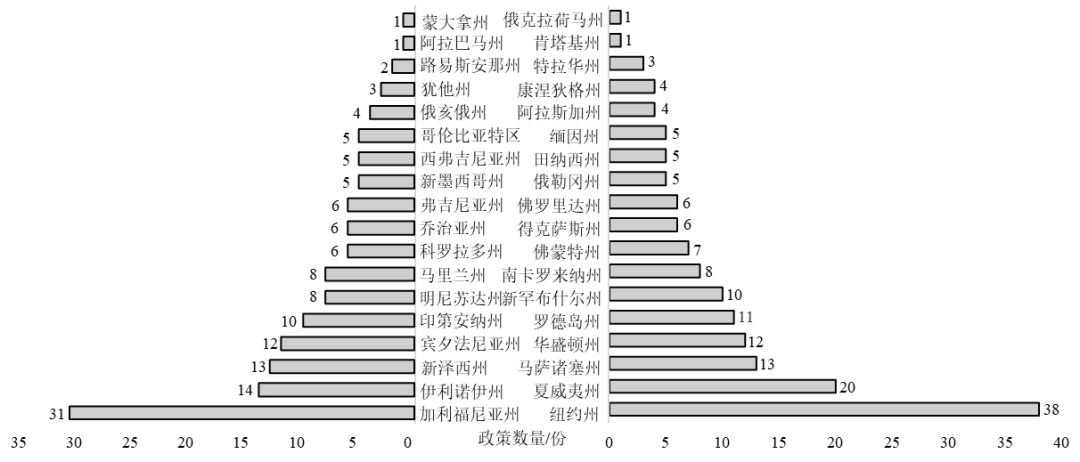

截至 2024 年,在美国 50 个行政区中,以加利福尼亚州、纽约州和夏威夷州为代表的 30 个州正式通过了有关人工智能监管的政策。

美国各州 AI 监管政策数量图,图源:《科学学研究》论文

在州级立法实践中,犹他州与科罗拉多州率先实现突破。2024 年颁布的《犹他州人工智能政策法案》规定了使用生成式人工智能的披露制度,通过人工智能政策办公室统筹制定标准,并设立技术沙盒实验室推动公私协同研发。

同年颁布的《科罗拉多州人工智能法案》则聚焦高风险人工智能系统的算法歧视治理,明确将就业、信贷、教育等关键决策场景纳入监管范畴,在涉及与人工智能系统交互的消费者保护领域建立包含影响评估、数据溯源、算法解释的透明度义务框架。至此,人工智能州级法律治理呈现出三大转型态势:从软性指南转向硬性约束、从普适原则转向场景规制、从分散治理转向机构化运作。

美国的双轨法律治理框架强调“弱监管”原则下的行业自律,各州监管力度与重点差异显著——既通过弹性监管为本土企业创造制度红利,又借助州际竞争筛选最优治理方案,但立法权分散也引发了标准互认的困境与跨国规制冲突。如何在激发地方创新动能的同时把控整体风险,逐渐成为美国人工智能法律治理体系优化的核心议题。

美国具体内容监管要求

美国的内容监管体系呈现出联邦与州分权、多领域法律交叉、言论自由与安全治理动态平衡的显著特征。

美国政府在网络内容监管上较为宽松,其著名的第 230 条法规规定,互联网服务的运营商无需对平台上的第三方言论承担法律责任,这几乎等同于是网络平台的豁免令。虽然美国近年来就废除 230 条款一事展开多轮辩论,但截至目前,互联网平台无需为平台内容负责的立法现状仍未改变。然而,政府立法监管的缺位并不代表美国网络世界毫无限制。

其一,美国政府虽然囿于对自由言论的保护,无法通过立法约束平台,但美国国会也在不断向企业施压,要求企业采取措施解决网络内容乱象。

其二,在美国活跃的社交平台基本上都属于全球头部企业,虽然美国本土无立法限制,但其他地方的立法要求,如欧盟,也会倒逼美国企业对网络内容进行限制。

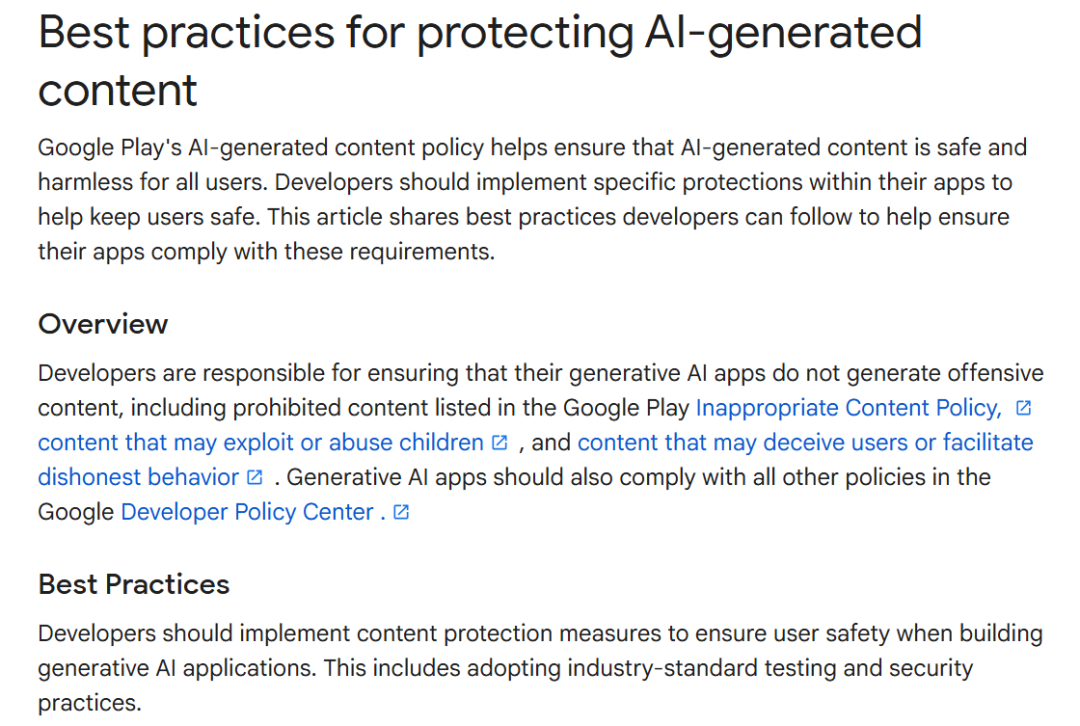

其三,海外的主流应用商店Google Play 和 App Store 均为上架 APP 设置了内容审核条款,头部行业自发设置的准入门槛成为美国互联网企业不得不遵守的硬性要求。2025 年 7 月 10 日,Google Play 发布政策公告,新增了 “AI 生成内容政策”,针对 AI 生成内容主要规定了 AI 生成内容的定义、生成式 AI 的免责使用、开发者责任三大板块。应用平台接纳AI生成内容并逐步建立起对 AI 生成内容的管理已是大势所趋。

图源:Google Play 截图

接下来,针对美国网络内容监管的重点领域进行分析。包括未成年人、色情内容、恐怖主义、网络赌博以及仇恨言论。

1. 未成年人

20 世纪 90 年代,由于未成年人容易接触到互联网上大量的色情内容,引发民众与政府的担忧与抵制,由此开始了美国第一波互联网管制浪潮。此后,美国联邦多次尝试通过立法建立一套强制内容审核系统,但由于《美国宪法第一修正案》对言论自由的强力保护,几次提案都以失败告终。几次比较著名的立法提案包括1996年《通讯规范法案》(Communications Decency Act, CDA)、1998年《儿童在线保护法案》(Child Online Protection Act, COPA)、 2000年《儿童互联网保护法案》(Child Internet Protection Act)以及2000年《儿童在线隐私保护法案》(Child Online Privacy Protection Act, COPPA)。

2024年7月31日,美国参议院通过了《儿童和青少年在线隐私保护法案》(简称COPPA 2.0)和《儿童在线安全法案》(KOSA),两项新法案的出台将禁止对未成年人进行定向广告投放和未经同意的数据收集,同时赋予家长和孩子删除其社交媒体平台个人信息的权利,此外还将明确社交媒体公司在未成年人使用其产品时的“注意义务”,重点关注互联网平台的合规设计和公司监管义务。2025年1月,美国联邦贸易委员会(FTC)修订《儿童在线隐私保护法》(COPPA 2.0),以加强儿童信息保护,赋予家长更多控制权。

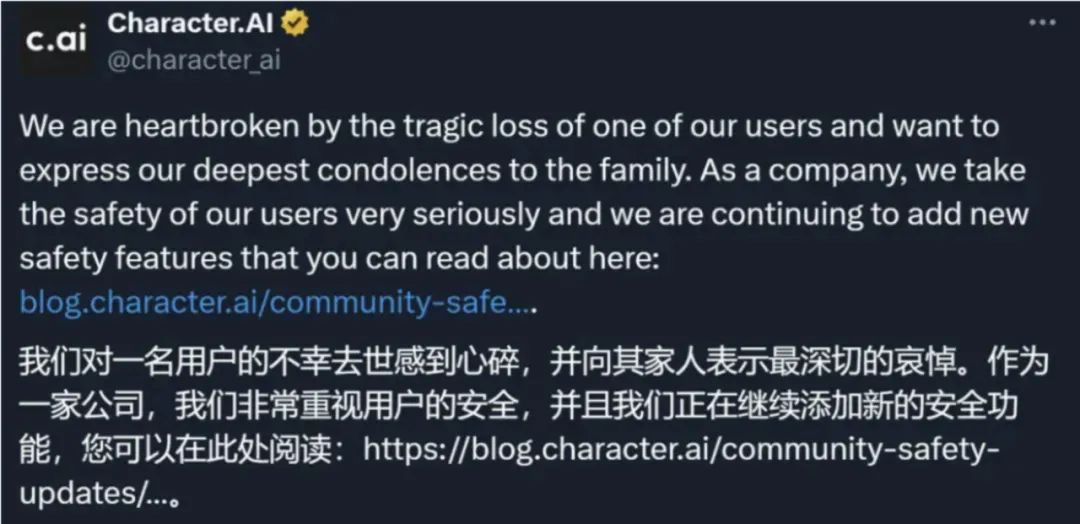

此前美国佛罗里达州一女子控告谷歌公司和 Character.AI 平台,指控后者的人工智能(AI)聊天机器人“教唆”其 14 岁儿子自杀。在美国高度重视未成年人保护的背景下,引发各界关注和讨论。

图源:网络报道

2. 色情内容

在美国,网络色情是一个非常有争议的话题。自 20 世纪 90 年代以来,公众、立法者以及法院就如何控制网络色情内容争论不休。反对者希望从道德的角度出发对网络色情内容进行管制,支持者则认为网络色情内容同样受《宪法第一修正案》保护,是公民言论自由的一部分。

单从立法层面而言,在美国通过网络浏览色情内容并不违法,但儿童色情是坚决不能触碰的红线。1990 年,最高法院裁定儿童色情内容不受宪法修正案保护, 禁止制作、持有、传播或意图传播任何以未成年人(不满18 周岁)为对象的淫秽视觉材料。2025 年修订的《儿童性虐待材料法》,明确将 AI 生成的儿童色情内容纳入“视觉材料” 范畴,持有或传播此类内容最高可判 10 年监禁,累犯或涉及真实儿童性虐待的案件可加重至终身监禁。

2025 年生效的《删除法案》(TAKE IT DOWN Act)进一步要求社交媒体平台在 48 小时内删除用户举报的儿童深度伪造影像,否则将失去《通讯规范法案》第 230 条的免责保护,并可能面临刑事处罚。

3. 恐怖主义

随着社交媒体的蓬勃发展,越来越多的恐怖分子和暴力极端分子也开始利用社交媒体开展宣传、招募、运营等。由于绝大多数活跃的互联网平台都是美国企业,美国互联网巨头也日益受到来自政府、股东、公民社会团体、媒体、民众等多方压力,要求平台采取措施对有害内容进行管制。近年来,多方呼吁美国政府通过立法直接对网络恐怖主义内容进行监管,但从实际情况来看,美国政府的动作还是较为克制,而社交平台自身成为网络恐怖主义内容管控的中坚力量。

经过长时间的讨论与尝试,美国现在已形成一套政府与行业共同参与的复杂的私下调解机制。美国政府自身不直接介入平台上的内容管制,而主要将这一责任“外包”给企业。一方面,美国政府虽然不会直接制定法律来监管网络上的恐怖主义内容,但它会通过立法权向社交媒体企业施压。另一方面,美国政府也通过提供专家指导、公私合作的方式,鼓励企业采取审核手段对抗平台上的恐怖主义内容。

在公众和美国政府的施压之下,美国各大社交媒体平台开始加快反恐步伐。事实上,美国互联网巨头最先感受到的压力来自欧洲政府。在 2015 年和 2016 年欧洲发生多次恐怖袭击事件后,Facebook、Twitter 和 Google 为回应欧洲各国政府的施压,开始移除其平台上的恐怖主义内容。

4.网络赌博

在过去很长一段时间里,美国联邦政府一直将网络赌博列为非法行为。2006 年,美国更是通过了《取缔非法互联网赌博法案》,要求美国的银行和信用卡公司不得为互联网博彩网站提供信用卡、支票、电子支付等转账支付,违者将受处罚。

转变发生在 2011 年,这一年联邦裁定,只有体彩赌博在网络上是被禁止的,其他形式的网络赌博不受法律约束,对网络赌博的立法权被交到了各州政府手上。截至2025 年,美国共有 48 个州宣布网络赌博合法,仅夏威夷州和犹他州通过立法明确禁止所有形式的网络赌博。

虽然法律并不禁止赌博,但各社交平台都对线上赌博广告做出了限制。以谷歌为例,谷歌仅允许国营实体投放彩票广告,仅允许在在线赌博合法的州投放赛马、体育博彩、在线赌场的广告。同时,广告客户不得定位到未满 21 周岁的用户或获得许可的州以外的用户,必须在登录页或广告素材中添加针对成瘾性和强迫性赌博的危险警告和相关帮助信息。

5. 仇恨言论

管制网络仇恨言论最先是由欧盟提出。2015 年,欧洲难民危机一再升级,网络仇恨言论开始成为欧盟立法机构与网络巨头争论的焦点。2016 年 5 月,欧盟委员会宣布与 Facebook、Twitter、YouTube 和 Microsoft 就控制网络仇恨言论开展合作,四家公司承诺“接到举报后 24 小时内屏蔽和删除相关仇恨言论”。欧盟各国也相继立法对网络仇恨内容进行管制。

但与欧盟通过立法管控仇恨言论不同,由于美国宪法对言论自由的高度保护,再加上《通信端正法》对互联网企业的豁免条款(第 230 条规定,互联网平台无需为其平台上的任何内容负责),美国政府以技术手段或立法过滤网络内容的情况较少出现,企业自律与行业合作成为互联网公司对抗仇恨言论的主要途径。

以Facebook 为例,Facebook 在其社区守则中将“仇恨言论”定义为“针对他们受保护的特征,而非观念或习俗直接发起的直接言论攻击,这些特征包括:民族、种族、原国籍、残疾、宗教信仰、种姓、性取向、性别、性别认同,以及严重疾病”,并明确禁止在平台上发布仇恨言论。

要点提炼:

-

美国的内容监管体系呈现出联邦与州分权、多领域法律交叉、言论自由与安全治理动态平衡的显著特征。

-

AI 监管从强调“过程合规”,转向了更注重“结果控制”的模式,AI技术的发展方向和内容产出,符合政府的价值观和政治议程,即所谓的“美国价值观”。

-

未成年人相关内容是出海美国不可逾越的合规红线,即便是 AI 生成的涉未成年人内容,亦需严格遵循这一刚性准则。

-

海外应用商店中 Google Play 率先新增了 “ AI 生成内容政策”,应用平台接纳 AI 生成内容并逐步建立起对 AI 生成内容的管理已是大势所趋。

本文政策解读仅供参考,所有信息均来自公开信息。

以下为参考信息:

Sensor Tower: State of Mobile 2025

白宫官网:White House Unveils America's AI Action Plan – The White House

FTC官网:FTC Adopts Amended Children’s Online Protection Act Rule | Wiley Rein LLP - JDSupra

复旦中美友好互信合作计划:美国观察|“势在必得的竞争”:《美国AI行动计划》全局解析

人民法院报:《人工智能法律治理的国际实践》

《科学学研究》网络首发论文:

《美国人工智能监管政策的复杂性及临近性研究——基于州域层面政策文本的主题模型》

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)