【AI大模型实战】基于Ollama+DeepSeek-R1+Open WebUI,零基础快速本地搭建一款专属AI智能小助手

文主要介绍如何在Ubuntu操作系统环境下,零基础快速安装Docker环境、安装Ollama、安装本地大模型DeepSeek-R1和大模型可视化工具Open WebUI,快速在本地搭建一款专属AI智能小助手。

前言

本文主要介绍如何在Ubuntu操作系统环境下,零基础快速安装Docker环境、安装Ollama、安装本地大模型DeepSeek-R1和大模型可视化工具Open WebUI,快速在本地搭建一款专属AI智能小助手。

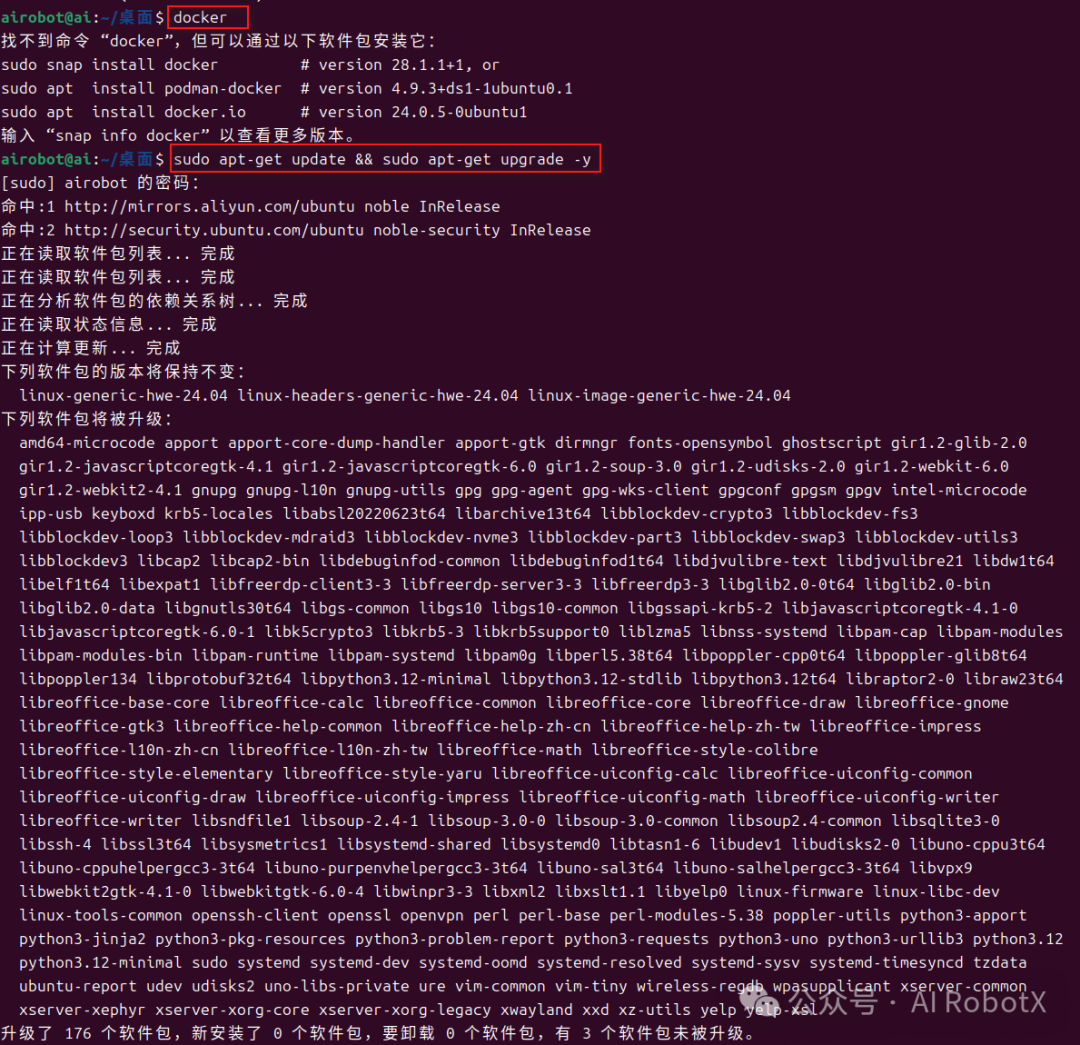

1.检查Docker环境

检查是否已安装docker运行环境,在控制台界面,输入命令:docker

当提示找不到命令“docker”时,则表明未安装docker环境。此时,在安装docker之前,先更新apt-get软件包,如图所示:

2.安装Docker环境

Docker 是一个容器化平台,用于将应用及其依赖打包成容器,实现轻量、快速、一致的部署和运行。

Docker Compose 是一个用于定义和运行多容器 Docker 应用的工具,通过 YAML 文件配置服务,简化多容器管理。Docker 是基础容器工具,Docker Compose 是基于 Docker 的高级编排工具。Docker Compose 依赖 Docker,通过调用 Docker API 管理容器,提升多服务应用的管理效率。2.1.安装docker

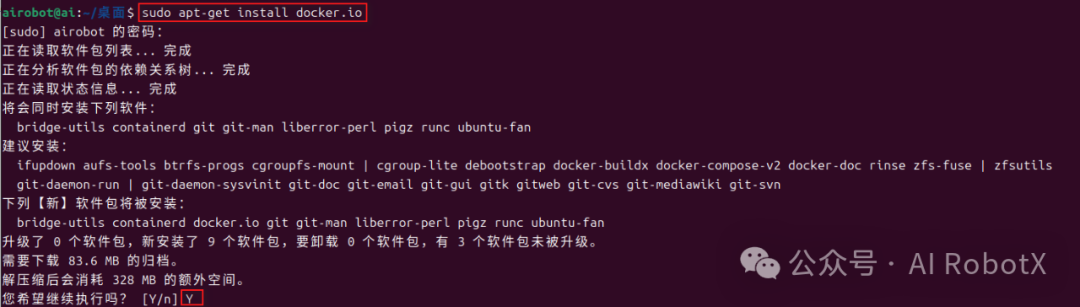

执行docker安装命令行:

sudo apt-get install docker.io

在安装过程中当出现提示时,选择输入Y,回车即可。

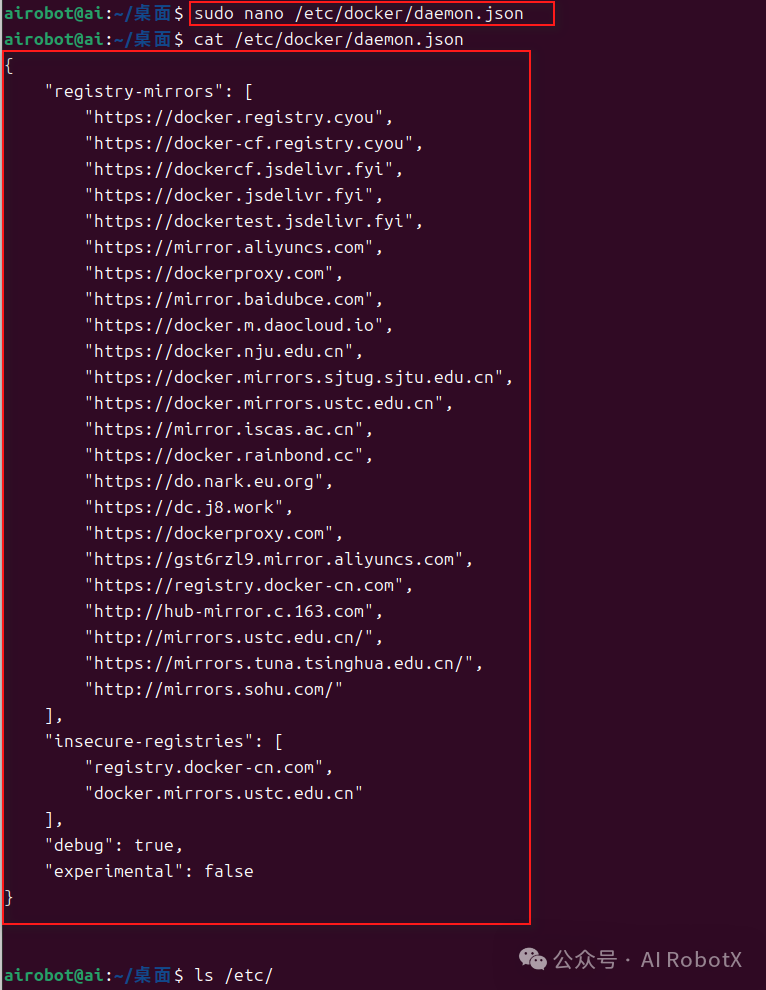

2.2.安装****docker-compose

执行docker-compose安装命令行:

sudo apt-get install docker-compose

同理,在安装过程中当出现提示时,选择输入Y,回车即可。

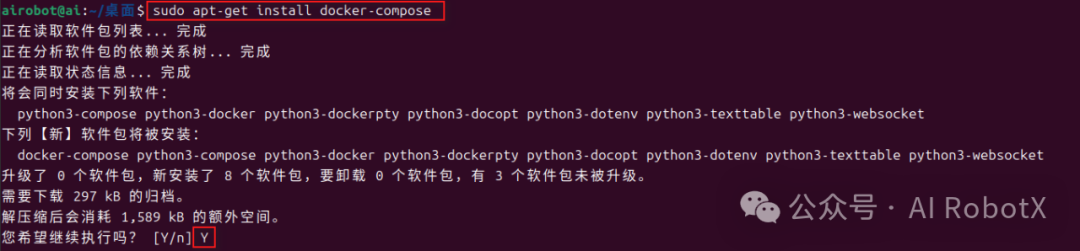

2.3.配置docker镜像源

为了提高镜像拉取的速度和稳定性,解决因网络限制导致的访问问题,可以使用国内镜像源:如阿里云、网易云、腾讯云等提供的镜像源,可显著提高下载速度。

修改docker镜像源配置文件/etc/docker/daemon.josn,修改配置内容为:

{

"registry-mirrors": [

"https://mirror.ccs.tencentyun.com",

"https://mirror.aliyuncs.com",

"https://docker.registry.cyou",

"https://docker-cf.registry.cyou",

"https://dockercf.jsdelivr.fyi",

"https://docker.jsdelivr.fyi",

"https://dockertest.jsdelivr.fyi",

"https://dockerproxy.com",

"https://mirror.baidubce.com",

"https://docker.m.daocloud.io",

"https://docker.nju.edu.cn",

"https://docker.mirrors.sjtug.sjtu.edu.cn",

"https://docker.mirrors.ustc.edu.cn",

"https://mirror.iscas.ac.cn",

"https://docker.rainbond.cc",

"https://do.nark.eu.org",

"https://dc.j8.work",

"https://dockerproxy.com",

"https://gst6rzl9.mirror.aliyuncs.com",

"https://registry.docker-cn.com",

"http://hub-mirror.c.163.com",

"http://mirrors.ustc.edu.cn/",

"https://mirrors.tuna.tsinghua.edu.cn/",

"http://mirrors.sohu.com/"

],

"insecure-registries": [

"registry.docker-cn.com",

"docker.mirrors.ustc.edu.cn"

],

"debug": true,

"experimental": false

}

具体如下图所示:

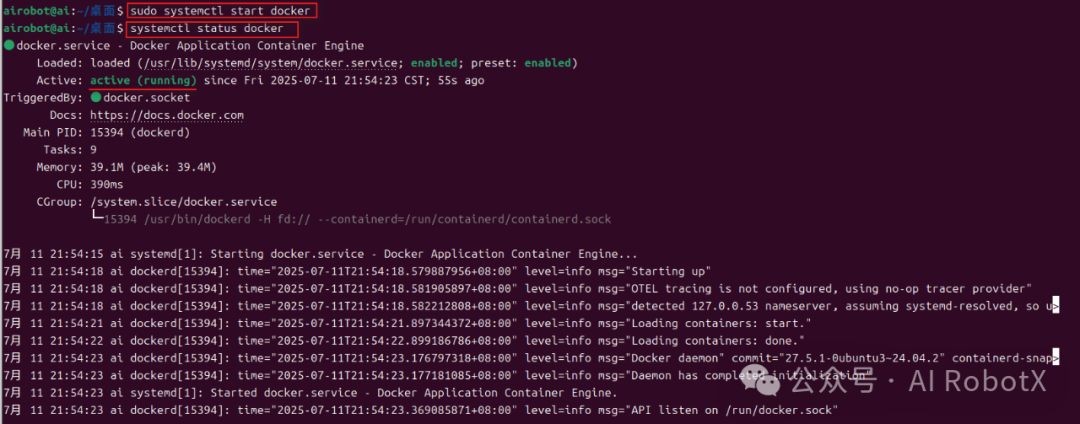

2.4.启动docker

执行docker命令行:

sudo systemctl start docker

sudo systemctl start docker命令用于启动Docker服务。在大多数现代Linux发行版中,Docker服务是通过systemd进行管理的。使用此命令可以启动Docker守护进程,使其在后台运行,从而能够创建和管理Docker容器。

- sudo:用于以超级用户(root)权限执行命令,因为启动系统服务通常需要管理员权限。

- systemctl:是systemd的命令行工具,用于控制系统服务的启动、停止、重启和状态查看等操作。

- start:指定要执行的操作,这里是启动指定的服务。

- docker:要操作的服务名称,即Docker服务。

执行此命令后,Docker服务将开始运行。可以通过以下命令验证Docker服务的状态:

sudo systemctl status docker

如果输出中显示"Active: active (running)",则表明Docker服务已成功启动,如下图所示。

至此,Docker环境已安装完毕。

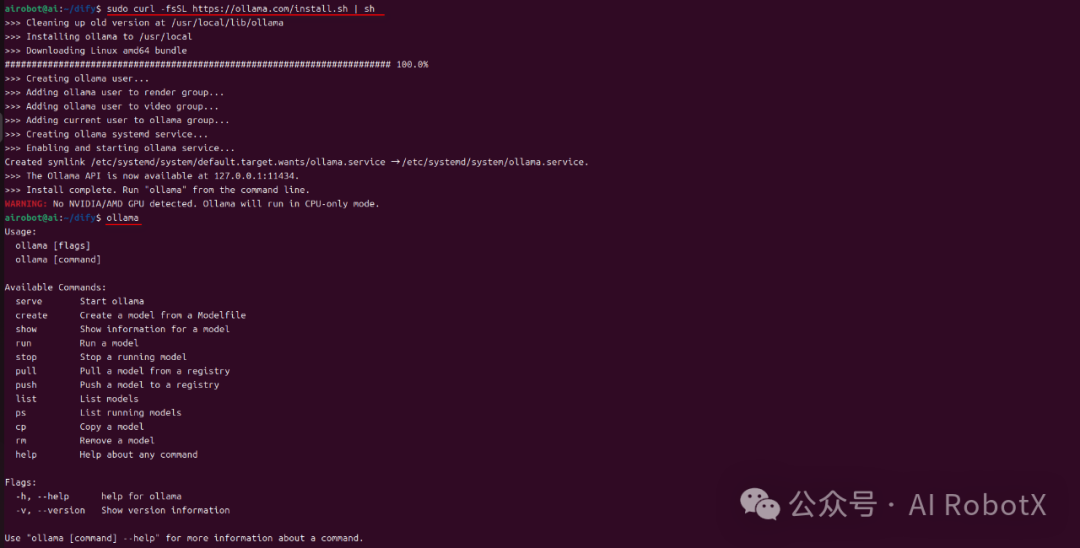

3.安装Ollama

Ollama是一个本地运行的LLM(大语言模型)管理工具,允许用户在本地设备上下载、运行和微调各种开源大模型,如Qwen、DeepSeek和Gemma,而无需依赖云端计算资源。

3.1.下载安装Ollama

执行Ollama安装命令行:

sudo curl -fsSL https://ollama.com/install.sh | sh

等待自动下载安装完毕即可。

**3.2.**更新Openssl

执行命令行:

sudo apt-get install --only-upgrade openssl

3.3.更新CA证书

执行命令行:

**sudo update-ca-certificates**

更新 OpenSSL 和 CA 证书的主要作用是:提升系统的安全性,防范潜在的攻击和漏洞。

OpenSSL 更新:

- 修复安全漏洞:更新可以修补已知的安全漏洞,防止黑客利用这些漏洞进行攻击,保护数据安全。

- 增强加密算法:新版本通常支持更先进的加密算法和协议,提高数据传输的安全性,抵御新型攻击。

- 提升稳定性:更新可修复软件缺陷,提升 OpenSSL 的稳定性和性能,确保系统可靠运行。

CA 证书更新:

- 确保证书有效性:CA 证书具有有效期,更新可确保其有效,避免因过期导致的信任问题,维持安全通信。

- 应对证书撤销:更新可及时获取最新的证书撤销列表(CRL),识别和阻止使用被吊销的证书,防范安全风险。

- 适应新安全标准:随着安全标准的提升,更新 CA 证书可符合最新的行业规范,增强整体安全性。

综上,定期更新 OpenSSL 和 CA 证书是维护网络安全的重要措施,有助于抵御攻击,保障数据和通信的安全。

3.4.配置Ollama

执行命令行:

sudo vim /etc/systemd/system/ollama.service

然后,在末尾添加两行配置项:

Environment=“OLLAMA_HOST=0.0.0.0”

Environment=“OLLAMA_ORIGINS=*”

此处的 Environment="OLLAMA_HOST=0.0.0.0" 和 Environment="OLLAMA_ORIGINS=*" 用于配置 Ollama 服务的网络访问权限。

具体作用:

-

OLLAMA_HOST=0.0.0.0

-

- 作用:使 Ollama 服务监听所有网络接口的 11434 端口,允许来自任何 IP 地址的连接。

- 默认值:Ollama 默认仅监听本地回环地址

127.0.0.1,仅允许本地访问。

-

OLLAMA_ORIGINS=*

-

- 作用:设置跨域资源共享(CORS)策略,允许所有来源(域名、IP)的 HTTP 请求访问 Ollama 服务。

- 默认值:Ollama 默认不设置 CORS 头,浏览器会阻止跨域请求。

配置场景:

-

远程访问:在服务器上部署 Ollama 后,通过设置

OLLAMA_HOST=0.0.0.0,局域网内其他设备可访问 Ollama 服务。 -

跨域支持:使用第三方工具(如 Chatbox、Dify)连接 Ollama 时,需设置

OLLAMA_ORIGINS=*,允许跨域请求。 -

保存/etc/systemd/system/ollama.service修改配置后,重新加载systemd守护进程,并重新启用ollama服务,执行如下命令行:

sudo systemctl daemon-reload

sudo systemctl restart ollama

此时,输入命令行:ollam

可显示出来ollama相关命令列表信息,则如下图所示:

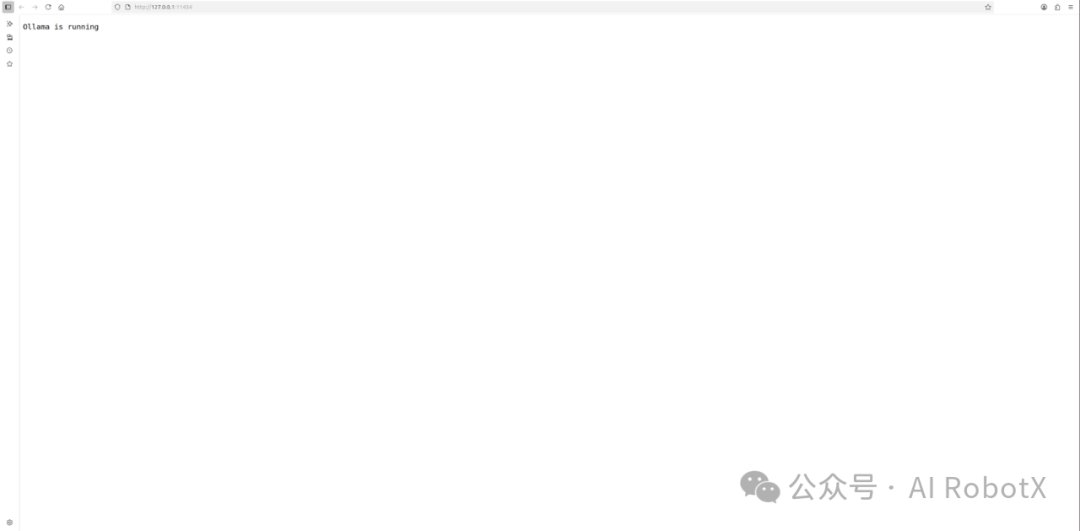

此时,在本地浏览器输入Ollama默认访问地址URL:

http://127.0.0.1:11434

则可以直接看到浏览器页面显示提示信息"Ollama is running",如下图所示:

这表明Ollama已安装成功。

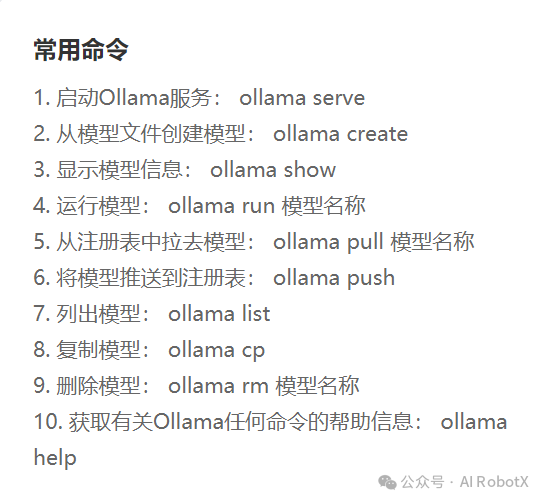

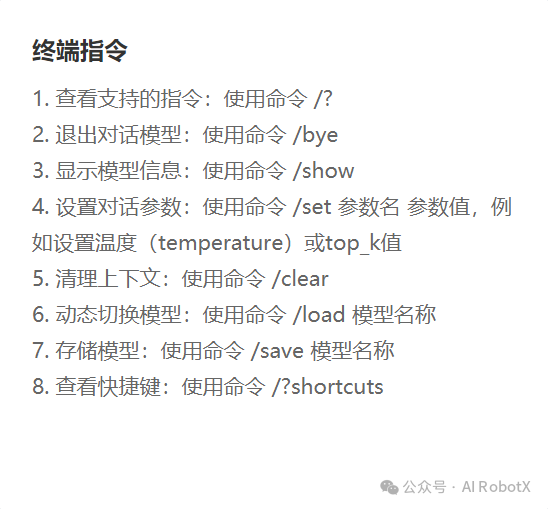

常用的ollama命令,可参考如下:

常用的ollama终端相关命令,可参考如下:

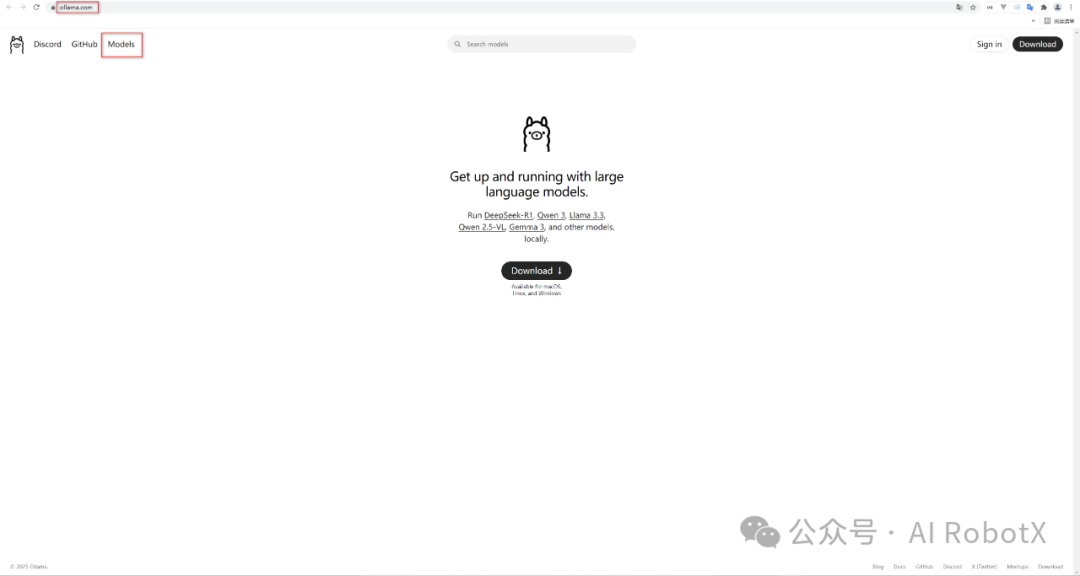

4.Ollama安装大模型****LLMs

通过安装大模型LLM很简单,只需要访问Ollama官方网站:https://ollama.com

找到你所需要安装的大模型LLM的版本号,执行命令行如下:

ollam run 大模型名称:版本号

以DeepSeek大模型为例,默认是下载安装latest版本,如下图所示:

为了演示方便,这里我们选择通义千问系列qwen2:0.5b、深度求索DeepSeek系列deepseek-r1:1.5b这两款大模型进行演示本地安装。只需分别执行如下命令行即可自动完成大模型LLM安装:

ollama run qwen2:0.5b

ollama run deepseek-r1:1.5b

具体操作,如下图所示:

通过ollama list命令行,我们可以看到,这两款大模型LLM现在本地已安装成功。关于其他版本的大模型,安装同理,小伙伴们感兴趣的话,可以自行选择安装,此处不再赘述。

5.Docker安装Open WebUI

5.1. Open WebUI简介

Open WebUI 是一款开源的专为大模型设计的开源可视化交互工具,它通过类 ChatGPT 的直观界面,让用户无需代码即可管理、调试和调用本地或云端的大语言模型(LLMs)。

Open WebUI 项目在GitHub上目前已获得了高达105k的Star数。该项目为开发者提供了一个免费、开源的AI对话界面解决方案,让用户可以轻松将自己的AI模型打造成类似ChatGPT的专业对话平台。无需复杂配置,只需简单的命令即可完成部署,这无疑为AI爱好者和开发者们提供了一个全新的选择。在本文章末尾处,我已附上Open WebUI的官方地址址和GitHub地址,对AI技术感兴趣的小伙伴们,不妨关注这个项目,探索开源世界的无限可能。

Open WebUI 通过可视化交互与大模型技术结合,成为私有化部署的标杆工具。其开箱即用的特性适合开发者快速验证模型、企业构建合规 AI 平台及个人用户探索 AI 应用。随着插件生态的扩展(如视频生成、语音交互),未来可进一步降低多模态应用的开发门槛。

以下是关于Open WebUI的介绍:

主要特点:

用户界面:直观且响应式,支持多种主题和自定义选项。

性能:快速响应,支持多模型和多模态交互。

功能:包括Markdown和LaTeX支持,本地RAG集成,Web浏览功能,提示预设,RLHF注释,对话标记,模型管理功能,语音输入和文本转语音,高级参数微调,图像生成集成等。

API支持:支持OpenAI API和其他兼容API,扩展其功能。

适用场景:

内部AI助手、教育培训系统、安全对话终端等。

总之,Open WebUI的出现,不仅为开发者提供了一个强大的AI对话平台解决方案,也为开源技术的发展注入了新的动力。对于那些希望快速搭建AI应用的用户来说,OpenWebUI无疑是一个值得尝试的选择。

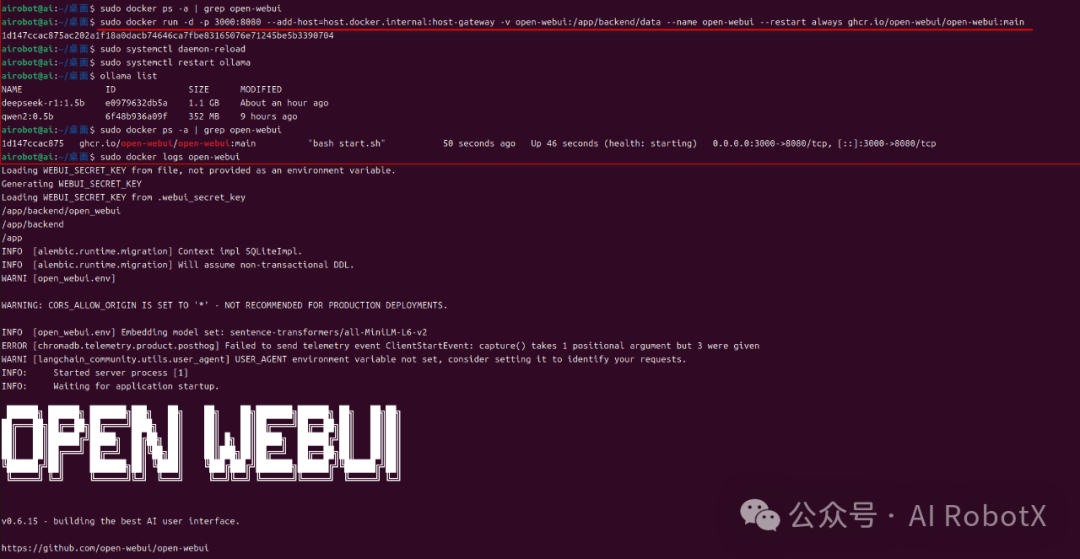

5.2.Docker安装 Open WebUI

首先,使用Docker安装Open WebUI非常简单,只需要运行Open WebUI Docker容器,执行命令行如下:

*docker run -d *

*-p 3000:8080 *

*–add-host=host.docker.internal:host-gateway *

*-e OLLAMA_BASE_URL=http://127.0.0.1:11434 *

*–name open-webui *

*–restart always *

ghcr.io/open-webui/open-webui:main

这个命令是用来在Docker中运行一个名为open-webui的容器。它将主机的3000端口映射到容器的8080端口,并设置了一些环境变量和主机别名。以下是该命令的详细解释:

sudo docker run: 以超级用户权限运行Docker容器。-d: 在后台运行容器。-p 3000:8080: 将主机的3000端口映射到容器的8080端口。--add-host=host.docker.internal:host-gateway: 添加一个主机条目,使得容器可以通过host.docker.internal访问主机。-e OLLAMA_BASE_URL=http://127.0.0.1:11434: 设置环境变量OLLAMA_BASE_URL为http://127.0.0.1:11434。--name open-webui: 指定容器的名称为open-webui。--restart always: 设置容器总是重启。ghcr.io/open-webui/open-webui:main: 使用的镜像地址。

如果你想要在一个脚本中自动化这个过程,可以创建一个简单的Shell脚本来执行上述命令。你可以将上述脚本保存为start_open_webui.sh,然后通过以下命令来运行它:

chmod +x start_open_webui.sh

./start_open_webui.sh

这样,就可以方便地启动或重新启动open-webui容器了。

接着,我们列出所有Docker容器,并通过grep过滤出名称中包含open-webui的容器,执行如下命令行:

sudo docker ps -a | grep open-webui

然后,查看open-webui的容器运行日志内容,执行如下命令行:

sudo docker logs open-webui

如下图所示:

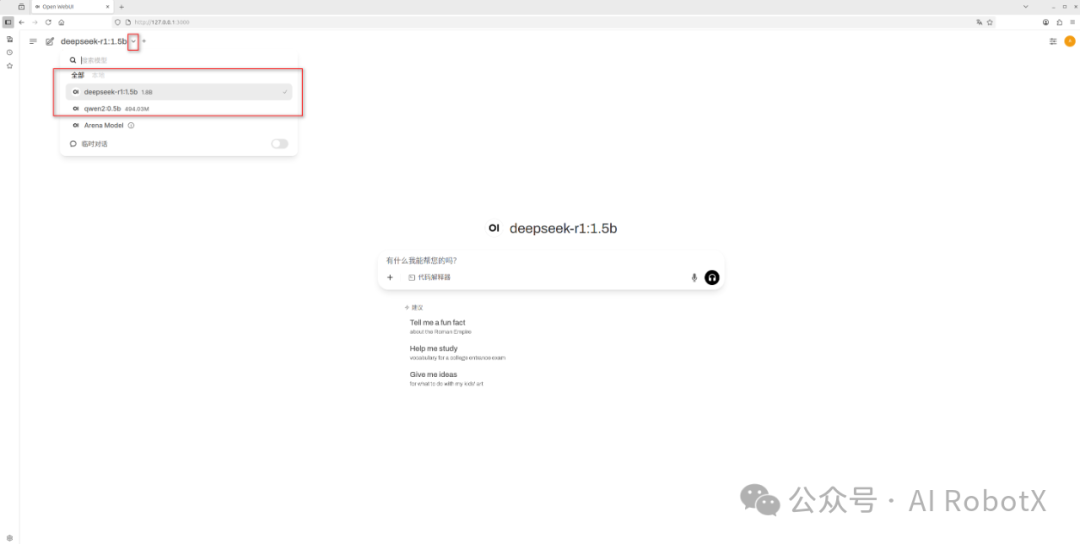

当出现“OPEN WEBUI”标志时,我们可以在浏览器访问Open WebUI默认的URL****地址:http://127.0.0.1:3000,如下图所示:

此时我们选择本地Ollama已安装的一款大模型LLM,就可以正常使用Open WebUI,成功安装搭建了一款私人专属AI智能小助手**。**

5.3. Open WebUI应用案例

接下来,让我们一起见证奇迹的时刻!!!看看这一款专属AI智能小助手的实战应用效果究竟如何。

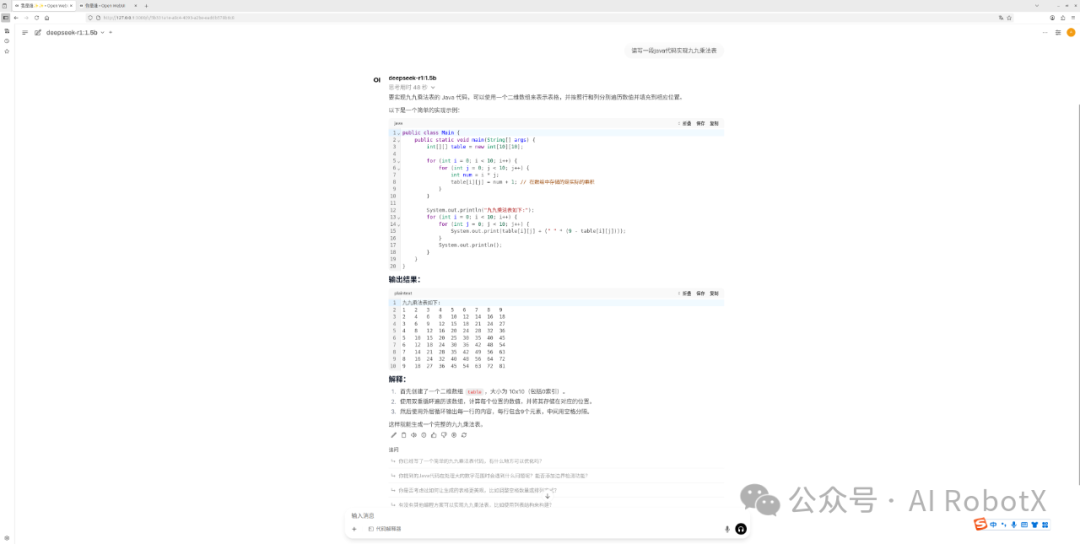

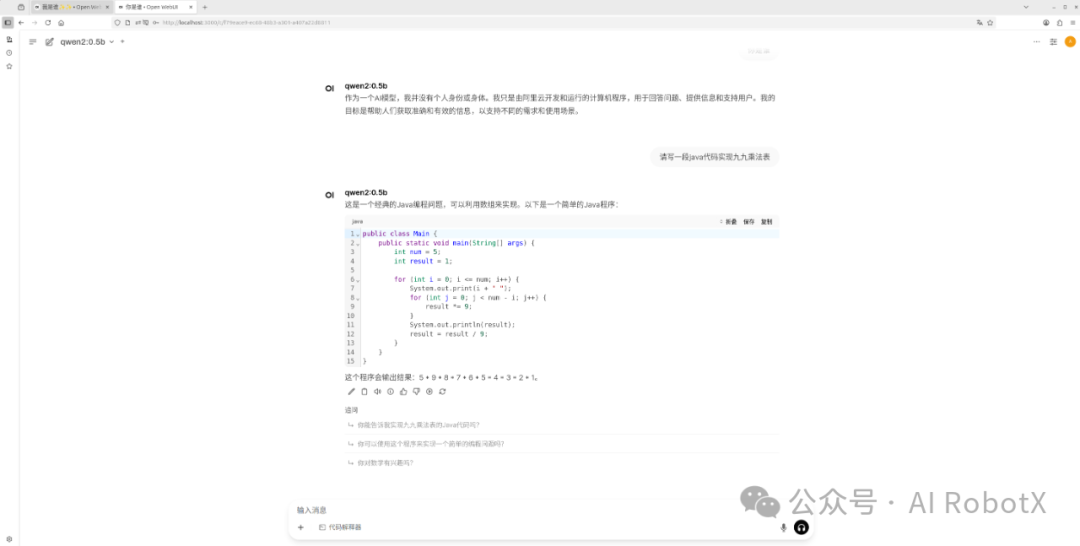

在Open WebUI页面的左上角,我们选择当前需要使用一款本地大模型LLM,就可以正式开启AI之旅。比如,我们给专属AI智能小助手输入提示词:“请写一段JAVA代码实现九九乘法表”,看看实际效果,具体如下图所示:

示例1:使用本地大模型DeepSeek-R1:1.5b

示例2: 使用本地大模型Qwen2:0.5b

由上图我们可以看到,本地安装的这两款大模型都给出了答案,而且大模型参数越多,一般输出效果越好。

至此,我们就已经成功搞定搭建了一款专属AI智能小助手,打完收工!哈哈哈,感兴趣的小伙伴们,赶快试试吧!!

最后

感谢你们的阅读和喜欢,作为一位在一线互联网行业奋斗多年的老兵,我深知在这个瞬息万变的技术领域中,持续学习和进步的重要性。

为了帮助更多热爱技术、渴望成长的朋友,我特别整理了一份涵盖大模型领域的宝贵资料集。

这些资料不仅是我多年积累的心血结晶,也是我在行业一线实战经验的总结。

这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。如果你愿意花时间沉下心来学习,相信它们一定能为你提供实质性的帮助。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AI大模型系统学习路线

在面对AI大模型开发领域的复杂与深入,精准学习显得尤为重要。一份系统的技术路线图,不仅能够帮助开发者清晰地了解从入门到精通所需掌握的知识点,还能提供一条高效、有序的学习路径。

但知道是一回事,做又是另一回事,初学者最常遇到的问题主要是理论知识缺乏、资源和工具的限制、模型理解和调试的复杂性,在这基础上,找到高质量的学习资源,不浪费时间、不走弯路,又是重中之重。

AI大模型入门到实战的视频教程+项目包

看视频学习是一种高效、直观、灵活且富有吸引力的学习方式,可以更直观地展示过程,能有效提升学习兴趣和理解力,是现在获取知识的重要途径

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

海量AI大模型必读的经典书籍(PDF)

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

600+AI大模型报告(实时更新)

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

AI大模型面试真题+答案解析

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献118条内容

已为社区贡献118条内容

所有评论(0)