一边闭源,一边开源!Meta之后,OpenAI祭出最强武器gpt-oss!

OpenAI宣布推出GPT-OSS系列开放权重语言模型,包含1200亿和200亿参数两个版本,支持本地部署和微调。新模型采用MoE架构和稀疏注意力机制,在多项基准测试中表现优异,部分指标超越商业模型。GPT-OSS强调推理能力、工具调用和安全性,允许用户通过Apache2.0协议进行商业使用。此举标志着OpenAI重返开放战略,旨在降低AI技术门槛,促进生态创新。同时提供完整的大模型学习路线和资源

OpenAI 在 2025 年 8 月 5 日宣布推出 GPT‑OSS,这是该公司自 2019 年 GPT‑2 以来首次公开开放权重的语言模型系列。这一次 OpenAI 直接将模型权重开放下载,允许任何人本地运行、查看和微调,让用户能够在高性能笔记本,甚至手机上使用强大的语言模型。

GPT‑OSS 系列目前包含两个版本:参数规模为 1200 亿的 gpt‑oss‑120b,以及约 200 亿参数的 gpt‑oss‑20b。后者设计用于大多数桌面和笔记本电脑,配备 16 GB 以上内存即可运行;前者适配单块高端 GPU 的系统,性能接近 OpenAI 自家的 o4‑mini 模型。想要部署120b模型可以访问https://www.alayanew.com/backend/register?id=AlayaNeW九章智算云平台注册、充值、部署体验。

在技术上,这两个模型都是“open‑weight”——即权重公开,但训练使用的数据、完整训练代码并未公开。因此虽然不是完全开源,但足以让研究者和开发者在本地部署、自定义使用,并且根据 Apache 2.0 许可协议进行商业或非商业用途。

预训练和模型架构

gpt-oss模型使用OpenAI最先进的预训练和后训练技术进行训练,特别关注各种部署环境的推理、效率和现实世界的可用性。虽然OpenAI已经公开提供了包括Whisper和CLIP在内的其他模型,但gpt-oss模型是自GPT-2以来的第一个开放权重语言模型。

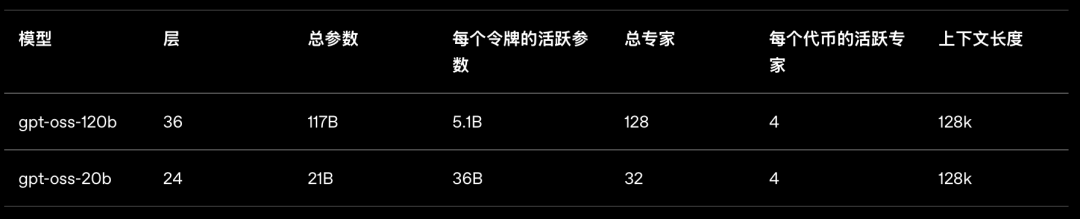

每个模型都是一个Transformer,它利用专家混合(MoE)来减少处理输入所需的活动参数数量。gpt-oss-120b激活每Token 5.1B参数,而gpt-oss-20b激活3.6B参数。这些模型分别有117b和21b的总参数。这些模型使用交替密集和局部带状稀疏注意力模式,类似于GPT-3。为了推理和内存效率,模型还使用分组多查询注意力,组大小为8。OpenAI使用旋转位置嵌入(RoPE)进行位置编码,并原生支持高达128k的上下文长度。

后训练

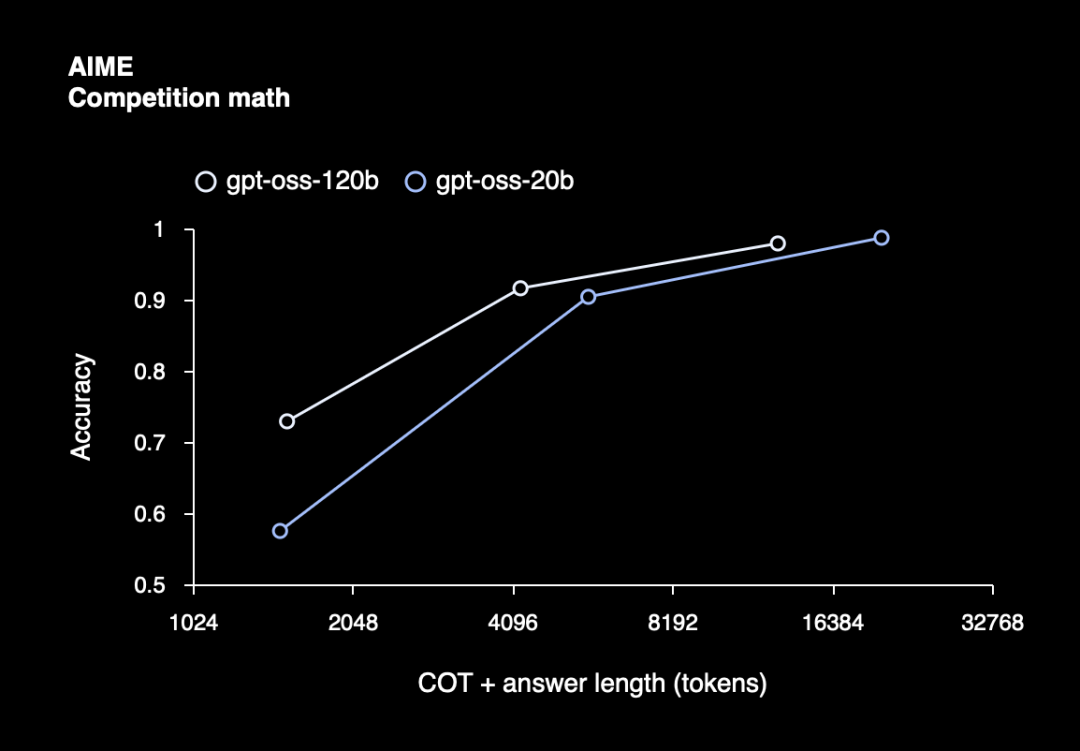

这些模型使用与o4-mini类似的工艺进行后训练,包括监督微调阶段和高计算RL阶段。OpenAI的目标是将模型与OpenAI模型规格(OpenAIModelSpec)保持一致,并在产生答案之前教它应用CoT推理和工具使用。通过使用与OpenAI的SoTA专有推理模型相同的技术,这些模型在培训后展示了卓越的能力。

与API中的OpenAI o系列推理模型类似,两个开放权重模型支持三种推理努力——低、中和高——它们在延迟与性能上进行权衡。开发人员可以通过系统消息中的一句话轻松设置推理工作。

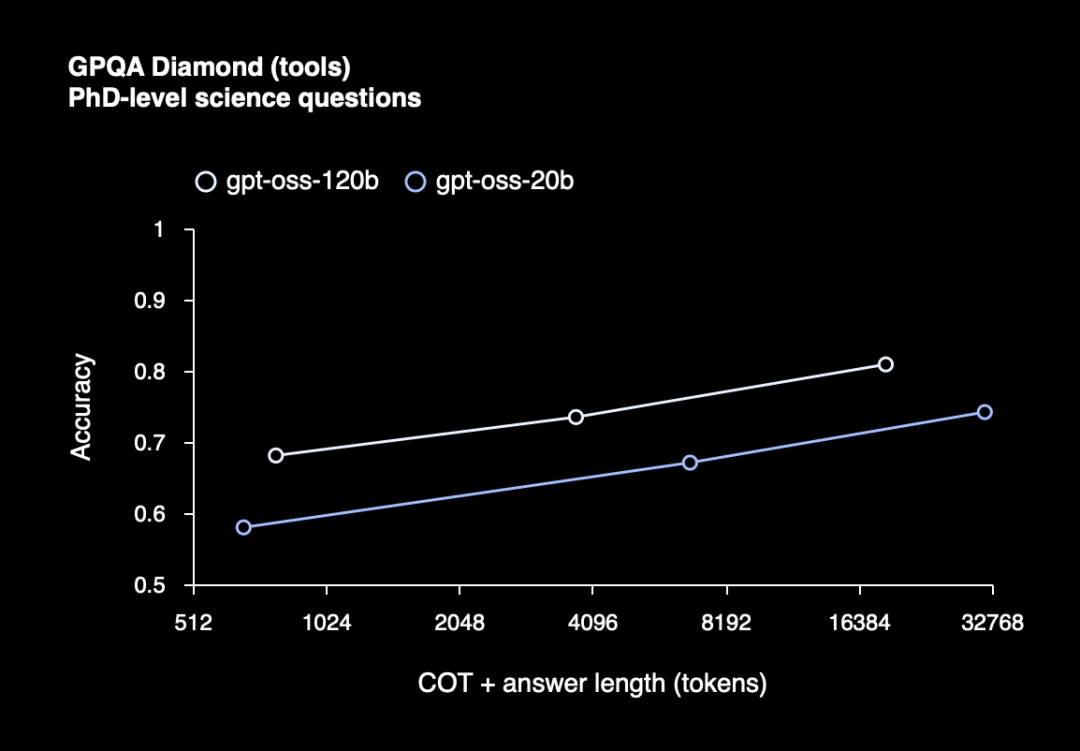

评测

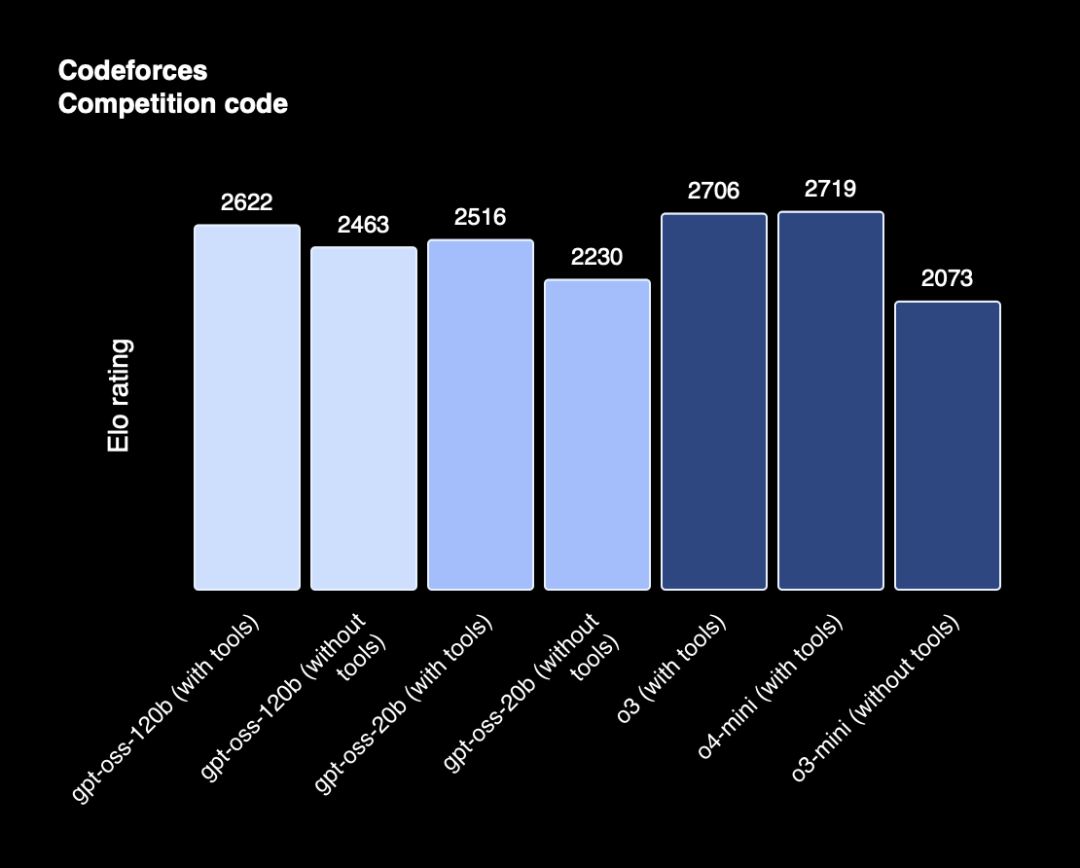

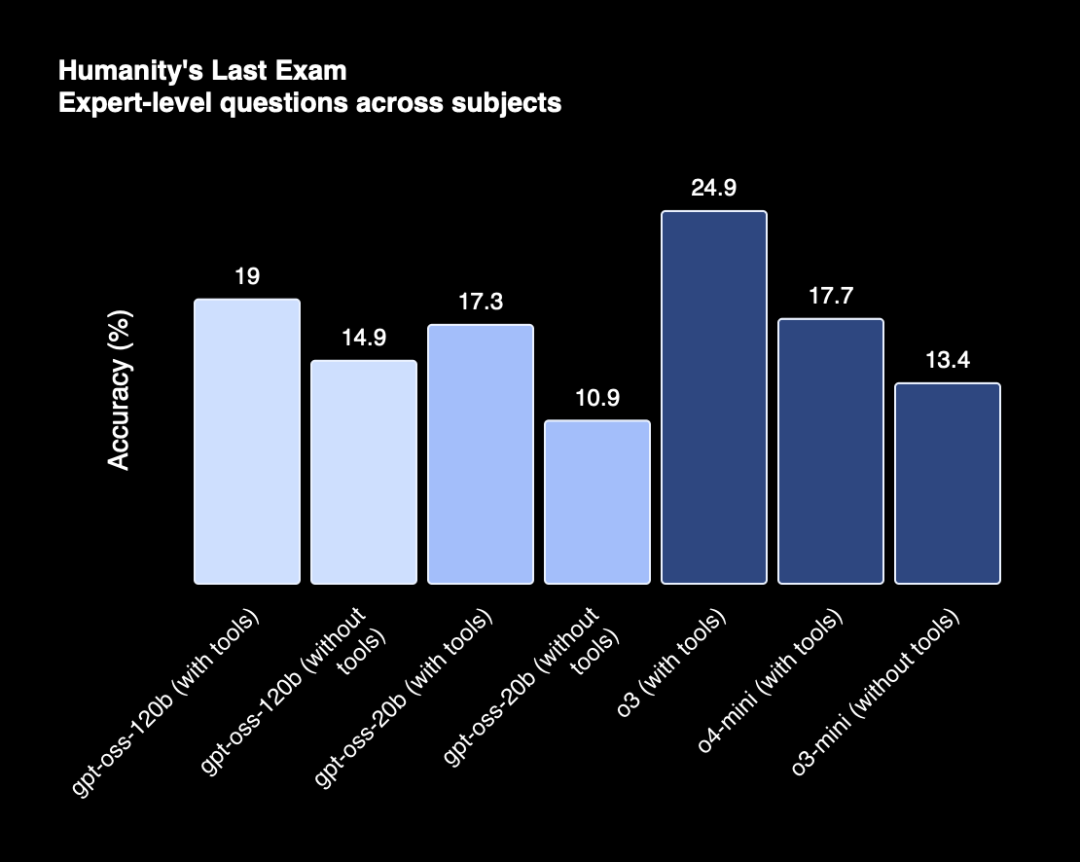

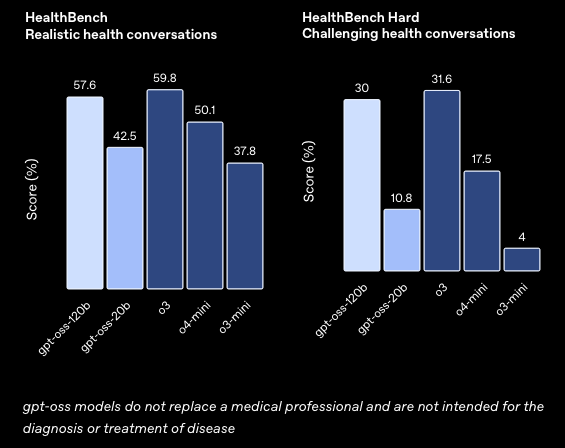

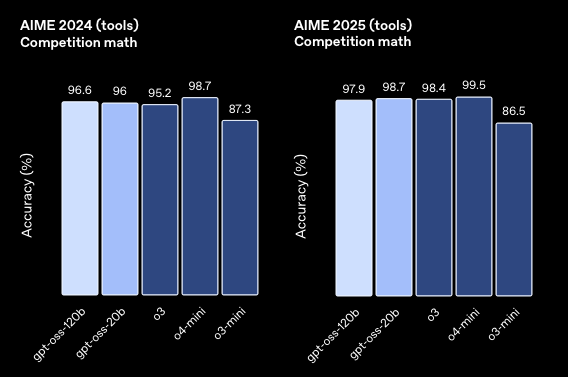

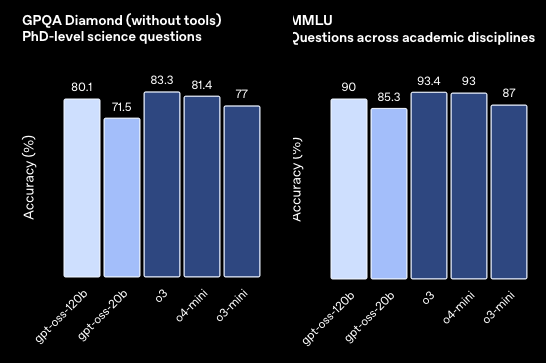

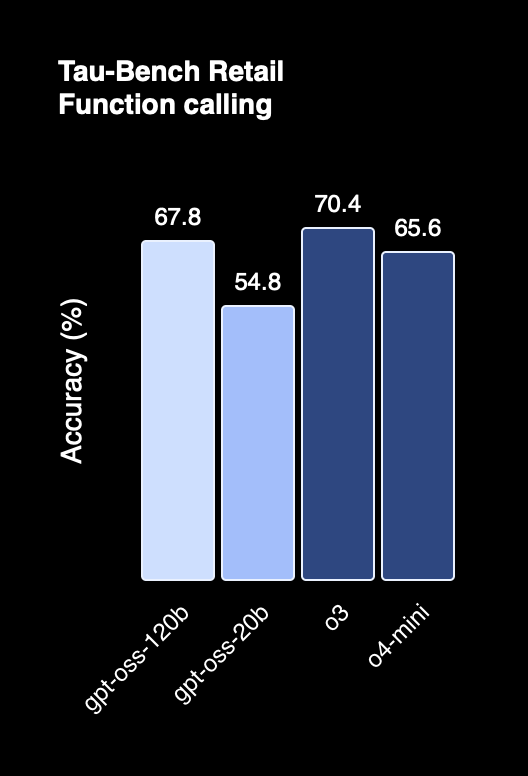

在标准学术基准测试中评估了 gpt‑oss‑120b 和 gpt‑oss‑20b,在编程、竞赛数学、健康,以及代理式工具使用等任务上,与 OpenAI 的推理模型(包括 o3、o3‑mini 和 o4‑mini)进行了对比。

gpt‑oss‑120b 在 Codeforces 代码竞赛、通用问题解决(MMLU 和 HLE)以及工具调用(TauBench)等测试中均优于 o3‑mini,并在这些领域的表现与 o4‑mini 相当或更好。更重要的是,在健康相关的任务(HealthBench)和数学竞赛题(如 2024 和 2025 年的 AIME)上,它甚至超过了 o4‑mini。

尽管 gpt‑oss‑20b 体量更小,但仍在上述评测中能够与 o3‑mini 匹敌,甚至在竞赛数学和健康领域表现更好。

GPT‑OSS 强调推理能力,包括“chain‑of‑thought”思维链式推理,这意味着模型在回答复杂问题时会分步骤思考,并向用户展示思路。这种机制不仅提升了模型的准确性,也便于追踪和检测潜在误用行为。此外,GPT‑OSS 支持联网浏览网页、执行代码、调用代理功能,并可结合更大云端模型协同工作。

安全性也是 OpenAI 的重点关注。GPT‑OSS 是该公司迄今最严格测试的开放模型之一:它们经过内部模拟恶意使用、并通过外部安全机构评估,结果显示即便被攻击者精调,模型也未表现出高风险能力。同时 OpenAI 延迟了发布计划两次,以进行额外的安全审查。

在Meta刚刚宣布闭源后,OpenAI为何在此时开源?OpenAI 高层表态,回归“民主化 AI”的使命,将技术带入更多人手中。他们认为很多用户已在使用开源模型,开放 GPT‑OSS 可以补足空白,同时推动研究创新,让更多人参与开发生态。这也是面对全球竞争格局的战略回应,突出在开放 AI 领域继续引领的意图。

总的来说,GPT‑OSS 对普通用户最直观的意义在于:你可以在自己的电脑上部署一个能力堪比云端的模型,不依赖网络、不需要付费,也可以根据需要做个性化定制。对技术社区而言,开放权重意味着可以深入分析模型内部机制,探索更多创新用途;对广大开发者或初创团队来说,这降低了进入先进语言模型领域的门槛。

这一举措无疑让 AI 更加开放透明,也将带动国内外开发者参与探索新工具和应用的热潮。GPT‑OSS 的发布,可能会成为未来 AI 平台、插件、垂直领域应用逐渐本地化、个性化发展的重要里程碑。

AI大模型学习路线

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

这是一份大模型从零基础到进阶的学习路线大纲全览,小伙伴们记得点个收藏!

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

100套AI大模型商业化落地方案

大模型全套视频教程

200本大模型PDF书籍

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

LLM面试题合集

大模型产品经理资源合集

大模型项目实战合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献193条内容

已为社区贡献193条内容

所有评论(0)