揭秘大模型优化:模型剪枝技术,如何“剪”出高效性能?

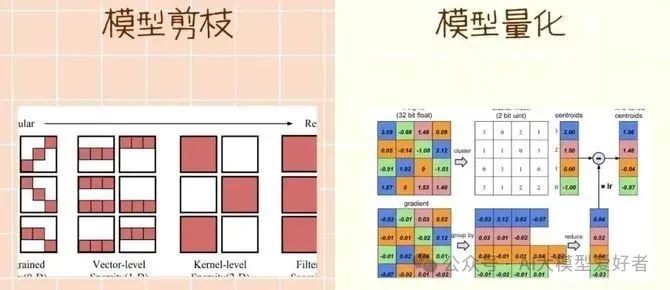

本文深入探讨了模型剪枝技术在AI领域的应用与发展。文章将剪枝比作"AI减肥术",通过去除神经网络中不重要的参数或结构,有效降低计算量和存储成本。作者详细介绍了结构化/非结构化剪枝等不同方法,分析了其在边缘设备部署、大语言模型优化等场景的应用价值,并提供了基于PyTorch的剪枝代码示例。文章指出,剪枝技术虽可能影响精度,但能显著提升推理速度、降低部署成本,未来发展将趋向软硬协同

如果你曾在深夜跑过一个百亿参数的大模型,一边眼睁睁看着GPU爆显存,一边默默刷卡加云算力,那你一定会和我一样,对“让模型更小、更快”的技术——模型剪枝(Model Pruning)爱得深沉。

剪枝,听起来像是修树,其实也是。它的目标,就是像园丁一样,去除神经网络中那些“不长果子”的枝叶,让整棵树更健康、更高效。

本文将带你深入了解剪枝技术的来龙去脉,从技术原理、实际应用到工程实现,以及未来的发展趋势,一起看看这项“AI减肥术”的神奇魔力。

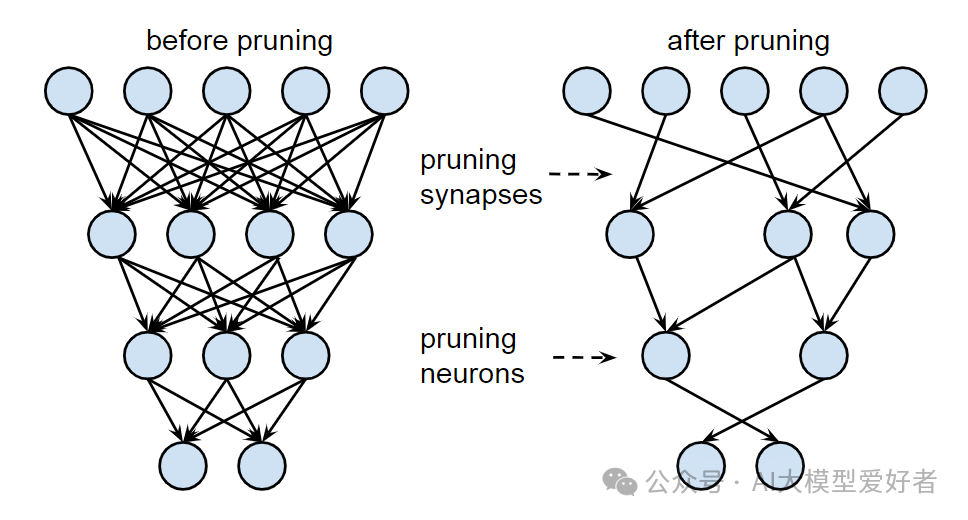

一、什么是模型剪枝?能剪哪里?

在深度学习模型中,尤其是大模型(如GPT、BERT、LLaMA这类参数动辄上百亿的庞然大物),并不是每一个神经元、每一个连接都对最终预测结果起到关键作用。

剪枝的本质:

识别出网络中“不重要”的参数或结构,然后将其“剪掉”,以降低计算量和存储成本。

常见的剪枝类型

|

剪枝方式 |

描述 |

类比 |

|---|---|---|

| 非结构化剪枝(Unstructured Pruning) |

剪掉单个权重值(通常是接近于0的) |

像在整棵树中挑选每一片枯叶 |

| 结构化剪枝(Structured Pruning) |

剪掉整个通道、滤波器或神经元块 |

一刀剪掉一整个树枝 |

| 动态剪枝(Dynamic Pruning) |

根据输入实时决定是否激活某些神经元 |

类似“临时休假”员工 |

| 稀疏训练(Sparsity Aware Training) |

在训练过程中引导模型形成可剪枝结构 |

边长边瘦身,科学又健康 |

非结构化剪枝粒度小,但硬件加速难;结构化剪枝更适配GPU/TPU推理,但对模型影响大。实际部署时要根据场景权衡使用。

二、剪枝都用在哪?它正在改变哪些行业?

1. 边缘设备的模型部署

-

手机、智能音箱、穿戴设备上的AI助手;

-

无法装配高性能芯片的智能摄像头;

-

工业控制器中的轻量化质量检测模型。

剪枝让模型“塞进”设备,AI不再云端遥不可及,而是与你“近在咫尺”。

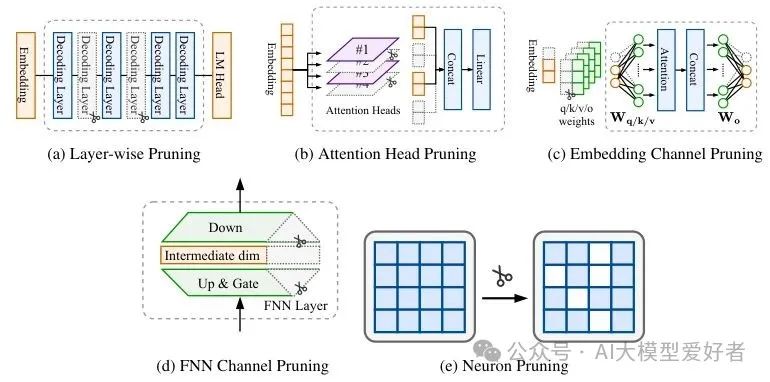

2. 大语言模型的推理优化

在企业内部部署 LLaMA、Baichuan、ChatGLM 等大模型时,内存和推理时间是一大痛点。通过剪枝:

-

减少延迟,提升响应速度;

-

降低推理成本,尤其是在多轮对话场景中节省电费和租金。

3. 模型压缩与迁移学习

-

模型训练后太大,无法迁移到其他任务?

-

剪枝后配合知识蒸馏,可进一步迁移压缩,适合中小任务部署。

剪枝技术与蒸馏、量化、低秩分解等方法组合拳出击,是当前“小模型时代”的主力选手。

三、剪枝怎么做?一套技术流程带你上手!

以 PyTorch 为例,我们来用一段可复用的剪枝代码 + HuggingFace 模型演示实际流程。

1. 安装必要工具

pip install torch torchvision transformers accelerate2. 使用 PyTorch 提供的剪枝工具(以非结构化为例)

import torchimport torch.nn.utils.prune as pruneimport torch.nn.functional as Fimport torch.nn as nnclass MyNet(nn.Module):def __init__(self):super().__init__()self.fc1 = nn.Linear(768, 512)self.fc2 = nn.Linear(512, 10)def forward(self, x):x = F.relu(self.fc1(x))return self.fc2(x)model = MyNet()# 对fc1进行非结构化剪枝,剪掉50%小权重prune.l1_unstructured(model.fc1, name="weight", amount=0.5)# 查看剪枝结果print(model.fc1.weight_mask)

3. 保存剪枝后模型

# 把剪枝结构“合并”到权重中prune.remove(model.fc1, 'weight')torch.save(model.state_dict(), "pruned_model.pth")

常见框架支持情况

|

框架 |

剪枝支持 |

是否支持结构化 |

工程成熟度 |

|---|---|---|---|

|

PyTorch |

✅ |

✅ |

⭐⭐⭐⭐ |

|

TensorFlow + TFLite |

✅ |

✅ |

⭐⭐⭐ |

|

HuggingFace Transformers |

✅(需结合外部工具,如 |

✅ |

⭐⭐⭐⭐ |

|

DeepSpeed |

✅(与稀疏训练结合) |

✅ |

⭐⭐⭐⭐ |

四、剪枝的优缺点和未来趋势

优点

-

推理加速:少算就是快!

-

减少显存占用:小模型更易部署;

-

降低成本:云端部署费用大幅降低;

-

适配隐私部署:本地运行大模型不再遥不可及。

缺点

-

剪太狠易失智:过度剪枝会显著影响精度;

-

剪枝策略复杂:选择什么剪、怎么剪、剪多少是一门学问;

-

对硬件友好度不一:稀疏结构未必能被GPU加速支持好。

发展趋势

-

软硬协同剪枝:未来剪枝策略将与硬件平台(如NVIDIA TensorRT、Apple ANE)联合优化;

-

自动剪枝(AutoPrune):利用AutoML自动选择最佳剪枝策略;

-

与蒸馏/量化/低秩分解结合:形成多模态压缩流水线;

-

多任务共享剪枝:不同任务共享一个“剪好”的骨架,提升迁移效率。

剪枝不仅仅是模型压缩,更是一种智能资源调度策略,未来在边缘智能、AI芯片、智能终端中将大放异彩。

五、让AI“瘦身”,不仅是效率,更是普惠

我们总以为,AI的进步靠的是“大力出奇迹”。但现实告诉我们,真正聪明的技术,是把“过剩的聪明”合理舍弃。

剪枝技术,就是在“舍”中求“稳”、在“剪”中求“快”。它让庞大的神经网络更像人类大脑那样,有选择性地激活、遗忘、优化资源。

未来每一个运行在手机、耳机、眼镜、甚至手表里的智能助手,也许背后都有剪枝技术默默贡献的“优雅身姿”。

如果说大模型是AI时代的鲸鱼,那么剪枝,就是帮助鲸鱼轻松游弋于浅海的“流线型优化”。

六、AI大模型学习路线

如果你对AI大模型入门感兴趣,那么你需要的话可以点击这里大模型重磅福利:入门进阶全套104G学习资源包免费分享!

扫描下方csdn官方合作二维码获取哦!

这是一份大模型从零基础到进阶的学习路线大纲全览,小伙伴们记得点个收藏!

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

100套AI大模型商业化落地方案

大模型全套视频教程

200本大模型PDF书籍

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

LLM面试题合集

大模型产品经理资源合集

大模型项目实战合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献293条内容

已为社区贡献293条内容

所有评论(0)