小模型+大模型:两步走的RAG,非常详细收藏我这一篇就够了

《SPECULATIVERAG:通过起草机制增强检索增强生成》提出创新两阶段框架,将RAG任务分解为起草和验证阶段。该方法使用小型专家LM(起草者)基于不同文档子集并行生成多个答案草稿,再由大型通用LM(验证者)通过概率评估等指标选择最优答案。实验显示,在TriviaQA等四个基准数据集上,该方法相比标准RAG延迟最高降低51.25%,准确率显著提升,且无需额外指令微调。通过并行草稿生成和高效验证

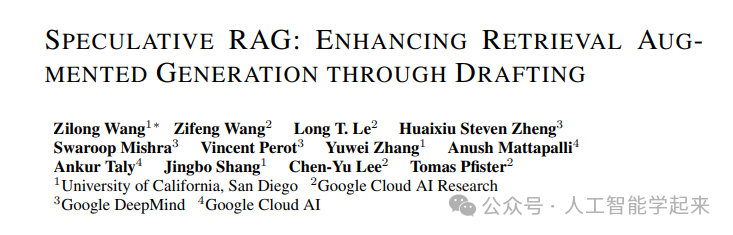

论文题目:SPECULATIVE RAG: ENHANCING RETRIEVAL AUGMENTED GENERATION THROUGH DRAFTING

论文地址:https://arxiv.org/pdf/2407.08223

创新点

-

SPECULATIVE RAG 将 RAG 任务分解为两个独立的阶段:起草(drafting)和验证(verification)。它利用一个较小的专家语言模型(LM)作为 RAG 起草者(drafter),专门负责根据检索到的文档生成多个答案草稿;然后由一个较大的通用 LM 作为 RAG 验证者(verifier),对这些草稿进行评估和验证,最终选择最准确的答案。

-

与一些需要对通用 LM 进行额外指令微调的 RAG 方法不同,SPECULATIVE RAG 的 RAG 验证者无需进行专门的指令微调。它直接利用通用 LM 的语言建模能力来评估草稿,大大简化了系统的实现过程,降低了训练成本和复杂度。

方法

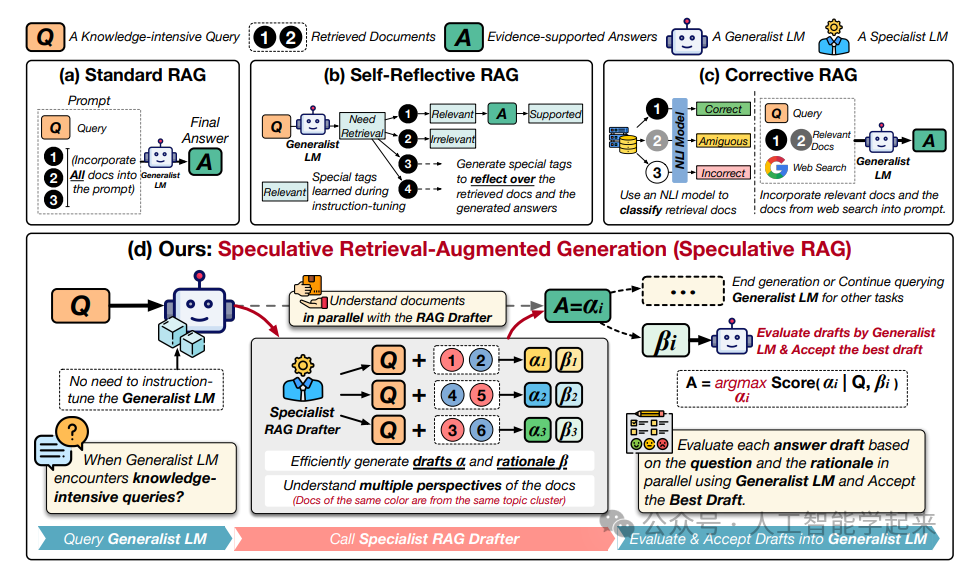

本文提出了一种名为 SPECULATIVE RAG(Speculative Retrieval-Augmented Generation)的研究方法,旨在通过一种高效的框架设计来提升检索增强型生成(RAG)系统的性能。该方法的核心在于将 RAG 任务分解为两个阶段:起草(drafting) 和 验证(verification)。在起草阶段,SPECULATIVE RAG 使用一个较小的专家语言模型(LM),称为 RAG 起草者(drafter),负责根据检索到的文档生成多个答案草稿。为了充分利用检索结果中的多样化信息,起草者采用了一种 多视角采样策略。在验证阶段,SPECULATIVE RAG 利用一个较大的通用 LM,称为 RAG 验证者(verifier),对起草者生成的多个草稿进行评估和验证。验证者通过计算每个草稿的 生成概率、自一致性得分 和 自我反思得分 来综合评估草稿的质量。

不同 RAG 方法的示意图

-

(a) Standard RAG:标准 RAG 方法将所有检索到的文档直接整合到提示(prompt)中,传递给通用语言模型(LM),这种方法在处理长文档时效率较低。

-

(b) Self-Reflective RAG:自反思 RAG 方法通过在通用 LM 中生成特定的标记来反思检索到的文档和生成的答案,需要额外的指令微调。

-

(c) Corrective RAG:校正 RAG 方法使用一个外部的自然语言推理(NLI)模型来评估检索到的文档的相关性,但缺乏高级推理能力。

-

(d) Speculative RAG:本文提出的方法,利用一个较小的专家 LM(RAG 起草者)并行生成多个答案草稿,每个草稿基于不同的文档子集。然后,较大的通用 LM(RAG 验证者)对这些草稿进行验证,选择最佳答案。这种方法通过减少每个草稿的输入标记数量,提高了效率并减少了潜在的长文档位置偏差问题。

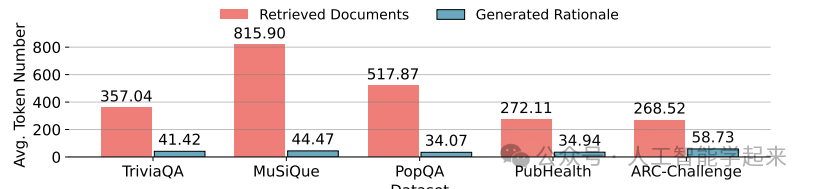

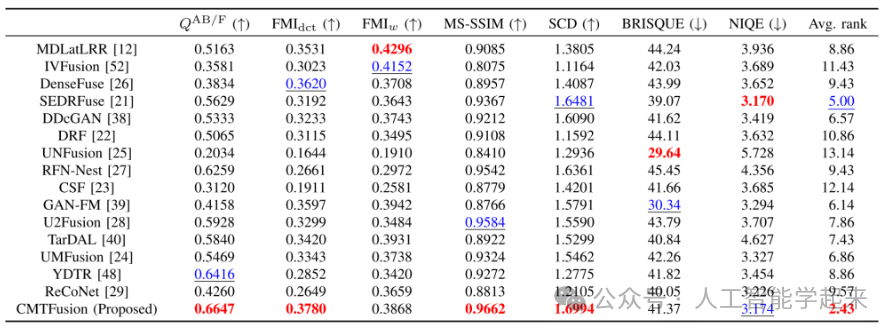

标准 RAG 和 Speculative RAG 的延迟分析

本图展示了标准 RAG 和 Speculative RAG 在 TriviaQA、MuSiQue、PubHealth 和 ARC-Challenge 四个数据集上的平均处理时间。标准 RAG 采用不同大小的张量并行以适应 GPU 内存,但并行化开销未显著提升效率。而 Speculative RAG 通过并行生成多个草稿,并利用较小的 RAG 起草者和较大的 RAG 验证者进行验证,显著降低了处理时间,如在 PubHealth 数据集上延迟减少了 51.25%。图中红色标注部分表示 Speculative RAG 相比标准 RAG 的延迟减少比例。

不同草稿数量和文档子集大小下的 Speculative RAG 性能分析

-

(a) 不同草稿数量的影响:展示了在 TriviaQA 和 PubHealth 数据集上,随着草稿数量的增加(5、10、15、20 个草稿),Speculative RAG 的准确率如何变化。结果表明,增加草稿数量可以进一步提升性能,因为更多的草稿能够覆盖更多文档的视角。

-

(b) 不同文档子集大小的影响:展示了在 TriviaQA 和 PubHealth 数据集上,改变每个草稿的文档子集大小(1、2、4、6 个文档)对性能的影响。结果表明,增加文档子集大小并不总是能提升性能,Speculative RAG 即使在每个草稿中只使用少量文档时也能取得很好的效果。

实验

本表展示了在四个公共检索增强生成基准数据集(TriviaQA、MuSiQue、PubHealth 和 ARC-Challenge)上不同 RAG 方法的性能对比。这些数据集涵盖了开放域问答和封闭域问答任务,用于评估模型在生成准确答案方面的能力。表中列出了多种 RAG 方法,包括标准 RAG 方法(如基于不同预训练语言模型的实现)、自反思 RAG(Self-Reflective RAG)、校正 RAG(Corrective RAG)以及本文提出的 Speculative RAG。每种方法的性能通过准确率(accuracy)来衡量,反映了模型生成的答案与真实答案的匹配程度。从表中可以看出,Speculative RAG 在所有四个数据集上均取得了最佳性能。总体而言,本表通过对比不同 RAG 方法在多个数据集上的准确率,清晰地展示了 Speculative RAG 方法在检索增强生成任务中的优越性,特别是在处理复杂的知识密集型问答时,其通过高效的起草和验证机制,显著提高了生成答案的质量和效率。

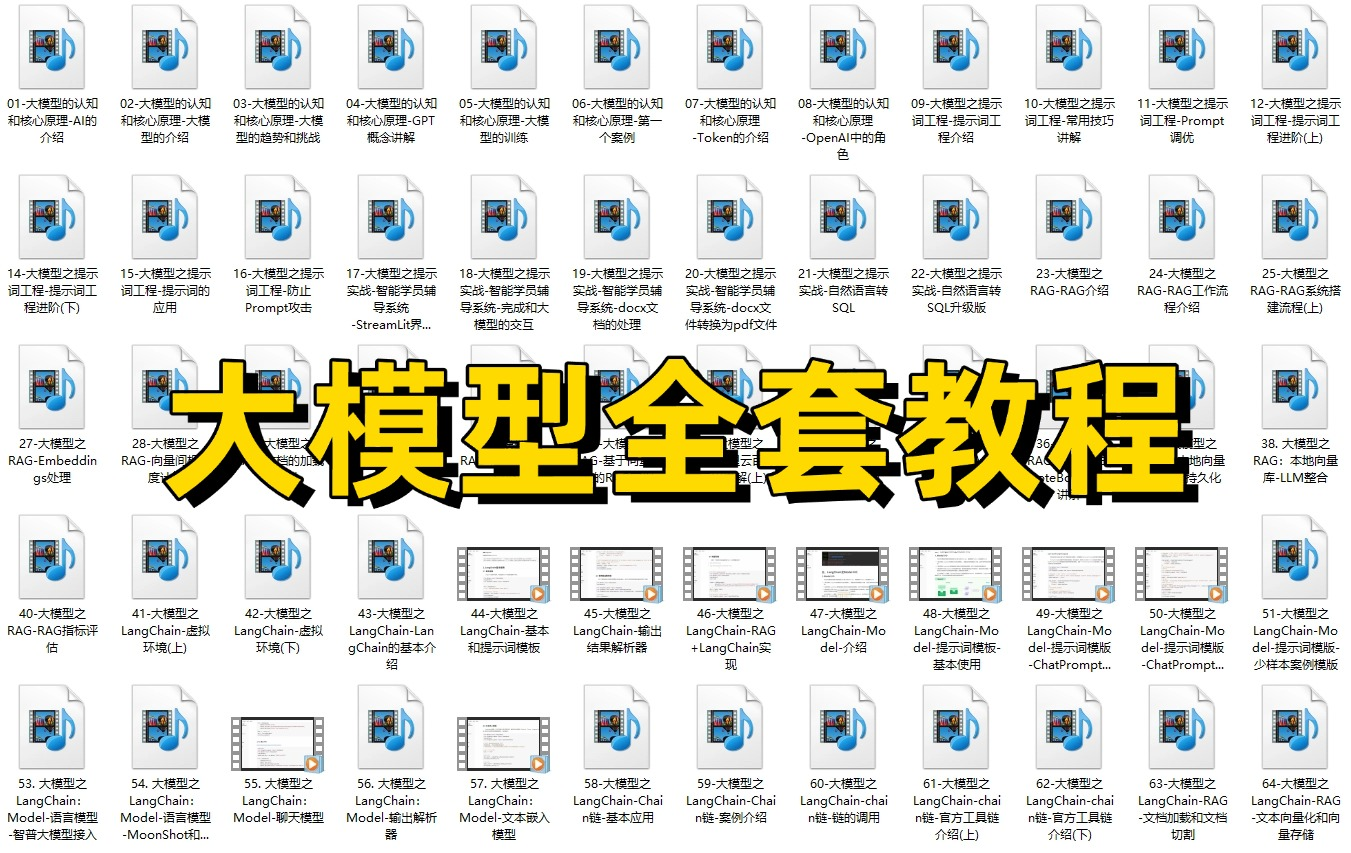

AI大模型从0到精通全套学习大礼包

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

只要你是真心想学AI大模型,我这份资料就可以无偿共享给你学习。大模型行业确实也需要更多的有志之士加入进来,我也真心希望帮助大家学好这门技术,如果日后有什么学习上的问题,欢迎找我交流,有技术上面的问题,我是很愿意去帮助大家的!

如果你也想通过学大模型技术去帮助就业和转行,可以点扫描下方👇👇

大模型重磅福利:入门进阶全套104G学习资源包免费分享!

01.从入门到精通的全套视频教程

包含提示词工程、RAG、Agent等技术点

02.AI大模型学习路线图(还有视频解说)

全过程AI大模型学习路线

03.学习电子书籍和技术文档

市面上的大模型书籍确实太多了,这些是我精选出来的

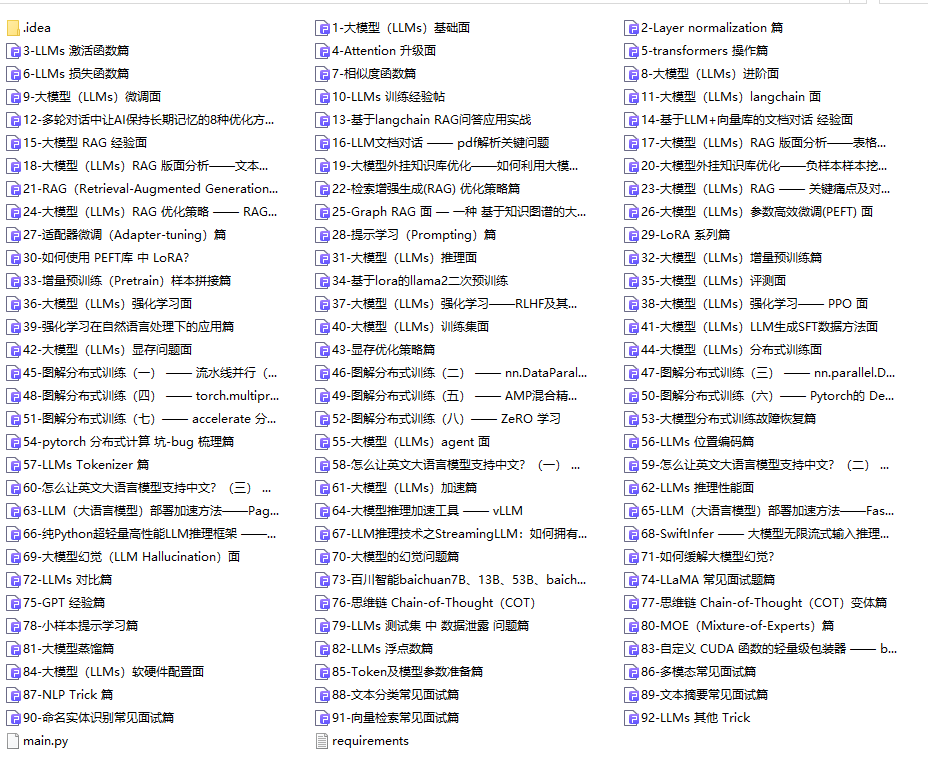

04.大模型面试题目详解

05.这些资料真的有用吗?

这份资料由我和鲁为民博士共同整理,鲁为民博士先后获得了北京清华大学学士和美国加州理工学院博士学位,在包括IEEE Transactions等学术期刊和诸多国际会议上发表了超过50篇学术论文、取得了多项美国和中国发明专利,同时还斩获了吴文俊人工智能科学技术奖。目前我正在和鲁博士共同进行人工智能的研究。

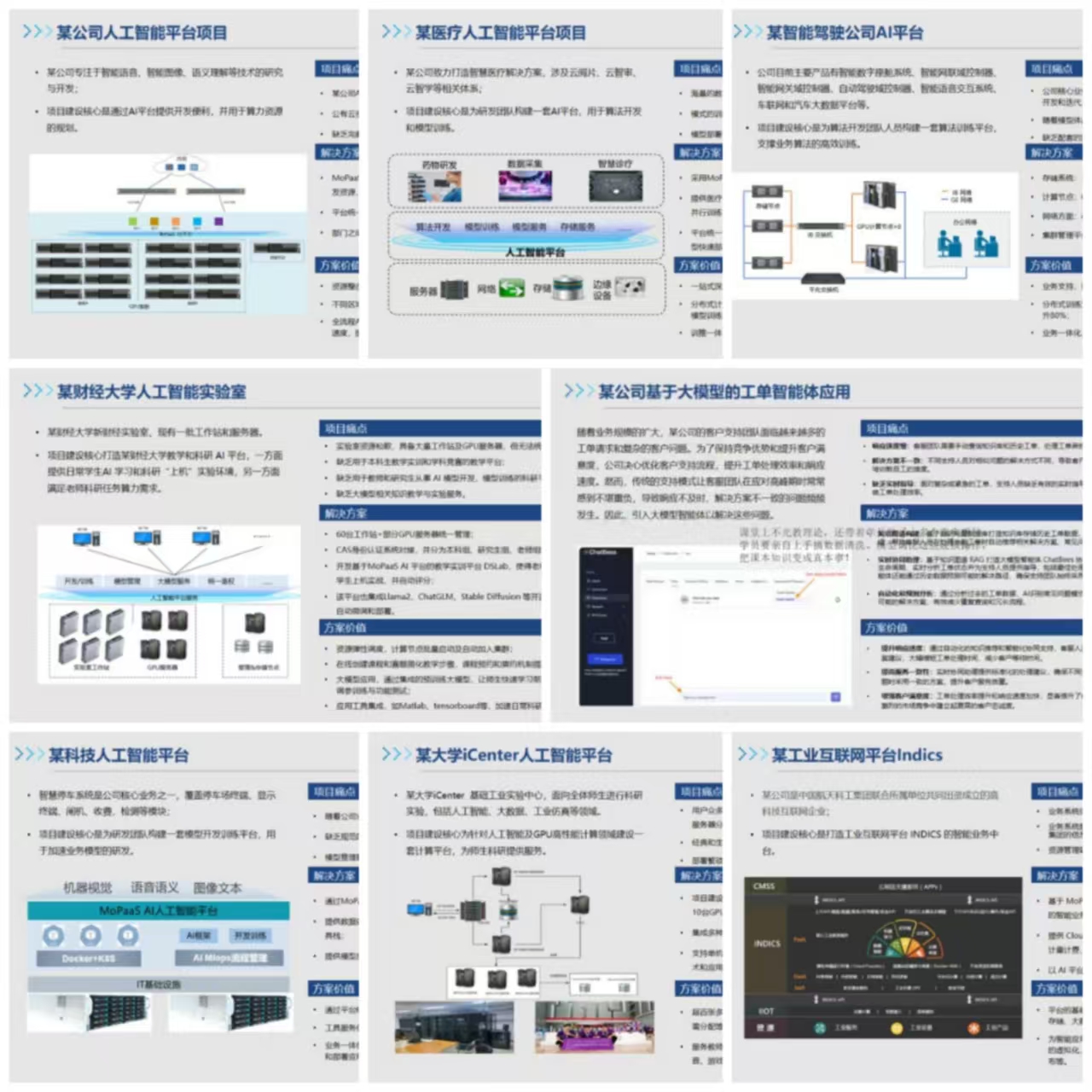

所有的视频由智泊AI老师录制,且资料与智泊AI共享,相互补充。这份学习大礼包应该算是现在最全面的大模型学习资料了。

资料内容涵盖了从入门到进阶的各类视频教程和实战项目,无论你是小白还是有些技术基础的,这份资料都绝对能帮助你提升薪资待遇,转行大模型岗位。

智泊AI始终秉持着“让每个人平等享受到优质教育资源”的育人理念,通过动态追踪大模型开发、数据标注伦理等前沿技术趋势,构建起"前沿课程+智能实训+精准就业"的高效培养体系。

课堂上不光教理论,还带着学员做了十多个真实项目。学员要亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

如果说你是以下人群中的其中一类,都可以来智泊AI学习人工智能,找到高薪工作,一次小小的“投资”换来的是终身受益!

应届毕业生:无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型:非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能 突破瓶颈:传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

更多推荐

已为社区贡献185条内容

已为社区贡献185条内容

所有评论(0)