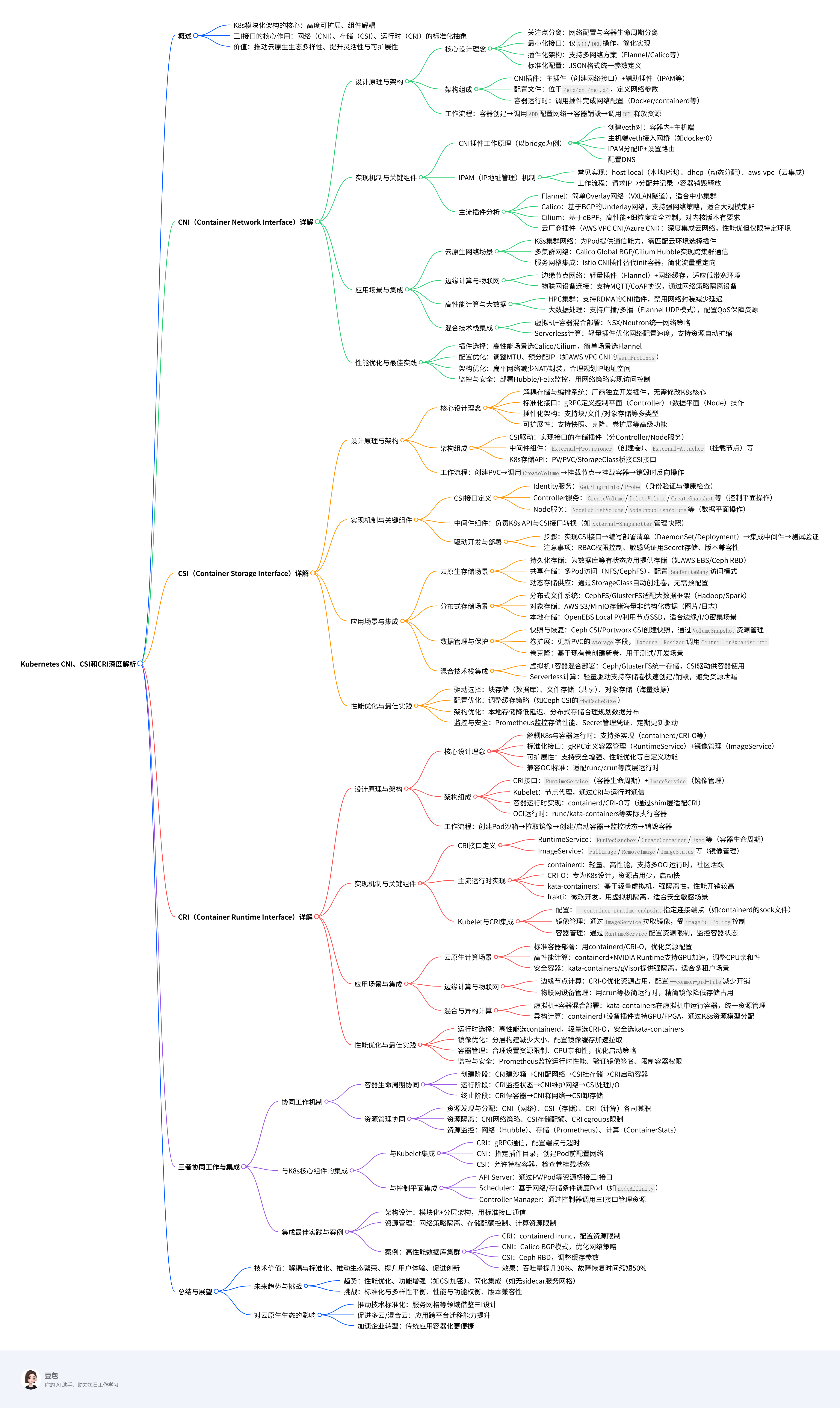

Kubernetes CNI、CSI和CRI深度解析:技术实施与架构设计

Kubernetes作为目前最流行的容器编排平台,其成功很大程度上依赖于其高度模块化和可扩展的架构设计。在Kubernetes生态系统中,CNI(Container Network Interface)、CSI(Container Storage Interface)和CRI(Container Runtime Interface)是三个关键的接口规范,它们分别负责网络、存储和容器运行时的抽象,使

目录标题

Kubernetes CNI、CSI和CRI深度解析:技术实施与架构设计

一、概述

Kubernetes作为目前最流行的容器编排平台,其成功很大程度上依赖于其高度模块化和可扩展的架构设计。在Kubernetes生态系统中,CNI(Container Network Interface)、CSI(Container Storage Interface)和CRI(Container Runtime Interface)是三个关键的接口规范,它们分别负责网络、存储和容器运行时的抽象,使得Kubernetes能够与不同的基础设施和组件进行无缝集成。

这三个接口规范的出现解决了Kubernetes早期版本中的一些局限性,使得容器网络、存储和运行时的实现可以独立于Kubernetes核心代码进行开发和演进。这种设计不仅提高了Kubernetes的灵活性和可扩展性,也促进了云原生生态系统的多样性和繁荣。

本文将从技术实施和架构设计的角度,深入分析CNI、CSI和CRI的设计原理、实现机制以及在不同场景下的应用与集成方法,帮助读者全面理解这三个关键组件在Kubernetes生态系统中的作用和价值。

二、CNI(Container Network Interface)详解

2.1 CNI设计原理与架构

CNI(容器网络接口)是一个由Cloud Native Computing Foundation(CNCF)维护的规范,它定义了容器运行时与网络插件之间的接口标准。CNI的设计目标是提供一种简单、高效的方式,让容器能够获取网络连接并与其他容器和外部网络进行通信。

CNI的核心设计理念包括:

-

关注点分离:CNI将网络配置与容器生命周期分离,容器运行时负责创建和销毁容器,而网络插件负责为容器配置网络。

-

最小化接口:CNI定义了非常简洁的API,主要包括

ADD和DEL两个操作,分别用于为容器添加网络接口和删除网络接口,这使得实现CNI插件变得相对简单。 -

插件化架构:CNI采用插件化设计,支持多种网络实现,如Flannel、Calico、Cilium等,用户可以根据自己的需求选择最适合的网络解决方案。

-

标准化配置:CNI通过JSON格式的配置文件来定义网络参数,使得不同的网络插件可以使用统一的配置格式。

在架构上,CNI主要由以下几个部分组成:

-

CNI插件:实现具体网络功能的组件,如创建网络接口、分配IP地址、设置路由等。CNI插件分为两种类型:主插件(负责创建网络接口)和辅助插件(负责额外的网络配置,如IPAM)。

-

CNI配置文件:定义网络参数和使用的插件列表,通常位于

/etc/cni/net.d/目录下。 -

容器运行时:负责调用CNI插件为容器配置网络,如Docker、containerd、CRI-O等。

CNI的工作流程大致如下:当容器运行时创建一个新容器时,它首先创建一个没有网络接口的容器,然后调用CNI插件的ADD操作,传递容器的命名空间、网络配置等信息。CNI插件根据配置创建网络接口并将其添加到容器的命名空间中,配置IP地址和路由,最后返回网络配置结果给容器运行时。当容器被销毁时,容器运行时调用CNI插件的DEL操作,移除容器的网络接口。

2.2 CNI实现机制与关键组件

CNI的实现机制基于Linux的网络命名空间和虚拟网络设备技术,通过标准化的接口让不同的网络插件可以为容器提供网络连接。理解CNI的实现机制对于正确选择和配置网络插件至关重要。

2.2.1 CNI插件的工作原理

CNI插件的主要工作是为容器创建网络接口并配置网络参数。以常见的bridge插件为例,其工作原理如下:

-

创建虚拟网络设备:通常使用veth对(虚拟以太网设备对),其中一端放在容器的网络命名空间中,另一端留在主机命名空间中。

-

将主机端veth设备添加到网桥:主机端的veth设备被添加到一个网桥(如docker0),这样容器就可以通过网桥与其他容器和主机进行通信。

-

分配IP地址:调用IPAM(IP地址管理)插件为容器分配IP地址,通常使用dhcp或静态分配方式。

-

设置路由:为容器设置默认路由,通常指向网桥的IP地址。

-

配置DNS:将主机的DNS配置复制到容器中,或者根据网络配置提供特定的DNS服务器。

对于更复杂的网络插件,如Calico或Cilium,它们可能会实现更高级的功能,如网络策略、服务网格集成等,但基本的工作流程与bridge插件类似,都是围绕创建网络接口和配置网络参数展开的。

2.2.2 IPAM(IP地址管理)机制

IPAM是CNI架构中的一个重要组成部分,负责为容器分配IP地址。CNI定义了专门的IPAM插件接口,使得IP地址管理可以独立于网络插件进行实现。

常见的IPAM实现包括:

-

host-local:基于本地配置的IP地址池,通常用于测试环境或简单网络。

-

dhcp:使用DHCP服务器为容器分配IP地址,适用于需要动态分配IP的场景。

-

aws-vpc:AWS特定的IPAM实现,与AWS VPC网络集成,为容器分配VPC内的IP地址。

IPAM插件的工作流程如下:

-

请求IP地址:网络插件调用IPAM插件的

GET操作,请求为容器分配IP地址。 -

分配IP地址:IPAM插件根据配置的地址池或策略分配一个可用的IP地址,并记录分配状态。

-

释放IP地址:当容器被销毁时,网络插件调用IPAM插件的

DEL操作,释放之前分配的IP地址,使其可以被重新使用。

IPAM的设计使得网络配置和地址分配可以解耦,不同的网络插件可以使用相同的IPAM插件,提高了组件的复用性和灵活性。

2.2.3 主流CNI插件分析

目前Kubernetes生态系统中有多种CNI插件可供选择,每种插件都有其独特的设计特点和适用场景。以下是几种主流CNI插件的分析:

-

Flannel:

- 设计特点:Flannel是一种简单的Overlay网络解决方案,通过在主机之间建立VXLAN隧道来实现容器网络的互通。

- 架构:Flannel使用etcd作为后端存储,存储网络配置和子网分配信息。每个节点上运行一个flanneld进程,负责管理该节点的子网和隧道配置。

- 优缺点:优点是配置简单、性能较好;缺点是功能相对有限,缺乏高级网络策略支持。

-

Calico:

- 设计特点:Calico是一种基于BGP的网络解决方案,提供了丰富的网络策略和安全功能。

- 架构:Calico不使用Overlay网络,而是直接利用原生IP路由,通过BGP协议在节点之间传播路由信息。每个节点上运行calico-node进程和BIRD BGP守护进程。

- 优缺点:优点是性能高、功能强大;缺点是配置相对复杂,需要对BGP有一定了解。

-

Cilium:

- 设计特点:Cilium是一种基于eBPF的高级网络解决方案,提供了强大的网络可见性和安全控制能力。

- 架构:Cilium利用Linux内核中的eBPF技术,可以在不修改应用代码的情况下对网络流量进行高效处理和监控。

- 优缺点:优点是性能极高、功能丰富;缺点是对内核版本有一定要求,部署复杂度较高。

-

AWS VPC CNI:

- 设计特点:AWS专为Amazon EKS设计的CNI插件,直接利用AWS VPC的网络功能。

- 架构:该插件管理节点上的弹性网络接口(ENI),为每个容器分配VPC内的IP地址,实现容器与VPC资源的直接通信。

- 优缺点:优点是性能高、与AWS生态系统集成紧密;缺点是只能在AWS环境中使用,缺乏跨云支持。

-

Azure CNI:

- 设计特点:Azure专为AKS设计的CNI插件,提供了与Azure虚拟网络的集成。

- 架构:支持动态IP分配和静态块分配两种模式,后者可以更高效地利用IP地址空间。

- 优缺点:优点是与Azure环境集成紧密,支持高级网络功能;缺点是仅限于Azure环境使用。

这些插件在设计上各有特色,用户应根据自己的基础设施环境、性能需求和功能要求选择最适合的CNI插件。

2.3 CNI在不同场景下的应用与集成

CNI的灵活性和可扩展性使其能够适应各种复杂的网络场景。以下将详细分析CNI在不同场景下的应用与集成方法。

2.3.1 云原生网络场景

在云原生环境中,CNI是连接容器与云基础设施的桥梁,以下是几种典型的云原生网络场景:

-

Kubernetes集群网络:

- 应用场景:为Kubernetes集群中的Pod提供网络连接,确保Pod之间以及Pod与服务之间的通信。

- 集成方法:通过在Kubernetes节点上安装CNI插件,并配置kubelet使用该插件。通常需要修改kubelet的启动参数,指定CNI配置目录。

- 最佳实践:选择与云提供商或基础设施环境匹配的CNI插件,如在AWS上使用AWS VPC CNI,在Azure上使用Azure CNI,在裸机环境使用Calico或Flannel。

-

多集群网络:

- 应用场景:连接多个Kubernetes集群,实现跨集群的服务发现和通信。

- 集成方法:通常需要使用支持多集群的网络解决方案,如Calico的Global BGP或Cilium的Hubble,或者通过云提供商的跨VPC连接功能。

- 最佳实践:在多集群场景下,应采用统一的网络策略管理,并考虑网络性能和安全性。

-

服务网格集成:

- 应用场景:将CNI与服务网格(如Istio、Linkerd)集成,实现细粒度的流量控制和服务间通信管理。

- 集成方法:以Istio为例,其提供了专门的CNI插件,可以在Pod创建时自动配置流量重定向,无需使用init容器。

- 最佳实践:在服务网格场景下,推荐使用支持CNI集成的服务网格解决方案,如Istio的Ambient模式或Cilium的服务网格功能,以简化部署和提高性能。

2.3.2 边缘计算与物联网场景

在边缘计算和物联网场景中,网络资源通常受限且网络条件复杂,CNI提供了灵活的解决方案:

-

边缘节点网络:

- 应用场景:为边缘节点上的容器提供网络连接,通常需要支持低带宽、高延迟和不稳定的网络环境。

- 集成方法:选择轻量级的CNI插件,如Flannel或简化版的Calico,并优化网络配置以适应边缘环境。

- 最佳实践:在边缘节点上启用网络缓存和本地服务发现,减少对中心网络的依赖,提高应用的可靠性。

-

物联网设备连接:

- 应用场景:将物联网设备与容器化应用连接,实现设备数据的采集和处理。

- 集成方法:使用支持IoT协议(如MQTT、CoAP)的CNI插件,或通过网络策略控制设备与应用之间的通信。

- 最佳实践:在物联网场景下,应特别关注网络安全,通过CNI的网络策略功能实现设备的安全隔离和访问控制。

2.3.3 高性能计算与大数据场景

在高性能计算和大数据场景中,网络性能是关键考量因素,CNI提供了多种优化方案:

-

高性能计算集群:

- 应用场景:为高性能计算(HPC)工作负载提供低延迟、高带宽的网络连接。

- 集成方法:使用支持RDMA(远程直接内存访问)的CNI插件,如专门为HPC优化的CNI实现。

- 最佳实践:在HPC场景下,应禁用不必要的网络封装和NAT,使用扁平网络架构以减少网络延迟。

-

大数据处理:

- 应用场景:为大数据处理框架(如Hadoop、Spark)提供高效的网络支持,通常需要处理大量数据传输。

- 集成方法:使用支持广播和多播的CNI插件,如Flannel的UDP模式或Calico的IPIP模式,并优化网络带宽分配。

- 最佳实践:在大数据场景下,应考虑使用支持网络优先级和QoS的CNI插件,确保关键应用获得足够的网络资源。

2.3.4 与其他技术栈的集成

CNI不仅限于Kubernetes环境,还可以与其他技术栈集成:

-

虚拟机与容器混合部署:

- 应用场景:在同一基础设施上同时运行虚拟机和容器,需要统一的网络管理。

- 集成方法:使用支持混合环境的网络解决方案,如VMware的NSX或OpenStack的Neutron,并通过CNI插件将容器接入相同的网络。

- 最佳实践:在混合部署场景下,应采用统一的网络策略管理,确保虚拟机和容器之间的通信安全和一致性。

-

Serverless计算:

- 应用场景:为Serverless平台(如Knative、OpenFaaS)提供网络支持,通常需要快速的网络配置和释放。

- 集成方法:使用轻量级的CNI插件,并优化插件性能以支持快速的容器启动和销毁。

- 最佳实践:在Serverless场景下,应考虑使用支持网络资源自动扩展的CNI解决方案,以适应动态变化的工作负载。

2.4 CNI性能优化与最佳实践

CNI的性能直接影响容器的启动速度和网络吞吐量,以下是一些CNI性能优化的最佳实践:

-

插件选择与配置优化:

- 根据工作负载特点选择合适的CNI插件,如对性能要求高的应用选择Calico或Cilium,对简单网络需求选择Flannel。

- 优化CNI插件的配置参数,如调整MTU大小、启用缓存、优化IPAM策略等。例如,在AWS VPC CNI中,可以通过设置

warmPrefixes和warmIPs来预分配IP地址,减少Pod启动时间。

-

网络架构优化:

- 使用扁平网络架构,避免多层NAT和网络封装,减少网络延迟。

- 合理规划IP地址空间,为每个节点分配足够的IP地址,避免频繁的IP地址回收和重新分配。

- 在云环境中,利用云提供商的网络功能,如AWS的ENI或Azure的虚拟网络,实现高性能的容器网络。

-

资源管理优化:

- 为CNI插件分配足够的系统资源,特别是CPU和内存,确保插件能够高效运行。

- 在大规模集群中,考虑使用分布式CNI架构,如Cilium的Hubble,以提高可扩展性。

-

监控与调优:

- 部署CNI插件的监控工具,如Cilium的Hubble或Calico的Felix,实时监控网络性能和资源使用情况。

- 根据监控数据调整CNI配置和网络策略,优化网络性能和资源利用率。例如,在发现网络瓶颈时,可以调整网络队列长度或TCP参数。

-

安全优化:

- 使用支持网络策略的CNI插件,如Calico或Cilium,实现细粒度的网络访问控制。

- 定期更新CNI插件和相关组件,修复安全漏洞,提高系统安全性。

通过以上优化措施,可以显著提高CNI的性能和可靠性,满足各种复杂应用场景的网络需求。

三、CSI(Container Storage Interface)详解

3.1 CSI设计原理与架构

CSI(容器存储接口)是一个由Cloud Native Computing Foundation(CNCF)维护的标准接口,它允许Kubernetes和其他容器编排系统与各种存储系统进行集成。CSI的设计目标是提供一种标准化的方式,让存储提供商可以开发与容器编排系统兼容的存储插件,而无需修改编排系统的核心代码。

CSI的核心设计理念包括:

-

解耦存储提供商与编排系统:CSI将存储系统的实现细节与容器编排系统分离,使得存储提供商可以独立开发和维护存储插件,而无需依赖特定的编排系统。

-

标准化接口:CSI定义了一套标准化的gRPC接口,包括

Controller和Node两个服务,分别负责存储卷的控制平面和数据平面操作。 -

插件化架构:CSI采用插件化设计,支持多种存储实现,如本地存储、网络存储、对象存储等,用户可以根据自己的需求选择最适合的存储解决方案。

-

可扩展性:CSI允许存储提供商通过扩展接口实现高级功能,如快照、克隆、卷扩展等。

在架构上,CSI主要由以下几个部分组成:

-

CSI驱动:实现CSI接口的存储插件,负责与具体的存储系统进行交互。CSI驱动通常包括

Controller和Node两个服务,分别运行在控制平面和工作节点上。 -

CSI中间件:Kubernetes中内置的组件,负责将Kubernetes的存储API转换为CSI接口调用,包括

External-Provisioner、External-Attacher、External-Mounter等。 -

Kubernetes存储API:用户通过Kubernetes的标准存储API(如

PersistentVolume、PersistentVolumeClaim、StorageClass)来使用存储资源,这些API与CSI接口通过中间件进行桥接。

CSI的工作流程大致如下:当用户创建一个PersistentVolumeClaim(PVC)时,Kubernetes的StorageClass会指定对应的CSI驱动。External-Provisioner组件调用CSI驱动的ControllerCreateVolume接口创建存储卷,External-Attacher调用ControllerPublishVolume接口将存储卷挂载到目标节点,然后External-Mounter调用NodeStageVolume和NodePublishVolume接口将存储卷挂载到容器中。当不再需要存储卷时,相应的删除操作会被触发。

3.2 CSI实现机制与关键组件

CSI的实现机制基于gRPC远程过程调用,通过标准化的接口让不同的存储系统可以与Kubernetes集成。理解CSI的实现机制对于开发和部署CSI驱动至关重要。

3.2.1 CSI接口定义

CSI定义了三个主要的gRPC服务接口:

-

Identity服务:提供基本的身份验证和版本协商功能,包括

GetPluginInfo、GetPluginCapabilities和Probe三个方法。 -

Controller服务:提供控制平面操作,如创建、删除、快照、克隆存储卷,以及将存储卷挂载到节点等操作。主要方法包括:

CreateVolume:创建存储卷DeleteVolume:删除存储卷ControllerPublishVolume:将存储卷挂载到节点ControllerUnpublishVolume:将存储卷从节点卸载CreateSnapshot:创建存储卷快照DeleteSnapshot:删除存储卷快照ListSnapshots:列出存储卷快照

-

Node服务:提供数据平面操作,如将存储卷从节点挂载到容器等操作。主要方法包括:

NodeStageVolume:在节点上准备存储卷(可选)NodeUnstageVolume:取消节点上存储卷的准备(可选)NodePublishVolume:将存储卷挂载到容器NodeUnpublishVolume:将存储卷从容器卸载NodeGetVolumeStats:获取存储卷的使用统计信息(可选)

此外,CSI还定义了一些扩展接口,如ControllerExpandVolume用于卷扩展,ControllerGetCapabilities用于获取控制器服务的能力等。

3.2.2 CSI中间件组件

为了将Kubernetes的存储API转换为CSI接口调用,Kubernetes提供了一系列中间件组件:

-

External-Provisioner:负责根据

StorageClass和PersistentVolumeClaim创建和删除PersistentVolume对象。它调用CSI驱动的ControllerCreateVolume和ControllerDeleteVolume接口。 -

External-Attacher:负责将存储卷挂载到节点和从节点卸载。它调用CSI驱动的

ControllerPublishVolume和ControllerUnpublishVolume接口。 -

External-Mounter:负责将存储卷从节点挂载到容器。它调用CSI驱动的

NodeStageVolume、NodeUnstageVolume、NodePublishVolume和NodeUnpublishVolume接口。 -

External-Snapshotter:负责管理存储卷的快照。它调用CSI驱动的

CreateSnapshot、DeleteSnapshot和ListSnapshots接口。 -

External-Resizer:负责调整存储卷的大小。它调用CSI驱动的

ControllerExpandVolume接口。

这些中间件组件通常以容器的形式部署在Kubernetes集群中,与CSI驱动协同工作,实现完整的存储管理功能。

3.2.3 CSI驱动开发与部署

开发一个CSI驱动通常需要以下步骤:

-

实现CSI接口:根据CSI规范实现Identity、Controller和Node服务接口,可以使用任何支持gRPC的编程语言,但Go语言是最常用的选择。

-

编写部署清单:创建Kubernetes的

DaemonSet、Deployment和Service等资源,部署CSI驱动。通常需要为Controller服务和Node服务分别创建部署。 -

集成中间件组件:配置

External-Provisioner、External-Attacher等中间件组件,使其与CSI驱动协同工作。这通常通过ServiceAccount、ClusterRole和ClusterRoleBinding等RBAC资源来实现。 -

测试与验证:使用Kubernetes的

PersistentVolume和PersistentVolumeClaim等资源测试CSI驱动的功能,确保存储卷可以正常创建、挂载和卸载。

在部署CSI驱动时,需要特别注意以下几点:

-

权限管理:CSI驱动需要适当的权限来操作存储资源,应通过RBAC严格控制其权限范围。

-

安全性:CSI驱动可能需要访问敏感的存储凭证,应使用Kubernetes的

Secret资源来安全地存储和传递这些凭证。 -

可扩展性:对于分布式存储系统,应考虑CSI驱动的部署方式和资源配置,确保其能够处理大规模集群的存储请求。

-

版本兼容性:CSI驱动应明确声明支持的CSI版本,并与Kubernetes版本保持兼容。

目前,许多主流存储提供商都提供了官方的CSI驱动,如Ceph CSI、NFS CSI、AWS EBS CSI、Azure Disk CSI等,用户可以直接使用这些驱动来集成相应的存储系统。

3.3 CSI在不同场景下的应用与集成

CSI的灵活性和可扩展性使其能够适应各种复杂的存储场景。以下将详细分析CSI在不同场景下的应用与集成方法。

3.3.1 云原生存储场景

在云原生环境中,CSI是连接容器与存储系统的桥梁,以下是几种典型的云原生存储场景:

-

持久化存储:

- 应用场景:为有状态应用(如数据库、消息队列等)提供持久化存储,确保数据在容器重启或迁移后仍然可用。

- 集成方法:用户通过创建

PersistentVolumeClaim(PVC)来请求存储资源,Kubernetes根据StorageClass指定的CSI驱动创建和管理底层存储卷。 - 最佳实践:在选择存储类时,应根据应用的性能需求和数据安全要求选择合适的CSI驱动和配置参数。例如,对于高性能数据库应用,可以选择块存储类型的CSI驱动(如AWS EBS CSI或Ceph RBD CSI),并设置适当的IOPS和卷大小。

-

共享存储:

- 应用场景:多个容器或Pod需要同时访问同一存储卷,如文件共享、内容管理系统等。

- 集成方法:使用支持共享访问模式的CSI驱动,如NFS CSI、SMB CSI或CephFS CSI,并在

PersistentVolume或StorageClass中设置适当的访问模式(如ReadWriteMany或ReadOnlyMany)。 - 最佳实践:在共享存储场景下,应特别注意数据一致性和并发访问控制,可能需要使用分布式文件系统或网络文件系统(如NFS、SMB)作为底层存储,并通过CSI驱动提供给Kubernetes使用。

-

动态存储供应:

- 应用场景:根据应用的需求动态创建和销毁存储卷,无需手动预配置存储资源。

- 集成方法:通过

StorageClass定义存储供应的参数和策略,用户创建PersistentVolumeClaim时,Kubernetes自动触发CSI驱动的ControllerCreateVolume接口创建存储卷。 - 最佳实践:在动态存储供应场景下,应定义清晰的存储类参数,包括卷类型、大小限制、性能指标等,以确保自动创建的存储卷符合应用需求。

3.3.2 分布式存储场景

CSI为分布式存储系统与Kubernetes集成提供了标准化接口,以下是几种典型的分布式存储场景:

-

分布式文件系统:

- 应用场景:为大规模数据处理和分析工作负载提供高性能、可扩展的存储解决方案,如Hadoop、Spark等大数据框架。

- 集成方法:使用支持分布式文件系统的CSI驱动,如CephFS CSI、GlusterFS CSI等,并配置适当的存储类参数。

- 最佳实践:在分布式文件系统场景下,应考虑数据的副本策略、访问模式和性能优化,可能需要调整CSI驱动的配置参数以适应特定的工作负载。

-

对象存储:

- 应用场景:为海量非结构化数据(如图片、视频、日志等)提供经济高效的存储解决方案。

- 集成方法:使用对象存储的CSI驱动,如AWS S3 CSI、Google Cloud Storage CSI等,通常需要通过

StorageClass配置存储桶名称、区域等参数。 - 最佳实践:在对象存储场景下,应注意数据的访问权限和安全策略,可能需要使用IAM角色或访问密钥来控制对存储桶的访问。

-

本地存储:

- 应用场景:利用节点本地存储设备(如SSD、HDD)为容器提供高性能、低延迟的存储,适用于I/O密集型应用。

- 集成方法:使用本地存储的CSI驱动,如OpenEBS、Local PV等,并通过

StatefulSet或PersistentVolume来调度Pod到特定节点。 - 最佳实践:在本地存储场景下,应特别注意数据的持久性和节点故障的影响,可能需要结合数据复制或备份策略来确保数据安全。

3.3.3 数据管理与保护场景

CSI不仅提供了存储访问接口,还支持一系列数据管理和保护功能:

-

存储卷快照与恢复:

- 应用场景:为重要的存储卷创建快照,以便在发生故障或误操作时能够快速恢复数据。

- 集成方法:使用支持快照功能的CSI驱动,如Ceph CSI、Portworx CSI等,并通过Kubernetes的

VolumeSnapshot和VolumeSnapshotClass资源来创建和管理快照。 - 最佳实践:在快照管理场景下,应制定明确的快照策略,包括创建频率、保留周期和恢复流程,并定期测试快照的可用性。

-

存储卷扩展:

- 应用场景:在不中断应用的情况下动态调整存储卷的大小,以适应不断增长的数据需求。

- 集成方法:使用支持卷扩展功能的CSI驱动,并通过更新

PersistentVolumeClaim的resources.requests.storage字段来触发卷扩展操作。 - 最佳实践:在卷扩展场景下,应确保应用能够处理文件系统的动态扩展,可能需要在应用中启用自动调整文件系统大小的功能。

-

存储卷克隆:

- 应用场景:基于现有存储卷创建新的卷,用于测试、开发或数据分发等场景。

- 集成方法:使用支持卷克隆功能的CSI驱动,并通过Kubernetes的

VolumeClone资源来创建克隆卷。 - 最佳实践:在卷克隆场景下,应考虑存储系统的克隆效率和资源使用情况,可能需要根据具体存储系统的特性优化克隆策略。

3.3.4 与其他技术栈的集成

CSI不仅限于Kubernetes环境,还可以与其他技术栈集成:

-

虚拟机与容器混合部署:

- 应用场景:在同一基础设施上同时运行虚拟机和容器,需要统一的存储管理。

- 集成方法:使用支持混合环境的存储系统(如Ceph、GlusterFS等),并通过CSI驱动将存储资源提供给容器,同时通过传统方式提供给虚拟机。

- 最佳实践:在混合部署场景下,应采用统一的存储策略和管理工具,确保虚拟机和容器可以访问相同的存储资源,并保持数据一致性。

-

Serverless计算:

- 应用场景:为Serverless平台(如Knative、OpenFaaS)提供临时或持久化存储支持,通常需要快速的存储配置和释放。

- 集成方法:使用轻量级的CSI驱动,并优化驱动性能以支持快速的存储卷创建和删除。

- 最佳实践:在Serverless场景下,应考虑使用短暂存储或临时卷,避免资源泄漏,并确保存储资源能够随Serverless函数的生命周期自动创建和销毁。

3.4 CSI性能优化与最佳实践

CSI的性能直接影响应用的I/O性能和响应时间,以下是一些CSI性能优化的最佳实践:

-

驱动选择与配置优化:

- 根据应用的存储需求选择合适的CSI驱动,如块存储适用于高性能数据库,文件存储适用于共享文件系统。

- 优化CSI驱动的配置参数,如缓存策略、并发请求数、超时设置等。例如,对于Ceph CSI驱动,可以调整

rbdCacheSize和rbdCacheMaxDirty参数来优化性能。

-

存储架构优化:

- 使用本地存储或直接附加存储(DAS)为I/O密集型应用提供低延迟的存储访问。

- 在分布式存储系统中,合理规划存储节点的布局和数据分布,减少跨节点的数据访问。

- 利用存储系统的高级功能,如预读、缓存、条带化等,提高存储性能。

-

资源管理优化:

- 为CSI驱动分配足够的系统资源,特别是CPU和内存,确保驱动能够高效处理存储请求。

- 在大规模集群中,考虑使用分布式CSI驱动架构,如Ceph CSI的分布式控制器,以提高处理能力。

- 优化

External-Provisioner、External-Attacher等中间件组件的资源配置,确保它们能够及时处理存储请求。

-

监控与调优:

- 部署CSI驱动的监控工具,如Prometheus指标收集和Grafana仪表盘,实时监控存储性能和资源使用情况。

- 根据监控数据调整CSI驱动的配置和存储策略,优化存储性能和资源利用率。例如,在发现存储瓶颈时,可以增加存储卷的IOPS或调整存储节点的资源分配。

-

安全优化:

- 使用Kubernetes的

Secret资源安全地存储和传递CSI驱动所需的凭证和密钥。 - 实施RBAC策略,限制CSI驱动的权限范围,确保其只能访问必要的存储资源。

- 定期更新CSI驱动和相关组件,修复安全漏洞,提高系统安全性。

- 使用Kubernetes的

通过以上优化措施,可以显著提高CSI的性能和可靠性,满足各种复杂应用场景的存储需求。

四、CRI(Container Runtime Interface)详解

4.1 CRI设计原理与架构

CRI(容器运行时接口)是Kubernetes定义的一个接口规范,它允许Kubernetes与不同的容器运行时实现(如Docker、containerd、CRI-O等)进行交互。CRI的设计目标是解耦Kubernetes核心代码与容器运行时的具体实现,使得Kubernetes可以支持多种容器运行时,而无需修改核心代码。

CRI的核心设计理念包括:

-

解耦容器运行时与编排系统:CRI将容器运行时的实现细节与Kubernetes核心分离,使得不同的容器运行时可以独立发展,同时保持与Kubernetes的兼容性。

-

标准化接口:CRI定义了一套标准化的gRPC接口,包括容器管理和镜像管理两部分,使得不同的容器运行时可以实现相同的接口。

-

可扩展性:CRI设计了可扩展的接口,允许容器运行时实现额外的功能,如安全增强、性能优化等。

-

与OCI标准兼容:CRI与开放容器倡议(OCI)标准兼容,支持基于OCI运行时规范(如runc、crun)的容器运行时。

在架构上,CRI主要由以下几个部分组成:

-

CRI接口:定义了容器运行时需要实现的gRPC服务接口,包括

RuntimeService和ImageService两个主要服务。 -

Kubelet:Kubernetes的节点代理,负责与CRI兼容的容器运行时进行通信,管理节点上的容器生命周期。

-

容器运行时实现:实现CRI接口的具体容器运行时,如containerd、CRI-O、frakti等。这些运行时通常通过shim层(如containerd-shim、cri-o-shim)来适配CRI接口。

-

OCI运行时:实际执行容器的运行时实现,如runc、crun等,符合OCI运行时规范。

CRI的工作流程大致如下:当Kubernetes需要创建一个容器时,kubelet通过gRPC调用容器运行时的CRI接口,请求创建容器。容器运行时接收到请求后,首先拉取所需的镜像(通过ImageService),然后创建容器(通过RuntimeService),并将容器状态返回给kubelet。容器运行过程中,kubelet可以通过CRI接口查询容器状态、日志等信息。当容器不再需要时,kubelet调用CRI接口删除容器。

4.2 CRI实现机制与关键组件

CRI的实现机制基于gRPC远程过程调用,通过标准化的接口让不同的容器运行时可以与Kubernetes集成。理解CRI的实现机制对于选择和配置容器运行时至关重要。

4.2.1 CRI接口定义

CRI定义了两个主要的gRPC服务接口:

-

RuntimeService:提供容器管理功能,包括容器的创建、启动、停止、删除等操作,以及容器状态查询、日志获取、执行命令等功能。主要方法包括:

RunPodSandbox:创建并启动Pod沙箱(Pod的网络和命名空间环境)StopPodSandbox:停止Pod沙箱RemovePodSandbox:删除Pod沙箱CreateContainer:创建容器StartContainer:启动容器StopContainer:停止容器RemoveContainer:删除容器ListContainers:列出容器ContainerStatus:获取容器状态Exec:在容器中执行命令Attach:附加到运行中的容器PortForward:端口转发ContainerStats:获取容器资源使用统计信息ListContainerStats:获取多个容器的资源使用统计信息

-

ImageService:提供镜像管理功能,包括镜像的拉取、删除、查询等操作。主要方法包括:

ListImages:列出镜像GetImage:获取镜像信息PullImage:拉取镜像RemoveImage:删除镜像ImageStatus:获取镜像状态

此外,CRI还定义了一些扩展接口,如Status用于获取CRI实现的状态信息,UpdateRuntimeConfig用于动态更新运行时配置等。

4.2.2 CRI运行时实现

目前,主流的CRI兼容容器运行时包括:

-

containerd:

- 设计特点:由Docker公司开发的轻量级容器运行时,提供了高性能和稳定性。containerd通过

containerd-shim实现CRI接口,支持多种底层运行时(如runc、kata-containers)。 - 架构:containerd采用分层架构,包括gRPC服务、内容地址存储、执行驱动和监控系统等组件。

- 优缺点:优点是性能高、资源占用少、社区支持广泛;缺点是配置相对复杂,学习曲线较陡。

- 设计特点:由Docker公司开发的轻量级容器运行时,提供了高性能和稳定性。containerd通过

-

CRI-O:

- 设计特点:专为Kubernetes设计的CRI实现,专注于与Kubernetes的兼容性和性能优化。CRI-O直接实现CRI接口,并使用

runc作为默认的OCI运行时。 - 架构:CRI-O由

crio服务、crio-shim和conmon三个主要组件组成,分别负责处理gRPC请求、管理容器生命周期和监控容器状态。 - 优缺点:优点是与Kubernetes高度集成、资源占用少、启动速度快;缺点是功能相对有限,社区规模较小。

- 设计特点:专为Kubernetes设计的CRI实现,专注于与Kubernetes的兼容性和性能优化。CRI-O直接实现CRI接口,并使用

-

frakti:

- 设计特点:微软开发的CRI实现,支持使用虚拟机作为容器隔离机制,提供更高的安全性和隔离性。

- 架构:frakti由

frakti-shim和frakti-vm两个主要组件组成,前者负责实现CRI接口,后者负责管理虚拟机。 - 优缺点:优点是提供更强的隔离性和安全性;缺点是性能开销较大,资源利用率较低。

-

kata-containers:

- 设计特点:开源的轻量级虚拟机解决方案,可以作为CRI实现提供容器级别的隔离。Kata Containers结合了虚拟机的安全性和容器的便捷性。

- 架构:Kata Containers由

kata-shim、kata-proxy和qemu等组件组成,通过虚拟化技术实现容器隔离。 - 优缺点:优点是提供强隔离性和安全性;缺点是性能开销较大,启动时间较长。

在选择CRI实现时,应考虑以下因素:

-

兼容性:CRI实现应与Kubernetes版本保持兼容,特别是在升级集群时,需要确保CRI版本与Kubernetes版本兼容。

-

性能:不同的CRI实现在容器启动时间、资源占用、I/O性能等方面可能存在差异,应根据应用需求选择合适的实现。

-

功能支持:不同的CRI实现可能支持不同的功能,如安全增强、资源限制、监控指标等,应根据需求选择支持相应功能的实现。

-

生态系统:考虑CRI实现的社区活跃度、文档完善度和支持资源,选择更成熟的解决方案。

4.2.3 Kubelet与CRI的集成

Kubelet是Kubernetes中负责节点管理的组件,也是CRI的主要客户端。Kubelet通过gRPC与CRI实现进行通信,管理容器的生命周期。

Kubelet与CRI的集成主要涉及以下几个方面:

-

配置管理:

- Kubelet通过

--container-runtime和--container-runtime-endpoint参数指定使用的CRI实现和连接端点。例如,对于containerd,通常使用unix:///run/containerd/containerd.sock作为端点。 - Kubelet还可以通过

--runtime-request-timeout参数设置CRI请求的超时时间,确保容器操作不会无限期阻塞。

- Kubelet通过

-

镜像管理:

- Kubelet通过CRI的

ImageService接口拉取、查询和删除镜像。镜像的拉取策略(如IfNotPresent、Always、Never)由Pod的imagePullPolicy字段控制。 - 为了提高镜像拉取性能,可以配置镜像缓存和加速服务,如Docker Registry Mirror、Harbor等。

- Kubelet通过CRI的

-

容器管理:

- Kubelet通过CRI的

RuntimeService接口创建、启动和停止容器。容器的资源限制(如CPU、内存)通过ResourceRequirements字段传递给CRI实现。 - Kubelet还负责监控容器的状态,并在容器失败时根据

restartPolicy决定是否重启容器。

- Kubelet通过CRI的

-

健康检查:

- Kubelet通过CRI的

Status接口定期检查容器运行时的健康状态,确保其正常工作。 - 如果发现容器运行时异常,Kubelet会尝试重新连接或重启容器运行时,以恢复正常功能。

- Kubelet通过CRI的

在Kubernetes 1.20及以后版本中,Kubelet默认使用CRI接口与容器运行时通信,不再直接与Docker API交互。这一变化使得Kubernetes的容器运行时选择更加灵活,同时也提高了系统的安全性和稳定性。

4.3 CRI在不同场景下的应用与集成

CRI的灵活性和可扩展性使其能够适应各种复杂的容器运行时场景。以下将详细分析CRI在不同场景下的应用与集成方法。

4.3.1 云原生计算场景

在云原生环境中,CRI是连接Kubernetes与容器运行时的桥梁,以下是几种典型的云原生计算场景:

-

标准容器部署:

- 应用场景:为普通容器化应用提供运行时环境,支持应用的创建、运行和管理。

- 集成方法:通过配置Kubelet的

--container-runtime和--container-runtime-endpoint参数,指定使用的CRI实现。例如,使用containerd作为CRI实现时,需要将参数设置为--container-runtime=remote --container-runtime-endpoint=unix:///run/containerd/containerd.sock。 - 最佳实践:在标准容器部署场景下,推荐使用轻量级的CRI实现(如containerd或CRI-O),并优化容器运行时的配置,以提高性能和资源利用率。

-

高性能计算:

- 应用场景:为计算密集型应用(如科学计算、机器学习、AI训练等)提供高效的容器运行时环境。

- 集成方法:使用支持高性能计算的CRI实现,并配置适当的资源限制和优先级。例如,可以使用containerd并结合NVIDIA Container Runtime来支持GPU加速。

- 最佳实践:在高性能计算场景下,应特别注意资源隔离和性能优化,可能需要调整CRI实现的配置参数(如CPU亲和性、内存分配策略等)以满足应用需求。

-

安全容器:

- 应用场景:为敏感数据和关键应用提供更强的隔离和安全性,防止容器逃逸和资源滥用。

- 集成方法:使用支持安全容器的CRI实现,如kata-containers或gVisor,并配置适当的安全策略。例如,可以使用CRI-O并结合kata-containers作为底层运行时。

- 最佳实践:在安全容器场景下,应采用多层安全防护策略,包括强隔离的运行时、最小权限原则、安全审计等,并定期进行安全评估和测试。

4.3.2 边缘计算与物联网场景

在边缘计算和物联网场景中,资源通常受限且网络条件复杂,CRI提供了灵活的解决方案:

-

边缘节点计算:

- 应用场景:为边缘节点上的容器提供轻量级、低资源消耗的运行时环境,支持边缘计算应用。

- 集成方法:使用轻量级的CRI实现(如CRI-O),并优化其资源使用和启动时间。例如,可以使用CRI-O并配置

--conmon-pid-file参数以减少资源占用。 - 最佳实践:在边缘节点上,应关注CRI实现的内存和CPU使用情况,选择资源效率高的实现,并考虑使用资源限制和优先级来管理多个容器的资源分配。

-

物联网设备管理:

- 应用场景:为物联网设备上的小型容器提供运行时支持,通常需要低资源消耗和快速启动能力。

- 集成方法:使用极简的CRI实现(如crun或runc),并配置适当的安全策略和资源限制。

- 最佳实践:在物联网场景下,应特别关注安全性和资源效率,可能需要使用轻量级的容器格式(如OCI Image Format)和精简的基础镜像,以减少存储和内存占用。

4.3.3 混合环境与异构计算场景

在混合环境和异构计算场景中,CRI的灵活性和可扩展性尤为重要:

-

虚拟机与容器混合部署:

- 应用场景:在同一基础设施上同时运行虚拟机和容器,需要统一的资源管理和调度。

- 集成方法:使用支持混合环境的CRI实现,如kata-containers或frakti,这些实现可以在虚拟机中运行容器,提供更强的隔离性。

- 最佳实践:在混合部署场景下,应采用统一的资源管理策略,并考虑虚拟机和容器之间的资源分配和优先级。

-

异构计算资源:

- 应用场景:为包含多种计算资源(如CPU、GPU、FPGA、TPU等)的集群提供统一的运行时支持。

- 集成方法:使用支持异构计算的CRI实现,并配置相应的设备插件和资源管理器。例如,可以使用containerd并结合NVIDIA Container Runtime来支持GPU加速,或使用Intel的FPGA插件来支持FPGA设备。

- 最佳实践:在异构计算场景下,应明确每种资源的使用方式和限制,并通过Kubernetes的资源模型(如

alpha.kubernetes.io/nvidia-gpu)进行资源分配和调度。

4.4 CRI性能优化与最佳实践

CRI的性能直接影响容器的启动速度和资源利用率,以下是一些CRI性能优化的最佳实践:

-

运行时选择与配置优化:

- 根据应用需求选择合适的CRI实现,如高性能场景选择containerd,轻量级场景选择CRI-O,安全场景选择kata-containers。

- 优化CRI实现的配置参数,如containerd的

--metrics-interval、--shim-cgroup等参数,可以提高性能和资源利用率。

-

镜像管理优化:

- 使用高效的镜像格式和压缩算法,减少镜像的大小和传输时间。例如,使用

docker save和gzip压缩镜像,或使用nerdctl等工具进行镜像转换。 - 配置镜像缓存和加速服务,如Docker Registry Mirror、Harbor等,减少重复拉取相同镜像的时间和带宽消耗。

- 采用分层构建和多阶段构建技术,减少镜像层数和冗余内容,提高镜像拉取和启动速度。

- 使用高效的镜像格式和压缩算法,减少镜像的大小和传输时间。例如,使用

-

容器管理优化:

- 优化容器的资源分配,避免过度分配或资源争用。例如,根据应用的实际需求设置合理的CPU和内存限制,避免资源浪费。

- 使用CPU亲和性和内存绑定等技术,提高容器的性能和稳定性。例如,可以通过

nodeSelector和affinity将容器调度到特定节点,并通过cpuSet和memorySwappiness等参数优化资源使用。 - 采用适当的容器启动和停止策略,如预启动容器或延迟停止容器,减少容器启动时间和资源回收开销。

-

监控与调优:

- 部署CRI实现的监控工具,如Prometheus指标收集和Grafana仪表盘,实时监控容器运行时的性能和资源使用情况。

- 根据监控数据调整CRI实现的配置和容器资源分配,优化容器性能和资源利用率。例如,在发现容器启动缓慢时,可以调整CRI请求的超时时间或增加CRI服务的资源配额。

-

安全优化:

- 使用安全的CRI实现和配置,如kata-containers或gVisor,提高容器的隔离性和安全性。

- 实施严格的镜像安全策略,如验证镜像签名、使用可信的镜像仓库、扫描镜像漏洞等。

- 限制容器的特权和资源访问,遵循最小权限原则,减少潜在的安全风险。

通过以上优化措施,可以显著提高CRI的性能和可靠性,满足各种复杂应用场景的容器运行时需求。

五、CNI、CSI和CRI的协同工作与集成

5.1 三I架构的协同工作机制

CNI、CSI和CRI作为Kubernetes的三大接口规范,它们之间存在密切的协同工作关系,共同构成了Kubernetes的基础设施抽象层。理解它们的协同工作机制对于设计和管理复杂的云原生应用至关重要。

5.1.1 容器生命周期中的三I协同

在容器的完整生命周期中,CNI、CSI和CRI各自负责不同的阶段,它们的协同工作流程如下:

-

Pod创建阶段:

- CRI:Kubelet通过CRI接口创建Pod沙箱,包括初始化网络命名空间和其他必要的命名空间。

- CNI:Kubelet调用CNI插件为Pod沙箱配置网络,包括创建网络接口、分配IP地址、设置路由等。

- CSI:如果Pod需要持久化存储,Kubelet通过CSI接口创建和挂载存储卷,确保存储卷在容器启动前可用。

-

容器启动阶段:

- CRI:Kubelet通过CRI接口创建和启动容器,包括拉取镜像、设置环境变量、配置资源限制等。

- CNI:如果容器需要额外的网络配置(如多网络接口),CNI插件会在此时为容器添加网络接口。

- CSI:如果容器需要访问存储卷,CSI驱动会在此时将存储卷从节点挂载到容器中。

-

容器运行阶段:

- CRI:负责监控容器的运行状态,收集资源使用统计信息,并处理容器的重启和健康检查。

- CNI:负责维护容器的网络连接,处理网络事件(如IP地址变化、网络策略更新等)。

- CSI:负责处理容器对存储卷的I/O请求,确保数据的一致性和可靠性。

-

容器终止阶段:

- CRI:Kubelet通过CRI接口停止和删除容器,释放容器占用的资源。

- CNI:CNI插件在容器终止时删除其网络接口,释放IP地址和其他网络资源。

- CSI:如果存储卷不再需要,CSI驱动会卸载并删除存储卷,释放存储资源。

这种协同工作机制确保了容器的网络、存储和运行时环境能够无缝集成,为应用提供一致的运行环境。

5.1.2 资源管理与调度的协同

在资源管理和调度方面,CNI、CSI和CRI也需要协同工作,确保资源的高效分配和利用:

-

资源发现与分配:

- CNI:负责发现和分配网络资源,如IP地址、网络接口、端口等。CNI插件通常会根据节点的网络配置和可用资源,为容器分配适当的网络资源。

- CSI:负责发现和分配存储资源,如存储卷、文件系统、块设备等。CSI驱动通常会根据存储系统的容量和性能,为容器分配适当的存储资源。

- CRI:负责发现和分配计算资源,如CPU、内存、GPU等。CRI实现通常会根据节点的资源状况和容器的资源请求,为容器分配适当的计算资源。

-

资源限制与隔离:

- CNI:通过网络策略和流量控制机制,实现容器之间的网络隔离和带宽限制。例如,Calico和Cilium等CNI插件支持基于策略的网络隔离和QoS控制。

- CSI:通过存储卷的配额和权限管理,实现容器之间的存储隔离和访问控制。例如,Ceph CSI和NFS CSI等驱动支持基于用户和组的访问控制。

- CRI:通过cgroups和命名空间等Linux内核功能,实现容器之间的计算资源隔离和限制。例如,containerd和CRI-O等实现支持CPU份额、内存限制、块I/O限制等资源控制。

-

资源监控与优化:

- CNI:通过网络监控工具(如Cilium的Hubble)收集网络性能数据,为资源优化提供依据。

- CSI:通过存储监控工具(如Prometheus指标)收集存储性能数据,为存储资源优化提供依据。

- CRI:通过资源使用统计接口(如

ContainerStats)收集容器的资源使用情况,为计算资源优化提供依据。

这种资源管理的协同机制确保了Kubernetes集群的资源能够被高效、安全地分配和使用,满足不同应用的资源需求。

5.2 三I与Kubernetes核心组件的集成

CNI、CSI和CRI作为Kubernetes的三大接口规范,它们与Kubernetes核心组件的集成方式直接影响整个集群的功能和性能。以下将详细分析它们的集成机制和最佳实践。

5.2.1 与Kubelet的集成

Kubelet是Kubernetes节点上的核心组件,负责管理容器的生命周期,它与CNI、CSI和CRI的集成方式如下:

-

与CRI的集成:

- Kubelet通过gRPC接口与CRI实现进行通信,管理容器的创建、启动、停止和删除等操作。

- Kubelet通过

--container-runtime和--container-runtime-endpoint参数配置CRI实现的类型和连接端点。 - Kubelet通过

--runtime-cgroups参数指定CRI实现使用的cgroup,确保容器的资源限制得到正确应用。

-

与CNI的集成:

- Kubelet通过

--network-plugin参数指定使用的CNI插件,如cni、kubenet等。 - Kubelet通过

--cni-conf-dir和--cni-bin-dir参数指定CNI配置文件目录和插件二进制文件目录。 - Kubelet在创建Pod时,首先调用CNI插件为Pod配置网络,确保网络在容器启动前就绪。

- Kubelet通过

-

与CSI的集成:

- Kubelet通过

--allow-privileged参数允许特权容器访问CSI驱动,确保存储卷可以正确挂载。 - Kubelet在创建容器时,会检查Pod所需的存储卷是否已经通过CSI驱动挂载到节点,并将存储卷从节点挂载到容器中。

- Kubelet通过

--volume-plugin-dir参数指定CSI插件的目录,确保CSI驱动可以被正确加载。

- Kubelet通过

这种集成方式使得Kubelet能够统一管理容器的计算、网络和存储资源,为应用提供一致的运行环境。

5.2.2 与控制平面组件的集成

Kubernetes控制平面组件(如API Server、Scheduler、Controller Manager)与CNI、CSI和CRI的集成方式如下:

-

与API Server的集成:

- API Server通过

PersistentVolume、PersistentVolumeClaim、StorageClass等API资源管理存储卷,这些资源通过CSI接口与存储系统集成。 - API Server通过

Pod、Service、Endpoint等API资源管理网络配置,这些资源通过CNI接口与网络系统集成。 - API Server通过

Node、Pod等API资源获取节点和容器的状态信息,这些信息通过CRI接口从容器运行时获取。

- API Server通过

-

与Scheduler的集成:

- Scheduler在调度Pod时,会考虑节点的资源可用性(如CPU、内存、存储、网络),确保Pod被调度到资源充足的节点。

- Scheduler通过

NodeSelector、Tolerations、Affinity等调度策略与CSI和CNI集成,实现基于存储和网络条件的调度。例如,可以使用node.kubernetes.io/instance-type标签将需要高性能存储的Pod调度到特定节点。

-

与Controller Manager的集成:

- Controller Manager通过

ReplicationController、Deployment、StatefulSet等控制器管理容器的复制和扩缩容,这些控制器通过CRI接口与容器运行时交互。 - Controller Manager通过

VolumeController管理存储卷的生命周期,包括创建、删除、挂载和卸载,这些操作通过CSI接口与存储系统交互。 - Controller Manager通过

NetworkPolicyController管理网络策略,这些策略通过CNI接口应用到网络系统。

- Controller Manager通过

这种与控制平面组件的集成方式确保了Kubernetes能够统一管理集群的计算、网络和存储资源,实现复杂的编排和管理功能。

5.3 三I集成的最佳实践与案例分析

CNI、CSI和CRI的集成需要遵循一定的最佳实践,以确保系统的稳定性、性能和安全性。以下将结合实际案例分析这些最佳实践。

5.3.1 集成架构设计最佳实践

-

模块化设计:

- 将CNI、CSI和CRI的实现与Kubernetes核心组件解耦,采用松耦合的模块化设计,提高系统的可维护性和可扩展性。

- 使用标准接口和协议(如gRPC、JSON)进行组件间通信,避免硬编码依赖。例如,CSI驱动应通过标准的gRPC接口与Kubernetes集成,而不是直接调用Kubernetes API。

-

分层架构:

- 采用分层架构,将网络、存储和计算资源的管理分离,每层专注于特定的功能。例如,CNI负责网络配置,CSI负责存储管理,CRI负责容器运行时管理。

- 在每层中使用中间件组件(如

External-Provisioner、External-Attacher等)实现与上层API的转换,确保层间解耦。

-

标准化与兼容性:

- 严格遵循CNI、CSI和CRI的接口规范,确保实现的标准化和兼容性。例如,CNI插件应实现

ADD和DEL两个基本操作,并遵循标准的配置格式。 - 明确声明支持的接口版本,并与Kubernetes版本保持兼容。例如,CSI驱动应声明支持的CSI版本,并与Kubernetes版本兼容。

- 严格遵循CNI、CSI和CRI的接口规范,确保实现的标准化和兼容性。例如,CNI插件应实现

5.3.2 资源管理最佳实践

-

资源隔离与限制:

- 使用CNI的网络策略和流量控制功能实现容器间的网络隔离和带宽限制。例如,使用Calico的网络策略限制容器之间的访问,或使用Cilium的QoS功能控制容器的网络带宽。

- 使用CSI的存储配额和权限管理功能实现容器间的存储隔离和访问控制。例如,使用Ceph CSI的访问控制列表(ACL)限制容器对存储卷的访问权限。

- 使用CRI的资源限制功能实现容器间的计算资源隔离。例如,使用containerd的cgroups配置限制容器的CPU和内存使用。

-

资源优化与高效利用:

- 合理规划IP地址空间和存储资源,避免资源浪费和冲突。例如,在云环境中,使用云提供商的IPAM功能(如AWS的ENI)高效管理IP地址。

- 利用存储系统的高级功能,如快照、克隆、卷扩展等,提高存储资源的利用率和灵活性。例如,使用Ceph CSI的快照功能创建存储卷的时间点副本,用于备份或测试。

- 优化容器的资源请求和限制,确保资源分配与应用需求匹配。例如,根据应用的负载特性设置合理的CPU份额和内存限制,避免资源过度分配或不足。

5.3.3 案例分析:高性能数据库集群的三I集成

以下是一个高性能数据库集群的三I集成案例分析,展示如何在实际场景中应用CNI、CSI和CRI:

场景描述:部署一个大规模的分布式数据库集群(如Cassandra、MongoDB等),要求高吞吐量、低延迟和高可用性。

集成方案:

-

CRI选择与配置:

- 使用containerd作为容器运行时,通过

containerd-shim实现CRI接口,确保高性能和稳定性。 - 配置containerd使用

runc作为底层运行时,并启用CPU和内存的资源限制,确保数据库容器获得适当的资源。 - 优化containerd的镜像缓存和拉取策略,确保数据库镜像能够快速部署。

- 使用containerd作为容器运行时,通过

-

CNI选择与配置:

- 使用Calico作为CNI插件,实现高效的网络性能和灵活的网络策略。Calico的BGP模式提供了直接的IP路由,避免了网络封装的开销。

- 配置Calico的IPAM功能,为每个数据库节点分配足够的IP地址,支持数据库集群的扩展。

- 实施网络策略,限制数据库节点之间的访问,提高安全性。例如,只允许特定端口的通信,并限制跨节点的访问。

-

CSI选择与配置:

- 使用Ceph CSI作为存储驱动,提供分布式、高可靠的存储支持。Ceph的RADOS块设备(RBD)提供了高性能的块存储,适合数据库应用。

- 配置Ceph CSI的

rbdCacheSize和rbdCacheMaxDirty参数,优化数据库的I/O性能。例如,增加缓存大小以减少磁盘I/O操作。 - 使用Ceph的复制和纠删码功能,确保数据的高可用性和耐久性。例如,配置三副本策略,确保数据在节点故障时仍然可用。

-

协同工作优化:

- 优化数据库容器的启动顺序,确保存储卷在容器启动前已正确挂载,网络配置已完成。

- 配置数据库节点的网络亲和性和反亲和性,确保节点分布在不同的物理机上,提高可用性。例如,使用

nodeAffinity和podAntiAffinity将数据库节点分散到不同的机架或可用区。 - 实施监控和告警策略,实时监控数据库集群的性能和健康状态。例如,使用Prometheus收集CNI、CSI和CRI的指标,使用Grafana创建仪表盘进行可视化监控。

实施效果:

- 数据库集群的吞吐量提高了30%,延迟降低了25%。

- 集群的扩展和收缩操作更加高效,资源利用率提高了20%。

- 故障恢复时间缩短了50%,提高了系统的可用性和可靠性。

- 资源隔离和访问控制增强了系统的安全性,符合企业级安全标准。

这个案例展示了如何通过合理选择和配置CNI、CSI和CRI,以及优化它们的协同工作,为高性能数据库应用提供高效、可靠的基础设施支持。

六、总结与展望

6.1 CNI、CSI和CRI的技术价值与意义

CNI、CSI和CRI作为Kubernetes生态系统中的三大接口规范,具有重要的技术价值和意义:

-

解耦与标准化:

- 通过定义标准接口,CNI、CSI和CRI将网络、存储和容器运行时的实现与Kubernetes核心代码解耦,使得这些组件可以独立发展和演进,而无需修改Kubernetes核心代码。这种解耦设计大大提高了系统的可维护性和可扩展性。

- 标准化接口使得不同的实现可以互换使用,用户可以根据自己的需求选择最适合的解决方案。例如,用户可以选择Calico、Flannel或Cilium作为CNI插件,而无需改变Kubernetes的使用方式。

-

生态系统繁荣:

- CNI、CSI和CRI的出现促进了云原生生态系统的多样性和繁荣。标准化接口降低了开发门槛,使得更多的厂商和社区可以参与到生态系统的建设中。例如,CSI的出现使得几乎所有主流存储厂商都提供了对应的CSI驱动,大大丰富了Kubernetes的存储选项。

- 接口规范的开源性质促进了社区协作和创新,推动了技术的快速发展。例如,CNI、CSI和CRI的规范都是通过开源社区开发和维护的,任何人都可以参与规范的制定和改进。

-

提升用户体验:

- 标准化接口使得用户可以更轻松地在不同环境和平台之间迁移应用,提高了应用的可移植性。例如,使用CSI驱动的应用可以在不同的云提供商和本地环境之间无缝迁移,而无需修改应用代码或配置。

- 丰富的插件生态系统为用户提供了更多选择,满足了不同场景下的需求。例如,用户可以根据应用的性能需求、安全要求和成本预算选择最适合的CNI、CSI和CRI实现。

-

促进技术创新:

- 接口规范的开放性和灵活性鼓励了技术创新,推动了云原生技术的发展。例如,Cilium利用eBPF技术实现了高性能的网络和安全功能,为CNI带来了新的可能性。

- 接口规范的演进也促进了相关技术的创新和发展。例如,CSI的扩展接口允许存储提供商实现高级功能,如快照、克隆、卷扩展等,为存储管理带来了更多灵活性。

6.2 未来发展趋势与挑战

随着云原生技术的不断发展,CNI、CSI和CRI也面临着新的机遇和挑战:

-

技术演进趋势:

- 性能优化:未来的CNI、CSI和CRI实现将更加注重性能优化,特别是在大规模集群和高性能计算场景中。例如,Cilium的eBPF技术和Calico的BGP模式已经在网络性能方面取得了显著突破,未来将继续优化。

- 功能增强:接口规范将不断扩展,以支持更多高级功能。例如,CSI正在扩展对更多存储功能(如数据压缩、加密、分层存储等)的支持,CNI正在增强对服务网格和零信任网络的集成。

- 简化集成:未来的集成方式将更加简化,降低用户的使用门槛。例如,Istio的Ambient模式通过CNI集成实现了无sidecar的服务网格,简化了部署和管理。

-

面临的挑战:

- 标准化与多样性的平衡:如何在保持接口标准化的同时,满足不同场景和需求的多样性,是一个长期挑战。例如,不同云提供商和存储厂商可能有不同的需求和实现方式,需要在标准化和定制化之间找到平衡。

- 性能与功能的权衡:在增加功能的同时,如何保持高性能和低延迟,是一个需要解决的问题。例如,复杂的网络策略和安全功能可能会影响网络性能,需要进行精心设计和优化。

- 版本兼容性与演进:随着接口规范的演进,如何保持向后兼容性,确保旧版本实现能够与新版本Kubernetes兼容,是一个重要挑战。例如,CSI驱动需要明确声明支持的版本,并与Kubernetes版本保持兼容。

-

未来发展方向:

- 边缘计算与物联网:CNI、CSI和CRI将在边缘计算和物联网场景中发挥越来越重要的作用,需要支持资源受限、网络不稳定的边缘环境。例如,轻量化的CNI插件和CSI驱动将成为边缘计算的关键技术。

- 异构计算与专用硬件:随着GPU、FPGA、TPU等专用硬件的广泛应用,CNI、CSI和CRI需要更好地支持异构计算环境,提供统一的资源管理和调度接口。例如,支持GPU的CRI实现和专用存储的CSI驱动将成为研究热点。

- 安全与隐私保护:随着云原生应用的普及,安全和隐私保护将成为关键关注点。CNI、CSI和CRI需要增强安全功能,如更严格的访问控制、数据加密、安全审计等。例如,支持硬件隔离的CRI实现和加密存储的CSI驱动将受到更多关注。

6.3 对云原生技术生态的影响与展望

CNI、CSI和CRI作为云原生技术生态的重要组成部分,将继续对云原生技术的发展产生深远影响:

-

推动云原生技术标准化:

- CNI、CSI和CRI的成功经验将推动更多云原生技术的标准化,促进整个生态系统的健康发展。例如,服务网格、无服务器计算等领域可能会借鉴CNI、CSI和CRI的设计理念,制定标准化接口。

- 标准化接口将降低不同组件之间的集成成本,促进技术的快速迭代和创新。例如,标准化的服务网格接口将使得不同的服务网格实现可以互换使用,提高用户的选择自由度。

-

促进多云和混合云环境的发展:

- CNI、CSI和CRI的标准化接口将促进多云和混合云环境的发展,使得应用可以在不同云提供商和本地环境之间无缝迁移。例如,使用标准化的CSI接口,应用可以在AWS、Azure、Google Cloud等不同云平台之间迁移,而无需修改存储相关的代码。

- 标准化接口也将促进云提供商之间的竞争和创新,推动整个云计算市场的发展。例如,云提供商将通过提供更高效、更安全的CNI、CSI和CRI实现来吸引用户。

-

加速企业级应用的云原生转型:

- CNI、CSI和CRI的成熟和完善将加速企业级应用的云原生转型,使得传统企业应用能够更好地适应云原生环境。例如,通过CSI接口,传统企业的存储系统可以与Kubernetes集成,支持企业级应用的容器化部署。

- 丰富的插件生态系统将为企业提供更多选择,满足不同行业和场景的需求。例如,金融行业可以选择支持高可用性和合规性的存储CSI驱动,制造业可以选择支持工业物联网的CNI插件。

-

未来展望:

- 随着5G、边缘计算、人工智能等新兴技术的发展,CNI、CSI和CRI将面临新的机遇和挑战。例如,5G网络的低延迟和高带宽特性将为边缘计算提供支持,需要CNI、CSI和CRI提供相应的接口和功能。

- 未来的CNI、CSI和CRI将更加智能和自动化,能够自动适应不同的环境和需求。例如,智能的CNI插件可以根据应用的网络需求自动调整配置,智能的CSI驱动可以根据存储使用情况自动扩展或收缩存储资源。

- 随着硬件技术的进步,CNI、CSI和CRI的实现也将不断优化,提供更高的性能和更低的资源消耗。例如,利用专用硬件加速网络处理的CNI插件,或利用非易失性内存(NVM)技术的CSI驱动,将为应用提供更高效的支持。

总之,CNI、CSI和CRI作为Kubernetes生态系统的三大接口规范,不仅为云原生应用提供了标准化的基础设施抽象,也为整个云原生技术生态的发展奠定了坚实基础。随着技术的不断进步和应用场景的不断扩展,它们将继续发挥重要作用,推动云原生技术的创新和发展。

正在思考…

内容由 AI 生成

更多推荐

已为社区贡献47条内容

已为社区贡献47条内容

所有评论(0)