【AI大模型微调】你真的了解大模型怎么“调”?四种主流LLM微调方法详解!零基础小白收藏这一篇就够了!!

如果你是一个开发者,手里有一个强大的语言模型(LLM),想用它来做点厉害的事情,比如文本分类、智能问答,或者识别文本里的关键信息。可问题来了:训练这么一个庞然大物需要海量的计算资源和时间,你手头的电脑可能累到冒烟,甚至还有数据不够多导致模型“学歪”的风险。别慌,今天我们就来聊聊四种LLM微调方法,帮你高效优化模型,轻松应对各种场景。这四种方法分别是:Full-tuning(全量微调)、Freeze

前言

1、大模型只有结合业务才有意义,做出有价值的应用才是王道。

2、对于AI你需要及时更新自己的认知,你不仅要知道What,还要Know-How,还要Do It,帮大模型产品找到合理的价值主张。提供企业级大模型解决方案咨询服务。

如果你是一个开发者,手里有一个强大的语言模型(LLM),想用它来做点厉害的事情,比如文本分类、智能问答,或者识别文本里的关键信息。可问题来了:训练这么一个庞然大物需要海量的计算资源和时间,你手头的电脑可能累到冒烟,甚至还有数据不够多导致模型“学歪”的风险。别慌,今天我们就来聊聊四种LLM微调方法,帮你高效优化模型,轻松应对各种场景。

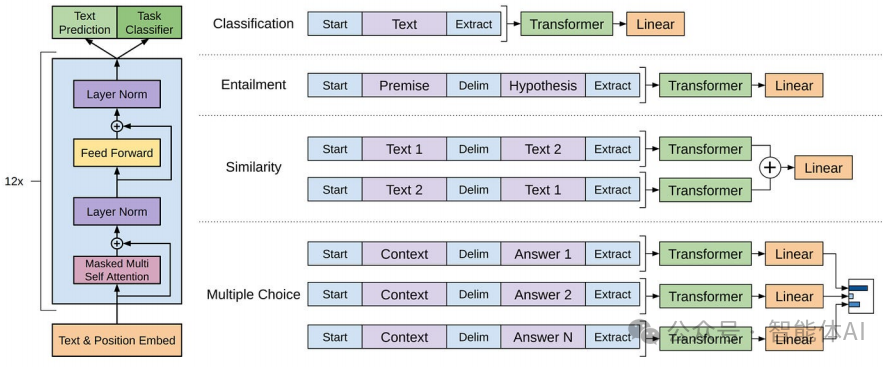

这四种方法分别是:Full-tuning(全量微调)、Freeze-tuning(冻结部分参数微调)、LoRA(低秩适应)和QLoRA(量化低秩适应)。它们各有绝活,能在不同情况下帮你省时省力又保证效果。接下来,我们就用大白话把它们讲明白。

一、Full-tuning(全量微调):给模型做“重塑金身”

Full-tuning是最传统、最彻底的微调方式。简单来说,就是把模型的每个零件(参数)都拿出来调一调,让它完全适应你的任务。就像给模型做一次“重塑金身”,从头到脚都照顾到位。

1、怎么做?

- 先加载一个预训练好的LLM模型,连它所有的参数一起带进来。

- 用你的任务数据(比如分类用的文本),搭配一个目标(比如让误差最小),对模型从头到尾调整一遍。

- 每个参数都会被更新,直到模型能干好你的活儿。

2、优点

- 超级灵活:模型能深度学习你的任务,效果往往很顶。

- 表现力强:特别适合数据多、任务复杂的情况。

3、缺点

- 费力又费钱:参数动辄几亿甚至上千亿,训练起来需要高端显卡和好几天时间。

- 容易学过头:如果数据不够多,模型可能会死记硬背训练数据,碰到新数据就懵。

4、适合场景

数据一大堆、任务特别复杂、而且你有好设备的时候,Full-tuning是你的好帮手。

二、Freeze-tuning(冻结部分参数微调):只调“头部”

Freeze-tuning是个轻量化的选择。它不像Full-tuning那样大动干戈,而是只调整模型的“顶层”(比如最后几层),其他部分保持原样。就像只给模型的“头部”调整,省时省力。

1、怎么做?

- 加载预训练的LLM模型。

- 挑出顶层(比如最后一个模块),让它的参数可以动。

- 底下的参数全部“冻住”,保持预训练时的样子。

- 只用任务数据调这部分解冻的参数。

2、优点

- 效率高:动的地方少,训练快,资源耗得也少。

- 不容易学歪:底层保留了预训练的通用知识,泛化能力强。

3、缺点

- 能力有限:大部分参数不动,模型可能没法完全适应你的任务。

4、适合场景

数据不多、任务简单,或者设备一般的时候,Freeze-tuning能快速搞定。

三、LoRA(低秩适应):给模型穿“智能外套”

LoRA是个更聪明的方法。它不直接改模型的参数,而是在每个关键部位加一组“低秩矩阵”(可以理解为小配件),只调这些配件,原模型一动不动。就像给模型穿上一件“智能外套”,不用大改内部结构就能适应新任务。

1、怎么做?

- 加载预训练的LLM模型。

- 在模型的关键层(比如注意力机制部分)加上一组小矩阵。

- 冻住原模型的所有参数,只调这些新加的小矩阵。

- 任务数据跑起来时,小矩阵和原参数配合,输出结果。

2、优点

- 超高效:调的参数比Full-tuning少几百倍,训练快又省资源。

- 效果好:很多任务上跟Full-tuning差不多,甚至更好。

- 稳得住:保留原模型知识,不容易过拟合。

3、缺点

- 某些特殊任务可能比不上Full-tuning。

- 假设任务能用小矩阵搞定,不一定每次都对。

4、适合场景

大部分NLP任务,比如文本分类、问答等,LoRA都是性价比超高的选择。

四、QLoRA(量化低秩适应):轻量化“智能外套”

QLoRA是LoRA的升级版。它先把模型“压缩”一下(把参数从高精度数字变成低精度整数),再用LoRA的方法加小矩阵调整。就像给LoRA的“智能外套”减了肥,更轻便省资源。

1、怎么做?

- 先把预训练模型压缩,参数变小体积。

- 在压缩后的模型上加低秩矩阵,像LoRA那样调。

- 只动这些小矩阵,原模型参数不动。

- 用的时候,压缩模型和小矩阵一起工作,输出结果。

2、优点

- 体积小:模型缩水好几倍,存起来部署起来都方便。

- 跑得快:用整数运算,推理速度飞起。

- 效率高:跟LoRA一样,调的参数少。

3、缺点

- 压缩可能会丢点性能,任务复杂时得小心。

- 操作稍微复杂点,需要懂点量化技巧。

4、适合场景

资源特别紧张的地方,比如手机、边缘设备,QLoRA能大显身手。

五、总结:怎么选最适合你的方法?

这四种方法就像工具箱里的不同家伙事儿,各有各的用处:

- Full-tuning:数据多、任务难、设备好,追求极致效果就选它。

- Freeze-tuning:数据少、任务简单、资源有限,快速上手的好选择。

- LoRA:大多数情况下的“万能钥匙”,效率和效果兼得。

- QLoRA:资源紧巴巴时,比如移动设备上跑模型,选它准没错。

希望这篇文章能帮你搞清楚LLM微调的门道,找到最适合自己的方法,让模型在你的项目里发挥最大威力!

最后

为什么要学AI大模型

当下,⼈⼯智能市场迎来了爆发期,并逐渐进⼊以⼈⼯通⽤智能(AGI)为主导的新时代。企业纷纷官宣“ AI+ ”战略,为新兴技术⼈才创造丰富的就业机会,⼈才缺⼝将达 400 万!

DeepSeek问世以来,生成式AI和大模型技术爆发式增长,让很多岗位重新成了炙手可热的新星,岗位薪资远超很多后端岗位,在程序员中稳居前列。

与此同时AI与各行各业深度融合,飞速发展,成为炙手可热的新风口,企业非常需要了解AI、懂AI、会用AI的员工,纷纷开出高薪招聘AI大模型相关岗位。

最近很多程序员朋友都已经学习或者准备学习 AI 大模型,后台也经常会有小伙伴咨询学习路线和学习资料,我特别拜托北京清华大学学士和美国加州理工学院博士学位的鲁为民老师给大家这里给大家准备了一份涵盖了AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频 全系列的学习资料,这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

AI大模型系统学习路线

在面对AI大模型开发领域的复杂与深入,精准学习显得尤为重要。一份系统的技术路线图,不仅能够帮助开发者清晰地了解从入门到精通所需掌握的知识点,还能提供一条高效、有序的学习路径。

但知道是一回事,做又是另一回事,初学者最常遇到的问题主要是理论知识缺乏、资源和工具的限制、模型理解和调试的复杂性,在这基础上,找到高质量的学习资源,不浪费时间、不走弯路,又是重中之重。

AI大模型入门到实战的视频教程+项目包

看视频学习是一种高效、直观、灵活且富有吸引力的学习方式,可以更直观地展示过程,能有效提升学习兴趣和理解力,是现在获取知识的重要途径

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

海量AI大模型必读的经典书籍(PDF)

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

600+AI大模型报告(实时更新)

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

AI大模型面试真题+答案解析

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献123条内容

已为社区贡献123条内容

所有评论(0)