AI通识整理

本文系统介绍了人工智能(AI)及其核心技术机器学习的知识框架。AI发展依赖数据、算法和算力三大要素,主要分支包括计算机视觉、自然语言处理和机器人技术。机器学习作为AI实现方式,其流程涵盖数据收集、预处理、模型训练与评估等关键环节。文章详细解析了计算机视觉的三大任务(分类、检测、分割)及图像处理方法,并介绍了数据归一化的多种技术(如Softmax、Min-Max、Z-score等)。同时阐述了欠拟合

一、人工智能

1.发展三要素

数据:用于训练AI

算法:用于提升效率和准确性

算力:用于提升速度

2.人工智能、机器学习、深度学习

关系:机器学习是人工智能的一个实现方式

深度学习是机器学习的一个方法发展而来

3.人工智能的主要分支

感知、认知与行动是人工智能的三个关键能力:

a.计算机视觉(CV):图像采集、图像处理、图像提取、图像推理、图像生成。

b.自然语言处理(NLP)/语音识别:让计算机处理、理解、生成文本的技术,语音处理部分主要包含语音识别和语音合成。

c.机器人(robot):研究机器人的设计、制造、运作和应用,以及控制他们的计算机系统、传感反馈和信息处理。

二、机器学习

1.机器学习定义

机器学习是研究如何让计算机可以像人一样进行学习的技术、方法和理论,也就是像人可以从历史经验中,获取新的知识和技能。理论一点说就是让计算机对大量历史数据进行分析,提取数据中的规律,进而利用规律对未知数据进行推断。

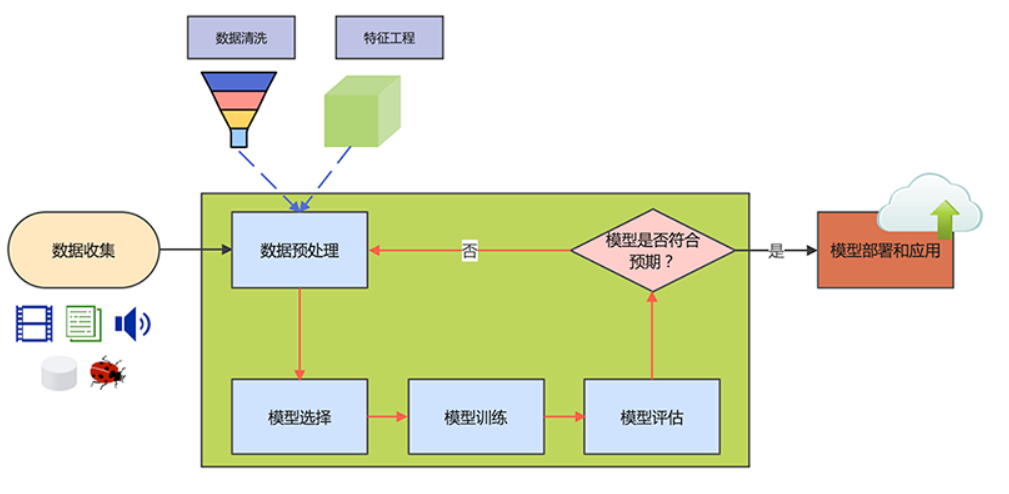

2.机器学习主要流程

1)数据收集:收集并整理有关问题的数据,例如:图像、文本、表格等;

2)数据预处理:对数据进行清洗、归一化、特征提取等操作,以便后续建模和分析。

3)模型选择:选择适合问题的模型,线性回归、决策树、神经网络等。

4)模型训练:使用已有预处理好的数据进行模型训练,使得模型学习数据之间的关系。

5)模型评估:使用测试数据集对模型进行评估,以衡量模型的性能和准确性。

6)模型优化:根据模型评估结果对模型进行优化,例如:调整模型超参、增加训练数据、改变网络结构等。

7)模型部署和应用:将训练好的模型部署为实例,应用到实际问题中,例如:图像分类、文本分类、预测等。

3.机器学习算法分类

4.欠拟合和过拟合

对于模型预测的表现结果主要分为三类:

1)欠拟合:模型学习的过于粗糙,未学习到训练样本中的特征,导致准确性的降低。

2)过拟合:机器学习模型在训练样本中表现得过于优越,学习到了一些噪声规律,导致模型泛化能力急剧降低。

3)拟合:模型具备较好的泛化能力以及准确性,能够用于应用方面。

三、编码与运算

在AI领域,无论是计算机视觉还是自然语言处理,均需要将图片或者文字转换成计算机理解的数值使用欧氏距离或余弦相似度进行运算,用于匹配相似度亦或是识别和生成。

详细内容查看NLP整理。

四、计算机视觉

1.三大任务

a.图像分类:是指将图像结构化为某一类别的信息,用于事先确定好的类别来描述图片。

b.目标检测:分类任务关心整体,给出的是整张图片的内容描述,而检测关注特定的物体目标,要求同事获取这一目标的类别信息和位置信息。

c.图像分割:分割是对图像的像素级描述,它赋予每个像素类别(实例)意义,适用于理解要求较高的场景,如无人驾驶中对道路和非道路的分割。

2.图像训练的处理方式

常使用opencv库去处理图像

import cv2

#BGR格式打开图片

image = cv2.imread('path')

1.图像处理

常见图像均为RGB三通道图像(数值为0-255之间的三维数组),目的是减少计算机的运算,通常将三通道图像转换为单通道图像或进行二值化处理。

1)灰度化(单通道)

import cv2

image = cv2.imread('path')

image_gray = cv2.cvtColor(image,cv2.COLOR_RGB2GRAY)2)二值化

选定一个阈值,将大于这个阈值的像素点数值设为255,小于这个阈值的像素点设为0,即变成黑白图片,进一步减少运算。

import cv2

image = cv2.imread('path')

#灰度化

image_gray = cv2.cvtColor(image,cv2.COLOR_RGB2GRAY)

#二值化

retval,image_thr = cv2.threshold(image_gray,128,255,cv2.THRESH_BINARY)详细内容查看计算机视觉整理。

五、数据归一化处理

1.softmax归一化(常用)

Softmax是一种数学函数,通常用于将一组任意实数转换为表示概率分布的实数。其本质上是一种归一化函数,可以将一组任意的实数直转化为在[0,1]之间的概率值,因为softmax将它们转换为0到1之间的值,所以它们可以被解释为概率。如果其中一个输入很小或为负,softmax将其变为小概率,如果输入很大,则将其变为大概率,但它将始终保持在0到1之间。

Softmax是逻辑回归的一种推广,可以用于多分类任务,其公式与逻辑回归的siqmoid函数非常相似。只有当分类是互斥的,才可以在分类器中使用softmax函数,也就是说只能是多元分类(即数据只有一个标签),而不能是多标签分类(即一条数据可能有多个标签)。

许多多层神经网络输出层的最后一层是一个全连接层,输出是一个实数向量,这个向量通常代表了每个类别的得分或置信度。为了将这些得分转换为概率分布,通常会使用softmax函数。因为它将分数转换为规范化的概率分布,可以显示给用户或用作其他系统的输入。

所以通常附加一个softmax函数在神经网络的最后一层之后。

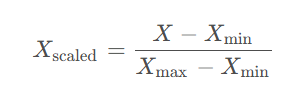

2.Min-Max标准化(常用)

它通过将数据缩放到一个指定的范围(通常是0到1之间),来消除特征之间的量纲差异。

3.平均值标准化

4.Z-score标准化(常用)

z-score标准化是一种将数据转换为均值为0、标准差为1的统计方法,其核心是通过线性变换消除数据的量纲影响,保留原始分布形态

5.均值方差标准化

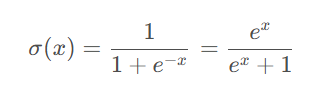

6.sigmoid标准化(常用)

多用于二分类问题

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)