从理论到实践:大语言模型驱动的AI原生应用开发手册

本文旨在帮助开发者理解大语言模型的运作机制,并掌握构建企业级AI应用的核心技能。内容涵盖从基础概念到真实业务场景落地的全链路知识。Token:模型处理文本的基本单位,约等于0.75个英文单词Embedding:将文字转换为数值向量的技术:控制生成结果随机性的超参数大语言模型像具备通用智能的"大脑",需要配合领域知识才能发挥最大价值RAG+微调的组合拳能平衡效果与成本生产部署要考虑可靠性、扩展性和安

从理论到实践:大语言模型驱动的AI原生应用开发手册

关键词:大语言模型、AI原生应用、Prompt工程、微调训练、模型部署、LangChain、RAG

摘要:本文从大语言模型的工作原理出发,通过面包店学徒的成长故事,系统讲解如何构建智能问答、文档分析和业务自动化等AI原生应用。读者将掌握从模型选择、Prompt设计到系统集成的完整开发流程。

背景介绍

目的和范围

本文旨在帮助开发者理解大语言模型的运作机制,并掌握构建企业级AI应用的核心技能。内容涵盖从基础概念到真实业务场景落地的全链路知识。

预期读者

- 具有Python基础的程序员

- 希望将AI能力集成到现有系统的架构师

- 探索智能化转型的企业技术负责人

术语表

核心术语定义

- Token:模型处理文本的基本单位,约等于0.75个英文单词

- Embedding:将文字转换为数值向量的技术

- Temperature:控制生成结果随机性的超参数

相关概念解释

- Few-Shot Learning:通过少量示例教会模型新任务

- Chain-of-Thought:引导模型展示推理过程的Prompt技巧

核心概念与联系

故事引入:面包店学徒的AI之旅

小明在"智慧面包房"当学徒,师傅给了他三个魔法工具:配方大全(预训练模型)、口味调节器(微调技术)、自动裱花机(RAG系统)。通过组合这些工具,小明学会了根据顾客需求快速制作定制蛋糕。

核心概念解释

1. 预训练模型(配方大全)

就像记录了所有已知面包配方的百科全书,模型通过阅读海量文本学会了基本的语言规律。但直接用它做特定任务,就像用通用配方做婚礼蛋糕——能用但不完美。

2. 微调训练(口味调节)

通过给模型"试吃"特定类型的数据样本(如客服对话记录),调整它的"味觉偏好"。就像让学徒反复练习婚礼蛋糕装饰,最终成为该领域的专家。

3. RAG系统(智能原料架)

实时检索相关知识库补充给模型,如同在制作蛋糕时自动调取最新的节日装饰素材。这让模型能回答训练时未见过的新信息。

概念关系图解

开发实战:智能客服系统

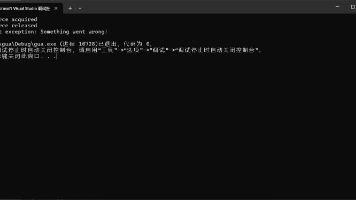

环境搭建

pip install langchain==0.1.4 openai==1.3.6 chromadb==0.4.15

代码实现(LangChain)

from langchain.chains import RetrievalQA

from langchain.embeddings import OpenAIEmbeddings

from langchain.vectorstores import Chroma

# 1. 准备知识库

documents = ["退货政策: 7天无理由退换", "支付方式: 支持支付宝/微信"]

embeddings = OpenAIEmbeddings()

vector_db = Chroma.from_texts(documents, embeddings)

# 2. 构建问答链

qa_chain = RetrievalQA.from_chain_type(

llm=OpenAI(temperature=0.2),

retriever=vector_db.as_retriever(),

chain_type="stuff"

)

# 3. 处理用户咨询

response = qa_chain.run("你们接受信用卡支付吗?")

print(f"客服回答: {response}")

代码解析

- 知识库向量化:将政策文档转换为便于检索的数学表示

- 温度参数:0.2确保回答稳定可靠,适合客服场景

- 检索增强:当用户问题涉及支付方式等具体政策时,自动补充相关知识

进阶技巧:微调实践

LoRA微调示例

from peft import LoraConfig, get_peft_model

# 1. 配置微调参数

lora_config = LoraConfig(

r=8,

target_modules=["query_key_value"],

lora_alpha=32,

lora_dropout=0.1

)

# 2. 创建可微调模型

base_model = AutoModelForCausalLM.from_pretrained("chatglm3-6b")

peft_model = get_peft_model(base_model, lora_config)

# 3. 准备训练数据

train_dataset = [

{"input": "用户: 怎么重置密码?", "output": "请访问设置页面..."},

# 更多客服对话样本...

]

# 4. 开始训练(简化版)

trainer = Trainer(

model=peft_model,

train_dataset=train_dataset,

args=TrainingArguments(per_device_train_batch_size=4)

)

trainer.train()

效果对比

| 问法 | 基础模型回答 | 微调后回答 |

|---|---|---|

| “密码忘了” | 请联系管理员 | 请点击登录页的"忘记密码"链接,按指引操作 |

部署优化:生产级方案

服务化架构

性能优化技巧

- 动态批处理:将多个请求合并计算

- 量化压缩:使用8bit精度减少显存占用

- 异步处理:对实时性要求低的任务采用队列机制

总结与展望

核心收获

- 大语言模型像具备通用智能的"大脑",需要配合领域知识才能发挥最大价值

- RAG+微调的组合拳能平衡效果与成本

- 生产部署要考虑可靠性、扩展性和安全性

未来挑战

- 多模态融合:处理图文混合输入

- 持续学习:模型的知识更新机制

- 可信AI:确保输出结果的准确性和安全性

思考题

- 如何设计一个能理解菜谱并智能调整分量的烹饪助手?

- 当用户询问模型训练时间范围外的时事新闻时,系统应该如何优雅处理?

附录:常见问题

Q: 微调需要多少数据?

A: 使用LoRA等技术时,通常500-1000个高质量样本即可见效

Q: 如何选择模型尺寸?

A: 7B参数模型适合大多数业务场景,13B+模型适合需要深度推理的任务

更多推荐

已为社区贡献183条内容

已为社区贡献183条内容

所有评论(0)